- 投稿日:2020-12-15T23:52:02+09:00

モデル作成後に、サーバ起動&アクセス時に「TypyError:'set' object is not reversible」となる場合の確認箇所について(@Python/jango)

はじめに

今回は、Djangoアプリ作成過程で起きたエラーについて触れていこうと思います。

TypyError:'set' object is not reversibleモデル作成を行った後、サーバー起動しアクセスした際に発生しました。

結論としては、入力ミスでしたので内容を確認していきます。

エラー詳細

models.pyを編集した後に、

以下のコマンドでサーバ起動しアクセス。$ python manage.py runserver原因

アプリケーションフォルダ内の

urls.pyの記述が以下の通りになっていました。。urlpatterns = { path('', views.index, name='index'), }誤:{}

正:[]

まとめ

基礎を確認しながら引き続き頑張ります!

参考にさせていただいた記事の作成者様ありがとうございました。

- 投稿日:2020-12-15T23:47:30+09:00

潮が気になるすべてのvimmerへ

はじめに

第二のドワンゴ Advent Calendar 2020 16日目の記事です。

前日の記事は、2020 年の Ebiten でした。全く関係ありませんが、私は海老天が大好きなので、Ebiten も応援しています。さて、表題ですが、

潮で画像検索するとかんむすがでてきますが、もちろん彼女のことではありません。潮を辞書で引くと、

- 月や太陽の引力で海水が満ち引きする現象。

- ある事をするのに適した時。よいころあい。潮時。

とあります。

ここでは、1の意味を指します。

つまり潮汐のことです。

潮汐は非常に重要な自然現象で、潮汐によって船が出港・帰港できなかったり、魚の活性が変わることにより漁獲量や釣果にも影響を与えます。

筆者もvimで釣りイベントの企画を書いているときに潮汐情報を参照したいことがありましたが、Webで潮汐情報を参照するのが面倒臭いことがしばしばありました。

というわけで、vimから直接潮汐情報を参照できると便利じゃね?ということで、vimプラグインを作ることにしました。

潮汐情報を取得する

前述したとおり、潮汐情報は経済や安全に大きな影響を与えるため、日本では気象庁が 潮位表 で潮汐情報を公開しています。

過去の潮位と未来の潮位の予測を 潮汐・海面水位に関する診断表、データ から参照することが出来ます。

各地点の潮汐情報は、潮位表(PDF版・テキストデータ版)フォーマットにおいてPDFとテキストデータで公開しており、テキストデータについては、

https://www.data.jma.go.jp/gmd/kaiyou/data/db/tide/suisan/txt/{西暦4桁}/{地点記号}.txtという形式で参照することが出来ます。地名と地点コードの対応表は、潮位表掲載地点一覧表 から参照することが出来ます。

例えば、2020年の川崎(地点コード:

KW)の潮位表は https://www.data.jma.go.jp/gmd/kaiyou/data/db/tide/suisan/txt/2020/KW.txt から参照することが出来ます。潮位表フォーマット

潮位表フォーマットは潮位表(PDF版・テキストデータ版)フォーマットで公開されており、以下のような仕様となっています。

- テキストファイルの改行コードは

LF- 毎時潮位データ

- 1-72カラム

- 3桁×24時間(0時から23時)

- 年月日

- 73-78カラム

- 2桁×3

- 地点記号

- 78-80カラム

- 2桁英数字記号

- 満潮時刻・潮位

- 81-108カラム

- 時刻4桁(時分)、潮位3桁(cm)

- 干潮時刻・潮位

- 109-136カラム

- 時刻4桁(時分)、潮位3桁(cm)

- 満(干)潮が予測されない場合、満(干)潮時刻を「9999」、潮位を「999」とする

例えば以下の潮位表データは

65 47 39 44 61 8611313715315915414212711210310110812113514614914212710620 1 1KW 9 3159194914999999999999999 2 7 39144210199999999999999

01:00時の潮位は47cm- 観測地点は川崎(KW)

- 満潮時刻

09:03で 潮位は159cm19:49で 潮位は `149cm- 干潮時刻

02:07で 潮位は39cm14:42で 潮位は101cmと読み取ることが出来ます。

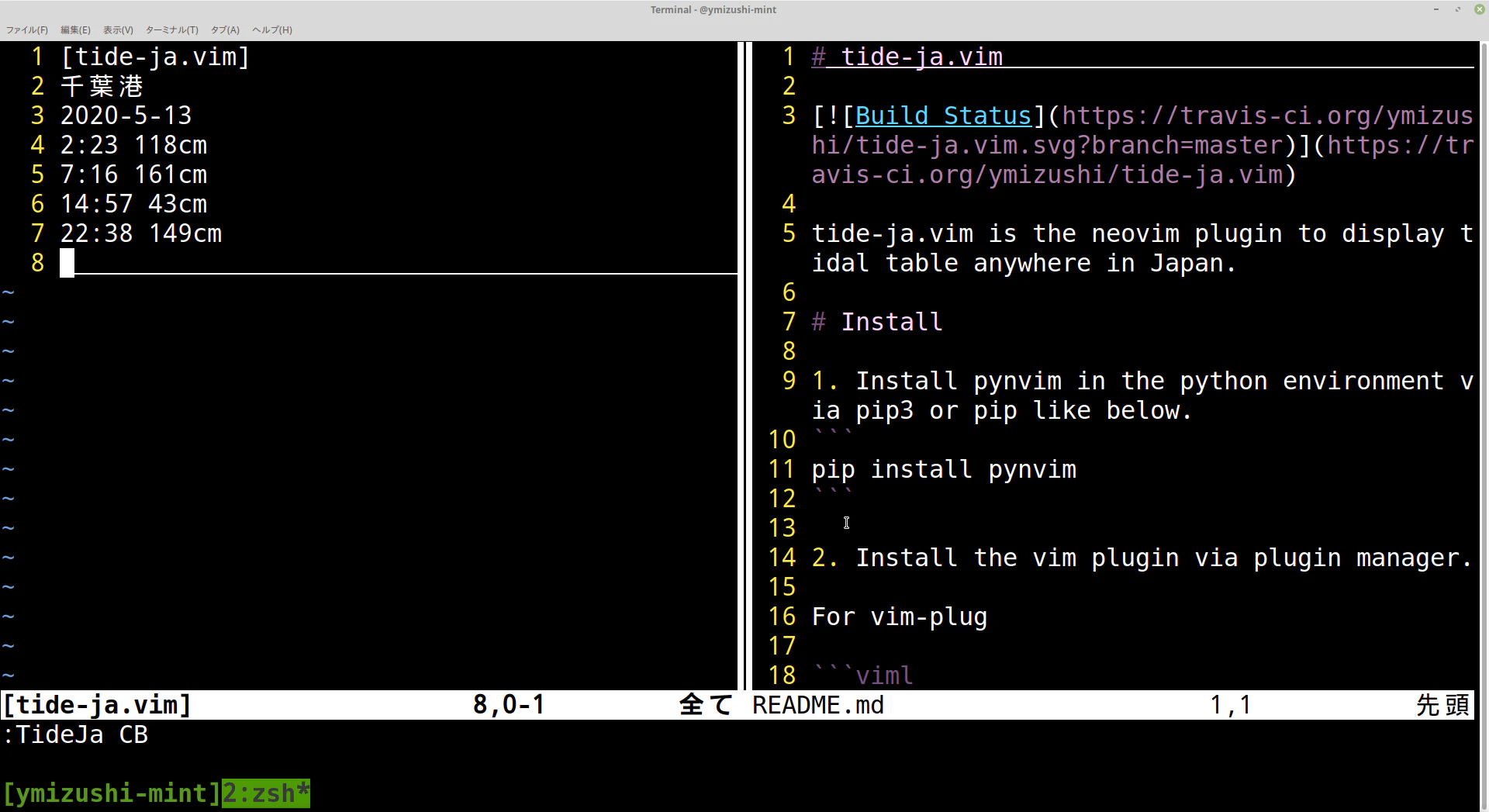

neovimプラグイン

上述のように、潮位表フォーマットの各データは固定長であるため、各データをリーダーから順番に読み込めばいけばいいだけなので、パース処理はとてもシンプルに実装できそうです。

また、vimプラグインとして潮汐情報を取得することにしましたが、vimプラグインからスクレイピングないしはプラグイン側で潮位表データベースを持つことで、潮汐データにアクセスできそうです。

今回はネットワークが使えないところでも動作させたかった事、潮位表データベースをvimプラグイン側で持っても大した容量にはならないので、vimプラグイン側で潮位表データベースを持つ仕様にしました。

そのため、スクレイピングによる潮位表データベース作成バッチを年1回ほど回し、リポジトリに突っ込む実装にしました。

また、あまりVimScriptを書きたくなかったこと、筆者がneovimに完全移行したこと、neovimはPythonのリモートプラグインが書きやすいことから、今回は pynvim を使って、プラグインを書くことにしました。

pynvim では Pythonのデコレータを使用することで簡単にリモートプラグインの内部実装を記述することが出来、また pynvim から簡単にneovimのコマンドが呼び出せるため、非常にneovim プラグインが書きやすいです。

以上の仕様と実装を決めて作ったのが tide-ja.vim です。

https://github.com/ymizushi/tide-ja.vim

インストール方法や使用方法、表示など詳しい情報は、README.md を参照してください。

実際に使っている感想としては、インターネットにアクセスせずに、簡単に目的の地点の潮汐情報を取得できるので、重宝しています。

潮汐情報が気になる人は、船乗りだったり釣り人だったりと、限られるとは思いますが、vimmerで潮汐情報が気になる人は使ってみてはいかがでしょうか。ちなみに、私は休日は ヤマハシースタイル で ボートを借りてタイラバ1、オカッパリ2ではイカ・タコ釣りに興じることが多いです。

釣り好きな方の連絡お待ちしております。

まとめ

- 潮汐情報は気象庁公式ウェブサイトから取得できる

- ある地点の毎時潮位、満潮・干潮の時刻とその時の潮位ががPDF・テキストフォーマットで取得できる

- テキストフォーマットはシンプルなフォーマットなので簡単にパース出来る

- neovim, pynvim を使うと簡単にneovimのリモートプラグインを作ることが出来る

- 釣り好きなかたの連絡をお待ちしております

明日の記事は、ytanaka さんです。よろしくお願いします。

- 投稿日:2020-12-15T23:31:57+09:00

unable to import 'google.cloud'pylint(import-error)でPythonのimport文が認識されないときの対処方法

※この記事は自身のブログからの転載です。

unable to import 'google.cloud'pylint(import-error)でPythonのimport文が認識されないときの対処方法 | outputableVSCodeでPythonを記述しているとpipのライブラリにあるにもかかわらずimport-errorがでていたので、修正してみた。

環境

virtualenvwrapperでPython仮想環境を作るで導入した仮想環境内のpipで「google-cloud-datastore」をインストールしていたが、VSCodeで正しく認識されていない。

VSCodeのターミナルを起動して

$ workon [該当の仮想環境名]としてライブラリのある環境に切り替えるも、「from .. import ...」の部分が赤波線のまま。

settings.jsonを開く

以下の画面から「settings.json」を開き編集しにいく。

File -> Preferences -> Settings

もしくは

「 ctrl + , 」で設定を開き、「Python > Auto Complete: Extra Paths」の欄にある「Edit in settings.json」を開く。

settings.jsonに追記

まずpipでライブラリを入れている仮想環境にログインし、pythonインタプリタの場所を調べる。

$ workon [仮想環境名] $ which python控えたpythonインタプリタのパスを以下の要素を追加し、保存する(ctrl + s)。

{ "workbench.startupEditor": "newUntitledFile", "git.autofetch": true, "emmet.extensionsPath": "", "emmet.variables": { "lang": "ja", "charset": "UTF-8" }, "editor.snippetSuggestions": "top", "editor.tabSize": 2, "go.useLanguageServer": true, "python.autoComplete.extraPaths": [ ], "python.pythonPath": "/home/[ubuntuユーザー名]/.virtualenvs/[仮想環境名]/bin/python" }無事に解消できた!

最後に

VSCodeが見やすいし使いやすいので利用しているが、やはり不正な文法エラー表示は解消できてよかった。

今後の開発が捗りそう。

今回はこのへんでおしまい。

- 投稿日:2020-12-15T23:31:57+09:00

[ VSCode ] unable to import 'google.cloud'pylint(import-error)でPythonのimport文が認識されないときの対処方法

※この記事は自身のブログからの転載です。

[ VSCode ] unable to import 'google.cloud'pylint(import-error)でPythonのimport文が認識されないときの対処方法 | outputableVSCodeでPythonを記述しているとpipのライブラリにあるにもかかわらずimport-errorがでていたので、修正してみた。

環境

virtualenvwrapperでPython仮想環境を作るで導入した仮想環境内のpipで「google-cloud-datastore」をインストールしていたが、VSCodeで正しく認識されていない。

VSCodeのターミナルを起動して

$ workon [該当の仮想環境名]としてライブラリのある環境に切り替えるも、「from .. import ...」の部分が赤波線のまま。

settings.jsonを開く

以下の画面から「settings.json」を開き編集しにいく。

File -> Preferences -> Settings

もしくは

「 ctrl + , 」で設定を開き、「Python > Auto Complete: Extra Paths」の欄にある「Edit in settings.json」を開く。

settings.jsonに追記

まずpipでライブラリを入れている仮想環境にログインし、pythonインタプリタの場所を調べる。

$ workon [仮想環境名] $ which python控えたpythonインタプリタのパスを以下の要素を追加し、保存する(ctrl + s)。

{ "workbench.startupEditor": "newUntitledFile", "git.autofetch": true, "emmet.extensionsPath": "", "emmet.variables": { "lang": "ja", "charset": "UTF-8" }, "editor.snippetSuggestions": "top", "editor.tabSize": 2, "go.useLanguageServer": true, "python.autoComplete.extraPaths": [ ], "python.pythonPath": "/home/[ubuntuユーザー名]/.virtualenvs/[仮想環境名]/bin/python" }無事に解消できた!

最後に

VSCodeが見やすいし使いやすいので利用しているが、やはり不正な文法エラー表示は解消できてよかった。

今後の開発が捗りそう。

今回はこのへんでおしまい。

- 投稿日:2020-12-15T23:12:15+09:00

分散処理を民主化するRay

イントロ

日立製作所 研究開発グループの中田です。普段、エッジコンピューティングや分散システムの研究開発、またシステムアーキテクトをやっています。

公私ともにQiitaは初投稿です。今回は、Rayを紹介します。

Rayは、分散処理を含むアプリを開発するためのライブラリおよび実行環境です。まだ日本では情報が少ないのですが、海外では有名企業や大学がこぞって活用しており、かなりホットなライブラリだと思います。今年2020年10月1日にバージョン1.0がリリースされました。また同じタイミングにRay Summitが開催され、50本程のセッションで多数の活用事例が紹介されました。

Rayは、通常の手続き型言語を容易に分散処理化できるものであり、データ分析やエッジ/IoTの分野で有用に思えるので、日本でも広まって欲しいと思っている次第です。

本記事では、そもそもここでの分散処理とは何か、から始めて、使い方や特徴と、Ray Summitで紹介された活用事例をまとめます。Let's enjoy distributed computing!

(環境:Python3.8、ray1.0.1-post1)

Rayとは

Rayは、分散処理を簡単に記述するためのPython/Javaのライブラリ・処理基盤です。Rayを使うことで、あたかもローカルで動くような見慣れたプログラムを、複数のスレッド、複数のコア、複数のサーバ、複数のクラウドにまたがって実行することができます。

(Google検索では、"ray distributed"などと検索するとトップに出ます)

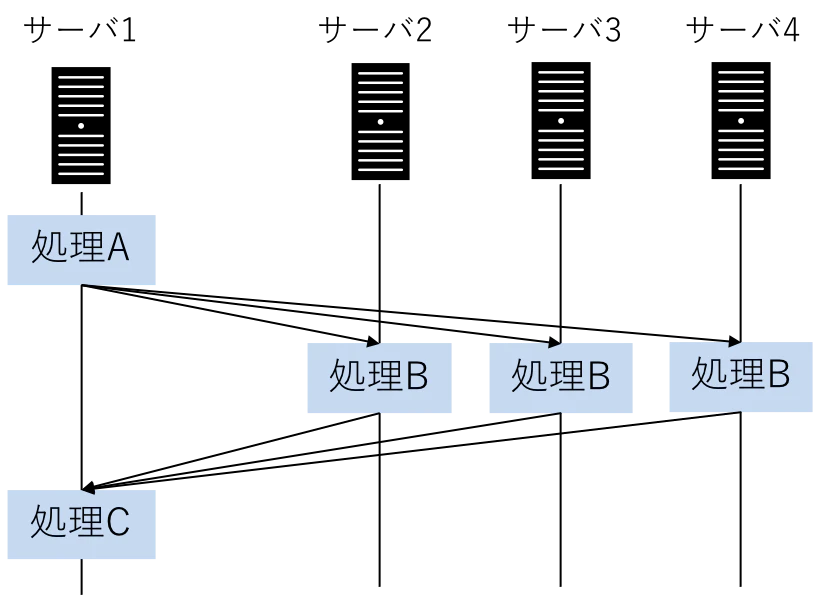

Rayが対象とする分散処理

まず、ここでの分散処理のイメージを合わせておきましょう。

Rayは、一つのアプリケーションの中において、一部の処理を、別の場所(スレッド、コア、サーバ、クラウド)で動かすような、アプリケーションアーキテクチャとしての分散処理を開発するためのものです。

例えば、このような処理です。

上は、主にスケールアウトのために行う分散処理です。例えば、MapReduceが含まれます。処理を並列に実行するため、分散"並列"処理と言われたりします。

他にも、このような処理もRayの範疇です。

これは、一つの処理の流れではあるものの、処理をする場所が処理ごとに異なっているケースです。例えば、オンプレの大量データをクラウドに送信したり保管するコストを抑えるために、オンプレである程度のデータ処理を行い、結果だけクラウドのシステムに持っていく、というイメージです。

「アクターモデル」と呼ばれるアーキテクチャもRayで容易に実装できます。

アクターモデルは、非同期分散処理を記述するためのアーキテクチャパラダイムの一つです。アクターは、特定の責務を持ったオブジェクト指向のオブジェクトのようなもので、他のアクターから生成されたり、常駐プロセスのように稼動させたりできます。アクターは互いにメッセージを投げ合ってリアクティブに反応します(メッセージの内容や型に応じた処理を実行します)。その処理の連携(連鎖)によってアプリケーションの機能が実現されます。

アクターは、状態をインメモリに持つ常駐プロセスとして実現できるため、ある意味で、DDD(ドメイン駆動設計)で言うドメインオブジェクトのマテリアライズドビューのようなものも実現できます。これを応用し、エッジコンピューティングでは、エッジデバイスの状態を反映するDigital Twinをアクターで表現することが考えられたりします(ご参考1, ご参考2、ご参考3)。

3つ例を挙げましたが、総じて、ここでの分散処理は、一つのアプリケーションの中の話です。コンテナ技術も分散処理ですが、一つのアプリを複数稼動させるシステムレベルのアーキテクチャであり、Rayとはレイヤーが違います。

一つのコンテキスト(関心事の範囲)の中に、分散処理を入れたい場合は、分散処理のためにアプリを分割したり、ドメインロジックを記述すべきところに分散処理用のコードを入れたくはないため、Rayのようなライブラリ・実行環境をうまく使い、システムの可読性・メンテナンス性を向上させるのが良いでしょう。

Rayの基礎的な使い方

Rayを使えば、分散処理がローカルで実行されるコードとあまり変わらずに記述できます。

まず、並列処理を行う一般的なPythonスクリプトを見てみましょう。

from multiprocessing import Pool import time def waiting(core_id): time.sleep(core_id) return core_id if __name__ == "__main__": CORE_NUM = 4 p = Pool(CORE_NUM) results = [p.apply_async(waiting, args=[x]) for x in range(CORE_NUM)] print([x.get() for x in results])4つのコアに、1~4秒待つ処理を実行していますが、

x.getで各処理が終わるのを待っています。並列で行っているので、1+2+3+4=10秒待つことはなく、4秒だけ待てば結果が返ってきます。この処理をRayを使うと、以下のように記述できます。

import ray import time ray.init(num_cpus=4) @ray.remote def waiting(id): time.sleep(id) return id if __name__ == "__main__": print(ray.get([waiting.remote(x) for x in range(4)]))

@ray.remoteが付いた関数が、__main__を実行するコアとは別のコアで実行されます。先ほどと似てはいますが、違いは、

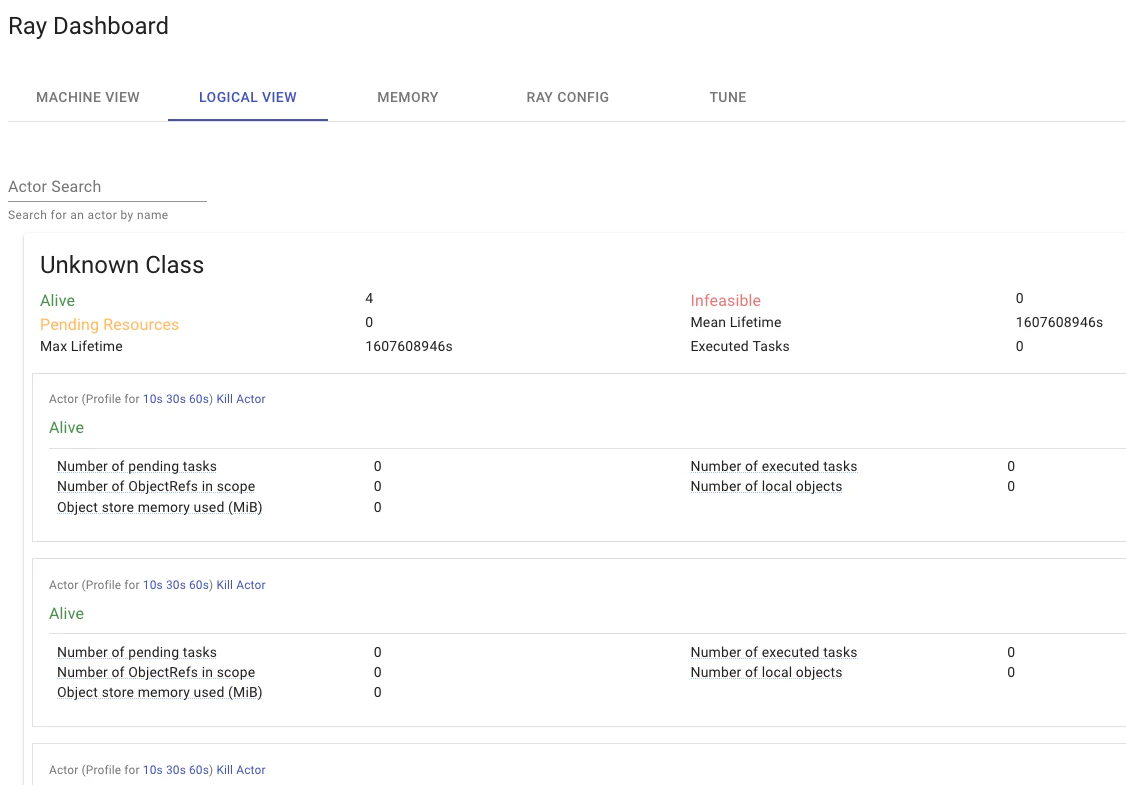

p = Pool()がなくなり、代わりにray.init()が追加されたことです。これが何を意味するのかと言うと、プロセスプールを開発者が管理する必要がなくなり、Rayに任せることになります。つまり、どこに処理を割り振るか、各プロセスのメモリの管理など、分散処理における抽象度の低い面倒なことを、Rayが引き受ける構造になったわけです。そのため、開発者は、以前のコードよりも、ドメインロジックに集中できます。アクターモデルの処理は、以下のように記述できます。

import ray import time ray.init() @ray.remote class Counter(object): def __init__(self): self.n = 0 def increment(self): self.n += 1 def read(self): return self.n if __name__ == "__main__": counters = [Counter.remote() for i in range(4)] [c.increment.remote() for c in counters] futures = [c.read.remote() for c in counters] print(ray.get(futures)) time.sleep(60)先程は関数に

@ray.remoteが付いていたのが、クラスに付きます。この@ray.remoteが付いたクラスを、データと振る舞いを持つ常駐プロセスとして機能することができます。こちらも、プロセスの管理がRayに任されているため、開発者は

Counterオブジェクトの処理を指示するだけで、Rayが良きに計らってどこかで処理を実行します。Rayがプロセスの管理を行うため、プロセスのモニタリングも、Rayが機能を提供しています。

上記のアクターモデルの処理が終わる前に(

time.sleep(60)が終わる前に)、http://127.0.0.1:8265にアクセスしましょう。そうすると、Rayのダッシュボードが閲覧できます。Rayの位置付け

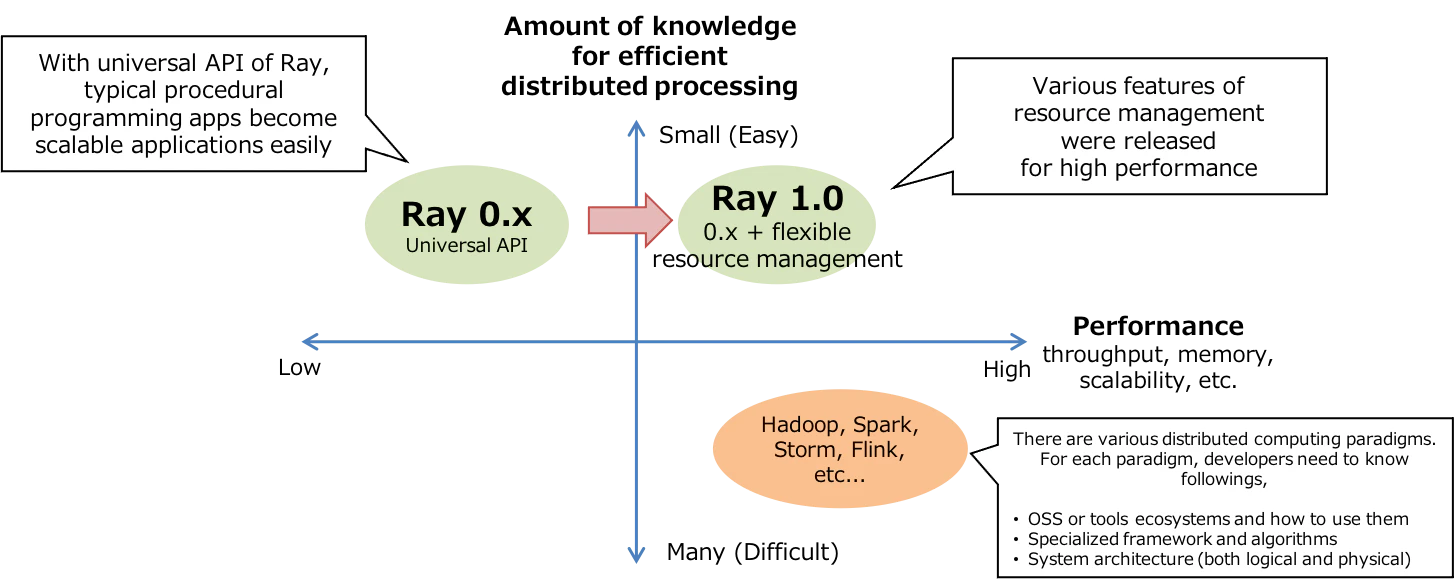

コンピュータサイエンスの世界で、分散処理は長い歴史があり、Hadoop, Spark, Stormなどなど、様々な分散基盤が存在しています。これらに対するRayの位置付けは、Rayの開発者であるSchafhalter氏の講演の以下の言葉にあると思います。

Modern scalable AI applications need support for distributed training, distributed reinforcement learning, model serving, hyperparameter search, data processing, and streaming. All these problems are right now siloed into specialized distributed systems.

(中略)

Instead of having a separate distributed computing framework that solves some specific part of the machine learning lifecycle, we created Ray, a high performance distributed computing system, and built libraries on top of Ray to support all these types of workflows. Using this architecture, we can avoid overheads and leverage performance of building on one system.以下、和訳です(一部、私の理解の範囲で補足しています)。

最新のスケーラブルなAIアプリケーションには、分散トレーニング、分散強化学習、モデルサービング、ハイパーパラメータ検索、データ処理、ストリーミングのサポートが必要です。これらの問題はすべて、現在、特殊な分散システムにサイロ化されています。

(中略)

機械学習での業務におけるいくつかの特定の部分を解決する個別の分散コンピューティングフレームワークを用いる代わりに、我々はRayを作りました。Rayは、人のあらゆるタイプの作業を支える、高性能な分散コンピューティングシステム、及び、その上で動くように作られたライブラリです。このアーキテクチャを用いて、我々は(個々のフレームワークを繋ぎ合わせて使う)負担を回避し、一つのシステムでの効率的な開発を享受できるのです。引用元:InfoQ Scaling Emerging AI Applications with Ray

下記は私が想像する、Rayの立ち位置のイメージです。

横軸は、分散処理のパフォーマンス、縦軸は開発の容易さです。

データ処理と言っても、バッチ、ストリーム、グラフ、強化学習、ディープラーニング、などなど、とても多様なパラダイムが存在しています。従来のビッグデータ処理のプラットフォームやOSSは、それぞれのパラダイムごとに存在していました。それらのプラットフォームやOSSは、パフォーマンスを常に追求し、そのパラダイムに最適なフレームワーク、分散ロジックが出来上がりました。

しかし、このDX時代において、データを扱うのは、データエンジニアだけではなく、むしろサービス開発者、ドメインエキスパートだったりもします。そういった職種の人々が、やりたいビジネス、改善活動があったときに、一から処理パラダイムについて学習するのは酷です。

これに対して、逆のアプローチなのがRayだと思っています。極端に言うと、Rayは、通常の手続き型言語のプログラムに対し、関数に

@ray.remoteをつけるだけなので、遥かに開発難易度が下がります。当然、関数やアクターの分散という、プリミティブな部分(Universal API)のみが範疇なので、複雑で大規模なデータ処理システムをRayで開発したとき、その開発者の設計次第で、パフォーマンスが大きく変わります。Rayは1.0になり、メモリ管理や、クラスタ環境でのスケジューリングなど、多くのパフォーマンスに関する機能が追加されました。そのため、依然としてRayを使った開発者依存はあるとしても、より性能の良い分散処理アプリケーションを開発できるように、進化しているイメージです。

こういった、パフォーマンスと開発容易性の両立が、Rayの方向性なのかと感じています。

Rayクラスタの構成

分散処理の醍醐味である、複数サーバでのクラスタ構築と分散処理を体験してみましょう。

アーキテクチャ

まず、Rayが稼動するクラスタのアーキテクチャを説明します。

(Ray1.0 White Paperから引用)

Rayが稼動する環境の一単位は、ノード(node)と呼ばれます。各ノード内のWorkerは、アプリの処理を実行するプロセスを指しています。

また、全ノードに、Rayletというコンポーネントがあります。RayletはRayにおけるミドルウェアで、いわゆるコントロールプレーンと呼ばれるような、処理のスケジューリングや各プロセスが使うオブジェクトのメモリ管理などを行ってくれるものです(KubernetesでいうKubeletと同じ立ち位置であり、英語ではよくこういうコンポーネントを〇〇letと呼びます)。

Rayletには、スケジューラと、オブジェクトストアの、2つのスレッドがあります。スケジューラは、リソース(利用できるCPU/GPU、メモリ等々)の状況を共有し合い、アプリで指定した条件に合うノードに分散させたい処理を割り当てます。オブジェクトストアは、分散させたい処理の中で使っている変数を、クラスタ間で共有する場合に用いる共有メモリです。Rayでは、Plasma Object Storeという、現在はApache Arrowの中で開発されている共有メモリオブジェクトストアを利用しています。

クラスタには、ヘッドノード(Head node)とワーカーノード(Worker node)が存在します。ヘッドノードのDriverは、アプリケーションを最初に実行するプロセスのことであり、Pythonであれば、

__main__を実行するプロセスと捉えてください。また、ヘッドノードには、Global Control Store (GCS)があります。GCSは、どこにActorがあるか、など、クラスタの内部管理用のメタデータを管理するデータストアです。これは、基本的に開発者が操作するものではありません。

クラスタの構築

このクラスタ構成を構築する方法は、2通りあります。1つは、ノード構築コマンドを使って手動で構築する方法、もう一方は、Cluster LauncherというRay内のツールを用いる方法です。

まずは、手動でクラスタを構築する方法です。

最初に、ヘッドノードを構築します。やる事は、rayのインストールの他には、コマンド1つだけです。

# ヘッドノード用の環境に入る pip install -U ray ray start --head --port=6379 # ヘッドノードの構築1,2秒後に、以下のような出力が出ます。

Local node IP: xxx.xxx.xxx.xxx 2020-12-13 10:11:48,321 INFO services.py:1090 -- View the Ray dashboard at http://localhost:8265 -------------------- Ray runtime started. -------------------- Next steps To connect to this Ray runtime from another node, run ray start --address='xxx.xxx.xxx.xxx:6379' --redis-password='xxxxxxxxxx' Alternatively, use the following Python code: import ray ray.init(address='auto', _redis_password='xxxxxxxxxx') If connection fails, check your firewall settings and network configuration. To terminate the Ray runtime, run ray stop出力の指示に従って、ワーカーノードを構築します。

# ワーカーノード用の環境に入る pip install -U ray ray start --address='xxx.xxx.xxx.xxx:6379' --redis-password='xxxxxxxxxx'1,2秒後に、以下のような出力が出ます。

Local node IP: xxx.xxx.yyy.yyy -------------------- Ray runtime started. -------------------- To terminate the Ray runtime, run ray stop手動でも特に大変ではありませんが、Cluster Launcherを用いると、もっと容易にクラスタを構築できます。

まず先に以下のような構築するクラスタの内容を記載した設定ファイルを用意し、

ray up <ファイルパス>をするだけです(AWSの場合は、事前にAWSアカウントの用意、boto3のインストール、クレデンシャルの設定が必要です)。cluster_name: basic-ray max_workers: 0 # this means zero workers provider: type: aws region: ap-northeast-1 availability_zone: ap-northeast-1 auth: ssh_user: ubuntu setup_commands: - pip install ray[all]立ち上がったクラスタに、アプリケーションをアップロードし実行する場合は、

ray attach、ray rsync-up、ray execコマンドを実行します。AWS以外にも、他のクラウドベンダや、自身で用意したKubernetesクラスタにも構築できます。その際の設定ファイルなどは、こちらのCluster Launcherのドキュメントを参照してください。

クラスタ上でアプリを実行

では、最後にクラスタ上で分散処理を実行してみましょう。以下のスクリプトを、クラスタ内のどこか(ワーカーノードでもOK)に置いて、実行しましょう(先程の

ray attach、ray rsync-up、ray execコマンドを利用しても良いです)。import ray import ray._private import time ray.init(address="auto") @ray.remote def f(): time.sleep(0.01) return ray._private.services.get_node_ip_address() # Get a list of the IP addresses of the nodes that have joined the cluster. print(set(ray.get([f.remote() for _ in range(1000)])))このスクリプトでは、

@ray.remoteの付いた関数が、その関数の処理を実行したノードのIPアドレスを返すため、1000回の処理の実行場所のIPアドレスのリストが生成され、それが集合(set)になります。その結果、クラスタに含まれるノードの数が1000未満の場合は、Rayが処理を均等に割り振るため、ノードのIPのリストが出力されるはずです。ちなみに、ray 1.0.0より前は、ノードのIPアドレスを出力する機能が、

ray以下にパブリックな機能として存在していたのですが、ray 1.0.0以降は、ray._privateに移動し、プライベート化されているので、上記スクリプトは推奨されていない処理だと思います。活用事例

最後に、Rayで何を作れそうかのイメージを掴んで頂くために、Ray Summitの情報から、活用事例をピックアップします。

(ほぼ全てのセッションは、Youtubeでも公開されています。こちらのRay Summitのスケジュール表からたどれます。)

Rayを用いて金融サービスの開発プラットフォームを開発 (Ant Group)

https://www.youtube.com/watch?v=Wwv9YNlXx0Q&feature=youtu.be

Ant Groupは中国のアリババのグループ企業であり、Alipayを運用する企業です。Ant Groupのユーザーは、13億人以上おり、大量のデータをサービス開発に活用しています。

ただし、様々な新しいサービス・機能を開発する上で、データの処理は画一的であるわけがなく、ストリーミング処理、バッチ処理、グラフ理論系処理、OLAP、ディープラーニングなどなど、様々です。そのため、従来は、それぞれの処理パラダイムごとに言語、OSS、システムが異なり、サービスの開発者が勉強することが膨らみました。

そこで、Rayのクラスタを共通基盤として、Rayが提供するAPIを用いて、先程の処理パラダイムを実現するフレームワークを開発し、自社のサービス開発者に開発プラットフォームを提供しています。これにより、多様な処理パラダイムを有するデータ分析基盤においても、下回りにRayに集約して依存するOSSなどを減らし、学習コストの低減、プラットフォームの進化可能性の向上を実現させています。

また、Microsoftも、機械に動作を教える強化学習サービスをRayを用いて構築し、サービス開発を行う顧客へ提供しているそうです。

https://www.youtube.com/watch?time_continue=329&v=yRowxgcrt_Q&feature=emb_logo

プロトタイプのスケールアウトに向けたライブラリ拡張 (Intel)

https://www.youtube.com/watch?v=Wwv9YNlXx0Q&feature=youtu.be

データ分析を行うほぼ全ての人は、Pandasというライブラリを利用していると思います。しかしPandasは分散処理を意識したスケーラブルなツールではありません。そのため、ローカル環境で何らかのプロトタイプを開発しても、大量データがある本番システムに適用しようとした場合、Sparkを利用するコードなどに書き直してシステム化しないといけませんでした。

そこで、Intelは、RayでPandasのDataFrameを並列に処理する、MODINという新たなライブラリを開発しています。

従来、

import pandas as pdと書いていたところを、import modin.pandas as pdとし、数行のクラスタ構成の設定をするコードを追記するだけで、Pandasの処理がスケールアウトするようになるそうです。この事例はライブラリ開発でしたが、皆さんもPoCやプロトタイプ開発にRayを使えば、本番移行する際に、少ないコード改変でスケールさせられます。

興味を持たれた方へ

Rayは、関数の分散、アクターの分散、という分散処理に必要最小限のコアAPIを用意し、プロセスの管理等、面倒なところを管理してくれます。そのため開発者は、多くの開発者が慣れ親しんだ手続き型言語のイメージのまま、ドメインロジックにフォーカスしつつ、分散処理を含むスケーラブルなアプリを開発できます。

ただし、最後に注意点も書いて終わりにしたいと思います。

もし本格的にRayを本番システムに活用しようとする場合は、Rayの内部ロジックをしっかり理解するべきに思います。それは、Rayの制限という意味ではなく、分散処理自体が、インフラやアプリの障害も考慮した高信頼なシステムを作るためには、インフラ、ミドルウェア、アプリの様々な仕様を理解しておく必要があるためです。

例えば、共有メモリオブジェクトストレージに保存された変数のライフタイム、AWS LambdaのStep Functionsのような依存関係のある非同期呼び出しにおける処理やアクターの管理、非同期実行中の処理が動くサーバの障害における再実行ロジックなど、今回記載していない、重要な点は多くあります。

今回の記事では、Rayを広めるための入門編ということで(というのは名目であり単に疲れたので)そこまでは説明しませんが、Ray1.0がリリースされた際に公開されたRay 1.0 Architecture Whitepaperに、内部ロジックの詳細が解説されています。比較的、内容は分かりやすいので、本番利用される方は一読することをおすすめします。

- PythonはPython Software Foundationの登録商標です

- KubernetesはLinux Foundationの登録商標です

- Hadoop, Spark, Storm, FlinkはApache Software Foundationの登録商標です

- AlipayはAlibaba Group Holdingの登録商標です

- AWS及びその製品名はAmazon Web Serviceの登録商標です

- YoutubeはGOOGLE LLCの登録商標です

- 投稿日:2020-12-15T23:06:01+09:00

Microsoft Excelのセルの値を取得するPythonスクリプトを作成してみた

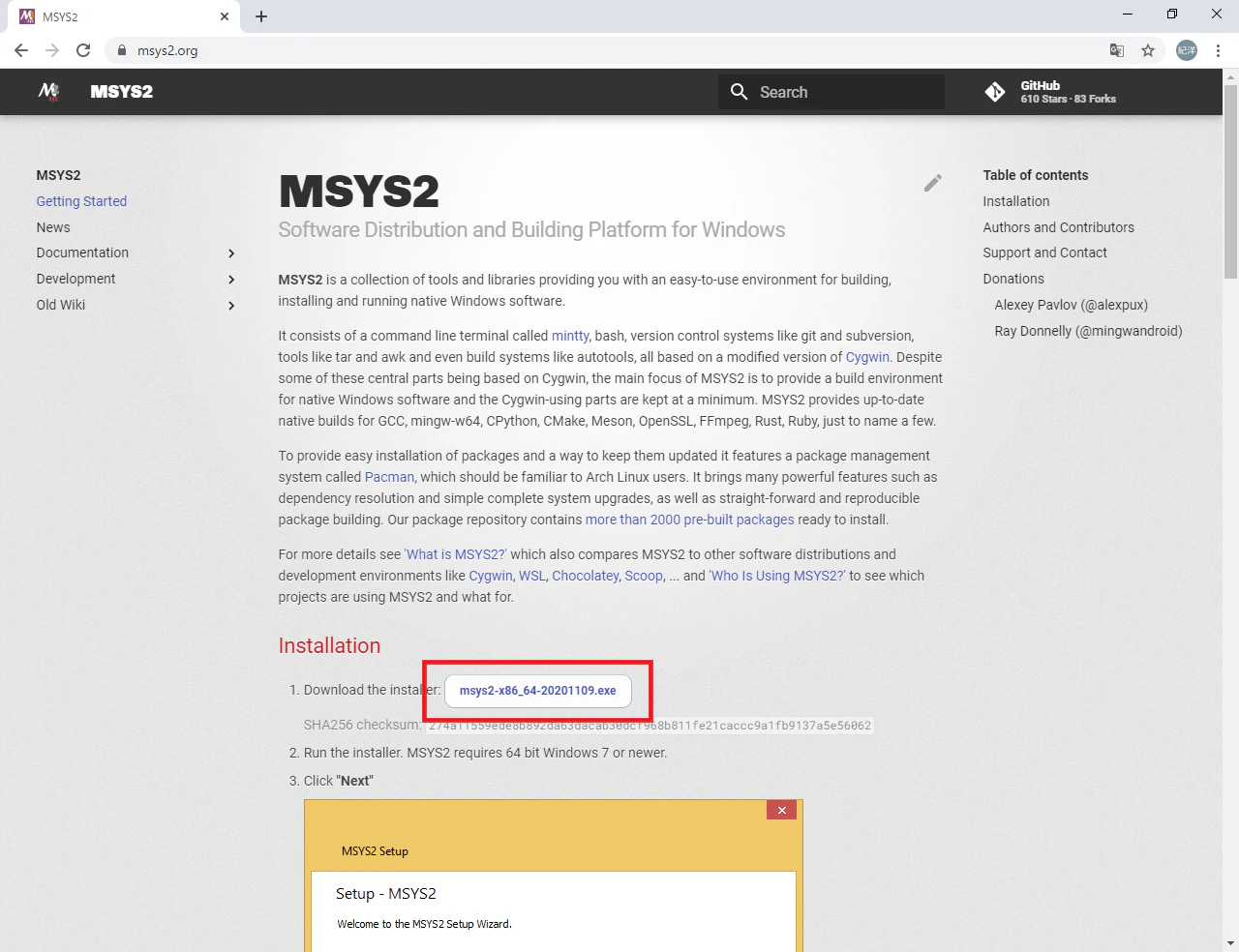

1. MSYS2のインストール

https://www.msys2.org/ からMSYS2の最新版をダウンロードし、Windows 10上にインストールする。

2. Pythonとopenpyxlのインストール

スタートメニュから「SYS2 64bit」-「MSYS2 MinGW 64-bit」を起動し、以下を実行する。

# pacman -Qe # yes | pacman -S mingw-w64-python mingw-w64-python-openpyxl # pacman -Qe3. スクリプトの作成

excellsp.py#!/usr/bin/env python3 import sys import getopt import openpyxl def usage(): print('usage: ' + sys.argv[0] + \ ' [ -h -q quotation -s separator ] workbook worksheet [celladdr...]', \ file=sys.stderr) try: opts,argv = getopt.getopt(sys.argv[1:], "hq:s:") except getopt.GetoptError as err: print(err) usage() sys.exit(1) separator = '\n' quotation = '' for opt,optarg in opts: if opt == "-h": usage() print("Pass2") sys.exit() elif opt == '-q': quotation = optarg elif opt == '-s': separator = optarg else: print("Pass1") usage() sys.exit(1) if len(argv) < 2: usage() sys.exit(1) wb = openpyxl.load_workbook(argv[0]) ws = wb[argv[1]] del argv[:2] separator = separator.replace('\\t', '\t').replace('\\n', '\n') output = '' for arg in argv: value = str(ws[arg].value); if quotation != '': value = quotation + value.replace(quotation, quotation + quotation) + \ quotation; if output != '': output += separator output += value print(output)4. テスト用ブックの作成

Microsoft Excelで以下の内容のシート「Sheet1」を持つブック「Book1.xlsx」を作成する。

A B C D E 1 a1 b1 c1 d1 2 a2 b2 c2 d2 3 a3 b3 c3 d"3 4 a4 b4 c4 d4 5. スクリプトの実行

# chmod a+x excellsp.py # ./excellsp.py -h usage: ./excellsp.py [ -h -q quotation -s separator ] workbook worksheet [celladdr...] # ./excellsp.py Book1.xlsx Sheet1 A1 C2 D3 E4 a1 c2 d"3 e4 # ./excellsp.py -s '\t' Book1.xlsx Sheet1 A1 C2 D3 E4 a1 c2 d"3 e4 # ./excellsp.py -q '"' -s '\t' Book1.xlsx Sheet1 A1 C2 D3 E4 "a1" "c2" "d""3" "e4"

- 投稿日:2020-12-15T22:34:05+09:00

呼び出すごとに1増える関数作りたい!ので作ってみた

test.pydef fueru(): global TanakaAtomicBomb if 'TanakaAtomicBomb' in globals(): TanakaAtomicBomb += 1 return TanakaAtomicBomb else: TanakaAtomicBomb = 0 return TanakaAtomicBomb使い方

下記の通り

print(fueru()) print(fueru()) print(fueru()) print(fueru()) print(fueru()) print(fueru())$ python test.py 0 1 2 3 4 5 6

- 投稿日:2020-12-15T22:27:35+09:00

初めてPythonで動くモノを作ってみた結果(画像認識)

1はじめに

こんにちは、Aidemy研修生のMagicchicです。皆さんはプログラミングというものに対してどのようなイメージを持っていますか?私がプログラミングに触れてから2ヶ月ほど経ちますが難しいという感触は抜けません。しかしそれ以上にエラーを改善して動かすことができると嬉しいです。今回はそんな初学者がpythonを用いて初めて動くモノを作ってみた結果を共有したいと思います。

2画像認識とは

最近よく聞くカメラの顔認証や工場での不良品検知など、画像認識という技術が活躍しています。写真から動物の種類を判定したりできるようにアプリでも似てる芸能人診断みたいなのもあります。こういった、高度な画像認識を実現している技術がCNN(畳み込みニューラルネットワーク)です。畳み込みニューラルネットワーク(Convolution Neural Network)とは、AIが画像分析を行うための学習手法の1つで、一部が見えにくくなっているような画像でも解析することができます。略してCNNとよばれることもあります。

畳み込み層とプーリング層という2つの層を含む構造の順伝播型のネットワークで、特徴として、それぞれの層の間に生物の脳の視覚野に関する脳科学の知見にヒントを得た、「局所受容野」「重み共有」という結合をもっています。

”多層構造”に加え、工夫された2つの隠れ層という”構造”が組み込まれたニューラルネットワークといえます。

分析する画像が入力層に読み込まれた後、このデータをくまなくスキャンし、データの特徴(勾配、凹凸など)を抽出するために使われるのがフィルタです。抽出された特徴データは畳み込み層に送られ、そこで更に特徴の凝縮されたデータが作成されます。

そして、そのCNNを誰もが簡単に利用できるようにしてくれたライブラリが、Kerasです。もし画像認識プログラムを作成するならば、KerasでCNNを作成するのが近道でしょう。

kerasとは

Kerasは,Pythonで書かれた,TensorFlowまたはTheano上で実行可能な高水準のニューラルネットワークライブラリです. Kerasは,迅速な実験を可能にすることに重点を置いて開発されました. 可能な限り遅れなくアイデアから結果に進められることは,良い研究をする上で重要です.(keras公式ドキュメントより)

3導入と手順

今回設定したテーマとして車種の判定をしようと思いました。私は車というものに対して全くの無知です。よく車を見るだけで車種を言い当てられる人を見るとすごいなと思います。対抗するというわけではありませんが機械学習で同じようなことができたらいいなと思いました。対象車種はトヨタの国産高級車から3つピックアップ

大まかな手順は以下の通りです。

1.画像収集

2.データを変換、その後学習データにnpyで保存

3.データを増やす

4.学習モデル、評価関数の構築

5.結果4説明

ここから先は上で示した手順に沿って書きます。

今回はicrawlerを用いて収集しました。pip install icrawlerこれをターミナルで実行してまずはicrawlerをインストールします。

その後テキストエディタにてfrom icrawler.builtin import BingImageCrawler crawler = BingImageCrawler(storage={"root_dir": "toyotacentury"}) crawler.crawl(keyword="toyotacentury", max_num=100) from icrawler.builtin import BingImageCrawler crawler = BingImageCrawler(storage={"root_dir": "toyotacrown"}) crawler.crawl(keyword="toyotacrown", max_num=120) from icrawler.builtin import BingImageCrawler crawler = BingImageCrawler(storage={"root_dir": "toyotamarkx"}) crawler.crawl(keyword="toyotamarkx", max_num=120)

次に集めたデータのうちデータとして使えなさそうなもの(関係のないものやはっきりとしていないもの)を目視で削除した結果それぞれ80枚になりました。それらをnpyで保存します。

from PIL import Image import os, glob import numpy as np import sklearn from sklearn import model_selection classes = ["toyotacentury", "toyotacrown", "toyotamarkx"] num_classes = len(classes) image_size = 100 # 画像の読み込み、numpyの配列に変換 X = [] Y = [] for index, classlabel in enumerate(classes): photos_dir = "./" + classlabel files = glob.glob(photos_dir + "/*.jpg") for i, file in enumerate(files): if i >= 93: break image = Image.open(file) image = image.convert("RGB") image = image.resize((image_size, image_size)) data = np.asarray(image) X.append(data) Y.append(index) #listからnumpyに変換 X = np.array(X) Y = np.array(Y) #データを学習用と評価用に分割する X_train, X_test, y_train, y_test = model_selection.train_test_split(X, Y) xy = (X_train, X_test, y_train, y_test) np.save("./toyotacar.npy", xy)

続いてデータを増やす作業です。現在の枚数では足りないはずなので対象のフォルダ内の画像を増加させます。

import os import glob import numpy as np from keras.preprocessing.image import ImageDataGenerator,load_img, img_to_array, array_to_img # 画像を拡張する関数 def draw_images(generator, x, dir_name, index): save_name = 'extened-' + str(index) g = generator.flow(x, batch_size=1, save_to_dir=output_dir, save_prefix=save_name, save_format='jpeg') # 1つの入力画像から何枚拡張するかを指定(今回は10枚) for i in range(10): bach = g.next() # 出力先フォルダの設定 output_dir = "toyotacenturyzou" if not(os.path.exists(output_dir)): os.mkdir(output_dir) # 拡張する画像読み込み images = glob.glob(os.path.join("toyotacentury", "*.jpg")) # ImageDataGeneratorを定義 datagen = ImageDataGenerator(rotation_range=20, width_shift_range=0, shear_range=0, height_shift_range=0, zoom_range=0, horizontal_flip=True, fill_mode="nearest", channel_shift_range=40) # 画像拡張 for i in range(len(images)): img = load_img(images[i]) img = img.resize((350,300 )) x = img_to_array(img) x = np.expand_dims(x, axis=0) draw_images(datagen, x, output_dir, i) import os import glob import numpy as np from keras.preprocessing.image import ImageDataGenerator,load_img, img_to_array, array_to_img # 画像を拡張する関数 def draw_images(generator, x, dir_name, index): save_name = 'extened-' + str(index) g = generator.flow(x, batch_size=1, save_to_dir=output_dir, save_prefix=save_name, save_format='jpeg') # 1つの入力画像から何枚拡張するかを指定(今回は10枚) for i in range(10): bach = g.next() # 出力先フォルダの設定 output_dir = "toyotacrownzou" if not(os.path.exists(output_dir)): os.mkdir(output_dir) # 拡張する画像読み込み images = glob.glob(os.path.join("toyotacrown", "*.jpg")) # ImageDataGeneratorを定義 datagen = ImageDataGenerator(rotation_range=20, width_shift_range=0, shear_range=0, height_shift_range=0, zoom_range=0, horizontal_flip=True, fill_mode="nearest", channel_shift_range=40) # 画像拡張 for i in range(len(images)): img = load_img(images[i]) img = img.resize((350,300 )) x = img_to_array(img) x = np.expand_dims(x, axis=0) draw_images(datagen, x, output_dir, i) import os import glob import numpy as np from keras.preprocessing.image import ImageDataGenerator,load_img, img_to_array, array_to_img # 画像を拡張する関数 def draw_images(generator, x, dir_name, index): save_name = 'extened-' + str(index) g = generator.flow(x, batch_size=1, save_to_dir=output_dir, save_prefix=save_name, save_format='jpeg') # 1つの入力画像から何枚拡張するかを指定(今回は10枚) for i in range(10): bach = g.next() # 出力先フォルダの設定 output_dir = "toyotamarkxzou" if not(os.path.exists(output_dir)): os.mkdir(output_dir) # 拡張する画像読み込み images = glob.glob(os.path.join("toyotamarkx", "*.jpg")) # ImageDataGeneratorを定義 datagen = ImageDataGenerator(rotation_range=20, width_shift_range=0, shear_range=0, height_shift_range=0, zoom_range=0, horizontal_flip=True, fill_mode="nearest", channel_shift_range=40) # 画像拡張 for i in range(len(images)): img = load_img(images[i]) img = img.resize((350,300 )) x = img_to_array(img) x = np.expand_dims(x, axis=0) draw_images(datagen, x, output_dir, i)この作業により元あった画像数の10倍、800枚まで増加しました。

それでは最後に学習モデル、評価関数の構築に移ります。

最初に注意しておきたい部分としてメイン関数の定義をする際にnp.loadで()内にデータの指定をするとエラーが発生するかも知れません。そこでallow_pickleオプションを指定すると改善されると思います。

以下リンク参照

(https://qiita.com/ytkj/items/ee6e1125476883923db8)from keras.models import Sequential from keras.layers import Conv2D, MaxPooling2D from keras.layers import Activation, Dropout, Flatten, Dense from keras.utils import np_utils import keras import numpy as np from keras.optimizers import RMSprop classes = ["toyotacentury", "toyotacrown", "toyotamarkx"] num_classes = len(classes) image_size = 100 # メイン関数の定義 def main(): X_train, X_test, y_train, y_test = np.load("./toyotacar.npy", allow_pickle=True)#ファイルからデータを配列に読み込む X_train = X_train.astype("float") / 256#データを正規化 X_test = X_test.astype("float") / 256 y_train = np_utils.to_categorical(y_train, num_classes) y_test = np_utils.to_categorical(y_test, num_classes) #トレーニング関数と評価関数の呼び出し model = model_train(X_train, y_train) model_eval(model, X_test, y_test) def model_train(X, y): model = Sequential() model.add(Conv2D(32,(3,3), padding='same',input_shape=X.shape[1:])) model.add(Activation('relu')) model.add(Conv2D(32,(3,3))) model.add(Activation('relu')) model.add(MaxPooling2D(pool_size=(2,2))) model.add(Dropout(0.25)) model.add(Conv2D(64,(2,2), padding='same')) model.add(Activation('relu')) model.add(Conv2D(64,(3,3))) model.add(Activation('relu')) model.add(MaxPooling2D(pool_size=(3,3))) model.add(Dropout(0.25)) model.add(Flatten()) model.add(Dense(512)) model.add(Activation('relu')) model.add(Dropout(0.5)) model.add(Dense(3)) model.add(Activation('softmax')) #最適化の処理 opt = keras.optimizers.RMSprop(lr=0.0001, decay=1e-6) #正解と推定値の誤差が小さくなるようにする model.compile(loss='categorical_crossentropy',optimizer=opt,metrics=['accuracy']) model.fit(X, y, batch_size=20, epochs=75) # モデルの保存 model.save('./toyota_cnn.h5') return model def model_eval(model, X, y): scores = model.evaluate(X, y, verbose=1) print('Test Loss: ', scores[0]) print('Test Accuracy: ', scores[1]) if __name__ == "__main__": main()実行をした際にAttributeErrorが発生するかもしれません(私だけかも知れませんが)、下記のリンクにて原因を詳しく説明していたので添付しておきます。

(https://ja.stackoverflow.com/questions/48286/python%e3%81%a7attributeerror)実行結果は以下のようになりました。

Test Loss: 2.74328875541687 Test Accuracy: 0.48333331942558295結果の考察と今後の展望

今回の実行結果ではaccuracyは50%を下回る正確性を欠いた状況、lossは0から大きくかけ離れた数値になりました。数値上昇のため画像の切り抜きや枚数増加、epoch数を変動させ最適解を見つけたいと思います。

特に「車」というテーマ上、形の大きな枠組みは大して特徴差はありません。accuracyを1.0、lossをoにできる限り近づけた後、画像を受け取り、判定する関数を定義して予測の実行を行いたいと思います。

今後の作成コードの参考予定リンク

(https://qiita.com/kenichiro-yamato/items/b64c70882473904600bf)

参考

(https://qiita.com/kazama0119/items/ede4732d21fe00085eb6)

(https://qiita.com/keimoriyama/items/846a3462a92c8c5661ff)

(https://qiita.com/keimoriyama/items/7b09d7c1797fcee6a2b0)

(https://udemy.benesse.co.jp/data-science/ai/convolution-neural-network.html)

(https://dev.classmethod.jp/articles/introduction-keras-deeplearning/)

- 投稿日:2020-12-15T22:21:25+09:00

iPhoneのスクリーンタイムをデータとしてスプレッドシートに記録してみた

はじめに

スマホ、触りすぎていませんか?

私は隙があればついついスマホでYouTubeやSNSを長々と見てしまいます。YouTubeを始めた芸能人も多く、無限にコンテンツを楽しめてしまいますよね。コロナ渦で自宅にいることが増えたこともあってか、スクリーンタイムを見て唖然としてしまう日も少なくありません...。

そんな中、スクリーンタイムをSNSに投稿して勉強のモチベーションにしている受験生を見て、こういう使い方もあるんだなぁと感心しました。

とはいえ、わざわざ設定画面を開いてスクショを撮り、それをトリミングしてSNSに手動で投稿するのは少々面倒に感じます()幸いなことに、macからも同じApple IDで登録されてデバイスのスクリーンタイムを見ることができます。また、macにはAutomatorという操作を自動化するアプリケーションがあります。

さらに、Googleが公開しているCloud Vison APIを使えば、画像から文字を抽出することができます。これらを上手いこと使って自動で「iPhoneのスクリーンタイムをデータとして記録する」までを行ってみました。

日々の生活を記録することで自己管理を効率化できるのではないかと思います!スクリーンタイムについて

スクリーンタイムで見れる項目には、

- App使用時間

- 通知

- 持ち上げ/再開回数

があります。

macのスクリーンタイム画面からは、サイドバーからこれらを選択して各項目の利用状況のグラフを見ることができます。注目すべきはシステム環境はウインドウサイズが一定で、スクリーンタイム内の文字やグラフの配置も同じような箇所にあることです。そのため、OCRで読み取りたい箇所だけを決め打ちでトリミングできます。Automator

文字認識をしたいスクリーンタイムの画像を取得するためにAutomatorを使います。

Automatorの大まかな流れはこのような感じです。

- システム環境設定を開く

- 操作を記録して、スクリーンタイムを開き、取得したいデバイスを選択する

- 「App使用時間」「通知」「持ち上げ/再開回数」それぞれでスクリーンショットを撮影 & OCRしたい箇所をトリミング

- トリミングした画像をくっつけてVisonAPIでテキスト取得、スプレッドシートに記録

Automatorの詳細

システムの外観モードを変更

起動したタイミングで外観モードをライトに変更しています。

AppleScript

「アプリケーションを開く」でシステム環境設定を開くと画面が手前にならないことがあり、操作を記録のステップで処理がコケてしまうのでAppleScriptで起動しています。

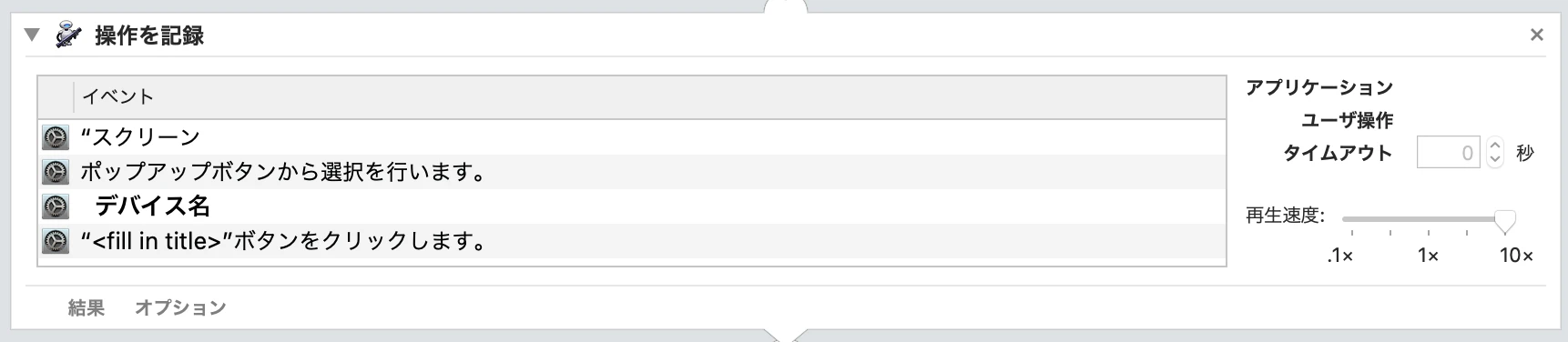

tell application "System Preferences" activate end tell操作を記録

Automatorアプリの

(記録)ボタンを押して、システム環境設定 > スクリーンタイム > デバイスの選択 > 日付を昨日に変更 までの流れをを記録させています

シェルスクリプトを実行

screencaptureコマンドで画面のスクリーンショットを撮影します。-lオプションで指定したwindow1dの画面を撮影することができます。また、-xは撮影音OFF、-oはスクリーンショットの影をなくすオプションです。

前の手順でクリックした直後に撮影しないように念のためシェルスクリプトの最初でsleep 1sとしています。sleep 1s dir="$HOME/lifelog" filepath=$dir/`date -v -1d +%Y%m%d`_screentime.png crop="/tmp/cropped_1.png" screencapture -xo -l$(osascript -e 'tell app "システム環境設定" to id of window 1') $filepath /usr/local/bin/convert $filepath -crop 828x574+466+152 $filepath # パスが通っていないので、フルパスで書く /usr/local/bin/convert $filepath +repage -crop 400x60+20+60 $crop操作を記録

システム環境設定のサイドバーにある「通知」のクリック操作を記録しています。「通知」をクリックした後は上記と同じ内容のシェルスクリプトを実行します。「持ち上げ/再開」でも同様に行います。

画像の結合とVisionAPI

/usr/local/bin/convert /tmp/cropped_1.png /tmp/cropped_2.png /tmp/cropped_3.png -append /tmp/combined.png python record_screentime.py # Vision APIとシートに記録スクリーンショットとトリミング

macでは、

screencaptureコマンドでCLIからスクリーンショットを撮影できます。

トリミングにはImageMagickのconvertコマンドを使用しています。-cropオプションの値には、(width)x(height)+(left)+(top)を指定しています。

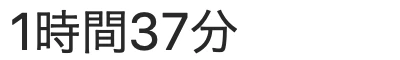

また、一度cropした画像にさらにcropしようとするとconvert: geometry does not contain imageというエラーが出てしまいましたが、-cropの前に+repageをつけることで解消できました。# ウインドウを指定してスクリーンショットを撮影 screencapture -xo -l$(osascript -e 'tell app "システム環境設定" to id of window 1') screentime.png # crop convert screentime.png -crop 828x574+466+152 screentime.png # OCRしたい箇所でさらにcrop convert screentime.png +repage -crop 400x60+20+60 screentime_cropped.png上記コマンドでOCRで文字認識したい箇所でcropすると、

- App使用時間

のようになります。これらを結合した画像をVisino APIに投げます。画像の結合は、以下のコマンドで行いました。

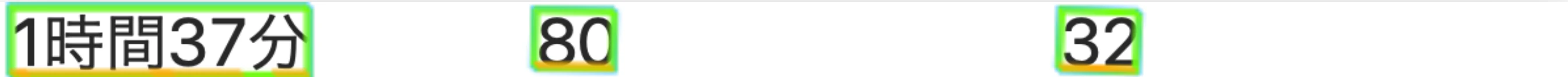

+appendで縦方向、-appendで横方向に結合できます。convert /tmp/cropped_1.png /tmp/cropped_2.png /tmp/cropped_3.png -append /tmp/combined.png結合した画像

これで準備完了です。

Vision APIとシートに記録

いよいよ準備した画像を使って、文字認識を行ってデータとして保存します。

以下の記事などを参考にさせていただきました。

- PythonでGoogleのCloud Vision APIを利用して画像から日本語文字検出する

- 【Google Colab】Vision APIで『レシートOCR』!

- Pythonでのスプレッドシート操作方法(gspreadの使い方)

import gspread import json from datetime import datetime, timedelta from oauth2client.service_account import ServiceAccountCredentials import os import io import re from google.cloud import vision credential_path = '【サービスアカウントキーのパス】' os.environ["GOOGLE_APPLICATION_CREDENTIALS"] = credential_path file_path = "/tmp/combined.png" with io.open(file_path, "rb") as image_file: content = image_file.read() image = vision.Image(content=content) client = vision.ImageAnnotatorClient() response = client.text_detection(image=image) data = response.text_annotations[0].description.split() # [0]でfull textを取得 scope = ['https://spreadsheets.google.com/feeds','https://www.googleapis.com/auth/drive'] credentials = ServiceAccountCredentials.from_json_keyfile_name(credential_path, scope) gc = gspread.authorize(credentials) SPREADSHEET_KEY = '【スプレッドシートのキー】' worksheet = gc.open_by_key(SPREADSHEET_KEY).sheet1 yesterday = datetime.today() - timedelta(days=1) date = datetime.strftime(yesterday, '%Y/%m/%d') d = re.findall("\d+", data[0]) # 'xx時間yy分` -> ['xx','yy'] d = list(map(int, d)) if len(d) == 2: # xx時間yy分の場合 data[0] = d[0]* 60 + d[1] elif len(d) == 1: # yy分の場合 data[0] = d[0] data = list(map(int, data)) data.insert(0, date) worksheet.append_row(data, value_input_option="USER_ENTERED")スクリーンタイムのデータがシートに反映されました!

あとはAutomatorのアプリを起動すれば今までの処理を自動で行ってくれます。(本当はcronで設定したかったけど、画面操作があるためできませんでした。。)ちなみに、VisionAPIを使った文字認識の結果はこうなりました。緑がParagraph、黄色が文字を表しています。きれいに認識できていますね。

おわりに

自動化ソフトや画像認識のツールを使って、スクリーンタイムをログに残してみました。せっかくならスクショだけはでなくて数字で記録に残せるといいですよね。

VisionAPIは1ヶ月1000リクエストまで無料なので毎日スクリーンタイムを記録して問題なさそうです。今のところスクリーンタイムを記録する術は英語でググっても見つからなかったので、この記事が誰かの参考になれば幸いです。

(Appleさん、スクリーンタイムもヘルスケアから読み取れるようにしてください)

- 投稿日:2020-12-15T22:21:25+09:00

iPhoneのスクリーンタイムをOCRで記録してみた

はじめに

スマホ、触りすぎていませんか?

私は隙があればついついスマホでYouTubeやSNSを長々と見てしまいます。YouTubeを始めた芸能人も多く、無限にコンテンツを楽しめてしまいますよね。コロナ渦で自宅にいることが増えたこともあってか、スクリーンタイムを見て唖然としてしまう日も少なくありません...。

そんな中、スクリーンタイムをSNSに投稿して勉強のモチベーションにしている受験生を見て、こういう使い方もあるんだなぁと感心しました。

とはいえ、わざわざ設定画面を開いてスクショを撮り、それをトリミングしてSNSに手動で投稿するのは少々面倒に感じます()幸いなことに、macからも同じApple IDで登録されてデバイスのスクリーンタイムを見ることができます。また、macにはAutomatorという操作を自動化するアプリケーションがあります。

さらに、Googleが公開しているCloud Vison APIを使えば、画像から文字を抽出することができます。これらを上手いこと使って自動で「iPhoneのスクリーンタイムをデータとして記録する」までを行ってみました。

日々の生活を記録することで自己管理を効率化できるのではないかと思います!スクリーンタイムについて

スクリーンタイムで見れる項目には、

- App使用時間

- 通知

- 持ち上げ/再開回数

があります。

macのスクリーンタイム画面からは、サイドバーからこれらを選択して各項目の利用状況のグラフを見ることができます。注目すべきはシステム環境はウインドウサイズが一定で、スクリーンタイム内の文字やグラフの配置も同じような箇所にあることです。そのため、OCRで読み取りたい箇所だけを決め打ちでトリミングできます。Automator

文字認識をしたいスクリーンタイムの画像を取得するためにAutomatorを使います。

Automatorの大まかな流れはこのような感じです。

- システム環境設定を開く

- 操作を記録して、スクリーンタイムを開き、取得したいデバイスを選択する

- 「App使用時間」「通知」「持ち上げ/再開回数」それぞれでスクリーンショットを撮影 & OCRしたい箇所をトリミング

- トリミングした画像をくっつけてVisonAPIでテキスト取得、スプレッドシートに記録

Automatorの詳細

システムの外観モードを変更

起動したタイミングで外観モードをライトに変更しています。

AppleScript

「アプリケーションを開く」でシステム環境設定を開くと画面が手前にならないことがあり、操作を記録のステップで処理がコケてしまうのでAppleScriptで起動しています。

tell application "System Preferences" activate end tell操作を記録

Automatorアプリの

(記録)ボタンを押して、システム環境設定 > スクリーンタイム > デバイスの選択 > 日付を昨日に変更 までの流れをを記録させています

シェルスクリプトを実行

screencaptureコマンドで画面のスクリーンショットを撮影します。-lオプションで指定したwindow1dの画面を撮影することができます。また、-xは撮影音OFF、-oはスクリーンショットの影をなくすオプションです。

前の手順でクリックした直後に撮影しないように念のためシェルスクリプトの最初でsleep 1sとしています。sleep 1s dir="$HOME/lifelog" filepath=$dir/`date -v -1d +%Y%m%d`_screentime.png crop="/tmp/cropped_1.png" screencapture -xo -l$(osascript -e 'tell app "システム環境設定" to id of window 1') $filepath /usr/local/bin/convert $filepath -crop 828x574+466+152 $filepath # パスが通っていないので、フルパスで書く /usr/local/bin/convert $filepath +repage -crop 400x60+20+60 $crop操作を記録

システム環境設定のサイドバーにある「通知」のクリック操作を記録しています。「通知」をクリックした後は上記と同じ内容のシェルスクリプトを実行します。「持ち上げ/再開」でも同様に行います。

画像の結合とVisionAPI

/usr/local/bin/convert /tmp/cropped_1.png /tmp/cropped_2.png /tmp/cropped_3.png -append /tmp/combined.png python record_screentime.py # Vision APIとシートに記録スクリーンショットとトリミング

macでは、

screencaptureコマンドでCLIからスクリーンショットを撮影できます。

トリミングにはImageMagickのconvertコマンドを使用しています。-cropオプションの値には、(width)x(height)+(left)+(top)を指定しています。

また、一度cropした画像にさらにcropしようとするとconvert: geometry does not contain imageというエラーが出てしまいましたが、-cropの前に+repageをつけることで解消できました。# ウインドウを指定してスクリーンショットを撮影 screencapture -xo -l$(osascript -e 'tell app "システム環境設定" to id of window 1') screentime.png # crop convert screentime.png -crop 828x574+466+152 screentime.png # OCRしたい箇所でさらにcrop convert screentime.png +repage -crop 400x60+20+60 screentime_cropped.png上記コマンドでOCRで文字認識したい箇所でcropすると、

- App使用時間

のようになります。これらを結合した画像をVisino APIに投げます。画像の結合は、以下のコマンドで行いました。

+appendで縦方向、-appendで横方向に結合できます。convert /tmp/cropped_1.png /tmp/cropped_2.png /tmp/cropped_3.png -append /tmp/combined.png結合した画像

これで準備完了です。

Vision APIとシートに記録

いよいよ準備した画像を使って、文字認識を行ってデータとして保存します。

以下の記事などを参考にさせていただきました。

- PythonでGoogleのCloud Vision APIを利用して画像から日本語文字検出する

- 【Google Colab】Vision APIで『レシートOCR』!

- Pythonでのスプレッドシート操作方法(gspreadの使い方)

import gspread import json from datetime import datetime, timedelta from oauth2client.service_account import ServiceAccountCredentials import os import io import re from google.cloud import vision credential_path = '【サービスアカウントキーのパス】' os.environ["GOOGLE_APPLICATION_CREDENTIALS"] = credential_path file_path = "/tmp/combined.png" with io.open(file_path, "rb") as image_file: content = image_file.read() image = vision.Image(content=content) client = vision.ImageAnnotatorClient() response = client.text_detection(image=image) data = response.text_annotations[0].description.split() # [0]でfull textを取得 scope = ['https://spreadsheets.google.com/feeds','https://www.googleapis.com/auth/drive'] credentials = ServiceAccountCredentials.from_json_keyfile_name(credential_path, scope) gc = gspread.authorize(credentials) SPREADSHEET_KEY = '【スプレッドシートのキー】' worksheet = gc.open_by_key(SPREADSHEET_KEY).sheet1 yesterday = datetime.today() - timedelta(days=1) date = datetime.strftime(yesterday, '%Y/%m/%d') d = re.findall("\d+", data[0]) # 'xx時間yy分` -> ['xx','yy'] d = list(map(int, d)) if len(d) == 2: # xx時間yy分の場合 data[0] = d[0]* 60 + d[1] elif len(d) == 1: # yy分の場合 data[0] = d[0] data = list(map(int, data)) data.insert(0, date) worksheet.append_row(data, value_input_option="USER_ENTERED")スクリーンタイムのデータがシートに反映されました!

あとはAutomatorのアプリを起動すれば今までの処理を自動で行ってくれます。(本当はcronで設定したかったけど、画面操作があるためできませんでした。。)ちなみに、VisionAPIを使った文字認識の結果はこうなりました。緑がParagraph、黄色が文字を表しています。きれいに認識できていますね。

おわりに

自動化ソフトや画像認識のツールを使って、スクリーンタイムをログに残してみました。せっかくならスクショだけはでなくて数字で記録に残せるといいですよね。

VisionAPIは1ヶ月1000リクエストまで無料なので毎日スクリーンタイムを記録して問題なさそうです。今のところスクリーンタイムを記録する術は英語でググっても見つからなかったので、この記事が誰かの参考になれば幸いです。

(Appleさん、スクリーンタイムもヘルスケアから読み取れるようにしてください)

- 投稿日:2020-12-15T22:10:15+09:00

地名で天気情報を取得して画像ファイルに出力する

はじめに

ここのアドベントカレンダーのやつです。

マストドン上で稼働している自作botの機能に”お天気情報取得”があります。”<地名>の天気を教えて!”とお願いすると、その地域の天気情報を返信してくれるというもので、従来”livedoor天気api”を使用していました。

ところが、2020年7月31日を以ってこの”livedoor天気api”はサービス終了となり、天気情報の機能が使えなくなってしまいました。

ということで、再び天気情報機能を使えるようになんとかしようと思います。

要件

- 指定された地名の天気情報を取得できること(既存要件)

- Pythonで実装すること(既存要件)※botをPythonで作成しているため

- 天気情報を表やグラフにして画像ファイル(PNG)にすること(追加要件)

※表・グラフの画像ファイル化は前からやってみたかったので、今回合わせてやってみたいと思います。

天気情報をどこから取得するか

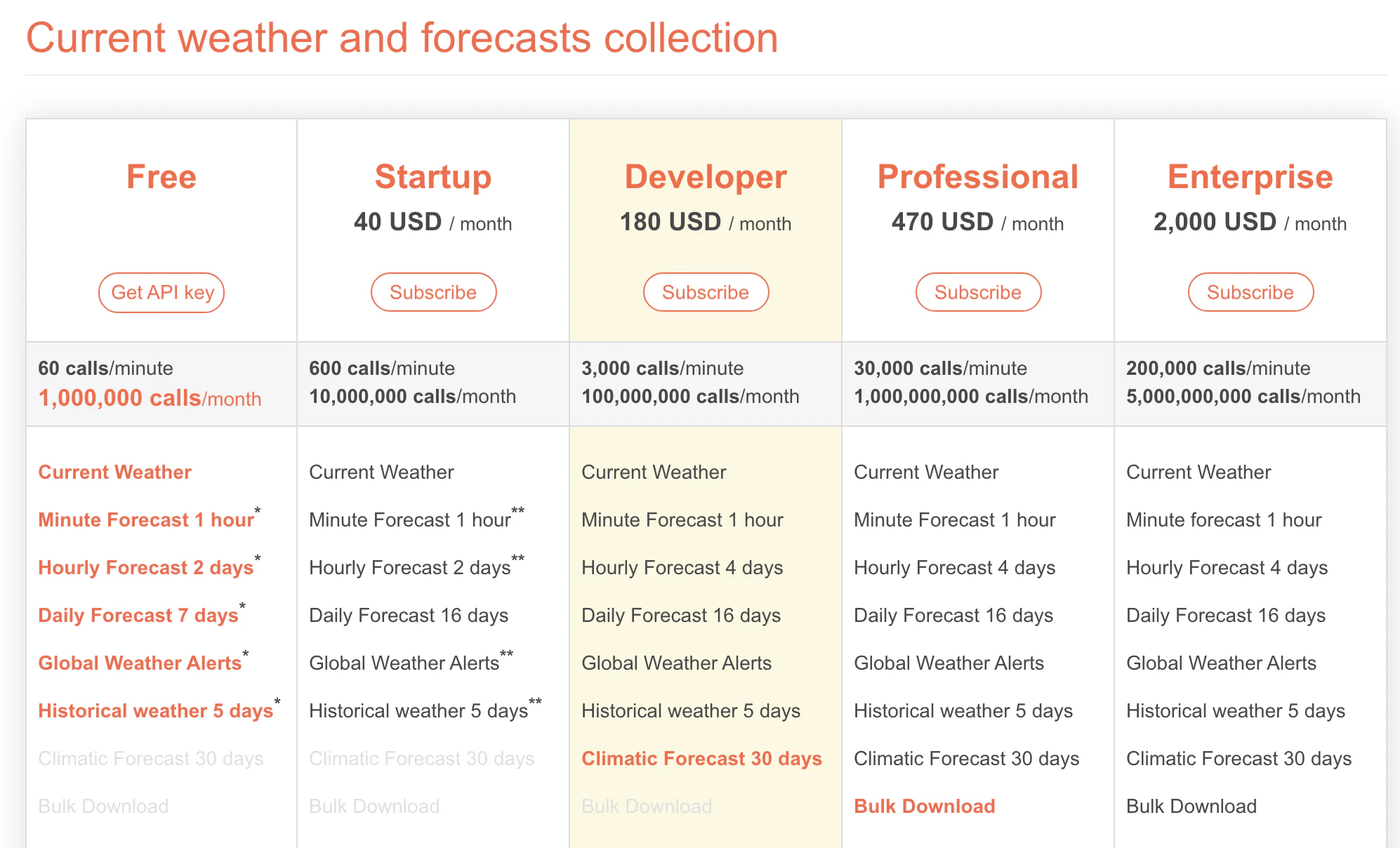

調べてみると、OpenWeatherMapというのが良さそうな感じです。これを使わせてもらいましょう。(ユーザ登録要、無料プランあり)

無料プランで、「60回/分・100万回/月」という制限がありますが、小規模なら十分すぎる感じです。取得できる情報も「現在天気」「1分毎天気」「1時間毎天気」「日毎天気」などこちらも十分そうです。

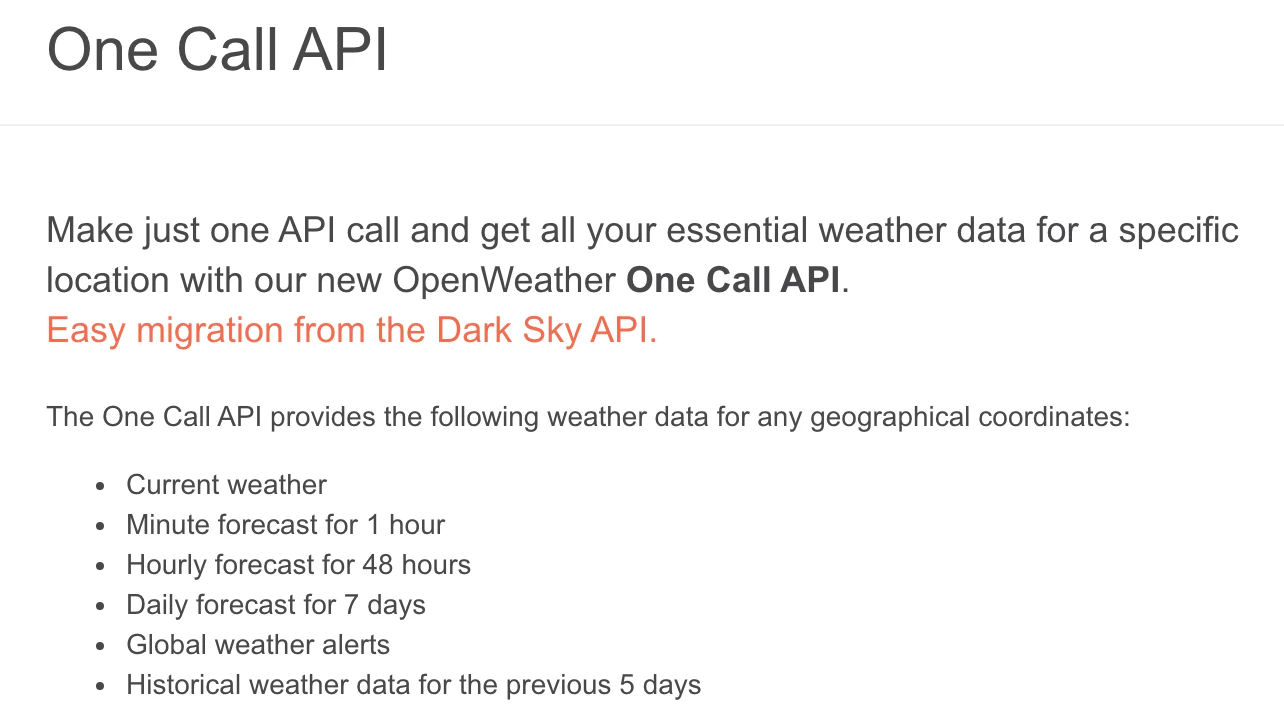

APIにはいくつか種類がありますが、”One Call API"を使えば欲しい情報は持ってきてくれそうです。

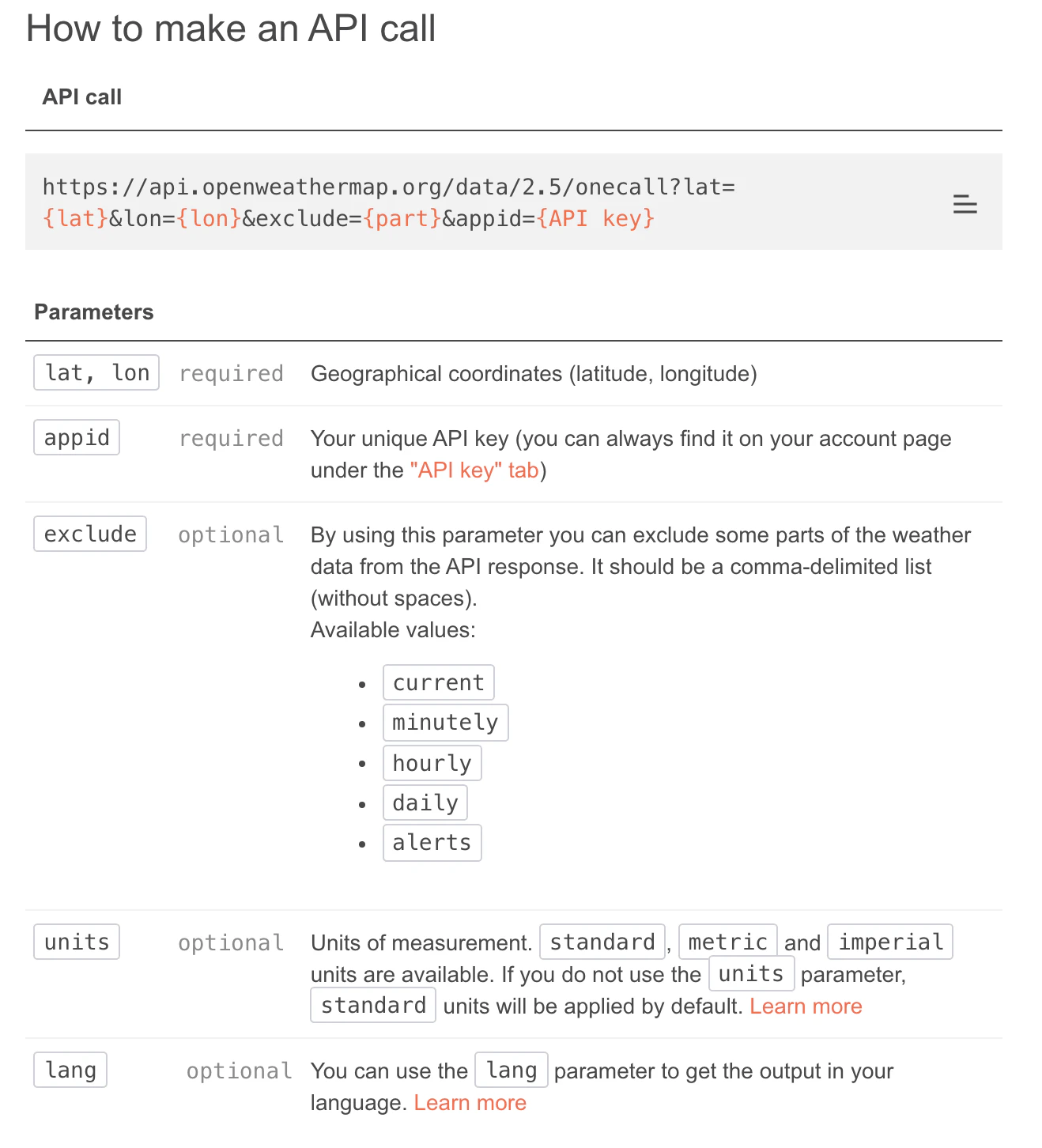

実際のAPI使用例を見てみると、"lat"、"lon"に経度・緯度指定が必要そうです。("apiid"はユーザ登録すればもらえます。)

グローバルなAPIなので、日本語地名による検索はダメそうです。(アルファベットでの地名検索はできるっぽいですが、主要都市だけかも?色々試しましたが諦めた気がします)

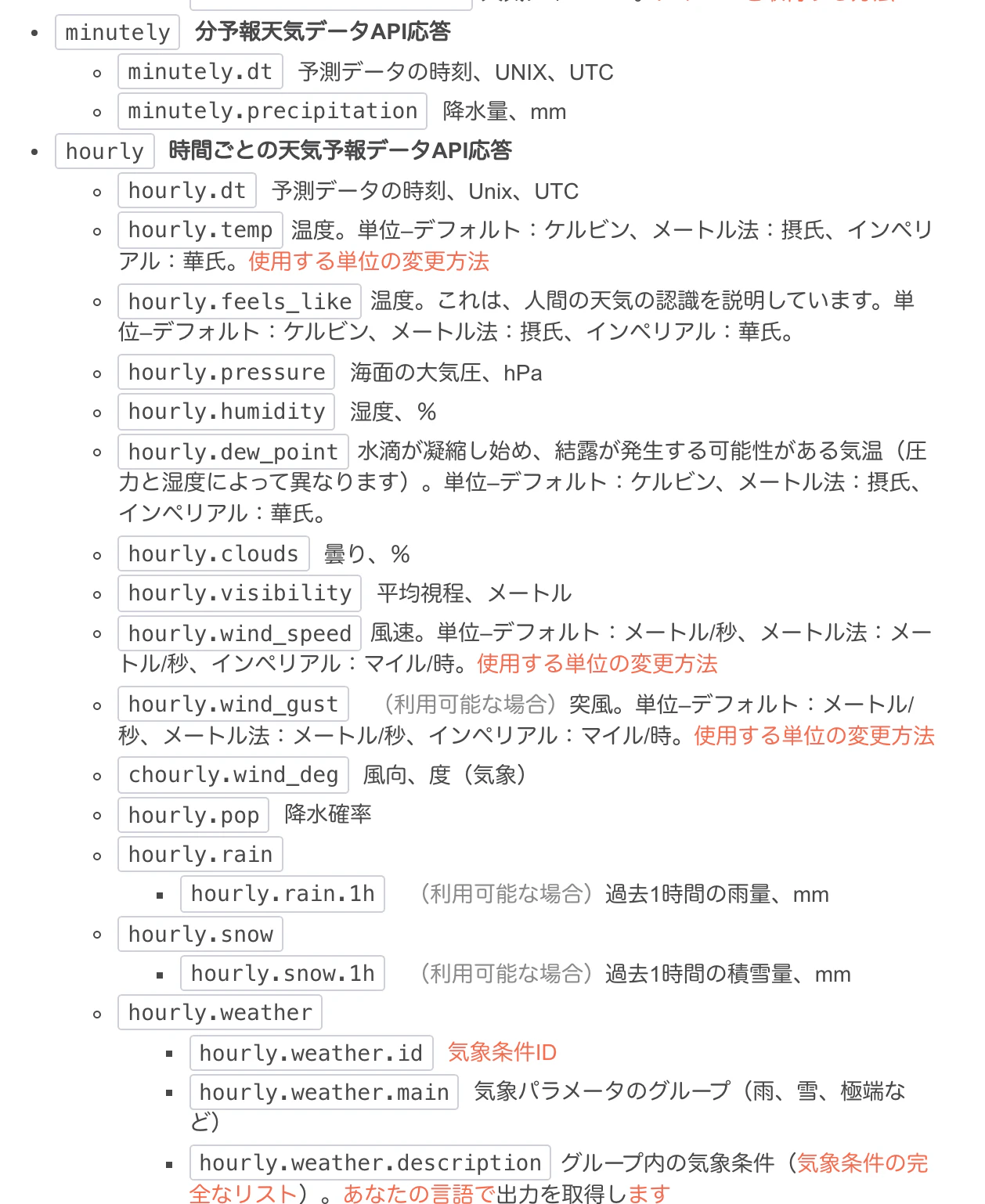

取得結果は以下のような情報が含まれるようです。(詳細は公式サイトのドキュメント参照)

地名と緯度・経度の一覧を作る

前述の通り、天気情報の取得には経度・緯度が必要そうなので、地名を経度・緯度に変換する方法を考えます。

調べてみると国土交通省のHPより「位置参照情報 ダウンロードサービス」というものがありました。都道府県毎にダウンロードする必要があるものの、全市区町村単位の位置情報は網羅されていそうです。”地名”はとりあえずは”市区町村名”とすることとします。(街区レベルのものもありますが、ここまで細かいのは今回は不必要と思います)

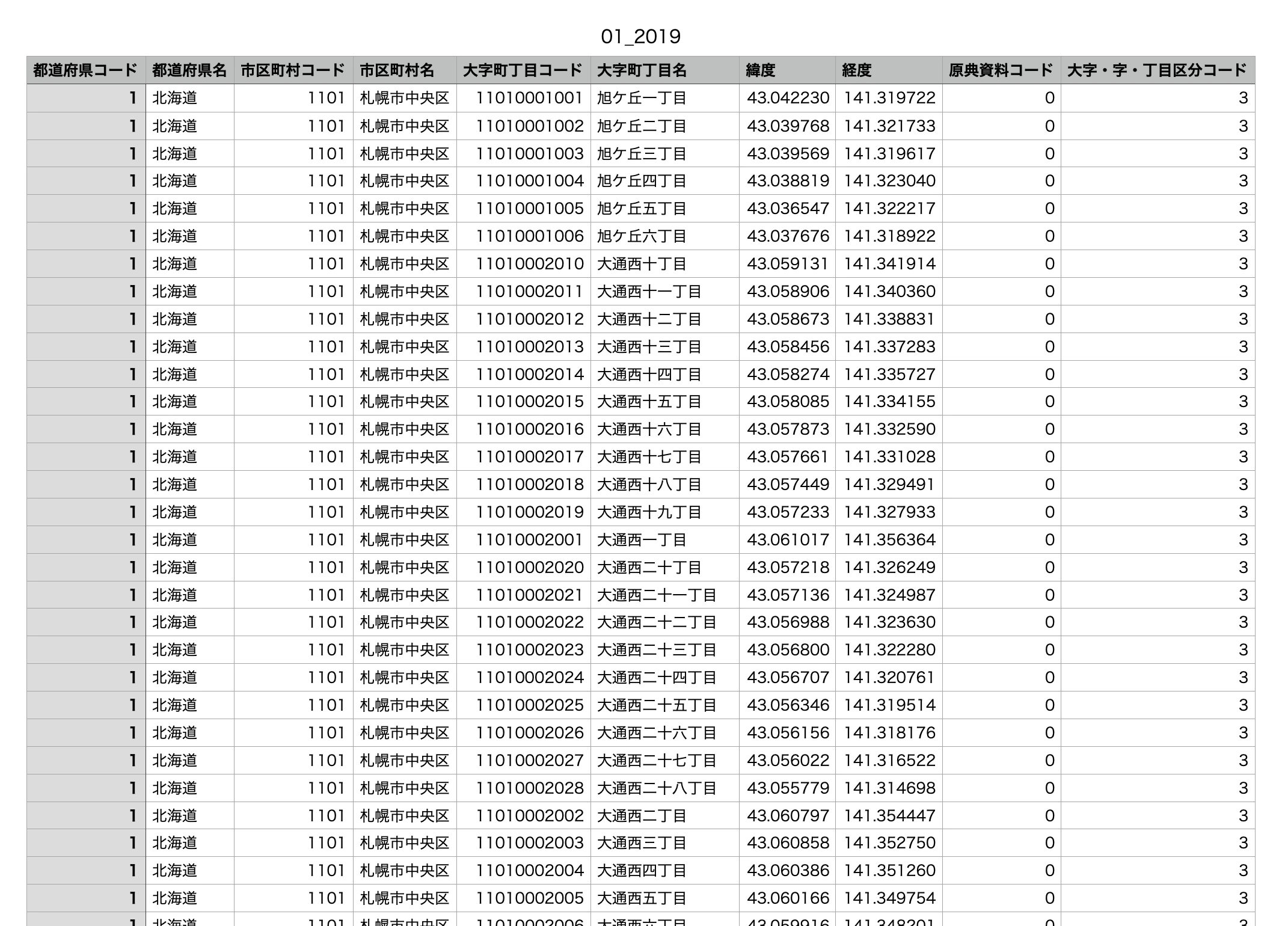

実際のデータの一部はこんな感じです。住所毎に緯度・経度情報があります。

今回はここまで細かくなくていいかなと思うので、市区町村名でグルーピングして緯度・経度のそれぞれの平均値を求め、その値を市区町村の緯度・経度とする感じで、一覧を作成しました。(使用しない情報は除外)

latloc.json{ "徳島県": { "徳島市": [ 34.0694450186722, 134.5442937966806 ], "鳴門市": [ 34.182439379310345, 134.5660390172414 ], "小松島市": [ 33.994815439999996, 134.59324916 ], "<省略>" } }以上から、天気情報取得の流れは、

市区町村名が指定される

一覧より該当の市区町村の経度・緯度を取得

OpenWeatherMap APIに経度・緯度を渡してコールし、天気情報を受け取る

天気情報を表・グラフなどに加工(※次項で説明)して返す

こんな感じで行けそうです。

Pythonでデータを表・グラフにして、画像ファイルにする

Pythonでグラフ作成ライブラリといえば、matplotlibとかpandasが挙がりますが(多分)、”表の画像ファイル化”、”画像の挿入(お天気マークを画像に入れたい)"がどうやっても難しそうで難航していました。

そこで、plotly という作図ライブラリを使わせてもらいました。これなら、表の画像ファイル化が綺麗にできました。図の挿入もバッチリです。詳細な使い方は他の記事に譲るとして、今回の作例とポイントだけ説明したいと思います。

作例1 表の画像ファイル化

作例2 棒グラフの画像ファイル化

otenki.py# -*- coding: utf-8 -*- import os from pprint import pprint as pp import requests import json from bs4 import BeautifulSoup from time import sleep from collections import defaultdict import pandas as pd import plotly.graph_objects as go import plotly.express as px import urllib.request from pytz import timezone from datetime import datetime, timedelta from PIL import Image import locale locale.setlocale(locale.LC_TIME, 'ja_JP.UTF-8') CITY_LATLOC_PATH = "dic/city_latloc.json" ICON_DIR = "tenki_icon" IMAGE_H = 1260 IMAGE_W = 800 BG_COLOR = "#100500" LINE_COLOR = "#5f5050" FONT_COLOR = "#fff5f3" WEATHER_IMAGE_PATH = "./media" # 天気メイン def get_tenki(quary, appid): with open(CITY_LATLOC_PATH, 'r') as fr: city_latloc_dict = json.load(fr) os.makedirs(WEATHER_IMAGE_PATH, exist_ok=True) os.makedirs(os.path.join(WEATHER_IMAGE_PATH, ICON_DIR), exist_ok=True) hit_tdfk = [tdfk for tdfk in city_latloc_dict.keys() if tdfk in quary] hit_skcs = [] hit_lat = 0.0 hit_loc = 0.0 if len(hit_tdfk) == 1: # 都道府県指定あり for k_skcs, latloc in city_latloc_dict[hit_tdfk[0]].items(): if quary.split(hit_tdfk[0])[-1] in [k_skcs, k_skcs[:-1]]: hit_skcs.append(hit_tdfk[0] + k_skcs) hit_lat = latloc[0] hit_loc = latloc[1] else: # 都道府県指定なし for k_tdfk, v in city_latloc_dict.items(): for k_skcs, latloc in v.items(): if quary in [k_skcs, k_skcs[:-1]]: hit_skcs.append(k_tdfk + k_skcs) hit_lat = latloc[0] hit_loc = latloc[1] if len(hit_skcs) == 0: return 900, None, None, None # 見つからなかった場合 elif len(hit_skcs) > 1: return 901, None, "、".join(hit_skcs), None # 複数見つかった場合 # 天気情報取得 url = "http://api.openweathermap.org/data/2.5/onecall" payload = { "lat": hit_lat, "lon": hit_loc, "lang": "ja", "units": "metric", "APPID": appid} tenki_data = requests.get(url, params=payload).json() tz = timezone(tenki_data['timezone']) skcs_name = hit_skcs[0] return 0, hit_skcs[0]+"の天気", \ make_weather_image_current(tenki_data['current'], skcs_name, tz),\ [make_weather_image_daily(tenki_data['daily'], skcs_name, tz), make_weather_image_hourly(tenki_data['hourly'], skcs_name, tz), make_weather_image_minutely(tenki_data['minutely'], skcs_name, tz)] # UV指数 def get_uvi_info(uvi): if uvi < 3.0: return f"弱い", "rgb(204,242,255)" elif uvi < 6.0: return f"中程度", "rgb(255,255,204)" elif uvi < 8.0: return f"強い", "rgb(255,204,153)" elif uvi < 11.0: return f"非常に強い", "rgb(255,101,101)" else: return f"極端に強い", "rgb(255,101,255)" # 16方位名 def get_wind_deg_name(deg): import math dname = ["北", "北北東", "北東", "東北東", "東", "東南東", "南東", "南南東", "南", "南南西", "南西", "西南西", "西", "西北西", "北西", "北北西", "北"] return dname[int((deg + 11.25)/22.5)] # 現在の天気 def make_weather_image_current(wd, skcs_name, tz): tmp_dict = {} tmp_dict['曇り%'] = wd['clouds'] tmp_dict['日時'] = datetime.fromtimestamp( wd['dt'], tz=tz).strftime("%m/%d %H:%M") tmp_dict['体感気温℃'] = f"{float(wd['feels_like']):.1f}" tmp_dict['湿度%'] = wd['humidity'] tmp_dict['気圧hPa'] = wd['pressure'] tmp_dict['日の出'] = datetime.fromtimestamp( wd['sunrise'], tz=tz).strftime("%H:%M:%S") tmp_dict['日の入'] = datetime.fromtimestamp( wd['sunset'], tz=tz).strftime("%H:%M:%S") tmp_dict['気温℃'] = f"{float(wd['temp']):.1f}" if 'uvi' in wd: uv_text, _ = get_uvi_info(wd['uvi']) tmp_dict['UV指数'] = f"{uv_text}({float(wd['uvi']):.1f})" else: tmp_dict['UV指数'] = "−" tmp_dict['天気'] = wd['weather'][0]['description'] ret_text = f"現在({tmp_dict['日時']}時点)の{skcs_name}の天気\n" ret_text += f"{tmp_dict['天気']}:" ret_text += f"気温{tmp_dict['気温℃']}℃/湿度{tmp_dict['湿度%']}%/体感気温{tmp_dict['体感気温℃']}℃\n" ret_text += f"気圧{tmp_dict['気圧hPa']}hPa/UV指数「{tmp_dict['UV指数']}」/雲率{tmp_dict['曇り%']}%\n" ret_text += f"日の出時刻は{tmp_dict['日の出']}、日の入時刻は{tmp_dict['日の入']}\n" ret_text += f" by OpenWeatherMap API https://openweathermap.org/" return ret_text # 1週間天気 def make_weather_image_daily(wd, skcs_name, tz): tenki_data_list = [] for l1 in wd: tmp_dict = {} tmp_dict['日付'] = datetime.fromtimestamp( l1['dt'], tz=tz).strftime("%m/%d(%a)") tmp_dict['☀☁'] = "" # お天気アイコン表示用 tmp_dict['icon'] = l1['weather'][0]['icon'] tmp_dict['天気'] = l1['weather'][0]['description'] tmp_dict['最高気温℃'] = f"{float(l1['temp']['max']):.1f}" tmp_dict['最低気温℃'] = f"{float(l1['temp']['min']):.1f}" tmp_dict['降水確率%'] = int(float(l1['pop'])*100) tmp_dict['UV指数'], tmp_dict['uv_color'] = get_uvi_info(l1['uvi']) tmp_dict['font_color'] = FONT_COLOR tmp_dict['風速m/s'] = f"{float(l1['wind_speed']):.1f}" tmp_dict['風向'] = get_wind_deg_name(l1['wind_deg']) tmp_dict['気圧hPa'] = f"{int(l1['pressure']):,}" tenki_data_list.append(tmp_dict) df_temp = pd.json_normalize(tenki_data_list) df = df_temp[['日付', '☀☁', '天気', '最高気温℃', '最低気温℃', '降水確率%', '風向', '風速m/s', '気圧hPa', 'UV指数']] # テーブルの作成 fig = go.Figure(data=[go.Table( columnwidth=[25, 10, 25, 20, 20, 20, 20, 20, 20, 20], # カラム幅の変更 header=dict(values=df.columns, align='center', font=dict(color=FONT_COLOR, size=18), height=30, line_color=LINE_COLOR, fill_color=BG_COLOR), cells=dict(values=df.values.T, align='center', font=dict(color=[df_temp.font_color]*9 + [df_temp.uv_color], size=18), height=30, # ポイント:UV指数カラムの色指定 line_color=LINE_COLOR, fill_color=BG_COLOR), )], layout=dict(margin=dict(l=0, r=0, t=30, b=0), paper_bgcolor=BG_COLOR, title=dict( text=skcs_name+"の1週間天気", x=0.5, y=1.0, font=dict(color=FONT_COLOR, size=24), xanchor='center', yanchor='top', pad=dict(l=0, r=0, t=5, b=0)) ) ) # ポイント:お天気アイコン貼り付け。後から画像を乗せるイメージ。位置調整は手動。 for i in range(1, len(df)+1, 1): # 天気アイコン取得 icon_name = df_temp['icon'][i-1] icon_image = get_weather_icon(icon_name) fig.add_layout_image( dict(source=icon_image, x=0.125, y=(1.0-1.0/(len(df)+1)*(i+0.5)))) fig.update_layout_images(dict( xref="paper", yref="paper", sizex=0.22, sizey=0.21, xanchor="left", yanchor="middle")) imagepath = os.path.join(WEATHER_IMAGE_PATH, "tmp_weather_d.png") fig.write_image(imagepath, height=30*(len(df)+2), width=1100, scale=1) return imagepath # 48時間天気 def make_weather_image_hourly(wd, skcs_name, tz): tenki_data_list = [] for l1 in wd: tmp_dict = {} tmp_dict['日時'] = datetime.fromtimestamp( l1['dt'], tz=tz).strftime("%m/%d %H時") tmp_dict['☀☁'] = "" # お天気アイコン表示用 tmp_dict['icon'] = l1['weather'][0]['icon'] tmp_dict['天気'] = l1['weather'][0]['description'] tmp_dict['気温℃'] = f"{float(l1['temp']): .1f}" tmp_dict['湿度%'] = l1['humidity'] tmp_dict['体感気温℃'] = f"{float(l1['feels_like']):.1f}" tmp_dict['降水確率%'] = int(float(l1['pop'])*100) tmp_dict['風向'] = get_wind_deg_name(l1['wind_deg']) tmp_dict['風速m/s'] = f"{float(l1['wind_speed']):.1f}" tmp_dict['気圧hPa'] = f"{int(l1['pressure']):,}" tenki_data_list.append(tmp_dict) df_temp = pd.json_normalize(tenki_data_list) df = df_temp[['日時', '☀☁', '天気', '気温℃', '湿度%', '体感気温℃', '降水確率%', '風向', '風速m/s', '気圧hPa']] # テーブルの作成 fig = go.Figure(data=[go.Table( # columnorder=[10, 20, 30, 40, 50, 25, 70], columnwidth=[25, 10, 25, 20, 20, 20, 20, 20, 20, 20], # カラム幅の変更 header=dict(values=df.columns, align='center', font=dict(color=FONT_COLOR, size=18), height=30, line_color=LINE_COLOR, fill_color=BG_COLOR), cells=dict(values=df.values.T, align='center', font=dict(color=FONT_COLOR, size=18), height=30, line_color=LINE_COLOR, fill_color=BG_COLOR), )], layout=dict(margin=dict(l=0, r=0, t=30, b=0), paper_bgcolor=BG_COLOR, title=dict( text=skcs_name+"の48時間天気", x=0.5, y=1.0, font=dict(color=FONT_COLOR, size=24), xanchor='center', yanchor='top', pad=dict(l=0, r=0, t=5, b=0)) ), ) # お天気アイコン貼り付け for i in range(1, len(df)+1, 1): # 天気アイコン取得 icon_name = df_temp['icon'][i-1] icon_image = get_weather_icon(icon_name) fig.add_layout_image( dict(source=icon_image, x=0.125, y=(1.0-1.0/49.0*(i+0.5)))) fig.update_layout_images(dict( xref="paper", yref="paper", sizex=0.05, sizey=0.05, xanchor="left", yanchor="middle")) imagepath = os.path.join(WEATHER_IMAGE_PATH, "tmp_weather_h.png") fig.write_image(imagepath, height=30*(48+2), width=1100, scale=1) return imagepath # 1時間降水量 def make_weather_image_minutely(wd, skcs_name, tz): tenki_data_list = [] for l1 in wd: tmp_dict = {} tmp_dict['時刻'] = datetime.fromtimestamp( l1['dt'], tz=tz).strftime("%H:%M") tmp_dict['降水量mm'] = l1['precipitation'] tenki_data_list.append(tmp_dict) df_temp = pd.json_normalize(tenki_data_list) df = df_temp[['時刻', '降水量mm']].round({'降水量mm': 2}) # テーブルの作成 fig = go.Figure([go.Bar(x=df['時刻'], y=df['降水量mm'], text=df['降水量mm'], textposition='auto', marker=dict(color='rgba(150,150,255,0.8)'), y0=0 )], layout=dict(margin=dict(l=0, r=0, t=30, b=0), paper_bgcolor=BG_COLOR, plot_bgcolor=BG_COLOR, title=dict( text=skcs_name+"の1時間の降水量", x=0.5, y=1.0, font=dict(color=FONT_COLOR, size=24), xanchor='center', yanchor='top', pad=dict(l=0, r=0, t=5, b=0)), font=dict(color=FONT_COLOR, size=18), xaxis=dict(title='時刻', showgrid=False), yaxis=dict(title='降水量mm', showgrid=False, rangemode='nonnegative') # ポイント:負の値は取らないグラフなので0起点にする ) ) imagepath = os.path.join(WEATHER_IMAGE_PATH, "tmp_weather_m.png") fig.write_image(imagepath, height=400, width=1600, scale=1) return imagepath # 天気アイコン取得 def get_weather_icon(icon_name): icon_image_path = os.path.join( WEATHER_IMAGE_PATH, ICON_DIR, icon_name + ".png") if os.path.exists(icon_image_path): pass else: url = f"http://openweathermap.org/img/wn/{icon_name}@4x.png" with urllib.request.urlopen(url) as web_file: data = web_file.read() with open(icon_image_path, mode='wb') as local_file: local_file.write(data) return Image.open(icon_image_path) if __name__ == '__main__': pp(get_tenki("札幌市中央区", "<<api_key>>"))おわりに

とりあえず、イメージした表・グラフの形になりました。

(アドベントカレンダー感はありませんが、まあよいでしょう。)

夏に実装したのですが、いつの間にか冬になってました。夏にAPIを叩いたときは降雪量情報は返ってこなかったのですが、今なら返ってくるかもしれないので試してみたいと思います。

- 投稿日:2020-12-15T21:57:52+09:00

Google OR-Toolsによる最適化プロジェクト入門

この記事は「数理最適化 Advent Calendar 2020」22日目の記事です。

21日目は@shuhei_fさんによる「SMOのworking setの選び方」でした。はじめに

Pythonと最適化モデリングライブラリGoogle OR-Toolsを用いて、簡単な最適化プロジェクトを進めていきます。題材は「個別指導塾における講師のシフト作成」で、0-1整数線形計画問題として解きます。

プログラムを書くのがド下手なので、「こう書いた方がいい」といったことは是非教えてください。問題発生

渋川君のアルバイト先の個別指導塾では、以下のようなシフト表に基づいて勤務することになっています。

例えば月曜1限では、講師Aが生徒1に対して国語を教えることになっています。

シフト表は一か月間固定で、毎月20日に教室長が翌月分のシフト表を作成します。今の教室長は非常に雑な人で、

・数学を担当できない講師が数学を教えることになっている

・希望を出していない曜日にシフトが入れられている

といったことが多発しています(※これはフィクションです)。そこで最近最適化に興味を持ち始めた読んだ渋川君が、数理最適化を使ってシフト表を自動生成してみようと考えました。

どうしたいのかを考える

ざっくりと「シフトを自動生成したい」と述べましたが、もう少し具体的に、最適化でどうなって欲しいかを考えてみます。

今回の例では、教室長が作るシフトが条件を満たしてさえいなかったので、一旦は条件を満たすような解を見つけるだけでも十分な気がします。実行可能解がないにしても、満たせない条件をなるべく少なくするようにモデリングすれば調整が楽そうです。

したがって、まずは条件を満たす解を見つけることから始め、それが出来たら何を最大化または最小化したいか考えることにします。どんな問題に落とし込むかを考える

長い前置き

早速定式化に取りかかります。定式化とは、「決定変数、制約条件、目的関数を数式で表すこと」であると認識しています。

個人的には、定式化の最初のステップとして「どんな問題になりそうか」を考える必要があると思っています。例えば「どんな順番にすると一番良いか知りたいから巡回セールスマン問題かな?」って感じです。

実務では多くが組合せ最適化問題に帰着することが多く、組合せ最適化問題には典型問題と呼ばれるものが存在します(巡回セールスマン問題も典型問題の一つ)。典型問題を知っていると定式化がしやすいですし、効率的な解法が盛んに研究されているので参考になります。そのため典型問題にどんなものがあるか、どんな応用例があるか知っておくと良いのかなと思います(これは自分への戒めでもあります)。

典型問題は、斉藤先生のこちらの記事やNTTデータ数理システムのこちらのサイトに良くまとまっています。今回のプロジェクトでは「どの講師が、どの曜日・時限・科目に割り当てられるか」を決めると良さそうなので、割当問題が使えそうです。

※実際は「どの生徒に割り当てられるか」ですが、今回は簡単のために「ある生徒に割り当てられる=その生徒が受講を希望する科目に割り当てられる」と考えます。同じ科目の受講を希望する生徒が複数いる場合はどっちを担当してもよいものとします。割当問題は適用できるシーンが非常に多く、定式化も分かりやすいので、とにかく何か最適化してみたい時の入り口としてかなりおすすめです。

決定変数を考える

ここからは数式による表現とPythonによる実装を並行して進めていきます。実装に関しては記事の流れの都合上変数の登場順序などが前後して分かりづらいですがご容赦ください。

決定変数は雑に言うと「コレが分かったら嬉しいモノ」です。巡回セールスマン問題でいえば「訪問順序」が決定変数で、「総移動距離(最小にしたい)」が目的関数です。決定変数をどう設定するかで目的関数や制約式の作りやすさが変わるので重要なのですが、このプロジェクトではゴリ押しでいきます。

数式

今回は上述のように「どの講師が、どの曜日のどの時限にどの科目を担当するか」を決めたいので、これをそのまま変数にします。

講師$i$が曜日$w$の時限$t$に科目$s$を担当するかどうかを表す変数を以下のように表します。x^i_{wts} \in \{0,1\}$x^i_{wts} =1$であれば、担当する(=シフトが入る)という意味になります。

実装

最初に

pywraplp.Solver(問題名,使用するソルバー)でソルバーを宣言します。今回は無料で使える混合整数計画ソルバーCBCを指定します。そしてsolver.IntVar(下限,上限,変数名)で整数変数を作成します。from ortools.linear_solver import pywraplp #曜日・時限・科目のリスト weekday_list = ['月','火','水','木','金','土'] timetable_list = [1,2,3,4] subject_list = ['国語','数学','英語'] #講師数、曜日数、時限数、科目数 I,W,T,S = len(shift_avlbl),len(weekday_list),len(timetable_list),len(subject_list) #ソルバーの宣言 solver = pywraplp.Solver('Staff Scheduling',pywraplp.Solver.CBC_MIXED_INTEGER_PROGRAMMING) #決定変数x x = [[[[solver.IntVar(0,1,'') for s in range(S)] for t in range(T)] for w in range(W)] for i in range(I)]

x[i][w][t][s]が上述の$x^i_{wts}$を表します。制約式を考える

今の教室長が守ってくれてないやつです。

シフトに関して満たさなければならない条件ですが、ぱっと思いつく範囲では

・一人の講師が担当するのは生徒一人まで

・希望していない日時にシフトを入れない

・(得意不得意の理由で)担当できない科目のシフトを入れない

・過不足なくシフトを入れる

あたりになりそうです。今回はあくまで講師に優しくというスタンスでいきます。この他に

・生徒側(講師側)から共演NGが出ている講師(生徒)

・中学受験経験者の講師を希望する生徒

などがありましたが、今回は考慮しないことにします。とりあえず最初に述べた4つを制約としたいと思います。

一人の講師が担当するのは生徒一人まで

私が所属していた塾では講師:生徒=1:2での授業でしたが、今回は簡単のためマンツーマンにします。

数式

次のような数式を考えます。

\sum_s x^i_{wts} \leq 1 \quad \forall i,w,t実装

solver.Add(等式制約または不等式制約)で制約式を作成します。

また、solver.Sum()で通常のsum()より速く計算することが出来ます。#制約 一人の講師が担当できる生徒は一人まで for i in range(I): for w in range(W): for t in range(T): solver.Add(solver.Sum([x[i][w][t][s] for s in range(S)]) <= 1)希望していない日時にシフトを入れない

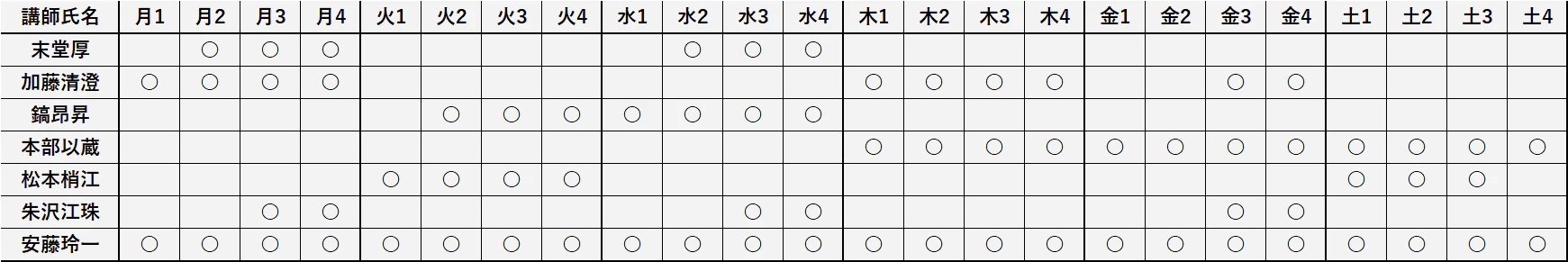

講師からは、以下のようなシフト希望表を受け取っているものとします。

今回は板垣先生作「グラップラー刃牙」より、7名の方に講師を担当して頂いています。

数式

次のように、希望しない日時に関しては最初から0になるように制約式を考えます。

\sum_s x^i_{wts} = 0 \quad \forall i,w,t \in講師iが希望しない日時実装

shift_avlblに上のシフト希望表がpandasのDataFrameとして格納されているものとします。

曜日・時限が横一列に並んだ状態から曜日インデックスと時限インデックスを取得するために、4で割った商と余りを用いています(今回は各曜日4限まであるため)。#制約 希望しない日時にシフトを入れない for i in range(I): for j in range(len(shift_avlbl.columns)): #この日時を希望しなければ if shift_avlbl.iat[i,j] == 0: unavlbl_w = j//4 #曜日インデックス unavlbl_t = j%4 #時限インデックス solver.Add(solver.Sum([x[i][unavlbl_w][unavlbl_t][s] for s in range(S)]) == 0)担当出来ない科目のシフトを入れない

シフト希望表と同様に、講師から次のような担当可能科目の情報を受け取っているものとします。

数式

先ほどと同様に、担当できない科目には最初から割り当ての可能性をなくすという形をとります。

\sum_{w,t} x^i_{wts} = 0 \quad \forall i,s \in講師iが担当できない科目実装

subject_avlblに上の担当可能科目の情報がpandasのDataFrameとして格納されているものとします。#制約 担当できない科目のシフトをいれない for i in range(I): for s in range(S): if subject_avlbl.iat[i,s] == 0: solver.Add(solver.Sum([x[i][w][t][s] for w in range(W) for t in range(T)]) == 0)過不足なくシフトを入れる

以下のような表で受講管理を行っているとします。

画像は途中までになっていますが、41件の登録があります。数式

この表によって、「どの日時にどの科目が何人分需要されているか」が分かるので、曜日$w$の時限$t$における科目$s$の需要量として$D_{wts}$という定数を考えます。

そして、過不足なくシフトを入れることは需要を丁度満たすことと考えられるので、以下の制約式を考えます。\sum_i x^i_{wts} = D_{wts} \quad \forall w,t,sまずは条件を全て満たすシフトを決めることが最初の目的でしたが、これまでに登場した制約を考えると、「実行可能解がない」可能性が十分にあります。実行可能解がないとソルバーの出力としての解は得られなくなってしまうので、対策として上記の制約式を緩めます。

新たな決定変数$y_{wts}$を用いて、以下の制約式に変更します。

\sum_i x^i_{wts} + y_{wts} = D_{wts} \quad \forall w,t,s$y_{wts}$は、「曜日$w$の時限$t$における、科目$s$を担当する講師の不足分」と解釈出来ます。そして、目的関数として

min \quad \sum_{w,t,s} y_{wts}を考えれば、「講師不足数」を最小化する問題となり、目的関数値が0であれば全ての制約を守れていることになります。また、0じゃなくても、最適解$y$の中身を参照することで「何曜日の何限に何の科目の講師が何人足りないのか」が分かるため、講師間での調整が出来ます。

実装

lecture_reqに先ほどの受講管理票がDataFrameで格納されているものとし、$D_{wts}$を表す配列demandを作成します。決定変数$y_{wts}$は事前に作成してあるものとして、以下のコードで制約式を加えます。#各曜日・各時限における各科目の需要量を表す配列 demand = [[[0 for s in range(S)] for t in range(T)] for w in range(W)] for index,row in lecture_req.iterrows(): weekday = weekday_list.index(row['曜日']) timetable = timetable_list.index(row['時限']) subject = subject_list.index(row['科目']) demand[weekday][timetable][subject] += 1 #制約 過不足なくシフトを入れる for w in range(W): for t in range(T): for s in range(S): solver.Add(solver.Sum([x[i][w][t][s] for i in range(I)]) + y[w][t][s] == demand[w][t][s])目的関数を考える

上述の通り、最初は「講師不足数の総和」を目的関数として最小化することで、実行可能解があるかどうかを確認し、なければ講師のシフト希望を調整します。実行可能解がある状態にできたら、最適なシフトを目指して別の目的関数を考えることにします。

数式

最初の目的関数を再掲します。

min \quad \sum_{w,t,s} y_{wts}実装

solver.Minimize(目的関数)で目的関数を作成します。最大化問題のときはsolver.Maximize(目的関数)とします。

また、solver.Solve()で最適化計算が行われ、返り値としてソルバーのステータスが得られます。ステータスが0であれば最適解が求まったことになります。#講師不足数の総和 shortage = solver.Sum([y[w][t][s] for s in range(S) for t in range(T) for w in range(W)]) #目的関数の設定 solver.Minimize(shortage) #求解 status = solver.Solve()全体のコード

データを取得してから、シフトを出力するまでの一連のコードを記載します。

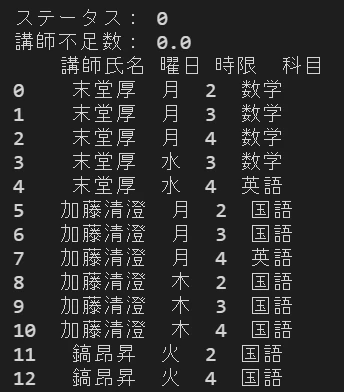

staff_scheduling.pyimport pandas as pd from ortools.linear_solver import pywraplp """必要なデータ""" #シフト希望表 shift_avlbl = pd.read_excel('~/data.xlsx',sheet_name='シフト希望表').set_index('講師氏名').applymap(lambda x: 1 if x=='〇' else 0) #担当可能科目 subject_avlbl = pd.read_excel('~/data.xlsx',sheet_name='担当可能科目').set_index('講師氏名').applymap(lambda x: 1 if x=='〇' else 0) #受講管理表 lecture_req = pd.read_excel('~/data.xlsx',sheet_name='受講管理表') """最適化""" #曜日・時限・科目のリスト weekday_list = ['月','火','水','木','金','土'] timetable_list = [1,2,3,4] subject_list = ['国語','数学','英語'] #講師数、曜日数、時限数、科目数 I,W,T,S = len(shift_avlbl),len(weekday_list),len(timetable_list),len(subject_list) #ソルバーの宣言 solver = pywraplp.Solver('Staff Scheduling',pywraplp.Solver.CBC_MIXED_INTEGER_PROGRAMMING) #決定変数x x = [[[[solver.IntVar(0,1,'') for s in range(S)] for t in range(T)] for w in range(W)] for i in range(I)] #決定変数 y y = [[[solver.IntVar(0,4,'') for s in range(S)] for t in range(T)] for w in range(W)] #制約 一人の講師が担当できる生徒は一人まで for i in range(I): for w in range(W): for t in range(T): solver.Add(solver.Sum([x[i][w][t][s] for s in range(S)]) <= 1) #制約 希望しない日時にシフトを入れない for i in range(I): for j in range(len(shift_avlbl.columns)): if shift_avlbl.iat[i,j] == 0: unavlbl_w = j//4 #曜日インデックス unavlbl_t = j%4 #時限インデックス solver.Add(solver.Sum([x[i][unavlbl_w][unavlbl_t][s] for s in range(S)]) == 0) #制約 担当できない科目のシフトをいれない for i in range(I): for s in range(S): if subject_avlbl.iat[i,s] == 0: solver.Add(solver.Sum([x[i][w][t][s] for w in range(W) for t in range(T)]) == 0) #各曜日・各時限における各科目の需要量を表す配列 demand = [[[0 for s in range(S)] for t in range(T)] for w in range(W)] for index,row in lecture_req.iterrows(): weekday = weekday_list.index(row['曜日']) timetable = timetable_list.index(row['時限']) subject = subject_list.index(row['科目']) demand[weekday][timetable][subject] += 1 #制約 過不足なくシフトを入れる for w in range(W): for t in range(T): for s in range(S): solver.Add(solver.Sum([x[i][w][t][s] for i in range(I)]) + y[w][t][s] == demand[w][t][s]) #講師不足数の総和 shortage = solver.Sum([y[w][t][s] for s in range(S) for t in range(T) for w in range(W)]) #目的関数の設定 solver.Minimize(shortage) #求解 status = solver.Solve() """結果の表示""" print('ステータス:',status) print('講師不足数:',solver.Objective().Value()) #最適解 x_solution = [[[[int(x[i][w][t][s].SolutionValue()) for s in range(S)] for t in range(T)] for w in range(W)] for i in range(I)] #シフトを表すデータフレーム teacher_list = shift_avlbl.index.tolist() shift_df = pd.DataFrame(columns=['講師氏名','曜日','時限','科目']) for i in range(I): for w in range(W): for t in range(T): for s in range(S): if x_solution[i][w][t][s] == 1: shift_df = shift_df.append({'講師氏名':teacher_list[i],'曜日':weekday_list[w],'時限':timetable_list[t],'科目':subject_list[s]},ignore_index=True) print(shift_df)結果

上記のコードを実行した結果、以下の出力が得られました。ステータスが0なので最適解が求まっていることが分かり、目的関数である講師不足数が0なので、現状のシフト希望と受講管理表のデータでも全ての制約を満たす解が存在することが分かりました。

シフトを表すデータフレームは途中で切れていますが、受講希望数と同じ41件のシフトが出力されています。

そして作成した担当表が以下になります。

人選が適当すぎて「〇曜△限であの戦いが起こりそう」とかはありませんでした。挫折

本当はここから別の目的関数や制約を取り入れて、より良いシフトを作る展開にしたかったのですが、上手く出来ませんでした。

取り入れたかったものとしては、「なるべく同じ日に連続でシフトに入りたい」を考えていました。朱沢先生や安藤先生のシフトを見てみると、一日に一コマだけシフトが入っていたり、空きコマがあったりします。人によるとは思いますが、なるべく一日に一気にシフトを入れることを好む方は多いと思うので、空きコマの数を最小化したり、同じシフト数でも出勤する日数を最小化するようなモデルを作りたいと考えていました。しかしながら、私の力では整数線形計画問題になるようにこれらをモデルに取り入れることが出来ませんでした。もし整数線形計画問題になるように取り入れるアイデアや、全く異なる定式化で実現するアイデアがあったら是非お教えいただければと思います。

まとめ

達人である渋川先生にプロジェクトを失敗させてしまい申し訳ないです。そして渋川先生のシフトを完全に忘れていました。

未熟ながらアドベントカレンダーに初挑戦させて頂きましたが、悔しい部分が多いので来年また挑戦させてください。読んで頂きありがとうございました。

- 投稿日:2020-12-15T21:38:17+09:00

Markdownの表をpandas dataframeに変換する

モチベーション

画像を貼り付けたマークダウンの表をエクセルで編集したい!ということがありました。(トレードオフ表や台帳)

ところが、VScodeのプレビューをエクセルにコピペしても、画像のリンクを持ってくることが出来ませんでした。

画像のリンクが付いてこないと、編集後エクセルからマークダウンにコピペした後、画像のパスを打ち直す必要があり、大変です。

ということで、pythonでスクリプトを作ることとしました。(かなり、やっつけ仕事ですが)やったこと

- VScodeのマークダウンの表をコピー

- 下記のコードを実行

- エクセルへ貼り付け

- エクセルで編集

- エクセルでコピー

- VScodeに貼り付け

画像のリンクが付いているので、何もしなくても画像が表示される!素晴らしい

md_table2df.pyimport mistune import pyperclip import pandas as pd import re md = mistune.Markdown() res = md(pyperclip.paste())#クリップボードからテキストを取得して、HTMLに変換 pattern = '<img src="(.*)" alt="(.*)">' rep = '' rep_tex = re.sub(pattern,rep,res)#画像の部分をマークダウン記法に変換 df = pd.read_html(rep_tex)[0]#dataframe作成 df.to_clipboard(index=False)#エクセルに貼り付けるため、クリップボードへコピー【コードの説明】

手順は正直まどろっこしい。。。もっといい方法ありそう

- マークダウンのテキストをクリップボードから取り出し

- 取り出したテキストをHTMLへ変換

- HTMLの画像の箇所を正規表現を使用してマークダウン記法に置換

- pandasでHTMLから表を作成

- その表をクリップボードへ入れる

感想

ググってもありそうで、なかったです

プレビュー画面をコピペすれば、大部分はエクセルに持ってこれるので、あんまり需要ないのかな

それとも他に良い方法があるのかなぁ

- 投稿日:2020-12-15T21:15:41+09:00

カテゴリーデータを数値データに変換する

1. はじめに

文字で与えられるカテゴリーデータを数値データに変換するやり方の一例として、指定した数字に置き換える方法、カテゴリーのカウント数に置き換える方法、についてメモしておきます。

2. ライブラリ、データを読み込む

データ例として、KaggleのTitanicデータを使用します。

import numpy as np import pandas as pd train = pd.read_csv("./input/train.csv") test = pd.read_csv("./input/test.csv") data0 = pd.concat([train, test], sort=False)data0.columns # Index(['PassengerId', 'Survived', 'Pclass', 'Name', 'Sex', 'Age', 'SibSp', # 'Parch', 'Ticket', 'Fare', 'Cabin', 'Embarked'], dtype='object')3. 空欄(nan)を埋める

'Embarked'のデータで変換してみます。

data0['Embarked'][0:6] # 0 S # 1 C # 2 S # 3 S # 4 S # 5 Q # Name: Embarked, dtype: object#文字データの種類を調べる data0['Embarked'].unique() #array(['S', 'C', 'Q', nan], dtype=object)#nanを数える data0['Embarked'].isnull().sum() #2#文字データをカウントする(before) v0 = data0["Embarked"].value_counts() v0 # S 914 # C 270 # Q 123 # Name: Embarked, dtype: int64#nanを'S'で埋める data0['Embarked'].fillna(('S'), inplace=True)#文字データをカウントする(after) v1 = data0["Embarked"].value_counts() v1 # S 916 # C 270 # Q 123 # Name: Embarked, dtype: int644-1. 文字データを指定した数字に置き換える

data = data0 v2 = { 'S':0, 'C':1, 'Q':2 } data['Embarked_1'] = data['Embarked'].map(v2) data['Embarked_1'][0:6] # 0 0 # 1 1 # 2 0 # 3 0 # 4 0 # 5 2 # Name: Embarked_map, dtype: int644-2. 文字データをカウント数に置き換える

data=data0 vc = data['Embarked'].value_counts() vc # S 916 # C 270 # Q 123 # Name: Embarked, dtype: int64data['Embarked_2'] = data['Embarked'].map(vc) data['Embarked_2'][0:6] # 0 916 # 1 270 # 2 916 # 3 916 # 4 916 # 5 123 # Name: Embarked_count, dtype: int64

- 投稿日:2020-12-15T20:52:58+09:00

django [Errno 61] Connection refusedの対処法(アカウント認証テストで、、、)(備忘録)

djangoで[Errno 61] Connection refusedになった時の対処法

エラー文の意味は直訳だと#接続が拒否された”と言っている。

sign_upページからテスト情報を入力してうまく登録出来るか確認しようとした段階のエラー。解決方法

以下をsettings.pyに追加したら直った。

EMAIL_BACKEND = 'django.core.mail.backends.console.EmailBackend'これはメールを実際には送らずに、コンソールに表示してくれる設定らしいです。

実際に送信するには以下のように書き換えが必要とのこと。

EMAIL_BACKEND = 'django.core.mail.backends.smtp.EmailBackend'

- 投稿日:2020-12-15T20:25:58+09:00

マリオに遺伝子を注入してみた~遺伝アルゴリズム~

はじめに

こんにちは。今回は遺伝アルゴリズムでスーパーマリオブラザーズの1-1をクリアしてみましたので、プロセスとコードを備忘録を兼ねて記事にしました。

また、なるべく理論に沿った実装にしたかったので、ライブラリはほとんど利用していません。おそらく配列処理などはもっと良い方法があると思いまが、大目に見てやってください。

遺伝アルゴリズムに関しては、このスライドが死ぬほどわかりやすいのでぜひ見てみてください(笑)

実装に関して

- 遺伝子長は300

マリオの1-1をクリアするには、最速ではないモデルでおよそ2700フレームが必要です。

皆さんがTASではない限り、フレームごとに入力を変えることはないですし、遺伝子長が長くなると生成や交配などで重くなったり多くのメモリを占有するのでこのようにしました。

10フレームごとに行動を選択することとしました。

- 遺伝子パターンは0と1

なるべく早くゴールしたかったので、ただ右に走る0と、走りながらジャンプする1の2つに絞りました。

- 個体数は20

特に理由はありませんが、あまり多くしても結果が変わらないことが多くあったので、私はいつもこのくらいの数にしています。

- 評価方法:たどり着いた距離

今回はゴールが目標なので、死ぬまで、もしくは時間切れまでに進んだ距離にしました。

移動する床もありませんし、右にしか進まないので、ステップが増えるごとに到達距離が減少することはありません。

- 交叉方法:1点交叉

今回は遺伝子長も短めで、時系列での配列になるので、これがベストだと思い選びました。

2点交叉でもよかったんですが、1点交叉の方が収束が早かったです。

- 遺伝子の突然変異率:5%

収束までを早めたかったので少し高めに設定しました。最速モデルを目指す場合はもう少し落とした方がいいと思います。

- 世代交代手法:最良の2個体はそのまま、残り18個体は上位10個体からランダムに選別し交配

いつも使ってる手法なのであまり考えたことはありませんが、最良個体をそのまま残すことで極端に低い世代が生まれにくくなりますし、個人的に気に入っている設定です。

実装(関数)

適当に実装していきます。普段はパラメータとか遺伝子クラスを継承したりして丁寧に作りますが、今回はわかりやすくマリオに遺伝子を組み込みたいので省略します。

気になる方は多くの先輩方がQiitaで実装を記事にしてくださっているので参考にしてみてください。

- 遺伝子の作成

def create_gene(): generation = [] for x in range(20): gene = [] for y in range(300): gene.append(random.choice([0, 1])) generation.append(gene) return generation

- 遺伝子の交配

def cross(gene1, gene2): cross_point = random.choice(range(len(gene1))) new_gene1 = gene1[:cross_point] + gene2[cross_point:] new_gene2 = gene2[:cross_point] + gene1[cross_point:] return new_gene1, new_gene2

- 遺伝子の突然変異

def mutation(genes): new_genes = [] for move in genes: if random.random() < 0.05: if move == 1: new_genes.append(0) else: new_genes.append(1) else: new_genes.append(move) return new_genes

- 遺伝子のスコアによるソート

def sorts(genes, scores): sorted_index = np.argsort(scores) sorted_li = [] for x in sorted_index: sorted_li.append(genes[x]) sorted_li.reverse() return sorted_li主要な関数はこのくらいなので、これを使ってメインを実装していきます。

今回マリオはこちらのライブラリを使用させていただきました。

実装(メイン)

このような感じにしました。

from nes_py.wrappers import JoypadSpace import gym_super_mario_bros import random import numpy as np # 移動設定 MOVEMENT = [ ['right', 'B'], ['right', 'A', 'B'], ] # 遺伝子作成 GENES = create_gene() # 環境構築 env = gym_super_mario_bros.make('SuperMarioBros-v0') env = JoypadSpace(env, MOVEMENT) # 初期設定 TRY_GENERATION = 1000 STEP_COUNT = 10 for x in range(TRY_GENERATION): generation_scores = [] for i, gen in enumerate(GENES): stete = env.reset() # 環境リセット for j, move in enumerate(gen): breaker = False for k in range(STEP_COUNT): state, reward, done, info = env.step(move) if done: breaker = True break if i == 0: # # env.render() # 実際に表示したい場合はコメントアウト pass if breaker: break generation_scores.append(info["x_pos"]) print("generation: {} genes: {} stops: {} score: {}".format(x + 1, i + 1, j + 1, info["x_pos"])) GENES, scores = sorts(GENES, generation_scores) NEW_GENES = [] for k in range(9): gene1, gene2 = random.sample(GENES[:10], 2) gene1, gene2 = gene.cross(gene1, gene2, mode="one-point") NEW_GENES.append(gene1) NEW_GENES.append(gene2) NEW_GENES = mutation(NEW_GENES) NEW_GENES = GENES[:2] + NEW_GENES GENES = NEW_GENES env.close()結果

やっと遺伝子組み換えマリオがゴールしてくれました!笑 pic.twitter.com/sEFE6RweDA

— そばっしー (@sobasssy) December 15, 2020簡単なステージではありますが...

第7世代でゴールする個体が現れました

ちょっと早すぎない?まだ2分くらいしか学習してないんだけど

遺伝アルゴリズムの強さを身にしみて感じました。

皆さんもぜひマリオに遺伝子を注入して組み換えまくってくださいね!(笑)

- 投稿日:2020-12-15T20:14:49+09:00

OracleFunctionsを利用するための「開発・デプロイ環境構築」及び「デプロイ方法」

始めまして(Qiita初投稿)、ジーアールソリューションズの趙と申します。

この記事はグロースエクスパートナーズ Advent Calendar 2020の19日目です。OracleCloudの資格を取得するため、OracleCloudのサービスを勉強しました。この間Oracle Functionsにも触っていました。インターネットで調べると、Oracle Cloud Shell を利用してFunctionsのデプロイ環境設定してデプロイする記事は沢山ありますが、OracleCloudのインスタンスを利用してFunctionsの開発・デプロイ環境構築の記事が少ないことに気づきました。

今回はOracleCloudのサーバーレスサービス(Functions)を利用したファンクションのデプロイ、およびOracleCloudのインスタンスを使った開発・デプロイ環境の構築を紹介します。OracleCloud Functionsとは

Oracle Functionsは、オープンソースFnProjectをベースとした Oracle Cloud Infrastructureに組み込まれている、フルマネージド、マルチテナント、高拡張性なオンデマンドのFunctions-as-a-Service(FaaS)プラットフォームです。

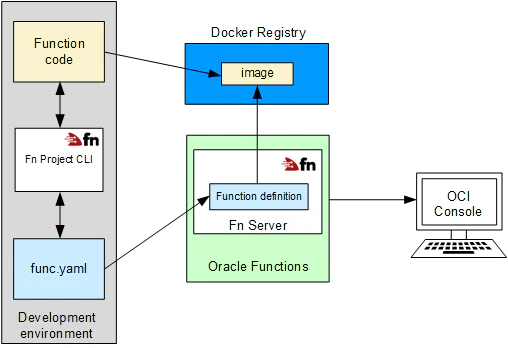

他のパブリック・クラウドにもファンクションが提供されており、AWS Lambdaは有名なファンクションサービスの一つです。比較するとAWS Lambdaで開発したファンクショはAWSの環境しか実行できないため、大きなロックイン性があります。でOracle FunctionsはFnProjectをベースに開発したファンクショサービスなので、簡単に移植することができます。Oracle Functionsデプロイ

デプロイ流れ概要

①開発・デプロイ環境を構築します。

②ファンクションからDockerイメージを作成します。

③func.yamlファイルでファンクション定義します。

④指定したDockerレジストリにイメージをプッシュします。

⑤ファンクションのメタデータをFnサーバーにアップロードします。

⑥OracleCloudのコンソールにファンクションを追加します。

※図のソース:「docs.cloud.oracle.com」環境準備

Oracle Functionsを使用してファンクションを作成及びデプロイする前に、ファンクション開発のためのテナンシ設定する必要があります。

設定のタスクおよび手順のリンクは以下となります。

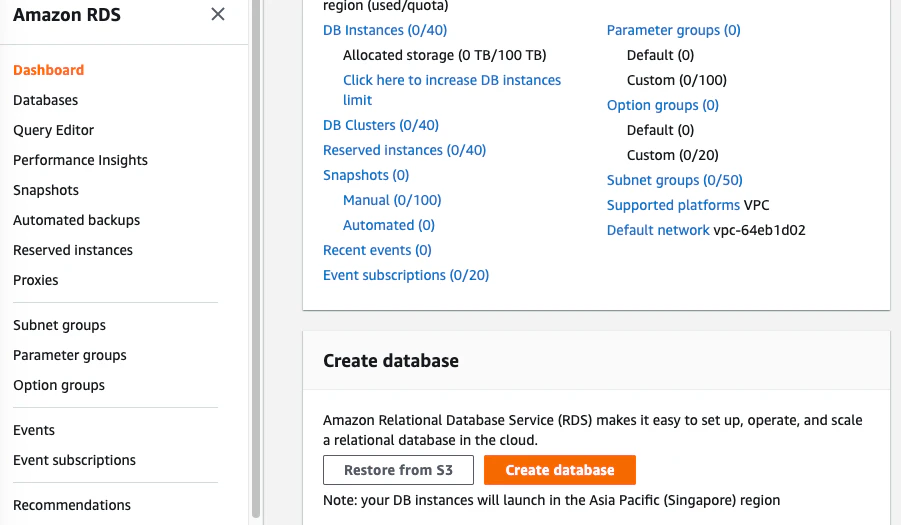

※本記事はOracleFunctionsで使用するグループとユーザーを存在する前提で記載します。Oracle FunctionsはVCN及びリポジトリを使用できるようにポリシーの作成

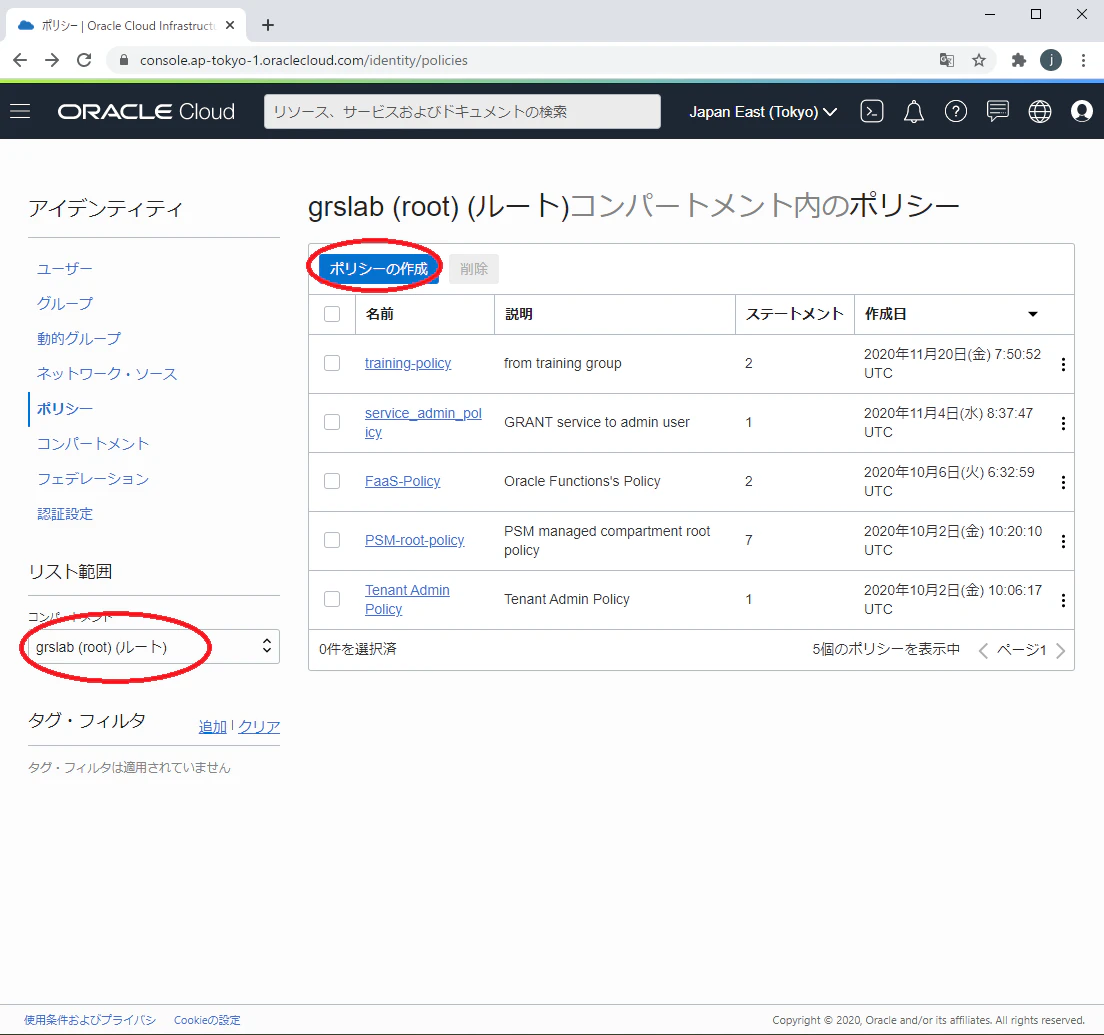

1.OracleCloudのコンソールにログインします。

2.ナビゲーション・メニューを開いて「アイデンティティ」⇒「ポリシー」をクリックします。

3.ルート・コンパートメントを選択して、「ポリシー作成」をクリックします。

4.ポリシー作成画面で、ポリシーを入力して、「作成」ボタンをクリックします。

Oracle Functionsサービスは、Oracle Cloud Infrastructure Registryのリポジトリに格納されたファンクションのイメージに対する読取りアクセス権及びVNCの使用権限が必要なので、以下のポリシー・ルールの設定が必要です。

Allow service FaaS to read repos in tenancy

Allow service FaaS to use virtual-network-family in tenancyOracle Functionsで使用するVCN及びサブネットの作成

1.OracleCloudのコンソールにログインします。

2.ナビゲーション・メニューを開いて「ネットワーキング」⇒「仮想クラウド・ネットワーク」をクリックします。

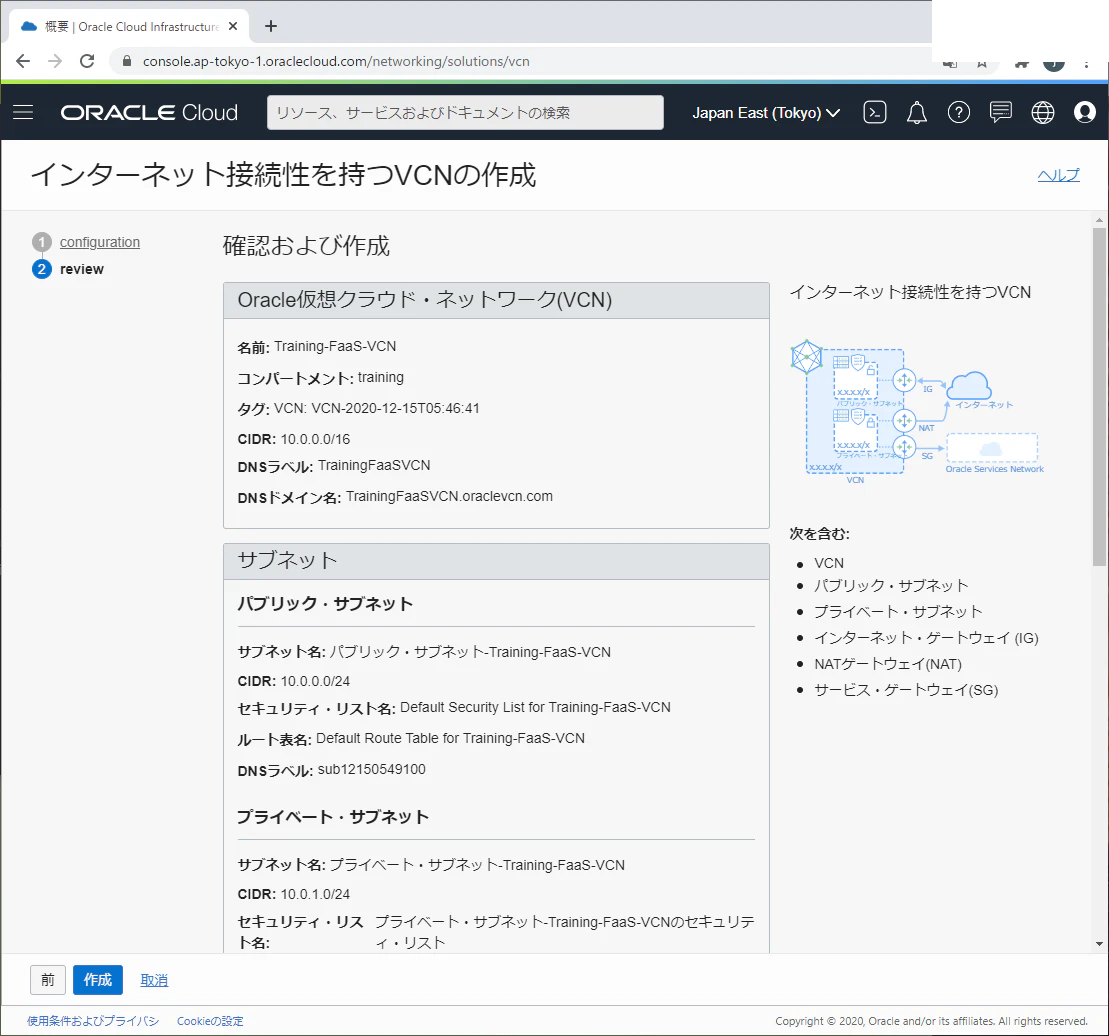

3.Oracle Functionsを所有するコンパートメントを選択して、「VCNウィザードの起動」をクリックします。

4.「VCNウィザードの起動」の画面で、「インターネット接続性を持つVCN」を選択して、「VCNウィザードの起動」をクリックします。

5.「構成」画面でVCN名およびVCN CIDRブロックを入力して「次」ボタンをクリックします。

6.「確認及び作成」画面で設定した項目を確認して、「作成」をクリックします。

Oracle Functionsの開発及びデプロイ用インスタンス作成

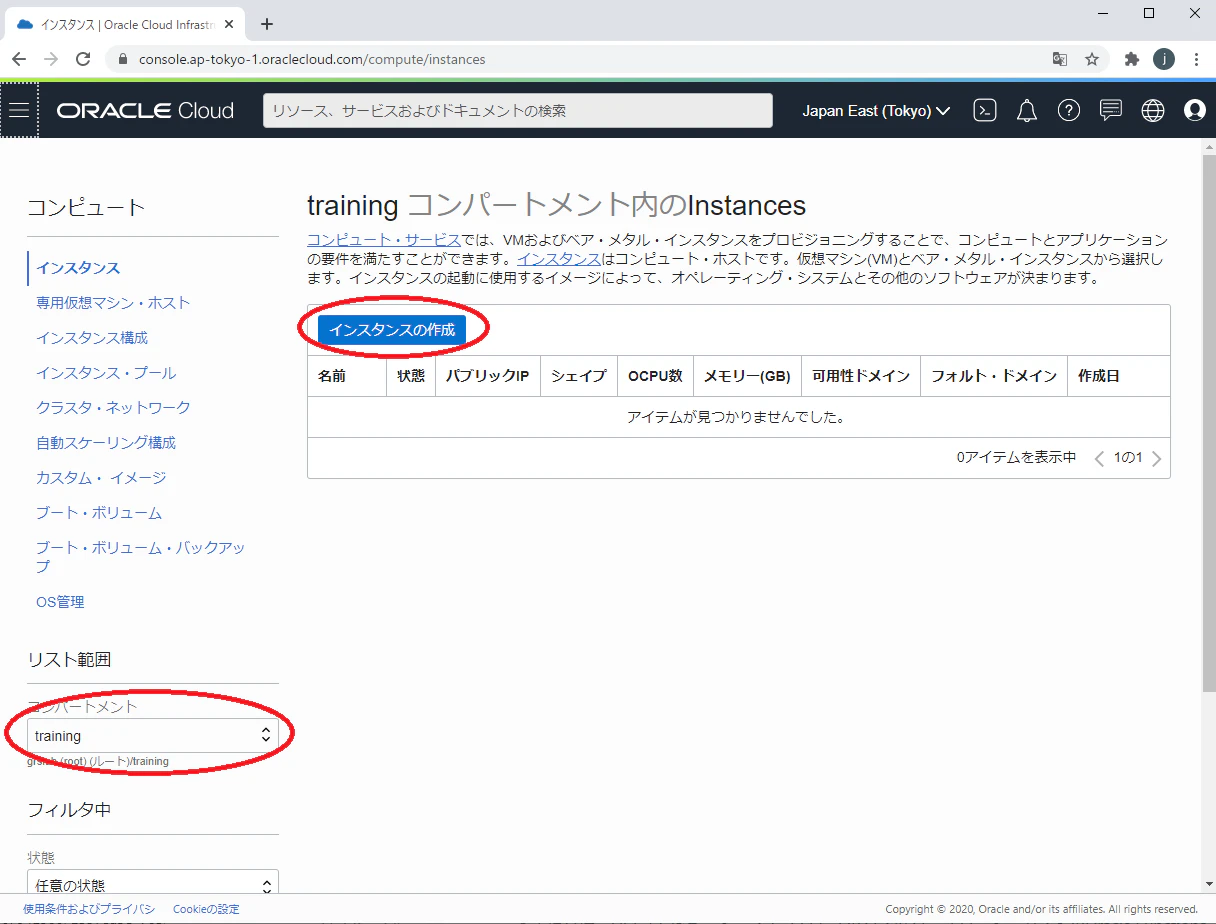

1.OracleCloudのコンソールにログインします。

2.ナビゲーション・メニューを開いて「コンピュート」⇒「インスタンス」をクリックします。

3.Oracle Functionsを所有するコンパートメントを選択して、「インスタンスの作成」をクリックします。

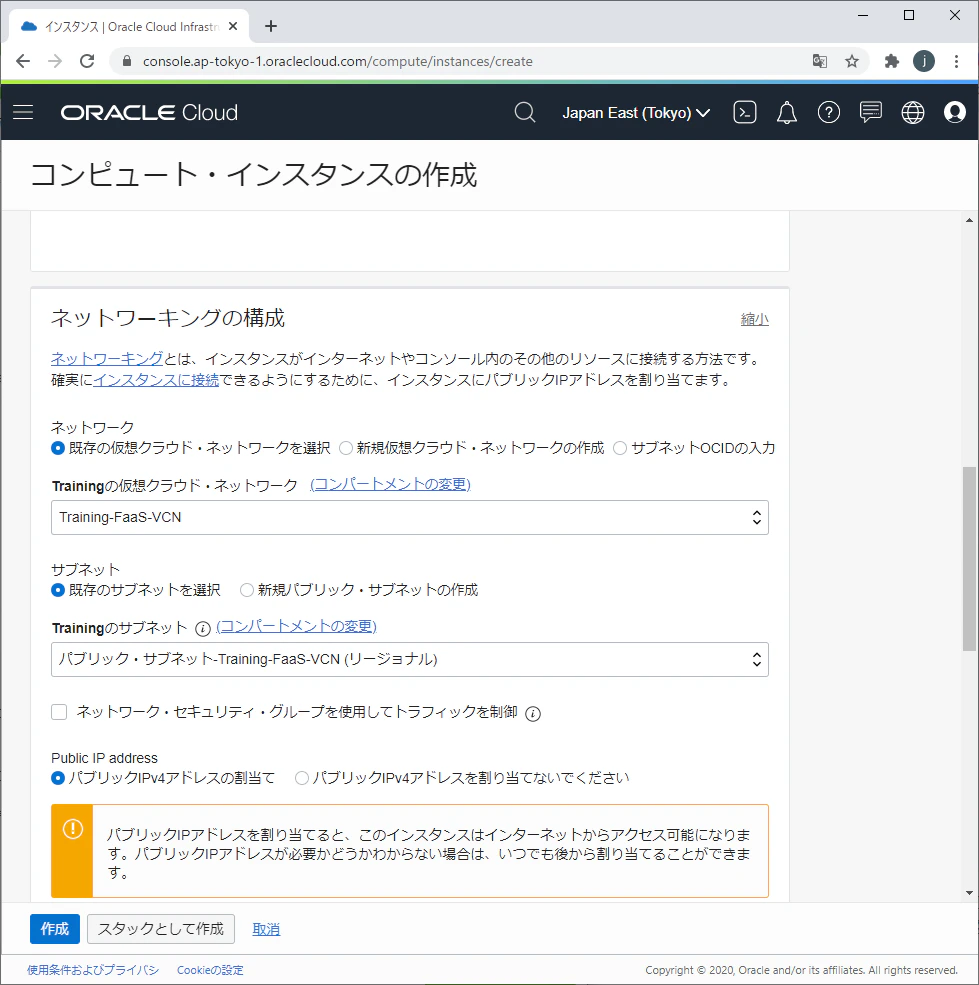

4.インスタンスの作成画面で、「Oracle Cloud Developer Image」イメージを選択します。

5.リモートからアクセスできるように、Oracle Functionsと同じVCNを選択し、「パブリック・サブネット」及び「パブリックIPv4アドレスの割当て」を選択します。

6.SSHキーとデータボリュームを設定して、「作成」ボタンをクリックしてインスタンスを作成します。インスタンスはFunctions及びリポジトリにアクセスできるように権限付与します。

1.新規作成したインスタンスの詳細画面を開いて、インスタンスのOCIDをコピーします。

2.ナビゲーション・メニューを開いて「アイデンティティ」⇒「動的グループ」をクリックします。

3.「動的グループの作成」をクリックして、動的グループの作成画面を開きます。

4.動的グループの作成画面で、インスタンスのID及びコンパートメントのIDを入力します。

例:

Any {instance.id = 'ocid1.instance.oc1.XXXXX', instance.compartment.id = 'ocid1.compartment.oc1..XXXX'}

※コンパートメントのOCIDはコンパートメントの詳細画面で、コピーできます。

5.ナビゲーション・メニューを開いて「アイデンティティ」⇒「ポリシー」をクリックします。

6.ルート・コンパートメントを選択して、「ポリシー作成」をクリックします。

7.ポリシー作成画面で、ポリシーを入力して、「作成」ボタンをクリックします。

例:

Allow dynamic-group Training-FaaS-DyGRP to manage functions-family in compartment <コンパートメント名>

Allow dynamic-group Training-FaaS-DyGRP to use virtual-network-family in compartment <コンパートメント名>

Allow dynamic-group Training-FaaS-DyGRP to read repos in tenancy

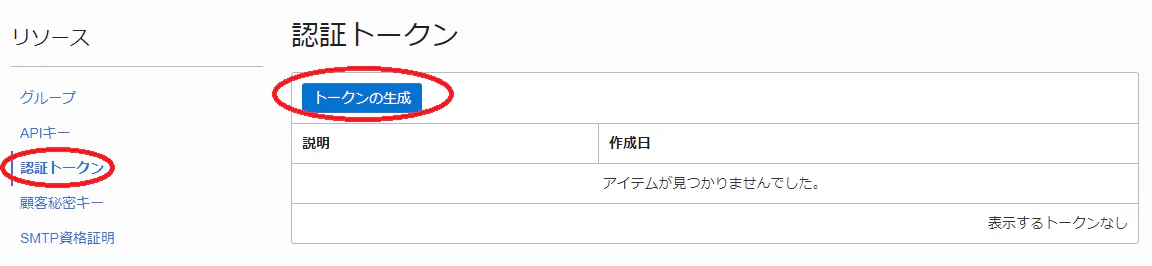

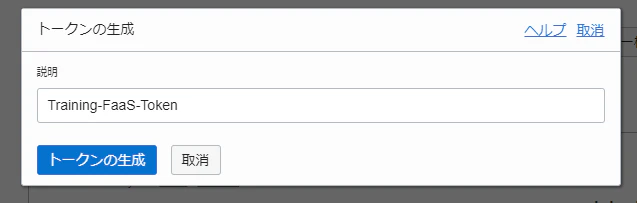

Oracle Functionsを実施するOracleクラウドユーザーのAuth Token を取得

1.OracleCloudのコンソールにログインします。

2.ナビゲーション・メニューを開いて「アイデンティティ」⇒「ユーザー」をクリックします。

3.ユーザー一覧画面で、対象ユーザーをクリックして、ユーザーの詳細画面に遷移します。

4.ユーザー詳細画面で、「認証トークン」をクリックして、「認証トークンの作成」をクリックします。

5.説明を記載して、「トークンの生成」をクリックします。

6.トークンの作成画面を表示して、トークンをコピーして、保存します。

この画面を閉じたら、トークンの再表示ができないため、トークンの再作成が必要!!2.Oracle Functionsの実行環境作成

Oracle Functionsの開発環境作成

Oracle Functionsの開発環境を構成するには、以下3つの方法があります。

・クラウド・シェルの設定

・ローカル・マシンの設定

・Oracle Cloud Infrastructureコンピュート・インスタンスの設定最も簡単な方法ではクラウド・シェルを利用して、Functionsの開発環境を構築します。本記事は「Oracle Cloud Infrastructureコンピュート・インスタンス」を使用してFunctionsの開発環境を構成します。

1.環境準備で作成したインスタンスにログインします。

2.Dockerのバージョンを確認します。$ sudo docker version Client: Docker Engine - Community Version: 18.09.8-ol API version: 1.39 Go version: go1.10.8 Git commit: 76804b7 Built: Fri Sep 27 21:00:18 2019 OS/Arch: linux/amd64 Experimental: false Server: Docker Engine - Community Engine: Version: 18.09.8-ol API version: 1.39 (minimum version 1.12) Go version: go1.10.8 Git commit: 76804b7 Built: Fri Sep 27 20:54:00 2019 OS/Arch: linux/amd64 Experimental: false Default Registry: docker.ioデフォルトでは一般ユーザーがDockerを使用する際は、sudoで実施します。一般ユーザーでファンクションをデプロイする際に、Dockerの権限がないと、デプロイ失敗します。

一般ユーザーでDockerを使えるように、対象ユーザーはDockerグループに追加が必要!!

本記事はopcユーザーを使用するため、以下のように設定して、opcユーザーは再度ログインします。$sudo usermod -g docker opc $sudo /bin/systemctl restart docker.service ####opcユーザーでインスタンスに再度ログイン $ docker info Containers: 3 Running: 0 Paused: 0 Stopped: 3 Images: 1 Server Version: 18.09.8-ol (略)3.FnProject CLIをインストールします。

OracleDevelopイメージはFnProject CLIを含まれていないため、インストールが必要です。$ curl -LSs https://raw.githubusercontent.com/fnproject/cli/master/install | sh fn version 0.6.1 ______ / ____/___ / /_ / __ \ / __/ / / / / /_/ /_/ /_/` $ fn version Client version is latest version: 0.6.1 Server version: ?4.Oracle Cloudのリポジトリにログインします。

リポジトリにログインする前に、Oracle Cloud ナビゲーション・メニューを開いて「管理」⇒「テナンシ詳細」の「オブジェクト・ストレージ・ネームスペース」の値を取得してコピーします。$ docker login <region-key>.ocir.io Username: <object-storage-namespace>/<username> Password:<user's AuthToken> WARNING! Your password will be stored unencrypted in /home/opc/.docker/config.json. Configure a credential helper to remove this warning. See https://docs.docker.com/engine/reference/commandline/login/#credentials-store Login Succeeded「Login Succeeded」が表示されたら、Oracle Cloudのリポジトリにログイン成功!!

※は3文字の英文であり、各リージョンのリージョンキーはここで確認できます。東京リージョンでは「nrt」となります。

5.FnProject CLIをセットアップ

####FN CLIのコンテキストをリストします。 $ fn list context CURRENT NAME PROVIDER API URL REGISTRY * default default http://localhost:8080 ####新しいFN CLIのコンテキストを作成します。 ######Oracle Cloudのインスタンで構築する場合、パラメータ「--provider oracle-ip」が必要 $ fn create context <context-name(任意)> --provider oracle-ip Successfully created context: training-faas ####新規したコンテキストを使用することを指定します。 $ fn use context training-faas Now using context: training-faas ####FN CLIのコンテキストを再度リストします。 $ fn list context CURRENT NAME PROVIDER API URL REGISTRY default default http://localhost:8080 * training-faas oracle-ip ####コンパートメントIDとOracle Functions API URLでコンテキストを更新します ######コンパートメントの詳細画面でコンテキストのIDを取得できます。 $ fn update context oracle.compartment-id <対象コンパートメントのID> Current context updated oracle.compartment-id with ocid1.compartment.oc1.XXXXX ######以下は東京リージョンのAPI-URLの例です。 $ fn update context api-url https://functions.ap-tokyo-1.oraclecloud.com Current context updated api-url with https://functions.ap-tokyo-1.oraclecloud.com ####Oracle Functionsを使用するレジストリの場所でコンテキストを更新します $ fn update context registry nrt.ocir.io/nretiuoewxik/<リポジトリ名(任意)> Current context updated registry with nrt.ocir.io/<object-storage-namespace>/training-repoここまでで、Functionsの開発環境の構築が完了しました。この環境でFunctionsの作成、デプロイ、実行をできます。

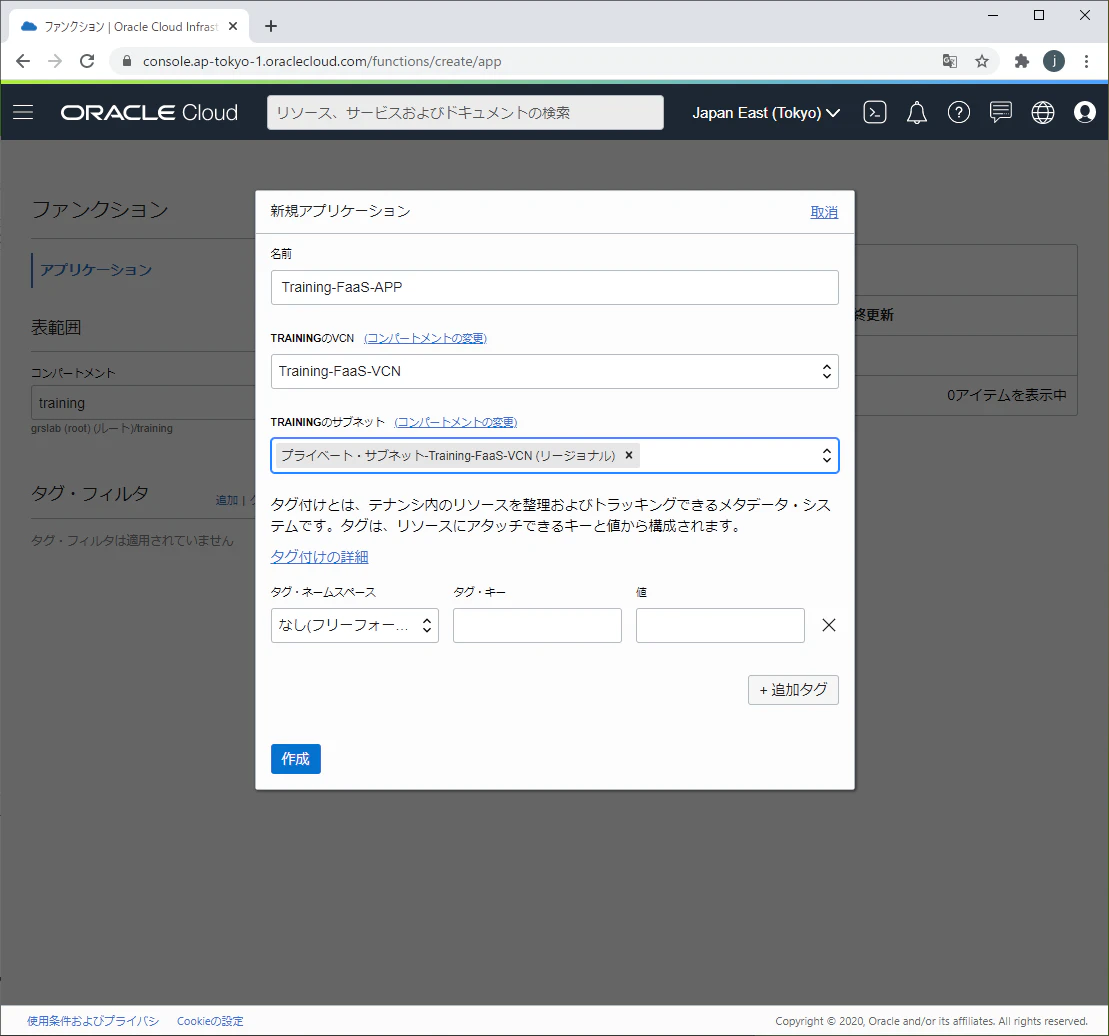

Oracle Functionsのアプリケーション作成

1.OracleCloudのコンソールにログインします。

2.ナビゲーション・メニューを開いて「開発者サービス」⇒「ファンクション」をクリックします。

3.Oracle Functionsを所要するコンパートメントを選択して、「アプリケーションの作成」をクリックします。

4.「アプリケーションの作成」画面でアプリケーションの名前、所属VCN及びサブネットを選択して「作成」ボタンをクリックします。

Oracle Functions作成

現時点でOracle Functionsは「go、java、node、python」をサポートします。

本記事はPythonを使ってファンクションの作成、デプロイ及び実行を行います。1.ファンクションを初期化

$ fn init --runtime python <functions-name> Creating function at: ./training-func1 Function boilerplate generated. func.yaml created. ####ファンクションを初期化したら<functions-name>でフォルダを作成し、以下のファイルを作成されます。 $ ls -l <functions-name> total 12 -rw-r--r--. 1 opc opc 576 Dec 15 10:03 func.py -rw-r--r--. 1 opc opc 143 Dec 15 10:03 func.yaml -rw-r--r--. 1 opc opc 3 Dec 15 10:03 requirements.txt「func.yaml」はファンクションの定義ファイル

例:schema_version: 20180708 name: training-func1 version: 0.0.1 runtime: python entrypoint: /python/bin/fdk /function/func.py handler memory: 256「func.py」はファンクションのソースコードが記載されたファイルです。初期化した際に、「hello-world」のソースコードが作成されます。

※Fn project で Python を書く際に、必ず handler 関数を使用する必要があります。Oracle Functions は Cloud 上のイベントサービスによって作動し、handler 関数はイベント情報が書かれた JSON ファイルを読み取るために使用されます。

例:import io import json import logging from fdk import response def handler(ctx, data: io.BytesIO = None): name = "World" try: body = json.loads(data.getvalue()) name = body.get("name") except (Exception, ValueError) as ex: logging.getLogger().info('error parsing json payload: ' + str(ex)) logging.getLogger().info("Inside Python Hello World function") return response.Response( ctx, response_data=json.dumps( {"message": "Hello {0}".format(name)}), headers={"Content-Type": "application/json"} )「requirements.txt」はファンクションのソースコード内でインポートするパッケージを記述するファイルです。

アプリケーションをデプロイする際に記述されたパッケージが自動で Docker コンテナにインストールします。

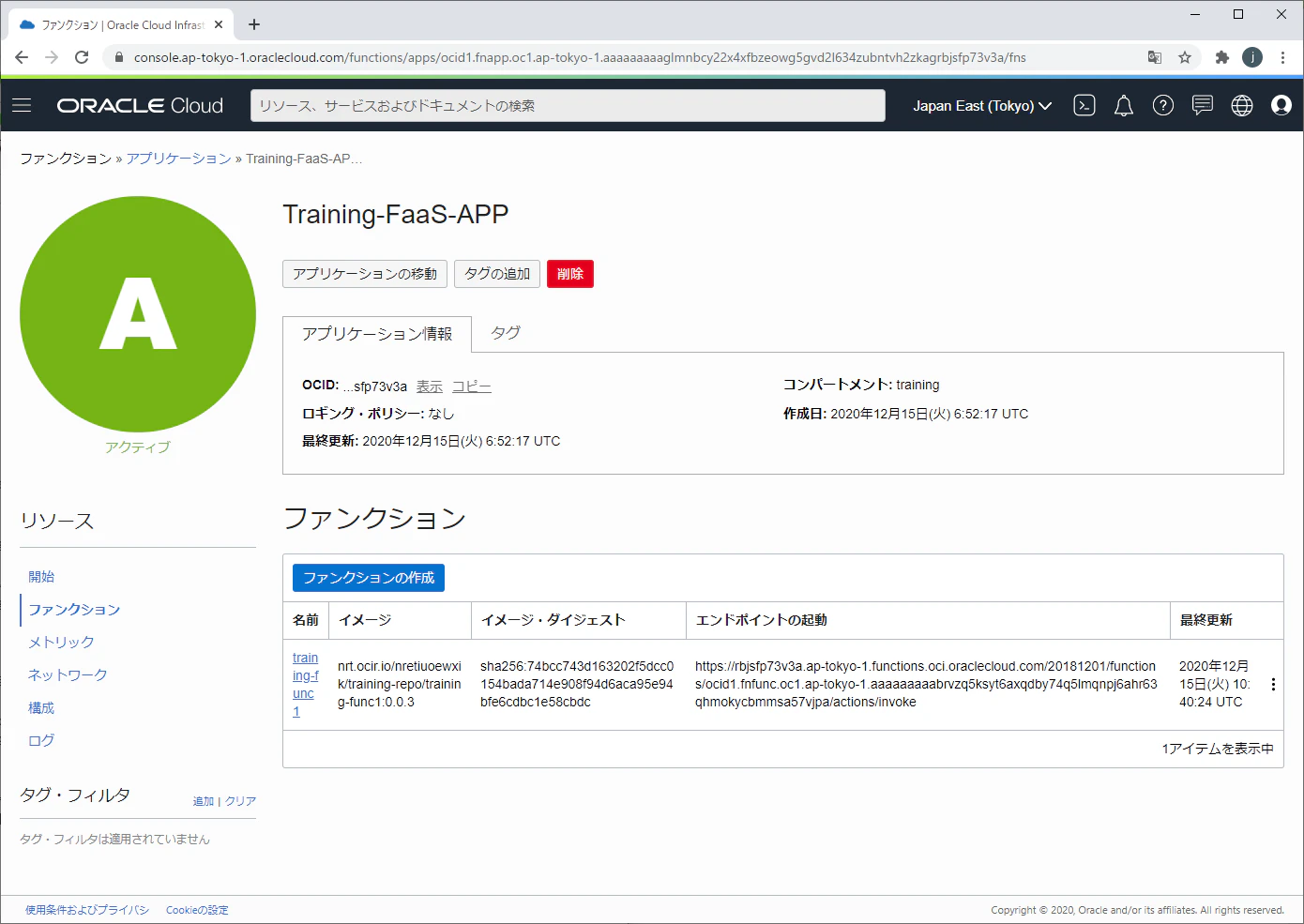

例:fdk2.ファンクションをデプロイします。

$ cd <functions-name> $ fn deploy --app <作成したアプリケーション名> Deploying training-func1 to app: Training-FaaS-APP Bumped to version 0.0.3 Building image nrt.ocir.io/<object-storage-namespace>/training-repo/training-func1:0.0.3 .............................................................. Parts: [nrt.ocir.io <object-storage-namespace> training-repo training-func1:0.0.3] Pushing nrt.ocir.io/<object-storage-namespace>/training-repo/training-func1:0.0.3 to docker registry...The push refers to repository [nrt.ocir.io/<object-storage-namespace>/training-repo/training-func1] f4688b2e9584: Pushed 8298236c4bc1: Pushed 2d864fd289b8: Pushed 77237016429d: Pushed 99c8d794f17e: Pushed 83adc987852c: Pushed bb38c3f3fcc5: Pushed 9f72a1f4c21f: Pushed 6280b41d048d: Pushed bd8e6688d36c: Pushed 07cab4339852: Pushed 0.0.3: digest: sha256:74bcc743d163202f5dcc0154bada714e908f94d6aca95e94bfe6cdbc1e58cbdc size: 2621 Updating function training-func1 using image nrt.ocir.io/<object-storage-namespace>/training-repo/training-func1:0.0.3... Successfully created function: training-func1 with nrt.ocir.io/<object-storage-namespace>/training-repo/training-func1:0.0.3Oracle Cloudをログインして、ナビゲーション・メニューを開いて「開発者サービス」⇒「コンテナ・レジストリ」をクリックします。

ファンクションがデプロイされたことを確認できます。

ナビゲーション・メニューを開いて「開発者サービス」⇒「コンテナ・レジストリ」をクリックし、作成したアプリケーションの詳細画面でデプロイしたファンクションが確認できます

最後、ファンクションを実行してみよう!

$ fn invoke Training-FaaS-APP training-func1 {"message": "Hello World"}まとめ

Oracle Cloud のインスタンスでファンクションのデプロイ環境の構築及びデプロイサンプルを紹介しました。

Oracle FunctionsはAPIゲートウェイもしくはイベントと連動してバッチジョブの構成もできます。

ご興味がある方、試してみてください。参考:

https://docs.cloud.oracle.com/ja-jp/iaas/Content/Functions/Concepts/functionsoverview.htm以上

- 投稿日:2020-12-15T20:06:42+09:00

RhinocerosでモデリングしたネットワークをPythonで読み込む①

建築・都市計画数理のなかでも、特にポピュラーなものがネットワーク分析でしょう。建築や都市を、ネットワークとして抽象的に表現することにより、数理的に扱いやすい形にしたうえで分析やシミュレーションを行うことは常套手段です。

目標

- Rhinocerosでネットワークを描く

- Rhinocerosで描いたネットワークをPythonで読み込めるように書き出す

- 書き出したファイルをPythonで読み込んで隣接配列を作る

本記事では第1項に取り組みます。

建築・都市の中のネットワーク

建築や都市の中には、様々なネットワークが織り込まれています。

対象 ノード エッジ 建築平面 部屋,開口部 廊下,通路 道路 交差点,建物出入口 道路 鉄道 駅 線路 ネットワークはノードとエッジからなっており、エッジには(時にはノードにも)"重み"が与えられています。重みは、そのエッジを通過するのに必要な移動距離、時間(時間距離)、費用(金銭距離)などを設定できます。重みの与え方ひとつで、分析の幅と面白さはぐんと上がります。

Rhinocerosでネットワークを描く

とにもかくにも、ネットワークを描いてみましょう。今回はRhinocerosというCADソフトを使ってネットワークを描いてみます。建築界隈の人の中には、Rhinocerosに明るい人がいるかもしれません。Rhinocerosは、そのなかでPythonを動かすことができるので、建築・都市計画の数理的な研究をする上では非常に使い勝手が良いです。今回は、下の地図(国土地理院地図)をもとに歩行空間ネットワークを描いてみます。

ネットワークを描くルールは統一する

道路中心線などの公のベクターデータがあればそれを用いれば良いですが、ない場合には自分で線を引っ張る必要があります。そのときに大事なのが、自分で決めたルールを守ることです。おそらく、皆さんがご自身でネットワークを描くときには、「曲がった道路をどうしようか」とか「建物をネットワークにどう接続しようか」とかに頭を悩ませることでしょう。実際、ネットワーク分析はネットワークの描き方に結果が大きく影響されることがあります。重要なのは、その結果がネットワークの描き方によるものなのか、本質的なものなのかを判別できるようにしておくことです。そのためにも、一度決めたルールをネットワーク全体で統一させておく必要があります。

今回は歩行空間ネットワークを描きますが、これに関して国土交通省より示されている整備仕様案1に従います。すると、下の図のようなネットワークになります。

今回、ネットワークは平面上にあるので、自己交差するようなエッジはありません。歩道橋や地下道などがある場合には、それらも含めてモデリングすると、より精緻な分析ができます。【次回】Rhinocerosで描いたネットワークを

Pythonで読み込めるように書き出すさて、Rhinocerosでネットワークを描き終えた後、分析するにあたり、そのネットワークをプログラミング言語が理解できるようなデータに翻訳してあげる必要があります。次回は、そのデータ構造と、データの作り方について説明します。

ホームページのご案内

建築・都市計画数理に関する私の研究の内容や、研究にまつわるtips等は、個人ホームページにて公開しています。ゆくゆくは、気軽に使える分析ツールも作っていきたいと思っているので、ぜひ覗きに来てください。

→田端祥太の個人ホームページ参考文献

- 投稿日:2020-12-15T19:49:19+09:00

deepchemのNormalizationTransformerはtransform_X = Trueにしようという話

ことの発端