- 投稿日:2020-12-12T23:59:32+09:00

LeetCodeに毎日挑戦してみた 104. Maximum Depth of Binary Tree(Python、Go)

Leetcodeとは

leetcode.com

ソフトウェア開発職のコーディング面接の練習といえばこれらしいです。

合計1500問以上のコーデイング問題が投稿されていて、実際の面接でも同じ問題が出されることは多いらしいとのことです。golang入門+アルゴリズム脳の強化のためにgoとPythonで解いていこうと思います。(Pythonは弱弱だが経験あり)

23問目(問題104)

104. Maximum Depth of Binary Tree

問題内容

Given the

rootof a binary tree, return its maximum depth.A binary tree's maximum depth is the number of nodes along the longest path from the root node down to the farthest leaf node.

(日本語訳)

root二分木のが与えられた場合、その最大深度を返します。二分木の最大深度 は、ルートノードから最も遠いリーフノードまでの最長パスに沿ったノードの数です。

Example 1:

Input: root = [3,9,20,null,null,15,7] Output: 3Example 2:

Input: root = [1,null,2] Output: 2Example 3:

Input: root = [] Output: 0Example 4:

Input: root = [0] Output: 1考え方

rootが存在しない場合、left,rightにアクセスするとエラーになるので例外処理をはじめにします

左の二分木と右の二分木それぞれ再帰処理で潜っていきます。

その二分木の左の二分木と右の二分木の大きい方をreturnします。

- 解答コード

class Solution: def maxDepth(self, root): if not root: return 0 return 1 + max(self.maxDepth(root.left), self.maxDepth(root.right))

- Goでも書いてみます!

func maxDepth(root *TreeNode) int { if root == nil { return 0 } return diveNode(root.Left, root.Right, 1) } func diveNode(p *TreeNode, q *TreeNode, count int) int { if p != nil && q != nil { return max(diveNode(p.Left, p.Right, count+1), diveNode(q.Left, q.Right, count+1)) } else if p != nil { return diveNode(p.Left, p.Right, count+1) } else if q != nil { return diveNode(q.Left, q.Right, count+1) } else { return count } } func max(values ...int) int { ret := values[0] for _, v := range values { if ret < v { ret = v } } return ret }

- 投稿日:2020-12-12T23:57:40+09:00

アイトラッカー作ってみた.

- この記事はOpenCV Advent Calendar 2020の13日目の記事です。

- 他の記事は目次にまとめられています。

概要

私はこれまで、弱視であるがゆえに様々な不便を感じてきたした。しかし、情報技術の発展に伴い、この弱視と情報技術を組み合わせることによって、逆に弱視であるがゆえに便利な生活が送れるのではないかと考えました。試作を重ねた結果、弱視の性質とOpenCVを活用することで安価にアイトラッカーを作成できました。よって本投稿では、弱視を活用するために作成したアイトラッカーについてまとめます。

はじめに

弱視とは

世には弱視と呼ばれる人が一定数存在します。のび太君のような目の悪さは、眼球のピントのズレ等によって引き起こされるので、眼鏡をかけることによってある程度軽減されます。

しかし、弱視は視神経自体が細かったり、網膜がうまく機能しない等によって引き起こされるので、眼鏡等を使用しても視力はあまり改善しません。私の場合、視界すべてにバイラテラルフィルタ(大変わかりやすい解説)がかかったように見えます。

この弱視のややこしいところは、片目だけ弱視になる場合がある点です。こうなってしまうと、左右の目に視力差が生じるため、距離推定がすこぶる苦手になってしまいます。また、見える画像全体にバイラテラルフィルタがかかったようになるので、人の顔の判別も不得意になります。

ではどうするか

アイトラッカーで視線を追うことでどの物体を見ているか大まかに特定し、高性能なカメラを用いてその物体を撮影すれば解決できると考えました。

距離推定が苦手な場合は、注目している物体をアイトラッカーで特定し、二台のカメラを組み合わせて三角測量を行うことで対象物への距離が推定できます。人の顔を特定したい場合は、適当なニューラルネットと組み合わせれば十分に解決できると考えたのです。

なぜわざわざ作るのか

既存のアイトラッカーは確かに高性能ですが、高価であります。私にそんな高価なデバイスを買う余裕はありません。また、視力が非常に低いという弱視の特性を使えば、大変安価にアイトラッカーを作成できると考えたからです。

作ってみる

ハードウェア編

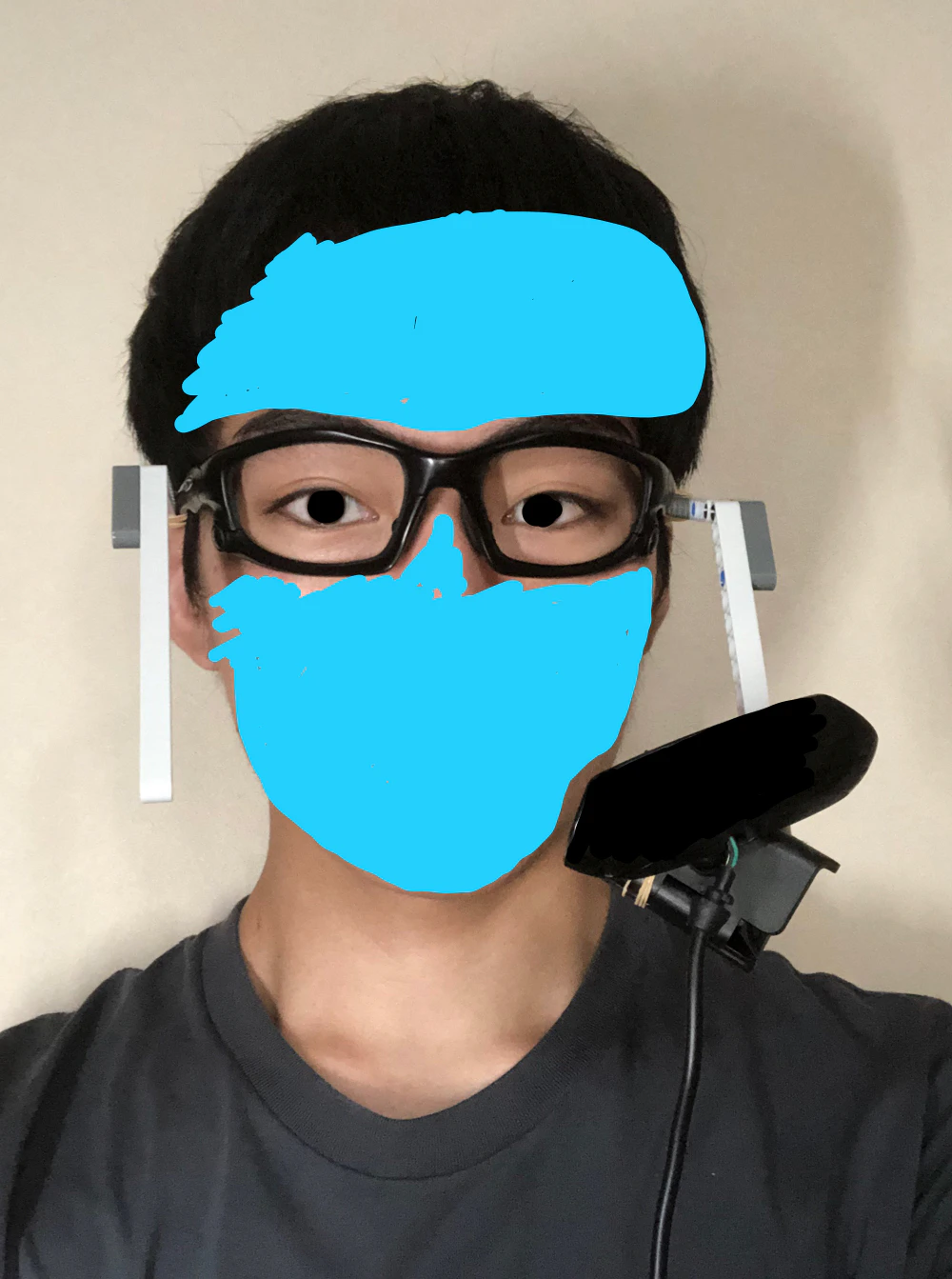

コードでいくら工夫してもデータが汚ければうまくいかないので、きれいなデータを得られるハードをつくってみます。画像中に不自然なところがいくつかあります。これは、気持ち程度のプライバシー保護であって、結果の捏造ではありません。

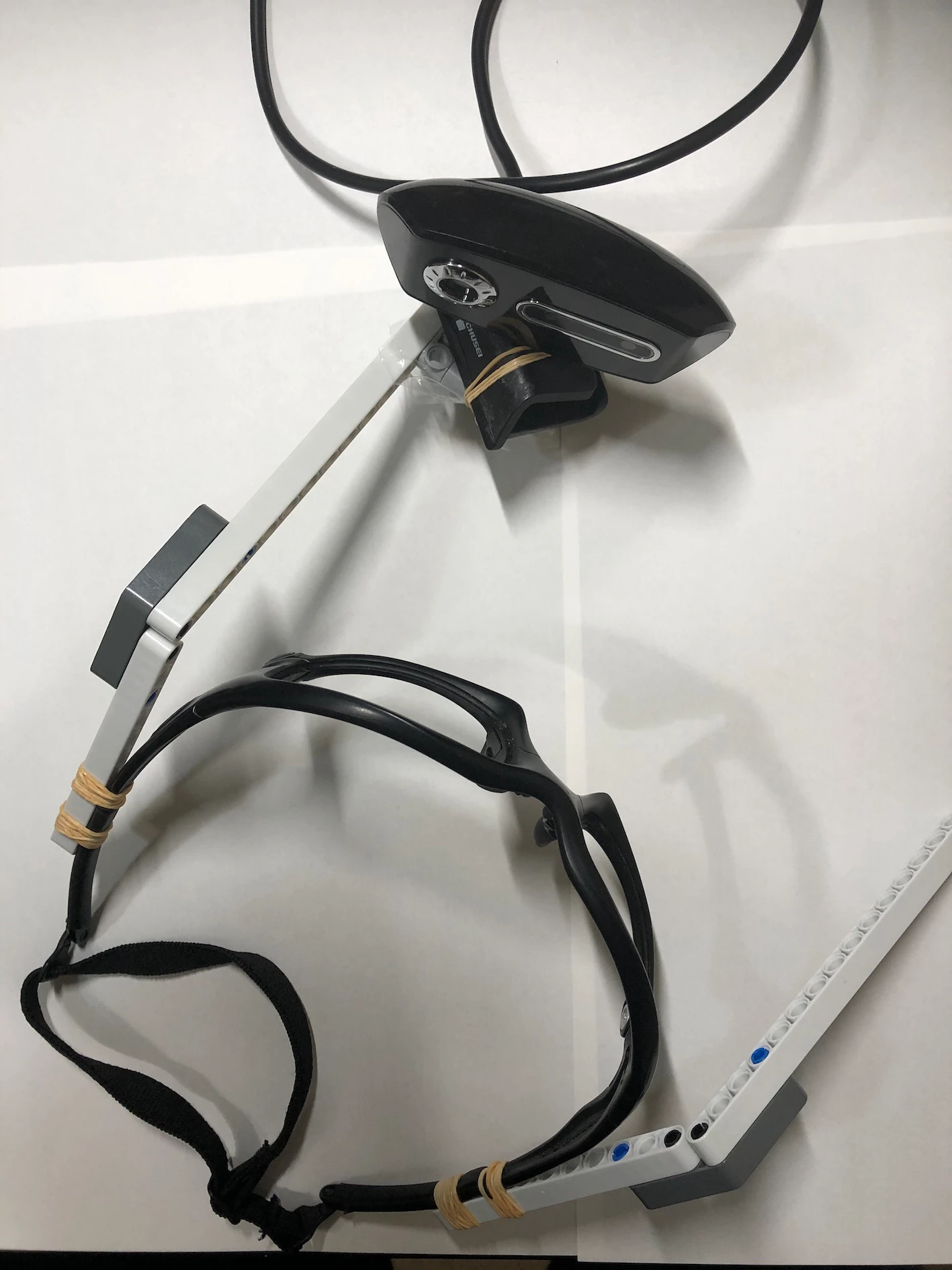

試作一号機

弱視は視力が弱い≒ほとんど見えていない->目の前にカメラを置いても問題ない

という飛躍した論理のもと、適当なWEBカメラとメガネを組み合わせて作ってみました。

文字通り目の前にカメラを設置してみました。しかし、弱視でほとんど見えていないといっても、左目は平衡感覚にはある程度寄与しているらしく、装着後に大変酔ってしまったのでこの構造が不適であることがわかりました。

試作二号機

一号機はフレームが貧弱だったため、目の前にカメラを設置するしかありませんでした。そのため、フレームをスポーツサングラスやプラスチックアームなど頑丈な素材で作ってみました。

つけてみた。

一号機より下にカメラをつけたので、酔いなどの問題も発生しませんでした。そのため、このシステムをもとにコードを書いていきます。

コード編

黒目と視線方向は一致しているため、画像解析によって黒目の中心を検出することを目標とします。

なお、ハードウェア本体に照明を取り付けることによって、二値化処理のみで黒目を抜き出すことに成功しました。円検出

ほとんどの場合黒目は円形であるので、円検出で黒目の方向を特定できると考えました。そこで、ハフ変換を用いた円検出を試しました。

import cv2 import numpy as np img = cv2.imread("frame.jpg") gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY) # 照明を当てることで明るさを一定にしたので、固定パラメータでも黒目の検出が可能になりました。 ret,th = cv2.threshold(gray,65, 255,cv2.THRESH_BINARY_INV) medimg = cv2.medianBlur(img,5) circles = cv2.HoughCircles(medimg,cv2.HOUGH_GRADIENT,1,20, param1=200,param2=13,minRadius=0,maxRadius=0) circles = np.uint16(np.around(circles)) for i in circles[0,:]: # 外側の円を書きます cv2.circle(img,(i[0],i[1]),i[2],(0,255,0),2) # 内側の円を書きます cv2.circle(img,(i[0],i[1]),2,(0,0,255),3) cv2.imwrite('detected.jpg',img)上の画像をこの処理にかけると下の画像のようになります。

このように、ある程度は検出できているように感じられます。赤色が検出された中心です。

しかし、この処理のままでは複数の円を検出できるので、複数の視線方向が検出されます。つまり、正しい視線方向を求めることができません。また、ハフ変換はアルゴリズム的に多少遅いので、リアルタイム処理が求められるアイトラッカーには不向きであると判断しました。

重心検出

先ほどの円検出には、黒目を円としてしか検出できないという致命的な欠点があります。

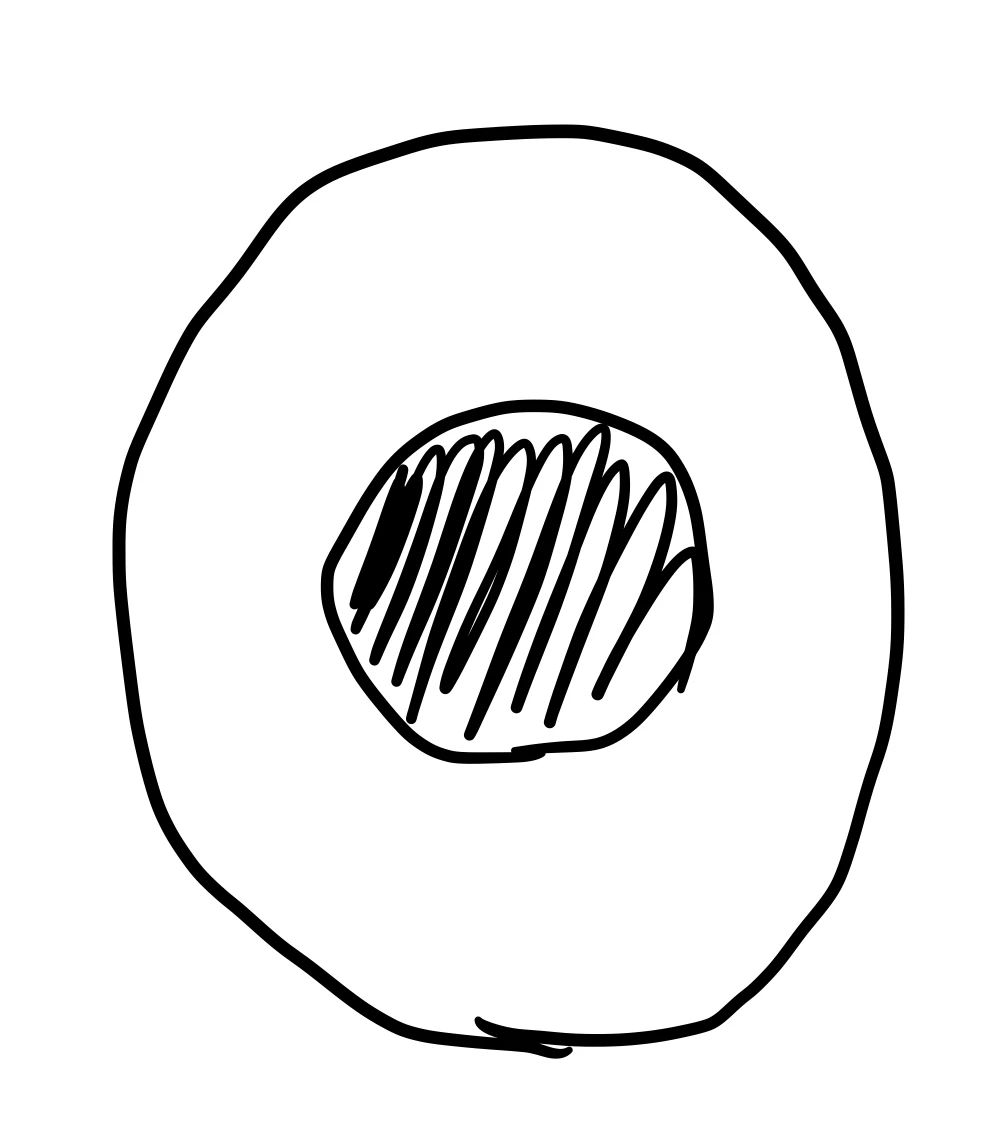

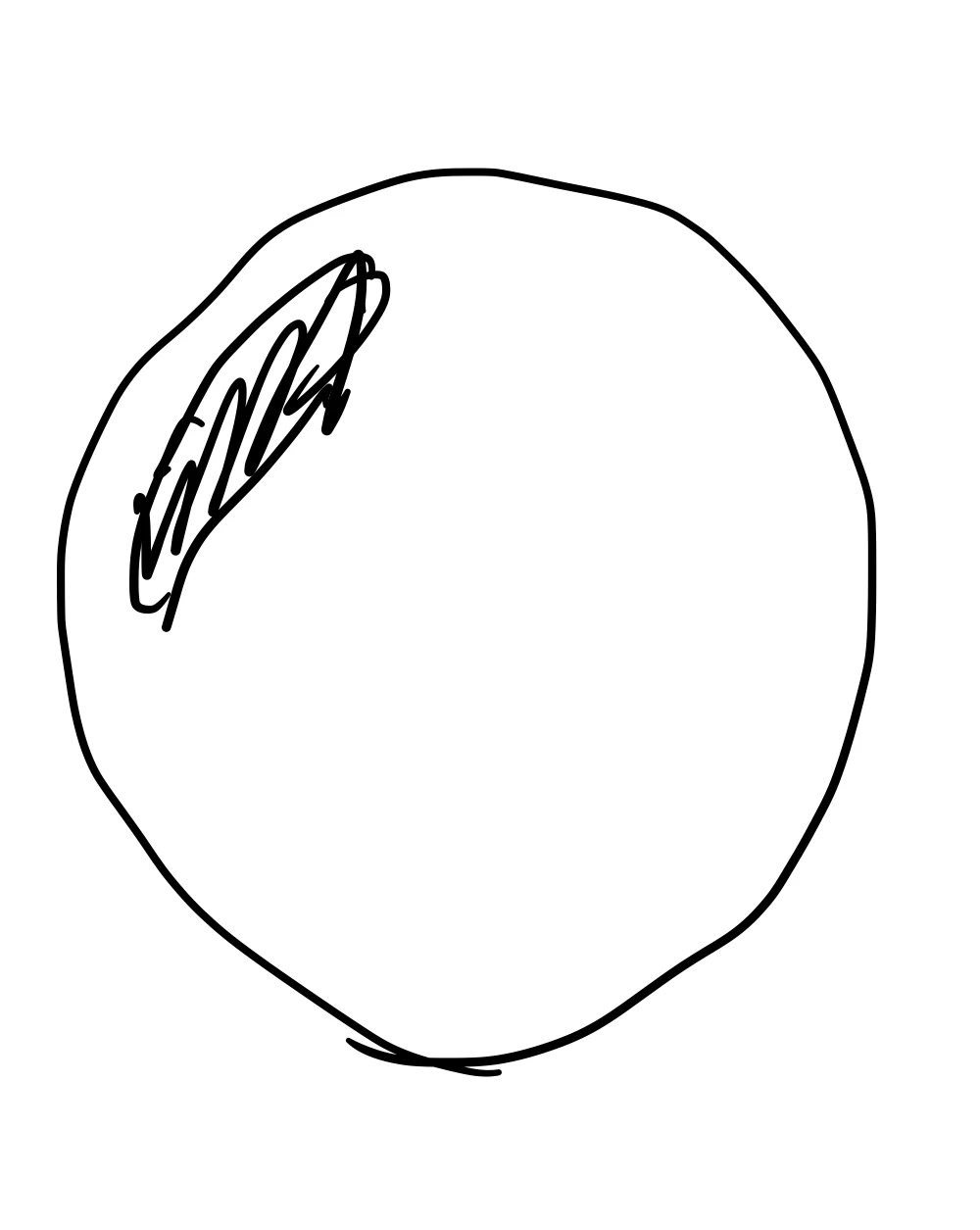

下図ような黒目は円として検出してもなんら問題はありませんが、

下図のように黒目が偏った際に、黒目を円として検出することは適切ではありません。

そこで、偏りに対して頑健であると考えられる重心を用いての検出を試しました。

import cv2 frame = cv2.imread("frame.jpg") gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) # 照明を当てることで明るさを一定にしたので、固定パラメータでも黒目の検出が可能になりました。 ret,th = cv2.threshold(gray,65, 200,cv2.THRESH_BINARY_INV) # 最大の面積を持つ輪郭を探します _, contours, _ = cv2.findContours(th, 1, 2) cnt = contours[0] for c in contours: if len(cnt) < len(c): print(c) cnt = c # 最大の面積を持つ輪郭の重心を求めます M = cv2.moments(cnt) cx = int(M['m10']/M['m00']) cy = int(M['m01']/M['m00']) cv2.circle(frame, (cx, cy), 5, (0, 255, 255), thickness=-1)上の画像をこの処理にかけると、下の図のようになります。

このように、綺麗に検出できました。黄色の点が検出された中心です。

まとめ

- 弱視の特徴を使うと、大変安価にアイトラッカーを作成できる。

- 重心を用いることで、広範囲にわたる視線方向が検知できる。

終わりに

本投稿では、私が自身の不自由を解決するために作成してきたアイトラッカーについてまとめてきました。大変しょぼいまとめで恐縮ですが、不便と思われがちな障害とコンピューター(そしてOpenCV!!!!)を組み合わせることで、安価に身体機能を拡張でき、むしろ便利な生活が送れる可能性があることを知っていただけたら幸いです。

明日(12/14)は、@UnaNancyOwen さんの「たぶんDNNモジュールでやってみた系のなにか」です。ご精読ありがとうございました。

資料

動作環境

- OpenCV 3.6 (手持ちのノートパソコンを壊したので断言はできません。ごめんなさい。)

費用

フレーム アーム(カメラ台) カメラ 試作一号機 100円(部屋に落ちていた) 2円(割り箸) 200円 試作二号機 30,000円(Oakleyのサングラス) 10円(LEGOのパーツ) 200円

- 投稿日:2020-12-12T23:08:30+09:00

【Django】annotateを使って高度なorder_byを書く方法

Djangoの

.all()や.filter()で値を取得した結果得られるオブジェクトは、Pythonのリストであり、各要素は辞書型になっています。Pythonにおいて、「各要素が辞書になっているリストで、特定のkeyの値に応じて並べ替えを行う」という処理はfor文で回す必要があり、コードもやや煩雑になるので、できればレコード取得と同時に

.order_by()で並べ替えを完了させておきたい所です。そんな時に、.annotate()を用いることでより高度な並べ替えを行う方法を紹介したいと思います。※ querysetの基本的な扱いを理解していることを前提とした記事になっているので、

.all()や.filter()、.order_by()などが分からない方は先に下記の記事などを参照していただければ幸いです。参考:

Django逆引きチートシート(QuerySet編)annotateとは

「annotate」とは、「注釈をつける」という意味を持った英単語です。使用方法としては、他のクエリメソッド同様、レコード取得の後に

.で連結する形になります。Book.objects.all().annotate(new_field="hoge")これを使用すれば、「モデルが持っているフィールドに加えて、こちらで指定したフィールドを追加で出力する」ということができるようになります。

ちなみに、docstringには下記のような説明が書かれています。

Return a query set in which the returned objects have been annotated with extra data or aggregations. (返されたオブジェクトが、追加データや集約でアノテーションされているクエリセットを返す)参照: https://github.com/django/django/blob/master/django/db/models/query.py

テーブル例

説明のため、下記のようなテーブルがあるとします。

テーブル 説明 Book 本の情報を保持する。 AwardBook 受賞歴のある本のIDを保持する。 これは、Djangoのモデルでは下記のように書けます。

from django.db import models class Book(models.Model): id = models.AutoField(primary_key=True) title = models.CharField(max_length=50) # 本の題名 price = models.IntegerField() # 本の値段 class AwardBook(models.Model): id = models.AutoField(primary_key=True) book = models.ForeignKey(Book, on_delete=models.CASCADE) # 受賞歴のある本のID※「Bookテーブルに受賞歴フラグを持たせれば良い」という話ではありますが、今回はあくまで簡略化した例なので、諸事情でテーブルを分ける必要があることとします。

使い方の例

例えば、本の一覧を取得した後、値段が安い順(=昇順)に並べ替えたい場合、下記のように書けます。

queryset = Book.objects.all().order_by("price")ちなみに、値段が高い順(=降順)にしたい場合、フィールド名の最初に

-を付けます。queryset = Book.objects.all().order_by("-price")ただし、複数の要素で並べ替えをしなくてはならず、その条件が下記のような場合はどうすれば良いでしょうか。

優先①: 受賞歴がある

優先②: 値段が安い

filterを使えば、「受賞歴のある本のみを取得する」ことは出来ますが、それ以外の本を同時に取得することが出来ません。そんな時、annotateを使えば次のように書くことが出来ます。from django.db.models import Case, When, Value, IntegerField from .models import Book, AwardBook # 受賞歴のあるの本のIDを取得する award_book_ids = set( # 計算量を減らすため、setに変換 AwardBook.objects.all().values_list( "book_id", flat=True ) ) # 並び替えを行いつつ、本一覧を取得 queryset = ( Book.objects.all() .annotate( # annotateで新しいフィールドを付与 # 「受賞歴があるかどうか」を表すフラグ award_flg=Case( # 本のIDが「award_book_ids」に含まれている場合、値を1に設定 When(id__in=award_book_ids, then=Value(1)), # それ以外の場合、値を0に設定 default=Value(0), # それらの値のフィールドは「IntegerField」にする output_field=IntegerField(), ) ) .order_by( "award_flg", # 1. 受賞歴のある本一覧の中に存在するか "price", # 2. 値段が安い順 ) )

annotateを用いて、award_flgという「受賞歴があるかどうか」を表すフラグを新たに設け、そちらのフラグが1になっているものを優先するロジックになっています。ここで、新たに登場したCase、Whenについて説明したいと思います。

Case, When

CaseおよびWhenは、SQL文のCASE式を表現するために使用することのできるクラスです。CASE式を使用すれば、「あるカラムの値に応じ、別の値を割り当てる」という処理を行うことができます。例えば、「テストの点数に応じて、成績をS,A,B,C,Fで割り振りたい」という処理を行う場合、下記のように書くことができます。

CASE WHEN score >= 90 THEN 'S' WHEN score >= 80 THEN 'A' WHEN score >= 70 THEN 'B' WHEN score >= 60 THEN 'C' ELSE 'F' ENDなお、式は上から順に処理されるので、2番目の式は自動的に

80 <= score < 90という意味になります。上記の成績評価をDjangoの

Case,Whenで表現すると、下記のように書くことができます。from django.db.models import Case, When, Value, CharField grade = Case( When(score__gte=90, then=Value("S")), When(score__gte=80, then=Value("A")), When(score__gte=70, then=Value("B")), When(score__gte=60, then=Value("C")), default=Value("F"), output_field=CharField(max_length=1) )CASE式のELSEに該当するパラメータが

defaultになっていることに注意してください。また、出力用のフィールドを指定することが必須であり、今回は文字列なのでCharFieldを指定しています。

{field}__gteの他にも、{field}__inや{field}__containsなど、querysetで用いることのできる演算子は使用することができます。もちろん、そのままイコールの意味として使いたい場合、下記のように=だけでつなげば大丈夫です。When(score=100, then=Value("SS"))まとめ

annotateによる、新しいフィールドの追加Case・Whenによる、条件に応じた値の割り当てorder_byで新しく追加されたフィールドを指定し、並べ替えこれらを組み合わせることで、高度な並べ替えを実現することが出来ました。工夫次第でさらに多様なケースに対応することが出来るので、ぜひ活用していただければ幸いです。

- 投稿日:2020-12-12T22:57:48+09:00

大量のラズパイにつけたsoracom simを管理するために、simの名前をmac addressにする方法

背景

複数工場に大量においたラズパイの soracom simがそれぞれどこにあるのかを管理することが目的

前提としてラズパイはmac addressをkeyとしてどこにあるかは管理されている。環境

ak-20

raspberry pi 4

raspbian buster

python 3.7方法

mac addressでラズパイを管理しているので、simカードそれぞれにmac addressを紐づける。

simのnameがmac addressになるように起動時にsoracom apiをたたく実装

下記を起動時に実行されるようにsystemctlに登録した。(AUTH_KEY_ID とAUTH_KEYは、ここを参考に作成)

register_mac_add_for_soracom.pyimport json import logging import logging.handlers import sys import os from os.path import abspath, dirname, join import requests AUTH_KEY_ID = "$auth-key-id" AUTH_KEY = "$auth-key" def get_mac(): """ pcのmacアドレスを取得 """ GET_RASPI_WLAN0_MAC_ADDRESS_COMMAND = "cat `find /sys/devices/ -name wlan0`/address" if platform.system() == "Darwin": # 下記記事を参考に実装 # https://qiita.com/FmtWeisszwerg/items/c7aa26859c463dda5ebc addr = ":".join( [ hex(fragment)[2:].zfill(2) for fragment in struct.unpack("BBBBBB", struct.pack("!Q", uuid.getnode())[2:]) ]) else: r = os.popen(GET_RASPI_WLAN0_MAC_ADDRESS_COMMAND).read() addr = r.replace("\n", "") return addr def main(): # ここでネットワーク接続とデバイス接続確認の関数があったほうがよい get_imsi_response = requests.get('http://metadata.soracom.io/v1/subscriber.imsi') logging.debug("get_imsi_response:{}".format(get_imsi_response.text)) if len(get_imsi_response.text) == 0: logging.warning("imsiが取得できません") return imsi = get_imsi_response.text[-15:] logger.info("imsi:{}".format(imsi)) if not imsi.isdigit(): logging.warning("imsiの値が数値ではないので不正です") return get_api_token_response = requests.post( 'https://api.soracom.io/v1/auth', headers={'Content-Type': 'application/json'}, data=json.dumps({ "authKeyId": AUTH_KEY_ID, "authKey": AUTH_KEY })) logging.info("get_api_token_response:{}".format(get_api_token_response.text)) if get_api_token_response.json().get("token") is None or get_api_token_response.json().get( "apiKey") is None: logging.warning("tokenの取得に失敗しました") return token = get_api_token_response.json()["token"] api_key = get_api_token_response.json()["apiKey"] register_tag_response = requests.put( 'https://api.soracom.io/v1/subscribers/' + imsi + '/tags', headers={ 'Content-Type': 'application/json', 'X-Soracom-API-Key': str(api_key), 'X-Soracom-Token': str(token), }, data=json.dumps([{ "tagName": "name", "tagValue": get_mac() }])) logging.debug("tag_register_process out:{}".format(register_tag_response.text)) register_tag_dic = register_tag_response.json() if register_tag_dic.get("tags") is not None and register_tag_dic["tags"].get("name") is not None: if register_tag_dic["tags"]["name"] == get_mac(): logging.info("success regist") return logging.warning("failed regist") if __name__ == '__main__': main()soracom ダッシュボード

ラズパイが起動すると下記のように、ダッシュボード上のsimの名前がmac addressになる。

- 投稿日:2020-12-12T22:53:21+09:00

tensowboardで特徴量を可視化する(tf.keras) - 全結合

tensorboardで特徴量を可視化してみた

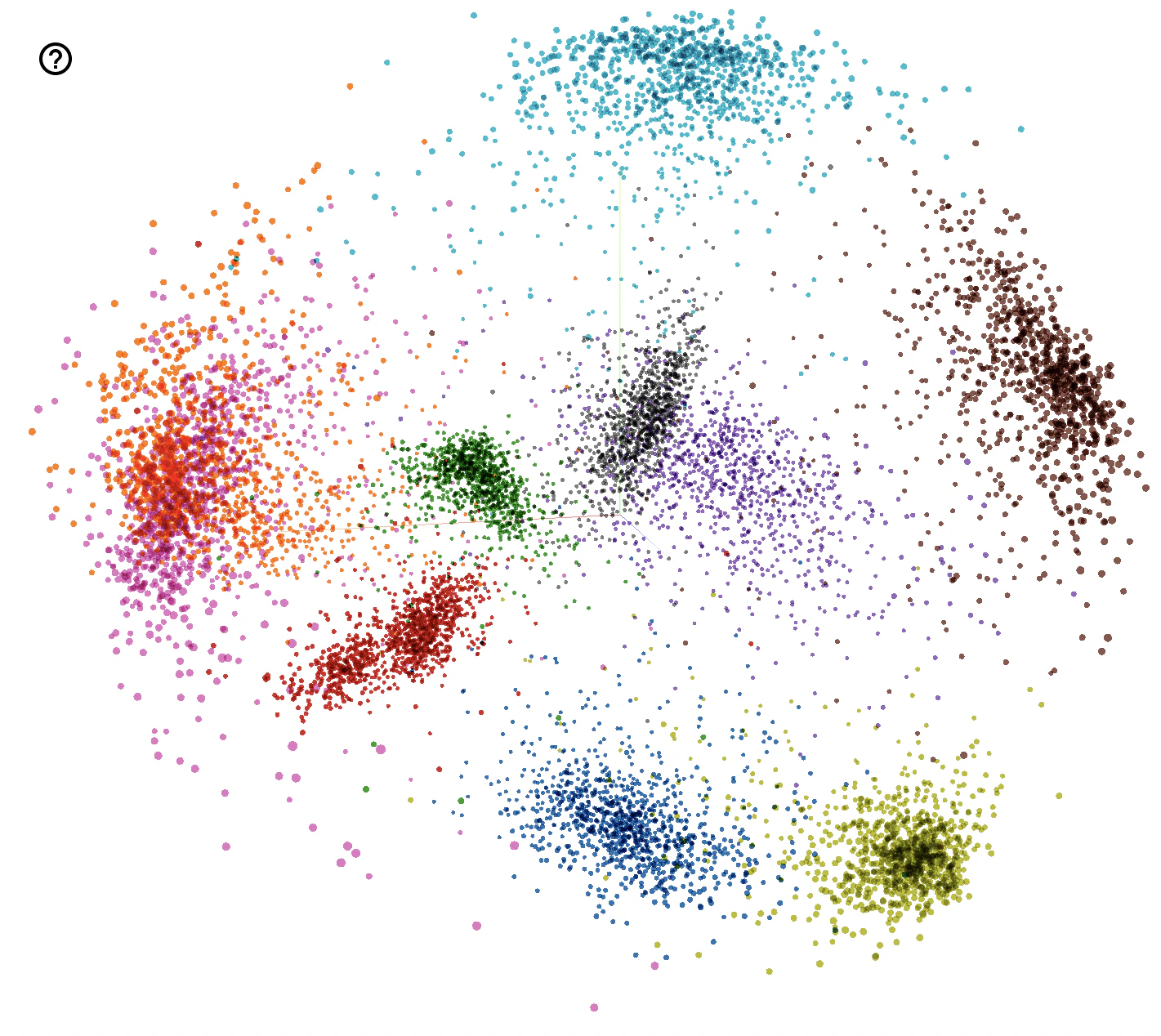

以前に投稿したmnistを全結合層で教師あり学習し、最終段をクラスタリングして評価するのコードに下記を追記して、tensorboardで可視化した。

metadata.tsvのをGUIで読み込まないとラベルが反映されない問題が出たが、tensorboardを起動するときに、./tflogではなく、./tflog/YYYY-MM-DDnnnnnnを指定することでmetadata.tsvが読み込まれるので注意

・・・できれば./tflogで読んで欲しいが、その場合はチェックポイントファイル自体も./tflogに書き出す必要がある模様。projectorに指定する変数名はtensorboadに表示される変数名を指定すること

ラベルを可視化するためのメタデータを作成

# メタデータ作成・保存 import datetime import os import numpy as np LOG_DIR = f"./tflog/{datetime.datetime.now().strftime('%Y-%m-%d-%H%M%S')}" META = os.path.join(LOG_DIR, 'metadata.tsv') with open(META, 'w') as f: f.write("Index\tLabel\n") for index,label in enumerate(np.where(y_test)[1]): f.write("%d\t%d\n" % (index,label))コールバックを作成し、学習中のデータを記録するようにする

# コールバックを作成 tb_cb = tensorflow.keras.callbacks.TensorBoard(log_dir= LOG_DIR, histogram_freq=1) cbks = [tb_cb] history = model.fit(x_train, y_train, batch_size=batch_size, epochs=epochs, verbose=1, validation_data=(x_test, y_test), callbacks=cbks)チェックポイントを作成し、Projectorに出力する

result = model.predict(x_test) emb = result # embeddingsの作成 embedding_var = tensorflow.Variable(emb, name='mnist_embedding') CHECKPOINT_FILE = LOG_DIR + '/model.ckpt' ckpt = tensorflow.train.Checkpoint(embeddings=embedding_var) ckpt.save(CHECKPOINT_FILE) from tensorboard.plugins import projector # Projector設定 config = projector.ProjectorConfig() embedding = config.embeddings.add() embedding.tensor_name = "embeddings/.ATTRIBUTES/VARIABLE_VALUE" # メタデータ(CSV)パス embedding.metadata_path= 'metadata.tsv' # Projectorに出力 projector.visualize_embeddings(LOG_DIR, config)全体コードは下記。

import tensorflow # one-hot encodingを施すためのメソッド from tensorflow.keras.utils import to_categorical # 必要なライブラリのインポート from tensorflow.keras.datasets import mnist import numpy as np #import pandas as pd #import sklearn from tensorflow.keras.layers import Lambda, Input, Dense from tensorflow.keras.models import Model from tensorflow.keras.losses import mse from tensorflow.keras import backend as K #Kerasの関数でデータの読み込み。データをシャッフルして学習データと訓練データに分割 (x_train, y_train), (x_test, y_test) = mnist.load_data() # 2次元データを数値に変換 x_train = x_train.reshape(60000, 784) x_test = x_test.reshape(10000, 784) # 型変換 x_train = x_train.astype('float32') x_test = x_test.astype('float32') # 255で割ったものを新たに変数とする x_train /= 255 x_test /= 255 # one-hot encodingを施すためのメソッド from tensorflow.keras.utils import to_categorical # クラス数は10 num_classes = 10 y_train = y_train.astype('int32') y_test = y_test.astype('int32') labels = y_test # one-hot encoding y_train = to_categorical(y_train, num_classes) y_test = to_categorical(y_test, num_classes) # 必要なライブラリのインポート、最適化手法はAdamを使う from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense, Dropout from tensorflow.keras.optimizers import Adam feature_dim = 10 # モデル作成 model = Sequential() model.add(Dense(512, activation='relu', input_shape=(784,))) model.add(Dropout(0.2)) model.add(Dense(512, activation='relu')) model.add(Dropout(0.2)) model.add(Dense(feature_dim, activation='relu')) # 特徴量として取り出すための層を追加 model.add(Dense(10, activation='softmax')) model.summary() # バッチサイズ、エポック数 batch_size = 128 epochs = 20 model.compile(loss='categorical_crossentropy', optimizer=Adam(), metrics=['accuracy']) # メタデータ作成・保存 import datetime import os import numpy as np LOG_DIR = f"./tflog/{datetime.datetime.now().strftime('%Y-%m-%d-%H%M%S')}" META = os.path.join(LOG_DIR, 'metadata.tsv') os.makedirs(os.path.join(LOG_DIR), exist_ok=True) with open(META, 'w') as f: f.write("Index\tLabel\n") for index,label in enumerate(np.where(y_test)[1]): f.write("%d\t%d\n" % (index,label)) # コールバックを作成 tb_cb = tensorflow.keras.callbacks.TensorBoard(log_dir= LOG_DIR, histogram_freq=1) cbks = [tb_cb] history = model.fit(x_train, y_train, batch_size=batch_size, epochs=epochs, verbose=1, validation_data=(x_test, y_test), callbacks=cbks) model.pop() # 最終段のsoftmax層を取り除いて、特徴量の層を最終段とする model.summary() result = model.predict(x_test) emb = result # embeddingsの作成 embedding_var = tensorflow.Variable(emb, name='mnist_embedding') CHECKPOINT_FILE = os.path.join(LOG_DIR, 'model.ckpt') ckpt = tensorflow.train.Checkpoint(embeddings=embedding_var) ckpt.save(CHECKPOINT_FILE) from tensorboard.plugins import projector # Projector設定 config = projector.ProjectorConfig() embedding = config.embeddings.add() embedding.tensor_name = "embeddings/.ATTRIBUTES/VARIABLE_VALUE" # メタデータ(CSV)パス embedding.metadata_path= 'metadata.tsv' # Projectorに出力 projector.visualize_embeddings(LOG_DIR, config)

- 投稿日:2020-12-12T22:53:21+09:00

tensowboardで特徴量を可視化する(tf.keras)

tensorboardで特徴量を可視化してみた

以前に投稿したmnistを全結合層で教師あり学習し、最終段をクラスタリングして評価するのコードに下記を追記して、tensorboardで可視化した。

todo: metadata.tsvをGUIで読み込まないとラベルが反映されない問題を調査する

ラベルを可視化するためのメタデータを作成

# メタデータ作成・保存 import datetime import os import numpy as np LOG_DIR = f"./tflog/{datetime.datetime.now().strftime('%Y-%m-%d-%H%M%S')}" META = os.path.join(LOG_DIR, 'metadata.tsv') with open(META, 'w') as f: f.write("Index\tLabel\n") for index,label in enumerate(np.where(y_test)[1]): f.write("%d\t%d\n" % (index,label))コールバックを作成し、学習中のデータを記録するようにする

# コールバックを作成 tb_cb = tensorflow.keras.callbacks.TensorBoard(log_dir= LOG_DIR, histogram_freq=1) cbks = [tb_cb] history = model.fit(x_train, y_train, batch_size=batch_size, epochs=epochs, verbose=1, validation_data=(x_test, y_test), callbacks=cbks)チェックポイントを作成し、Projectorに出力する

result = model.predict(x_test) emb = result # embeddingsの作成 embedding_var = tensorflow.Variable(emb, name='mnist_embedding') CHECKPOINT_FILE = LOG_DIR + '/model.ckpt' ckpt = tensorflow.train.Checkpoint(embeddings=embedding_var) ckpt.save(CHECKPOINT_FILE) from tensorboard.plugins import projector # Projector設定 config = projector.ProjectorConfig() embedding = config.embeddings.add() embedding.tensor_name = embedding_var.name # メタデータ(CSV)パス embedding.metadata_path= META # Projectorに出力 projector.visualize_embeddings(LOG_DIR, config)全体コードは下記。

import tensorflow # one-hot encodingを施すためのメソッド from tensorflow.keras.utils import to_categorical # 必要なライブラリのインポート from tensorflow.keras.datasets import mnist import numpy as np #import pandas as pd #import sklearn from tensorflow.keras.layers import Lambda, Input, Dense from tensorflow.keras.models import Model from tensorflow.keras.losses import mse from tensorflow.keras import backend as K #Kerasの関数でデータの読み込み。データをシャッフルして学習データと訓練データに分割 (x_train, y_train), (x_test, y_test) = mnist.load_data() # 2次元データを数値に変換 x_train = x_train.reshape(60000, 784) x_test = x_test.reshape(10000, 784) # 型変換 x_train = x_train.astype('float32') x_test = x_test.astype('float32') # 255で割ったものを新たに変数とする x_train /= 255 x_test /= 255 # one-hot encodingを施すためのメソッド from tensorflow.keras.utils import to_categorical # クラス数は10 num_classes = 10 y_train = y_train.astype('int32') y_test = y_test.astype('int32') labels = y_test # one-hot encoding y_train = to_categorical(y_train, num_classes) y_test = to_categorical(y_test, num_classes) # 必要なライブラリのインポート、最適化手法はAdamを使う from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense, Dropout from tensorflow.keras.optimizers import Adam feature_dim = 10 # モデル作成 model = Sequential() model.add(Dense(512, activation='relu', input_shape=(784,))) model.add(Dropout(0.2)) model.add(Dense(512, activation='relu')) model.add(Dropout(0.2)) model.add(Dense(feature_dim, activation='relu')) # 特徴量として取り出すための層を追加 model.add(Dense(10, activation='softmax')) model.summary() # バッチサイズ、エポック数 batch_size = 128 epochs = 20 model.compile(loss='categorical_crossentropy', optimizer=Adam(), metrics=['accuracy']) # メタデータ作成・保存 import datetime import os import numpy as np LOG_DIR = f"./tflog/{datetime.datetime.now().strftime('%Y-%m-%d-%H%M%S')}" CUR_DIR = './' META = os.path.join(CUR_DIR, 'metadata.tsv') with open(META, 'w') as f: f.write("Index\tLabel\n") for index,label in enumerate(np.where(y_test)[1]): f.write("%d\t%d\n" % (index,label)) tb_cb = tensorflow.keras.callbacks.TensorBoard(log_dir= LOG_DIR, histogram_freq=1) cbks = [tb_cb] history = model.fit(x_train, y_train, batch_size=batch_size, epochs=epochs, verbose=1, validation_data=(x_test, y_test), callbacks=cbks) model.pop() # 最終段のsoftmax層を取り除いて、特徴量の層を最終段とする model.summary() result = model.predict(x_test) emb = result # embeddingsの作成 embedding_var = tensorflow.Variable(emb, name='mnist_embedding') CHECKPOINT_FILE = LOG_DIR + '/model.ckpt' ckpt = tensorflow.train.Checkpoint(embeddings=embedding_var) ckpt.save(CHECKPOINT_FILE) from tensorboard.plugins import projector # Projector設定 config = projector.ProjectorConfig() embedding = config.embeddings.add() embedding.tensor_name = embedding_var.name # メタデータ(CSV)パス embedding.metadata_path= META # Projectorに出力 projector.visualize_embeddings(LOG_DIR, config)

- 投稿日:2020-12-12T22:29:42+09:00

中学数学から始める機械学習〜プログラミング未経験でもできるデータ分析〜

今回は数学偏差値の30文系の私でもデータ分析を行えるようにしてくれたとあるUdemyの「【キカガク流】人工知能・脱ブラックスボックス講座」について説明させて頂きます。

はじめに

「プログラミングやってみたいけど、何から始めれば良いのか分からない」

「データ分析ができるとカッコ良さそうだけど、数式見るだけでいやいやの嫌」というように思ったことはありませんか?

この記事は、私のようにデータ分析を始めたいけど数学の知識がなくてプログラミングの本を買ったのに読めてないといった人向けに是非受けて欲しい講座をご紹介したいと思います。

Udemy講座選びの参考にもどうぞ〜【キカガク流】人工知能・機械学習 脱ブラックボックス講座 - 初級編 -

【キカガク流】人工知能・機械学習 脱ブラックボックス講座 - 中級編 -データ分析を始めるならまずはこれから!

このキカガク流の講座は、中学生レベルの数学から最終的に単回帰分析や重回帰分析といった大学の研究やビジネスまで幅広く使えるデータ分析手法を学ぶことができます!もちろんデータ分析だけでなく、データ分析に必要なプログラミング(言語はPython)の知識を同時並行で手を動かしながら教えてくれるのでプログラミング初心者でも大丈夫です!

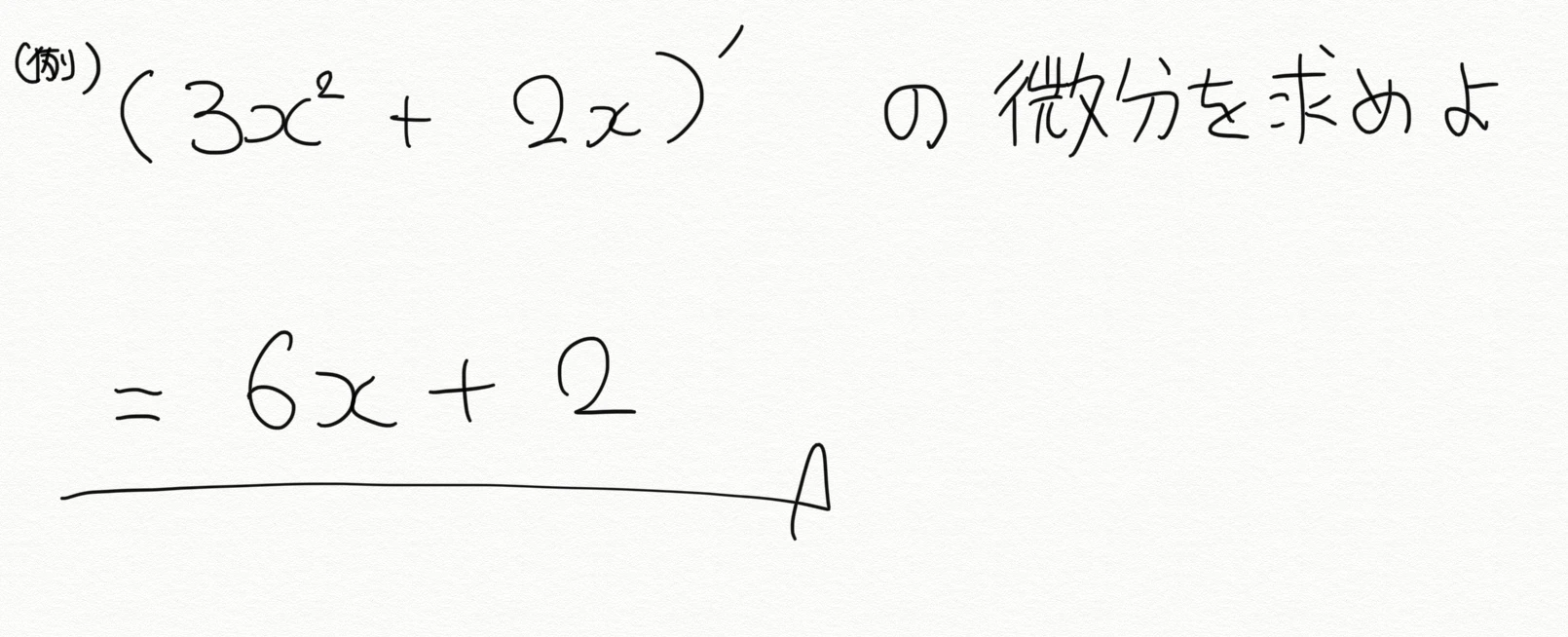

この講座のすばらしい点は、誰しも一度は思った「微分は現実世界でいつ使うの?」

「ベクトルって学ぶ必要ないんじゃない?」といった問いにデータ分析の実例を交えながら丁寧に答えてくれます!特に文系の方が最初に学ぶにあたって、うってつけではないでしょうか?

どんなことが学べるの?

主にデータ分析に必要な数学とプログラミング知識について学ぶことができます。

詳しくは以下のようになっています。初級(総時間:4時間17分)評価4.4

ー数学ー

・微分(中学レベルからスタート)

・偏微分

・単回帰分析

ーPythonー

・変数

・基本構文(演算やprint等の基礎的な扱い)

・制御構文

・関数(基礎レベル)

・numpy

・pandas

・matplotlib

・実践(実データを扱った単回帰分析)中級(総時間:4時間22分)評価4.4

ー数学ー

・スカラー:ベクトル:行列

・重回帰分析

・統計(基礎レベル)

ーPythonー

・重回帰分析をPython実装(Scikit-Learn)

1:実データで演習

2:外れ値・スケーリングを考慮した重回帰分析初級に関しては難易度的にも比較的易しい内容になっています。(初級って書いてある通り)

数学のレベルは本当に上の画像のような中学生レベル式から始めるので安心してオッケーです!research_test.pyfrom sklearn.externals import joblib joblib.dump(model,'test.pkl') model_new = joblib.load('test.pkl')また、プログラミング知識に関しては、一番簡単な四則演算から上のようなScikit-Learnを扱った予測まで順序よく教えてくれます。一気にレベルが跳ね上がるなんてこともありません。

おわりに

今回は初めてデータ分析をPythonで行う人におすすめのキカガク講座を紹介しました。私はこの講座を通して、データ分析の勉強を再会し、現在はTwitterのAPIから得たデータを分析しています。

大切なのはコードや方法を覚えるのではなく、理解することだと私は考えています。ぶっちゃけ分析の書き方や機械学習の書き方はぐぐればいっぱいでてくるので。ただ、自分が行いたい分析についてしっかり理解していないと作りたいものも作れません。

是非この講座を通して、データ分析のいろはについて学んでみてください!この記事が新しくデータ分析を始める人のきっかけになってくれたら幸いです、、、

- 投稿日:2020-12-12T22:29:42+09:00

キカガク流から学ぶ中学数学から始める機械学習ーUdemy紹介記事ー

今回は数学偏差値の30文系の私でもデータ分析を行えるようにしてくれたとあるUdemyの「【キカガク流】人工知能・脱ブラックスボックス講座」について説明させて頂きます。

はじめに

「プログラミングやってみたいけど、何から始めれば良いのか分からない」

「データ分析ができるとカッコ良さそうだけど、数式見るだけでいやいやの嫌」というように思ったことはありませんか?

この記事は、私のようにデータ分析を始めたいけど数学の知識がなくてプログラミングの本を買ったのに読めてないといった人向けに是非受けて欲しい講座をご紹介したいと思います。

Udemy講座選びの参考にもどうぞ〜【キカガク流】人工知能・機械学習 脱ブラックボックス講座 - 初級編 -

【キカガク流】人工知能・機械学習 脱ブラックボックス講座 - 中級編 -データ分析を始めるならまずはこれから!

このキカガク流の講座は、中学生レベルの数学から最終的に単回帰分析や重回帰分析といった大学の研究やビジネスまで幅広く使えるデータ分析手法を学ぶことができます!もちろんデータ分析だけでなく、データ分析に必要なプログラミング(言語はPython)の知識を同時並行で手を動かしながら教えてくれるのでプログラミング初心者でも大丈夫です!

この講座のすばらしい点は、誰しも一度は思った「微分は現実世界でいつ使うの?」

「ベクトルって学ぶ必要ないんじゃない?」といった問いにデータ分析の実例を交えながら丁寧に答えてくれます!特に文系の方が最初に学ぶにあたって、うってつけではないでしょうか?

どんなことが学べるの?

主にデータ分析に必要な数学とプログラミング知識について学ぶことができます。

詳しくは以下のようになっています。初級(総時間:4時間17分)評価4.4

ー数学ー

・微分(中学レベルからスタート)

・偏微分

・単回帰分析

ーPythonー

・変数

・基本構文(演算やprint等の基礎的な扱い)

・制御構文

・関数(基礎レベル)

・numpy

・pandas

・matplotlib

・実践(実データを扱った単回帰分析)中級(総時間:4時間22分)評価4.4

ー数学ー

・スカラー:ベクトル:行列

・重回帰分析

・統計(基礎レベル)

ーPythonー

・重回帰分析をPython実装(Scikit-Learn)

1:実データで演習

2:外れ値・スケーリングを考慮した重回帰分析初級に関しては難易度的にも比較的易しい内容になっています。(初級って書いてある通り)

数学のレベルは本当に上の画像のような中学生レベル式から始めるので安心してオッケーです!research_test.pyfrom sklearn.externals import joblib joblib.dump(model,'test.pkl') model_new = joblib.load('test.pkl')また、プログラミング知識に関しては、一番簡単な四則演算から上のようなScikit-Learnを扱った予測まで順序よく教えてくれます。一気にレベルが跳ね上がるなんてこともありません。

おわりに

今回は初めてデータ分析をPythonで行う人におすすめのキカガク講座を紹介しました。私はこの講座を通して、データ分析の勉強を再会し、現在はTwitterのAPIから得たデータを分析しています。

大切なのはコードや方法を覚えるのではなく、理解することだと私は考えています。ぶっちゃけ分析の書き方や機械学習の書き方はぐぐればいっぱいでてくるので。ただ、自分が行いたい分析についてしっかり理解していないと作りたいものも作れません。

是非この講座を通して、データ分析のいろはについて学んでみてください!この記事が新しくデータ分析を始める人のきっかけになってくれたら幸いです、、、

- 投稿日:2020-12-12T22:13:33+09:00

【Python】パーセプトロンモデルを利用した線形分類の実装

早稲田大学本庄高等学院所属でプログラミング系の活動をしているアイスです。

概要

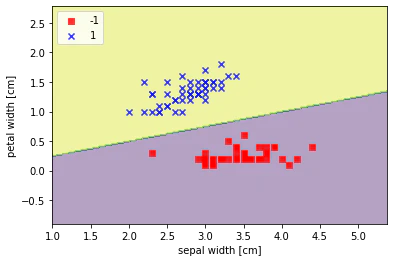

パーセプトロンを用いた学習アルゴリズムをPythonで実装します。Irisの花のデータセットから、「がく片の太さ」と「花びらの太さ」を取り出し、計100個のデータを描画、その分布を元に決定境界を学習させる。

結果として、次のようなグラフが描画されることを目標とすることにする。上の画像は、Google Colaboratory を利用して描画したグラフです。このグラフを描画するまでの過程を説明する。

データセットの取得

scikit-learnはimportせず、インターネット上のmachine-learning-databasesから直接データを取得。

main.pyimport numpy as np import pandas as pd # machine-learning-databasesからデータを取得 df = pd.read_csv('https://archive.ics.uci.edu/ml/machine-learning-databases/iris/iris.data', header=None) ''' irisデータセット(150, 4) - がく片の長さ(cm) - がく片の太さ(cm) - 花びらの長さ(cm) - 花びらの太さ(cm) - タグ(Iris-Setosa, Iris-Versicolour, Iris-Virginica) 0:50が "Iris-Setosa", 50:100が "Iris-Versicolur", 100:150が "Iris-Virginca" ''' # がく片の太さ(1)と花びらの太さ(3)を取得 # shape : (100, 2) x = df.iloc[:100, [1, 3]].values # タグを取得 # shape : (100, 1) y = df.iloc[:100, 4].values # クラスラベルを変換(Iris-Setoraを-1、Iris-Versicolourを1) y = np.where(y == 'Iris-setosa', -1, 1)Google Colaboratory を利用しているメリットとしては、Numpyなどのライブラリを追加で準備する必要がないためである。VS code などを使う場合は、Anacondaを別でダウンロードして、環境を構築したりなど、初学者にとって面倒かつ、挫折する原因にもなり得るので、Google Colaboratory を使うことをお勧めしている。

各種関数:

Irisデータの描画

後の分類実装を可視化するために、Irisのデータセットをグラフにプロットし、感覚的に確認できるようにする。

main.pyimport matplotlib.pyplot as plt # Setora を青色のoで表示 plt.scatter(x[:50, 0], x[:50, 1], color='blue', marker='o', label='Setora') # Versicolur を赤色のxで表示 plt.scatter(x[50:100, 0], x[50:100, 1], color='red', marker='x', label='Versicolur') # ラベルの設定 plt.xlabel('sepal width [cm]') plt.ylabel('petal width [cm]') plt.legend(loc='upper left') # 表示 plt.show()結果:

上の図のように点がプロットされた。青色のoがSetoraを表し、赤色のxがVersicolurを表している。x軸が「がく片の幅」、y軸が「花びらの幅」を表している。

グラフに描画するとSetoraとVersicolurが明らかに分類されていることが感覚的に理解できるようになった。これを機械に分類させるために、パーセプトロンの分類器のモデルを作成し、学習させる。各種関数:

パーセプトロンの分類器の実装

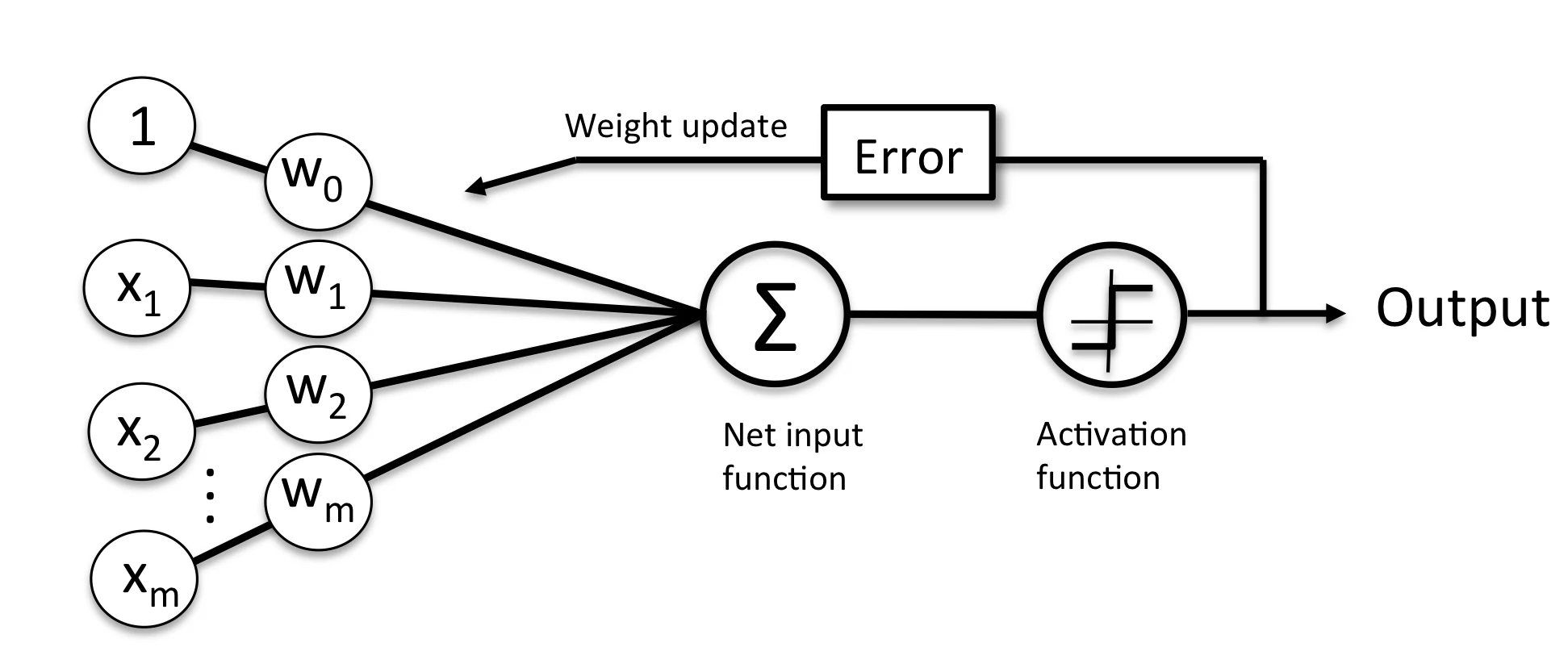

以下に示すのはパーセプトロンの概念図です。

(Sebastian Raschka『達人データサイエンティストによる理論と実装 Python機械学習プログラミング』福島真太郎監訳、クイープ訳、インプレス出版、2016年)より引用

m個の要素に対してデータxと重みwを組み合わせる。1, x_1, x_2, …, x_mw_0, w_1, w_2, …, w_mその総和はステップ関数(活性化関数)に渡され、誤差が計算される。この一連の流れを何回か繰り返すことで誤差を減らし、重みが更新する。

main.pyclass Perceptron(): def __init__(self, eta=0.1, n_iter=10): self.eta = eta self.n_itr = n_iter def fit(self, x, y): self.w_ = np.zeros(1 + x.shape[1]) self.errors = [] print(self.w_) for _ in range(self.n_itr): error = 0 for i, target in zip(x, y): update = self.eta * (target - self.step(i)) self.w_[1:] += update * i self.w_[0] += update error += int(update != 0.0) self.errors_.append(error) def net_input(self, x): return np.dot(x, self.w_[1:]) + self.w_[0] def step(self, x): return np.where(self.net_input(x) >= 0.0, 1, -1)オブジェクト指向に基づいてPerceprotonクラスを定義する。後にインスタンスを作成して、fit関数から使用すると、

fit関数

↓

step関数

↓

net_input関数

↓

step関数

↓

fit関数の順で処理される。fit関数では、エポック数(n_itr)回の処理を繰り返し、誤差を小さくしていく。その過程で、targetと予測値の差を取り、それに学習係数(eta)をかけた値を重みを随時更新、errorを更新していく。step関数では、net_input関数で内積をとったものをstep関数で処理し、予測値を計算していく。targetoと予測値の差に学習係数をかけたものを関数で処理し、重みを更新する。

この処理を繰り返します。各種関数:

誤差の収束の確認

上で実装したモデルで本当に分類が学習されているのかを確認するために、errorsに格納されている誤差が収束していく様子をグラフに描画して確認する。

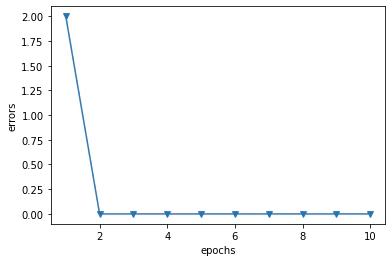

check.py# インスタンス化 ch = Perceptron(eta=0.1, n_iter=10) # モデルに学習させる ch.fit(x, y) # 誤差を描画 plt.plot(range(1, len(ch.errors) + 1), ch.errors, marker='v') plt.xlabel('epochs') plt.ylabel('errors') plt.show()結果:

x軸がエポック数、y軸が誤差を表している。上図のように、誤差はすぐに収束し、2回目以降は既に収束していることが分かった。各種関数:

決定境界の描画

カラーマップを事前準備し、その後、格子点の座標を用意し、等高線を色分けしながら表示する。

main.pyfrom matplotlib.colors import ListedColormap def plot_decision_regions(X, y, classifier, resolution=0.01): # マーカーと色の準備 # 2種類(1か-1)で十分 markers = ('s', 'x') colors = ('red', 'blue') mp = ListedColormap(colors[:len(np.unique(y))]) # 「がく片の太さ」の最大値と最小値を取得。 # 描画に余裕を持たせるために+1と-1 x1_min, x1_max = X[:, 0].min() - 1, X[:, 0].max() + 1 # 「花びらの太さ」の最大値と最小値を取得 # 描画に余裕を持たせるために+1と-1 x2_min, x2_max = X[:, 1].min() - 1, X[:, 1].max() + 1 # 格子点の座標をresolution(0.01)ごとに取得 xx1, xx2 = np.meshgrid(np.arange(x1_min, x1_max, resolution), np.arange(x2_min, x2_max, resolution)) # パーセプトロンの分類器を使って、zにデータを格納 z = classifier.predict(np.array([xx1.ravel(), xx2.ravel()]).T) z = z.reshape(xx1.shape) # 格子点とデータをもとに線をプロット plt.contourf(xx1, xx2, z, alpha=0.1) plt.xlim(xx1.min(), xx1.max()) plt.ylim(xx2.min(), xx2.max()) for i, cl in enumerate(np.unique(y)): plt.scatter(x=X[y == cl, 0], y=X[y == cl, 1], alpha=0.8, color=camp(i), marker=markers[i], label=cl)markers, colorsは点をプロットする際のマーカーとプロットを事前に準備する。今回取り扱うデータは、Setora(-1)とVersicolur(1)の二種類だけなので、マーカーと色も2種類で十分。

matplotlibからListedColormapを読み込む。np.unique(y)では、yの要素は2種類(1と-1)しかないので、mpには二つの色が格納される。

x1_min, x1_maxは「がく片の太さ」の最大値と最小値を取得し、グラフのx軸の幅を決めます。x2_min, x2_maxも同様に「花びらの太さ」の最大値と最小値を取得し、y軸の幅を決める。グラフの端を見やすくするために、それぞれ+1か-1している。

xx1、xx2はそれぞれx軸とy軸の格子点を表している。上で求めた最小値と最大値を両端に置き、resolution(0.01)ごとの間隔で格子点を設ける。この時使用するmeshgrid関数に対応させるため、それぞれをndarrayの型に統一し、処理を行う。

classfierインスタンスからpredict関数を呼び出し、zにデータを格納、それらのデータをcontourf関数を使って等高線として色分けして表示する。この時のalphaは色味を調整するものなので、適当でよい。最後に、xlimとylim関数でグラフの両端を設定して、等高線の表示は完了である。

for文内は、「がく片の太さ」と「花びらの太さ」をそれぞれプロットしている。最初に準備したcolorとmarkerから要素を取り出してきて表示している。labelはそれぞれ、-1がSetora、1がVercicolurを表している。

始めに設定した目標のグラフが表示されたことが確認できた。各種関数:

- matplotlib.colors.LinkedColormap

- np.meshgrid

- np.arange

- np.array

- np.ndarray.ravel

- np.ndarray.reshape

- plt.countourf

- plt.xlim

- plt.ylim

まとめ

今回は、Pythonを用いて、irisのデータをパーセプトロンと呼ばれる機械学習の手法を用いて分類した。データから、「がく片の太さ」と「花びらの太さ」を抽出し、それぞれの特徴を学習させ、その結果をグラフに表示させるところまですることが出来た。

感想

関数の種類を見て貰ったらわかるが、パーセプトロンの仕組み自体は、一度理解してしまえば実装もさほど難しくなく、簡単にまとめることができる。その一方で、描画に関しては、格子点、ラベル、両端、色などを全て設定しなければいけないため、手間がかかり、挫折の原因として大きいのではないかと思った。本記事は初学者向けに書いたため、そのような挫折をしないことを「させない」ことを目標に書いた。そのため、Google Colaboratoryを使い環境構築を簡単にしたり、関数の説明を載せて調べる手間を省くなどした。

自分としても学んだことを整理できたので、よかったと思う。参考文献

- pandas documentation

- numpy documentation

- matplotlib documentation

- [機械学習]iriデータセットを用いてscikit-learnの様々な分類アルゴリズムを試してみた

- Sebastian Raschka『達人データサイエンティストによる理論と実装 Python機械学習プログラミング』福島真太郎監訳、クイープ訳、インプレス出版、2016年

- 投稿日:2020-12-12T22:06:56+09:00

Djangoのアプリ作成で最初にすること

参考文献

このページの目的

備忘録です.チュートリアルを自分用に要約しました.

プロジェクトの作成

Djangoをインストールしている環境で,プロジェクトを作成したいディレクトリに移動.以下のコマンドでプロジェクトを作成.

django-admin startproject <mysite><mysite>は自分の好きな名前.この名前は重要ではなく,任意の名前に変更できる.

プロジェクトのルートディレクトリに移動.cd <mysite>サーバを起動してプロジェクトが正しく作成できていることを確認してもよい.

python3 manage.py runserverアプリケーションの作成

プロジェクトのルートディレクトリで以下のコマンドを入力しアプリを作成する.<app>はアプリ名に置き換える.

python3 manage.py startapp <app>上記コマンド実行後の構造は,

<mysite>/

┝manage.py

┝<mysite>/

└<app>/

となっている.

views.pyの編集.app/views.pyfrom django.http import HttpResponse def index(request): return HttpResponse("Hello, world. You're at the app index.")アプリのディレクトリにurls.pyはないので,urls.pyを新規作成し,app/urls.pyにpathを登録.

app/urls.pyfrom django.urls import path from .views import index urlpatterns = [ path('', index, name='index'), ]プロジェクトのurls.pyの方にアプリのpathを登録.path()の第1引数の最後のスラッシュを忘れないように.

mysite/urls.pyfrom django.contrib import admin from django.urls import include, path # includeを追加 urlpatterns = [ path('<アプリ名>/', include('<アプリ名>.urls')), # include path('admin/', admin.site.urls), ]app/apps.pyを参考に,アプリをsettings.pyに登録.

mysite/settings.pyINSTALLED_APPS = [ 'polls.apps.PollsConfig', # アプリ名が'polls'の場合. 'django.contrib.admin', 'django.contrib.auth', 'django.contrib.contenttypes', 'django.contrib.sessions', 'django.contrib.messages', 'django.contrib.staticfiles', ]terminalのプロジェクトのルートディレクトリで1回マイグレーションをする.これで作成したアプリをDjangoが認識できる.

python3 manage.py migrate<app>/models.pyを編集していなければ,下記を実行したときに"No changes detected in app <app>"と表示される.

python3 manage.py makemigrations <app>テンプレートの作成

アプリのディレクトリにtemplatesディレクトリを作成する.更に,templatesディレクトリ内にアプリ名のディレクトリを作成し,その中にindex.htmlを作成する.つまり,index.htmlのパスは<mysite>/<app>/templates/<app>/index.htmlとなる.

app/templates/app/index.html{% extends './base.html' %} {% block body %} <h1>Hello World</h1> <p>This is a template.</p> {% endblock body %}index.htmlと同じ階層にbase.htmlを作成する.

app/templates/app/base.html<!DOCTYPE html> <html lang="ja"> <head> <title>Title</title> <meta charset="utf-8"> {% block head %} {% endblock head %} </head> <body> {% block body %} replace me. {% endblock body %} </body> </html>このテンプレートを使用するために<app>/views.pyのindexビューを更新する.文字列中の<app>を自分のアプリ名に置き換え忘れないように.

app/views.pyfrom django.shortcuts import render def index(request): context = { 'foo': 'foo string!', } return render(request, '<app>/index.html', context)このコードは,<app>/index.htmlというテンプレートをロードし,そこにコンテキストを渡す.コンテキストは,テンプレート変数名をPythonオブジェクトにマッピングする辞書.

静的ファイルの作成

アプリのディレクトリにstaticディレクトリを作成する.更に,staticディレクトリ内にアプリ名のディレクトリを作成し,その中にstyle.cssを作成する.つまり,style.cssのパスは<mysite>/<app>/static/<app>/style.cssとなる.

mysite/app/static/app/style.css*{ box-sizing: border-box; /* This makes sure that the padding and border are included in the total width and height of the elements. */ } /* Extra small devices (phones, 600px and down) */ @media only screen and (max-width: 600px){ body{ background-color: papayawhip; } } /* Small devices (portrait tablets and large phones, 600px and up) */ @media only screen and (min-width: 600px){ body{ background-color: deepskyblue; } } /* Medium devices (landscape tablets, 768px and up) */ @media only screen and (min-width: 768px){ body{ background-color: mediumspringgreen; } } /* Large devices (laptops/desktops, 992px and up) */ @media only screen and (min-width: 992px){ body{ background-color: darkgoldenrod; } } /* Extra large devices (large laptops and desktops, 1200px and up) */ @media only screen and (min-width: 1200px){ body{ background-color: violet; } }HTMLファイルにstaticファイルをロードする.文字列中の<app>を自分のアプリ名に置き換え忘れないように.

app/templates/app/index.html{% extends './base.html' %} {% load static %} {% block head %} <link rel="stylesheet" type="text/css" href="{% static '<app>/style.css' %}"> {% endblock head %} {% block body %} <h1>Hello World</h1> <p>This is a template.</p> {% endblock body %}サーバを起動して背景色が変わることを確認しよう.

python3 manage.py runserver正常にstyle.cssがロードされれば,スクリーンサイズに応じて背景色が変わる.

- 投稿日:2020-12-12T21:59:01+09:00

AutoMLでおせちの価格予測&GANで非実在おせちを作る

はじめに

この記事は次のAdvent Calendarの12月12日分です

機械学習の自動化プラットフォームDataRobotを使って楽しむ冬のイベント予測チャレンジ

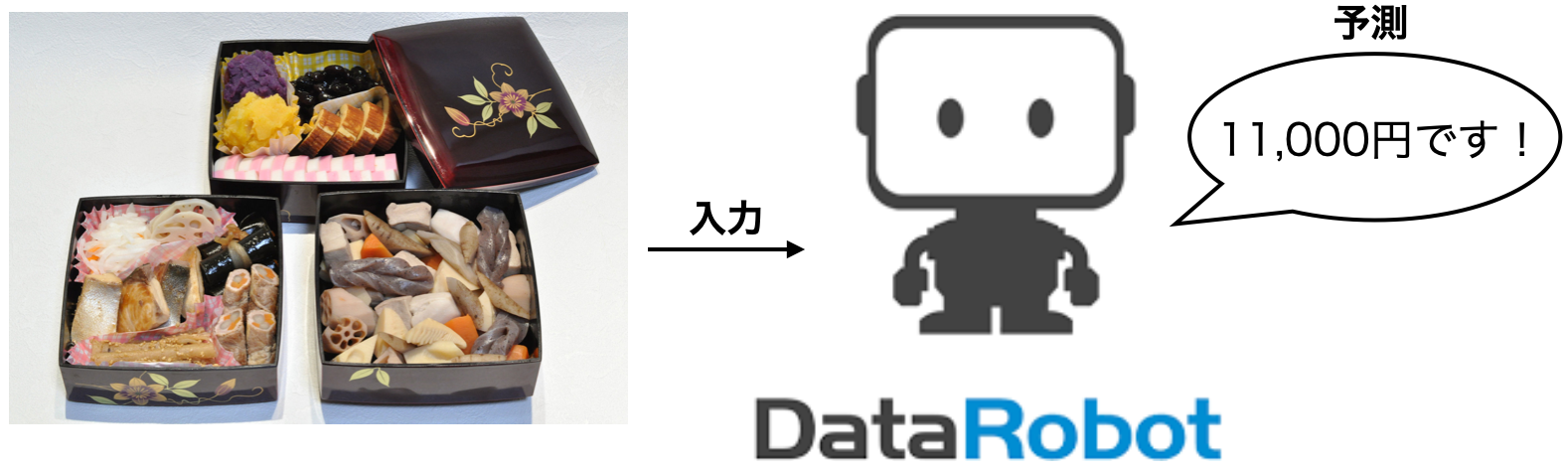

DataRobotはマネージドな機械学習(ML)プラットフォームです。データセットの用意からモデルの訓練・デプロイまでを、ブラウザを通じて進めていけるそうです。特徴量設計やモデルの選択もカバーしており、AutoMLサービスの一つということにもなります。ちょうどマネージドなAutoMLサービスに興味があったことから、この機会に試してみることにしました。

この記事がいいねと思ったらLGTMお願いします!(例のあれ)やりたいこと

さて、このAdvent Calendarのお題は『冬ならではのテーマで機械学習モデルを試そう』だそうです。

私はちょうど百貨店のおせちを探していたため、おせち料理の画像からの価格予測(回帰)を扱うことにしました。

しかし、何かがひっかかります。おせちと言えば元旦に食べるものですね。元旦・・・?

そう、GAN旦です。

『GANで生成された仮想おせち画像を眺めて、新年の学習がうまくいくことを祈る日』ですね。

GAN(Generative Adversarial Network)については後述することにして、この記事は次の2本立ての内容です。2. GAN(Generative Adversarial Network)によるおせち画像生成

おせちGANで生成した画像の一部です

では、始めましょう。

おせち画像からの価格予測

データセットの用意

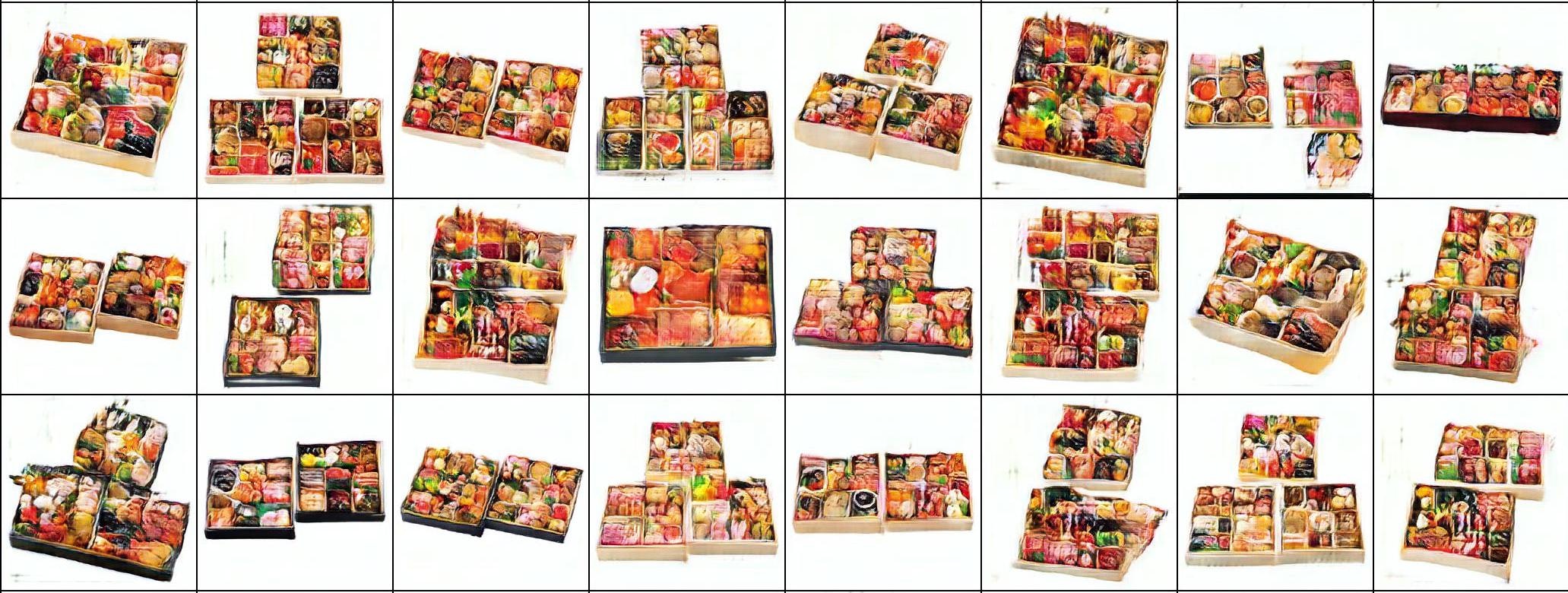

Data Robotは入力データとして画像を扱うことができます。おせち画像のデータセットはさすがになかったので、頑張って約500枚の画像と価格データを集めました。根性で集めるか、Beautiful Soupなど使ってECサイトからスクレイピングするのが順当でしょう。

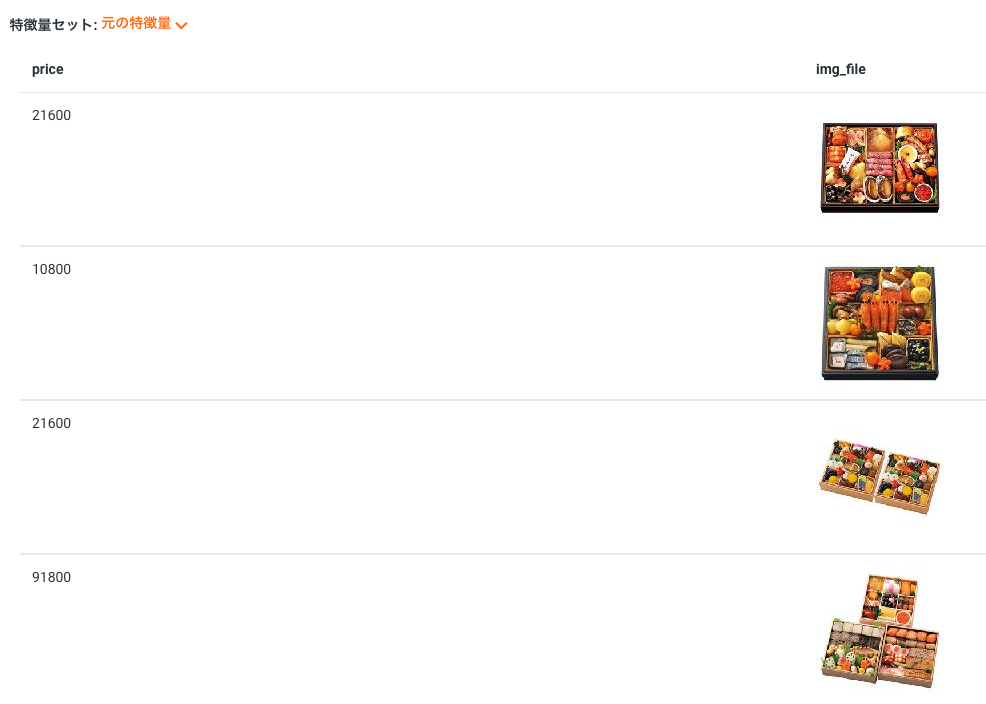

ところで、おせちは季節アイテムなので、年末以外はデータセットの入手難易度が高いです。もし似たような興味ある人はお早めに。数年分集めて年ごとの傾向を分析したりすると面白いかもしれませんね。用意したデータセットをData Robotにアップロードすると次のようになります。

いい感じですね。価格の平均値は32,096円、標準偏差は29,393円で、値は6000円〜32万円まで幅があります。

もしデータに欠損や外れ値があればここで警告を出して教えてくれます。

また、データセットからのtest data分割やクロスバリデーションの設定は機械学習ビギナーがミスりがちなステップですが、DataRobotではここは自動でやってくれるので安心です。クロスバリデーションでモデルを検証した後、最終ステップでtest dataによる検証ができます。

なお、trainとtest dataをユーザーが指定することはできないようです。時系列データやグループ属性をもつデータだとデータ分割は厄介な問題になるのですが、今回は未検証です。機械学習モデルの自動構築

さて、ここからが本番です。

押してくれと言わんばかりにダッシュボードで存在感を放っている『開始』ボタンを押すと、自動で特徴量設計と機械学習モデルの訓練が始まります。

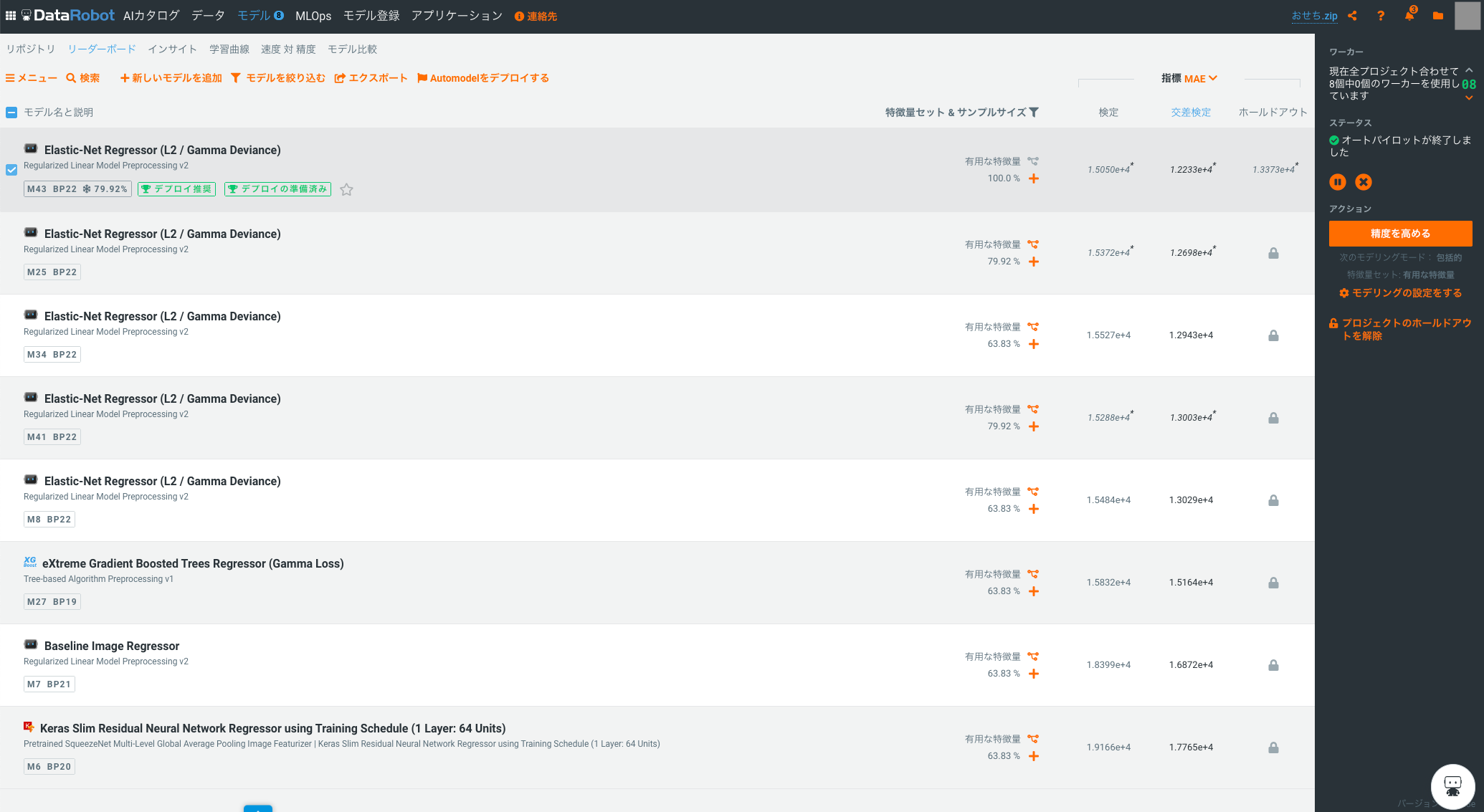

デフォルトではオートパイロットモード(=AutoML)が選択されており、複数の試行を通じて、性能の良い機械学習モデルを自動的に選択してくれます。今回は15分程度でオートパイロットが終了し、結果が一覧で表示されます。

今回は、機械学習アルゴリズムとしてElastic Netを使ったモデルが良い性能を示しています。1

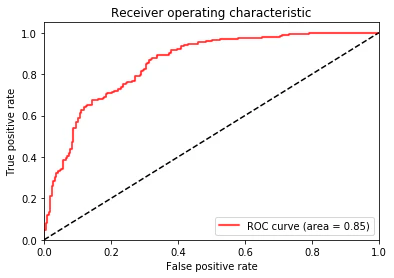

ベストなモデルのテストデータでの予測性能は、平均絶対誤差 13,373円、標準偏差 24,817円、相関係数(ピアソンのR^2) 0.515となりました。ランダムよりはマシな程度に学習できたことはわかりましたが、正直ちょっと残念な性能です。

この後、他のモデルも追加してもう少し試行錯誤してみましたが上記がベストでした。予測誤差の原因を分析

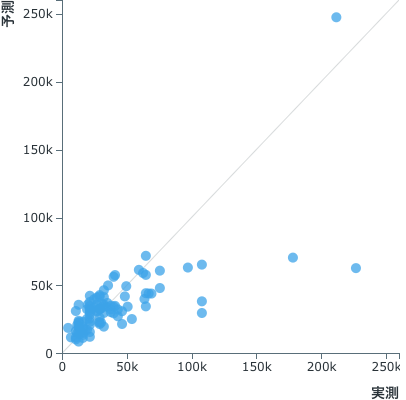

予測誤差が大きくなってしまった原因を調べるために、テストデータにおける予測結果の散布図を見てみましょう。

この図から、価格が10万円を超えてくる少数の高級おせちを大幅に安く予測している傾向が認められます。機械学習を用いている以上、学習データが少ない領域では最頻値に寄った予測をしがちで、正しい予測をするのは難しいと言えます。よって、十分な性能が得られなかった原因の一つはデータの不足と考えられます。今回の学習データは500枚程度と少ないことから、データの量を鑑みると、簡単に達成できる性能としてはこのあたりが壁かもしれません。ちなみにもし私がここから業務で携わるとしたら、モデルのエンジニアリングはさておき、まずはより多くの学習データを集める試みに注力すると思います。そもそもの問題として、おせちの値段が見た目と相関していない可能性もあるのですが。。このモデルのアクティベーションマップ(≒モデルが予測のために注目している箇所)2を見ると、おせち本体より背景にフォーカスしてしまっていることがわかります。直感的には、おせちの具を見て判断して欲しいところですが、どうもそうではないようです。ちなみに、このようなアクティベーションマップを自分で用意するのは結構面倒なので、数回クリックするだけで可視化できるのは便利です。

ここで終わらず、もう少し深堀りしてみましょう。一般的に、重箱の段数と価格には相関がありそうですね。

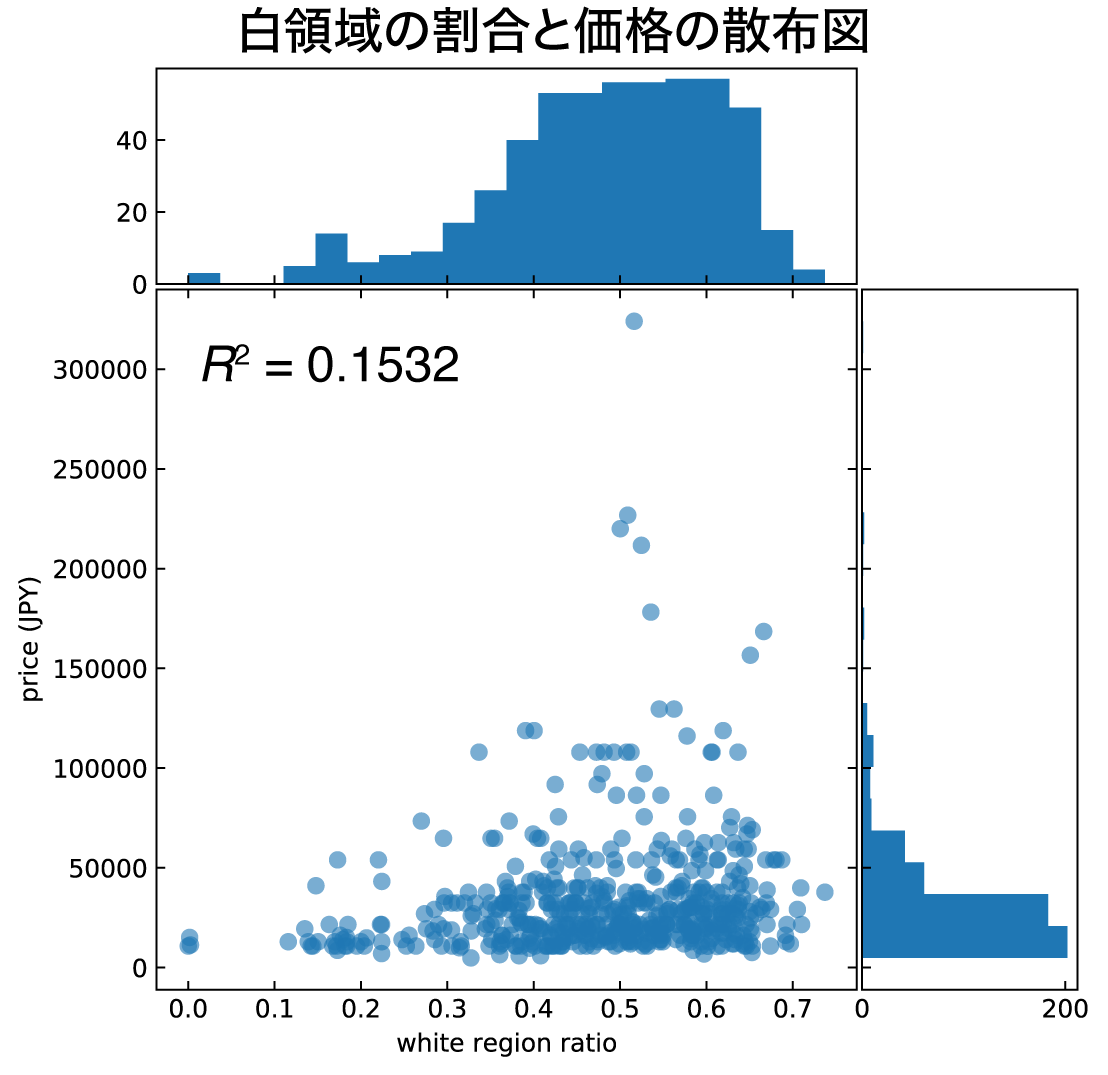

正方形の画像において、重箱が2段,3段のおせちは、1段のおせちより背景の白領域が多くなるはずです。

そこで、『おせち画像の背景の白エリアの面積が有効な特徴量として機能しているのでは』という仮説を立てました。

この仮説は、白エリアの面積と価格の相関を見れば簡単に検証できそうです。(ここは手元のPCで分析しました)

調べてみると、相関係数は0.15程度と、全体ではほぼ無相関でした。しかし、この散布図を見ると、画像背景である白エリアの面積(white region ratio)が大きいおせちでは価格にバラつきが大きく、5万円を超える高額おせちのほとんどは、画像の半分以上が白エリアであることがわかります。やや恣意的ですが、この結果の解釈の一例として次が考えられるでしょう。価格のボリュームゾーンである2-3万円のおせちでは、白領域と価格に相関は見られない。

一方、5万円を超える高額おせちは、2段や3段の重箱で提供されることが多く、おせち画像の白領域の割合が大きいほど高額となる傾向がある。高額おせちは数としては少数だが、価格のスケールが大きいためモデルの学習に大きな影響を与え、結果として価格予測モデルが背景の白領域に着目するに至った。さらに調べるなら、大外ししたデータ具体的に見ていったり、画像をt-SNE等で次元圧縮して可視化3して調べたりと色々やりたいことはありますが、長くなるのでこのあたりにします。

性能はともかく、これでおせち画像から価格を予測する機械学習モデルを構築できたとして、次に進みましょう。Lightweight GANによるおせち画像生成

元旦もといGAN旦に食べるおせち画像を、GANを使って生成してみましょう。

Generative Adversarial Networkって?

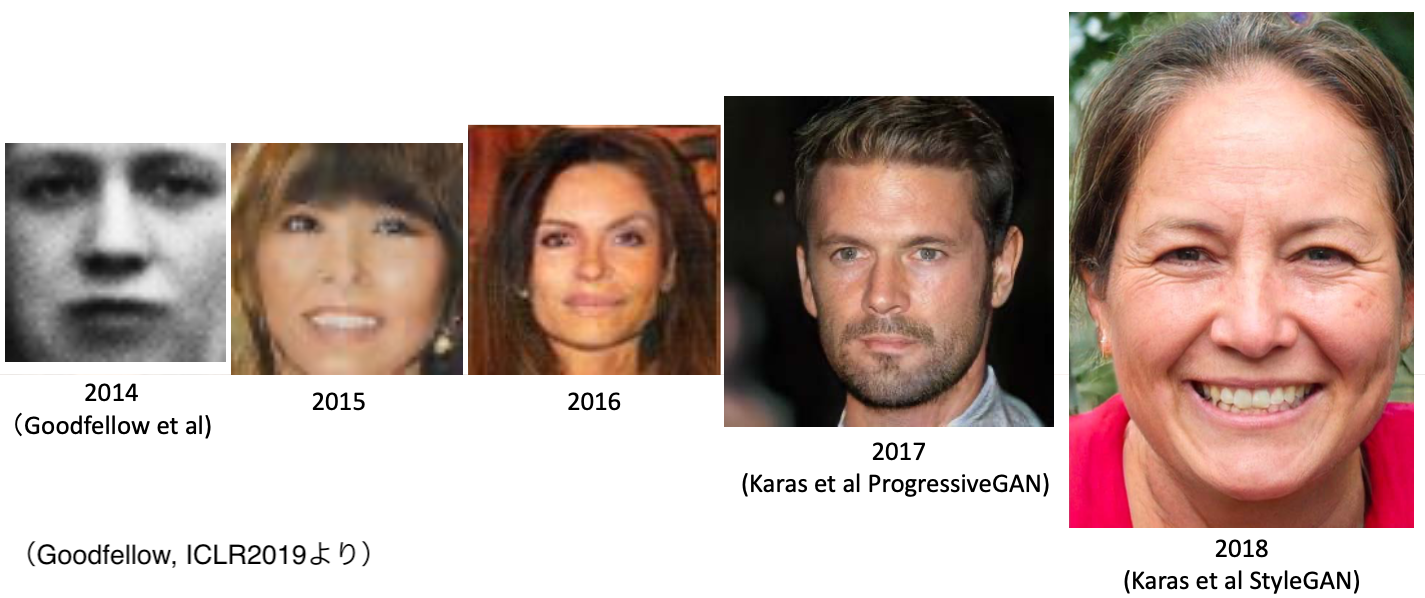

Generative Adversarial Network(GAN)とは、DNNを用いた深層生成モデルの一つです。GANは生成モデルという名前の通り、新しいデータを生成することができる手法です。詳しい説明は他の解説記事や論文に譲りますが、2014年にGoodfellowらによって発明されて以来、凄まじい勢いで進化を重ねている技術です。GANがもっとも成功しているのは画像への応用で、近年では本物と見分けがつかないほど綺麗な画像の生成が可能になっています。一例として、GANによる顔画像の生成結果の変遷を示します。

Which face is real? (https://www.whichfaceisreal.com)というwebサイトでは、人間の顔画像を見て、それがGANで生成されたものか、本物の顔かのクイズで遊ぶことができます。かなり難しいです。GANの実用上の大きな課題の一つは、学習に大量のデータと計算リソースが必要になる点です。

例えば上記画像右のStyleGANの学習には、7万枚の画像データセットと8個のGPUで1週間の計算が必要です。これを普通のゲーミングPCで実行したら2ヶ月ほどかかり、おせちを用意する前に2020年が終わってしまいます。

この問題を解決しようとする試みは多数ありますが、つい最近(2020年11月末)発表されたTowards Faster and Stabilized GAN Training for High-fidelity Few-shot Image Synthesisという論文で、Lightweight GANという手法が提案されました。DNNの構造と学習方法を工夫することによって、100枚程度の画像と1GPU・数時間の学習により高解像度かつ品質の良い画像生成を可能にした手法だそうです。上記論文では、様々なドメインで非常に高品質な画像生成に成功した結果が示されています(図5を一部改変)。

Lightweight GANによるおせち画像生成

今回はこのLightweight GANを用いておせち画像を生成します。ありがたいことに、Lightweight GANはPyTorchで書かれた使いやすい再現実装が公開されています。今回はこちらを使います。

https://github.com/lucidrains/lightweight-gan

使い方は簡単で、上記リポジトリをcloneしpip install lightweight-ganを実行した後に、次の1行で動きます。詳しい使い方やオプションについてはREADMEを参照してください。lightweight_gan --data ./path/to/images --image-size 256Google ColabのGPUランタイムでLightweight GANを12時間学習した後、生成した画像がこちら。価格予測モデルの学習に使用したのと同じ約500枚のおせち画像を学習に用いました。

かなりそれっぽい結果ではないでしょうか。ところどころ破綻してるのも味わい深いですね(?)

遠目から見るとおせちにしか見えませんが、拡大するとおせちじゃないのが不気味で良いです。GANの潜在空間上を移動しながら画像を生成するとこんな感じになります(Interpolation)。

GIFにしました。ぐにぐに動きます。悪夢に出そうです。

これでGAN旦のおせちの準備ができましたね。好きなだけおせち画像を生成できます。

おまけ:GANで作ったおせちの値段は?

初めにDataRobot上で構築した、おせちの価格予測モデルを用いて、GANで生成したおせち画像の価格を予測しました。ここでは予測モデルとGANの学習では違うデータセットを用いるべきですが、おまけの遊びということで。。

みなさんの直感とは合っていますか?

終わりに

Data Robotは初めて使いましたが、最初にモデルを学習させるまでの技術的・心理的ハードルをなるべく下げていることが伝わってきました。まず手元のデータでPoCしたいなど、サクッと試したい時には有用そうです。個人的な印象ですが、ユーザーペルソナとしては「専任のデータサイエンティストではないが業務のために機械学習を使いたい方」かなと思います(『商品の仕入れ数を経験で決めているが、データに基づいて予測したい』など、)。

UIや用語にはややクセがあるように感じましたが、他のAWSやGCPのサービスを使う場合に比べ、覚えるべきことが少なそうです。一方で、利用できる機械学習アルゴリズムには制約があったり、特徴量設計や前処理まで戻ってのトライアンドエラーはワークフロー上しづらいなど、システム上の制約があるのも確かです。簡便さと多機能さはトレードオフなので、ここは道具の使い分けの問題と思います。詳しい人はGoogleのAI Platform Notebooksなど使うほうが所望のことができるでしょう。GANの学習は非常に難しく、同じ画像しか生成されなくなったり(mode collapse)よくわからない理由でバグったりと、様々なハマりどころが知られています。しかし今回は何のトラブルも無くあっさり動いたので、画像の品質と合わせて最新のGANの進化に驚きました。

興味がある方はぜひ自分の好きなデータで試してみてください。

MLに明るい方は、「画像なのにElastic Net?」と疑問に思うかもしれません。Elastic Netは非常に古典的なアルゴリズムで、画像を直接入力として扱うのは苦手だからです。Data Robotでは、予め学習済みのDNNに入力画像を通して、そのDNNの出力を特徴量として他の様々なアルゴリズムの入力に使うことで対応しています。 ↩

ところで、オリジナルのクラスアクティベーションマップ(CAM)は分類問題において各クラスについてのfeature mapの重みや勾配を用いてCNNの着目領域を可視化する手法ですが、Data Robotでは、回帰問題でもアクティベーションマップが出力できるようCAMを拡張しているそうです。実装が気になるところですが、詳しい情報は記載がありませんでした。プロプライエタリなサービスの難しいところです。 ↩

Data Robotには画像の特徴量を次元圧縮して2次元で可視化する機能(画像埋め込み)がありますが、現状ではUIに難があり意味のある分析ができなかったので今回はスキップします。 ↩

- 投稿日:2020-12-12T21:57:46+09:00

pip install tensorflow==1.x がエラーになるとき

pip install tensorflow==1.x ができない

こんなエラーになるとき

python -m pip install tensorflow==1.15 ERROR: Could not find a version that satisfies the requirement tensorflow==1.15 (from versions: 2.2.0rc3, 2.2.0rc4, 2.2.0, 2.2.1, 2.3.0rc0, 2.3.0rc1, 2.3.0rc2, 2.3.0, 2.3.1, 2.4.0rc0, 2.4.0rc1, 2.4.0rc2, 2.4.0rc3, 2.4.0rc4) ERROR: No matching distribution found for tensorflow==1.15原因

Pythonのバージョンが合っていないことが原因の可能性が高いです。

例えばPyPIのtensorflow 1.15.4 のページ↓を見ると、tensorflow 1.15.4 が用意しているパッケージはpython 3.5, 3.6, 3.7 用しか提供されていません。

https://pypi.org/project/tensorflow/1.15.4/#filesなので、Python 3.8や3.9でpip installしても対応するパッケージがないので入りません。

解決方法

Pythonのバージョンをpython 3.5, 3.6, 3.7にすればインストールできます。

# バージョン確認 $ python --version Python 3.7.9 # インストール $ python -m pip install tensorflow==1.15 ///省略 # 確認。モジュールはあることが確認できる $ python -m tensorflow /.../bin/python: No module named tensorflow.__main__; 'tensorflow' is a package and cannot be directly executed参考

- 投稿日:2020-12-12T21:57:01+09:00

「すみません家NW不安定です」、Slack(社外)をMattermost(社内)に転記しよう。

はじめに

「●●さん、今Skype入るのでちょっとまってください」

「あー、▲▲さんのクライアントフリーズしちゃったので先に進めてましょう」

そんなオフィスでの一コマは、全社テレワークにより過去となりました。隣にいる人が察して一報を入れてくれる、それは同じ場所にいるからできたことでした。

テレワークとなり、自宅のNWが不安定などで数分音信不通になることはないでしょうか。そんなとき、みなさんはどうされてますか?

数分程度の不調では、なかなか上司や同僚へメール・電話とはならないのではないでしょうか。

かといって、自分に起きてることをサクッと通知したい。ぼやきたい。そんな経緯から、ゆるっとサクッと通知する方法として

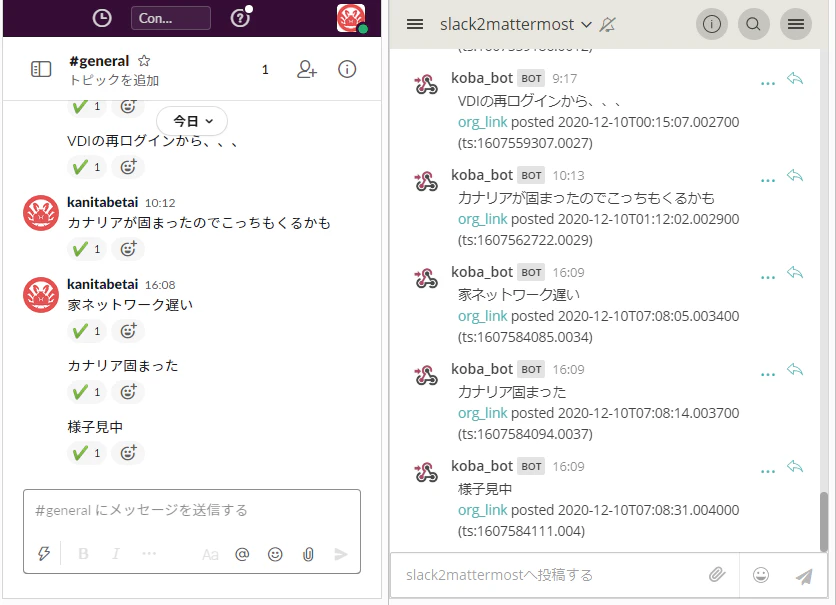

Slackにぼやいた内容を社内Mattermostに転記しようと考えました。やったこと

- 社内Mattermostに転記先チャンネル(Slack2Mattermost)を作る。

- Slack2Mattermost宛のincoming webhookを作成する。

- Slackに転記元のグループ⁽もしくはチャンネル⁾を作成する。

- Slackのトークンを作成する。

- Slack→Mattermostの転記スクリプトを作成する。(Python)

- Mattermostに転記する。(転記時、Slackのユーザ名とMattermostのユーザ名を置換する)

- 転記済のマーキングとしてリアクション絵文字をSlackのPOSTにつける。

- cronでスクリプトを定期実行する。

結果

※カナリア=私用PCのラジコストリーミング NW不安定の指標替わりに使用しています。

これから

記載の転記botはまだ上司に伝えていません。

というのも、人によって良く情報収集するチャンネルが異なり

私はMattermost鬼推しtwitter状態ですが、上司はそれほどでもないので

達成したかった「ちょっとした伝達」にはなり得ないところが、なかなか難しいなと。実装について、Mattermost→Mattermostで試作した後

Slack→Mattermostで実装しましたが、APIの仕様が全く違ったため面くらいました。

MattermostはSlackクローンですが、APIの世界では大きく異なることを知ることができました。

今後は他のSlack APIも試してみたいと思います。おわりに

キーボードが固まってます。といつかPOSTしたい(猫アレルギー)。

以上です、ありがとうございました。

- 投稿日:2020-12-12T21:35:16+09:00

wordファイルをhtmlにコンバートする

ある業務でワードの文章をhtmlにすることが多かったので、docxからhtmlを自動生成させます。

docxファイルを引数にとります。

word上では

h2は■でh3は●brは改行(\n)、空白行は\n\n\n\nで記述されているパターンを想定。

docx2html.rbdef docx2html(file_name): import docx2txt text = docx2txt.process(file_name) s=text.replace('\n\n\n\n\n\n', '[空白行]') s=text.replace('\n\n\n\n', '[空白行]') s=s.replace('\n\n', '<br>') lis=s.split('[空白行]') lis.pop(0) new_lis=[] for i in lis: if i[0:4] == "<br>": i = i[4:] new_lis.append(i) lines=[] for i in new_lis: if len(i)>0: if i[0]=="■" or i[0]=="●": s=i.replace('<br>', '[改行]',1) p=s.split('[改行]') for i in p: lines.append(i) else: lines.append(i) html= "" html_lines=[] for line in lines: if line[0] == "■": html=line.replace('■','<h2>') html=(html+"</h2>") elif line[0] == "●": html=line.replace('●','<h3>') html=html+"</h3>" else: html="<p>"+line+"</p>" html_lines.append(html) comp_lis=[] for i in html_lines: if "<br>" in i: i = i.replace("<br>","<br>\n") elif "<h3>" in i: i = i.replace("<h3>","<h3>●") comp_lis.append(i) """for i in comp_lis: print(i) print()""" f = open('docx2html_4.txt', 'w') for i in comp_lis: f.write(i+"\n") f.write("\n") f.close()

- 投稿日:2020-12-12T21:32:02+09:00

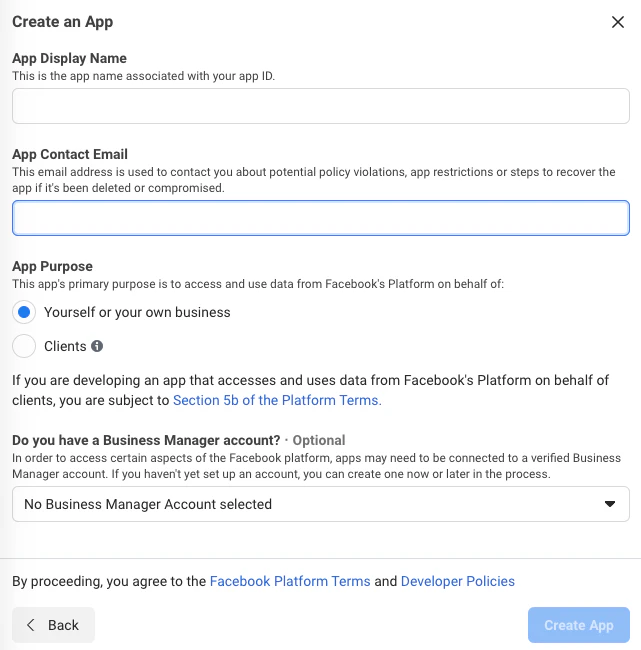

Facebook Messenger API + Flask 備忘録 [実装編 1]

導入編 からの続き、とりあえず簡単なオウム返しから。

pymessenger というサードパーティー製のライブラリもあるようだが、2016年から更新されていないので、勉強も兼ねて今回は自分で実装する。

POSTリクエストの中身

詳しくはこちら: Webhook Events, Send API

全部読むのは面倒なので、必要な部分だけ使いながら実装していく。

API の webhook の本体はこんな感じ。まずはユーザーがアプリに送信した場合

{ 'object': 'page', 'entry': [ { 'id': '<FBページのID>', 'time': 1607767826503, 'messaging': [ { 'sender': { 'id': '<FBユーザーのID>' }, 'recipient': { 'id': '<FBページのID>' }, 'timestamp': 1607767826302, 'message': { 'mid': 'xxxxxxxxxxxxxxxxxxxxx', 'text': 'hello' } } ] } ] }自分のページ側のIDは既に知っているので取得する必要はない。つまり

['entry']['messaging']の中の['sender']['id']および['message']['text']を取り出せば良い。ここで['entry']はイベントの配列、['entry']['messaging']はメッセージの配列になっているので for 処理などが必要。とは言っても、試した限りでは未受信のメッセージが溜まっていても同時にまとめて送られることはなく、一件のみだった。また、メッセージの直後にほぼ同じ形式でウォーターマークが送られる。こちらには

['message']の代わりに['delivery']がある。{ 'object': 'page', 'entry': [ { 'id': '<FBページのID>', 'time': 1607767829878, 'messaging': [ { 'sender': { 'id': '<FBユーザーのID>' }, 'recipient': { 'id': '<FBページのID>' }, 'timestamp': 1607767829912, 'delivery': { 'mids': [ 'xxxxxxxxxxxxxxx' ], 'watermark': 1607767827879 } } ] } ] }一方返信用の中身はこれだけで十分。これに発行したトークンを

access_tokenとしてパラメータで与え、ヘッダーにContent-Type: application/jsonを指定すればOK。{ "recipient": {"id": "<FBユーザーのID>"}, "message": {"text": "hello"} }おうむ返し実装

前回のコードに、POST 部分を追加する。後々のことを考えて、

send_message()という関数を分けて作っておく。ちなみにここで取得した

userIDというものは、FacebookアカウントのIDとは全く別物で、Page-scoped ID と呼ばれるらしい。自分のIDを知るためにも、返信文の中に埋め込む。import os, json from flask import Flask, request from dotenv import load_dotenv load_dotenv() # 環境変数ファイル .env の読み込み ACCESS_TOKEN = os.getenv('ACCESS_TOKEN') # .env に記載 VERIFY_TOKEN = os.getenv('VERIFY_TOKEN') # .env に記載 @app.route('/callback', methods=['GET', 'POST']) def receive_message(): if request.method == 'GET': # webhook テスト用 GET if request.args.get("hub.verify_token") == VERIFY_TOKEN: return request.args.get("hub.challenge") else: return 'ちがうよ' elif request.method == 'POST': # POSTリクエスト -> 返信処理 body = request.get_json() # 中身取得 for entry in body['entry']: # iterate 'entry' for messaging in entry['messaging']: # iterate 'messaging' userID = messaging['sender']['id'] # ユーザーのID if messaging.get('message'): # メッセージ以外を除外 received_message = messaging['message']['text'] # テキスト response = f'{userID}さん, {received_message}' # おうむ返し文 send_message(userID, response) # 返信実行 return "finished" # なんでも良い。返信内容とは無関係だが、無いとエラーになり返信を繰り返す # 返信リクエスト用関数 # 失敗したらログに出力, Heroku なら heroku logs --tail で確認可 def send_message(userID, message): result = requests.post("https://graph.facebook.com/v9.0/me/messages", params={"access_token": ACCESS_TOKEN}, headers={"Content-Type": "application/json"}, data=json.dumps({ "recipient": {"id": userID}, "message": {"text": message} }) ) if result.status_code != 200: print('送信失敗だよ:', data)とりあえずこれで、このようなおうむ返しが可能になる。

POST テスト

メッセージの送信テストをする際に、いちいち Python のプログラムをデプロイするのは非常に面倒なので、専用のツールを使って試したい。

Facebook はブラウザ上で API の動作を試せる Graph API Explorer なるものをわざわざ作ってくれておりこれだけでもいろいろできるのだが、やはり保存したり再利用したりすることを考えて、ド定番のリクエストツール Postman を利用する。

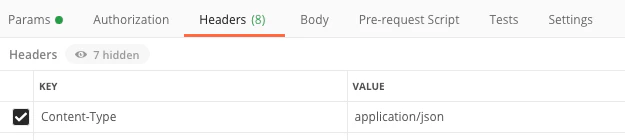

POST を選んで URL に

https://graph.facebook.com/v9.0/me/messages

Params の KEY にaccess_token, VALUE に発行した長いアクセストークンを入力

HeadersはContent-Typeとapplication/json

最後に Body は raw を選んで、送りたいメッセージを json 形式で記入する。先ほどのプログラムで取得した自分のIDを入力する。

このように、簡単にメッセージを送信できる。これ自体は上で実装した関数

send_message()を用いてももちろん可能。

- 投稿日:2020-12-12T21:21:20+09:00

20年来のCプログラマがPythonに移行した話

はじめに

この記事は「プログラミング技術の変化で得られた知見・苦労話【PR】パソナテック Advent Calendar 2020」のために記載したものです。

なんかの拍子にQuitaのこの広告目に入って、そういや随分昔からプログラムやってるなぁ、と思い出し、

自分の知識整理かねて記事書いてみよう、と思い立った次第です。ネタとしては表題の通り、20年Cをやっていたものの最近はほぼPythonしか書かなくなってしまった、という話ですが

なんでそうなってしまったかを自分の経験とか使い方とか踏まえて考察してみようと思います。

決して商品のM1Macにつられたわけではありません。いや興味はすっごくあるんですが。つか欲しいです...!軽く自己紹介

まずお前誰やねん、というとこが分からないと苦労話もできませんので属性を書いておきます。

まじめにプログラムやったのは大学生以降ですね。

ちょくちょく他言語に触れながらも基本はC/C++で20年超です。

Pythonはここ3年ほど使ってますが最近はC/C++で書くことがほとんどなくなりPythonばっかりという状況です。

- 大学の講義でCに触れ、K&Rで学ぶ(~22歳)

- 大学院まで進んだが研究で使ってたのはVisualBasic(手っ取り早くGUI書きたかったので。~25歳)

- 社会人になり家電メーカーにて組み込みLinux家電とかを開発

- Linuxドライバ開発やカーネル弄りを担当してどっぷりC言語につかる(~30歳)

- その後itronとかipl※開発とかも手掛けるが相変わらずC言語(~3x歳)

- android開発を始めたのでちょっとJavaとかに手を出すも、android NDKやれと言われ再びC/C++に出戻り(~3x歳)

- 画像系処理の仕事に転向するも、主力はC/C++版openCV(~4x歳)

- 画像系は今後はAIやらんと駄目ねと思い立つ(3年ほど前)

- 現在4x歳のおっさん

Pythonなれそめ

画像系処理といっても家電メーカーなので、写真を綺麗にとれるようにちょっとした機能を入れましょう、程度の実装で済んでいましたが

ここ数年で「わが社もAIで新たな機能を開発すべし」みたいな声があちこちから降ってきました。

で、技術担当としてはAIやらねば、となったはいいものの、開発言語としてはほぼPythonしか選択肢がないわけです。

(一応C++とかもあったにはあったけど)

えー、言ってもインタプリタ言語でしょ?ちゃんと速度出るの?みたいな感じで仕方なくはじめてみた感じだったと思います。

画像系だととにかく速度が問題になることが多く(※)、より機械に近いC言語のようなプログラム言語を使って無駄をなくすというのがそれまでの自分内常識でした。

ただ、それまでの経験から「ユーザー数の少ないプラットフォームは情報の少なさで割を食う」ことは見えていたので、まずは一番メジャーなPython版で試さない事にはC++とかも難しかろう、と触ってみたのが最初だったはずです。※例えば動画をカクつかせずに画像フィルタをかけろ、とか

Pythonおっそい

で、とりあえず画像処理とかやってみるわけです。

本当は業務に沿った処理内容になるのですが、ここでは適当なサンプルということで画素のRGBそれぞれの平均を求めてみる処理を書いてみます。

C++版のOpenCVはそれまでも使ってたので、同じように…import cv2 import nump as np def calc_img_mean(img): bgr = np.zeros((3)) hwc = img.shape for y in range(hwc[0]): for x in range(hwc[1]): bgr += img[y, x] return bgr / (hwc[0] * hwc[1])こっちはC++実装.

#include <opencv2/opencv.hpp> cv::Vec3f calc_img_mean(const cv::Mat *img) { cv::Vec3f rgb_sum(0,0,0); for(int y = 0;y < img->size().height;y++){ for(int x = 0;x < img->size().width;x++){ rgb_sum += (img->ptr<cv::Vec3b>(y))[x]; } } rgb_sum /= img->size().width * img->size().height; return rgb_sum; }4000x3000くらいの画像に対して手元のPCで実行してみると、それぞれの実行時間は以下の通りになりました。

実装 実行時間(s) C++ 0.03 Python 34.4 うぉぉぉい!遅すぎて変な声出ました。本当に1000倍遅い。なんぼ何でも遅すぎません…?

numpyが全てを解決する

で、世の中の人はどんな感じで書いてるんだ?と見たところ

img_mean = np.mean(img, axis=(0,1))え、これでいいの?ってな感じでした。まずopencvで読み込んでるのにnumpyが出てきてるのに混乱。確かにcv::Matと概念似てるみたいですが..

で、実行時間は..346msec! 一気に100倍アップです。30秒だとどうにもなりませんが0.3秒なら工夫すりゃ何とかなりそうです。

いやいや、C++だってcv::mean()あるじゃん、と思われるでしょうが、C++ではここまで劇的には変わりません。というかこういうAPIがあることを後で知りました。

C/C++だと自分で書いてもそれなりに速度出るせいで, 機能探すより自分で書いちゃうんですよね...

実装 実行時間(s) C++(自前ループ) 0.03 C++(cv::mean()) 0.015 Python(自前ループ) 34.4 C++(np.mean()) 0.35 それに本当にやりたいのは「画像の平均」みたいな定型処理じゃなく、用途ごとに色々ありますからね。

色々って何よ。うーん、じゃあBayer配列のRGB化とか...def raw2rgb(raw): h, w = raw.shape rgb = np.empty((h//2,w//2,3), dtype=np.uint8) rgb[...,0] = raw[1::2,1::2] rgb[...,1] = (raw[1::2,::2] + raw[::2,1::2])//2 rgb[...,2] = raw[::2,::2] return rgb同じようにC++実装。

cv::Mat raw2rgb(const cv::Mat *raw) { cv::Mat rgb = cv::Mat_<cv::Vec3b>( raw->size().height/2, raw->size().width/2); unsigned r, g, b; for(int y=0;y < raw->size().height/2;y++){ for(int x=0;x < raw->size().width;x++){ r = (raw->ptr(y*2+1))[x*2+1]; b = (raw->ptr(y*2))[x*2]; g = ((raw->ptr(y*2+1))[x*2] + (raw->ptr(y*2))[x*2+1]) / 2; cv::Vec3b rgb_value(r,g,b); (rgb.ptr<cv::Vec3b>(y))[x] = rgb_value; } } return rgb; }8000x6000サイズの配列を与えた時の処理時間は以下の通り。

実装(raw2rgb) 実行時間(s) C++(自前ループ) 0.12 Python(numpy) 0.13 なんと、C++自前ループとほぼ同じ速度が出てきてしまいました。そしてコードのシンプルさが凄い。

C++版のOpenCV使う時には型チェックのコンパイルエラーに悩まされてたりしてたのが、間違えようがない位にシンプルです。Pythonいいじゃん

これで図にのり、当初は「C++実装のCaffeeとか使うか…?」とか考えてましたがPythonでAI進めることに。

で、これでいろいろ実装していくとC/C++と比べたPythonの利点がいろいろと。個人的にこれは便利と思った点を書いていきます。numpyは神

最初のころは「numpyがPythonの本体なのでは...」とか失礼なことを考えるくらいでした。本当、画像処理にnumpyはこれ以上考えられない位の組み合わせです。

cv::Matと似ているとは言え, あっちはAPIによって型とかがいろいろ定義されててキャストだらけになりがち(※1)なのが, とにかくシンプルに書けます。

例えばOpenCVには画像を反転するflip()という関数があるのですが、AIフレームワークの中では対応する関数がないものもあります。

で、どうするんだと海外の掲示板とか見てみるとQ. 画像反転したいんだけどAPIないよ

A. img[::,::-1,...] ※2みたいなことが書かれていて目から鱗でした。ちょっとした画像の変形とか解析ならnumpyだけでさくっとできてしまいます。

※1 筆者のopenCV知識不足によるものの可能性があります。とはいえnumpyだと知識いらずという点で優れているかと。

※2 numpy(および類似のAIフレームワークtensor)での「第2軸を逆順に並べる」という処理辞書(dict)型がすごく便利

キーとオブジェクト参照を入れる辞書型が一つあるだけで, C/C++で構造体に求めていた役割はほぼすべて代替されているような印象です。

とりあえず辞書作って、ある関数の出力をキーAに、別の出力をキーBに..と突っ込んでいって、受ける側では自分の必要な情報だけ参照する、みたいなことができます。

これがC/C++だと構造体を定義しなおしたり関数引数型を変えたりと、処理途中に関数を追加しようと思うととにかく手続きが多い。その分チェックが厳密になるという点はありますが、そのためコードが増えたら意味ないと思うんですよね。コードが増えた分1行当たりにかけられる注意は減っていくわけで。良くも悪くも実行時評価

関数を書いた時点では構文チェック程度しか行われておらず、引数が何者であるかなどは考慮されません。

なので次のような関数定義もできちゃいます。hello()メソッドがあるクラスなら何でも受け付けるわけですね。

で、その後で新しいクラスを作った時や人の作ったクラス流用する場合にもhello()メソッドさえ追加してしまえばfunc()に突っ込める訳です。めっちゃ便利。

これをC/C++でやろうとすると皆に共通の基底クラス作るなりして関数の引数型を宣言して..と段取りが大変です。

いやそういう大規模設計が必要なところもまだあるんでしょうが、今日日何か月もかけて大規模開発するってのは流行らない気がします。def func(cls_inst): cls_inst.hello() class A(object): def hello(self): print("I am class A")たまに困ることもあるけど

生データ操作には限界もある

ctypesとかstructとか使うことでバイナリデータの読み書きなんかもかなり行けるんですが、バイト境界を跨いだビットフィールド、みたいなデータの扱いは難しいですね。というかこんな部分はC/C++の出番でしょう。Pythonでやる需要もなさそうだし。

富豪プログラミングになりがち

Pythonで書いた関数をCに戻そうとすると, 膨大な自動変数を確保してるのに気づかされたりします。C++だと割と同じようなことできるけど、とにかくメモリを贅沢に使った富豪プログラミングになりがちです。

まぁAI使うようなところだと実行環境も富豪だったりするのでそれほど問題にならないんですが、組み込みCに画像処理を移植、なんてときは大変ですね。名前の上書きに気づきにくい

変数宣言がなく、名前になんでも突っ込めるせいで気づかないうちに「モジュール名を別のオブジェクトで上書き→挙動がおかしくなる」みたいなことが起きます。

pycocotools.maskとかtorch.optimみたいな「自分でも変数として使いがちな名前」が危ない。

さすがに下みたいに直近に書くのは気づきますが、Jupyter noteとかで書いてると「1つ前のセルに戻ったら、さっき動いたコードが動かない」みたいなことをやってしまいます。from pycocotools import mask .... # アノテーション画像をCOCO辞書に変換 ann_img = np.array(Image.open(xxx)) mask = ann_img == clsid mask.encode(mask) #エラー, maskは既にモジュールじゃなくてndarrayで、何故Pythonでしか書かなくなってしまったのか

私的には「プログラムに求められる事が変わった」ためだと思います。

昔書いていたころは

- とにかく速度が正義

- メモリも節約すべし

- 開発はじっくり時間かけてもいいよ

- 求められる機能はそんなに多くないよ

だったのですが、今は速度とメモリが最優先される環境はかなり減りました。

もちろんそうはいっても冒頭のループみたいな部分が問題になって、20年来C/C++から乗り換え進まなかったのですが、Pythonだとnumpyがほぼ解決してくれるのが大きいですね。加えて、開発スタイルが大きく変わりました。

とにかく開発速度優先、できるかできないかをまず検討すべし、みたいな開発要求が増えています。

C/C++で書いてると開発速度がどうしても遅くなってしまうんですよね。コード量の問題もありますし、コンパイルとコーディングを行き来するのは思っている以上に開発速度を落としているんだな、というのもPythonを使って思いました。

できたコードを周囲に展開するのもC/C++だと開発環境だのライブラリだので一苦労ですしね。以上、プログラミング技術の変化で得られた知見・苦労話でした。

記事を書いてみて

久々にC++書いたのでコード至らない点はご容赦ください(言い訳)。つか書いてないと忘れるものですね...

- 投稿日:2020-12-12T21:05:20+09:00

Let's challenge LeetCode!! _2

こんばんは(*´ω`)

二回目は何故か日本語で行きます。121. Best Time to Buy and Sell Stock

Say you have an array for which the ith element is the price of a given stock on day i.

If you were only permitted to complete at most one transaction (i.e., buy one and sell one share of the stock), design an algorithm to find the maximum profit.

Note that you cannot sell a stock before you buy one.--ザックリ翻訳-----

与えられた株の売値、買値が i th day まで先読みできたとします。

買う前に売ることは勿論できませんが、1日に出来るのは売り or 買い の何れかです。

利益の最大値を求めてみましょう。これは間違いなく、DP!! っと意気揚々と

以下のコードを書いてみたがあえなく撃沈。。。best-time-to-buy-and-sell-stock_0.pyclass Solution: def maxProfit(self, prices: List[int]) -> int: dp = [0 for m in range(len(prices))] if len(prices) <= 0: return 0 for i in range(1,len(prices),1): for j in range(i): if prices[i] - prices[j] > 0: dp[i] = max(dp[i-1],dp[i],prices[i]-prices[j]) else: dp[i] = dp[i-1] return dp[-1]時間が掛かりすぎるようです。

用意しているノートをコンパクトにし、

1 つのセルを死ぬほど更新してみようと思いました。best-time-to-buy-and-sell-stock_1.pyclass Solution: def maxProfit(self, prices: List[int]) -> int: Mval = 0 for i in range(len(prices)-1): for j in range(i+1,len(prices),1): Cval = prices[j]-prices[i] if Cval > Mval: Mval = Cval return Mval残念ながら、これも time over。。

やっぱり for のネストが良くないだと思います。

クリアするためには n に抑える必要がありそうです。

そこで以下のコードに辿り着きました。best-time-to-buy-and-sell-stock_2.pyclass Solution: if len(prices) == 0: return 0 dp = [0 for i in range(len(prices))] for i in range(1,len(prices)): dp[i] = prices[i]-prices[i-1] CM = [0 for i in range(len(prices))] for j in range(1,len(prices)): CM[j] = max(dp[j],CM[j-1]+dp[j]) return max(CM)for 文をネストして切り抜けようとする考えを捨ててみました。

例えばですが、data[3] - data[2] に data[2] - data[1] を足すとどうなりますか?

data[3] - data[1] になりますよね?

前述だと data 長が [0] ~ [3] だった場合、

全てのケースを比較した選定は出来ませんが、

maxを使って、常に最大値を記録していたので全部やる必要が無いのです。最後ですが、以下の記述を見つけて、自分は度肝を抜かれました。

best-time-to-buy-and-sell-stock_3.pyclass Solution: def maxProfit(self, prices: List[int]) -> int: max_price = 0 price = 0 for i , high in enumerate(prices): if i == 0 or high < low: low = high else: max_price = high - low if max_price > price: price = max_price return priceprices[0] を最小値と設定します。

これを基準に利益の最大値を更新していきます。

しかし、このコードの素晴らしい所は、最小値も

常に更新し、利益を記録している所です。

無理に表に落とすことなく、パラメータ用の箱をそれぞれ用意して、

その箱の中を都度更新していきます。勿論、for 文のネスト無しで実現しています。

これが easy だって。

やばい。。(笑)

- 投稿日:2020-12-12T20:57:58+09:00

量子スピン模型のハミルトニアンを数値対角化しよう

対象

この記事は

- 量子スピン系のハミルトニアンの対角化方法が分からない人

- 量子スピン系の小さいモデルでちょっと遊んでみたいけど,いちいち専用ライブラリを使うのはめんどくさい人

向けの記事です.

初学者向けなので,最適化とかは真面目にはやりません.

基本的にpythonで解説しています.最後にちょっとjuliaのコードもあります.環境は,pythonでnumpyとscipyが動けば大丈夫です.

juliaの場合はArpack, SparseArraysが必要です.はじめに

プログラムと整合性を取りやすい様に,添字は0から始めます.

簡単のため,スピンは$\pm 1$のみをとるとします.

この記事ではI = \begin{pmatrix} 1 & 0 \\ 0 & 1 \end{pmatrix} ~ , ~ S^x = \begin{pmatrix} 0 & 1 \\ 1 & 0 \end{pmatrix} ~ , ~ S^y = \begin{pmatrix} 0 & -i \\ i & 0 \end{pmatrix} ~ , ~ S^z = \begin{pmatrix} 1 & 0 \\ 0 & -1 \end{pmatrix}とします.

いくら初学者向けとは言ってもスピン数が少なすぎると悲しいので,(N=16ぐらいの)そこそこのスピン数の基底状態計算がノートPCでもちょっと待てば動く様なコードを目指します.

(でもN=16って2次元正方格子だとL=4だし,4次元超立方格子だとL=2しかないので悲しい.)それと,私は対角化の人ではないので,間違ったこと書いてるかもしれません.先に謝っておきます.ごめんなさい.

ハミルトニアンと行列

スピン模型のハミルトニアンは

\mathcal{H} = \sum_{\langle i, j \rangle} J_x S^x_i S^x_j + J_y S^y_i S^y_j + J_z S^z_i S^z_jのような形で書かれることが多いですが,ハミルトニアンの行列表示において,$S^x_i S^x_j$などの積はテンソル積を意味します.

テンソル積は,行列A, Bに対してA \otimes B = \left( a_{ij} B \right) = \begin{pmatrix} a_{11} B & a_{12} B & \cdots \\ a_{21} B & a_{22} B & \cdots \\ \vdots & \vdots & \ddots \end{pmatrix}と表される演算です (Wikidepdiaより)

更に,$i, j$で指定されていないindexには全て単位行列$I$がかかります.

つまり先ほどのハミルトニアンの$i=0, j=1$の時の$\sum$の中身は,J_x S^x \otimes S^x \otimes I \otimes I \otimes \dots + \\ J_y S^y \otimes S^y \otimes I \otimes I \otimes \dots + \\ J_z S^z \otimes S^z \otimes I \otimes I \otimes \dots \ \と計算できます.よって,先ほどのハミルトニアンを行列表示できちんと書くと

\mathcal{H} = \sum_{\langle i, j \rangle} J_x \ I \otimes \cdots \otimes I \otimes \underset{\underset{i}{\wedge}}{S^x} \otimes I \otimes \cdots \otimes I \otimes \underset{\underset{j}{\wedge}}{S^x} \otimes I \otimes \cdots + \\ J_y \ I \otimes \cdots \otimes I \otimes \underset{\underset{i}{\wedge}}{S^y} \otimes I \otimes \cdots \otimes I \otimes \underset{\underset{j}{\wedge}}{S^y} \otimes I \otimes \cdots + \\ J_z \ I \otimes \cdots \otimes I \otimes \underset{\underset{i}{\wedge}}{S^z} \otimes I \otimes \cdots \otimes I \otimes \underset{\underset{j}{\wedge}}{S^z} \otimes I \otimes \cdotsとなります.これを定義に従って計算するのは大変ですが,実際はほとんどが0となります.

実際に0以外の値が入るindexは,まず$(x, y) = (0, 0)$として,テンソル積を構成する行列を後ろから見て,

1. (x, y) を 2倍にする

2. (x, y) に 行列の成分が非零となるindexを加える

(例. $I$,$S^z$だったら$(0, 0)$ or $(1, 1)$, $S^x$,$S^y$だったら$(0, 1)$ or $(1, 0)$)

3. 一つ前の行列に移動する

というステップを繰り返すことで,最終的に成分が入るindexを計算することができます.値も同様に計算できます.ここで,1ステップ目の"2倍"の2という数字は,$SやI$の行列サイズが2だからです.異なる行列サイズの場合はここを変えてください.

この方法から分かるように,このハミルトニアンを表す行列の非零成分は,2ステップ目のindexを加える過程で毎回2倍に増えるので,近接相互作用のみの場合,$O(結合数 \times 2^N) \approx O(N 2^N)$となります.行列自体は$2^N$行$2^N$列なので,効率よく行列を生成することができます.

簡単な実装

簡単な実装のための準備をします.

def set_Hamiltonian_tmp(O1, index1, O2, index2, x, y, itr, val, matrix): if(val==0): return if(itr>=0): if(itr==index1): set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x, 2*y, itr-1, val*O1[0][0], matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x+1, 2*y, itr-1, val*O1[1][0], matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x, 2*y+1, itr-1, val*O1[0][1], matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x+1, 2*y+1, itr-1, val*O1[1][1], matrix) elif(itr==index2): set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x, 2*y, itr-1, val*O2[0][0], matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x+1, 2*y, itr-1, val*O2[1][0], matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x, 2*y+1, itr-1, val*O2[0][1], matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x+1, 2*y+1, itr-1, val*O2[1][1], matrix) else: set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x, 2*y, itr-1, val, matrix) set_Hamiltonian_tmp(O1, index1, O2, index2, 2*x+1, 2*y+1, itr-1, val, matrix) else: matrix[x,y] += val return def set_Hamiltonian(O1, index1, O2, index2, J, matrix, N): set_Hamiltonian_tmp(O1, index1, O2, index2, 0, 0, N-1, J, matrix) returnset_Hamiltonian_tmpを再帰的に呼んで,非零行列要素の場所と値を計算しています.

このset_Hamiltonian_tmpが先ほどのアルゴリズムを表しています.

このような準備をしておくと,Nスピンの1次元ハイゼンベルグ模型のハミルトニアン\mathcal{H} = \sum_{i} J_x S^x_i S^x_{i+1} + J_y S^y_i S^y_{i+1} + J_z S^z_i S^z_{i+1}($J_x = J_y = J_z = 1$)が(周期境界条件で)次のようにして求まります.

import numpy as np Sx = np.array(([0, 1], [1, 0]), dtype=np.complex128) Sy = np.array(([0, -1j], [1j, 0]), dtype=np.complex128) Sz = np.array(([1, 0], [0, -1]), dtype=np.complex128) N = 12 Jx = 1.0 Jy = 1.0 Jz = 1.0 hamiltonian = np.zeros((2**N, 2**N), dtype=np.complex128) for i in range(N-1): set_Hamiltonian(Sx, i, Sx, i+1, Jx, hamiltonian, N) set_Hamiltonian(Sy, i, Sy, i+1, Jy, hamiltonian, N) set_Hamiltonian(Sz, i, Sz, i+1, Jz, hamiltonian, N) set_Hamiltonian(Sx, N-1, Sx, 0, Jx, hamiltonian, N) set_Hamiltonian(Sy, N-1, Sy, 0, Jy, hamiltonian, N) set_Hamiltonian(Sz, N-1, Sz, 0, Jz, hamiltonian, N)このハミルトニアンを対角化したい場合は,

from numpy.linalg import eigh eigs, eigvals = eigh(hamiltonian)とすれば求まるはずです.

高速化する

先ほどの実装は遅すぎます.

密行列の固有値と固有ベクトルを全て求めると当然時間がかかります.

必要がないならやめましょう.疎行列

ハミルトニアンに$I$が多いので,ハミルトニアンを表す行列成分に0が多くなります.

なので,実際に0以外の成分が入るとこをのみを計算するようにしましょう.

pythonのscipy.sparse.lil_matrixを用いると,numpyの配列のように疎行列を扱うことができます.hamiltonian = lil_matrix((2**N, 2**N), dtype=np.complex128)と変更するだけで大丈夫です.

小さい固有値と対応する固有ベクトル

ハミルトニアンの固有値/固有ベクトルは$2^N$個ありますが,全部必要になることはあまりありません.

エルミート行列の小さい固有値と対応する固有ベクトルのみだけを計算する場合は,scipy.sparse.linalgのeigshを使いましょう.

また,lil_matrixは計算には向かないので,scr_matrix等の形式に変更しましょう.

次の例では,ハミルトニアンの固有値/固有ベクトルを小さい方から6個とってきてます.from scipy.sparse import csr_matrix from scipy.sparse.linalg import eigsh hamiltonian = csr_matrix(hamiltonian) eigs, eigvecs = eigsh(hamiltonian, which='SA', k=6)詳しくは,scipyのeigshのページを参照してください.

もうちょっと高速化する

先ほどのコードでも動きますが,まだ計算できるNが小さいです.

N=16程度を高速で計算しようと思ったら,もう少し手間を加える必要があります.eigshの仕様

Find k eigenvalues and eigenvectors of the real symmetric square matrix or complex hermitian matrix A.

と書いてありますが,eigshのソースコードを読むと

complex hermitian matrices should be solved with eigs

と書いてあります.(実際,複素数成分の行列をeigshに投げると内部でeigsが実行されます)

- エルミート性を仮定するアルゴリズムは,仮定しないアルゴリズムより遅い

- エルミート性を仮定しないアルゴリズム場合,固有ベクトルが直交するとは限らない

という問題があるので,できるだけエルミート性を仮定したアルゴリズムにした方が良いです.

先に挙げたハミルトニアンの場合,実対称行列となっています.なので,

hamiltonian = hamiltonian.astype(np.float64)のようにして実対称行列に変換してからeigshに投げましょう.

$S^x S^y$のような項があって実対象とはならない場合は,(実際に実行されているのはeigsなので)諦めてeigsを実行後に固有ベクトルを直交化しましょう.

(一応,N行N列エルミート行列を実部と虚部に分解して2N行2N列の対称行列にして実行するテクニックも存在します.)pythonの疎行列の仕様

はむかずさんのページにあるように,lil_matrixは挿入操作ですら遅いので,最初からcsr_matrixで持っていた方が良いです.

ハミルトニアンの非零成分が(x_1, y_1, val_1), (x_2, y_2, val_2), (x_3, y_3, val_3), \cdotsの様に表される場合,

x_array = [x_1, x_2, ...] y_array = [y_1, y_2, ...] val_array = [val_1, val_2, ...] hamiltonian = csr_matrix((val_array, (x_array, y_array)), shape=(2**N, 2**N))とすることで,lil_matrixを経由することなくcsr_matrixが生成できます.

(詳しくはcsr_matrixの仕様を参照してください)ここで,ハミルトニアンの非零成分についてもう少し詳しく見てみます.

対角成分

対角成分は$S^zS^z$のように,$S^z$のみの項から来ます.この項はどの添字によるものかに関わらず,x_arrayとy_arrayが共通します.なので,

val_arrayのみを計算して足し上げることで,対角成分由来のx_array,y_array,val_arrayの配列の長さを圧縮できます.def set_Hamiltonian_diag(O1, index1, O2, index2, J, N): val_array = [J] for i in range(N-1, -1, -1): val_array_new = [None]*(len(val_array)*2) if(i==index1): val_array_new[::2] = [val*O1[0][0] for val in val_array] val_array_new[1::2] = [val*O1[1][1] for val in val_array] elif(i==index2): val_array_new[::2] = [val*O2[0][0] for val in val_array] val_array_new[1::2] = [val*O2[1][1] for val in val_array] else: val_array_new[::2] = val_array val_array_new[1::2] = val_array val_array = val_array_new return np.array(val_array)このような関数を実装しておくと,先ほどのハミルトニアンの対角成分は

hamiltonian_diag = np.zeros((2**N), dtype=np.complex128) for i in range(N-1): hamiltonian_diag += set_Hamiltonian_diag(Sz, i, Sz, i+1, Jz, N) hamiltonian_diag += set_Hamiltonian_diag(Sz, N-1, Sz, 0, Jz, N)のようにして実装できます.(この実装の場合,x_arrayとy_arrayは共に $[0, 1, \cdots, 2^N-1]$ =range(2**N)なので,覚えていません)

非対角成分

非対角成分の場合,異なるindexからくる項は異なる行列成分に属するため,x_array, y_array, val_arrayを全て覚えておく必要があります.

def set_Hamiltonian_offdiag(O1, index1, O2, index2, J, N): x_array = [0] y_array = [0] val_array = [J] for i in range(N-1, -1, -1): x_array_new = [None]*(len(x_array)*2) y_array_new = [None]*(len(y_array)*2) val_array_new = [None]*(len(val_array)*2) if(i==index1): x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y+1 for y in y_array] val_array_new[::2] = [val*O1[0][1] for val in val_array] x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y for y in y_array] val_array_new[1::2] = [val*O1[1][0] for val in val_array] elif(i==index2): x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y+1 for y in y_array] val_array_new[::2] = [val*O2[0][1] for val in val_array] x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y for y in y_array] val_array_new[1::2] = [val*O2[1][0] for val in val_array] else: x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y for y in y_array] val_array_new[::2] = val_array x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y+1 for y in y_array] val_array_new[1::2] = val_array x_array = x_array_new y_array = y_array_new val_array = val_array_new return x_array, y_array, val_arrayこのような関数を実装しておくと,先ほどのハミルトニアンの非対角成分は

x_array = [] y_array = [] val_array = [] for i in range(N-1): x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sx, i, Sx, i+1, Jx, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new) x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sy, i, Sy, i+1, Jy, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new) x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sx, N-1, Sx, 0, Jx, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new) x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sy, N-1, Sy, 0, Jy, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new)の様になります.(この実装の場合もx_arrayは$[0, 1, \cdots, 2^N-1]$ =range(2**N)となりますが,y_arrayだけ書くのは教育的ではない気がしたので書いておきます.)

ただ,非対角成分は項が多いため,出来るだけ数を減らしたいです.

ここで注目するのは,$S^x_i S^x_j$と$S^y_i S^y_j$(と,$S^x_i S^y_j$や$S^y_i S^x_j$)が指す非零成分の場所は全く同じということです.(同様に,$S^z_i S^x_j$と$S^z_i S^y_j$も非零成分の場所が同じになります.非零成分を求めるアルゴリズムを見ると自明です.)なので,まとめてしまいましょう.def set_Hamiltonian_offdiag(O1_1, O2_1, index1, O1_2, O2_2, index2, J1, J2, N): x_array = [0] y_array = [0] val1_array = [J1] val2_array = [J2] for i in range(N-1, -1, -1): x_array_new = [None]*(len(x_array)*2) y_array_new = [None]*(len(y_array)*2) val1_array_new = [None]*(len(val1_array)*2) val2_array_new = [None]*(len(val2_array)*2) if(i==index1): x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y+1 for y in y_array] val1_array_new[::2] = [val*O1_1[0][1] for val in val1_array] val2_array_new[::2] = [val*O2_1[0][1] for val in val2_array] x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y for y in y_array] val1_array_new[1::2] = [val*O1_1[1][0] for val in val1_array] val2_array_new[1::2] = [val*O2_1[1][0] for val in val2_array] elif(i==index2): x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y+1 for y in y_array] val1_array_new[::2] = [val*O1_2[0][1] for val in val1_array] val2_array_new[::2] = [val*O2_2[0][1] for val in val2_array] x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y for y in y_array] val1_array_new[1::2] = [val*O1_2[1][0] for val in val1_array] val2_array_new[1::2] = [val*O2_2[1][0] for val in val2_array] else: x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y for y in y_array] val1_array_new[::2] = val1_array val2_array_new[::2] = val2_array x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y+1 for y in y_array] val1_array_new[1::2] = val1_array val2_array_new[1::2] = val2_array x_array = x_array_new y_array = y_array_new val1_array = val1_array_new val2_array = val2_array_new return x_array, y_array, np.array(val1_array) + np.array(val2_array)このように,先ほどの$S^xS^x$と$S^yS^y$に関するset_Hamiltonian_offdiag関数を一つにまとめると,先ほどのハミルトニアンの非対角成分は

x_array = [] y_array = [] val_array = [] for i in range(N-1): x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sx, Sy, i, Sx, Sy, i+1, Jx, Jy, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new) x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sx, Sy, N-1, Sx, Sy, 0, Jx, Jy, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new)の様になります.

このようにして非対角成分を求めると,先ほどよりも必要な配列サイズが半分になります.最終的なpythonコード

先ほどまでの事例をまとめると,次の様なコードになります.

import numpy as np from scipy.sparse import csr_matrix from scipy.sparse.linalg import eigsh Sx = np.array(([0, 1], [1, 0]), dtype=np.complex128) Sy = np.array(([0, -1j], [1j, 0]), dtype=np.complex128) Sz = np.array(([1, 0], [0, -1]), dtype=np.complex128) def set_Hamiltonian_diag(O1, index1, O2, index2, J, N): val_array = [J] for i in range(N-1, -1, -1): val_array_new = [None]*(len(val_array)*2) if(i==index1): val_array_new[::2] = [val*O1[0][0] for val in val_array] val_array_new[1::2] = [val*O1[1][1] for val in val_array] elif(i==index2): val_array_new[::2] = [val*O2[0][0] for val in val_array] val_array_new[1::2] = [val*O2[1][1] for val in val_array] else: val_array_new[::2] = val_array val_array_new[1::2] = val_array val_array = val_array_new return np.array(val_array) def set_Hamiltonian_offdiag(O1_1, O2_1, index1, O1_2, O2_2, index2, J1, J2, N): x_array = [0] y_array = [0] val1_array = [J1] val2_array = [J2] for i in range(N-1, -1, -1): x_array_new = [None]*(len(x_array)*2) y_array_new = [None]*(len(y_array)*2) val1_array_new = [None]*(len(val1_array)*2) val2_array_new = [None]*(len(val2_array)*2) if(i==index1): x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y+1 for y in y_array] val1_array_new[::2] = [val*O1_1[0][1] for val in val1_array] val2_array_new[::2] = [val*O2_1[0][1] for val in val2_array] x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y for y in y_array] val1_array_new[1::2] = [val*O1_1[1][0] for val in val1_array] val2_array_new[1::2] = [val*O2_1[1][0] for val in val2_array] elif(i==index2): x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y+1 for y in y_array] val1_array_new[::2] = [val*O1_2[0][1] for val in val1_array] val2_array_new[::2] = [val*O2_2[0][1] for val in val2_array] x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y for y in y_array] val1_array_new[1::2] = [val*O1_2[1][0] for val in val1_array] val2_array_new[1::2] = [val*O2_2[1][0] for val in val2_array] else: x_array_new[::2] = [2*x for x in x_array] y_array_new[::2] = [2*y for y in y_array] val1_array_new[::2] = val1_array val2_array_new[::2] = val2_array x_array_new[1::2] = [2*x+1 for x in x_array] y_array_new[1::2] = [2*y+1 for y in y_array] val1_array_new[1::2] = val1_array val2_array_new[1::2] = val2_array x_array = x_array_new y_array = y_array_new val1_array = val1_array_new val2_array = val2_array_new return x_array, y_array, np.array(val1_array) + np.array(val2_array) if __name__ == "__main__": N = 16 Jx = 1.0 Jy = 1.0 Jz = 1.0 hamiltonian_diag = np.zeros((2**N), dtype=np.complex128) x_array = [] y_array = [] val_array = [] for i in range(N-1): x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sx, Sy, i, Sx, Sy, i+1, Jx, Jy, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new) hamiltonian_diag += set_Hamiltonian_diag(Sz, i, Sz, i+1, Jz, N) x_array_new, y_array_new, val_array_new = set_Hamiltonian_offdiag(Sx, Sy, N-1, Sx, Sy, 0, Jx, Jy, N) x_array.extend(x_array_new) y_array.extend(y_array_new) val_array.extend(val_array_new) hamiltonian_diag += set_Hamiltonian_diag(Sz, N-1, Sz, 0, Jz, N) x_array.extend(range(2**N)) y_array.extend(range(2**N)) val_array.extend(hamiltonian_diag) hamiltonian = csr_matrix((val_array, (x_array, y_array)), shape=(2**N, 2**N)) hamiltonian = hamiltonian.astype(np.float64) eigs, eigvecs = eigsh(hamiltonian, which='SA') print(min(eigs)/N)(最後に1スピン当たりの基底エネルギーを出力しています)

N=16の1次元ハイゼンベルグ模型の基底状態計算が手元のノートPCで5~6秒ほどで実行できます.

N=20にすると2~3分ぐらいでした.

このくらいなら「ちょっと遊ぶ」のに十分ではないでしょうか.周期境界条件(PBC)と開放境界条件(OBC)で計算した基底エネルギー$e_{calc}$をN無限大極限での厳密解($e_{exact} = 1-4\log2 = -1.772589...$)(このサイトなどを参照)と比較した結果が次です.

N $e_calc$ (PBC) $e_calc$ (OBC) 4 -2.000000 -1.616025 6 -1.868517 -1.662385 8 -1.825547 -1.687466 10 -1.806179 -1.703214 12 -1.795797 -1.714030 14 -1.789586 -1.721921 16 -1.785574 -1.727934 18 -1.782833 -1.732669 20 -1.780877 -1.736495 PBCの結果が先ほどのサイトの結果と一致しているのでアルゴリズムは多分大丈夫ですけど,OBCの結果がちょっと不安ですね......

フェルミオン系やボゾン系の場合

フェルミオン系やボゾン系は全くの専門外なので,コメントだけにしておきます.

フェルミオン系の場合

スピン系は各サイトにつきスピンが上向き,スピンが下向きの2状態でしたが,フェルミオン系の場合は各サイトにつき(上向きスピンの粒子数,下向きスピンの粒子数)= (0, 0), (0, 1), (1, 0), (1, 1) の4通りとなります.

もしくは,(サイトindex, スピンの上下)を((サイト+スピンindex), 粒子の有無)にとして計算することもできます.(やってることは同じです)

なので,それ用にコードを書き換えるだけです.

特に,後者の場合は生成消滅演算子$c^{\dagger}, c$がc^{\dagger} = \begin{pmatrix} 0 & 1 \\ 0 & 0 \end{pmatrix} ~ , ~ c = \begin{pmatrix} 0 & 0 \\ 1 & 0 \end{pmatrix}と書けるので,ある程度先ほどのコードを使い回せます.

また,全粒子数と同時対角化可能(可換)な場合は,ターゲットとする全粒子数に関連する成分のみ取り出すことで,行列サイズを小さくすることができます.

(上向きスピンの粒子数,下向きスピンの粒子数それぞれと可換,というケースもよくあります.)何か可換な物理量がある場合に行列サイズを小さくして対角化する手法はスピン系でも使えます.

ボゾン系の場合

全粒子数が保存する場合は,サイトとスピンindexを固定すると粒子数は0以上全粒子数以下の全粒子数+1通りなので,頑張れば計算できます.

全粒子数が保存しない場合は,サイトとスピンindexを固定した時の粒子数の最大値を決めて計算し,その最大値を徐々に大きくして外挿する,という方法があるみたいです.(全粒子数が保存する場合も使えます)juliaのコード

最後のpythonコードのjulia版です.

versionは1.5.2です.using Arpack using SparseArrays function set_Hamiltonian_diag(O1, index1, O2, index2, J, N) val_array = [J] for i=1:N val_array_new = zeros(Complex, length(val_array)*2) if N+1-i==index1 val_array_new[1:2:length(val_array_new)] = [val*O1[1][1] for val in val_array] val_array_new[2:2:length(val_array_new)] = [val*O1[2][2] for val in val_array] elseif N+1-i==index2 val_array_new[1:2:length(val_array_new)] = [val*O2[1][1] for val in val_array] val_array_new[2:2:length(val_array_new)] = [val*O2[2][2] for val in val_array] else val_array_new[1:2:length(val_array_new)] = val_array val_array_new[2:2:length(val_array_new)] = val_array end val_array = val_array_new end return val_array end function set_Hamiltonian_offdiag(O1_1, O2_1, index1, O1_2, O2_2, index2, J1, J2, N) x_array = [1] y_array = [1] val1_array = [complex(J1)] val2_array = [complex(J2)] for i=1:N x_array_new = zeros(length(x_array)*2) y_array_new = zeros(length(y_array)*2) val1_array_new = zeros(Complex, length(val1_array)*2) val2_array_new = zeros(Complex, length(val2_array)*2) if N+1-i==index1 x_array_new[1:2:length(x_array_new)] = [2*x-1 for x in x_array] y_array_new[1:2:length(y_array_new)] = [2*y for y in y_array] val1_array_new[1:2:length(val1_array_new)] = [val*O1_1[1][2] for val in val1_array] val2_array_new[1:2:length(val2_array_new)] = [val*O2_1[1][2] for val in val2_array] x_array_new[2:2:length(x_array_new)] = [2*x for x in x_array] y_array_new[2:2:length(y_array_new)] = [2*y-1 for y in y_array] val1_array_new[2:2:length(val1_array_new)] = [val*O1_1[2][1] for val in val1_array] val2_array_new[2:2:length(val2_array_new)] = [val*O2_1[2][1] for val in val2_array] elseif N+1-i==index2 x_array_new[1:2:length(x_array_new)] = [2*x-1 for x in x_array] y_array_new[1:2:length(y_array_new)] = [2*y for y in y_array] val1_array_new[1:2:length(val1_array_new)] = [val*O1_2[1][2] for val in val1_array] val2_array_new[1:2:length(val2_array_new)] = [val*O2_2[1][2] for val in val2_array] x_array_new[2:2:length(x_array_new)] = [2*x for x in x_array] y_array_new[2:2:length(y_array_new)] = [2*y-1 for y in y_array] val1_array_new[2:2:length(val1_array_new)] = [val*O1_2[2][1] for val in val1_array] val2_array_new[2:2:length(val2_array_new)] = [val*O2_2[2][1] for val in val2_array] else x_array_new[1:2:length(x_array_new)] = [2*x-1 for x in x_array] y_array_new[1:2:length(y_array_new)] = [2*y-1 for y in y_array] val1_array_new[1:2:length(val1_array_new)] = val1_array val2_array_new[1:2:length(val2_array_new)] = val2_array x_array_new[2:2:length(x_array_new)] = [2*x for x in x_array] y_array_new[2:2:length(y_array_new)] = [2*y for y in y_array] val1_array_new[2:2:length(val1_array_new)] = val1_array val2_array_new[2:2:length(val2_array_new)] = val2_array end x_array = x_array_new y_array = y_array_new val1_array = val1_array_new val2_array = val2_array_new end return x_array, y_array, val1_array+val2_array end function main() Sx = [[0, 1], [1, 0]] Sy = [[0, complex(0, -1)], [complex(0, 1), 0]] Sz = [[1, 0], [0, -1]] N = 16 Jx = complex(1.0, 0.0) Jy = complex(1.0, 0.0) Jz = complex(1.0, 0.0) hamiltonian_diag = zeros(Complex, (2^N)) arrays = [zeros(Int, 0), zeros(Int, 0), zeros(Complex, 0)] for i=1:N-1 arrays_new = set_Hamiltonian_offdiag(Sx, Sy, i, Sx, Sy, i+1, Jx, Jy, N) append!(arrays[1], arrays_new[1]) append!(arrays[2], arrays_new[2]) append!(arrays[3], arrays_new[3]) hamiltonian_diag += set_Hamiltonian_diag(Sz, i, Sz, i+1, Jz, N) end arrays_new = set_Hamiltonian_offdiag(Sx, Sy, N, Sx, Sy, 1, Jx, Jy, N) append!(arrays[1], arrays_new[1]) append!(arrays[2], arrays_new[2]) append!(arrays[3], arrays_new[3]) hamiltonian_diag += set_Hamiltonian_diag(Sz, N, Sz, 1, Jz, N) append!(arrays[1], [n for n in 1:2^N]) append!(arrays[2], [n for n in 1:2^N]) append!(arrays[3], hamiltonian_diag) arrays[3] = real(arrays[3]) hamiltonian = sparse(arrays[1], arrays[2], arrays[3]) eigvals = eigs(hamiltonian, which=:SR)[1] println(minimum(eigvals)/N) end main()juliaの場合はpythonの時とは異なりeigsを使って固有値を求めていますが,juliaのArpackのeigsはLinearAlgebraのissymmetric(hamiltonian)がtrueの場合は勝手にeigsh相当のアルゴリズムになります.(そもそもeigshが実装されていないです)

配列の添字が1始まりなことと,配列のslicingの方法に注意しましょう.

- 投稿日:2020-12-12T20:54:49+09:00

Pythonの型(クラス)システム

Pythonの型(クラス)を扱う機能に関して調べてみて,面白かったので記事を投稿します.

● Pythonの型(クラス)システム(PDF形式3ページ:395KB)

(Pythonのテキストからの抜粋です)Pythonのオブジェクト指向プログラミング関連の機能はしっかりできているので,管理機能の全体とクラス階層を一度眺めてみる価値があると思います.

あらゆる型(クラス)が「objectクラス」を頂点として整然と構成されている様子が面白いです.● クラス階層を出力するサンプルプログラム:getSubclasses.py

- 投稿日:2020-12-12T20:03:53+09:00

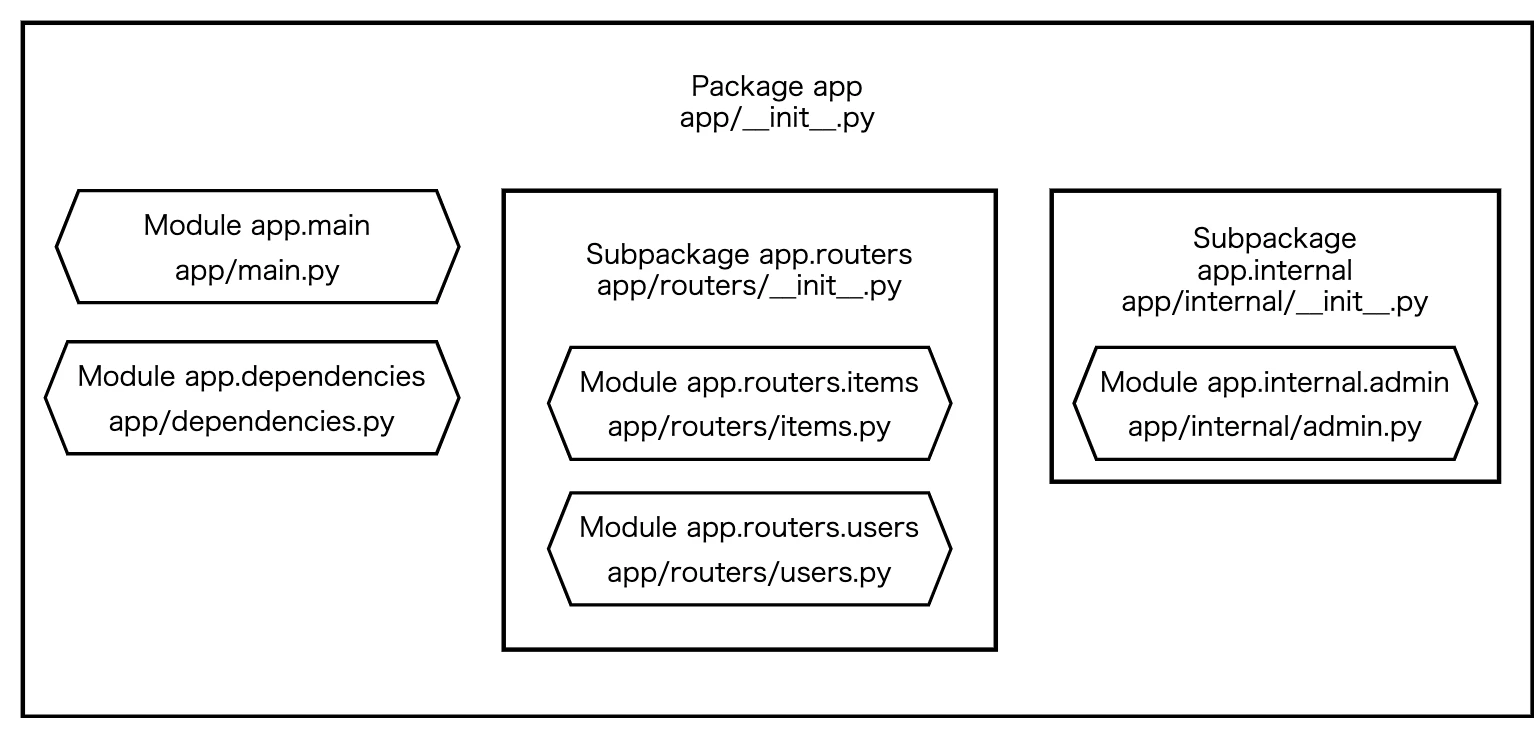

FastAPI勉強メモ

参考資料

FastAPIは?

FastAPI framework, high performance, easy to learn, fast to code, ready for production

- 特徴

- typeの定義でrequest内容を自動bindingできる

- type hintで静的チェックできるので、バグになりにくい

- 簡単

- ハイパフォーマンス

- OAuth2

- OpenAPI docs自動作成

- GraphQLサポート

- ドキュメントが充実

開発環境の構築

libraryインストール

- virtualenv is a tool for creating isolated virtual python environments.