- 投稿日:2020-12-06T23:02:26+09:00

数々の苦難を乗り越えTorch for R with CUDA on Dockerを完成させたというお話

この記事はFujitsu Advent Calendar 2020 6日目の記事です。

Deep Learningと言えばPythonの独壇場というイメージがずっと有りましたが,ここに来てR言語でもDeep Learningのモデルを構築,学習,推論が出来る様になったということを知りました。早速RStdio環境をNVIDIA Dockerを用いて構築し,「Torch for R1」を試してみたいと思います。しかし,それは思いの他難儀なことになろうとは当初思っていませんでした。。。

tokyor/rstudioイメージファイルをベースにコンテナを構築

当初以下のDockerfile(tokyor/rstudio)とdocker-compose.ymlを用いて試しました。GPUを利用出来るNVIDIA Docker2に対応出来れば完成すると考えたからです。しかし,筆者の考えは甘かったことがすぐに証明されます。

tokyor/rstudioのイメージファイルをベースに作成したDockerfileFROM tokyor/rstudio RUN apt update && apt upgrade -y RUN apt install -y vim wget curl gitdocker-compose.ymlversion: "2.4" services: rstudio_docker: build: context: . dockerfile: Dockerfile runtime: nvidia environment: - NVIDIA_VISIBLE_DEVICES=all - NVIDIA_DRIVER_CAPABILITIES=all ports: - 8787:8787 volumes:構築したコンテナにTorch for Rをインストールしてみます。

install.packages("torch")

実行結果

> install.packages("torch") Installing package into ‘/usr/local/lib/R/site-library’ (as ‘lib’ is unspecified) trying URL 'https://cran.rstudio.com/src/contrib/torch_0.1.1.tar.gz' Content type 'application/x-gzip' length 5014778 bytes (4.8 MB) ================================================== downloaded 4.8 MB * installing *source* package ‘torch’ ... ** package ‘torch’ successfully unpacked and MD5 sums checked ** libs g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c RcppExports.cpp -o RcppExports.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c autograd.cpp -o autograd.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c contrib.cpp -o contrib.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c cuda.cpp -o cuda.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c device.cpp -o device.o In file included from device.cpp:2:0: torch_types.h:7:0: warning: "LANTERN_HOST_HANDLER" redefined #define LANTERN_HOST_HANDLER lantern_host_handler(); In file included from device.cpp:1:0: lantern/lantern.h:35:0: note: this is the location of the previous definition #define LANTERN_HOST_HANDLER In file included from device.cpp:1:0: lantern/lantern.h: In function ‘bool lanternInit(const string&, std::__cxx11::string*)’: lantern/lantern.h:4097:6: note: variable tracking size limit exceeded with -fvar-tracking-assignments, retrying without bool lanternInit(const std::string &libPath, std::string *pError) ^~~~~~~~~~~ g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c dimname_list.cpp -o dimname_list.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c dtype.cpp -o dtype.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c gen-namespace.cpp -o gen-namespace.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c generator.cpp -o generator.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c indexing.cpp -o indexing.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c lantern.cpp -o lantern.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c layout.cpp -o layout.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c memory_format.cpp -o memory_format.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c nn_utils_rnn.cpp -o nn_utils_rnn.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c qscheme.cpp -o qscheme.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c quantization.cpp -o quantization.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c reduction.cpp -o reduction.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c save.cpp -o save.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c scalar.cpp -o scalar.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c storage.cpp -o storage.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c tensor.cpp -o tensor.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c tensor_list.cpp -o tensor_list.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c tensor_options.cpp -o tensor_options.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c utils.cpp -o utils.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c variable_list.cpp -o variable_list.o g++ -std=gnu++11 -shared -L/usr/local/lib/R/lib -L/usr/local/lib -o torch.so RcppExports.o autograd.o contrib.o cuda.o device.o dimname_list.o dtype.o gen-namespace.o generator.o indexing.o lantern.o layout.o memory_format.o nn_utils_rnn.o qscheme.o quantization.o reduction.o save.o scalar.o storage.o tensor.o tensor_list.o tensor_options.o utils.o variable_list.o -L/usr/local/lib/R/lib -lR Renaming torch lib to torchpkg "/usr/local/lib/R/bin/Rscript" "../tools/renamelib.R" installing to /usr/local/lib/R/site-library/torch/libs ** R ** inst ** preparing package for lazy loading Error : 'pairlist2' is not an exported object from 'namespace:rlang' Error : unable to load R code in package ‘torch’ ERROR: lazy loading failed for package ‘torch’ * removing ‘/usr/local/lib/R/site-library/torch’ Warning in install.packages : installation of package ‘torch’ had non-zero exit status The downloaded source packages are in ‘/tmp/Rtmpvhb8H5/downloaded_packages’ >上記のコマンドではエラーに阻まれてインストール出来ませんでしたので,ドキュメントでダメだった場合はこれと書いてあったコマンドでインストールを試みました。

remotes::install_github("mlverse/torch")

実行結果

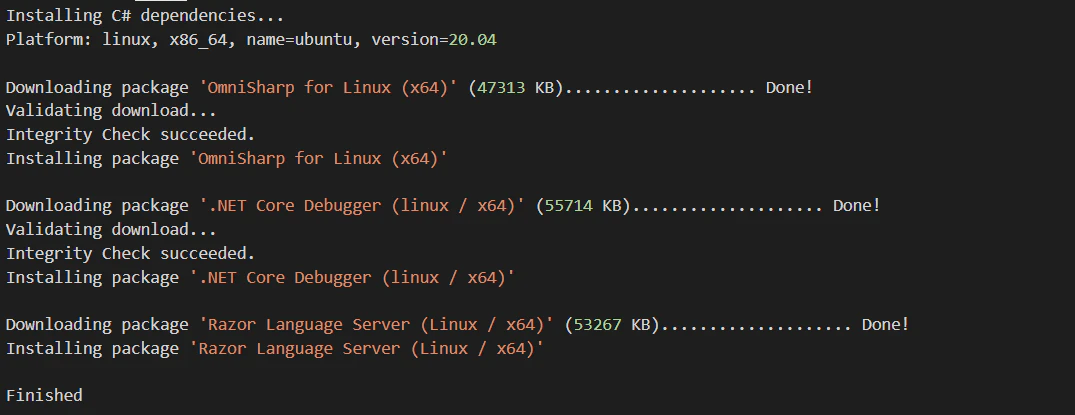

> remotes::install_github("mlverse/torch") Downloading GitHub repo mlverse/torch@master Installing 6 packages: bit, bit64, R6, Rcpp, rlang, withr Installing packages into ‘/usr/local/lib/R/site-library’ (as ‘lib’ is unspecified) trying URL 'https://cran.rstudio.com/src/contrib/bit_4.0.4.tar.gz' Content type 'application/x-gzip' length 279723 bytes (273 KB) ================================================== downloaded 273 KB trying URL 'https://cran.rstudio.com/src/contrib/bit64_4.0.5.tar.gz' Content type 'application/x-gzip' length 135091 bytes (131 KB) ================================================== downloaded 131 KB trying URL 'https://cran.rstudio.com/src/contrib/R6_2.5.0.tar.gz' Content type 'application/x-gzip' length 63361 bytes (61 KB) ================================================== downloaded 61 KB trying URL 'https://cran.rstudio.com/src/contrib/Rcpp_1.0.5.tar.gz' Content type 'application/x-gzip' length 2950521 bytes (2.8 MB) ================================================== downloaded 2.8 MB trying URL 'https://cran.rstudio.com/src/contrib/rlang_0.4.8.tar.gz' Content type 'application/x-gzip' length 847517 bytes (827 KB) ================================================== downloaded 827 KB trying URL 'https://cran.rstudio.com/src/contrib/withr_2.3.0.tar.gz' Content type 'application/x-gzip' length 91443 bytes (89 KB) ================================================== downloaded 89 KB * installing *source* package ‘bit’ ... ** package ‘bit’ successfully unpacked and MD5 sums checked ** libs gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c attrutil.c -o attrutil.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c bit.c -o bit.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c chunkutil.c -o chunkutil.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c clone.c -o clone.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c init.c -o init.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c integerutil.c -o integerutil.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c merge.c -o merge.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c rle.c -o rle.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c sort.c -o sort.o gcc -shared -L/usr/local/lib/R/lib -L/usr/local/lib -o bit.so attrutil.o bit.o chunkutil.o clone.o init.o integerutil.o merge.o rle.o sort.o -L/usr/local/lib/R/lib -lR installing to /usr/local/lib/R/site-library/bit/libs ** R ** inst ** byte-compile and prepare package for lazy loading ** help *** installing help indices ** building package indices ** installing vignettes ** testing if installed package can be loaded * DONE (bit) * installing *source* package ‘R6’ ... ** package ‘R6’ successfully unpacked and MD5 sums checked ** R ** preparing package for lazy loading ** help *** installing help indices *** copying figures ** building package indices ** testing if installed package can be loaded * DONE (R6) * installing *source* package ‘Rcpp’ ... ** package ‘Rcpp’ successfully unpacked and MD5 sums checked ** libs g++ -I/usr/local/lib/R/include -DNDEBUG -I../inst/include/ -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c api.cpp -o api.o g++ -I/usr/local/lib/R/include -DNDEBUG -I../inst/include/ -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c attributes.cpp -o attributes.o g++ -I/usr/local/lib/R/include -DNDEBUG -I../inst/include/ -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c barrier.cpp -o barrier.o g++ -I/usr/local/lib/R/include -DNDEBUG -I../inst/include/ -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c date.cpp -o date.o g++ -I/usr/local/lib/R/include -DNDEBUG -I../inst/include/ -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c module.cpp -o module.o g++ -I/usr/local/lib/R/include -DNDEBUG -I../inst/include/ -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c rcpp_init.cpp -o rcpp_init.o g++ -shared -L/usr/local/lib/R/lib -L/usr/local/lib -o Rcpp.so api.o attributes.o barrier.o date.o module.o rcpp_init.o -L/usr/local/lib/R/lib -lR installing to /usr/local/lib/R/site-library/Rcpp/libs ** R ** inst ** preparing package for lazy loading ** help *** installing help indices ** building package indices ** installing vignettes ** testing if installed package can be loaded * DONE (Rcpp) * installing *source* package ‘rlang’ ... ** package ‘rlang’ successfully unpacked and MD5 sums checked ** libs gcc -I/usr/local/lib/R/include -DNDEBUG -I./lib/ -I/usr/local/include -fvisibility=hidden -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c capture.c -o capture.o gcc -I/usr/local/lib/R/include -DNDEBUG -I./lib/ -I/usr/local/include -fvisibility=hidden -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c export.c -o export.o gcc -I/usr/local/lib/R/include -DNDEBUG -I./lib/ -I/usr/local/include -fvisibility=hidden -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c internal.c -o internal.o gcc -I/usr/local/lib/R/include -DNDEBUG -I./lib/ -I/usr/local/include -fvisibility=hidden -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c lib.c -o lib.o gcc -I/usr/local/lib/R/include -DNDEBUG -I./lib/ -I/usr/local/include -fvisibility=hidden -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c version.c -o version.o gcc -shared -L/usr/local/lib/R/lib -L/usr/local/lib -o rlang.so capture.o export.o internal.o lib.o version.o -L/usr/local/lib/R/lib -lR installing to /usr/local/lib/R/site-library/rlang/libs ** R ** inst ** byte-compile and prepare package for lazy loading ** help *** installing help indices *** copying figures ** building package indices ** testing if installed package can be loaded * DONE (rlang) * installing *source* package ‘withr’ ... ** package ‘withr’ successfully unpacked and MD5 sums checked ** R ** inst ** preparing package for lazy loading ** help *** installing help indices *** copying figures ** building package indices ** installing vignettes ** testing if installed package can be loaded * DONE (withr) * installing *source* package ‘bit64’ ... ** package ‘bit64’ successfully unpacked and MD5 sums checked ** libs gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c bsearch.c -o bsearch.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c cache.c -o cache.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c hash64.c -o hash64.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c init.c -o init.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c integer64.c -o integer64.o integer64.c:270:1: warning: ‘no_sanitize’ attribute directive ignored [-Wattributes] __attribute__((no_sanitize("signed-integer-overflow"))) SEXP plus_integer64(SEXP e1_, SEXP e2_, SEXP ret_){ ^~~~~~~~~~~~~ integer64.c:285:1: warning: ‘no_sanitize’ attribute directive ignored [-Wattributes] __attribute__((no_sanitize("signed-integer-overflow"))) SEXP minus_integer64(SEXP e1_, SEXP e2_, SEXP ret_){ ^~~~~~~~~~~~~ integer64.c:300:1: warning: ‘no_sanitize’ attribute directive ignored [-Wattributes] __attribute__((no_sanitize("signed-integer-overflow"))) SEXP diff_integer64(SEXP x_, SEXP lag_, SEXP n_, SEXP ret_){ ^~~~~~~~~~~~~ integer64.c:347:1: warning: ‘no_sanitize’ attribute directive ignored [-Wattributes] __attribute__((no_sanitize("signed-integer-overflow"))) SEXP times_integer64_integer64(SEXP e1_, SEXP e2_, SEXP ret_){ ^~~~~~~~~~~~~ gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c sort64.c -o sort64.o gcc -I/usr/local/lib/R/include -DNDEBUG -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c sortuse64.c -o sortuse64.o gcc -shared -L/usr/local/lib/R/lib -L/usr/local/lib -o bit64.so bsearch.o cache.o hash64.o init.o integer64.o sort64.o sortuse64.o -lm -L/usr/local/lib/R/lib -lR installing to /usr/local/lib/R/site-library/bit64/libs ** R ** data ** exec ** inst ** byte-compile and prepare package for lazy loading ** help *** installing help indices ** building package indices ** testing if installed package can be loaded * DONE (bit64) The downloaded source packages are in ‘/tmp/Rtmpvhb8H5/downloaded_packages’ Installing package into ‘/usr/local/lib/R/site-library’ (as ‘lib’ is unspecified) * installing *source* package ‘torch’ ... ** libs g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c RcppExports.cpp -o RcppExports.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c autograd.cpp -o autograd.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c contrib.cpp -o contrib.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c cuda.cpp -o cuda.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c device.cpp -o device.o In file included from device.cpp:2:0: torch_types.h:7:0: warning: "LANTERN_HOST_HANDLER" redefined #define LANTERN_HOST_HANDLER lantern_host_handler(); In file included from device.cpp:1:0: lantern/lantern.h:35:0: note: this is the location of the previous definition #define LANTERN_HOST_HANDLER In file included from device.cpp:1:0: lantern/lantern.h: In function ‘bool lanternInit(const string&, std::__cxx11::string*)’: lantern/lantern.h:4949:6: note: variable tracking size limit exceeded with -fvar-tracking-assignments, retrying without bool lanternInit(const std::string &libPath, std::string *pError) ^~~~~~~~~~~ g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c dimname_list.cpp -o dimname_list.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c dtype.cpp -o dtype.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c gen-namespace.cpp -o gen-namespace.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c generator.cpp -o generator.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c indexing.cpp -o indexing.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c lantern.cpp -o lantern.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c layout.cpp -o layout.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c memory_format.cpp -o memory_format.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c nn_utils_rnn.cpp -o nn_utils_rnn.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c qscheme.cpp -o qscheme.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c quantization.cpp -o quantization.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c reduction.cpp -o reduction.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c save.cpp -o save.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c scalar.cpp -o scalar.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c storage.cpp -o storage.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c tensor.cpp -o tensor.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c tensor_list.cpp -o tensor_list.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c tensor_options.cpp -o tensor_options.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c utils.cpp -o utils.o g++ -std=gnu++11 -I/usr/local/lib/R/include -DNDEBUG -I"/usr/local/lib/R/site-library/Rcpp/include" -I/usr/local/include -fpic -g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g -c variable_list.cpp -o variable_list.o g++ -std=gnu++11 -shared -L/usr/local/lib/R/lib -L/usr/local/lib -o torch.so RcppExports.o autograd.o contrib.o cuda.o device.o dimname_list.o dtype.o gen-namespace.o generator.o indexing.o lantern.o layout.o memory_format.o nn_utils_rnn.o qscheme.o quantization.o reduction.o save.o scalar.o storage.o tensor.o tensor_list.o tensor_options.o utils.o variable_list.o -L/usr/local/lib/R/lib -lR Renaming torch lib to torchpkg "/usr/local/lib/R/bin/Rscript" "../tools/renamelib.R" installing to /usr/local/lib/R/site-library/torch/libs ** R ** preparing package for lazy loading ** help *** installing help indices *** copying figures ** building package indices ** installing vignettes ** testing if installed package can be loaded * DONE (torch) >インストールが無事完了しました。さて気を取り直してTorch for RでDeep Learningだと意気込んだ矢先に以下の警告が。。。最新のCUDA11.0には対応していないので,CUDA10.x,9.2のいずれかの環境で構築しないとGPUは動かないですよという内容。

> library("torch") Cuda 11.0 detected but torch only supports: cpu, 10.1, 10.2, 9.2 trying URL 'https://download.pytorch.org/libtorch/cpu/libtorch-cxx11-abi-shared-with-deps-1.7.0%2Bcpu.zip' Content type 'application/zip' length 165327275 bytes (157.7 MB) ================================================== downloaded 157.7 MB trying URL 'https://storage.googleapis.com/torch-lantern-builds/refs/heads/master/latest/Linux-cpu.zip' Content type 'application/zip' length 1531419 bytes (1.5 MB) ================================================== downloaded 1.5 MBCUDA10.xをインストールして再度チャレンジしようと思った矢先に以下の問題に突き当たります。。。

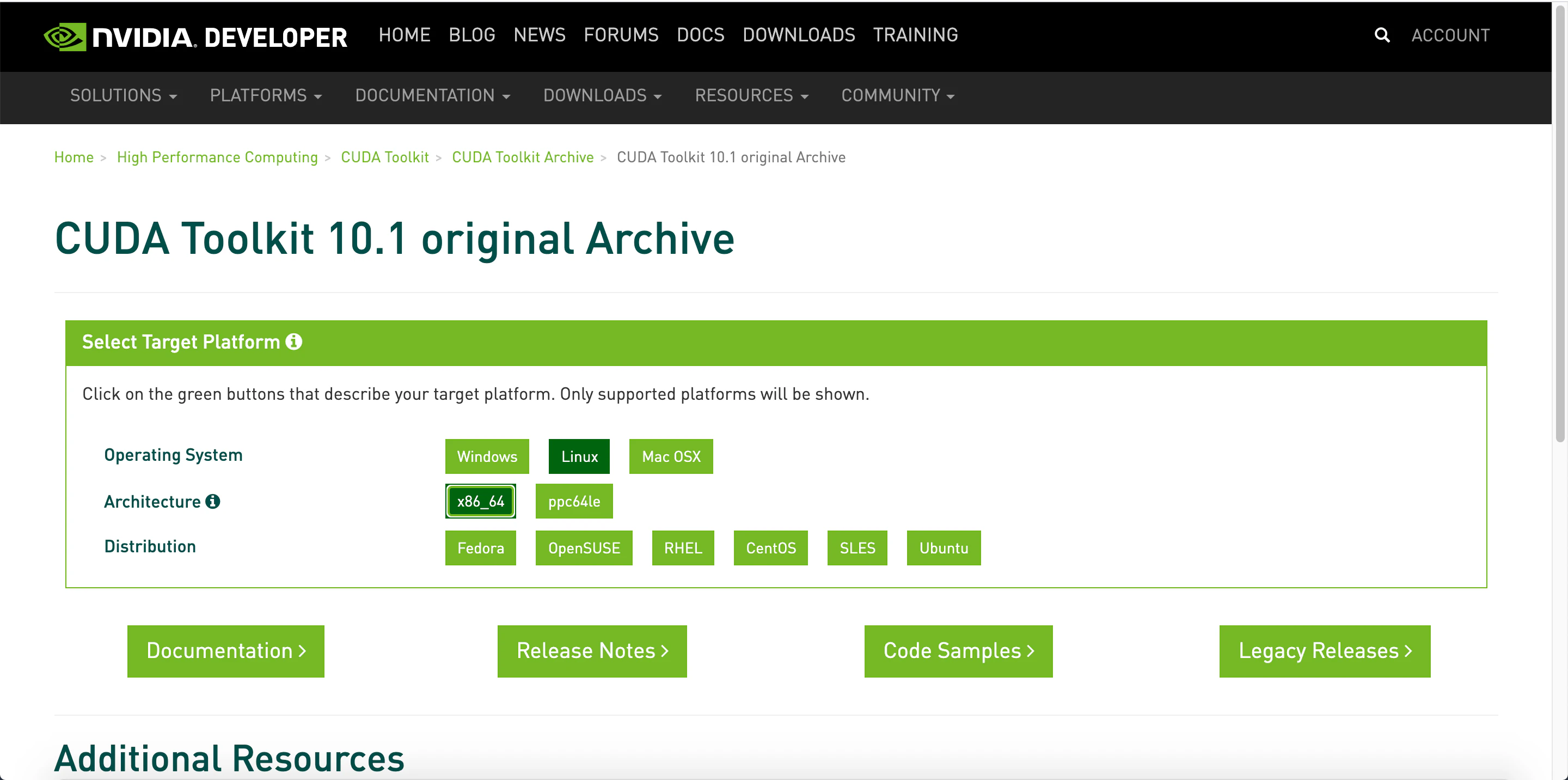

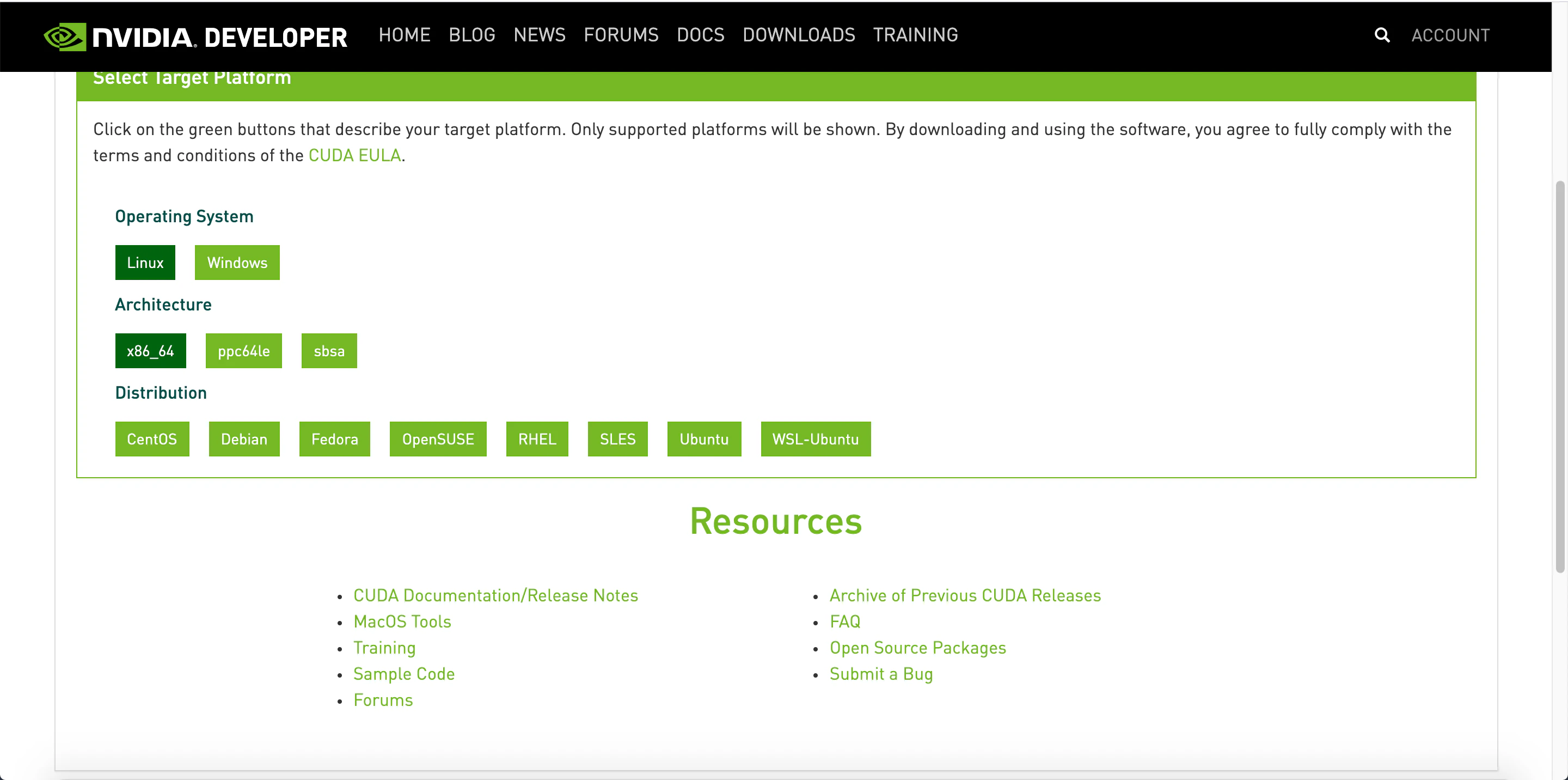

CUDA10.xはDebianでは動かない

CUDA10.xをインストールしようと思い,Ubuntu18.04におけるインストール方法を公式サイトから調べてDockerfileに反映しましたが,エラーで通りません。。。実はtokyor/rstudioのご先祖様のイメージはDebian2ベースとなっています。DebianにCUDA10.xをインストールしようとした所,対応していないことが分かりました。。。(詳細は下図)

CUDA11はDebianに対応しているが,Torch for Rが対応していない。。。

Ubuntu18ベースに新たなイメージをビルド

Ubuntu18.04で尚且つCUDA10.2がインストールされているイメージをベースにRStudioのコンテナイメージをビルドして,Torch for Rが利用出来るコンテナ環境を構築することにしました。実際に作成したDockerfileとdocker-compose.ymlを以下に示します。今回作成したDockerfileは以下のコンテナイメージファイルをベースに筆者が独自に改良して作成しました。イメージ4つ分の内容を1つのDockerfileに詰め込んだので長い長いソースとなってしまいました。。。

ベースとしたイメージ: nvidia/cuda:10.1-cudnn7-devel

参考としたイメージ

参考イメージを元に以下の改良を追加

- Ubuntuには非対応なので削除したライブラリ

- libicu63

- libjpeg62-turbo

- Ubuntu向けに追加したライブラリ

- libreadline-dev

- xorg-dev

- libbz2-dev

- liblzma-dev

- libpcre2-dev

- libcurl4-openssl-dev

- 記載を削除した処理

- autoremove/autoclean処理(∵ 何故かCUDA関連の実行ファイルまで消えてしまうため)

- torch/torch vision及びその他必用なライブラリのインストール

FROM nvidia/cuda:10.1-cudnn7-devel ARG ROOT_PASSWD ARG PASSWD # Set up R(Reference rocker/r-ver) ARG R_VERSION_FULL=4.0.2 ARG R_VERSION=4 ENV CRAN=${CRAN:-https://cran.rstudio.com} ENV LC_ALL=en_US.UTF-8 ENV LANG=en_US.UTF-8 ENV TERM=xterm ENV DEBIAN_FRONTEND=noninteractive RUN apt-get update && apt-get install -y --no-install-recommends bash-completion libbz2-dev \ ca-certificates file fonts-texgyre g++ gfortran gsfonts libblas-dev libbz2-1.0 libcurl4 \ libcurl4-openssl-dev libjpeg-dev liblzma-dev libopenblas-dev libpangocairo-1.0-0 libpcre2-dev \ libpcre3 libpng16-16 libreadline-dev libtiff5 liblzma5 locales make unzip wget xorg-dev zip zlib1g \ && BUILDDEPS="curl default-jdk libbz2-dev libcairo2-dev libcurl4-openssl-dev libpango1.0-dev libjpeg-dev \ libicu-dev libpcre3-dev libpng-dev libreadline-dev libtiff5-dev liblzma-dev libx11-dev libxt-dev perl \ tcl8.6-dev tk8.6-dev texinfo texlive-extra-utils texlive-fonts-recommended texlive-fonts-extra \ texlive-latex-recommended x11proto-core-dev xauth xfonts-base xvfb zlib1g-dev" \ && echo "en_US.UTF-8 UTF-8" >> /etc/locale.gen && locale-gen en_US.utf8 && /usr/sbin/update-locale LANG=en_US.UTF-8 \ && apt-get install -y --no-install-recommends $BUILDDEPS \ && cd tmp/ \ ## Download source code && wget https://cran.r-project.org/src/base/R-${R_VERSION}/R-${R_VERSION_FULL}.tar.gz \ ## Extract source code && tar -xf R-${R_VERSION_FULL}.tar.gz \ && cd R-${R_VERSION_FULL} \ ## Set compiler flags && R_PAPERSIZE=letter \ R_BATCHSAVE="--no-save --no-restore" R_BROWSER=xdg-open PAGER=/usr/bin/pager PERL=/usr/bin/perl R_UNZIPCMD=/usr/bin/unzip \ R_ZIPCMD=/usr/bin/zip R_PRINTCMD=/usr/bin/lpr LIBnn=lib AWK=/usr/bin/awk \ CFLAGS="-g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g" \ CXXFLAGS="-g -O2 -fstack-protector-strong -Wformat -Werror=format-security -Wdate-time -D_FORTIFY_SOURCE=2 -g" \ ## Configure options ./configure --enable-R-shlib --enable-memory-profiling --with-readline --with-blas --with-tcltk --disable-nls --with-recommended-packages \ ## Build and install && make \ && make install \ ## Add a library directory (for user-installed packages) && mkdir -p /usr/local/lib/R/site-library \ && chown root:staff /usr/local/lib/R/site-library \ && chmod g+ws /usr/local/lib/R/site-library \ ## Fix library path && sed -i '/^R_LIBS_USER=.*$/d' /usr/local/lib/R/etc/Renviron \ && echo "R_LIBS_USER=\${R_LIBS_USER-'/usr/local/lib/R/site-library'}" >> /usr/local/lib/R/etc/Renviron \ && echo "R_LIBS=\${R_LIBS-'/usr/local/lib/R/site-library:/usr/local/lib/R/library:/usr/lib/R/library'}" >> /usr/local/lib/R/etc/Renviron \ ## Set configured CRAN mirror && if [ -z "$BUILD_DATE" ]; then MRAN=$CRAN; \ else MRAN=https://mran.microsoft.com/snapshot/${BUILD_DATE}; fi \ && echo MRAN=$MRAN >> /etc/environment \ && echo "options(repos = c(CRAN='$MRAN'), download.file.method = 'libcurl')" >> /usr/local/lib/R/etc/Rprofile.site \ ## Use littler installation scripts && Rscript -e "install.packages(c('littler', 'docopt'), repo = '$CRAN')" \ && ln -s /usr/local/lib/R/site-library/littler/examples/install2.r /usr/local/bin/install2.r \ && ln -s /usr/local/lib/R/site-library/littler/examples/installGithub.r /usr/local/bin/installGithub.r \ && ln -s /usr/local/lib/R/site-library/littler/bin/r /usr/local/bin/r \ ## Clean up from R source install && cd / \ && rm -rf /tmp/* \ && rm -rf /var/lib/apt/lists/* # Set up RStudio(Reference rocker/rstudio) ARG RSTUDIO_VERSION ENV RSTUDIO_VERSION=${RSTUDIO_VERSION:-1.2.5042} ARG S6_VERSION ARG PANDOC_TEMPLATES_VERSION ENV S6_VERSION=${S6_VERSION:-v1.21.7.0} ENV S6_BEHAVIOUR_IF_STAGE2_FAILS=2 ENV PATH=/usr/lib/rstudio-server/bin:$PATH ENV PANDOC_TEMPLATES_VERSION=${PANDOC_TEMPLATES_VERSION:-2.9} ## Download and install RStudio server & dependencies ## Attempts to get detect latest version, otherwise falls back to version given in $VER ## Symlink pandoc, pandoc-citeproc so they are available system-wide RUN apt-get update && apt-get install -y --no-install-recommends git libapparmor1 libclang-dev libedit2 libssl-dev \ lsb-release multiarch-support psmisc procps python-setuptools sudo \ && if [ -z "$RSTUDIO_VERSION" ]; \ then RSTUDIO_URL="https://www.rstudio.org/download/latest/stable/server/bionic/rstudio-server-latest-amd64.deb"; \ else RSTUDIO_URL="http://download2.rstudio.org/server/bionic/amd64/rstudio-server-${RSTUDIO_VERSION}-amd64.deb"; fi \ && wget -q $RSTUDIO_URL \ && dpkg -i rstudio-server-*-amd64.deb \ && rm rstudio-server-*-amd64.deb \ ## Symlink pandoc & standard pandoc templates for use system-wide && ln -s /usr/lib/rstudio-server/bin/pandoc/pandoc /usr/local/bin \ && ln -s /usr/lib/rstudio-server/bin/pandoc/pandoc-citeproc /usr/local/bin \ && git clone --recursive --branch ${PANDOC_TEMPLATES_VERSION} https://github.com/jgm/pandoc-templates \ && mkdir -p /opt/pandoc/templates \ && cp -r pandoc-templates*/* /opt/pandoc/templates && rm -rf pandoc-templates* \ && mkdir /root/.pandoc && ln -s /opt/pandoc/templates /root/.pandoc/templates \ && apt-get clean \ && rm -rf /var/lib/apt/lists/ \ ## RStudio wants an /etc/R, will populate from $R_HOME/etc && mkdir -p /etc/R \ ## Write config files in $R_HOME/etc && echo '\n\ \n# Configure httr to perform out-of-band authentication if HTTR_LOCALHOST \ \n# is not set since a redirect to localhost may not work depending upon \ \n# where this Docker container is running. \ \nif(is.na(Sys.getenv("HTTR_LOCALHOST", unset=NA))) { \ \n options(httr_oob_default = TRUE) \ \n}' >> /usr/local/lib/R/etc/Rprofile.site \ && echo "PATH=${PATH}" >> /usr/local/lib/R/etc/Renviron \ ## Need to configure non-root user for RStudio && useradd rstudio \ && echo "rstudio:rstudio" | chpasswd \ && mkdir /home/rstudio \ && chown rstudio:rstudio /home/rstudio \ && addgroup rstudio staff \ ## Prevent rstudio from deciding to use /usr/bin/R if a user apt-get installs a package && echo 'rsession-which-r=/usr/local/bin/R' >> /etc/rstudio/rserver.conf \ ## use more robust file locking to avoid errors when using shared volumes: && echo 'lock-type=advisory' >> /etc/rstudio/file-locks \ ## configure git not to request password each time && git config --system credential.helper 'cache --timeout=3600' \ && git config --system push.default simple \ ## Set up S6 init system && wget -P /tmp/ https://github.com/just-containers/s6-overlay/releases/download/${S6_VERSION}/s6-overlay-amd64.tar.gz \ && tar xzf /tmp/s6-overlay-amd64.tar.gz -C / \ && mkdir -p /etc/services.d/rstudio \ && echo '#!/usr/bin/with-contenv bash \ \n## load /etc/environment vars first: \ \n for line in $( cat /etc/environment ) ; do export $line ; done \ \n exec /usr/lib/rstudio-server/bin/rserver --server-daemonize 0' \ > /etc/services.d/rstudio/run \ && echo '#!/bin/bash \ \n rstudio-server stop' \ > /etc/services.d/rstudio/finish \ && mkdir -p /home/rstudio/.rstudio/monitored/user-settings \ && echo 'alwaysSaveHistory="0" \ \nloadRData="0" \ \nsaveAction="0"' \ > /home/rstudio/.rstudio/monitored/user-settings/user-settings \ && chown -R rstudio:rstudio /home/rstudio/.rstudio RUN wget -P /etc/cont-init.d/ -O userconf https://github.com/rocker-org/rocker-versioned/blob/master/rstudio/userconf.sh ## running with "-e ADD=shiny" adds shiny server RUN wget -P /etc/cont-init.d/ -O add https://github.com/rocker-org/rocker-versioned/blob/master/rstudio/add_shiny.sh RUN wget -P /etc/rstudio/ https://github.com/rocker-org/rocker-versioned/blob/master/rstudio/disable_auth_rserver.conf RUN wget -P /usr/lib/rstudio-server/bin/ -O pam-helper https://github.com/rocker-org/rocker-versioned/blob/master/rstudio/pam-helper.sh EXPOSE 8787 ## automatically link a shared volume for kitematic users VOLUME /home/rstudio/kitematic # Install some requires(Reference rocker/tidyverse) RUN apt-get update -qq && apt-get -y --no-install-recommends install \ libxml2-dev libcairo2-dev libsqlite-dev libmariadbd-dev libmariadbclient-dev \ libpq-dev libssh2-1-dev unixodbc-dev libsasl2-dev \ && Rscript -e "install.packages(c('tidyverse', 'dplyr', 'devtools', 'formatR', \ 'remotes', 'selectr', 'caTools', 'BiocManager'))" # Set up localize(Reference tokyor/rstudio) # Change environment to Japanese(Character and DateTime) ENV LANG ja_JP.UTF-8 ENV LC_ALL ja_JP.UTF-8 RUN sed -i '$d' /etc/locale.gen && echo "ja_JP.UTF-8 UTF-8" >> /etc/locale.gen \ && locale-gen ja_JP.UTF-8 && /usr/sbin/update-locale LANG=ja_JP.UTF-8 LANGUAGE="ja_JP:ja" RUN /bin/bash -c "source /etc/default/locale" RUN ln -sf /usr/share/zoneinfo/Asia/Tokyo /etc/localtime # Install ipaexfont and some requires RUN apt-get update && apt-get install -y fonts-ipaexfont vim curl # Install packages RUN Rscript -e "install.packages(c('githubinstall', 'ranger'))" # Install torch for R RUN Rscript -e "install.packages('torch')" RUN Rscript -e "remotes::install_github('mlverse/torchvision')" RUN echo 'root:'${ROOT_PASSWD} | chpasswd RUN echo 'rstudio:'${PASSWD} | chpasswd RUN echo "rstudio ALL=(ALL:ALL) ALL" >> /etc/sudoers RUN gpasswd -a rstudio sudo CMD ["/init"]version: "2.4" services: rstudio_docker: build: context: . dockerfile: Dockerfile runtime: nvidia environment: - NVIDIA_VISIBLE_DEVICES=all - NVIDIA_DRIVER_CAPABILITIES=all ports: - 8787:8787 volumes: - ../rstudio_home:/home/rstudio restart: alwaysまた,コマンド入力が面倒くさいのでイメージビルド用に以下のシェルファイルも作成しました。rstudio/rstudioが認証情報だとGoogle Chromeの警告(パスワードの弱さに関する)が出るので変更することにします。

auth.txtというファイルを作成し,そこにパスワードを記載することで,コマンドの履歴にパスワードの内容が残らない様にしています。#!/bin/bash if [ "${1}" = "-nc" ]; then cat auth.txt | xargs -n 2 sh -c 'docker-compose build --no-cache --build-arg ROOT_PASSWD=$0 --build-arg PASSWD=$1' else cat auth.txt | xargs -n 2 sh -c 'docker-compose build --build-arg ROOT_PASSWD=$0 --build-arg PASSWD=$1' fiCUDAが有効にならない苦難の歴史

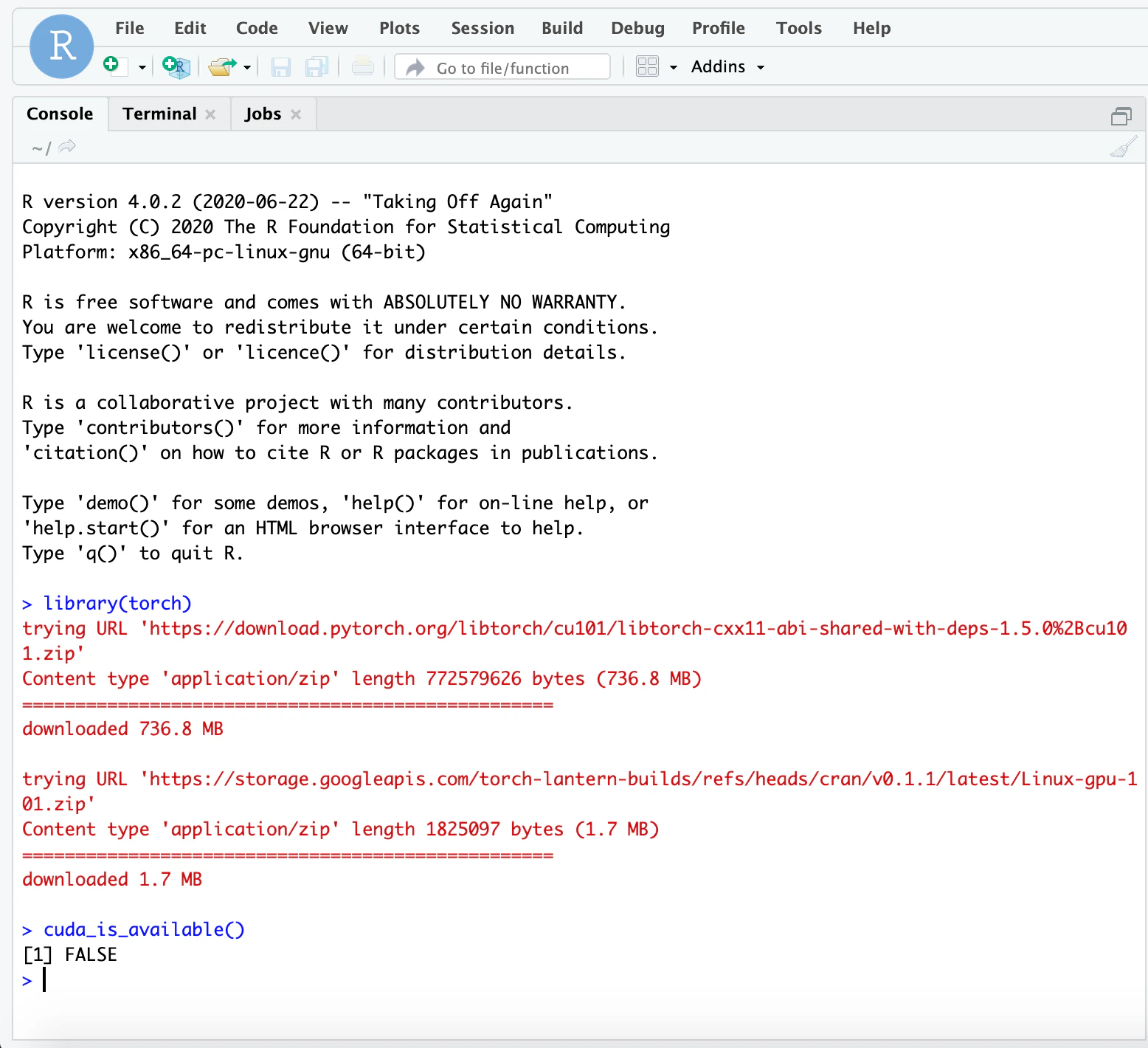

上記のDockerfileをビルドしてコンテナを起動すればいよいよGPU版のTorch for RをDocker上で利用出来る様になる筈でした。しかし,実際に待っていたのは,以下の図の様な状況です。。。

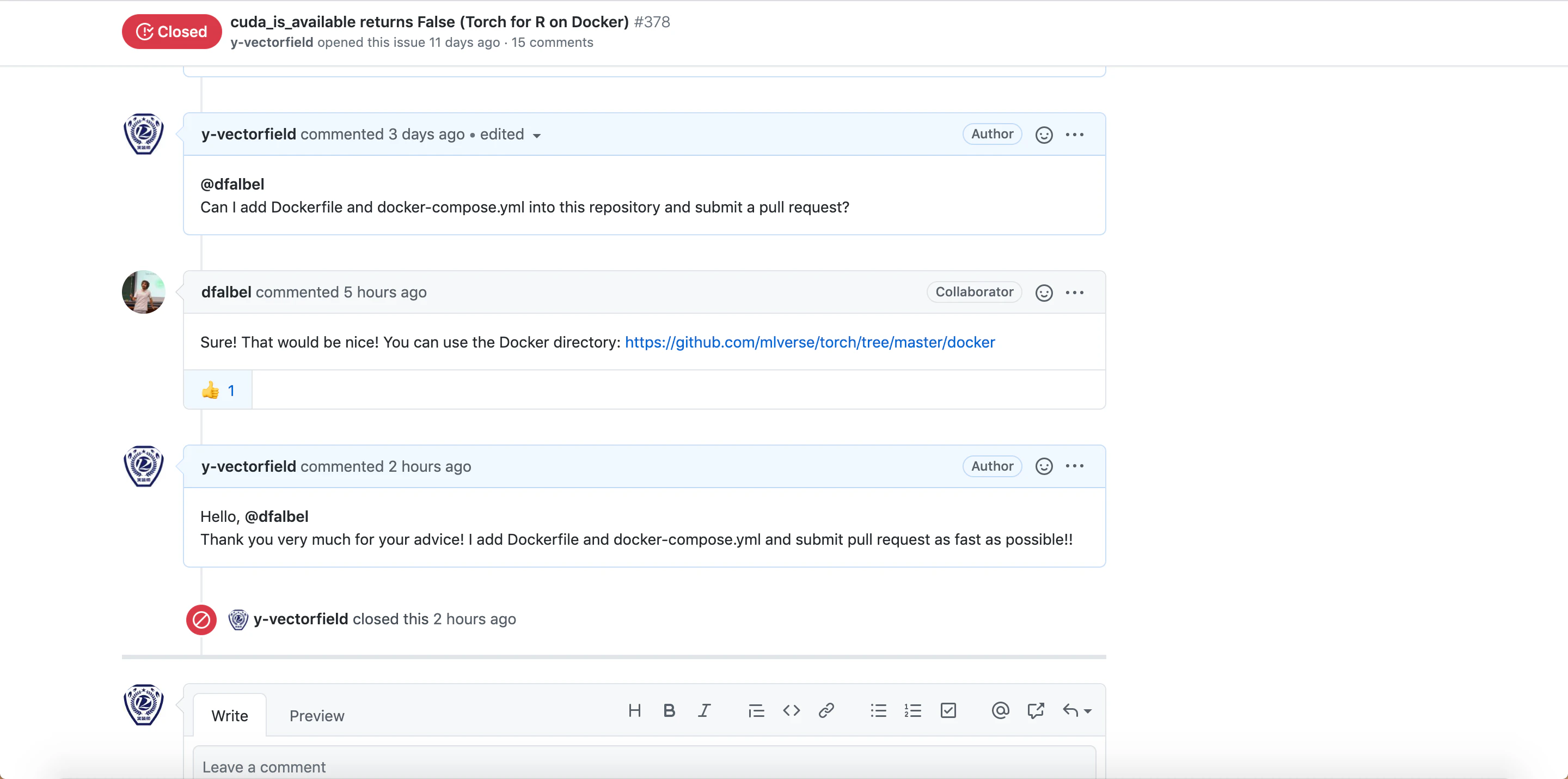

万事休す。。。一縷の望みを託すべくGitHubにIssueを上げてみました。詳細は以下を参照して下さい。(本家RStudio社のエンジニアとの議論になるとは夢にも思っていませんでした。RStudio社がブラジルの会社だったという事実を今回初めて知りました。)

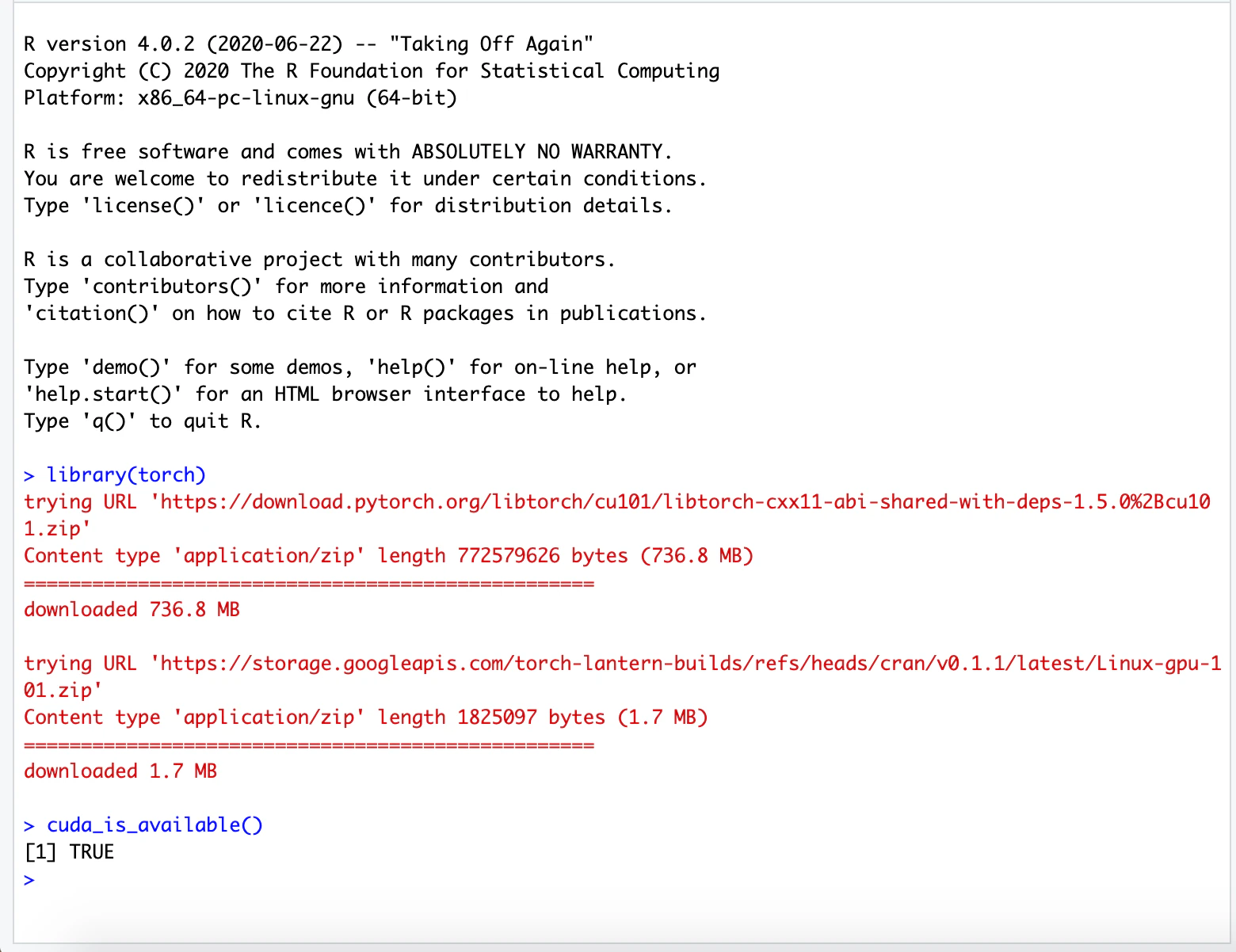

結局解決。。。しかし,その方法が。。。

Issueを見て頂くとお分かり頂けますが,結局

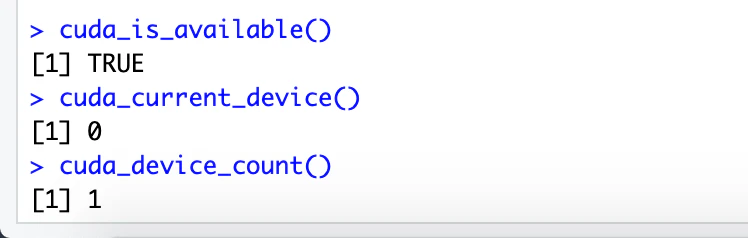

cuda_is_available() == FalseとなるトラブルはDockerfileをリビルド(厳密にはキャッシュされているコンテナイメージを使用しない)を実施すると解決しました。但し,キャッシュを用いずにリビルドする作業は何度も実施していましたが,解決に至っていなかったのが,ある日もう一度やってみようと思ってやってみたら解決したので,Docker Hubに上がっていたイメージファイルにバグが有ったか,キャッシュを使わないビルドをやっているつもりでキャッシュを使ってしまっていたのかもしれません。どっちにしてもキャッシュされていたコンテナイメージは壊れていたということはこのことから分かりました。以下の図の様にGPUのデバイス番号が得られている。Rはリストのインデックスは1から開始する仕様であることが知られていますが,CUDA DeviceのIDは0から開始するという奇妙な仕様です。

2020/12/7追記: 苦難の歴史が認められ本家のリポジトリに。。。

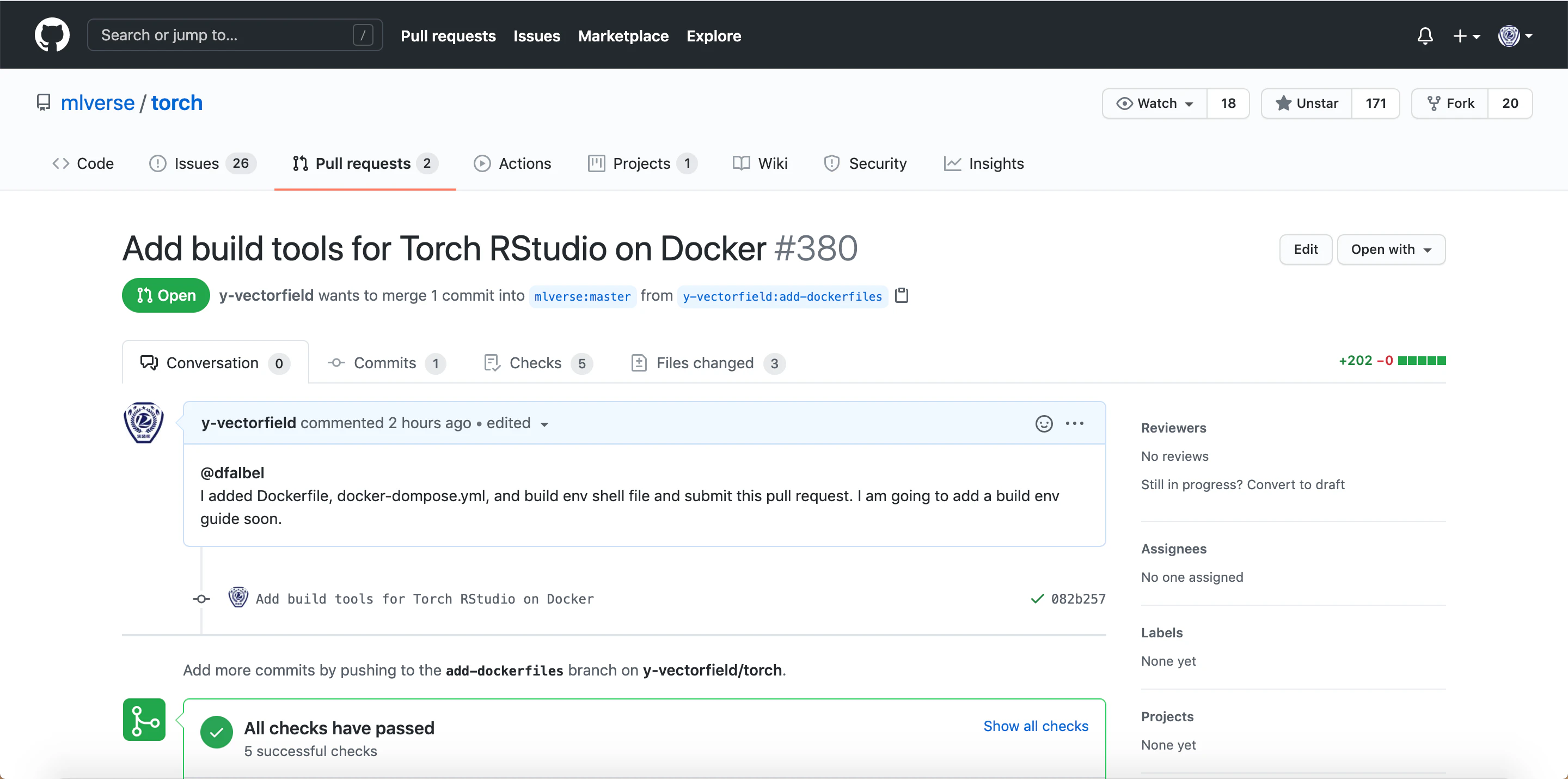

ダメ元でコミュニティーのリポジトリに成果物を追加出来ないか聞いてみた所,何と!!あっさり許可が下りてしまいました。地球の裏側のエンジニア3に筆者の苦闘の成果が認められた瞬間です。(参照)

Pull Requestを出してみた!!

御言葉に甘えてPull Requestを出してみました。マージされれば本家のリポジトリから環境構築ツールが利用出来ます。請うご期待!!

Mergeされました!!(2020/12/7)

無事Mergeされました。めでたしめでたし。但し環境構築ガイドを追加するという追加タスクが。。。(Pull Requestに書いてしまったので。。。しかも,in Englishで。。。)

まとめ

Torch for RをGPUモードで実行出来る環境をDockerでお手軽に構築出来る様にDockerfile, docker-compose.yml等の必用なファイルの作成を今回実施しました。これもTorch for RがCUDA11に対応すれば,お役御免になるかもしれませんが,それまでは今回作成した環境でTorch for Rを用いてDNNで遊んでみようと思います。

今後の展望

- MLP(Multi Layer Perceptron)で手書き文字認識を試してみる

- DNNで手書き文字認識を試してみる

- もう少し複雑なデータセットでDNNを試す

- Kaggleでも活用してみる

- 友人に利用を紹介する etc...

Reference

- 投稿日:2020-12-06T21:50:05+09:00

【初心者向け】20分でLaravel開発環境を爆速構築するDockerハンズオン

概要

docker(docker-compose)でLEMP環境(PHP/nginx/MySQL)を構築し、Laravelの新規プロジェクト作成、構築した環境を破棄してから環境の再構築までをハンズオン形式で行います。

ご注意

記事を寄稿したタイミングでは、補足の解説は特になくコマンドだけのご紹介だったので、コマンド部分のみコピペすれば20分で終わる内容でした。

しかし、継ぎ足しで解説を追記していった結果、普通に読みながら進めていくと2時間ぐらいのボリュームになってしまってます?ご了承下さい?♂️

更新履歴

- 2020/09/09 Laravel8(当時はLaravel6が出た頃)がリリースされ、こちらの記事も内容が古くなったので全て書き直しました。

目的

Dockerの細かい概念などはすっ飛ばして、

このハンズオンの通りに進めればDocker×Laravelの環境を構築できます。

習うより慣れろで行ってみましょう!ハンズオン終了時のGitHub

https://github.com/ucan-lab/docker-laravel-handson

ハンズオンイベント

【ぺちオブ】ゆーきゃんプレゼンツ!Laravel + Docker 環境構築ハンズオン

https://phper-oop.connpass.com/event/137152

あの有名なぺちオブのイベントとしてハンズオン講師をやらせていただきました!

ありがとうございます?レビュワー

- hiroさん @hirodragon

- かひろくん @kahirokunn

- もっぷ先生 @kobayashi-m42

- こはさん @smspp

スペシャルサンクス?♂️?

前提条件

- Mac基準ですが、Windowsでも動作することを確認済み

- コマンドは

[環境] $とprefixを付けてます。- 所要時間は事前準備部分を除いて20分を目安としてます。

- エディタはファイル編集時にお好みのもので開いて作業ください?

構築環境(Dockerイメージ、各種バージョン)

- php: 7.4-fpm-buster

- composer: 1.10

- nginx: 1.18-alpine

- mysql: 8.0

- Laravel: 8.x

dockerおすすめ書籍

冒頭で習うより慣れろと言いましたが、習っておくのもそれはそれで良いことなのでオススメの書籍や記事をご紹介します。私はこの辺りの記事や本を読んで勉強したのでオススメしてます。

マンガでわかるdockerシリーズ

@llminatoll さんがDockerについてマンガで分かりやすく説明されてます。

初めての方はこちらのマンガでDockerの概念を学んでから進めると理解しやすいです。dockerおすすめ記事・サイト

公式系

記事

スライド

- Docker入門-基礎編 いまから始めるDocker管理【2nd Edition】

- Dockerfileを改善するためのBest Practice 2019年版

- Dockerfile を書くためのベストプラクティス解説編

事前準備

Windowsユーザー

Git Bashのインストールをお願いします。(Linuxコマンドをそのまま打てるようになります)

Git Bash を起動した際は下記のコマンドを実行ください。

$ exec winpty bashGitHubアカウントの作成

Gitの初期設定

user.emailとuser.nameが設定されていればok!

Gitの初期設定を行ってない場合、下記の記事を参考に初期設定をお願いします。最終的に下記のように表示されればokです。

$ git config --list | grep user user.email=xxx@yyy.com user.name=zzzGitHub SSH接続設定

$ ssh -T github.com Warning: Permanently added 'github.com,52.69.186.44' (RSA) to the list of known hosts. Hi ucan-lab! You've successfully authenticated, but GitHub does not provide shell access.

successfully authenticatedの文字が出ればok!

Warningは気にしなくてok!GitHub SSH接続設定を行ってない場合、下記の記事を参考に初期設定をお願いします。

もしくはハンズオンをHTTPSに置き換えて進めてください。docker, docker-compose のインストール

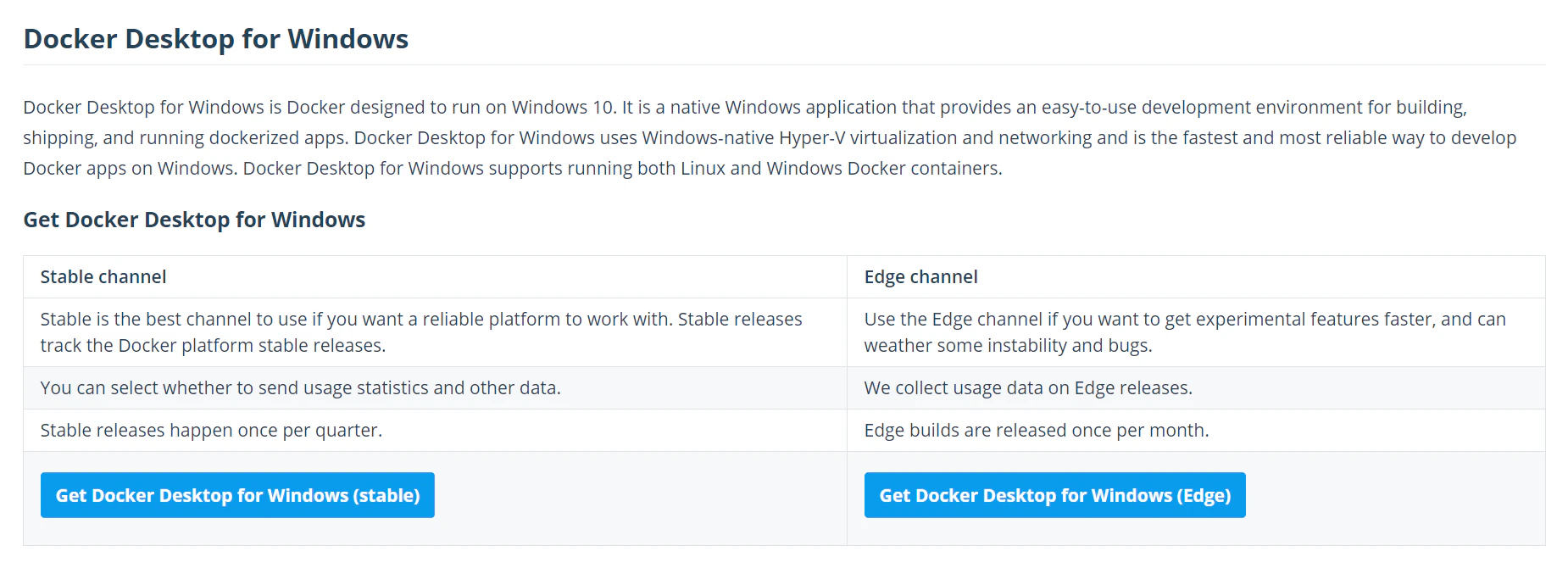

[Mac] Docker for Macをインストール

[Windows] Docker for Windowsをインストール

イントール確認

[mac] $ docker --version Docker version 19.03.12, build 48a66213fe [mac] $ docker-compose --version docker-compose version 1.26.2, build eefe0d31Docker起動確認

インストールしたDockerを起動してください。

running状態になっていればokです。

ここまでで事前準備終了です。

今回のハンズオンのゴール

- 3層アーキテクチャのコンテナの構築

- ウェブサーバー(web)

- nginxで静的コンテンツ配信サーバを構築

- アプリケーションサーバー(app)

- nginxを経由してPHPを動作させるアプリケーションサーバを構築

- PHPパッケージ管理ツールComposerのインストール

- データベースサーバー(db)

- MySQLデータベースサーバーの構築

- Laravelをインストールしてwelcome画面の表示

- LaravelとMySQLを連携し、マイグレーションを実行

- Docker環境の破棄

- Docker環境をGitHubから再構築

?【初心者向け】20分でLaravel開発環境を爆速構築するDockerハンズオン?

- 所要時間: 20分目安

作業ディレクトリを作成

[mac] $ mkdir docker-laravel-handson [mac] $ cd docker-laravel-handson最終的なディレクトリ構成

. ├── README.md (この名前にするとGitHubで見た時にHTMLに変換して表示してくれる) ├── infra (*1) │ ├── mysql (*1) │ │ ├── Dockerfile │ │ └── my.cnf (*1) │ ├── nginx (*1) │ │ └── default.conf (*1) │ └── php (*1) │ ├── Dockerfile (この名前にするとファイル名の指定を省略できる) │ └── php.ini (*1) ├── docker-compose.yml (この名前にするとファイル名の指定を省略できる) └── backend (*1) └── Laravelをインストールするディレクトリこのディレクトリ構成を目指します。

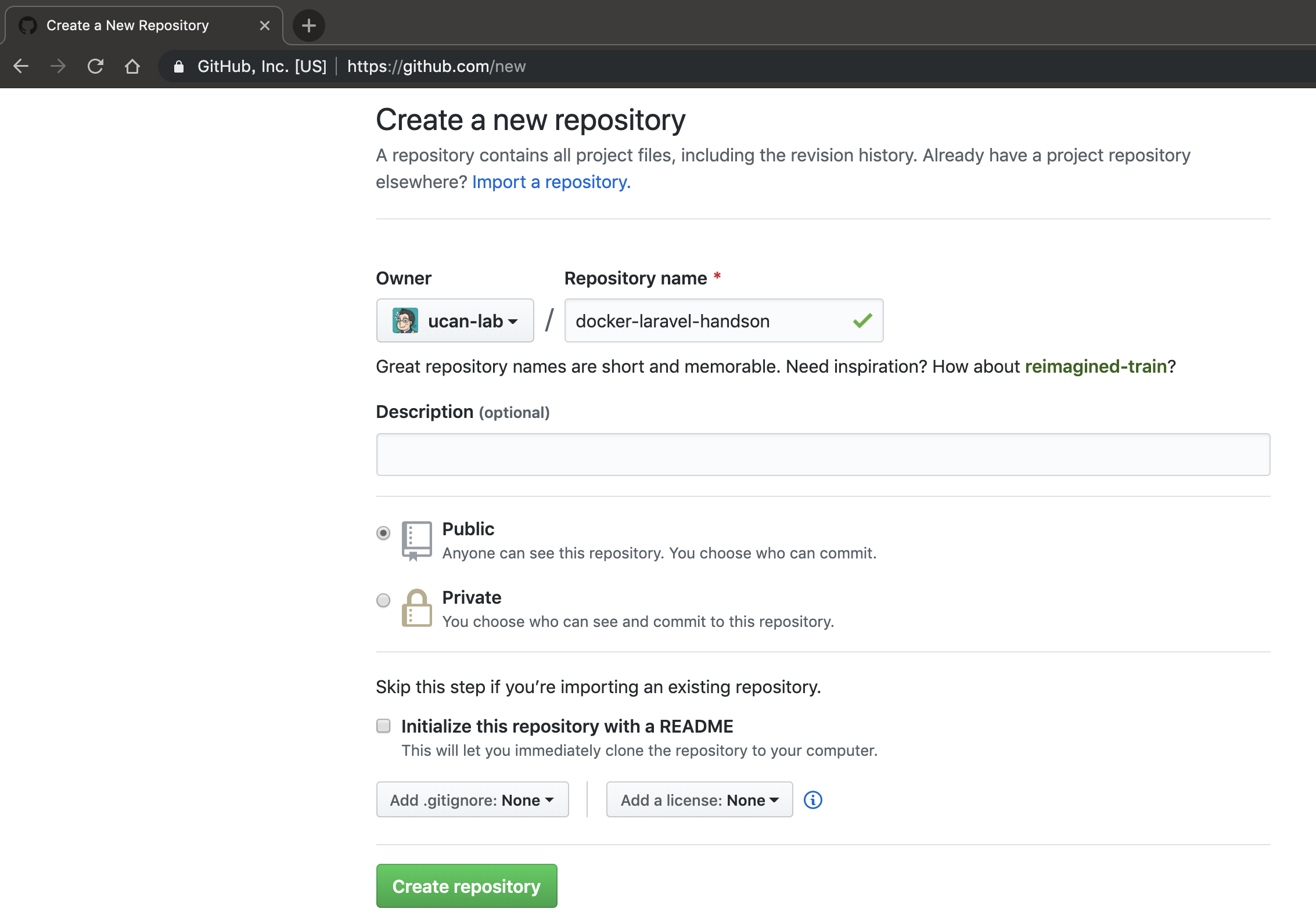

(*1)任意の名前に変更してもokです。リモートリポジトリを作成

リポジトリ名

docker-laravel-handsonのGitHubリモートリポジトリを作成する。リモートリポジトリへ初回コミット&プッシュ

[mac] $ echo "# docker-laravel-handson" >> README.md [mac] $ git init [mac] $ git add README.md [mac] $ git commit -m "first commit" [mac] $ git branch -M main※ 2020/10/1 からデフォルトブランチがmasterからmainに変更されました。

リモートリポジトリを登録します。

リモートリポジトリ先は適宜置き換えてください。[mac] $ git remote add origin git@github.com:ucan-lab/docker-laravel-handson.gitリモートリポジトリ先が正しく設定されていることを確認してください。

[mac] $ git remote -v origin git@github.com:ucan-lab/docker-laravel-handson.git (fetch) origin git@github.com:ucan-lab/docker-laravel-handson.git (push) # もしリモートリポジトリ先を間違えた場合は下記のコマンドから変更できます。 [mac] $ git remote set-url origin <リモートリポジトリ>リモートリポジトリ先の名前を

originと付けられていること。

リモートリポジトリ先のURL等に間違いがないことを確認する。GitHubへpushします。

[mac] $ git push -u origin main

-uオプションは--set-upstreamの省略

- ローカルリポジトリの現在のブランチ(main)をリモートリポジトリ(origin)のmainにpush先を設定

- 以降は

git pushだけでgit push origin mainと同義GitHubのリモートリポジトリのmainブランチへpushされていることを確認します。

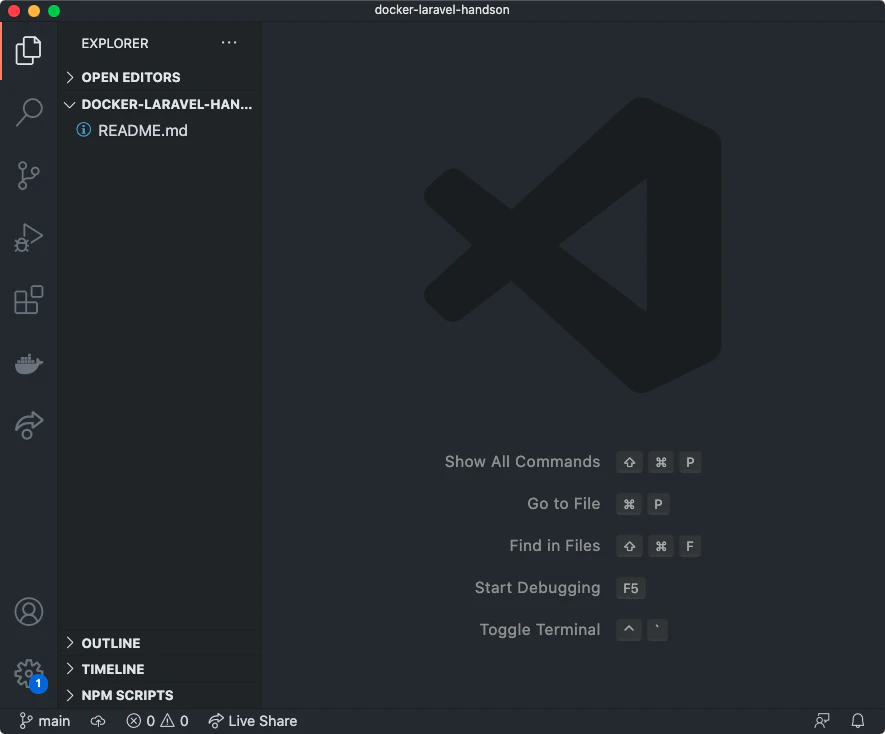

お好みのGUIエディタで開く

ymlファイルをCUIエディタで書いていくのは大変なのでお好みのGUIエディタ(今回はVSCode)で開きます。

codeコマンドがインストールされていれば、簡単にプロジェクトをVSCodeで開けます。[mac] $ code .また、

control+shift+@で統合ターミナルをVSCodeで開くことができます。

ファイルの編集もコマンドの実行もVSCodeだけで行えます。アプリケーションサーバ(app)コンテナを作る

PHPアプリケーションサーバコンテナを作成します。

公式のPHP-FPMイメージをベースイメージとしてカスタマイズします。ディレクトリ構成

. ├── infra │ └── php │ ├── Dockerfile │ └── php.ini # PHPの設定ファイル ├── backend # Laravelをインストールするディレクトリ └── docker-compose.ymldocker-compose.yml を作成する

touchコマンドで空ファイルを作成してますが、作成後はお好みのエディタで編集ください。

ファイル名のタイプミス防止のため空ファイルだけ作成してます。

当ハンズオンはこの流れで進めていきます。[mac] $ touch docker-compose.yml作成した

docker-compose.ymlを下記の通りに編集します。docker-compose.ymlversion: "3.8" services: app: build: ./infra/php volumes: - ./backend:/work

docker-compose.ymlファイルはインデント(半角スペース)が意味を持ちます。注意してコピペしてください。docker-compose.yml: 設定値の補足

docker-compose.ymlversion: "3.8"Docker Composeファイルのバージョンを指定しています。

https://matsuand.github.io/docs.docker.jp.onthefly/compose/compose-file/compose-versioning/

通常はメジャー番号とマイナー番号を両方指定します。

ちなみにマイナーバージョンを指定しない場合はデフォルト0が使用されます。docker-compose.yml# 下記は同じ指定になる version: "3" version: "3.0"docker-compose.ymlservices: app: # => サービス名は任意 build: ./infra/php volumes: - ./backend:/workサービス名に

app(アプリケーションサーバー)の名前を付けて定義しています。

サービス名は任意に決められます。

build:で指定しているのはビルドコンテキストを指定します。

ビルドコンテキストとは、docker buildを実行する際の現在の作業ディレクトリのことをビルドコンテキスト(build context)と呼びます。

Dockerfileが置かれている./infra/phpディレクトリをビルドコンテキストとして指定します。

Dockerビルドの際はDockerfileのファイルを探すので、ファイル名の指定は不要です。

volumes:ではホスト側のディレクトリや名前付きボリュームをコンテナ側へマウントしたい時に指定します。

今回はホスト側の./backendディレクトリをappサービスのコンテナ内/workへマウントしてます。./docker/php/Dockerfile を作成する

- Composerコマンドのインストール

- Laravelで必要なPHP拡張機能のインストール

- bcmath, pdo_mysql が不足しているので追加インストール

[mac] $ mkdir -p infra/php [mac] $ touch infra/php/Dockerfile下記のコードを丸ごとコピーして Dockerfile へ貼り付けてください。

infra/php/DockerfileFROM php:7.4-fpm-buster SHELL ["/bin/bash", "-oeux", "pipefail", "-c"] ENV COMPOSER_ALLOW_SUPERUSER=1 \ COMPOSER_HOME=/composer COPY --from=composer:1.10 /usr/bin/composer /usr/bin/composer RUN apt-get update && \ apt-get -y install git unzip libzip-dev libicu-dev libonig-dev && \ apt-get clean && \ rm -rf /var/lib/apt/lists/* && \ docker-php-ext-install intl pdo_mysql zip bcmath COPY ./php.ini /usr/local/etc/php/php.ini WORKDIR /work./docker/php/Dockerfile: 設定値の補足

Dockerfileはテキストファイルであり、Dockerイメージを作り上げるために実行する命令をこのファイルに含めることができます。

各種Docker命令を解説します。

FROM php:7.4-fpm-busterhttps://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#from

FROM命令はイメージビルドのためのベースイメージを設定します。

FROM イメージ名:タグ名で指定します。php | Docker Hub公式イメージをベースイメージとして利用します。

SHELL ["/bin/bash", "-oeux", "pipefail", "-c"]https://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#shell

SHELL命令は何も指定しない場合は

SHELL ["/bin/sh", "-c"]がデフォルト値となります(Linuxの場合)パイプ中のあらゆる段階でエラーがあれば失敗とするため、

pipefailオプションを明示的に指定してます。

-oオプションはオプションを設定するためのオプションです。

-eオプションを定義しておくと、そのシェルスクリプト内で何らかのエラーが発生した時点で、それ以降の処理を中断できます。

-uオプションを定義しておくと、未定義の変数に対して読み込み等を行おうとした際にエラーとなります。

-xオプションを定義しておくと、実行したコマンドを全て標準エラー出力に出してくれます。おまじないと思ってもらえればokです。SHELL命令は必須ではないです。

ENV COMPOSER_ALLOW_SUPERUSER=1 \ COMPOSER_HOME=/composerhttps://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#env

ENV命令はコンテナ内のサーバー環境変数を設定します。

COPY --from=composer:1.10 /usr/bin/composer /usr/bin/composerhttps://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#copy

RUN apt-get update && \ apt-get -y install git unzip libzip-dev libicu-dev libonig-dev && \ apt-get clean && \ rm -rf /var/lib/apt/lists/* && \ docker-php-ext-install intl pdo_mysql zip bcmathhttps://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#run

Debian系のパッケージ管理ツールは

apt-get,aptとありますが、Dockerfile内でaptを実行するとCLIインターフェース向けではないと警告が表示されるため、apt-getを使用します。

apt-get updateインストール可能なパッケージの「一覧」を更新します。

実際のパッケージのインストール、アップグレードなどは行いません。

apt-get -y install xxxLaravelのインストールに必要なパッケージをインストールします。

下記のパッケージをインストールしておけばokだと思います。

- https://packages.debian.org/ja/sid/git

- https://packages.debian.org/ja/sid/unzip

- https://packages.debian.org/ja/sid/libzip-dev

- https://packages.debian.org/ja/sid/libicu-dev

- https://packages.debian.org/ja/sid/libonig-dev

apt-get clean && rm -rf /var/lib/apt/lists/*ここはパッケージインストールで使用したキャッシュファイルを削除しています。phpの公式Dockerイメージには、

docker-php-ext-install,docker-php-ext-enable,docker-php-ext-configureのPHP拡張ライブラリを簡単に利用するための便利コマンドが予め用意されています。

docker-php-ext-install intl pdo_mysql zip bcmathPHPの拡張ライブラリをインストールしています。

- https://www.php.net/manual/ja/book.intl.php

- https://www.php.net/manual/ja/ref.pdo-mysql.php

- https://www.php.net/manual/ja/book.zip.php

- https://www.php.net/manual/ja/book.bc.php

COPY ./php.ini /usr/local/etc/php/php.inihttps://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#copy

WORKDIR /workhttps://matsuand.github.io/docs.docker.jp.onthefly/engine/reference/builder/#workdir

./docker/php/php.ini を作成する

php.ini はPHPの設定ファイル

- PHPエラーメッセージの設定

- PHPエラーログの設定

- メモリ等の設定(お好みで)

- タイムゾーン設定

- 文字コード設定

[mac] $ touch infra/php/php.iniphp.inizend.exception_ignore_args = off expose_php = on max_execution_time = 30 max_input_vars = 1000 upload_max_filesize = 64M post_max_size = 128M memory_limit = 256M error_reporting = E_ALL display_errors = on display_startup_errors = on log_errors = on error_log = /dev/stderr default_charset = UTF-8 [Date] date.timezone = Asia/Tokyo [mysqlnd] mysqlnd.collect_memory_statistics = on [Assertion] zend.assertions = 1 [mbstring] mbstring.language = Japanesebuild & up

- appコンテナの作成

- PHPのバージョン確認

- Laravelで必要なPHP拡張機能の確認

[mac] $ docker-compose up -d --build

docker-composeコマンドはdocker-compose.ymlがあるディレクトリで実行します。docker-compose upはdocker-compose.ymlに定義したサービスを起動します。-d「デタッチド」モードでコンテナを起動します。

- デフォルトは「アタッチド」モードで全てのコンテナログを画面上に表示

- 「デタッチド」モードではバックグラウンドで動作

--buildコンテナの開始前にイメージを構築します

- 特に変更がない場合はキャッシュが使用されます。

[mac] $ docker-compose ps Name Command State Ports ------------------------------------------------------------------------------- docker-laravel-handson_app_1 docker-php-entrypoint php-fpm Up 9000/tcpdocker-laravel-handson_app_1 コンテナの State が Up になっていたら正常に起動している状態です。

docker-compose psコンテナ一覧を表示します。

- Name: コンテナ名

- Command: 最後に実行されたコマンド

- State: 状態(Up)はコンテナが起動している状態

- Ports: 9000/tcp(コンテナのポート)

- 9000番のホストポートは公開されていないので、コンテナの外からはアクセスできない

appコンテナ内ミドルウェアのバージョン確認(コンテナに入ってコマンド実行)

作成したappコンテナの中に入ってPHP, Composerのバージョン、インストール済みの拡張機能を確認します。

Laravel 7.xのサーバ要件に必要な拡張機能が入っていることを確認します。[mac] $ docker-compose exec app bash # PHPのバージョン確認 [app] # php -v PHP 7.4.6 (cli) (built: May 15 2020 13:01:21) ( NTS ) Copyright (c) The PHP Group Zend Engine v3.4.0, Copyright (c) Zend Technologies # Composerのバージョン確認 [app] # composer -V Composer version 1.10.10 2020-08-03 11:35:19 # インストール済みの拡張機能の一覧 [app] # php -m [PHP Modules] bcmath Core ctype curl date dom fileinfo filter ftp hash iconv intl json libxml mbstring mysqlnd openssl pcre PDO pdo_mysql pdo_sqlite Phar posix readline Reflection session SimpleXML sodium SPL sqlite3 standard tokenizer xml xmlreader xmlwriter zip zlib [Zend Modules]

exitでコンテナの外に出ます。[app] $ exit

control+dでもコンテナから出られます。補足説明

appコンテナ内に入ってphpコマンドを実行しています。

docker-compose exec実行中のコンテナ内で、コマンドを実行します。appサービス名(コンテナ名)を指定します。PHPのバージョン確認(コンテナの外からコマンド実行)

コンテナの外から

phpコマンドを実行することもできます。

docker-compose exec [サービス名] [実行したいコマンド][mac] $ docker-compose exec app php -v PHP 7.4.6 (cli) (built: May 15 2020 13:01:21) ( NTS ) Copyright (c) The PHP Group Zend Engine v3.4.0, Copyright (c) Zend Technologies結果にコミット

[mac] $ git status (use "git add <file>..." to include in what will be committed) docker-compose.yml infra/php/Dockerfile infra/php/php.ini [mac] $ git add . [mac] $ git status On branch main Changes to be committed: (use "git restore --staged <file>..." to unstage) new file: docker-compose.yml new file: infra/php/Dockerfile new file: infra/php/php.ini [mac] $ git commit -m "feat create docker app container" [main f5a637f] feat create docker app container 3 files changed, 49 insertions(+) create mode 100644 docker-compose.yml create mode 100644 infra/php/Dockerfile create mode 100644 infra/php/php.ini [mac] $ git logウェブサーバー(web)コンテナを作る

nginxウェブサーバーコンテナを作成します。

nginxのベースイメージをそのまま利用します。ディレクトリ構成

. ├── infra │ └── nginx │ └── default.conf # nginxの設定ファイル ├── backend │ └── public # 動作確認用に作成 │ ├── index.html # HTML動作確認用 │ └── phpinfo.php # PHP動作確認用 └─── docker-compose.ymldocker-compose.yml へ追記する

- ポート転送の設定(今回は10080ポートにする)

- タイムゾーンの設定

version: "3.8" services: app: build: ./infra/php volumes: - ./backend:/work # 追記 web: image: nginx:1.18-alpine ports: - 10080:80 volumes: - ./backend:/work - ./infra/nginx/default.conf:/etc/nginx/conf.d/default.conf working_dir: /work

docker-compose.ymlファイルはインデント(半角スペース)が意味を持ちます。注意してコピペしてください。appコンテナの設定と同じインデントレベルで貼り付けます。docker-compose.yml: 設定値の解説

image: nginx:1.18-alpinehttps://matsuand.github.io/docs.docker.jp.onthefly/compose/compose-file/#image

コンテナを起動させるイメージを指定します。

nginx | Docker Hubを指定してます。

今回は公式のnginxイメージをそのまま利用しています。(Dockerfileは不要)ちなみにnginxは

1.10,1.12等の偶数のバージョンが安定バージョンになります。

特に理由がなければ偶数バージョンをご利用ください。ports: - 10080:80https://matsuand.github.io/docs.docker.jp.onthefly/compose/compose-file/#ports

nginxへ外(ホスト側)からコンテナ内へアクセスさせるため公開用のポートを設定します。

ホスト側:コンテナ側と設定します。volumes: - ./backend:/work - ./infra/nginx/default.conf:/etc/nginx/conf.d/default.confhttps://matsuand.github.io/docs.docker.jp.onthefly/compose/compose-file/#volumes

ホスト側にあるディレクトリ、ファイルをコンテナ内へマウントさせています。

docker/nginx/default.conf を作成する

[mac] $ mkdir infra/nginx [mac] $ touch infra/nginx/default.confLaravel公式にnginxの設定例が用意されているので、こちらを流用します。

https://readouble.com/laravel/7.x/ja/deployment.htmldefault.confserver { listen 80; server_name example.com; root /work/public; add_header X-Frame-Options "SAMEORIGIN"; add_header X-XSS-Protection "1; mode=block"; add_header X-Content-Type-Options "nosniff"; index index.php; charset utf-8; location / { try_files $uri $uri/ /index.php?$query_string; } location = /favicon.ico { access_log off; log_not_found off; } location = /robots.txt { access_log off; log_not_found off; } error_page 404 /index.php; location ~ \.php$ { fastcgi_pass app:9000; fastcgi_param SCRIPT_FILENAME $realpath_root$fastcgi_script_name; include fastcgi_params; } location ~ /\.(?!well-known).* { deny all; } }

root,fastcgi_passドキュメントルート設定を書き換えてます。

nginxの設定を詳しく知りたい方は下記の記事がオススメです。build & up

[mac] $ docker-compose down [mac] $ docker-compose up -d --build

docker-composeコマンドはdocker-compose.ymlがあるディレクトリで実行します。[mac] $ docker-compose ps Name Command State Ports -------------------------------------------------------------------------------------------- docker-laravel-handson_app_1 docker-php-entrypoint php-fpm Up 9000/tcp docker-laravel-handson_web_1 nginx -g daemon off; Up 0.0.0.0:10080->80/tcpdocker-laravel-handson_web_1 コンテナの State が Up になっていたら正常に起動している状態です。

また、

Portsの項目が、appコンテナは9000/tcpでwebコンテナは0.0.0.0:10080->80/tcpと表示形式が異なってます。

これはホスト上の10080番ポートをコンテナの80番ポートへ割り当てています。nginxのバージョン確認

[mac] $ docker-compose exec web nginx -v nginx version: nginx/1.18.0webコンテナの確認

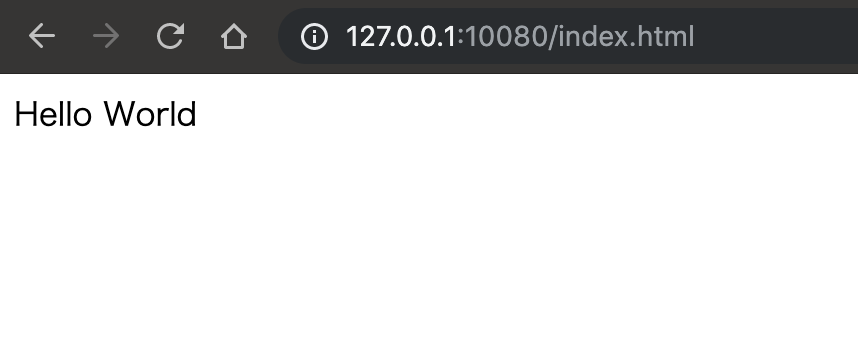

- webコンテナの動作確認

- HTMLとPHPが表示されるか

[mac] $ mkdir backend/public [mac] $ echo "Hello World" > backend/public/index.html [mac] $ echo "<?php phpinfo();" > backend/public/phpinfo.phphttp://127.0.0.1:10080/index.html

「Hello World」が表示されることを確認する。

http://127.0.0.1:10080/phpinfo.php

phpinfoの情報が表示されることを確認する。

[mac] $ rm -rf backend/*確認用に作成したHTML, PHPファイルは不要なので削除します。

結果にコミット

[mac] $ git status On branch main Changes not staged for commit: (use "git add <file>..." to update what will be committed) (use "git restore <file>..." to discard changes in working directory) modified: docker-compose.yml modified: infra/php/Dockerfile Untracked files: (use "git add <file>..." to include in what will be committed) infra/nginx/default.conf [mac] $ git add . [mac] $ git status On branch main Changes to be committed: (use "git restore --staged <file>..." to unstage) modified: docker-compose.yml new file: infra/nginx/default.conf modified: infra/php/Dockerfile [mac] $ git commit -m "feat create docker web container" [main 5e278c1] feat create docker web container 3 files changed, 29 insertions(+), 1 deletion(-) create mode 100644 infra/nginx/default.conf [mac] $ git logLaravelをインストールする

- app コンテナに入り、Laravelをインストール

- welcomeページが表示されるか

[mac] $ docker-compose exec app bash [app] $ composer create-project --prefer-dist "laravel/laravel=8.*" . [app] $ php artisan -V Laravel Framework 8.0.0 [app] $ exit

composer create-project --prefer-dist

--prefer-distzipでダウンロードするため高速- composer の–prefer-distってよく使うけど何してる?

composer create-projectコマンドでメモリ足りない問題の対策artisanについて

- Laravelが用意しているコマンドラインインターフェイス

- https://readouble.com/laravel/7.0/ja/artisan.html

php artisan list使用可能なコマンド一覧を表示Laravel ウェルカム画面の表示

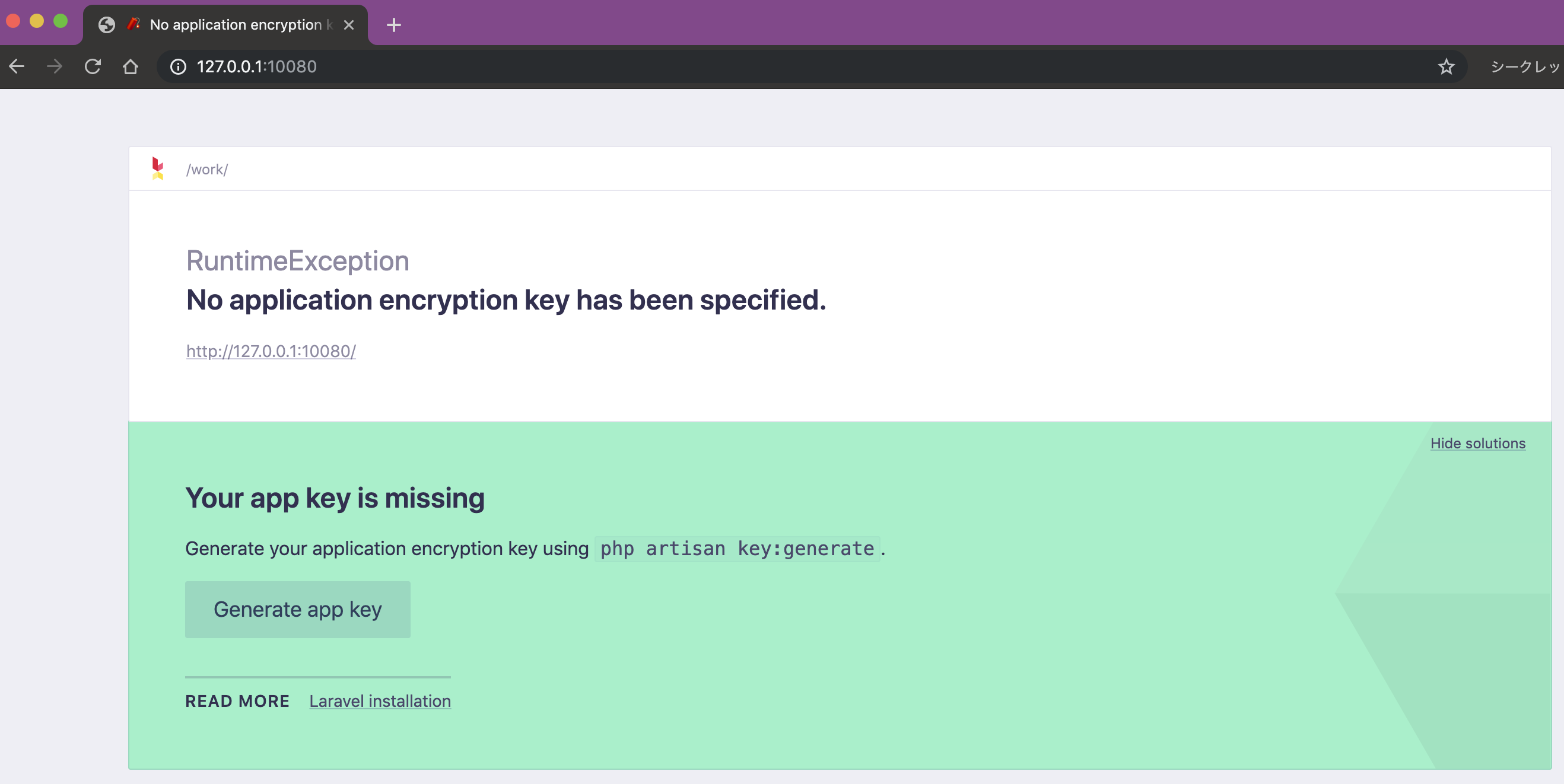

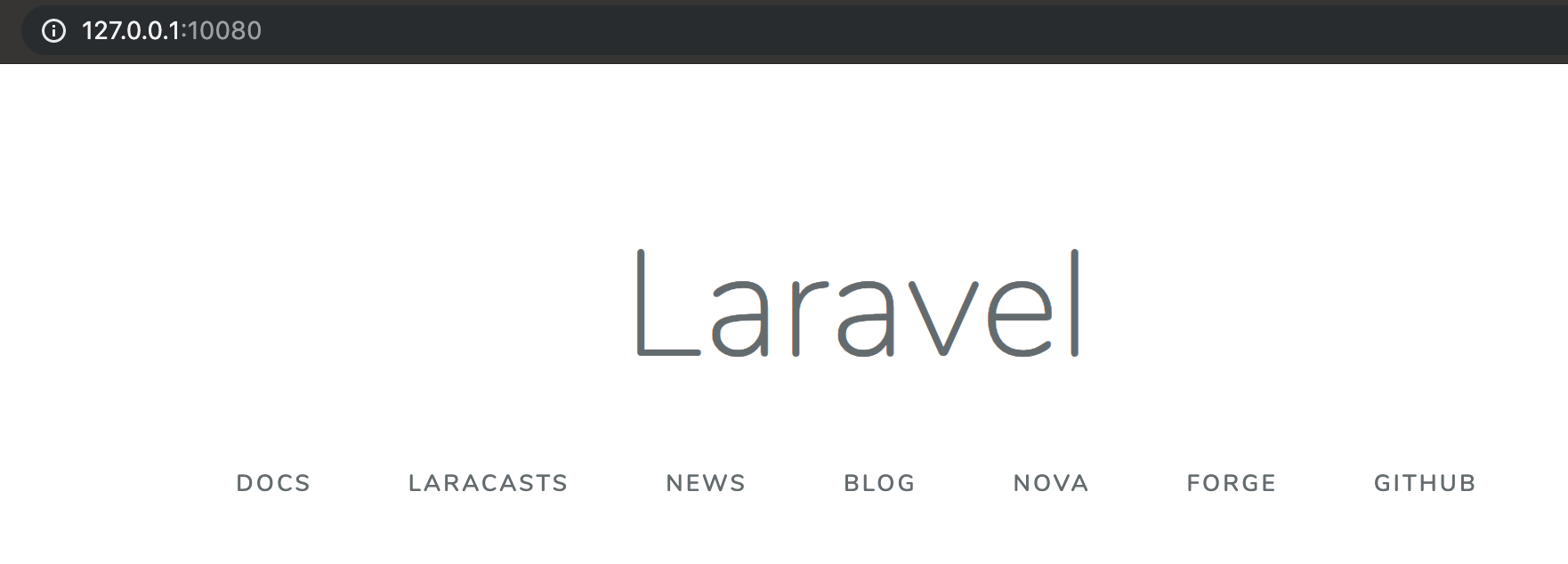

LaravelのWelcome画面が表示されることを確認する。

結果にコミット

[mac] $ git status [mac] $ git add . [mac] $ git status [mac] $ git commit -m "feat laravel install" [mac] $ git logデータベース(db)コンテナを作る

MySQLデータベースコンテナを作成します。

MySQLのベースイメージをそのまま利用します。参考記事

ディレクトリ構成

. ├── infra │ └── mysql │ ├── Dockerfile │ └── my.cnf # MySQLの設定ファイル └── docker-compose.ymldocker-compose.yml へ追記する

- データベース名やユーザー名等の接続情報とタイムゾーンの設定は環境変数で渡す

- トップレベルvolumeを使用してデータの永続化

version: "3.8" services: app: build: ./infra/php volumes: - ./backend:/work web: image: nginx:1.18-alpine ports: - 10080:80 volumes: - ./backend:/work - ./infra/nginx/default.conf:/etc/nginx/conf.d/default.conf working_dir: /work # 追記 db: build: ./infra/mysql volumes: - db-store:/var/lib/mysql volumes: db-store:

docker-compose.ymlファイルはインデント(半角スペース)が意味を持ちます。注意してコピペしてください。webコンテナの設定と同じインデントレベルでdbコンテナの設定を貼り付けます。volumesはトップレベル(servicesと同じレベル)に貼り付けます。- DockerのMySQLイメージ起動時に渡す環境変数

- Docker for Macのmount遅い問題まとめ

- Performance tuning for volume mounts (shared filesystems)

./docker/mysql/Dockerfile を作成する

[mac] $ mkdir infra/mysql [mac] $ touch infra/mysql/Dockerfile下記のコードを丸ごとコピーして Dockerfile へ貼り付けてください。

infra/mysql/DockerfileFROM mysql:8.0 ENV MYSQL_DATABASE=laravel_local \ MYSQL_USER=phper \ MYSQL_PASSWORD=secret \ MYSQL_ROOT_PASSWORD=secret \ TZ=Asia/Tokyo COPY ./my.cnf /etc/mysql/conf.d/my.cnf RUN chmod 644 /etc/mysql/conf.d/my.cnfコメントでいただいたのですが、Windows環境でボリュームマウントを行うと、ファイルパーミッションが777となるようです。

my.cnfに書き込み権限が付いてるとMySQLの起動時にエラーが発生します。

その対策としてボリュームマウントではなくDockerfileを作成してmy.cnfファイルコピー、読み取り専用に権限変更してます。docker/mysql/my.cnf を作成する

- 文字コードの設定

- タイムゾーンの設定

- ログ設定

[mac] $ mkdir infra/mysql [mac] $ touch infra/mysql/my.cnfmy.cnf[mysqld] # character set / collation character_set_server = utf8mb4 collation_server = utf8mb4_0900_ai_ci # timezone default-time-zone = SYSTEM log_timestamps = SYSTEM # Error Log log-error = mysql-error.log # Slow Query Log slow_query_log = 1 slow_query_log_file = mysql-slow.log long_query_time = 1.0 log_queries_not_using_indexes = 0 # General Log general_log = 1 general_log_file = mysql-general.log [mysql] default-character-set = utf8mb4 [client] default-character-set = utf8mb4build & up

[mac] $ docker-compose down [mac] $ docker-compose up -d --build

docker-composeコマンドはdocker-compose.ymlがあるディレクトリで実行します。[mac] $ docker-compose ps Name Command State Ports -------------------------------------------------------------------------------------------- docker-laravel-handson_app_1 docker-php-entrypoint php-fpm Up 9000/tcp docker-laravel-handson_db_1 docker-entrypoint.sh mysqld Up 3306/tcp, 33060/tcp docker-laravel-handson_web_1 nginx -g daemon off; Up 0.0.0.0:10080->80/tcpdocker-laravel-handson_db_1 コンテナの State が Up になっていたら正常に起動している状態です。

[mac] $ docker-compose exec db mysql -V mysql Ver 8.0.20 for Linux on x86_64 (MySQL Community Server - GPL)マイグレーション実行(エラーが発生します)

[mac] $ docker-compose exec app bash [app] $ php artisan migrate Illuminate\Database\QueryException SQLSTATE[HY000] [2002] Connection refused (SQL: select * from information_schema.tables where table_schema = laravel and table_name = migrations and table_type = 'BASE TABLE') at vendor/laravel/framework/src/Illuminate/Database/Connection.php:671 667▕ // If an exception occurs when attempting to run a query, we'll format the error 668▕ // message to include the bindings with SQL, which will make this exception a 669▕ // lot more helpful to the developer instead of just the database's errors. 670▕ catch (Exception $e) { ➜ 671▕ throw new QueryException( 672▕ $query, $this->prepareBindings($bindings), $e 673▕ ); 674▕ } 675▕ +37 vendor frames 38 artisan:37 Illuminate\Foundation\Console\Kernel::handle(Object(Symfony\Component\Console\Input\ArgvInput), Object(Symfony\Component\Console\Output\ConsoleOutput)) [app] $ exit

SQLSTATE[HY000] [2002] Connection refusedこのエラーはよく見るMySQLのエラーです。

MySQLに接続拒否されたエラーなので、この場合は大体MySQLへの接続設定に誤りがあります。

backend/.envのDB接続設定を修正する。[mac] $ vim backend/.env DB_CONNECTION=mysql DB_HOST=db DB_PORT=3306 DB_DATABASE=laravel_local DB_USERNAME=phper DB_PASSWORD=secret

backend/.env.exampleも同様にDB接続設定を修正しておきます。[mac] $ vim backend/.env.example DB_CONNECTION=mysql DB_HOST=db DB_PORT=3306 DB_DATABASE=laravel_local DB_USERNAME=phper DB_PASSWORD=secretマイグレーション実行(再実行)

[mac] $ docker-compose exec app bash [app] $ php artisan migrate Migration table created successfully. Migrating: 2014_10_12_000000_create_users_table Migrated: 2014_10_12_000000_create_users_table (0.07 seconds) Migrating: 2014_10_12_100000_create_password_resets_table Migrated: 2014_10_12_100000_create_password_resets_table (0.04 seconds) Migrating: 2019_08_19_000000_create_failed_jobs_table Migrated: 2019_08_19_000000_create_failed_jobs_table (0.02 seconds)試しにデータを作ってみる

[mac] $ docker-compose exec app bash [app] php artisan tinker $user = new App\Models\User(); $user->name = 'phper'; $user->email = 'phper@example.com'; $user->password = Hash::make('secret'); $user->save();[mac] $ docker-compose exec db bash [db] $ mysql -u $MYSQL_USER -p$MYSQL_PASSWORD $MYSQL_DATABASE [mysql] > SELECT * FROM users; +----+--------------------+-----------------------------+---------------------+--------------------------------------------------------------+----------------+---------------------+---------------------+ | id | name | email | email_verified_at | password | remember_token | created_at | updated_at | +----+--------------------+-----------------------------+---------------------+--------------------------------------------------------------+----------------+---------------------+---------------------+ | 1 | phper | phper@example.com | NULL | $2y$10$/cmcAIdF7twOntcazkn4/e61YAM2F99hCrOo.qRUz7cUa/ZydrbVS | NULL | 2020-08-24 17:09:53 | 2020-08-24 17:09:53 | +----+--------------------+-----------------------------+---------------------+--------------------------------------------------------------+----------------+---------------------+---------------------+ 1 rows in set (0.00 sec)結果にコミット

[mac] $ git status [mac] $ git add . [mac] $ git status [mac] $ git commit -m "feat create docker db container" [mac] $ git logGitHubにpush

[mac] $ git pushリモートリポジトリへpushされていることを確認します。

Docker環境の再構築

Docker環境の破棄

コンテナの停止、ネットワーク・名前付きボリューム・コンテナイメージ、未定義コンテナを削除

[mac] $ docker-compose down --rmi all --volumes --remove-orphans作業ディレクトリの削除

プロジェクトを削除するので、GUIエディタは閉じておきましょう。

[mac] $ cd .. [mac] $ rm -rf docker-laravel-handsonVisual Studio Code等のGUIエディタで開いている場合は、一度エディタを終了しましょう。

環境の再構築

GitHubからリポジトリをクローン

** 自身のリポジトリ先に適宜変更してください **

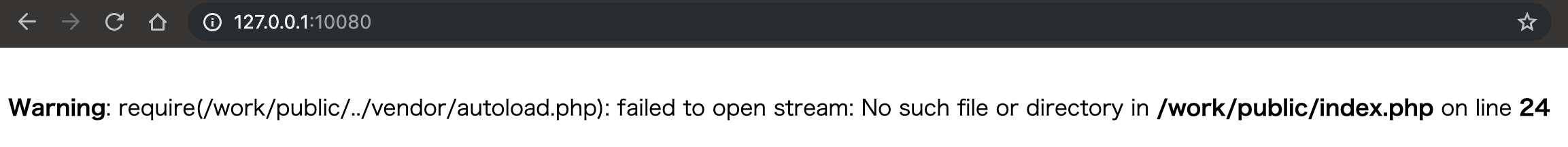

[mac] $ git clone git@github.com:ucan-lab/docker-laravel-handson.git [mac] $ cd docker-laravel-handson [mac] $ docker-compose up -d --build

/work/public/../vendor/autoload.phpを開くのに失敗してエラーになっていることを確認します。

git cloneが終わった状態ではappコンテナ内に/work/vendorディレクトリが存在しないためです。Laravelインストール

app コンテナに入ります。

[mac] $ docker-compose exec app bash

vendorディレクトリへライブラリ群をインストールします。

composer.lockファイルを参照します。[app] $ composer install

composer install時は.env環境変数ファイルは作成されないので、.env.exampleを元にコピーして作成します。[app] $ cp .env.example .env

.envにAPP_KEY=の値がないとこのエラーが発生します。

このコマンドでアプリケーションキーを生成できます。[app] $ php artisan key:generateWelcome画面が表示されることを確認します。

[app] $ php artisan migrate最後にマイグレーションを実行して成功すればハンズオン終了です。

お疲れ様でした?? コンテナを停止して終了してください。[app] $ exit [mac] $ docker-compose downオマケ

MySQLに接続したい

[mac] $ docker-compose exec db bash -c 'mysql -u${MYSQL_USER} -p${MYSQL_PASSWORD} ${MYSQL_DATABASE}' mysql> show tables; +---------------------+ | Tables_in_homestead | +---------------------+ | migrations | | password_resets | | users | +---------------------+ 3 rows in set (0.00 sec) mysql> desc users; +-------------------+---------------------+------+-----+---------+----------------+ | Field | Type | Null | Key | Default | Extra | +-------------------+---------------------+------+-----+---------+----------------+ | id | bigint(20) unsigned | NO | PRI | NULL | auto_increment | | name | varchar(255) | NO | | NULL | | | email | varchar(255) | NO | UNI | NULL | | | email_verified_at | timestamp | YES | | NULL | | | password | varchar(255) | NO | | NULL | | | remember_token | varchar(100) | YES | | NULL | | | created_at | timestamp | YES | | NULL | | | updated_at | timestamp | YES | | NULL | | +-------------------+---------------------+------+-----+---------+----------------+ 8 rows in set (0.01 sec)マイグレーションが実行されるとLaravel側で最初から用意されている

users,password_resetsのテーブルが生成されています。Laravelのログをコンテナログに表示する

backend/.envを修正する。LOG_CHANNEL=stderr

backend/routes/web.phpRoute::get('/', function () { logger('welcome route.'); return view('welcome'); });$ docker-compose logs # -f でログウォッチ $ docker-compose logs -f # サービス名を指定してログを表示 $ docker-compose logs -f appMySQLクライアントツールで接続したい

docker-compose.ymlのdbサービスに下記設定を追記して、コンテナを再起動して設定を反映してください。ports: - 33060:3306dbコンテナへのポート転送設定がないとホストからアクセスが行えません。

MySQLクライアントツールは「Sequel Ace」がオススメです。Windowsエラーメモ

Error response from daemon

$ docker-compose up -d --build docker: Error response from daemon: Get https://registry-1.docker.io/v2/: net/http: request canceled while waiting for connection (Client.Timeout exceeded while awaiting headers).解決策をいくつか

- Docker For Windowsを再起動する

- Dockerでpullやrunを行ったときイメージダウンロードができなくなった問題の解決法

- Proxy環境下のDockerトラブルシューティング

- さわって理解する Docker 入門

マイグレーションエラーの補足

Host '172.27.0.2' is not allowed to connect to this MySQL server

$ php artisan migrate Illuminate\Database\QueryException : SQLSTATE[HY000] [1130] Host '172.27.0.2' is not allowed to connect to this MySQL server (SQL: select * from information_schema.tables where table_schema = homestead and table_name = migrations and table_type = 'BASE TABLE') at /work/vendor/laravel/framework/src/Illuminate/Database/Connection.php:664 660| // If an exception occurs when attempting to run a query, we'll format the error 661| // message to include the bindings with SQL, which will make this exception a 662| // lot more helpful to the developer instead of just the database's errors. 663| catch (Exception $e) { > 664| throw new QueryException( 665| $query, $this->prepareBindings($bindings), $e 666| ); 667| } 668| Exception trace: 1 PDOException::("SQLSTATE[HY000] [1130] Host '172.27.0.2' is not allowed to connect to this MySQL server") /work/vendor/laravel/framework/src/Illuminate/Database/Connectors/Connector.php:70 2 PDO::__construct("mysql:host=db;port=3306;dbname=homestead", "homestead", "secret", []) /work/vendor/laravel/framework/src/Illuminate/Database/Connectors/Connector.php:70 Please use the argument -v to see more details.このエラーが発生した場合は

my.cnfを作成する前にdocker-compose up -dでビルドしてしまった可能性が高いです。$ docker-compose down --volumes --rmi all $ docker-compose up -d --build設定ファイルがない状態でMySQLの初期化が行われたでデータが永続化されてしまってるので一度ボリューム毎削除してビルドし直せばokです。

docker volumes の共有で Permission denied (SELinux) 問題

CentOS 等の場合 volumes でホストと共有したファイル(ディレクトリ)にアクセスできないことがあります。

書き込み権限を与える

$ chmod -R 777 logs $ chmod -R 777 src/storage/logsログディレクトリはホスト側からもコンテナ側からも書き込みするので、書き込み権限を付与しておきましょう。

応用

より実用的な構成のdocker構成の記事を書いてますので、よかったらこちらの記事も読んでもらえると嬉しいです。

- 投稿日:2020-12-06T21:30:48+09:00

【Docker】環境構築

環境

- Ruby: 2.6.0

- Rails: 6.0.3

- MySQL

- MacOS

Dockerの要約

Dockerとは?

Docker Engineを常駐させることで、ゲストOSを使用せず、ホストOSを基盤にミドルウェア以降を仮想環境(コンテナ)として起動する仕組み。- ミドルウェア等の層をimageと呼び、

Docker Hubで公開されている構成を流用したり、Dockerfileを用いて自身で新規作成する事もできる。docker-compose.ymlに複数のコンテナ構成を記述することでこれらを一括起動できる。- 流動データはコンテナ削除とともに消えるため、残したい場合にはホストのデータをコンテナにマウントする必要がある(

docker-compose.ymlに記述)。手順

1. Dockerfile・docker-compose.yml作成

FROM ruby:2.6.5 RUN apt-get update -qq && apt-get install -y build-essential libpq-dev nodejs WORKDIR /myapp COPY Gemfile /myapp/Gemfile COPY Gemfile.lock /myapp/Gemfile.lock RUN gem install bundler:2.0.2 && bundle install COPY . /myapp[FROM] 使用するイメージとバージョン

[RUN] コマンドの実行

[WORKDIR] 作業ディレクトリ

[ADD] ファイルをコンテナへコピー

[EXPOSE] port番号

[CMD] イメージ内部のソフトウェア実行(ここではRailsを指す)docker-compose.ymlversion: '3' services: db: image: mysql:5.6 environment: MYSQL_ROOT_PASSWORD: password MYSQL_DATABASE: root volumes: - mysql-data:/var/lib/mysql ports: - "3306:3306" web: tty: true stdin_open: true build: . command: /bin/sh -c "rm -f tmp/pids/server.pid && bundle exec rails s -p 3000 -b '0.0.0.0'" volumes: - .:/myapp ports: - "3000:3000" links: - db volumes: mysql-data:dbボリュームを設定しコンテナを終了してもデータをボリューム内に残すための記述。

appボリュームを設定しローカルにあるディレクトリをコンテナにマウントするための記述。

コマンドの/bin/sh -c "rm -f tmp/pids/server.pidに関しては、Pidファイル削除のために記述。起動時に残っているとエラーを吐くため削除が必要。自分で削除しても良いが、これを書けば起動時に自動で削除するようになる。2. database.yml

database.ymldefault: &default adapter: mysql2 encoding: utf8 pool: <%= ENV.fetch("RAILS_MAX_THREADS") { 5 } %> username: root password: password host: db3. エラーへの対処

trueをfalseに変更すると正常に動作する。

厳密な整合性のチェックをオフにする事でエラーを回避しているようです。

記述時点では、アプリケーション動作に問題は発生していません。======================================== Your Yarn packages are out of date! Please run `yarn install --check-files` to update. ========================================webpacker.yml# Verifies that correct packages and versions are installed by inspecting package.json, yarn.lock, and node_modules check_yarn_integrity: false以上

- 投稿日:2020-12-06T20:33:02+09:00

WSL2 のDocker for Windowsで動作が重い時の原因と対処方法

問題:WSL2のDocker for Windowsの動作が重い・・・

Windows10 Homeの環境に、WSL2でDocker for Windowsがインストールできるようになって、よかったなぁと思って使っていたら、Dockerコンテナの動作が遅かったり、Docker buildコマンドでイメージ作成がにやたらと時間がかかったりするようで、なんだかおかしいなと思っていました。

原因:WindowsとWSL2(Ubuntu)のファイルシステム変換処理に時間がかかっていた。

これまで、ソース群をWindowsの「C:\Source\Project」みたいなところに入れてました。WSL2(Ubuntu)では、この場所は「/mnt/c/Source/Project」に該当します。

実はこのように「/mnt/」以下の場所は、WindowsのファイルシステムからWSL2(Ubuntu)のファイルシステムに変換かける処理が発生するようで、このために動作がめっちゃ遅くなってたようです。対処方法:ソース群をWindowsファイルシステム配下のフォルダから、WSL2(Ubuntu)ファイルシステム配下のフォルダに移動させる。

WSL2とDocker for Windowsがこの問題を解決してくれたら良いのですが、まだ対応方法がないようです。

現状のベストプラクティスとしては、ソース群をWindowsファイルシステムである「/mnt/」以下に配置せず、WSL2(Ubuntu)のファイルシステム管理下のフォルダに配置して、Dockerを動作させることみたいです。私の場合Ubuntuのbashで、 mvコマンドを使い、「mv /mnt/c/Source/Project /home/username/Source」みたいなコマンドで、ソース群を「/home/username」配下に配置しました。

このファイル移動はファイルシステム変換があるため、かなり時間がかかります。ファイル移動の後、Dockerコンテナを起動して動作を確認したところ、軽くなっていました。

また、Docker buildコマンドでイメージ作成したところ、COPYコマンドがめっちゃ早くなり、使用上耐えられるまでのビルド速度になりました。ファイル操作とGit操作にはVisual Studio codeを使う。

Windowsファイルシステム配下のフォルダから、WSL2(Ubuntu)ファイルシステム配下のフォルダに移動するということは、WindowsのGUIでどうやって使うようにするかが問題になります。

Windowsのエクスプローラーで使いたい場合は、パスに「\wsl$」を入れると、ネットワークフォルダとして表示させることができます。

しかしエクスプローラーでは、ファイルシステム変換がかかるため、1つ1つのファイルを操作するにはいいですが、まとめてファイルを操作するときに、アプリによっては激重だったりエラーになったりするようです。GitのGUIクライアントとしてSourcetreeを使っていましたが、この場合もファイルをまとめて操作するので、動作が重くならないか心配です。

おすすめな方法としては、ファイル操作とGit操作にはVisual Studio codeを使います。

https://azure.microsoft.com/ja-jp/products/visual-studio-code/①「Remote Development」プラグインで「Remote WSL」プラグインを入れる。

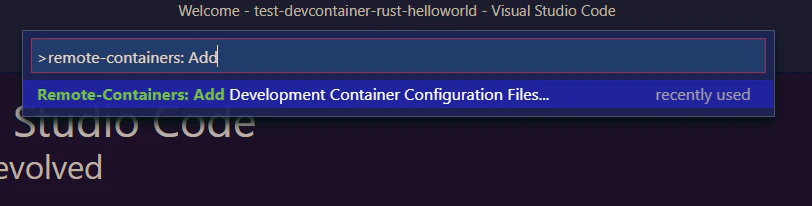

Visual Studio codeに「Remote Development」というプラグインを入れると「Remote WSL」というプラグインが入ります。

https://code.visualstudio.com/blogs/2019/05/02/remote-development

こちらをつかうと、WSL2(Ubuntu)配下のファイル群にアクセスして、自由にファイルを操作したり、編集して開発できるようになります。②「Git History」プラグインを入れる。

Visual Studio codeでは標準で基本的なGit操作ができますが、標準ではGitログ履歴がありません。

Visual Studio codeに「Git History」というプラグインを入れると、Sourcetreeのように、Gitのログ履歴をみながらGit操作ができるようになります。

https://marketplace.visualstudio.com/items?itemName=donjayamanne.githistory③WSL2(Ubuntu)でGitHubにアクセスするためのキーペアを作ってGitHubに登録する

Visual Studio codeのWSLでは、「/home/username/.ssh/」配下にある、下記のファイルがGitへのアクセス情報として使われますのでWSL2(Ubuntu)でキーペアを作って、GitHubに登録しておきましょう。

そうすると、Visual Studio codeのWSLでもGitHubを使えるようになります。/home/username/.ssh/id_rsa

/home/username/.ssh/id_rsa.pub

/home/username/.ssh/known_hostshttps://docs.github.com/ja/free-pro-team@latest/github/authenticating-to-github/generating-a-new-ssh-key-and-adding-it-to-the-ssh-agent

(Linuxを参考にやってみてください)

- 投稿日:2020-12-06T19:49:27+09:00

left4dead2サーバー用のDockerイメージを作り、GCE上で動かしてみた #1(使い方編)

はじめに

コンテナ(Docker)について学んだため、何かアウトプットしたいと思いl4d2用のサーバーのコンテナを作成し、googleが提供するIaaSであるGoogle Compute Engine上で動かしてみました。

今回は#1ということで、作成したコンテナの使い方を紹介します。

「コンテナなんて使ったことない、鯖なんて立てたことないよ」という人でも立てられることを目指しました。以下は記事を読み進めるにあたっての留意いただきたい事項です。

- 今回は「とりあえず」使えるサーバーを構築してみることが目的なので、dockerfileの中身がイマイチです(この詳細は、別途記事(#2)を作って説明します)。この点はご容赦ください。

- #1は「使い方編」ですが、#2で「コンテナ作成の過程で得た知見編」、#3, 4で「サーバー構築までで苦労したこと編」を書く予定です。

使い方

1. GCE上の基本設定(登録からファイアウォール設定まで)

まずはGCEのコンソール画面を開きます(今回はGUIを使います)。

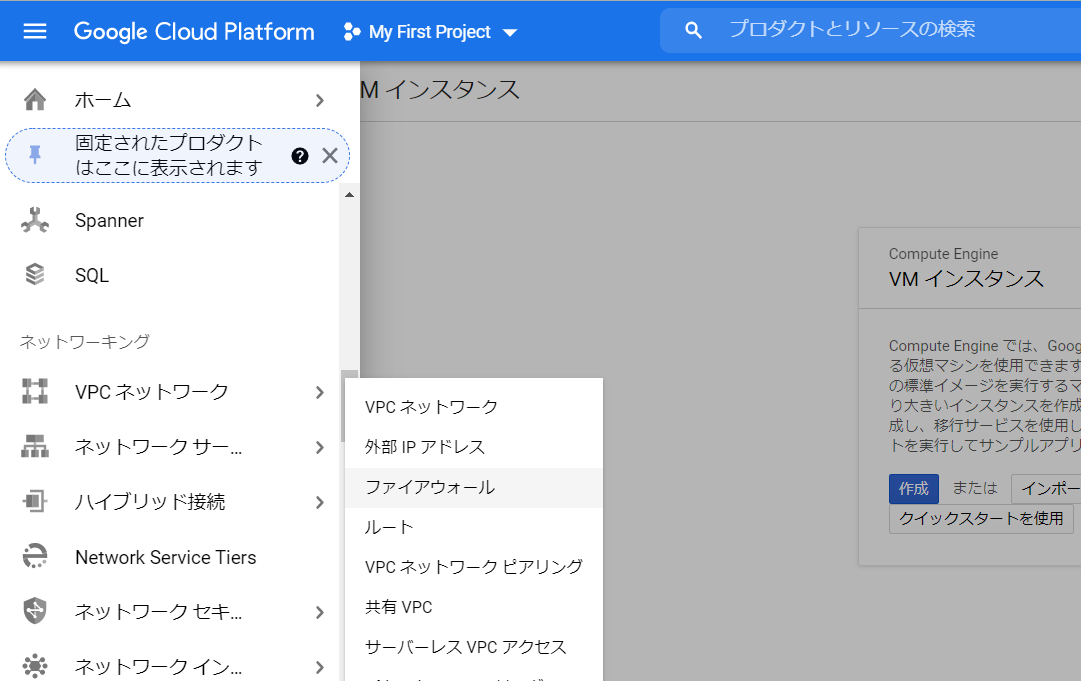

初めての方は「無料トライアル」を選択して登録を行います(2020/12時点で無料トライアル$300, 90日間が利用可能)。最初にファイアウォールの設定をします。l4d2はデフォルトで27015番ポートを使用するので接続を許可する必要があります。

画面左上にあるGCPのナビゲーションメニューを選択し、ネットワーキングの項目のVPCネットワーク、ファイアウォールを選択します。

次に、「ファイアウォール ルールの作成」を選択し、任意の名前を設定してターゲットタグ(ここではl4d2とします)、ソースIPの範囲(どこからでも繋げられるよう、0.0.0.0/0を設定)、指定したプロトコルとポート(TCP, UDPの27015を許可)の3つを入力します。

2. GCE上の基本設定(インスタンス起動まで)

次に、再びナビゲーションメニューを選択し、コンピューティングの項目のCompute Engine(GCE)、VMインスタンスを選択します。そしてVMインスタンスの作成を選択。

インスタンスの名前は任意で問題無く、リージョンは近いところ(東京)を選んでおけば大丈夫です。

マシンタイプは2vCPU, 8GBメモリにします(4GBでも動くと思いますが、極端に遅いような気がしたので8GBにしています)。

コンテナイメージのデプロイを選択し、コンテナイメージを入力(ここでは、今回dockerイメージのリポジトリをdocker hub上に作成しているので、「ekarunian/l4d2-server:1.0」を入力します。

ブートディスクはデフォルトだと10GBですが、コンテナが重いので30GBを選択します(25GBはダメでした)。

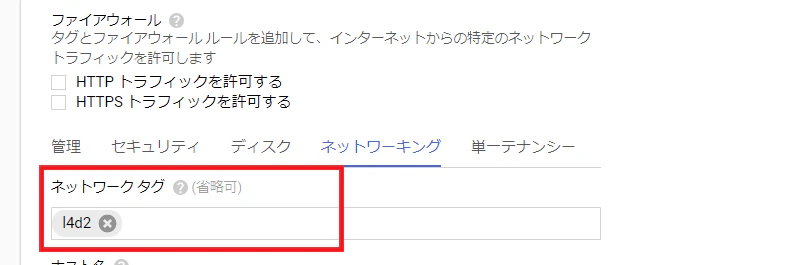

下にスクロールして、「管理、セキュリティ、ディスク、ネットワーキング、単一テナンシー」の折りたたみメニューを展開し、ネットワーキングタブのネットワークタグにファイアウォール設定で設定したターゲットタグ(l4d2)を入力します。これでこのインスタンスは27015ポート(TCP/UDP)を許可します。

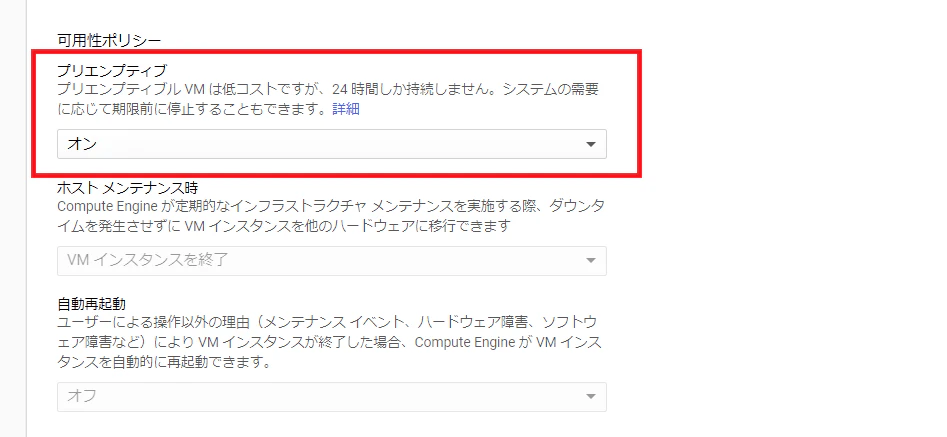

次に管理タブを選択し、プリエンプティブをオンにします。

今回は友人と一日だけ遊ぶような場合を想定しており24時間でインスタンスが消えても大丈夫なので、これを選択します(いないと思いますが、24時間以上遊ぶ場合はオフにします)。

これを設定するとサーバーコストが下がります。今までの設定をプリエンプティブオフで作成すると1時間に約\$0.087(2020/12/06時点)かかりますが、オンでは1時間に約$0.027(同日時点)となります。

ここまで設定したら一番下の「作成」を選択し、インスタンスを起動します。

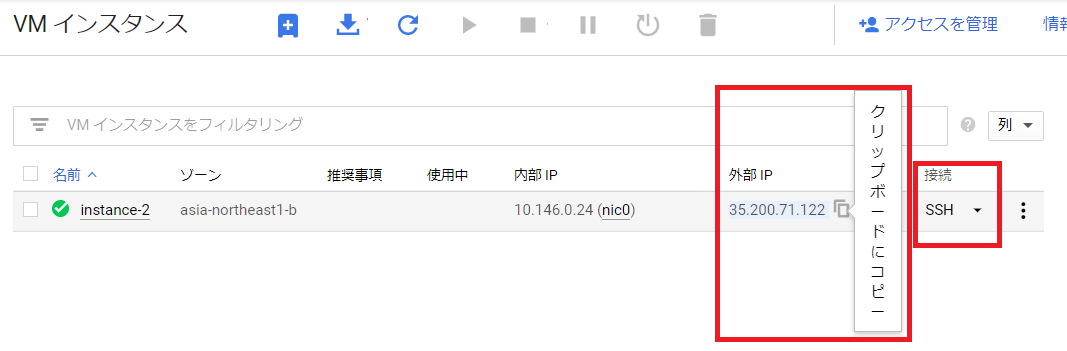

しばらくすると、以下のような画面が出ると思いますので、外部IPを控えておいてください(サーバーに接続するのに必要です)。また、SSH接続を選択してターミナルに接続します。

(今回、外部IPは固定していないので特に隠していません)3. インスタンス内での操作(コンテナ、サーバー起動まで)

インスタンスを起動(して、ターミナルにssh接続)したら、数分待ちます。

ターミナルに「docker images」と入力し、下記のように「ekarunian/l4d2-server」がリポジトリにあればOKです。(GCE上の)ローカルにあるdockerイメージの一覧ekaru2an@instance-2 ~ $ docker images REPOSITORY TAG ekarunian/l4d2-server 1.0 gcr.io/gce-containers/konlet v.0.11-latest gcr.io/stackdriver-agents/stackdriver-logging-agent確認出来たら、「docker run -it -p 27015:27015 -p 27015:27015/udp --name l4d2 ekarunian/l4d2-server:1.0 bash」でコンテナを起動します。

-pオプションでサーバーからコンテナへポートの転送設定(今回はクライアントからの送信がデフォルトで27015なので、サーバー側(コロンの前)を27015にしています。コンテナ側もこれに合わせています。)を行い、bashを対話型で実行します。

最初は反応がないですが、少しすると下記のように2行目が出てきます。コンテナを起動ekaru2an@instance-2 ~ $ docker run -it -p 27015:27015 -p 27015:27015/udp --name l4d2 ekarunian/l4d2-server:1.0 bash steam@534a1f30218e:~/l4d2server/left4dead2$ここに「../srcds_run -game left4dead2 +map c1m1_hotel coop」を入力してエンターを押下すると色々メッセージが出て(エラーメッセージも含まれておりますが、問題ありません)、下記の2行が出ればサーバー起動成功です。

ゲームサーバーを起動steam@534a1f30218e:~/l4d2server/left4dead2$ ../srcds_run -game left4dead2 +map c1m1_hotel coop ---(省略)--- Connection to Steam servers successful. VAC secure mode is activated.「c1m1_hotel coop」は起動時のマップ指定となり、ここでマップを変更できます。

例えば、Left 4 Dead 2 Dedicated Server Guideの下部にマップ名が列挙されております。

また、サーバー起動後はこの画面でl4d2のコンソール機能がadmin権限で使えます。例えば「god 1」などとすれば無敵になります(ただし、ゲーム中はログが爆速で流れるので注意が必要です)。

チートコマンドはwikiなどを参考にしてください。

サーバーを閉じるときは「exit」などを入れれば終了します。4. ゲーム側の設定(部屋に入るまで)

ここからはl4d2ゲーム側の設定です。l4d2を起動したら、設定->キーボード/マウス->開発者コンソールを許可 を有効にします。

有効にすると、"`" キーまたは "半角/全角" キーでコンソールを表示できるようになります。

コンソールを表示したらGCEのインスタンス作成時に控えた外部IPを利用し、以下を入力してサーバーを有効にし、connectでサーバーに入ります。

これで、先ほど「../srcds_run・・・」で設定したマップに入れます。コンソール画面に以下を入力mm_dedicated_force_servers [インスタンスの外部IP] connect [インスタンスの外部IP]招待が出来ないので、友人側にも同様にコンソールを有効にしてもらい、「connect [インスタンスの外部IP]」を入力してもらうことで、一緒に遊ぶことが可能となります。

なお、本サーバーは知らない人が入りにくい設定にしておりますが、入れない設定ではないので注意してください(少なくとも、私は友人と3時間プレイして際は入ってきませんでした)。あとは、ゲームを楽しんで、終わったらサーバーを閉じてGCEインスタンスを停止したらおしまいです。

5. まとめ

今回は、誰でもl4d2 dedicatedサーバーが構築できることを目指してコンテナの作成、Qiita記事の作成をしました。結果、1時間3円程度のサーバーが構築できました。

「この手順に従ってもおかしなことが起きたよ」などがありましたらコメントいただけますとありがたいです。また、今更言うなという感じですが、今回起動したサーバーは通常設定のサーバーではなく、色々な設定をハチャメチャに弄っております(通常設定のサーバーならローカル環境でもつくれるので。。。)。

どうなっているのかは実際に遊んで確認してみてください。

ちなみに、下記のサイトを参考に、色々なプラグインを入れております。

- 涼月蒼菜様のブログ「気まま研究所」の記事:Left 4 Dead 2 Dedicated サーバの建て方

- ztar様のブログ「SunriseBlue」の記事:L4D2でうごく!自作(改造)プラグイン置き場

その他、今回のdockerfileはsteamCMDのdockerイメージをベースに作成しております

今後やりたいこと

- 今回はdockerfileだけでゴリ押してしまったので、サーバー設定を容易に変更できるようコンテナを綺麗にし直す(優先度:高)。

- #2で詳細を記載しますが、もう少しクレバーな見た目になるようにdocker-composeを作りつつ再整理します。

- アドオンマップ等modの導入(優先度:高)

- これはl4d2 dedicated serverの設定を変えるだけなのでそんなに難しくない(はず)

- ゲームプレイ中にサーバーへ生じた変更をGCSにバックアップする仕組みを作る(優先度:中)