- 投稿日:2020-12-23T23:55:03+09:00

Pythonでtwitterでいいねしたツイートにある画像を収集するプログラムを作ってみた

この記事はAkatsuki Advent Calender 2020の23日目になります

はじめに

運用して2~3年経っているのですが記事にしておらず今回いい機会なのですることにしました。

まず事の経緯として

twitterを覗いていると収集したい画像が回ってくることがあります。

そこでいちいち右クリック->ダウンロード->パス指定は非常に面倒だしそういうツイートが連続で来たら?となるとやってられません。そこで何かしらトリガーがあって自動でダウンロードしてくれないかなと。

それで閲覧する用のwebページがあれば完璧ではないかと。

そんな訳で収集欲と技術欲半々のなか作ることにしました。今回は収集のところだけ。

(それpixivとかで良くない?とか思うかもしれないですが

自分の欲しいやつだけ閲覧できるものが欲しいんです・・・)要件

・RTではなくいいねのツイートのみダウンロードすることに。

いいねだとクリック手順が1つ少ないので速攻次のツイートに移れる

・収集はレンタルサーバーか何かで行う

自宅に常時つけるPCはないので、収集タイミング時につけてないといけないのは利便性が悪い。

・実装当時はstreaming apiが生きていたのでそれでリアルタイムでいいねツイートを取得

-> なくなったのでrest apiで時間をおいて取得する方にしました。

・ツイート内容やURL、@ IDなどもwebページでの検索用として保存しておく開発環境

レンタルサーバー

・さくらサーバー言語

・python3.6使用ライブラリ

・requests_outhlib

・mysql.connectorTwitter Devへの登録

https://developer.twitter.com/

こちらで登録を行っておき、認証を通せるようにしときます。実装へ

ところどころ省略しています

1. セッションの生成

twitter developerにてappを作っておく。

そこでKey And Tokenのタブに認証に必要なKeyとTokenがあるのでコピーしておきます。requests_outhlibにてセッションを作る際は

以下のコードで先程のKeyとTokenを指定します。twitter_session = OAuth1Session(consumerKey , consumerSecret , accessToken , accessSecret)2. APIの結果取得

https://developer.twitter.com/en/docs/twitter-api/v1/tweets/post-and-engage/api-reference/get-favorites-list

今回使ういいねAPIについてはこちらコードでは以下のように使用します

#APIのResources URLと渡すパラメータを指定 #パラメータは上のページに載っていますが今回は以下の2つをメインで使います #screen_name:@で表記するid 本来はuser_idを指定するのが確実ですが、収集アカウントは変える予定ないのでこれで #count:一度に取得するツイート数 (max:200) request = twitter_session.get("https://api.twitter.com/1.1/favorites/list.json", params = {"screen_name":ID, "count":200}) #古いのツイートを取得したい場合 パラメータに以下を追加します #tweet_idよりも前のツイートを取得するようになります。指定なしで最新のツイートからになります "max_id":tweet_id結果はjsonで返ってきます。

status_codeでエラーかどうか判別。request.textにjsonのデータが有るためjson.loadsでjsonに変換しておきます。if request.status_code == 200: print("rest connect") else: print("rest Error code%d", request.status_code) return "" tweets = json.loads(request.text)またこれを実行する際も以下の制限に気をつける必要があります

・75リクエスト/15分

・取得されるツイートの順番はいいねした順番ではなくいいね先のツイート日時が新しい順に取得されます

なので古いツイートを取得する場合は工夫する必要があります3. jsonデータを元に画像を取得

先程取得したtweets変数にはツイートが配列が入っているためfor文で1つずつ処理が可能です

for tweet in tweets: #ツイートから情報を取得 #ツイートのID 一番最後のtweet["id"]を上で説明したtwitter_session.getのmax_idに指定することで #次のリクエストで取得する結果がかぶることなく処理できます tweet["id"] #表示する名前 tweet["user"]["name"] #@id tweet["user"]["screen_name"] #画像一覧 (URL) tweet["extended_entities"]["media"] #ツイート文 tweet["text"] #ツイートURLは以下の組み合わせで "https://twitter.com/"+tweet["user"]["screen_name"]+"/status/"+tweet["id_str"]今回は画像一覧なので

#画像一覧 (URL) image_list = tweet["extended_entities"]["media"]これを使います。

これも配列としてやってくるのでfor文で処理します

色々と省略はしていますが基本的にこれでダウンロード後保存を繰り返しています。for image in image_list: url = image["media_url"] img = urllib.request.urlopen(url, timeout = 5).read() f = open(path, 'wb') f.write(img) f.close()流れとしては以下の通り

・セッション作成

・リミットまでgetリクエスト75回ループ

・取得ツイートの画像を取得

・取得ツイートの最後のツイートIDを保持してリクエスト時に渡すもし古いツイートを取得する場合は定期的に全いいねを見ていくのが良いかと

4.レンタルサーバーでCRON設定

今回はリクエストが15分ごとに制限があるのでそれに合わせてCRONを設定します

これでいいね自動収集化完了ですが

web上で閲覧・検索をするのであればDBにツイートの情報保存したりする必要があります。最後に

この後、DBやwebページは適宜設定して閲覧はできたのですが、

正直ほとんど見てません。収集とプログラムが動いたのでそこができただけで満足しちゃいました。

とはいえ学習するための題材としてはなかなか良かったと思います。スクリプト言語全然触っていなかったのと

自動化への興味が湧いた一番の作品?だったので。いいねの回数は

1 5 万 い い ね

自分でもこの人イカれてますねと思いました。自分だけど・・・もっと良いシステムを作るとするならば機械学習で収集する画像も自動化が一番いいのですが、一度やろうとしたところ

収集したい画像の判定がめちゃんこ難しくて諦めました。自分の好みを落とし込まないといけない難易度高い・・・

学習のための画像はあるんですけどね・・・・・

- 投稿日:2020-12-23T23:41:50+09:00

オブジェクトストレージ Cloudian/S3 にJSON形式のデータを書き込みしてみます

はじめに

AWS SDK for Python(boto3) を使って、プログラムをほぼ変更せずに Cloudian と S3 へのアクセスが可能となります。オブジェクトストレージをハイブリッド(オンプレミス:Cloudian、AWS:S3)で使いたい方への参考になればと、、、

概要

オブジェクトストレージ Cloudian/S3 上のバケット名「boto3-cloudian」に、JSON形式のデータを書込む Python プログラムです。

生成するJSON形式のデータ件数はパラメータで指定でき、ファイル「test-iot-dummy.json」に書き込まれます。プログラムをカスタマイズすることにより、なんちゃってIoTデータ生成として使えるかもと想定しております。生成されるデータ項目についてはプログラム内の「items」を参照ください。

- パラメータは以下の3種類となります。

- --count : 生成するデータ件数(デフォルト:10件)

- --proc : 生成するプロセス名(デフォルト:111)

- --mode : 生成データの出力先の指定 tm:ターミナルへの出力、 s3:Cloudian/S3への出力(デフォルト:tm)

プログラム実行時に、パラメータ「-h」を指定することにより表示されるヘルプも参照ください。

実行環境

macOS Big Sur 11.1

python 3.8.3クレデンシャル情報の定義

今回はクレデンシャル情報を .zshenv に定義してプログラムを実行しています。接続先に合わせて定義ください。

# AWS S3 export AWS_ACCESS_KEY_ID=xxxxxxxxxxxxx export AWS_SECRET_ACCESS_KEY=yyyyyyyyyyyyyyyyy export AWS_DEFAULT_REGION=ap-northeast-1 # Cloudian #export AWS_ACCESS_KEY_ID=aaaaaaaaaaaaaaaaaa #export AWS_SECRET_ACCESS_KEY=bbbbbbbbbbbbbbbbbbbb #export AWS_DEFAULT_REGION=pic実行プログラム

Cloudianへアクセスする場合は endpoint_url を記載ください(プログラム内を参照ください)。

IoTSample-write.pyimport random import json import time from datetime import date, datetime from collections import OrderedDict import argparse import string import boto3 import pprint from faker.factory import Factory BUCKET_NAME = 'boto3-cloudian' OBJECT_KEY = 'test-iot-dummy.json' # ダミーデータ作成のための Faker の使用 Faker = Factory.create fake = Faker() fake = Faker("ja_JP") # IoT機器のダミーセクション(小文字アルファベットを定義) section = string.ascii_uppercase # IoT機器で送信JSONデータの作成 def iot_json_data(count, proc): iot_items = json.dumps({ 'items': [{ 'id': i, # id 'time': generate_time(), # データ生成時間 'proc': proc, # データ生成プロセス名 'section': random.choice(section), # IoT機器セクション 'iot_num': fake.zipcode(), # IoT機器番号 'iot_state': fake.prefecture(), # IoT設置場所 'vol_1': random.uniform(100, 200), # IoT値−1 'vol_2': random.uniform(50, 90) # IoT値−2 } for i in range(count) ] }, ensure_ascii=False).encode('utf-8') return iot_items # IoT機器で計測されたダミーデータの生成時間 def generate_time(): dt_time = datetime.now() gtime = json_trans_date(dt_time) return gtime # date, datetimeの変換関数 def json_trans_date(obj): # 日付型を文字列に変換 if isinstance(obj, (datetime, date)): return obj.isoformat() # 上記以外は対象外. raise TypeError ("Type %s not serializable" % type(obj)) # メイン(ターミナル出力用) def tm_main(count, proc): print('ターミナル 出力') iotjsondata = iot_json_data(count, proc) pprint.pprint(iotjsondata) # メイン(Cloudian/S3 出力用) def s3_main(count, proc): print('Cloudian/S3 出力') iotjsondata = iot_json_data(count, proc) # pprint.pprint(iotjsondata) # client = boto3.client('s3', endpoint_url='http://s3-pic.networld.local') # Cloudianへのアクセス時 client = boto3.client('s3') # S3へのアクセス時 client.put_object( Bucket=BUCKET_NAME, Key=OBJECT_KEY, Body=iotjsondata ) if __name__ == '__main__': parser = argparse.ArgumentParser(description='IoT機器のなんちゃってダミーデータの生成') parser.add_argument('--count', type=int, default=10, help='データ作成件数') parser.add_argument('--proc', type=str, default='111', help='データ作成プロセス名') parser.add_argument('--mode', type=str, default='tm', help='tm(生成データをターミナル出力)/ s3(生成データをCloudian/S3出力)') args = parser.parse_args() start = time.time() if (args.mode == 's3'): s3_main(args.count, args.proc) else : tm_main(args.count, args.proc) making_time = time.time() - start print("") print(f"データ作成件数:{args.count}") print("データ作成時間(通常_API):{0}".format(making_time) + " [sec]") print("")プログラムの実行

最初にヘルプを表示してみます。

$ python IoTSample-write.py -h usage: IoTSample-write.py [-h] [--count COUNT] [--proc PROC] [--mode MODE] IoT機器のなんちゃってダミーデータの生成 optional arguments: -h, --help show this help message and exit --count COUNT データ作成件数 --proc PROC データ作成プロセス名 --mode MODE tm(生成データをターミナル出力)/ s3(生成データをCloudian/S3出力)次に、10万件のデータを生成し、それをターミナル出力してみます

$ python IoTSample-write.py --count 100000 : 出力内容は割愛 : データ作成件数:100000 データ作成時間(通常_API):4.5370988845825195 [sec]今度は実際に Cloudian/S3 に10万件のデータを生成してみます。

$ python IoTSample-write.py --count 100000 --mode s3 データ作成件数:100000 データ作成時間(通常_API):2.7221038341522217 [sec]まとめ

今回は、AWS SDK for Python(boto3) を使って、オブジェクトストレージ Cloudian / S3 へデータを生成することを確認できました(10万件のデータを数秒で作成完了(もちろん環境に依存します))。

Cloudianについては、ここ を確認ください。

- 投稿日:2020-12-23T23:34:20+09:00

[Python] 区間スケジューリング ABC103D

ABC103D

下図のようにすべて串刺しにするには、最小何本必要か、という問題である。

区間スケジューリング問題とは以下のような問題である:M 個の区間が与えられ、どの 2 つの区間も時間帯を共有しないように最大個数の区間を選べ

蟻本の Greedy の章の最初にも載っている有名問題で、区間の終端でソートして Greedy にとっていけばよい。

実は今回の問題の答えは、区間スケジューリング問題の最適解と同じになる:

- まず区間スケジューリング問題の答えが k 個だった場合、その k 個は時間帯を共有しないので、それらを全部刺すには最低でも k 本の串が必要である (弱双対性)

逆に k 本の串があれば十分であることは、区間スケジューリング問題に対する貪欲法の動きを注意深く追うと理解することができる。具体的には、

- 区間スケジューリング問題で選ぶ k 個の区間に対して、その右端から串を刺していけば、ちょうど k 本の串ですべての区間を串刺しにできる (強双対性)

サンプルコードfrom operator import itemgetter n, m = map(int, input().split()) # 区間の終端でソート ab = sorted([tuple(map(int, input().split())) for i in range(m)], key=itemgetter(1)) # 前回除いた橋 removed = -1 ans = 0 for a, b in ab: # a が removed より大きい = まだ取り除いてない if a > removed: removed = b - 1 ans += 1 print(ans)

- 投稿日:2020-12-23T22:58:06+09:00

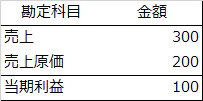

statsmodelsでホールドアウト検証を実装する

はじめに

pythonでは,ロジスティック回帰モデルを利用できるライブラリとして主にsklearnとstatsmodelsが用いられます.statsmodelsには係数の有意差検定を自動でしてくれる等のsklearnにはない利点がある一方で,代表的なモデルの評価方法であるホールドアウト法や交差検証法に対応していません.そこで今回は,statsmodelsでホールドアウト法を実装するためのコードを作成してみます.

ライブラリのインストール

sample.ipynbimport numpy as np import pandas as pd from sklearn.model_selection import train_test_split from sklearn.model_selection import StratifiedKFold import statsmodels.api as smデータのインストールと前処理

データには,私が卒業研究のために独自に集めたクラウドファンディングに関するデータを用います.

このデータは私のgithubページに置いているので必要なら自分の環境にダウンロードしてください.sample.ipynb#csvファイルの読み込み cultured = pd.read_csv("cultured.csvへのpath") #目的変数を作成 0:クラウドファンディング失敗 1:クラウドファンディング成功 cultured["achievement"] = cultured["支援総額"] // cultured["目標金額"] cultured["target"] = 0 cultured.loc[cultured['achievement']>=1,'target'] = 1 #目的変数(y)と説明変数(x)に分ける #add_constantで定数項を作成 y = cultured["target"] x_pre = cultured[["目標金額","支援者数","文字数","活動報告回数"]] x = sm.add_constant(x_pre)このデータは,説明変数である目標金額,支援者数,文字数,活動報告回数からクラウドファンディングプロジェクトが成功(y=1)か失敗(y=0)かを予測するためのものです.sklearnのロジスティック回帰では,定数項を勝手に生成してくれますが,statsmodelsにはその機能はないのでadd_constant()を用いて生成しています.

説明変数は(x)はこんな感じです.

実装(この記事のメイン)

sample.ipynb#ホールドアウト法 def hold_out(x,y): #データを訓練データとテストデータに分割 #test_sizeはデータ全体に対するテストデータの割合 X_train, X_test, y_train, y_test = train_test_split(x,y,test_size=0.2,random_state=42) #訓練データを用いて学習 model = sm.Logit(y_train, X_train) results = model.fit() #テストデータに対する予測をpredに格納 #ただし出力値は目的変数が1になる確率(今回だと成功確率)なので注意 pred = results.predict(X_test) #確率が0.5より大きいものを1に,それ以外を0に変換 #リスト内表記を利用 result = [1 if i>0.5 else 0 for i in pred] #train_test_splitでインデックスの順番がめちゃくちゃなので振り直す y_test_re = y_test.reset_index(drop=True) #カウントに初期値を格納 count=0 #y_testと予測値の値が一致するならばcountに1を足す for i in range(len(y_test)): if y_test_re[i] == result[i]: count+=1 #戻り値は予測の精度 return count/len(y_test)結果

sample.ipynbhold_out(x,y)関数を実行すると...

私の環境だと0.878でした!

- 投稿日:2020-12-23T22:49:27+09:00

Unix Domain SocketによるuWSGIとNginxの通信

本記事は東京学芸大学 櫨山研究室 Advent Calendar 2020の16日目の記事になります.

はじめに

本記事はPythonのWebフレームワークであるflaskで作成したアプリケーションをuWSGIサーバを使って動作させる内容を通してUnix Domain Socket通信について学ぶという内容になります.

Unix Domain Socketとは

Unix Domain SocketはPOSIX系のOSに搭載されている機能でTCP/UDPによるソケット通信とは異なり,カーネル内部で完結する高速なネットワークインタフェースを作成します.

カーネル内部で完結するため外部のコンピュータとは接続することはできません.flaskのアプリケーションの作成

エンドポイント

/でアクセスしてHello, Worldとだけ返す簡単なアプリケーションを作成します.app.pyfrom flask import Flask app = Flask(__name__) @app.route("/") def index(): return "Hello World" if __name__ == "__main__": app.run(host="0.0.0.0", debug=True)そして以下のコマンドを実行することでアプリケーションが起動します.

この時,起動には開発用の組み込みサーバが立ち上がります.python app.pyhttp://localhost:5000/

にアクセスしてHello, Worldと表示されれば成功です.uWSGIを使って動かす

先ほどの例では開発用の組み込みサーバを使用していました.

PythonにはアプリケーションサーバとしてuWSGIがあります.

uWSGIではUnix Domain Socketでの通信がサポートされています.まずは

uWSGIを使って先ほどのアプリケーションを動作させてみます.pip install uWSGIapp.pyfrom flask import Flask app = Flask(__name__) @app.route("/") def index(): return "Hello World" if __name__ == "__main__": app.run()

uWSGIで先ほどのアプリケーションを起動するには以下のコマンドを入力します.uwsgi --http=0.0.0.0:4000 --wsgi-file=app.py --callable=apphttp://localhost:4000/

にアクセスしてHello, Worldと表示されれば成功です.

uwsgi.iniという設定ファイルを作成することでより短いコマンドで起動することも可能です.uwsgi.ini[uwsgi] wsgi-file=app.py callable=app http=0.0.0.0:4000uwsgi uwsgi.iniNginxの導入

さてここからが本題のUnix Domina Socketでのアクセスです.これまでの起動方法ではHTTP通信(TCPソケット)でのアクセスでした.

実際に運用する場合は同一サーバで複数のアプリケーションを動作させることを考慮しNginxをリバースプロキシとする場合が多いでしょう.

この時,同一サーバ内の通信であればUnix Domain Socketを使ってHTTP通信よりも高速にアクセスすることができます.今回は便宜的にDockerを用いて動作させてみます.

uwsgi.iniの編集

uwsgi.iniを編集してUnix Domain Socketで通信するようにします.

Unix Domain Socketではファイルシステム上の指定した位置にソケットファイルができます.

クライアントはソケットファイルにアクセスを試みます.

つまりIPアドレスとポート番号ではなくファイルパスによって通信相手を決めます.今回は

/var/app/app.sockというソケットファイルを作成するようにします.uwsgi.ini[uwsgi] wsgi-file=app.py callable=app http=0.0.0.0:4000 # 追記 socket=/var/app/app.sockDocker環境の準備

まずは先ほどのflaskのアプリケーションを動作させる環境を用意する

Dockerfileを用意します.DockerfileFROM python:3.7 ENV LANG C.UTF-8 ENV TZ Asia/Tokyo WORKDIR /app ADD app.py ./ ADD uwsgi.ini ./ RUN pip install flask uWSGI CMD ["uwsgi", "uwsgi.ini"]

nginxも動かしたいのでdocker-compose.ymlを用意します.docker-compose.ymlversion: '3.7' services: app: container_name: uds_app build: context: . dockerfile: ./Dockerfile volumes: - ./tmp/:/var/app/ tty: true nginx: container_name: uds_nginx image: nginx volumes: - ./tmp:/var/app/ - ./nginx.conf:/etc/nginx/conf.d/default.conf ports: - 80:80 tty: trueここで重要なのはホストマシン上の

./tmpディレクトリをflaskアプリケーションコンテナとNginxコンテナの両方と共有していることです.

- ホストマシン上の

./tmpディレクトリ ←→ flaskアプリケーションコンテナの/var/appディレクトリ- ホストマシン上の

./tmpディレクトリ ←→ Nginxコンテナの/var/appディレクトリこれによりNginxコンテナからもソケットファイルを参照できます.

Nginxの設定ファイルを記述し

/へのアクセスをflaskのアプリケーションを呼び出すようにします.nginx.confserver { listen 80 default_server; listen [::]:80 default_server; server_name _; location / { include uwsgi_params; uwsgi_pass unix:/var/app/app.sock; } error_page 404 /404.html; location = /404.html { } error_page 500 502 503 504 /50x.html; location = /50x.html { } }

docker-compose upコマンドで起動してみましょう.docker-compose uphttp://localhost/

にアクセスして先ほどと同様にHello, Worldの文字列が確認できれば成功です.おわりに

本記事ではflaskで作成したアプリケーションにリバースプロキシのNginxからUnix Domain Socketで通信するということを扱いました.

TCP通信と異なりファイルパスによって通信相手を決めるという部分が伝わればと思います.

また余裕があれば性能も調査してきたいですね.

- 投稿日:2020-12-23T22:48:35+09:00

Google Colab で Dash する

python のデータ可視化のフレームワークに Dash(https://dash.plotly.com/) があります。

これが Google Colab でも利用可能に、、とすでに解説されている良記事を見つけてしまいました。

https://qiita.com/OgawaHideyuki/items/725f4ffd93ffb0d30b6cということで、この記事は参考にさせていただいて自分の手を動かしました、という記録です。

お題は安直にコロナ感染者数の可視化です。使用する環境など

Google Colaboratory を使用します。

その他は下記です。

- Dash(https://dash.plotly.com/) グラフライブラリである plotly を使用して、インンタラクティブなデータ可視化画面を簡単に作れる python フレームワークです。

- Johns Hopkins 大学の国・地域別感染者データを使わせていただきます。 https://github.com/CSSEGISandData/COVID-19

今回のノートブックは下記に置いています。

https://colab.research.google.com/drive/1fUP4818fSsFFFlUHlLGNoTxq8uoL2VAu?usp=sharing実行準備とデータ

まず Google Colab/Jupyter ノートブックから Dash を使用するためのパッケージをインストールします。

! pip install jupyter_dash ! pip install --upgrade plotlyDash と関連するパッケージを import します。

import dash from jupyter_dash import JupyterDash import dash_core_components as dcc import dash_html_components as html import plotly.express as px from dash.dependencies import Input, Outputコロナの感染者データを GitHub から取得します。

データに関しては下記のページを参考にさせていただいています。

https://dodotechno.com/covd-19-visualization/! wget https://github.com/CSSEGISandData/COVID-19/raw/master/csse_covid_19_data/csse_covid_19_time_series/time_series_covid19_confirmed_global.csvデータフレームにダウンロードした csv を読み込みます。

import pandas as pd df = pd.read_csv("time_series_covid19_confirmed_global.csv")region ごとの集計、緯度経度の削除、国ごとの列に転換し、date 列の追加を行います。

df = df.groupby(['Country/Region'], as_index=False).sum() df.drop(["Lat","Long"], axis=1,inplace=True) df = df.T df.columns = df.iloc[0] df = df[1:] df.reset_index(inplace=True) df.rename(columns={'index': 'date'},inplace=True) df結果、得られる表は以下のようになります。

画面に表示してみる

まずは日本の感染者数を表示してみます。

第一波(4月下旬)、第二波(8月上旬)、第三波(11月)らしき増加が見えます。px.line(df, x="date", y="Japan")つづいて任意の国を選択可能にしてみます。

ノートブック上で選択できますので、試してみてください。

https://colab.research.google.com/drive/1fUP4818fSsFFFlUHlLGNoTxq8uoL2VAu#scrollTo=Kr-FsvLIpCoN&line=1&uniqifier=1app = JupyterDash(__name__) app.layout = html.Div([ dcc.Dropdown(id="my_dropdown", options=[{"value": country, "label": country} for country in df.columns.unique()], value=["Japan"], multi=True ), dcc.Graph(id="my_graph") ]) @app.callback(Output("my_graph", "figure"), Input("my_dropdown", "value")) def update_graph(selected_country): return px.line(df, x="date", y=selected_country) app.run_server(mode="inline")ドロップダウンから、日本とカナダを選択して表示します。カナダも増加傾向のようですね。

アメリカを追加して見ると、本当に日本の比ではないですね。。やはりグラフで見るとインパクトがあります。

ワクチンが有効打になって欲しいです(人ごとではありませんが)。おわりに

ちょっとした可視化なら簡単に実装でき、Google Colab でインターネット公開も容易です。

csv の加工が一番手間かも。

地図上の可視化なども追加してみたいと思います。

- 投稿日:2020-12-23T22:40:19+09:00

DjangoでCORSカスタムミドルウェアをつくった

この記事は、 岩手大学 Advent Calendar 2020 の24日目の記事です。

はじめに

個人開発でDjangoを使ったAPIをつくるときがありました。

そのとき、APIの実装でCORS問題にぶち当たり、CORSの対応をする必要がありました。Djangoには django-cors-headers というものがあります。しかし、django-cors-headersを使って実装をしてみましたが、どうも

Access-Control-Allow-Originがうまく指定できず、他のサイトからでもリクエストを送れるようになってしまっていました。

そこで、Djangoのミドルウェアを作成しCORS対応をしましたのでご紹介します。Django初心者なので、間違いなどがありましたらご指摘していただけると勉強になります。

実装

実装は以下のようになりました。

custom_middlewares/custom_cors_middleware.pyfrom django.http import HttpResponse from django.utils.deprecation import MiddlewareMixin class CustomCorsMiddleware(MiddlewareMixin): def process_request(self, request): if request.method == 'OPTIONS': response = HttpResponse() response['Access-Control-Allow-Origin'] = 'http://localhost:3000' # クライアントのオリジン response['Access-Control-Allow-Headers'] = ', '.join([ # 許可するHeaderを追加 'Content-Type', ]) response['Access-Control-Allow-Methods'] = ', '.join([ # 許可するリクエストメソッドを追加 'DELETE', 'GET', 'OPTIONS', 'PATCH', 'POST', 'PUT', ]) return response else: return None def process_response(self, request, response): response['Access-Control-Allow-Origin'] = 'http://localhost:3000' # レスポンスを読み取ることができるオリジン response['Content-Type'] = 'application/json' # レスポンスタイプ return response

process_requestメソッドは、リクエストが来たときに実行され、Noneが返り値の場合はルーティングされているviewが実行されます。リクエスト ↓ process_request が実行 → 返り値がある場合はその返り値を返す ↓ 返り値が None の場合は、リクエストのルーティングに対応する`view`が実行される上記のコードでは、プリフライトリクエストに備えて、

OPTIONSメソッドの場合は、許可するオリジン・ヘッダー・リクエストメソッドをヘッダーに付与したレスポンスを返すようにしています。次に、

process_responseメソッドは、レスポンスをするときの最後に実行されます。view を実行 ↓ process_request が view から返されたレスポンスを受け取り、レスポンスに処理を行う ↓ レスポンス上記のコードでは、CORSでよく見る

Access to XMLHttpRequest at 'http://locahost:8000' from origin 'http://localhost:3000' has been blocked by CORS policy: No 'Access-Control-Allow-Origin' header is present on the requested resource.のためにレスポンスを読み取ることができるオリジンを指定し、またレスポンスタイプに

application/jsonを指定しています。あとは、このカスタムミドルウェアを

settings.pyに追加してあげれば完了です。your_application_name/settings.pyMIDDLEWARE = [ 'custom_middlewares.custom_cors_middleware.CustomCorsMiddleware', # 追加 'django.middleware.security.SecurityMiddleware', 'django.contrib.sessions.middleware.SessionMiddleware', 'django.middleware.common.CommonMiddleware', 'django.middleware.csrf.CsrfViewMiddleware', 'django.contrib.auth.middleware.AuthenticationMiddleware', 'django.contrib.messages.middleware.MessageMiddleware', 'django.middleware.clickjacking.XFrameOptionsMiddleware', ]おわりに

Djangoを触ってみて思ったのは、日本語のドキュメントが少ないことです。

英語のドキュメントでも日本語のように読めると苦労が減るのかもしれませんね。

- 投稿日:2020-12-23T22:34:11+09:00

木構造の復習ついでに BFS に挑戦

こんばんは(*´ω`)

最近、leatcode の問題が少しづつ解けるようになってきました。

皆様のおかげです、有難うございます。 m(_ _)mあくまで私見ですが、問題の傾向としてアルゴリズムの基本を

理解しているかを問われているような印象を持ちました。

まだ easy, チョット medium のレベルで恐縮ですが。。新しい問題にチャレンジする際に行き詰ったら

基本に戻って理解を底上げすることが前進するキッカケになると思います。

行き詰った方が居たら、ぜひ基本に戻ってみることをお勧めいたします。微力ながら次の leetcode の問題にチャレンジしたいので

基本の復習 + α(deque の勉強) として本誌を書くことにしました。はい、本題です。

まずは何も見ないで

どんなツリーを作りたいか想像して書いてみました。myTree.py### TreeImage ### # 0 # # / \ # # 1 2 # # / \ # # 3 4 # # / \ # # 5 6 # ################# class tree_node: def __init__(self,val,left=None,right=None): self.val = val self.left = left self.right = right class tree: def __init__(self): self.root = None def add_left(self,val): if not self.root: self.root = tree_node(val) else: if not self.root.left: self.root.left = tree_node(val) else: runner = self.root while runner.left: runner = runner.left runner.left = tree_node(val) def add_right(self,val): if not self.root: self.root = tree_node(val) else: if not self.root.right: self.root.right = tree_node(val) else: runner = self.root while runner.right: runner = runner.right runner.right = tree_node(val) T = tree() T.add_left(0) T.add_left(1) T.add_left(3) T.add_left(5) T.add_right(2) T.add_right(4) T.add_right(6)イメージ通りか確認してみましょう。

確認方法ですが、deque を使います。

今日触ったばかりなのでイメージが怪しいですが、

とりあえず TreeNode を丸々バッファすることができます。

この特徴を利用して BFS で読み込むにはどうしたら良いのか検討してみました。

こんな記述はどうでしょうか。myTree.pydef show(self): head = self.root q = deque([head]) ans = [] while q: nums = q.popleft() if not nums: continue ans.append(nums.val) if nums.left or nums.right: q.append(nums.left) q.append(nums.right) print(ans)今回作成したツリーはこちらでした。

tree_image.py### TreeImage ### # 0 # # / \ # # 1 2 # # / \ # # 3 4 # # / \ # # 5 6 # #################一応、イメージとしては、以下にあるように、

上から矢印の方向に、同一層の値を順番に読みだしてリストに順次格納していくつもりです(笑)tree_image.py### TreeImage ### # → 0 # # / \ # # → 1 2 # # / \ # # → 3 4 # # / \ # # →5 6 # #################そのため、配列に直して表示すると、[0,1,2,3,4,5,6] ってなるはずです。

それでは実行してみましょう。実行結果.py[0, 1, 2, 3, 4, 5, 6]うん、大丈夫そうです。

因みに、ジグザグっぽく読んでも一応 BFS ですよね?

イメージはこんな感じです。tree_image.py### TreeImage ### # → 0 # # / \ # # 1 2 ← # # / \ # # → 3 4 # # / \ # # 5 6 ← # #################ではでは行ってみましょう。

myTree.pydef show(self): head = self.root q = deque([head]) ans = [] i = 0 while q: if i%2 == 0: nums = q.popleft() else: nums = q.pop() if not nums: continue ans.append(nums.val) if nums.left or nums.right: q.append(nums.left) q.append(nums.right) i += 1 print(ans)実行結果.py### TreeImage ### # → 0 # # / \ # # 1 2 ← # # / \ # # → 3 4 # # / \ # # 5 6 ← # ################# [0, 2, 1, 3, 4, 6, 5]OK ですね、勉強になって良かった良かった( *´艸`)

木構造は冒頭に書いたやり方以外にもリストで作るやり方もあるようです。

やっておいた方がいいなー( ´ー`)y-~~

多分、触ってみた感想を本誌に追記しておくと思います。

ではでは( `ー´)ノ

- 投稿日:2020-12-23T22:29:41+09:00

機械学習エンジニア弁護士が解説するAIと権利の話

みなさん、こんにちは。

こちらは「ABEJAアドベントカレンダー2020」の23日目の記事です。はじめに

私は、弁護士として法律事務所に所属しつつ、ABEJAで法務のサポートなどをしています。

また、JDLAのE資格を取得したので、機械学習エンジニアを名乗って少しだけエンジニア的な活動をしたりもしています。

仕事柄、AIと法律の話をすることが多いのですが、その際に私がよく質問されるのが、

① 所有権とか著作権とか特許権とか、権利がいろいろあってAIとの関係で何が問題になるかよくわからない

② データの利用が法的にOK/NGってどういう観点から検討してるのかよくわからない

③ AI開発の委託・受託のときのモデルの権利問題がよくわからないといったものです。

そこで今日は、この3つの問題をできるだけわかりやすく、一気に解説してしまおう!という記事を書きました。

経産省の「AI・データの利用に関する契約ガイドライン(AI編)」にも少し触れながら解説します(この記事では「AI契約ガイドライン」といいます)。長文なので、気になるところだけでも読んで参考にしていただければ幸いです!

(ちなみに、ABEJA法務にはRDチームの立ち上げ経験があり自分で機械学習モデルの開発もやっちゃう弁護士もおりまして、その弁護士が書いた「AIと公平性」の記事も絶賛公開中です!)

ということで、早速本題に入っていきましょう!

よくある質問①:所有権とか著作権とか特許権とか、権利がいろいろあってAIとの関係で何が問題になるかよくわからない

AIの開発段階・利用段階は以下のように図示することができます(AI契約ガイドライン12頁より引用)。

また、AIの開発過程で様々なノウハウが共有されますし、新たに生まれてきます。

そうすると、開発の際の契約で問題になりそうなものとしては、生データ・学習用データセット・学習用プログラム・推論プログラム・学習済みパラメータ・ノウハウといったものが挙げられそうです。

権利と聞いてパッと思いつくのは、所有権・著作権・特許権あたりでしょうか(「知的財産権」が思いついたという方もいらっしゃるかもしれませんが、知的財産権は著作権・特許権・商標権…といった権利の総称として使われる言葉なので、今回は使いません)。

そうすると、次の表の空欄を埋めることができれば「何の権利が問題になるか」という疑問には答えられそうです。

空欄の中身がわかりますか?それでは、空欄を埋めるべく、所有権・著作権・特許権を簡単に解説したいと思います。

(1) 所有権

答えから言うと、上記の表では所有権はいずれも発生しません!

なぜなら、所有権は「有体物」に生じる、とされているからです(民法206条→85条を読んでいただけるとわかります)。データやプログラムといったものは有体物ではないので、これらには所有権は生じない、ということです。データが記録媒体に保存されている場合、記録媒体を所有していても、中身のデータを所有している、とは言えません。

ということで、所有権の部分の答えは以下のようになります。(2) 著作権

所有権とは異なり、著作権は、基本的に無体物に発生します。著作権は、「思想又は感情を創作的に表現したもの」に発生しえます。

著作権は、絵画や音楽などに加え、創作性のある文章や写真、プログラムにも発生しえます。

したがって、例えば学習につかう生データが、誰かが書いた文章や誰かが撮影した写真などであった場合、当該データには著作権が発生している可能性があります(他方、機械的に取得した数値データや機械的に撮影した写真などには、基本的に著作権は発生しません。また、パラメータにも発生しません)。

学習用プログラムや推論プログラムのソースコードにも、著作権が発生しえます。

ということで、著作権の部分の答えは以下のようになります。

(学習用データセットについては、△としていますが、「データベースの著作物」という解説しだすとややこしい問題があるので、ここでは省略します。)

ここで、「著作権が発生する」ということの意味を少しだけ解説します。

著作権は、よく「権利の束である」と言われます。どういうことかというと、著作権を持つと、著作物をコピーしたり(複製権)、Qiitaで公開したり(公衆送信権)、編集したり(翻案権)、といったことができるようになりますし、他人が無断でそういった行為をしていたらやめるように求めることができます。

著作権は、こういったいろいろな権利を束にしたものなのです。所有権が、所有する「物」を支配する権利であるのに対し、著作権が無体物である創作に対する権利であることが何となくイメージできましたでしょうか?

例えば、絵画を例に挙げると、物体としての「絵」には所有権が生じ、無体物としての「絵」(これは見た感じでは物体としての絵と一体となっています)があります。物体としての絵が盗まれた場合には、所有権に基づいて返還請求をしますが、似たような絵を描いて販売しているのをやめさせたい場合には、基本的に所有権では対応できません(物体としての絵を奪われたわけではないため)。この場合には著作権を根拠に、似たような絵の作成をやめるよう請求することになります。(3) 特許権

特許権は、発明をした場合に、当該発明を出願し、登録されることで効力を生じる権利です。

著作権は著作物ができれば同時に発生しますが、特許権は出願し、登録されないと発生しないという点が一つの特徴です。

では、特許権はどういったものに生じるでしょうか。

特許権は発明である必要があるので、生データといった単純なデータには生じないのが通常です。

学習用プログラムについては、純粋にAIのモデルのみの開発を行う(周辺のシステムなどは含まない)場合を考えると、アルゴリズムについての発明に特許権が成立する可能性があります(有名な発明としては、Googleのバッチノーマライゼーションがありますね。バッチノーマライゼーションは米国等ではすでに特許として登録されており、日本でも特許出願されています。こういった、GAFA等による重要特許の取得についても語りたいことはたくさんあるのですが、ここでは書ききれないのでまたの機会にします)。ということで、特許権の部分の答えも埋まりましたね!

(4) 権利が発生しないものもある?

と、ここで気になる点が出てきたのではないでしょうか?

それは、全てが×(要は所有権・著作権・特許権のいずれも発生しえない)のものがあるということです。例えば、創作性のない生データや学習済みパラメータがそうですね。学習済みパラメータは、重要な情報ではありますが、創作性のない単純な行列の値なので著作権も特許権も基本的に生じないと考えられています。

こういった、「何も権利が生じていない情報」は何か保護がされるのでしょうか?

答えは「保護はされない」となります(ここでは割愛しますが、「営業秘密」「限定提供データ」などの例外はあります)。つまり、権利が発生しない情報をうっかり第三者に渡してしまった場合、第三者が情報をどう扱おうと、基本的になにも文句は言えないということになります。

それは困る!ということで出てくるのがNDAなどの秘密保持条項です。秘密保持条項では、通常、

・情報を●●という目的以外には使ってはならない(目的の限定)

・第三者に開示してはならない(対象者の限定)

・複製してはならない(利用態様の限定)

といった制約が置かれていますが、これは、権利が発生しない情報を守る、という効果もあるのです(情報授受の前にいちいちNDAを締結するのは面倒ですが、実はすごく重要だということがお分かりいただけるかと思います)。(5) まとめ

ということで、いったんここまでのポイントをまとめます。

まず、この図は重要ですね。

その他、以下の点が重要です。

- 所有権は有体物にしか生じないため、データやプログラムには生じない。

- 著作権・特許権は無体物に生じる。

- 著作権は創作と同時に発生するが、特許権は登録しないと発生しない。

- 著作権は権利の束。著作権を持っていると、複製、公表、編集など様々なことができる(著作権を持っていないとできない)。

- 所有権・著作権・特許権などの権利が発生しない情報もある。そのような情報を保護するには、開示する際に契約を締結して制限をかける必要がある。

よくある質問②:データの収集・利用が法的にOK/NGってどういう観点から検討してるのかよくわからない

(1) データの収集方法ごとの検討

機械学習では、まずデータを収集する必要があります。

データの確保には様々な方法がありますが、①自社で用意する、②特定の企業からデータを買う、③公開されているデータセットを使う、④不特定多数から収集する、といった方法が考えられますので、順にみていきましょう。① 自社で用意する場合

①自社で用意する場合の例はたくさんありますが、例えば、不良品検知のAIを作るために、自社製品の写真を大量に準備する、といったことが考えられます。この場合、準備した画像は(おそらく機械的に撮影するでしょうから)通常は創作性がなく、著作権は発生しなそうですね(生データに著作権が発生するかどうかは、データの創作性の有無によって異なってくることを先ほど説明しました。)。利用にあたっても、特に法的な障害はなさそうです。

② 特定の企業からデータを買ってくる場合

②特定の企業からデータを買ってくる場合には、売主の企業が権利を持っていることを確認して、権利ごと譲ってもらえば大丈夫そうです。また、権利は売主に残しつつ、学習に使うことを許可してもらう形でも良さそうです。

要は、締結する契約の内容次第ということですね。

実は、データの取引についても経産省からガイドラインが出ています(「AI・データの利用に関する契約ガイドライン(データ編)」)。興味がある人は見てみてください。③ 公開されているデータセットを使う場合

③公開されているデータセットを使う場合には、利用条件が設定されている場合が多いです。

例えば、有名な画像のデータセットであるCOCOでは、Creative Commons Attribution 4.0 LicenseのBYという要素が採用されており、原作者のクレジット(氏名、作品タイトルなど)を表示することが要求されています。このようなデータセットの利用条件は、データをダウンロードした時点で利用条件に同意した(=契約した)と解されるため、データ提供者と受領者との間での契約という形で当事者を規律します。契約上の義務として利用条件がかかってくるという構造はNDAとも同じですね(②特定の企業からデータを買ってくる場合も同様です)。

要は、設定している利用条件を検討する必要があるということになります。④ 不特定多数から収集する場合

④不特定多数から収集する場合には、どういった点が問題になるでしょうか?

例えば、クローリング・スクレイピングにより風景画像を収集して学習に使いたいと思った場合を考えてみましょう。収集した風景画像はいろんな人が撮影したものなので、著作権が発生しています。そして、学習に使おうとすると、画像をコピーして、リサイズ等の前処理やアノテーションをする必要がありますが、これは複製権や翻案権を侵害しそうです。また、著作権者に許諾を得ようにも誰が著作権者かがわかりません。

でも、実はこのような行為は著作権を侵害せずに行い得ます。

日本の著作権法が「機械学習パラダイス」と呼ばれていたりするのをご存じの方もいらっしゃるかもしれませんが、著作権法30条の4という条文で、機械学習のような情報解析の目的では、一定の場合に著作物を利用できるとされているからです。

この著作権法30条の4は、2019年1月1日施行の改正著作権法で改正されたもので、(改正前から機械学習パラダイスといわれていたのですが)より機械学習パラダイスな条文になっています。ちなみにABEJAでは、2019年2月にRPAテクノロジーズ様と提携し、改正法で初めて可能になったワンストップのデータセットクローリングサービスを展開しています。サービス開始時のプレスリリースでは、プレスリリースとしては珍しく、かなり詳細に改正法の解説をしました。

著作権法30条の4の内容が気になる方は是非プレスリリースを読んでみてください。不特定多数人からデータを収集するケースとして、もう一つ、街頭にカメラを設置して人の顔画像を収集する場合を考えてみましょう。カメラから機械的に取得される画像は基本的に著作物ではありませんが、この場合は、個人情報保護法やプライバシー・倫理という別の観点の制約に留意する必要があります。

このように、データの収集や利活用を行う場合には、個人情報保護法などの法令や、プライバシー・倫理といった観点からの検討が必要な場合があります。

(2) まとめ(データの収集・利活用の際のチェックポイント)

- 契約によってデータ利活用が制限されないか

- 個人情報保護法などの法令等によりデータ利活用が制限されないか

※ データの中に第三者の著作物が含まれていても、適法に利活用しうる

よくある質問③:AI開発の委託・受託のときのモデルの権利問題がよくわからない

(1) 学習用プログラム・推論プログラムと著作権

モデル開発の委託/受託では、学習用プログラム、推論プログラム、学習済みパラメータといったものについて、開発フェーズで納品されることが多いかと思います。

下図のとおり、学習用プログラム・推論プログラムには著作権が発生しますが、学習済みパラメータにはこういった権利は発生しません。この記事では、特に重要な、著作権が生じる学習用プログラム・推論プログラムについて解説をしたいと思います。

納品予定の学習用プログラム・推論プログラムの著作権について契約で定める場合、①著作権をどちらに帰属させるか(権利帰属)、②双方がどういった条件で利用できるようにするか(利用条件)の二段階の検討が必要です。

(2) 著作権の権利帰属

まず、著作権がユーザ・ベンダのどちらに帰属するかを決める必要があります。

ユーザ帰属、ベンダ帰属、ユーザとベンダの共有、といった選択肢があります。

後述の利用条件のところでも述べるとおり、あまり「どちらに帰属させるべき」という定式はありませんが、

- ベンダがライセンスフィーで利益を得るようなビジネスモデルの場合には著作権の帰属にこだわることが多い

- ユーザが開発手法等についても主導権をもって開発を進め、ベンダの裁量が狭いような場合にはユーザに著作権を帰属させることも多い

- ユーザ・ベンダが協業して完成したモデルを売っていくような場合には共有にすることも多い

といった大まかな傾向はあるかもしれません。

ちなみに、権利帰属について契約で何も決めない場合は、基本的には、プログラムを生成したベンダに著作権が帰属します。

(3) 利用条件

所有権の対象(有体物)は、基本的に「一人しか対象物を利用できない」ことになりますが、著作権の対象(無体物)は多数の人が同時に利用可能です。

例えば、家は有体物で所有権の対象とりますが、

- 所有者が住む

- 所有者は使わずに賃借人に住まわせる

といった程度の選択肢しかありません。

他方、著作権の対象となるもの(たとえばプログラム)であれば、

- 著作権者だけが使う

- 著作権者も使うが、公開して世界中の人にも使わせてあげる。

- 著作権者は使わず、もっぱら知り合いに使わせてあげる。使うだけでなく、改良することも許可する。知り合いが改良版を公開したいといったので許可する。

といった、様々な使い方があります。

先ほど、著作権は「権利の束」だと説明しました。

この束のなかで、どの部分を許可するかを自由に決めることができるのです(a)。

例えば、

・複製は自由に許す

・貸与することも許すが、お金の支払いなどの条件を付ける

・翻案(編集)も許すが、編集できる範囲を制限する

・複製・貸与・翻案以外は禁止

といった具合です。また、これも重要な視点ですが、著作権者の権利を契約によって制限することもできます(b)。

著作権者の権利を全部制限し、他方で第三者に広い範囲でライセンスを付与するような場合には、もはやライセンスを付与される第三者が著作権を持っているのとあまり変わらない状態にもなり得ます。

「権利をどちらに帰属するか」も重要ですが、「利用条件をどのように設定するか」が重要なことがお分かりいただけたでしょうか。

では、利用条件はどういった要素に着目して定めればよいでしょうか。

この点については、経産省のAI契約ガイドラインの次の表が参考になります(AI契約ガイドライン31頁)例えば、

・著作権はベンダ帰属

・ユーザは自己の業務に必要な範囲で、無償・無期限の非独占的な利用の許諾を受ける

・ベンダは基本的に自由に使えるが、ユーザの競合企業である●●社には横展開してはならない

といった条件を定めることが考えられます。このような条件を決めたら、上記の表を「別紙」として契約書につけて、「別紙の条件で利用します」という趣旨の条項に落とし込めばOKです!(この表をいい感じに完成させて法務にもっていけばいい感じに契約に落とし込んでくれるはずです!)

以下はAI契約ガイドラインを参考にした規定例です(AI契約ガイドライン114~118頁参照)。第●●条(本件成果物の著作権)

1.本件成果物および本開発遂行に伴い生じた知的財産(以下「本件成果物等」という。)に関する著作権(著作権法第 27 条および第 28 条の権利を含む。)は、ユーザまたは第三者が従前から保有していた著作物の著作権を除き、ベンダに帰属する。

2.ユーザおよびベンダは、本契約に従った本件成果物等の利用について、他の当事者および正当に権利を取得または承継した第三者に対して、著作者人格権を行使しないものとする。第●●条(本件成果物の利用条件)

ユーザおよびベンダは、本件成果物等について、別紙「利用条件一覧表」記載のとおりの条件で利用できるものとする。同別紙の内容と本契約の内容との間に矛盾がある場合には同別紙の内容が優先するものとする。「著作者人格権」などの難しい表現は一旦さておき、何となくイメージを持っていただけたのではないでしょうか。

(4) 契約の落とし穴

最後に、契約締結の際に陥りがちな落とし穴を二つほど紹介します。

落とし穴①:「著作権共有」

著作権の帰属について、ユーザもベンダも譲らず決着がつかない…といった場合には、折衷案として著作権をユーザ・ベンダの一方に帰属させず、「共有」とすることもあるかと思います。また、共同開発のような場合にも共有とすることもあるでしょう。

この場合、「共有にしたからお互い自由に使える」と思っていませんか?

著作権法65条1項・2項を見てみましょう。

(共有著作権の行使)

第六十五条 共同著作物の著作権その他共有に係る著作権(以下この条において「共有著作権」という。)については、各共有者は、他の共有者の同意を得なければ、その持分を譲渡し、又は質権の目的とすることができない。

2 共有著作権は、その共有者全員の合意によらなければ、行使することができない。条文をみると、著作権の行使は「他の共有者の合意」が必要とされています。

つまり、「●●に使っていいよ」という合意を逐一得ないとなにもできない、ということですね。

ですので、共有にする場合には、同じ契約で「●●に使っていいよ」という合意を得ることが重要です。AI契約ガイドラインの契約書案でも、共有にする場合にはちゃんとこの「合意」についての規定があります(114頁)。

ちょっと長いですが、条文を貼っておきます。第●●条(本件成果物等の著作権)

1.本件成果物および本開発遂行に伴い生じた知的財産(以下「本件成果物等」という。)に関する著作権(著作権法第 27 条および第 28 条の権利を含む。)は、ユーザのベンダに対する委託料の支払いが完了した時点で、ユーザ、ベンダまたは第三者が従前から保有していた著作物の著作権を除き、ベンダおよびユーザの共有(持分均等)とする。なお、ベンダからユーザへの著作権移転の対価は、委託料に含まれるものとする。

2.前項の場合、ユーザおよびベンダは、共有にかかる著作権につき、本契約に別に定めるところに従い、前項の共有にかかる著作権の行使についての法律上必要とされる共有者の合意を、あらかじめこの契約により与えられるものとし、相手方の同意なしに、かつ、相手方に対する対価の支払いの義務を負うことなく、自ら利用することができるものとする。

3.ユーザ及びベンダは、相手方の同意を得なければ、第 1 項所定の著作権の共有持分を処分することはできないものとする。

4.ユーザおよびベンダは、本契約に従った本件成果物等の利用について、他の当事者および正当に権利を取得または承継した第三者に対して、著作者人格権を行使しないものとする。落とし穴②:「協議によって定める」

著作権の帰属について、ユーザもベンダも譲らず決着がつかない…という場合には、帰属について定めることをあきらめて「協議によって定める」といった規定がされることもあります。

しかし、これは当事者にとってリスクが残る契約といえます。著作権の帰属について何も定めなかった場合には、著作権は開発を行った側、すなわちベンダに帰属します。

そうすると、ユーザとしては、「協議によって定める」場合に協議がまとまらないと、権利を得られないことになります。また、利用許諾も得ていないと、せっかくできたモデルを何も使えない、ということになってしまいます。

ベンダとしても、例えばユーザに有償でライセンスして利益を得ようと思っていた場合、「協議」がまとまらないと結局このようなも目論見が外れてしまい、せっかく作ったのにお金にならない、、となりかねません。

したがって、権利帰属をペンディングにして「協議によって定める」ということは避けるべきです。

同様のことは、開発PJ開始時に権利帰属について定めていない場合にも妥当することがあります。

すなわち、アセスメント・PoCと個別に契約を締結して進めてきたものの、開発フェーズに入って初めてモデルの権利帰属を議論したところまとまらない、といった事態が生じうることがあります。

これはどうすれば防げたかというと、アセスメント開始時に、開発PJ全体に適用される「基本契約書」と締結し、そこでモデルの権利帰属について定めておけばよかった、ということになります。

ただ、開発PJ初期で開発対象が明確に決まっていないことも多く、そういった場合に無理して権利帰属の議論をすることは避けた方がよい場合もあり、どういった形の契約を締結するかは案件ごとに判断した方がよいです。(5) まとめ

- 学習用プログラム・推論プログラムには著作権が発生する。

- 権利帰属と利用条件の二つを決める必要がある。

- 利用条件を考える際には、AI契約ガイドライン31頁の表が参考になる。

- 著作権を共有にする場合には、行使についての合意をしておく。

- 「協議によって定める」といった条項は避けた方がよい場合が多い。

最後に

いかがでしたでしょうか?

今回、初めてQiitaに記事を投稿させていただいたのですが、これまでAIの開発契約を数多く見てきた中で、「技術者・ビジネスサイドと法務がもっと理解しあっていればもっとスムーズに契約交渉が進むのに…」と思ったことが数多くありました。また、技術者が法的なところで疑問を持っているが適切な相談相手がまわりにいない、という場面を見かけることもありました。

この記事が、少しでもそのような問題の解決の一助になれば、と思っております!

かなり長文になってしまったので、最後まで読んでくださった方はいるのだろうか。。。という気もしますが、

今後も記事を更新していくかもしれませんので、疑問点などあればお気軽にコメントなどしていただけますと幸いです!最後までお読みいただき、ありがとうございました。

※※※※※※※

・この記事のうち意見にわたる部分は私の個人的な見解でであり、私が所属する組織の見解ではないことにご留意ください。

・この記事は一般論を述べたものであり、具体的ケースのご判断の際には専門家にご相談ください。

・この記事はわかりやすさに重点を置いたため、厳密には不正確な表現となっている部分もあることにもご留意ください。

※※※※※※※

- 投稿日:2020-12-23T22:27:03+09:00

rpycモジュールを使ってMayaを外部のPythonインタプリタから操作する

この記事はTakumi Akashiro ひとり Advent Calendar 2020の23日目の記事です。

始めに

以前Houdiniを触った際、外部のPythonからHoudiniの

houオブジェクトを操作するhrpycモジュールが凄いなあ……1とおもったので、

hrpycを参考にして、Mayaで同じようなものが書けないかなあと思ったので作ってみました。使い方

pip install rpyc -t <mayaのScriptフォルダ>でrpycをインストールする。

バイナリは無いのでpython2系なら何でも大丈夫……なはず。- 以下のファイルをMayaのScriptフォルダを保存。

mrpyc.py#! python2 # encoding: utf-8 import threading from rpyc.utils import classic from rpyc.core import SlaveService from rpyc.utils.server import ThreadedServer PORT = 18812 def _start_server(port=PORT): t = ThreadedServer( SlaveService, hostname = '0.0.0.0', port = int(port), reuse_addr = True, authenticator = None, registrar = None, auto_register = False ) t.start() def start_server(port=PORT): thread = threading.Thread(target=lambda: _start_server(port)) thread.start() return thread def import_remote_maya_module(server="127.0.0.1", port=PORT): return classic.connect(server, port).modules['maya']3.MayaのScriptEditorなどで以下を実行してMayaのサーバーを立てる。

import mrpyc mrpyc.start_server()4.外部のインタプリタで以下を実行して、mayaモジュールを取得して、polyCubeを作ってみます。

import mrpyc maya = mrpyc.import_remote_maya_module() maya.cmds.polyCube()締め

以外と簡単2にできましたね!

ただ実験した感じ、数分経つと接続が死んだり、Mayaがクラッシュしたりするので、

もうちょっとhrpycの_RemoteHouAttrWrapperを参考にして実装すると安全にできるのかもしれないです。

- 投稿日:2020-12-23T22:27:03+09:00

rpycモジュールを使って外部のPythonインタプリタからMayaを操作する

この記事はTakumi Akashiro ひとり Advent Calendar 2020の23日目の記事です。

始めに

以前Houdiniを触った際、外部のPythonからHoudiniの

houオブジェクトを操作するhrpycモジュールが凄いなあ……1とおもったので、

hrpycを参考にして、Mayaで同じようなものが書けないかなあと思ったので作ってみました。rpycモジュールとは

Remote Python Call、すなわち別のプロセスのPythonのオブジェクトを使うためのモジュールです。2

呼び出し元はサーバーを立て、呼び出し先にネットワーク経由でオブジェクトのプロキシを提供することで別セッションのPythonのオブジェクトを使えます。

詳細はrpyc · PyPIに任せますが、Houdiniで使うhrpycはrpycを非常に簡素にしたラッパーです。使い方

pip install rpyc -t <mayaのScriptフォルダ>でrpycをインストールする。

バイナリは無いのでpython2系なら何でも大丈夫……なはず。- 以下のファイルをMayaのScriptフォルダを保存。

mrpyc.py#! python2 # encoding: utf-8 import threading from rpyc.utils import classic from rpyc.core import SlaveService from rpyc.utils.server import ThreadedServer PORT = 18812 def _start_server(port=PORT): t = ThreadedServer( SlaveService, hostname = '0.0.0.0', port = int(port), reuse_addr = True, authenticator = None, registrar = None, auto_register = False ) t.start() def start_server(port=PORT): thread = threading.Thread(target=lambda: _start_server(port)) thread.start() return thread def import_remote_maya_module(server="127.0.0.1", port=PORT): return classic.connect(server, port).modules['maya']3.MayaのScriptEditorなどで以下を実行してMayaのサーバーを立てる。

import mrpyc mrpyc.start_server()4.外部のインタプリタで以下を実行して、mayaモジュールを取得して、polyCubeを作ってみます。

import mrpyc maya = mrpyc.import_remote_maya_module() maya.cmds.polyCube()締め

以外と簡単3にできましたね!

ただ実験した感じ、数分経つと接続が死んだり、Mayaがクラッシュしたりするので、

もうちょっとhrpycの_RemoteHouAttrWrapperを参考にして実装すると安全にできるのかもしれないです。

- 投稿日:2020-12-23T22:23:26+09:00

性のクリスマスイブに彼女が居ないひとへ ◯ぎ声キーボード

みなさんこんにちは限界開発鯖のやばい人やFascodeNetworkの広報やブログでデブ活などなどをやっているくもことなおこです。

Qiitaで投稿したのが初めてなので若干至らない点があるかもしれませんがご了承ください作った経緯

早速自分が使いたいがために作った◯ぎ声キーボード、キーを押すたびに◯ぎ声がなるという恐ろしく世紀末的なPythonとVLCを使ったツール?です。

まずは自分が多少わかる言語でバックグラウンド上で動作するキー検知いわゆるキーロガーですね、、、を作らなくちゃいけません

その条件で色々探したところ

Pythonのpyxhookライブラリを使うのが一番楽そう

使い方に関してはここがわかりやすい

https://qiita.com/kaitaku/items/5c327ddd779260c63036コード

と言っても上の方のソースコードコピーしてちょいといじった感じですね。

キー入力検知したらサウンド鳴らすだけのコードです。GitHubのコード

https://gist.github.com/naoko1010hh/77d15c8658a4fadfc7e945da80446e22

実際に動かしてみた動画をTwitterに上げているのでもしよければ見てね。ボリューム小さくしてから見たほうがいいかも

https://twitter.com/naoko1010hh/status/1322766477649453057?s=19動画内で使用した音声はみじんこさんの音声有料素材を使用させていただきました。https://www.dlsite.com/maniax/work/=/product_id/RJ287819.html

最後に

後つけ感はありますが今後の目標はキーごとに音を割り振って支援が必要な方がキー配置を覚えられるようにしたいですね

- 投稿日:2020-12-23T22:05:12+09:00

SWIGでC/C++をラップしPythonの処理を高速化する。【概要編】

SWIGとは?

SWIGは、C/C++で書かれたプログラムをラップし、多言語で使えるようにするためのツールです。

サポートされている言語には、Javascript、Perl、PHP、Python、Tcl、Rubyなどのスクリプト言語や、C#、D、Go、Java、Lua、OCaml、Octave、Scilab、Rなどの非スクリプト言語があります。速度比較

C/C++で書かれたコードが早いのはよく知られていますが、実際にどれくらいの速度差があるのか、いくつかの条件で比較します。

<実行環境>

OS: Ubuntu18.04

CPU: Intel Corei7-7700k

メモリ: 24GB<コンパイル環境>

-O3オプションあり

並列化なしHello World

"hello world!"と1000回表示する関数の実行速度

python_time:2.356291e-03[sec] swig_time__:1.398325e-03[sec]2倍程度の差がありますが、一般的に言われているほどの差があるようには見えません。

厳密にはわかりませんが、文字列のコンソール表示速度のオーバーヘッドがあるからだと思われます。

コード

pythondef hello_world(): for i in range(1000): print("hello world!") def test1(): # python start = time.time() hello_world() python_time = time.time() - start # swig start = time.time() helloWorld() swig_time = time.time() - start print("python_time:{:e}".format(python_time) + "[sec]") print("swig_time__:{:e}".format(swig_time) + "[sec]")cvoid helloWorld() { for (int i = 0; i < 1000; i++) { printf("hello world!\n"); } }

数字のカウントアップ

1000までをカウントアップして返す関数の実行速度

python_time:6.842613e-05[sec] swig_time__:5.483627e-06[sec]今度は10倍以上の差が出ました。数字をカウントアップするだけでここまで差が出ると、pythonは遅いといわれる理由が垣間見えてきます。

コード

pythondef count_up(): res = 0 for i in range(1000): res += 1 return res def test2(): # python start = time.time() res = count_up() print(res) python_time = time.time() - start # swig start = time.time() res = countUp() print(res) swig_time = time.time() - start print("python_time:{:e}".format(python_time) + "[sec]") print("swig_time__:{:e}".format(swig_time) + "[sec]")cint countUp() { int res = 0; for (int i = 0; i < 1000; i++) { res += 1; } return res; }

画像の変換

グレースケール画像からRGB画像へ変換する関数の実行速度

※Python側ではOpenCVモジュールを使用python_time:1.032352e-04[sec] swig_time__:1.156330e-04[sec]こちらはほとんど変わらない結果になりました。OpenCVはそもそもC/C++で書かれているので、当然といえば当然の結果ですね。

しかし、このSWIGの実行速度には、np.zeros()で出力先のメモリを確保しておく処理が含まれています。OpenCVのpythonパッケージを利用している場合には不可能ですが、SWIGで書いている場合には出力先メモリを再利用することが可能です。

メモリ空間の確保を外だしした場合の速度は以下のようになります。python_time:1.101494e-04[sec] swig_time__:7.319450e-05[sec]この条件だとSWIGが30%以上高速化しています。複数回実行する場合はSWIGでのベタ書きにも優位性がありそうです。

コード

pythondef test3(): img_size = (256, 256) org_img = np.random.randint(0, 256, (img_size), dtype=np.uint8) # python start = time.time() res_py = cv2.cvtColor(org_img, cv2.COLOR_GRAY2RGB) python_time = time.time() - start # swig # res_swig = np.zeros((*img_size, 3), dtype=np.uint8) start = time.time() res_swig = np.zeros((*img_size, 3), dtype=np.uint8) imgGray2RGB(org_img, res_swig) swig_time = time.time() - start print("array_equal: {}".format(np.array_equal(res_py, res_swig))) print("python_time:{:e}".format(python_time) + "[sec]") print("swig_time__:{:e}".format(swig_time) + "[sec]")cvoid imgGray2RGB(unsigned char *inArr, int inDim1, int inDim2, unsigned char *inplaceArr, int inplaceDim1, int inplaceDim2, int inplaceDim3) { int height = inplaceDim1; int width = inplaceDim2; int channel = inplaceDim3; int h, w; int in_point, out_point; for (h = 0; h < height; h++) { for (w = 0; w < width; w++) { in_point = h * width + w; out_point = channel * (h * width + w); inplaceArr[out_point] = inArr[in_point]; inplaceArr[out_point + 1] = inArr[in_point]; inplaceArr[out_point + 2] = inArr[in_point]; } } }

(オプション) 画像の正規化

グレースケールからRGBへの変換に加え、画像の正規化を行った実行速度

※Python側ではOpenCVモジュールを使用python_time:1.460791e-03[sec] swig_time__:3.521442e-04[sec]OpenCVもC/C++で実装しているはずですが、SWIGがOpenCVより4倍の速度が出ています。

これは、一度のラスタ走査ですべての処理を終えており、処理の量が大きく削減されているためです。OpenCVのPythonパッケージは当然ながら関数単位でわかれているため、こういった処理の削減で高速化を狙う場合は、C/C++での処理が必須になります。

コード

pythondef test4(): img_size = (256, 256) mean = [0.485, 0.456, 0.406] std = [0.229, 0.224, 0.225] mean_np = np.array(mean, dtype=np.float32) std_np = np.array(std, dtype=np.float32) org_img = np.random.randint(0, 256, (img_size), dtype=np.uint8) # python start = time.time() res_py = cv2.cvtColor(org_img, cv2.COLOR_GRAY2RGB).astype(np.float32) res_py = ((res_py / 255) - mean_np) / std_np python_time = time.time() - start # swig start = time.time() res_swig = np.zeros((*img_size, 3), dtype=np.float32) imgNormalize(org_img, res_swig, *mean, *std) swig_time = time.time() - start print("array_equal: {}".format(np.array_equal(res_py, res_swig))) print("python_time:{:e}".format(python_time) + "[sec]") print("swig_time__:{:e}".format(swig_time) + "[sec]")cvoid imgNormalize(unsigned char *inArr, int inDim1, int inDim2, float *inplaceArr, int inplaceDim1, int inplaceDim2, int inplaceDim3, float meanR, float meanG, float meanB, float stdR, float stdG, float stdB) { int height = inplaceDim1; int width = inplaceDim2; int channel = inplaceDim3; int h, w; int val; int inPoint, outPoint; for (h = 0; h < height; h++) { for (w = 0; w < width; w++) { inPoint = h * width + w; outPoint = channel * (w + width * h); val = inArr[inPoint]; inplaceArr[outPoint] = ((float)val / 255 - meanR) / stdR; inplaceArr[outPoint + 1] = ((float)val / 255 - meanG) / stdG; inplaceArr[outPoint + 2] = ((float)val / 255 - meanB) / stdB; } } }

次回

次は実装編になります。実装編では基本的なSWIGの使い方から、Numpyを直接引数へ渡してC/C++側からポインタ参照する方法など、ちょっとした応用を紹介予定です。

- 投稿日:2020-12-23T20:41:34+09:00

TKinterを利用してパソコン設定変更アプリを作ってみるぞ?

pythonの勉強として簡単なソフトを作ってみよう!

なんて意気込みでtkinterで1つのソフトを作ってみます。

とりあえず、Windows上で設定変更をかけるソフト。名前は「お家に帰ろう」

「設定変更が便利になるといいな」的なコンセプトで作り始めました。

Windowsの設定変更ソフトを作りたい方に、少し参考になる程度の情報が提供できたらいいな!

tkinterとは?

python標準のGUIライブラリで、古い見た目のUIを実装できます。

調べていくと、どうやらtkinterとtkinter.ttkでUIデザインが異なる模様。

ttkの方がモダンなUIになります。さらに2018年からPySimpleGUIの開発が始まっており、コードも短く、よりモダンなデザインでGUIを組める模様。

今回はNETに情報が多いからtkinterでチャレンジしてみよう!ってわけで作成を開始しました。

作ったもの

こんな感じです。

うん。素人の作品っぽくていいですね 笑とりあえず下記を実装してみました。

・PC名変更

・IPv4変更

・自動ログオン作って気づいたこと

ごく当たり前のことで、薄々わかってたんですが、せめて設計書的なものは作りましょう 笑

はじめは「PC名変更」くらいしか考えてなかったのですが、後から実装したい機能がどんどん増えてきてしまいました。。

その都度UIに変更を加えていったので、ここがモーレツに面倒でした。

いや、ほんとアホですよね。うん。

思い付きはダメデスこんなノリで作り始めましたが、上の画像の機能自体はちゃんと動くようになりました。

Windowsは権限、UACの問題があるので、そのへんの動きをおさえて変更が完了するように作る必要があります。

そのほか、process.runやレジストリ書き込み、入力文字のチェックやログ出力の実装、pyarmor、exe化、モジュール分割などなど入れて、再起動後は自動的にstep2としてプログラムを起動するところまで作ってます。

デバッグやブラッシュアップができればフリーソフト公開なんてできればいいのですが、まだ先かなぁと思ってます。

でも、やっぱり1つのモノを作ることで1連の流れが見えてきますね!

勉強になりました。tkinterの実装

こんな感じのコードでGUIの実装を始めます。

class Application(tk.Frame): def __init__(self, master): super().__init__(master) self.pack() self.master.geometry("620x630") self.master.title("お家に帰ろう") nb = ttk.Notebook(width=200, height=200)メニューバーはこんな感じ。

# メニューバーの作成 self.menubar = tk.Menu(master) master.configure(menu = self.menubar) # ファイルメニュー filemenu = tk.Menu(self.menubar, tearoff = 0) self.menubar.add_cascade(label = "ファイル", menu = filemenu) # ~内容 filemenu.add_command(label = "ファイルから読み込む(開発中)") # ~内容 filemenu.add_command(label = "ファイルに保存する(開発中)") # セパレーター filemenu.add_separator() filemenu.add_command(label = "終了", command = lambda: master.destroy())タブの実装

#タブ tab1 = tk.Frame(nb) tab2 = tk.Frame(nb) tab3 = tk.Frame(nb) tab4 = tk.Frame(nb) self.textbox1 = tk.Text(tab4) self.textbox1.configure(font=("", 14, "")) self.textbox1.pack() self.textbox1.place(x=150, y=0,width = 460, height = 570) tab5 = tk.Frame(nb)ちなみにtab4はtextboxを実装します。

例えばエクセルからパラメータを張り付けて設定変更できると便利だよね?なんて発想。

実装自体は難しくないレベル。CSVファイルから読み込んでもいいですし、このあたりはどうやってデータを入れるか、運用に合わせて決めるといいですね!

設定変更コマンド

単純にコマンドプロンプトのコマンドをprocess.runで実装できます。ただ、errorlevelを受け取る方法がわかりませんでした。

なので判定を入れ込むならpowershellの方がいいかもしれませんね。

今回はpowershellでコンピュータ名を変更し、戻り値を判定して正常、異常を判定しています。

IP変更

今回はコマンドプロンプトで実装しました。

判定はレジストリからパラメータを取得し、変更後の値と比較すればOK。

単純にipconfigなんて打ってもオフライン時は出力しないので注意が必要。なお、レジストリを参照すれば「イーサネット」などのインタフェースもリストで出力できますヨ

チェック機能

値のチェックは入力なしや文字数などで判定させています。

ipaddressは以下のようなチェック方法があります。

import ipaddress as ipadd def chk_ipv4(self,ipaddress): try: ipadd.ip_address(ipaddress) return "ok" except ValueError: return "ng"難易度

pythonの初学者にとってちょうどいいくらいのレベルなのかな?と思います。

私自身、python勉強して2ヶ月くらいでつくりました。

ただしWindowsの動きがわかってないと作るのが難しいとは思います。

同じようなソフトを作る方へ

pyinstallerでexe化ができますが、process.runを利用する場合は下記の記事を読んだ方がいいです。とても参照になりました。(ありがとうございます。)

https://sapporo-president.com/archives/15581普通にexeにすると動作しませんでした。

- 投稿日:2020-12-23T20:41:34+09:00

TKinterを利用してパソコン設定変更ソフトを作ってみる(初心者)

pythonの勉強として簡単なソフトを作ってみよう!

なんて意気込みでtkinterで1つのソフトを作ってみます。

とりあえず、Windows上で設定変更をかけるソフト。名前は「お家に帰ろう」

「設定変更が便利になるといいな」的なコンセプトで作り始めました。

Windowsの設定変更ソフトを作りたい方に、少し参考になる程度の情報が提供できたらいいな!

tkinterとは?

python標準のGUIライブラリで、古い見た目のUIを実装できます。

調べていくと、どうやらtkinterとtkinter.ttkでUIデザインが異なる模様。

ttkの方がモダンなUIになります。さらに2018年からPySimpleGUIの開発が始まっており、コードも短く、よりモダンなデザインでGUIを組める模様。

今回はNETに情報が多いからtkinterでチャレンジしてみよう!ってわけで作成を開始しました。

作ったもの

こんな感じです。

うん。素人の作品っぽくていいですね 笑とりあえず下記を実装してみました。

・PC名変更

・IPv4変更

・自動ログオン作って気づいたこと

ごく当たり前のことで、薄々わかってたんですが、せめて設計書的なものは作りましょう 笑

はじめは「PC名変更」くらいしか考えてなかったのですが、後から実装したい機能がどんどん増えてきてしまいました。。

その都度UIに変更を加えていったので、ここがモーレツに面倒でした。

いや、ほんとアホですよね。うん。

思い付きはダメデスこんなノリで作り始めましたが、上の画像の機能自体はちゃんと動くようになりました。

Windowsは権限、UACの問題があるので、そのへんの動きをおさえて変更が完了するように作る必要があります。

そのほか、process.runやレジストリ書き込み、入力文字のチェックやログ出力の実装、pyarmor、exe化、モジュール分割などなど入れて、再起動後は自動的にstep2としてプログラムを起動するところまで作ってます。

デバッグやブラッシュアップができればフリーソフト公開なんてできればいいのですが、まだ先かなぁと思ってます。

でも、やっぱり1つのモノを作ることで1連の流れが見えてきますね!

勉強になりました。tkinterの実装

こんな感じのコードでGUIの実装を始めます。

class Application(tk.Frame): def __init__(self, master): super().__init__(master) self.pack() self.master.geometry("620x630") self.master.title("お家に帰ろう") nb = ttk.Notebook(width=200, height=200)メニューバーはこんな感じ。

# メニューバーの作成 self.menubar = tk.Menu(master) master.configure(menu = self.menubar) # ファイルメニュー filemenu = tk.Menu(self.menubar, tearoff = 0) self.menubar.add_cascade(label = "ファイル", menu = filemenu) # ~内容 filemenu.add_command(label = "ファイルから読み込む(開発中)") # ~内容 filemenu.add_command(label = "ファイルに保存する(開発中)") # セパレーター filemenu.add_separator() filemenu.add_command(label = "終了", command = lambda: master.destroy())タブの実装

#タブ tab1 = tk.Frame(nb) tab2 = tk.Frame(nb) tab3 = tk.Frame(nb) tab4 = tk.Frame(nb) self.textbox1 = tk.Text(tab4) self.textbox1.configure(font=("", 14, "")) self.textbox1.pack() self.textbox1.place(x=150, y=0,width = 460, height = 570) tab5 = tk.Frame(nb)ちなみにtab4はtextboxを実装します。

例えばエクセルからパラメータを張り付けて設定変更できると便利だよね?なんて発想。

実装自体は難しくないレベル。CSVファイルから読み込んでもいいですし、このあたりはどうやってデータを入れるか、運用に合わせて決めるといいですね!

設定変更コマンド

単純にコマンドプロンプトのコマンドをprocess.runで実装できます。ただ、errorlevelを受け取る方法がわかりませんでした。

なので判定を入れ込むならpowershellの方がいいかもしれませんね。

今回はpowershellでコンピュータ名を変更し、戻り値を判定して正常、異常を判定しています。

IP変更

今回はコマンドプロンプトで実装しました。

判定はレジストリからパラメータを取得し、変更後の値と比較すればOK。

単純にipconfigなんて打ってもオフライン時は出力しないので注意が必要。なお、レジストリを参照すれば「イーサネット」などのインタフェースもリストで出力できますヨ

チェック機能

値のチェックは入力なしや文字数などで判定させていますが、IPアドレス形式は下記で簡単にチェックできます。

import ipaddress as ipadd def chk_ipv4(self,ipaddress): try: ipadd.ip_address(ipaddress) return "ok" except ValueError: return "ng"難易度

pythonの初学者にとってちょうどいいくらいのレベルなのかな?と思います。

私自身、python勉強して2ヶ月くらいでつくりました。

ただしWindowsの動きがわかってないと作るのが難しいとは思います。

同じようなソフトを作る方へ

pyinstallerでexe化ができますが、process.runを利用する場合は下記の記事を読んだ方がいいです。とても参照になりました。(ありがとうございます。)

https://sapporo-president.com/archives/15581普通にexeにすると動作しませんでした。

- 投稿日:2020-12-23T19:37:31+09:00

【2021年度版】Pythonインストール Windows10(64bit)編

はじめに

Pythonをインストールする機会が多いのでマニュアル化しました。

本記事はWindows10(64bit)向けです。Python3.9 インストール

Python公式のダウンロードページ(https://www.python.org/downloads) にアクセスして「Download Python」をクリックします。

ダウンロードしたexeファイルをクリックします。

ダイアログ画面が起動しましたら「Add Python 3.9 to Path」にチェックを入れて「Install now」をクリックしてインストールを開始します。※チェックは入れることで、環境変数の設定が不要となるため楽です。

「Setup was successful」と表示されればインストール成功のため「Close」をクリックして閉じます。

Pythonコマンドのチェック

正常にインストールされたことをチェックするため、コマンドプロンプトを起動して以下コマンドを入力して実行します。

python -V今回私がダウンロードしたバージョンはPython3.9.1になるため「Python 3.9.1」と表示されれば成功です。

最後に

特に難しい手順はないですね!読んでいただきありがとうございます。

- 投稿日:2020-12-23T19:05:56+09:00

OpenCV で動画を加工する

OpenCVで簡単に動画に任意の処理ができます。

1、ビデオを読み込んで書き込む

import cv2 cap = cv2.VideoCapture('./video.mp4') #読み込む動画のパス fps = cap.get(cv2.CAP_PROP_FPS) fourcc = cv2.VideoWriter_fourcc('m','p','4', 'v') #mp4フォーマット video = cv2.VideoWriter('./edited_video.mp4', fourcc, fps, (1920,1080)) #書き込み先のパス、フォーマット、fps、サイズ avg = None while True: # 1フレームずつ取得する。 ret, frame = cap.read() if not ret: break #? 任意の処理をここに書く ? video.write(frame) key = cv2.waitKey(30) if key == 27: break cap.release() video.release()2、処理を書く

例えば、動画をスケッチ風にするには、

1、の任意の処理のところに以下を入れます。#? 任意の処理をここに書く ? # 白黒画像に grayImage = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) # 白黒反転 grayImageInv = 255 - grayImage # ぼかしをかける grayImageInv = cv2.GaussianBlur(grayImageInv, (21, 21), 0) #blend using color dodge output = cv2.divide(grayImage, 255-grayImageInv, scale=256.0) output = cv2.cvtColor(output, cv2.COLOR_GRAY2BGR) video.write(output)?

フリーランスエンジニアです。

お仕事のご相談こちらまで

rockyshikoku@gmail.comCore MLを使ったアプリを作っています。

機械学習関連の情報を発信しています。

- 投稿日:2020-12-23T18:40:06+09:00

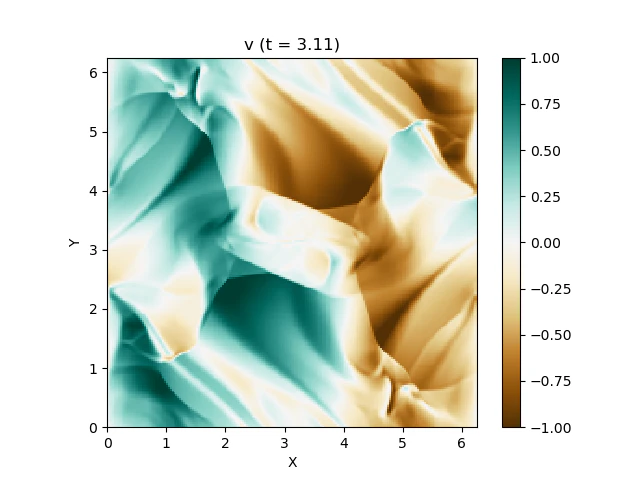

磁気流体の数値計算で遊ぶ

磁気流体とは

プラズマや液体金属のような電気伝導性の高い流体を扱う流体力学を磁気流体力学 (Magnetohydrodynamics) といいます。英語から略してよくMHDと呼ばれます。

この磁気流体の方程式系は保存形で書くと以下のようになります。\frac{\partial\mathbf{U}}{\partial t} + \frac{\partial\mathbf{F}}{\partial x} + \frac{\partial\mathbf{G}}{\partial y} + \frac{\partial\mathbf{H}}{\partial z}= \mathbf{0}\mathbf{U} = \begin{bmatrix} \rho \\ \rho u \\ \rho v \\ \rho w \\ B_x \\ B_y \\ B_z \\ e \end{bmatrix},\ \mathbf{F} = \begin{bmatrix} \rho u \\ \rho u^2+p_T-B_x^2 \\ \rho uv-B_xB_y \\ \rho uw-B_xB_z \\ 0 \\ B_yu-B_xv \\ B_zu-B_xw \\ \left(e+p_T\right)u-B_x\left(\mathbf{v}\cdot\mathbf{B}\right) \end{bmatrix},\ \mathbf{G} = \begin{bmatrix} \rho v \\ \rho vu-B_yB_x \\ \rho v^2+p_T-B_y^2 \\ \rho vw-B_yB_z \\ B_xv-B_yu \\ 0 \\ B_zv-B_yw \\ \left(e+p_T\right)v-B_y\left(\mathbf{v}\cdot\mathbf{B}\right) \end{bmatrix},\ \mathbf{H} = \begin{bmatrix} \rho w \\ \rho wu-B_zB_x \\ \rho wv-B_zB_y \\ \rho w^2+p_T-B_z^2 \\ B_xw-B_zu \\ B_yw-B_zv \\ 0 \\ \left(e+p_T\right)w-B_z\left(\mathbf{v}\cdot\mathbf{B}\right) \end{bmatrix}p = \left(\gamma-1\right)\left(e-\frac{1}{2}\rho|\mathbf{v}|^2-\frac{1}{2}|\mathbf{B}|^2\right),\ p_T = p+\frac{1}{2}|\mathbf{B}|^2ここで $\rho, p$ は密度・圧力で、$u, v, w$ はそれぞれ $x, y, z$ 方向の速度、$B_x, B_y, B_z$ はそれぞれ $x, y, z$ 方向の磁場、さらに $e$ はエネルギー密度を表しています。$\gamma$ は比熱比です。またここでは $\mu_0, 4\pi$ 等の磁場に関する係数が消える単位系を採用しています。

通常の流体と比べてみると、新たに磁場が変数として加わっていることがわかりますね。さて、この磁気流体の有名な問題にOrszag-Tang渦問題 (Orszag and Tang, 1979) というものがあります (Google画像検索) 。渦が衝撃波を形成しながら複雑に絡み合った模様が形成され、しかも数値的に発生する磁場発散を適切に除去できないと計算が破綻しやすいことが知られており、磁気流体計算の標準的なテスト問題としてよく用いられています。

具体的な設定は以下の通りです。\rho = \gamma^2,\ p = \gammau = -\sin y,\ v = \sin x,\ w = 0B_x = -\sin y,\ B_y = \sin 2x,\ B_z = 0\gamma = 5/3,\ 0\le x \le 2\pi,\ 0\le y \le 2\pi境界条件は $x, y$ 各方向に周期境界条件を課します。

今回はこれを解くのが目標です。最終的にはこんな図が出来上がります。HLLD近似リーマン解法

ここで一旦簡単のために1次元とします。このとき方程式系は以下のように書けます。

\frac{\partial\mathbf{U}}{\partial t} + \frac{\partial\mathbf{F}}{\partial x} = \mathbf{0}\mathbf{U} = \begin{bmatrix} \rho \\ \rho u \\ \rho v \\ \rho w \\ B_y \\ B_z \\ e \end{bmatrix},\ \mathbf{F} = \begin{bmatrix} \rho u \\ \rho u^2+p_T-B_x^2 \\ \rho uv-B_xB_y \\ \rho uw-B_xB_z \\ B_yu-B_xv \\ B_zu-B_xw \\ \left(e+p_T\right)u-B_x\left(\mathbf{v}\cdot\mathbf{B}\right) \end{bmatrix}1次元の場合マクスウェル方程式の

\nabla\cdot\mathbf{B} = 0から $B_x$ は時間・空間的に常に一定となるので、$B_x$ は方程式の独立変数から外してあります。

さて、上の $\mathbf{F}$ のヤコビアンの固有値を求めることで、この磁気流体には7個の特性速度

\lambda_1 = u-c_{fx}, \lambda_2 = u-c_{ax}, \lambda_3 = u-c_{sx}, \lambda_4 = u, \lambda_5 = u+c_{sx}, \lambda_6 = u+c_{ax},\lambda_7 = u+c_{fx}があることがわかります (導出はめちゃくちゃ面倒なので省略します)。ここで

a = \sqrt{\frac{\gamma p}{\rho}},\ c_{a} = \frac{|\mathbf{B}|}{\sqrt{\rho}}c_{ax} = \frac{|B_x|}{\sqrt{\rho}},\ c_{fx,sx} = \left[\frac{a^2+c_a^2\pm\sqrt{\left(a^2+c_a^2\right)^2-4a^2c_{ax}^2}}{2}\right]^{1/2}で、 $\lambda_2, \lambda_6$ はAlfvén波、$\lambda_1, \lambda_7$ は速進磁気音波 (fast magnetosonic wave)、$\lambda_3, \lambda_5$ は遅進磁気音波 (slow magnetosonic wave)、そして $\lambda_4$ はエントロピー波を表しています。

通常の流体が前後の音波とエントロピー波の合計3種類だったことを考えると、随分波の種類が増えています。うーんこれは大変そう。

何しろ多くの場合無視される遅進磁気音波抜きにしても5個です。これら多種多様な波を的確に捉えて計算するのは、通常の流体と比べてもかなり難易度が高くなります。そんななか、HLLD近似リーマン解法 (Miyoshi and Kusano, 2005) は精度・計算効率・ロバスト性いずれも優れた解法として広く用いられており、今回はこれを採用したいと思います。

ここで以下のような原点を境に不連続に配置された初期値問題を考えます。

\mathbf{U} = \begin{cases} \mathbf{U}_L & (x > 0) \\ \mathbf{U}_R & (x < 0) \end{cases}これをリーマン問題といい、HLLD法をはじめとする近似リーマン解法系のスキームでは、各セル内では $\mathbf{U}$ が一様になっていると近似して、各セルの境界毎のリーマン問題に帰着させます (下図)。

そこでHLLD法の説明に入る前に、より単純なHLL法を説明します (後でこの結果を使います)。リーマン問題の解は中心からさまざまな波が広がってゆく、という形になりますが、HLL法では左向きの波 $S_L$ と右向きの波 $S_R$ の2種類のみを考えます。さらに2つの波に囲まれた領域 (リーマンファン) 内で $\mathbf{U}$ は一定と近似します。

この2つの波には左右に一番速い速進磁気音波を選び、その速さはS_L = \mathrm{min}\left(u_L-{c_{fx}}_L, u_R-{c_{fx}}_R\right), S_R = \mathrm{max}\left(u_L+{c_{fx}}_L, u_R+{c_{fx}}_R\right)または

S_L = \mathrm{min}\left(u_L, u_R\right)-\mathrm{max}\left({c_{fx}}_L, {c_{fx}}_R\right), S_R = \mathrm{max}\left(u_L, u_R\right)+\mathrm{max}\left({c_{fx}}_L, {c_{fx}}_R\right)などと求めます。

方程式を $x-t$ 平面内でグリーンの定理を使って積分すると\iint_S\left(\frac{\partial\mathbf{U}}{\partial t}+\frac{\partial\mathbf{F}}{\partial x}\right)dxdt = \oint_c\left(-\mathbf{U}dx+\mathbf{F}dt\right) = \mathbf{0}となるので、下図積分路①について、

-S_R\mathbf{U}_R+S_L\mathbf{U}_L+\mathbf{F}_R-\mathbf{F}_L+\left(S_R-S_L\right)\mathbf {U}^* = \mathbf{0}積分路②について、

-S_R\mathbf{U}_R+\mathbf{F}_R-\mathbf{F}_{HLL}+S_R\mathbf {U}^* = \mathbf{0}したがって、中間状態の $\mathbf{U}^*$ と $\mathbf{F}_{HLL}$ は、

\begin{aligned} \mathbf{U}^* &= \frac{S_R\mathbf{U}_R-S_L\mathbf{U}_L-\mathbf{F}_R+\mathbf{F}_L}{S_R-S_L} \\ \mathbf{F}_{HLL} &= \mathbf{F}_R+S_R\left(\mathbf{U}^*-\mathbf{U}_R\right) \\ &= \frac{S_R\mathbf{F}_L-S_L\mathbf{F}_R+S_R S_L\left(\mathbf{U}_R-\mathbf{U}_L\right)}{S_R-S_L} \end{aligned}と得られます。

ここでは一旦 $S_L < 0 < S_R$ の場合を考えていますが、もし $S_L > 0$ の場合には $\mathbf{F}_L$ を、$S_R < 0$ の場合には $\mathbf{F}_R$ をそれぞれセル境界でのフラックスとすればOKです。

次に以上の方法を拡張してHLLD法を導出してみましょう。HLLD法ではリーマンファン内で $u$ が一定と仮定します。これによって $p_T$ も一定となり、遅進磁気音波が除外されます。なのでこの場合リーマン問題の解は、下図のように

- 速進磁気音波より速い領域 × 2

- 速進磁気音波とAlfvén波の間の領域 × 2

- Alfvén波とエントロピー波の間の領域 × 2

の6領域に分かれます。

ここから領域内の $\mathbf{U}$ を次々求めてゆきましょう。

まず前提から以下が成り立ちます。u^*_L = u^{**}_L = u^{**}_R = u^*_R \equiv S_M{p_T}^*_L = {p_T}^{**}_L = {p_T}^{**}_R = {p_T}^*_R \equiv {p_T}^*$S_M$ はHLL法で得られた $\rho_{HLL}$ と $\left(\rho u\right)_{HLL}$ を使って以下のように求めます。

S_M = \frac{\left(\rho u\right)_{HLL}}{\rho_{HLL}} = \frac{\left(S_R-u_R\right)\rho_R u_R-\left(S_L-u_L\right)\rho_L u_L-{p_T}_R+{p_T}_L}{\left(S_R-u_R\right)\rho_R-\left(S_L-u_L\right)\rho_L}速進磁気音波に対するジャンプ条件

まず速進磁気音波の前後で値がどのように変わるか見てみましょう。

そのために積分路①を下図のように半分ずつ $\mathbf{U}_R$ の領域と $\mathbf{U}^*_R$ の領域が入るようにとります。このとき

S_R\mathbf{U}_R-\mathbf{F}\left(\mathbf{U}_R\right) = S_R\mathbf{U}^*_R-\mathbf{F}\left(\mathbf{U}^*_R\right)で、これを具体的に成分で書くと以下のようになります。

S_R\begin{bmatrix} \rho_R \\ \rho_R u_R \\ \rho_R v_R \\ \rho_R w_R \\ {B_y}_R \\ {B_z}_R \\ e_R \end{bmatrix} - \begin{bmatrix} \rho_R u_R \\ \rho_R u_R^2+{p_T}_R-B_x^2 \\ \rho_R u_R v_R-B_x{B_y}_R \\ \rho_R u_R w_R-B_x{B_z}_R \\ {B_y}_R u_R-B_x v_R \\ {B_z}_R u_R-B_x w_R \\ \left(e_R+{p_T}_R\right)u_R-B_x \left(\mathbf{v}_R\cdot\mathbf{B}_R\right) \end{bmatrix} = S_R\begin{bmatrix} \rho^*_R \\ \rho^*_R S_M \\ \rho^*_R v^*_R \\ \rho^*_R w^*_R \\ {B_y}^*_R \\ {B_z}^*_R \\ e^*_R \end{bmatrix} - \begin{bmatrix} \rho^*_R S_M \\ \rho^*_R S_M^2+{p_T}^*-B_x^2 \\ \rho^*_R S_M v^*_R-B_x{B_y}^*_R \\ \rho^*_R S_M w^*_R-B_x{B_z}^*_R \\ {B_y}^*_R S_M-B_x v^*_R \\ {B_z}^*_R S_M-B_x w^*_R \\ \left(e^*_R+{p_T}^*\right)S_M-B_x \left(\mathbf{v}^*_R\cdot\mathbf{B}^*_R\right) \end{bmatrix}左側についても同様に考えることで、ここから $\mathbf{U}^*_\alpha$ が以下のように求められます。$\alpha$ はLまたはRという意味です。

\begin{aligned} \rho^*_\alpha &= \rho_\alpha\frac{S_\alpha-u_\alpha}{S_\alpha-S_M} \\ v^*_\alpha &= v_\alpha-B_x {B_y}_\alpha\frac{S_M-u_\alpha}{\rho_\alpha\left(S_\alpha-u_\alpha\right)\left(S_\alpha-S_M\right)-B_x^2} \\ w^*_\alpha &= w_\alpha-B_x {B_z}_\alpha\frac{S_M-u_\alpha}{\rho_\alpha\left(S_\alpha-u_\alpha\right)\left(S_\alpha-S_M\right)-B_x^2} \\ {B_y}^*_\alpha &= {B_y}_\alpha\frac{\rho_\alpha\left(S_\alpha-u_\alpha\right)^2-B_x^2}{\rho_\alpha\left(S_\alpha-u_\alpha\right)\left(S_\alpha-S_M\right)-B_x^2} \\ {B_z}^*_\alpha &= {B_z}_\alpha\frac{\rho_\alpha\left(S-u_\alpha\right)^2-B_x^2}{\rho_\alpha\left(S_\alpha-u_\alpha\right)\left(S_\alpha-S_M\right)-B_x^2} \end{aligned}\begin{aligned} p_T^* &= {p_T}_L+\rho_L\left(S_L-u_L\right)\left(S_M-u_L\right) \\ &= {p_T}_R+\rho_R\left(S_R-u_R\right)\left(S_M-u_R\right) \\ &= \frac{\left(S_R-u_R\right)\rho_R{p_T}_L-\left(S_L-u_L\right)\rho_L{p_T}_R+\rho_L\rho_R\left(S_R-u_R\right)\left(S_L-u_L\right)\left(u_R-u_L\right)}{\left(S_R-u_R\right)\rho_R-\left(S_L-u_L\right)\rho_L} \end{aligned}e^*_\alpha = \frac{\left(S_\alpha-u_\alpha\right)e_\alpha-{p_T}_\alpha u_\alpha+p_T^*S_M+B_x\left(\mathbf{v}_\alpha\cdot\mathbf{B}_\alpha-\mathbf{v}^*_\alpha\cdot\mathbf{B}^*_\alpha\right)}{S_\alpha-S_M}Alfvén波に対するジャンプ条件

次にAlfvén波の前後の変化を見るために、積分路②を下図のように半分ずつ $\mathbf{U}^*_R$ の領域と $\mathbf{U}^{**}_R$ の領域が入るようにとります。

ここで $S^{*}_L$ と $S^{*}_R$ は

S^*_L = S_M-\frac{|B_x|}{\sqrt{\rho^*_L}},\ S^*_R = S_M+\frac{|B_x|}{\sqrt{\rho^*_R}}ととります。積分路①の場合と同様にして、

S^*_R\mathbf{U}^*_R-\mathbf{F}\left(\mathbf{U}^*_R\right) = S^*_R\mathbf{U}^{**}_R-\mathbf{F}\left(\mathbf{U}^{**}_R\right)S^*_R\begin{bmatrix} \rho^*_R \\ \rho^*_R S_M \\ \rho^*_R v^*_R \\ \rho^*_R w^*_R \\ {B_y}^*_R \\ {B_z}^*_R \\ e^*_R \end{bmatrix} - \begin{bmatrix} \rho^*_R S_M \\ \rho^*_R S_M^2+{p_T}^*-B_x^2 \\ \rho^*_R S_M v^*_R-B_x{B_y}^*_R \\ \rho^*_R S_M w^*_R-B_x{B_z}^*_R \\ {B_y}^*_R S_M-B_x v^*_R \\ {B_z}^*_R S_M-B_x w^*_R \\ \left(e^*_R+{p_T}^*\right)S_M-B_x \left(\mathbf{v}^*_R\cdot\mathbf{B}^*_R\right) \end{bmatrix} = S^*_R\begin{bmatrix} \rho^{**}_R \\ \rho^{**}_R S_M \\ \rho^{**}_R v^{**}_R \\ \rho^{**}_R w^{**}_R \\ {B_y}^{**}_R \\ {B_z}^{**}_R \\ e^{**}_R \end{bmatrix} - \begin{bmatrix} \rho^{**}_R S_M \\ \rho^{**}_R S_M^2+{p_T}^*-B_x^2 \\ \rho^{**}_R S_M v^{**}_R-B_x{B_y}^{**}_R \\ \rho^{**}_R S_M w^{**}_R-B_x{B_z}^{**}_R \\ {B_y}^{**}_R S_M-B_x v^{**}_R \\ {B_z}^{**}_R S_M-B_x w^{**}_R \\ \left(e^{**}_R+{p_T}^*\right)S_M-B_x \left(\mathbf{v}^{**}_R\cdot\mathbf{B}^{**}_R\right) \end{bmatrix}となります。ここからわかるのは以下の $\rho^{**}_\alpha$ だけです。

\rho^{**}_\alpha = \rho^*_\alphaエントロピー波に対するジャンプ条件

さらに下図積分路③を考えます。

S_M\mathbf{U}^{**}_L-\mathbf{F}\left(\mathbf{U}^{**}_L\right) = S_R\mathbf{U}^{**}_R-\mathbf{F}\left(\mathbf{U}^{**}_R\right)S_M\begin{bmatrix} \rho^*_L \\ \rho^*_L S_M \\ \rho^*_L v^{**}_L \\ \rho^*_L w^{**}_L \\ {B_y}^{**}_L \\ {B_z}^{**}_L \\ e^{**}_L \end{bmatrix} - \begin{bmatrix} \rho^*_L S_M \\ \rho^*_L S_M^2+{p_T}^*-B_x^2 \\ \rho^*_L S_M v^{**}_L-B_x{B_y}^{**}_L \\ \rho^*_L S_M w^{**}_L-B_x{B_z}^{**}_L \\ {B_y}^{**}_L S_M-B_x v^{**}_L \\ {B_z}^{**}_L S_M-B_x w^{**}_L \\ \left(e^{**}_L+{p_T}^*\right)S_M-B_x \left(\mathbf{v}^{**}_L\cdot\mathbf{B}^{**}_L\right) \end{bmatrix} = S_M\begin{bmatrix} \rho^*_R \\ \rho^*_R S_M \\ \rho^*_R v^{**}_R \\ \rho^*_R w^{**}_R \\ {B_y}^{**}_R \\ {B_z}^{**}_R \\ e^{**}_R \end{bmatrix} - \begin{bmatrix} \rho^*_R S_M \\ \rho^*_R S_M^2+{p_T}^*-B_x^2 \\ \rho^*_R S_M v^{**}_R-B_x{B_y}^{**}_R \\ \rho^*_R S_M w^{**}_R-B_x{B_z}^{**}_R \\ {B_y}^{**}_R S_M-B_x v^{**}_R \\ {B_z}^{**}_R S_M-B_x w^{**}_R \\ \left(e^{**}_R+{p_T}^*\right)S_M-B_x \left(\mathbf{v}^{**}_R\cdot\mathbf{B}^{**}_R\right) \end{bmatrix}ここから以下のように $v^{**}$, $w^{**}$, ${B_y}^{**}$, ${B_z}^{**}$ が左右で等しいことが示されます。

\begin{aligned} v^{**}_L &= v^{**}_R \equiv v^{**} \\ w^{**}_L &= w^{**}_R \equiv w^{**} \\ {B_y}^{**}_L &= {B_y}^{**}_R \equiv {B_y}^{**} \\ {B_z}^{**}_L &= {B_z}^{**}_R \equiv {B_z}^{**} \end{aligned}これを踏まえ、今度は下図積分路④で積分します。

\begin{aligned} \mathbf{0} &= -S_R\mathbf{U}_R+S_L\mathbf{U}_L+\mathbf{F}_R-\mathbf{F}_L+\left(S_R-S^*_R\right)\mathbf{U}^*_R+\left(S^*_L-S_L\right)\mathbf{U}^*_L+\left(S^*_R-S_M\right)\mathbf{U}^{**}_R+\left(S_M-S^*_L\right)\mathbf{U}^{**}_L \\ &= -S^*_R\mathbf{U}^*_R+S^*_L\mathbf{U}^*_L+\mathbf{F}^*_R-\mathbf{F}^*_L+\left(S^*_R-S_M\right)\mathbf{U}^{**}_R+\left(S_M-S^*_L\right)\mathbf{U}^{**}_L \\ &= -\left(S_M+\frac{|B_x|}{\sqrt{\rho^*_R}}\right)\mathbf{U}^*_R+\left(S_M-\frac{|B_x|}{\sqrt{\rho^*_L}}\right)\mathbf{U}^*_L+\mathbf{F}^*_R-\mathbf{F}^*_L+\frac{|B_x|}{\sqrt{\rho^*_R}}\mathbf{U}^{**}_R+\frac{|B_x|}{\sqrt{\rho^*_L}}\mathbf{U}^{**}_L \end{aligned}ここから、

\begin{aligned} v^{**} &= \frac{\sqrt{\rho^*_L}v^*_L+\sqrt{\rho^*_R}v^*_R+\left({B_y}^*_R-{B_y}^*_L\right)\mathrm{sign}\left(B_x\right)}{\sqrt{\rho^*_L}+\sqrt{\rho^*_R}} \\ w^{**} &= \frac{\sqrt{\rho^*_L}w^*_L+\sqrt{\rho^*_R}w^*_R+\left({B_z}^*_R-{B_z}^*_L\right)\mathrm{sign}\left(B_x\right)}{\sqrt{\rho^*_L}+\sqrt{\rho^*_R}} \\ B_y^{**} &= \frac{\sqrt{\rho^*_L}{B_y}^*_R+\sqrt{\rho^*_R}{B_y}^*_L+\sqrt{\rho^*_L\rho^*_R}\left(v^*_R-v^*_L\right)\mathrm{sign}\left(B_x\right)}{\sqrt{\rho^*_L}+\sqrt{\rho^*_R}} \\ B_z^{**} &= \frac{\sqrt{\rho^*_L}{B_z}^*_R+\sqrt{\rho^*_R}{B_z}^*_L+\sqrt{\rho^*_L\rho^*_R}\left(w^*_R-w^*_L\right)\mathrm{sign}\left(B_x\right)}{\sqrt{\rho^*_L}+\sqrt{\rho^*_R}} \end{aligned}最後にAlfvén波に対するジャンプ条件をもう一度使うことで、以下が得られます。

e^{**}_\alpha = e^*_\alpha\mp\sqrt{\rho^*_\alpha}\left(\mathbf{v}^*_\alpha\cdot\mathbf{B}^*_\alpha-\mathbf{v}^{**}\cdot\mathbf{B}^{**}\right)\mathrm{sign}\left(B_x\right)複号はLのときマイナス、Rのときプラスをとります。

長くなりましたが、これで各領域の $\mathbf{U}$ がすべて求まりました。

以上をまとめますと最終的に以下の式になります。\mathbf{F}_{HLLD} = \begin{cases} \mathbf{F}_L & (0 < S_L) \\ \mathbf{F}_L^* & (S_L \le 0 < S_L^*) \\ \mathbf{F}_L^{**} & (S_L^* \le 0 < S_M) \\ \mathbf{F}_R^{**} & (S_M \le 0 < S_R^*) \\ \mathbf{F}_R^* & (S_R^* \le 0 < S_R) \\ \mathbf{F}_R & (S_R < 0) \end{cases}多次元化

多次元化を行うためには、単にHLLD法を $x,y,z$ 方向それぞれに適用すればよさそうな気がしますが、実際にはそう単純にはいかないところが磁気流体計算の難しさの一つです。

ここで問題になるのが磁場の発散です。本来ならマクスウェル方程式から磁場は常に非発散、つまり\nabla\cdot\mathbf{B} = 0でなければなりませんが、数値計算の場合誤差によってこれが破れることがあり、時には計算を破綻させてしまうほどの悪影響を及ぼします。これを回避する方法としては、大きく分けて

- 配置等を工夫することで磁場発散を初めから発生させない方法

- 方程式に変更を加えることで発生した磁場発散を抑制する方法

の2種類があります。前者はCT法が有名です。後者ではプロジェクション法や9 wave法が知られており、ここでは実装の比較的単純な9 wave法を紹介します。

9 wave法

Dedner et al. (2002) で提案された方法で、$\psi$ という新しい変数を導入して以下のように方程式を拡張します。

\frac{\partial\mathbf{U}}{\partial t} + \frac{\partial\mathbf{F}}{\partial x} + \frac{\partial\mathbf{G}}{\partial y} + \frac{\partial\mathbf{H}}{\partial z} = \mathbf{S}\mathbf{U} = \begin{bmatrix} \rho \\ \rho u \\ \rho v \\ \rho w \\ B_x \\ B_y \\ B_z \\ e \\ \psi \end{bmatrix},\ \mathbf{F} = \begin{bmatrix} \rho u \\ \rho u^2+p_T-B_x^2 \\ \rho uv-B_xB_y \\ \rho uw-B_xB_z \\ \psi \\ B_yu-B_xv \\ B_zu-B_xw \\ \left(e+p_T\right)u-B_x\left(\mathbf{v}\cdot\mathbf{B}\right) \\ c_h^2 B_x \end{bmatrix},\ \mathbf{G} = \begin{bmatrix} \rho v \\ \rho vu-B_yB_x \\ \rho v^2+p_T-B_y^2 \\ \rho vw-B_yB_z \\ B_xv-B_yu \\ \psi \\ B_zv-B_yw \\ \left(e+p_T\right)v-B_y\left(\mathbf{v}\cdot\mathbf{B}\right) \\ c_h^2 B_y \end{bmatrix},\ \mathbf{H} = \begin{bmatrix} \rho w \\ \rho wu-B_zB_x \\ \rho wv-B_zB_y \\ \rho w^2+p_T-B_z^2 \\ B_xw-B_zu \\ B_yw-B_zv \\ \psi \\ \left(e+p_T\right)w-B_z\left(\mathbf{v}\cdot\mathbf{B}\right) \\ c_h^2 B_z \end{bmatrix},\ \mathbf{S} = \begin{bmatrix} 0 \\ 0 \\ 0 \\ 0 \\ 0 \\ 0 \\ 0 \\ 0 \\ -\frac{c_h^2}{c_p^2}\psi \end{bmatrix}この $\psi$ は磁場発散を抑制するために人工的に導入された変数なので、何か物理的な意味があるわけではありません。

セル境界での $B_x$ と $\psi$ は以下のようにして求めます。

\begin{aligned} {B_x}_M &= {B_x}_L+\frac{1}{2}\left({B_x}_R-{B_x}_L\right)-\frac{1}{2c_h}\left(\psi_R-\psi_L\right) \\ \psi_M &= \psi_L+\frac{1}{2}\left(\psi_R-\psi_L\right)-\frac{c_h}{2}\left({B_x}_R-{B_x}_L\right) \end{aligned}実際の計算においては $\psi$ のソース項をそのまま計算するのではなく、一旦ソース項を忘れて他変数と同様にフラックスの差から $\psi^*$ を求めた後、以下のようにして $\psi^{n+1}$ を求めるのが一般的です。

\psi^{n+1} = \psi^*\exp\left(-\Delta t_n\frac{c_h^2}{c_p^2}\right)なおここで出てくる $c_h$ と $c_p$ は、$\nabla\cdot\mathbf{B}$ および $\psi$ に対する人工的な伝播と減衰の速さを表すフリーパラメータになります。

$c_h$ としてはCFL条件によって許される最大速度、c_h = \mathrm{CFL}\cdot\mathrm{min}\left(\Delta x, \Delta y, \Delta z\right)/\Delta t_n$c_p$ としては $c_r = c_p^2/c_h$ が定数となるようにした上で、$c_r = 0.18$ を選ぶのが空間解像度によらず最適となるようです。

高精度化

$\mathbf{F}_{i+1/2}$ を求める際、$\mathbf{U}_L$ として $\mathbf{U}_i$ を、$\mathbf{U}_R$ として $\mathbf{U}_{i+1}$ を選ぶのはいわゆる風上差分に相当し、1次の空間精度になります。

後で図をお見せしますが、実はこれ、数値拡散が大きくかなりぼやけた解になります。そこでここでは空間精度を上げる方法を紹介します。

また時間精度についても、常微分方程式でRunge-Kutta法を用いることで精度が上げられたように、偏微分方程式でも同様のことを考えることができます。

(そろそろ長くなって疲れてきました。。。)空間の高精度化

${\mathbf{U}_{i+1/2}}_L$ として例えば

{\mathbf{U}_{i+1/2}}_L = \frac{-\mathbf{U}_{i-1}+4\mathbf{U}_i+\mathbf{U}_{i+1}}{4}を使うようにすれば空間2次精度が得られますが、このように $\mathbf{U}$ を単純に線形に組み合わせるだけだと数値振動が発生してしまいあまり好ましくありません。

そこでこれを回避するために様々な非線形スキームが考案されています。ここでは2次精度のMUSCLと5次精度のMP5を簡単に紹介します。MUSCL

van Leer (1979) で提案された手法で、以下のようにリミッターを導入することで基本は2次精度を保ちつつ、不連続面では数値振動が発生しないように1次精度に落とすことができます。

\begin{aligned} {\mathbf{U}_{i+1/2}}_L &= \mathbf{U}_i+\frac{1}{2}\Delta_i \\ {\mathbf{U}_{i-1/2}}_R &= \mathbf{U}_i-\frac{1}{2}\Delta_i \end{aligned}\Delta_i = \mathrm{limiter}\left(\mathbf{U}_{i+1}-\mathbf{U}_i, \mathbf{U}_i-\mathbf{U}_{i-1}\right)リミッターとしては以下のminmod (Roe, 1986) やMC (van Leer, 1977) がよく使われるようです。

\begin{aligned} \mathrm{minmod}\left(a, b\right) &= \frac{1}{2}\left[\mathrm{sign}\left(a\right)+\mathrm{sign}\left(b\right)\right]\mathrm{min}\left(|a|, |b|\right) \\ \mathrm{MC}\left(a, b\right) &= \frac{1}{2}\left[\mathrm{sign}\left(a\right)+\mathrm{sign}\left(b\right)\right]\mathrm{min}\left(2|a|, \frac{|a+b|}{2}, 2|b|\right) \end{aligned}MP5

Suresh and Huynh (1997) による方法です。まず ${\mathbf{U}_{i+1/2}}_L$ を5次精度の線形スキームで補間します。

{\mathbf{U}_{i+1/2}}^*_L = \frac{2\mathbf{U}_{i-2}-13\mathbf{U}_{i-1}+4\mathbf{U}_i+47\mathbf{U}_{i+1}-3\mathbf{U}_{i+2}}{60}もちろんこのままでは数値振動が発生してしまうため、ある下限値 $\mathbf{U}_{\mathrm{min}}$ と上限値 $\mathbf{U}_{\mathrm{max}}$ を定め、それらの中央値を使って ${\mathbf{U}_{i+1/2}}_L$ を求めます。

{\mathbf{U}_{i+1/2}}_L = \mathrm{median}\left({\mathbf{U}_{i+1/2}}^*_L, \mathbf{U}_{\mathrm{min}}, \mathbf{U}_{\mathrm{max}}\right)具体的な $\mathbf{U}_{\mathrm{min}}$ と $\mathbf{U}_{\mathrm{max}}$ の求め方は結構長いのでここでは省略します。

時間の高精度化

\frac{d\mathbf{U}}{dt} = L\left(\mathbf{U}\right)と書けるとき、以下のように解くのはいわゆるオイラー法に相当し、1次の時間精度になります。

\mathbf{U}^{n+1} = \mathbf{U}^n+\Delta tL\left(\mathbf{U}^n\right)しかしこれもRunge-Kutta法を使えば精度を上げることができます。

今回はRunge-Kutta法のうちでも、特に余分な数値振動を発生させないという意味で性質の良いSSPRK (strong stability preserving Runge-Kutta) シリーズ (Shu and Osher, 1988) を載せておきます。2次精度 SSPRK (2, 2)

\begin{aligned} \mathbf{U}^{\left(1\right)} &= \mathbf{U}^n+\Delta tL\left(\mathbf{U}^n\right) \\ \mathbf{U}^{n+1} &= \frac{1}{2}\mathbf{U}^n+\frac{1}{2}\mathbf{U}^{\left(1\right)}+\frac{1}{2}\Delta tL\left(\mathbf{U}^{\left(1\right)}\right) \end{aligned}3次精度 SSPRK (3, 3)

\begin{aligned} \mathbf{U}^{\left(1\right)} &= \mathbf{U}^n+\Delta tL\left(\mathbf{U}^n\right) \\ \mathbf{U}^{\left(2\right)} &= \frac{3}{4}\mathbf{U}^n+\frac{1}{4}\mathbf{U}^{\left(1\right)}+\frac{1}{4}\Delta tL\left(\mathbf{U}^{\left(1\right)}\right) \\ \mathbf{U}^{n+1} &= \frac{1}{3}\mathbf{U}^n+\frac{2}{3}\mathbf{U}^{\left(2\right)}+\frac{2}{3}\Delta tL\left(\mathbf{U}^{\left(2\right)}\right) \end{aligned}結果

以上を踏まえて、MP5およびSSPRK (3, 3)を用いて計算した結果が以下になります。以下はすべて分割数 $N_x\times N_y = 200\times 200$, $\mathrm{CFL} = 0.4$ で計算しています。

上は圧力のプロットです。折り畳んだところを開けばすべての変数が見られます。

良い感じ!

スキームによる違い

せっかくなのでスキームによる違いも見てみましょう。以下の3種類を比較してみます。

- 風上差分・オイラー法 (空間1次・時間1次)

- MUSCL-minmod・SSPRK (2, 2) (空間2次・時間2次)

- MP5・SSPRK (3, 3) (空間5次・時間3次)

こうしてみると歴然とした違いがありますね。特に風上差分・オイラー法は同じ空間解像度のはずなのに随分ぼやけてしまっています。

磁場発散処理の有無による違い

次に磁場発散処理を入れなかったらどうなるか見てみます。

両者の違いが一番見やすかったMUSCL-minmod・SSPRK (2, 2)で比較します。...

...

磁場発散処理を入れないと破綻してしまいました。。。

とりあえず計算が壊れる直前の図を見比べてみます。

左にはいかにもヤバそうな、怪しい縞模様が見えますね。

$|\nabla\cdot\mathbf{B}|$ をプロットしてみると、ちょうどそこで大きな磁場発散が生じてしまっていることがわかります。一方で右ではうまく抑えられていますね。ソースコード

現時点でC++とPythonの2バージョンを作成しており、GutHubにて公開しています。

C++バージョンではOpenMPによる並列化を施しているので、$N_x\times N_y = 200\times 200$ のような大きなサイズの計算に適しています。なお、constexpr if文や構造化束縛を使っているのでコンパイルにはC++17以上が必要です。

一方Pythonバージョンではその場ですぐプロットするように作ったので、サクッと結果を見たい場合はこちらが良いかと思います。Pythonといってもfor文を排除してできるだけNumPyに計算を任せるようにしているので、そこそこのパフォーマンスになってくれる、はず。。。

長くなるのでここではPythonバージョンのみ載せておきます。

Pythonバージョンのソースコード