- 投稿日:2020-06-19T23:54:40+09:00

yukicoder contest 253 参戦記

yukicoder contest 253 参戦記

A 1081 和の和

結論的に ∑Ni=1 N-1Ci-1Ai になる. N≤100 なのでパスカルの三角形でも解けるだろうけど、めんどくさいのでいつもの mcomb を貼った.

N = int(input()) A = list(map(int, input().split())) m = 1000000007 fac = [0] * N fac[0] = 1 for i in range(N - 1): fac[i + 1] = fac[i] * (i + 1) % m def mcomb(n, k): if n == 0 and k == 0: return 1 if n < k or k < 0: return 0 return fac[n] * pow(fac[n - k], m - 2, m) * pow(fac[k], m - 2, m) % m result = 0 for i in range(N): result += mcomb(N - 1, i) * A[i] result %= m print(result)B 1082 XORのXOR

並べ替えた Ai を元にすると、X = A1 xor A2 xor A2 xor A3 xor ... xor AN - 1 xor AN - 1 xor AN となる. A1 xor A1 = 1 なので、X = A1 xor AN となる. 結果として任意の i != j の i, j について Ai xor Aj の最大値が答えとなる.

N = int(input()) A = list(map(int, input().split())) result = 0 for i in range(N - 1): for j in range(i + 1, N): result = max(result, A[i] ^ A[j]) print(result)C 1083 余りの余り

K を i で割ったとして、j > i である j については K % i % j = K % i である. なので A を大きい順にソートして、AN で割るまでの総当りをすれば良い. 前進するだけなので計算量は O(2N-1) となり解ける.

N, K = map(int, input().split()) A = list(map(int, input().split())) A.sort(reverse=True) def f(k, i): if i == N: return k result = -1 for j in range(i, N): result = max(result, f(k % A[j], j + 1)) return result print(f(K, 0))D 1084 積の積

結構いいところまで行っていた(テストケースの3/4がAC)が、解けずに終了.

f(l,r) が 109 以上とならない l, r を求めるのは尺取り法を使うというのはすぐ分かる. f(l,r) が 109 未満のとき、l≤x≤r である x について f(x,r) も当然 109 未満だが、これをループで解に畳み込んでいくと、最大 N=105 の O(N2) になってしまうので TLE 必至. つまり、尺取り法のアキュムレータとは別にもう一つアキュムレータが必要となる.

例として、1,2,3 に4を追加することを考える. もう一つのアキュムレータを a とおくと4を追加する前は a=(1×2×3)×(2×3)×(3) となる. これを a=(1×2×3×4)×(2×3×4)×(3×4)×(4) に変えることになる. つまり変更操作は a = a×44 となる. 要するに「追加する数追加後の尺取りの長さ」を掛けることになる.

次に左端の1を削除することを考える. これは a=(1×2×3×4)×(2×3×4)×(3×4)×(4) を a=(2×3×4)×(3×4)×(4) に変更する操作で、1×2×3×4 を無くす操作となる. ちょうど尺取り法のアキュムレータが 1×2×3×4 で一致しているので、尺取り法のアキュムレータで割ればいい(といっても 1000000007 の mod なのでフェルマーの小定理を使うことになるが).

以上が分かっていれば、O(logN) の冪乗関数を使って、O(NlogN) で解が求めれる.

N = int(input()) A = list(map(int, input().split())) m = 1000000007 l = 0 a = 1 b = 1 result = 1 for r in range(N): a *= A[r] b *= pow(A[r], r - l + 1, m) b %= m while a >= 1000000000: b *= pow(a, m - 2, m) a //= A[l] l += 1 result *= b result %= m print(result)

- 投稿日:2020-06-19T23:45:26+09:00

【強化学習】OpenAI Gym を Google Corab上で描画する方法 (2020.6版)

0. はじめに

Google Colab上でOpenAI Gym を描画する方法を調べたのでメモ。

参考にしたサイト群

- ColaboratoryでOpenAI gym

- ChainerRL を Colaboratory で動かす

- OpenAI GymをJupyter notebookで動かすときの注意点一覧

- How to run OpenAI Gym .render() over a server

- Rendering OpenAI Gym Envs on Binder and Google Colab

1. 課題

gym.Envのrender()メソッドで環境を表示しようとする際にNoSuchDisplayExceptionエラーが出る。import gym env = gym.make('CartPole-v1') env.reset() env.render()NoSuchDisplayException Traceback (most recent call last) <ipython-input-3-74ea9519f385> in <module>() 2 env = gym.make('CartPole-v1') 3 env.reset() ----> 4 env.render()2. 対策

調べた限り、Colab上でGymの描画機能を利用する方法は3通りあることがわかった。

どの方法も長短あり、1つに絞ることができなかったので、3種類とも記載する。2.1 共通の準備

3種類いずれの方法でも、X11の仮想ディスプレイであるXvfbを利用するので、インストールする。

!apt update !apt install xvfb(Dockerイメージなどで独自にJupyter Notebookを起動させる際には、OpenGL関連も必要なため、

apt install python-openglとする。)さらに、Xvfbを Google Colab (Jupyter Notebook)上から利用するために、PyVirtualDisplayを利用する。

!pip install pyvirtualdisplay from pyvirtualdisplay import Display d = Display() d.start()

"DISPLAY"環境変数に{ディスプレイ番号}.{スクリーン番号}を設定するという記述があるサイトもあったが、不要だとPyVirtualDisplayの作者に教えてもらった。曰く、スクリーン番号は、複数ディスプレイがある状況で利用する値で、PyVirtualDisplayでは1つしか画面を生成しないので

0固定であり、かつスクリーン番号を書かないと自動的に0と解釈されるためだと。(StackOverflow参照)もっと言えば、

pyvirtualdisplay.Display.start()の中で環境変数を設定しているので、外部から変更することは必要ないとのことであった。

(少なくとも、2020年6月18日時点の最新版である1.3.2で確認済み)2.2 方法1

1つ目はシンプルにmatplotlibで画面データを描画しては消しを繰り返す方法である。

あまり速くない、かつ1回しか表示されないことがデメリットだが、描画データを保持せず上書きし続けるので、描画データが長くなっても対応できる方法である。

import gym from IPython import display from pyvirtualdisplay import Display import matplotlib.pyplot as plt d = Display() d.start() env = gym.make('CartPole-v1') o = env.reset() img = plt.imshow(env.render('rgb_array')) for _ in range(100): o, r, d, i = env.step(env.action_space.sample()) # 本当はDNNからアクションを入れる display.clear_output(wait=True) img.set_data(env.render('rgb_array')) plt.axis('off') display.display(plt.gcf()) if d: env.reset()2.3 方法2

2つ目は、

matplotlib.animation.FuncAnimationを使ってアニメーションを表示する方法である。描画画面を繰り返し表示することができ、フレームごとの表示速度を自由に設定できる一方、描画データを保持しておく必要があるためメモリーを多く必要とし、表示する画面サイズや表示枚数を調整しないとメモリーエラーを起こしうる。

(長ーい学習の途中で、エラーを出されると・・・。)import gym from IPython import display from pyvirtualdisplay import Display import matplotlib.pyplot as plt from matplotlib import animation d = Display() d.start() env = gym.make('CartPole-v1') o = env.reset() img = [] for _ in range(100): o, r, d, i = env.step(env.action_space.sample()) # 本当はDNNからアクションを入れる display.clear_output(wait=True) img.append(env.render('rgb_array')) if d: env.reset() dpi = 72 interval = 50 # ms plt.figure(figsize=(img[0].shape[1]/dpi,img[0].shape[0]/dpi),dpi=dpi) patch = plt.imshow(img[0]) plt.axis=('off') animate = lambda i: patch.set_data(img[i]) ani = animation.FuncAnimation(plt.gcf(),animate,frames=len(img),interval=interval) display.display(display.HTML(ani.to_jshtml()))2.4 方法3

最後は、

gym.wrappers.Monitorを利用して描画データを動画として保存する方法である。

render()メソッドは不要で、step(action)メソッドを呼び出す際に自動で保存される。import base64 import io import gym from gym.wrappers import Monitor from IPython import display from pyvirtualdisplay import Display d = Display() d.start() env = Monitor(gym.make('CartPole-v1'),'./') o = env.reset() for _ in range(100): o, r, d, i = env.step(env.action_space.sample()) # 本当はDNNからアクションを入れる if d: env.reset() for f in env.videos: video = io.open(f[0], 'r+b').read() encoded = base64.b64encode(video) display.display(display.HTML(data=""" <video alt="test" controls> <source src="data:video/mp4;base64,{0}" type="video/mp4" /> </video> """.format(encoded.decode('ascii'))))3. ライブラリ: Gym-Notebook-Wrapper

上記の方法を毎回書くのは面倒なため、ライブラリ化した。

- Gym-Notebook-Wrapper | GitLab.com

- Gym-Notebook-Wrapper | GitHub.com (ミラーレポジトリ)

- Gym-Notebook-Wrapper | PyPI

3.1 インストール

PyPIに公開しているので、

pip install gym-notebook-wrapperでインストールできる。!apt update && apt install xvfb !pip install gym-notebook-wrapperもちろん、Google Colab以外でも利用できるが、 Xvfb を利用するためLinuxが前提。

3.2 使い方

gym-notebook-wrapper だと、長いしハイフン(

-)が入っているので、 インポートできるモジュール名はgnwrapperにしてある。

- 方法1 →

gnwrapper.Animation- 方法2 →

gnwrapper.LoopAnimation- 方法3 →

gnwrapper.Monitor3.2.1

gnwrapper.Animation(= 2.2 方法1)import gnwrapper import gym env = gnwrapper.Animation(gym.make('CartPole-v1')) # Xvfbが起動される o = env.reset() for _ in range(100): o, r, d, i = env.step(env.action_space.sample()) # 本当はDNNからアクションを入れる env.render() # ここで、前の描画を消し、新しいステップの描画を行う。 if d: env.reset()3.2.2

gnwrapper.LoopAnimation(= 2.3 方法2)import gnwrapper import gym env = gnwrapper.LoopAnimation(gym.make('CartPole-v1')) # Xvfbが起動される o = env.reset() for _ in range(100): o, r, d, i = env.step(env.action_space.sample()) # 本当はDNNからアクションを入れる env.render() # ここで、描画データを保存する if d: env.reset() env.display() # ここで、保存した描画データをアニメーションとして表示する3.2.3

gnwrapper.Monitor(= 2.4 方法3)import gnwrapper import gym env = gnwrapper.Monitor(gym.make('CartPole-v1'),directory="./") # Xvfbが起動される o = env.reset() for _ in range(100): o, r, d, i = env.step(env.action_space.sample()) # 本当はDNNからアクションを入れる if d: env.reset() env.display() # ここで、ビデオとして保存した描画データを表示する4. 最後に

ネット上に色々記載されている情報を整理して、OpenAI GymをGoogle Colab上で描画する方法を3種類まとめた。

何度か実際に走らせて確認したコードのはずだけど、コピペミスとかしてたらすみません。Gym-Notebook-Wrapperはまだまだ荒削りでバグもあるかもしれないので、何かあれば気軽に issue を立ててもらえると嬉しい。

- 投稿日:2020-06-19T23:28:43+09:00

Tacotron2で始める日本語音声合成

はじめに

最も気になるのはやはりどの程度のものができるのかだと思うので、まずはこちらをお聞きください。

このモデルは

- pre-trained model を使用した転移学習

- 約一時間の前処理済みのデータ

- WaveGlow (published model)

で学習、推論しています。

これから始める方の参考になるように私のやり方を紹介します。Tacotron2についてはこちらが参考になります。

Tacotron2を用いた日本語TTS(Text-to-Speech)の研究・開発【まとめ】※デモを既に動かしていることを前提としています。

用意するもの

音声ファイル

- 22050Hz 16bit モノラル wav

- 音声区間毎に分割

ノイズが多いもの、笑い声等のテキストにしづらいものは除外します。

長過ぎるものは学習時にメモリエラーが出ることがあります。私は10秒以内のもののみにしています。テキスト

train.txt val.txt を作成

ljs_audio_text_val_filelist.txt を参考に

FILE PATH|TEXT

と表記していきます。

trainとvalのバランスは私は9:1にしています。音素バランスなどは考慮していません。音素表記

TEXTは下記を参考に音素で表記していきます。

wiki 日本語の音素

声優統計コーパス 音素バランス文使用できる文字はsymbols.pyの要素のみです。

このとき注意する点として

koNnichiwaと入力するとTacotron2の内部では['k','o','n','n','i','c','h','i','w','a']と変換されます。

もし['k','o','N','n','i','ch','i','w','a']としたいのであれば{}で囲う必要があります。

ただし使用できるのはcmudict.pyのvalid_symbols内の要素のみです。

ですのでko{N}ni{CH}iwaとする必要があります。また

k o {N} n i {CH} i w aというような表記でも良いかとおもいます。私はkonnnichiwaとしています。文末にEOSを追加

Model can not converge #254

学習時にattentionの収束が加速されるそうです。例

私はこのようにしています。

train.txt/wav/0126.wav|na&tanndesukedo-. /wav/0022.wav|biyo-inndake-yoyakuwasimasita. /wav/0149.wav|tasikani,ari!. /wav/0092.wav|sositara-. /wav/0063.wav|teyu-ne. /wav/0202.wav|donndonn,tama&tekunndesuyo.設定

hparams.pyを編集

- iters_per_checkpoint

好きな数値に変更- training_files

train.txtのpath- validation_files

val.txtのpath- text_cleaners

['basic_cleaners']に変更

transliteration_cleaners についてはこちらが参考になります。

Tacotron2系における日本語のunidecodeの不確かさ- batch_size

私は32にしています。issuesなどを見ると8~16くらいにしてる方が多いようです。GPUと相談して決めてください。train.pyにexponential learning rate decayを追加

学習

pre-trained model を使用して学習していきます。

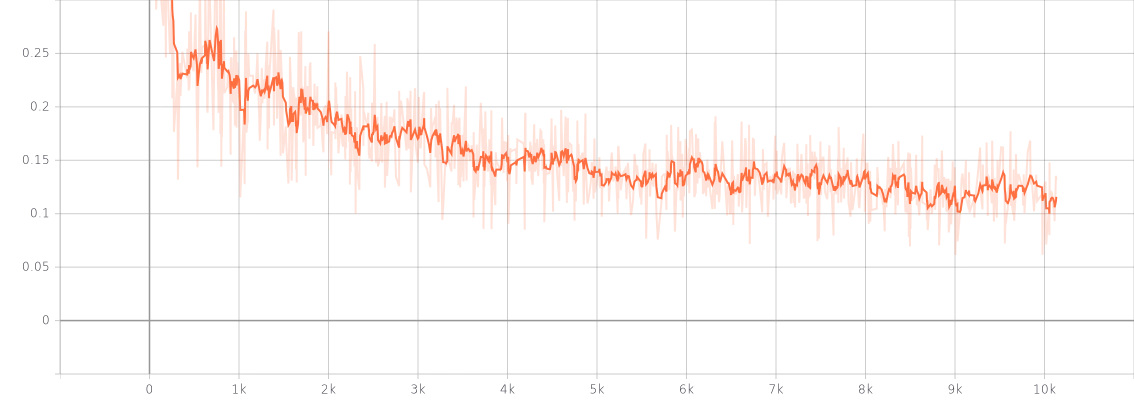

10k iterの結果です。Colab T4で約6時間半でした。

grad.norm

推論

各checkpointの結果です。

sigma=1,denoiser未使用

- 投稿日:2020-06-19T23:24:52+09:00

Djangoのテンプレート内で定数を扱う

はじめに

Djangoのテンプレート内でドメイン名やサイト名などの基本的に固定となる定数値を扱いたいとき、Context Processorという機能を利用して、都度ビュー側から定数を渡さずにテンプレート内から定数のように扱うことができます。

環境

- Django 2.2

Context Processor とは

Context Processorはビューからテンプレートへコンテキストオブジェクトを渡す際に変数を追加する処理を記述できる関数です。

テンプレート内で利用するcsrf_token等がこの仕組みで実装されています。Context Processor の作成

Context Processorは

HTTP Requestオブジェクトを引数として、辞書型のオブジェクトを返す関数として定義します。関数の名前は任意の名前で作成し、ファイルはアプリケーションのディレクトリ配下等に作成します。

hogeapp/context_processors.pydef my_context_processor(req): return { 'domain_name': 'https://hogehoge.com', 'site_name': 'Hogehoge Site', }上記の例では単純に辞書オブジェクトを返却しているのみですが、通常の関数同様に処理を記述することもできます。これを利用して外部ファイルに別で定義した定数を参照したり、環境変数の値から環境によって値を変える等の使い方も可能です。

config.py設定

作成したContext Processorを利用するには、

config.pyへの設定が必要になります。

config.pyで定義されているTEMPLATESのOPTIONSにあるcontext_processorsへ前項で作成した関数を追加します。config.pyTEMPLATES = [ { 'OPTIONS': { 'context_processors': [ 'django.contrib.auth.context_processors.auth', 'django.contrib.messages.context_processors.messages', 'hogeapp.context_processors.my_context_processor', # 追加 ], }, }, ]テンプレートからの呼び出し方法

Context Processorで追加される変数は、テンプレート内から通常のコンテキストの変数と同じように利用できます。

template.html<link rel="icon" href="{{ domain_name }}/favicon.ico"> <title>{{ site_name }}</title>参考

The Django template language: for Python programmers | Django ドキュメント | Django

https://docs.djangoproject.com/ja/2.2/ref/templates/api/#writing-your-own-context-processors

- 投稿日:2020-06-19T23:15:50+09:00

csvデータを取り出し、計算する

csvデータを取り扱う

データ分析をするとき、cvsデータの扱い方を毎回忘れてしまうので、メモとしてまとめておきたいと思います。

csvを読み込む

import pandas as pd pd.read_csv('data.csv')

UnicodeDecodeError: 'utf-8' codec can't decode byte 0x8e in position 0: invalid start byteとエラーが出てきてしまいました。pd.read_csv('data.csv' , encoding='cp932')

encoding='cp932'を後ろに付けたらちゃんと表示されました。csvデータから列・行を取り出す

csvから1行または1列だけデータを取得

df = pd.read_csv('data.csv' , encoding='cp932') df.iloc[0,:] #1行目すべてのデータを取り出す df.iloc[:,2] #3列目すべてのデータを取り出すpandas.DataFrameの行を取得

[行名・行番号のスライス]: 複数行を取り出す

df[1:4] #1行目から3行目まで取り出す列ごとに合計を計算する

1列のデータをすべて足して合計を出す

df.iloc[:,3].sum() #4列目のデータの合計を出すcsvデータをfor文で計算

csvデータの列データを一定の数で割りたいとき

#csvデータの3列目の数値をそれぞれ2で割る w = df.iloc[:,2] for i in w: d = i / 2 print(d)

- 投稿日:2020-06-19T22:58:03+09:00

ゼロから始めるLeetCode Day61「7. Reverse Integer」

概要

海外ではエンジニアの面接においてコーディングテストというものが行われるらしく、多くの場合、特定の関数やクラスをお題に沿って実装するという物がメインである。

どうやら多くのエンジニアはその対策としてLeetCodeなるサイトで対策を行うようだ。

早い話が本場でも行われているようなコーディングテストに耐えうるようなアルゴリズム力を鍛えるサイトであり、海外のテックカンパニーでのキャリアを積みたい方にとっては避けては通れない道である。

と、仰々しく書いてみましたが、私は今のところそういった面接を受ける予定はありません。

ただ、ITエンジニアとして人並みのアルゴリズム力くらいは持っておいた方がいいだろうということで不定期に問題を解いてその時に考えたやり方をメモ的に書いていこうかと思います。

Python3で解いています。

前回

ゼロから始めるLeetCode Day60「1481. Least Number of Unique Integers after K Removals」今はTop 100 Liked QuestionsのMediumを優先的に解いています。

Easyは全て解いたので気になる方は目次の方へどうぞ。Twitterやってます。

問題

難易度はEasy。

32ビット符号付き整数xが与えられたとき、整数の逆数を計算するアルゴリズムを設計してください、という問題です。Input: 123

Output: 321Input: -123

Output: -321Input: 120

Output: 21解法

Pythonの場合はスライスと

absを使えば要素の指定と絶対値の管理ができるので比較的解きやすいのではないかと思います。他の言語については知りませんが、スタックを使って解くのが一般的なのかもしれませんね。

今回は32bit整数という前提があるため、処理に入る前に別の桁を追加してもオーバーフローしないかを事前に確認しておく方が良いでしょう。

Pythonではint型に最大値がないのでメモリの有る限りいくらでも計算できます。

なので以下のように自分で設定しておく必要があります。max_32 = 2**31 - 1最初にこの値より

xが大きかった場合は無条件で0を返すときちんと場合分けできていると思います。そして、この後の分岐ですが、正の値ならば後ろから要素を取ってあげて、負の値ならば絶対値の逆から要素を取ってあげて代入する前に

-を付けてあげます。Pythonでは負の値ならば代入する要素の先頭に

-を付けてあげると反転し直した後にも-がついた状態になります。反転させたものを内包表記で書けば良くない?と思う方がいらっしゃるかもしれませんが、これだけで処理を終わらせてしまってはオーバーフローする可能性がまだ残っている可能性があります。

なので、最後の分岐に仮にオーバーフローしそうなら0を返し、それ以外の場合にのみ反転した値を返せば完成です。

これらの一連の流れをまとめたものが以下になります。

class Solution: def reverse(self, x: int) -> int: max_32 = 2**31 - 1 if abs(x) > max_32: return 0 if x < 0: reverse_int = -int(str(abs(x))[::-1]) else: reverse_int = int(str(x)[::-1]) if abs(reverse_int) > max_32: return 0 else: return reverse_int # Runtime: 28 ms, faster than 86.13% of Python3 online submissions for Reverse Integer. # Memory Usage: 14 MB, less than 9.77% of Python3 online submissions for Reverse Integer.そういえば新しくブログを始めました。

Qiitaでも発信は続けて行く予定ですが、まったりとした内容で書ける技術・ガジェットブログみたいな感じで書く予定なので興味ある方はプロフィールからどうぞ。今回はここまで。お疲れ様でした。

- 投稿日:2020-06-19T22:26:46+09:00

[光-Hikari-のPython]<補足>06章-05 関数(引数と戻り値4)

[Python]<補足>06章-05 引数と戻り値4

06章-04で関数における引数がリストだった場合について説明しました。

そのほかのデータ構造である、タプルやディクショナリを引数として受け取るもできます。今回はタプルとディクショナリを引数として受け取ることについて取り扱いたいと思います。

なお、この節は<補足>としていますので、時間のない方は読み飛ばしていただいても構いません。なお、基本情報技術者試験では今後タプルやディクショナリの引数の扱いをするといった問題も出題されることが予測されるため、目を通しておきましょう。

任意の数の引数~タプルで受け取る~

関数を呼び出す際に、実引数と仮引数の数は以下のプログラムのように一致させないといけません。chap06の中に、samp06-05-01.pyというファイル名でファイルを作成し、以下のコードを書いてください。

samp06-05-01.pydef called_func(x, y, z): print('関数内で実行しています。') print(x, y, z) #called_func(2) #←引数の数が一致していないので、関数を呼び出すとエラーとなります called_func(4, -1, 2)【実行結果】

関数内で実行しています。

4 -1 2最初の関数の呼び出しcalled_func(2)では実引数の数が1個ですが、仮引数の数は3つとなっており、一致していません。そのため、このコメントを外すとエラーとなります。

次に呼び出しているcalled_func(4, -1, 2)では、実引数と仮引数の数が一致しているため、呼び出すことができます。

しかし、Pythonの関数では、任意の数の引数を受け取ることができるのです。それが以下の方法です。先ほど書いたプログラムsamp06-05-01.pyを修正して、以下のコードを書いてください。

samp06-05-01.pydef called_func(*args): print('関数内で実行しています。') print(args) called_func(2) #←今度は呼び出せます called_func(4, -1, 2)【実行結果】

関数内で実行しています。

(2,)

関数内で実行しています。

(4, -1, 2)仮引数に*(アスタリスク)を付けると、タプルとして受け取っていることがわかります。

なお、関数内で*argsの中身を出力していますが、出力する際には*は不要です。また*argsという仮引数名を使用していますが、実際は何でも構いません。ただし、ほとんどの方が(慣習的に)argsを使用しています。

※argsはargumentの略では引数という意味です。任意の数のキーワード引数~ディクショナリの受け取り~

06章-03でキーワード引数について取り扱いました。実はこのキーワード引数を実引数で指定し、仮引数でまとめて任意の数を受け取ることができます。

chap06の中に、samp06-05-02.pyというファイル名でファイルを作成し、以下のコードを書いてください。samp06-05-02.pydef called_func(**kwargs): print('関数内で実行しています。') print(kwargs) called_func(x=1, y=2, z=3)【実行結果】

関数内で実行しています。

{'x': 1, 'y': 2, 'z': 3}実引数にキーワード引数を、仮引数に**(アスタリスク2つ)を付けると、ディクショナリとして受け取っていることがわかります。

なお、関数内で**kwargsの中身を出力していますが、出力する際には**は不要です。また**kwargsという仮引数名を使用していますが、実際は何でも構いません。ただし、ほとんどの方が(慣習的に)**kwargsを使用しています。最後に

引数の受け取り方は多種ありますので、押さえておきましょう。タプルやディクショナリとして受け取るといったケースは見かける機会はあまりないですが、こういったこともできるということは把握しておいてください。ただし、情報処理技術者試験では出題される可能性はありますので注意しましょう。

【目次リンク】へ戻る

- 投稿日:2020-06-19T21:31:12+09:00

コスパ最強IoT家電!TPLink製品をRaspberryPiから操作

TPLinkとは?

ルータを主力とする中国・深圳のネットワーク機器メーカーです。

近年はスマート電球、スマートプラグ等のIoT家電に力を入れており、コスパの良さからAmazonで独自の地位を築いています。今回は、APIを使用して、

・機器のON-OFF操作

・ON-OFF、電球の明るさ等の情報取得

を、PythonおよびNode.jsで実行してみましたIoT家電として思いつく用途の多くを上記でカバーできるので

応用の可能性を感じる結果となりました!必要なもの

・PC

・RaspberryPi

・TPLink製スマートプラグあるいは電球

今回は下記3製品を試しました

HS105:スマートプラグ

KL110:ホワイト電球

KL130:カラー電球①データ取得の確認

まずは、TPLinkからデータが取得できるかターミナル上でテストします。

※参考にさせて頂いた記事

https://lmjs7.net/blog/tag/tp-link/

https://qiita.com/tmisuoka0423/items/582ff0c303abe8570ee5IPを調べる

tplink-smarthome-api(参考)をインストール

sudo npm install -g tplink-smarthome-api下記コマンドで、接続しているTPLinkデバイス一覧を取得

tplink-smarthome-api searchHS105(JP) plug IOT.SMARTPLUGSWITCH 192.168.0.101 9999 B0BE76‥ スマートプラグ KL110(JP) bulb IOT.SMARTBULB 192.168.0.102 9999 98DAC4‥ ホワイト電球 KL130(JP) bulb IOT.SMARTBULB 192.168.0.103 9999 0C8063‥ カラー電球3つのデバイス全てが検出できていることが分かります

デバイス動作情報の取得確認

下記コマンドで、デバイスの設定やOnOffが取得できる

tplink-smarthome-api getSysInfo [デバイスのIPアドレス]:9999・KL130(カラー電球)の例

: ctrl_protocols: { name: 'Linkie', version: '1.0' }, ↓ここからがデバイスの設定 light_state: { on_off: 1, mode: 'normal', hue: 0, saturation: 0, color_temp: 2700, brightness: 100 }, ↑ここまでがデバイスの設定 is_dimmable: 1, is_color: 1, :on_off:0なら電源OFF、1なら電源ON

hue:色?(白色モードのとき0)

color_temp:色温度(白色モード以外のとき0)

brightness:明るさ(%単位)

と思われます・KL110(ホワイト電球)の例

: ctrl_protocols: { name: 'Linkie', version: '1.0' }, ↓ここからがデバイスの設定 light_state: { on_off: 1, mode: 'normal', hue: 0, saturation: 0, color_temp: 2700, brightness: 100 }, ↑ここまでがデバイスの設定 is_dimmable: 1, is_color: 0, :on_off:0なら電源OFF、1なら電源ON

hue:色相(白色モードのとき0)

saturation:彩度

color_temp:色温度(白色モード以外のとき0)

brightness:明るさ(%単位)

と思われます。

KL130とほぼ同じですが、カラーではないのでis_color: 0となっていると思われます。・KL105(スマートプラグ)の例

alias: '', ↓ここからがデバイスの設定 relay_state: 1, on_time: 288, active_mode: 'none', feature: 'TIM', updating: 0, icon_hash: '', rssi: -52, led_off: 0, longitude_i: 1356352, latitude_i: 348422, ↑ここまでがデバイスの設定 hwId: '047D‥',relay_state:0なら電源OFF、1なら電源ON

on_time:連続電源ON時間

rssi: WiFiの信号強度

と思われます。

経度(logitude)と緯度(latitude)も表示されていますが、実際の場所と5キロくらいずれていて謎が深まります。上記で、コマンドで欲しい情報が取得できることが確認できました!

次章以降で、プログラム(Node.js&Python)から取得・操作する方法を記載します。②Node.jsで状態取得

※「Pythonを使うからNode.jsの説明はいらん!」という方は、この章を飛ばして③に移動してください

こちらを参考に、Node.jsを

npmにパスを通す(Windowの場合)

Windowsだとnpmのグローバルインストール先にパスが通っておらず、Node.jsでモジュールが読み込めないので、下記を参考にパスを通してください

https://qiita.com/shiftsphere/items/5610f692899796b03f99npmにパスを通す(RaspberryPiの場合)

下記コマンドで、グローバルでのnpmモジュールインストール先を調べます

(なぜかWindowsのときのコマンド"npm bin -g"で見つかるフォルダとは違うようです)npm ls -g下記コマンドで.profileを編集します。

※SSH環境では.profileの代わりに、.bash_profileを編集してくださいnano /home/[ユーザ名]/.profile.profileの最後に下記の1行を追加してrebootしてください

export NODE_PATH=[上で調べたパス]/node_modules下記コマンドで指定したパスが表示されれば成功です

printenv NODE_PATHnode.jsスクリプトの作成

下記スクリプトを作成します

tplink_test.jsconst { Client } = require('tplink-smarthome-api'); const client = new Client(); client.getDevice({ host: '192.168.0.102' }).then(device => { device.getSysInfo().then(console.log); });下記コマンドでスクリプトを実行すると、①と同様に各種情報が取得できます

node tplink_test.js※上記をcsvロギングするスクリプト(③のPythonスクリプトと同機能)も作成しましたが、私のJavaScriptスキルが低くうまく動作しないときがある(非同期部分の処理順が逆転する)ので、コードはここには貼らないこととします

下記GitHubにアップロードしたので、自己責任で改造して使用していただければと思います。

(願わくば無知な私に処理順が逆転する理由もコメント…頂けると嬉しいです笑)

https://github.com/c60evaporator/TPLink_Info_Nodejs③Pythonで状態取得

私のJavaScriptスキル不足でNode.jsでのロギングが上手くいかなかったので、

気を取り直してPythonで操作・ロギングするスクリプトを作りました。PythonはNode.jsほど丁寧なドキュメントが見当たらず苦戦しましたが、こちらやこちらのコードを解読して、スクリプトを作成しました。

TPLink操作クラスの作成

上記コードを参考に、下記の4つのクラスを作成しました

TPLink_Common():プラグ、電球共通機能のクラス

TPLink_Plug():プラグ専用機能のクラス(TPLink_Common()を継承)

TPLink_Bulb():電球専用機能のクラス(TPLink_Common()を継承)

GetTPLinkData():上記クラスを利用して、データを取得するクラスtplink.pyimport socket from struct import pack import json #TPLinkデータ取得用クラス class GetTPLinkData(): #プラグデータ取得用メソッド def get_plug_data(self, ip): #プラグ操作用クラス作成 plg = TPLink_Plug(ip) #データを取得し、dictに変換 rjson = plg.info() rdict = json.loads(rjson) return rdict #電球データ取得用メソッド def get_bulb_data(self, ip): #電球操作用クラス作成 blb = TPLink_Bulb(ip) #データを取得し、dictに変換 rjson = blb.info() rdict = json.loads(rjson) return rdict #TPLink電球&プラグ共通クラス class TPLink_Common(): def __init__(self, ip, port=9999): """Default constructor """ self.__ip = ip self.__port = port def info(self): cmd = '{"system":{"get_sysinfo":{}}}' receive = self.send_command(cmd) return receive def send_command(self, cmd, timeout=10): try: sock_tcp = socket.socket(socket.AF_INET, socket.SOCK_STREAM) sock_tcp.settimeout(timeout) sock_tcp.connect((self.__ip, self.__port)) sock_tcp.settimeout(None) sock_tcp.send(self.encrypt(cmd)) data = sock_tcp.recv(2048) sock_tcp.close() decrypted = self.decrypt(data[4:]) print("Sent: ", cmd) print("Received: ", decrypted) return decrypted except socket.error: quit("Could not connect to host " + self.__ip + ":" + str(self.__port)) return None def encrypt(self, string): key = 171 result = pack('>I', len(string)) for i in string: a = key ^ ord(i) key = a result += bytes([a]) return result def decrypt(self, string): key = 171 result = "" for i in string: a = key ^ i key = i result += chr(a) return result #TPLinkプラグ操作用クラス class TPLink_Plug(TPLink_Common): def on(self): cmd = '{"system":{"set_relay_state":{"state":1}}}' receive = self.send_command(cmd) def off(self): cmd = '{"system":{"set_relay_state":{"state":0}}}' receive = self.send_command(cmd) def ledon(self): cmd = '{"system":{"set_led_off":{"off":0}}}' receive = self.send_command(cmd) def ledoff(self): cmd = '{"system":{"set_led_off":{"off":1}}}' receive = self.send_command(cmd) def set_countdown_on(self, delay): cmd = '{"count_down":{"add_rule":{"enable":1,"delay":' + str(delay) +',"act":1,"name":"turn on"}}}' receive = self.send_command(cmd) def set_countdown_off(self, delay): cmd = '{"count_down":{"add_rule":{"enable":1,"delay":' + str(delay) +',"act":0,"name":"turn off"}}}' receive = self.send_command(cmd) def delete_countdown_table(self): cmd = '{"count_down":{"delete_all_rules":null}}' receive = self.send_command(cmd) def energy(self): cmd = '{"emeter":{"get_realtime":{}}}' receive = self.send_command(cmd) return receive #TPLink電球操作用クラス class TPLink_Bulb(TPLink_Common): def on(self): cmd = '{"smartlife.iot.smartbulb.lightingservice":{"transition_light_state":{"on_off":1}}}' receive = self.send_command(cmd) def off(self): cmd = '{"smartlife.iot.smartbulb.lightingservice":{"transition_light_state":{"on_off":0}}}' receive = self.send_command(cmd) def transition_light_state(self, hue: int = None, saturation: int = None, brightness: int = None, color_temp: int = None, on_off: bool = None, transition_period: int = None, mode: str = None, ignore_default: bool = None): # copy all given argument name-value pairs as a dict d = {k: v for k, v in locals().items() if k is not 'self' and v is not None} r = { 'smartlife.iot.smartbulb.lightingservice': { 'transition_light_state': d } } cmd = json.dumps(r) receive = self.send_command(cmd) print(receive) def brightness(self, brightness): self.transition_light_state(brightness=brightness) def purple(self, brightness = None, transition_period = None): self.transition_light_state(hue=277, saturation=86, color_temp=0, brightness=brightness, transition_period=transition_period) def blue(self, brightness = None, transition_period = None): self.transition_light_state(hue=240, saturation=100, color_temp=0, brightness=brightness, transition_period=transition_period) def cyan(self, brightness = None, transition_period = None): self.transition_light_state(hue=180, saturation=100, color_temp=0, brightness=brightness, transition_period=transition_period) def green(self, brightness = None, transition_period = None): self.transition_light_state(hue=120, saturation=100, color_temp=0, brightness=brightness, transition_period=transition_period) def yellow(self, brightness = None, transition_period = None): self.transition_light_state(hue=60, saturation=100, color_temp=0, brightness=brightness, transition_period=transition_period) def orange(self, brightness = None, transition_period = None): self.transition_light_state(hue=39, saturation=100, color_temp=0, brightness=brightness, transition_period=transition_period) def red(self, brightness = None, transition_period = None): self.transition_light_state(hue=0, saturation=100, color_temp=0, brightness=brightness, transition_period=transition_period) def lamp_color(self, brightness = None): self.transition_light_state(color_temp=2700, brightness=brightness)TPLink操作クラスの実行方法

上記クラスは、Pythonコード上で下記のように実行できます

・電球の電源をONにしたいとき

TPLink_Bulb(電球のIPアドレス).on()・プラグの電源をOFFにしたいとき

TPLink_Plug(プラグのIPアドレス).off()・10秒後にプラグをONにしたいとき

TPLink_Plug(プラグのIPアドレス).set_countdown_on(10)・電球の明るさを10%にしたいとき

TPLink_Bulb(電球のIPアドレス).brightness(10)・電球を赤色にしたいとき(カラー電球のみ)

TPLink_Bulb(電球のIPアドレス).red()・電球のOn-Off等の情報を取得

info = GetTPLinkData().get_plug_data(プラグのIPアドレス)※上記メソッドは、取得したjson情報をdict形式に変換して出力されます。

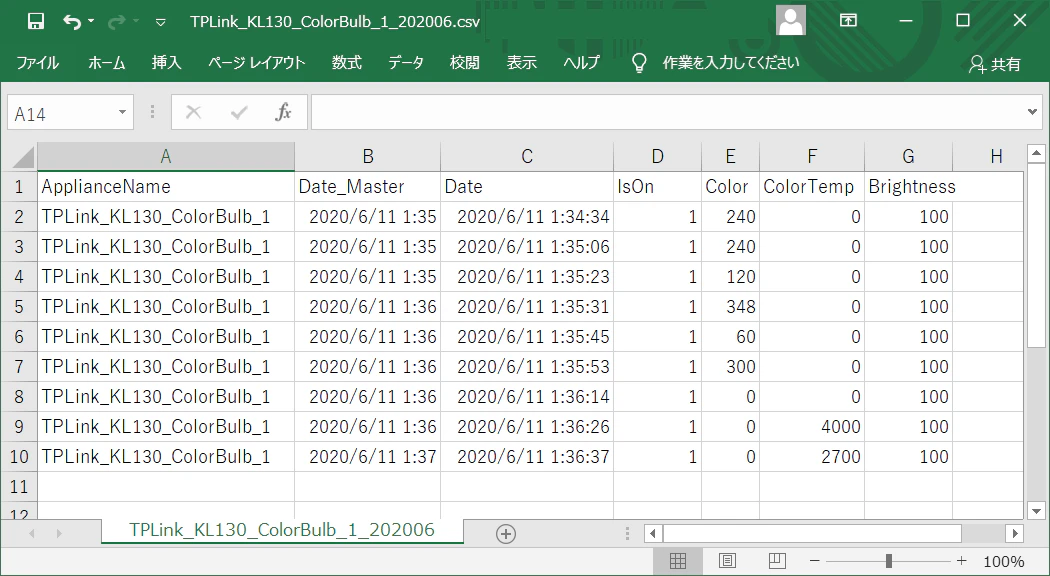

出力される電球情報は①を参照ください④ロギング用Pythonスクリプトの作成

前章最後の方法を利用して、電球やプラグの情報をロギングするスクリプトを作成しました。

スクリプトの構造はこちらと同じなので、リンク先をご一読いただければと思います。設定ファイル

こちらの記事同様、管理をしやすくするため下記2種類の設定ファイルを作成しました

・DeviceList.csv:センサごとに必要情報を記載DeviceList.csv ApplianceName,ApplianceType,IP,Retry TPLink_KL130_ColorBulb_1,TPLink_ColorBulb,192.168.0.103,2 TPLink_KL110_WhiteBulb_1,TPLink_WhiteBulb,192.168.0.102,2 TPLink_HS105_Plug_1,TPLink_Plug,192.168.0.101,2カラムの意味は下記となります

ApplianceName:デバイス名を管理、同種類のデバイスが複数あるときの識別用

ApplianceType:デバイスの種類。

TPLink_ColorBulb:カラー電球(KL130等)

TPLink_WhiteBulb:白色電球(KL110等)

TPLink_Plug:スマートプラグ(HS105等)

IP:デバイスのIPアドレス

Retry:最大再実行回数詳細(取得失敗時の再実行回数、詳しくはこちら)・config.ini:CSVおよびログ出力ディレクトリを指定

config.ini

[Path]

CSVOutput = /share/Data/Appliance

LogOutput = /share/Log/Appliance

どちらもsambaで作成した共有フォルダ内に出力すると、RaspberryPi外からアクセスできて便利です。実際のスクリプト

appliance_data_logger.pyfrom tplink import GetTPLinkData import logging from datetime import datetime, timedelta import os import csv import configparser import pandas as pd #グローバル変数 global masterdate ######TPLinkのデータ取得###### def getdata_tplink(appliance): #データ値が得られないとき、最大appliance.Retry回スキャンを繰り返す for i in range(appliance.Retry): try: #プラグのとき if appliance.ApplianceType == 'TPLink_Plug': applianceValue = GetTPLinkData().get_plug_data(appliance.IP) #電球のとき elif appliance.ApplianceType == 'TPLink_ColorBulb' or appliance.ApplianceType == 'TPLink_WhiteBulb': applianceValue = GetTPLinkData().get_bulb_data(appliance.IP) else: applianceValue = None #エラー出たらログ出力 except: logging.warning(f'retry to get data [loop{str(i)}, date{str(masterdate)}, appliance{appliance.ApplianceName}]') applianceValue = None continue else: break #値取得できていたら、POSTするデータをdictに格納 if applianceValue is not None: #プラグのとき if appliance.ApplianceType == 'TPLink_Plug': data = { 'ApplianceName': appliance.ApplianceName, 'Date_Master': str(masterdate), 'Date': str(datetime.today()), 'IsOn': str(applianceValue['system']['get_sysinfo']['relay_state']), 'OnTime': str(applianceValue['system']['get_sysinfo']['on_time']) } #電球のとき else: data = { 'ApplianceName': appliance.ApplianceName, 'Date_Master': str(masterdate), 'Date': str(datetime.today()), 'IsOn': str(applianceValue['system']['get_sysinfo']['light_state']['on_off']), 'Color': str(applianceValue['system']['get_sysinfo']['light_state']['hue']), 'ColorTemp': str(applianceValue['system']['get_sysinfo']['light_state']['color_temp']), 'Brightness': str(applianceValue['system']['get_sysinfo']['light_state']['brightness']) } return data #取得できていなかったら、ログ出力 else: logging.error(f'cannot get data [loop{str(appliance.Retry)}, date{str(masterdate)}, appliance{appliance.ApplianceName}]') return None ######データのCSV出力###### def output_csv(data, csvpath): appliancename = data['ApplianceName'] monthstr = masterdate.strftime('%Y%m') #出力先フォルダ名 outdir = f'{csvpath}/{appliancename}/{masterdate.year}' #出力先フォルダが存在しないとき、新規作成 os.makedirs(outdir, exist_ok=True) #出力ファイルのパス outpath = f'{outdir}/{appliancename}_{monthstr}.csv' #出力ファイル存在しないとき、新たに作成 if not os.path.exists(outpath): with open(outpath, 'w', newline="") as f: writer = csv.DictWriter(f, data.keys()) writer.writeheader() writer.writerow(data) #出力ファイル存在するとき、1行追加 else: with open(outpath, 'a', newline="") as f: writer = csv.DictWriter(f, data.keys()) writer.writerow(data) ######メイン###### if __name__ == '__main__': #開始時刻を取得 startdate = datetime.today() #開始時刻を分単位で丸める masterdate = startdate.replace(second=0, microsecond=0) if startdate.second >= 30: masterdate += timedelta(minutes=1) #設定ファイルとデバイスリスト読込 cfg = configparser.ConfigParser() cfg.read('./config.ini', encoding='utf-8') df_appliancelist = pd.read_csv('./ApplianceList.csv') #全センサ数とデータ取得成功数 appliance_num = len(df_appliancelist) success_num = 0 #ログの初期化 logname = f"/appliancelog_{str(masterdate.strftime('%y%m%d'))}.log" logging.basicConfig(filename=cfg['Path']['LogOutput'] + logname, level=logging.INFO) #取得した全データ保持用dict all_values_dict = None ######デバイスごとにデータ取得###### for appliance in df_appliancelist.itertuples(): #ApplianceTypeがTPLinkeであることを確認 if appliance.ApplianceType in ['TPLink_Plug','TPLink_ColorBulb','TPLink_WhiteBulb']: data = getdata_tplink(appliance) #上記以外 else: data = None #データが存在するとき、全データ保持用Dictに追加し、CSV出力 if data is not None: #all_values_dictがNoneのとき、新たに辞書を作成 if all_values_dict is None: all_values_dict = {data['ApplianceName']: data} #all_values_dictがNoneでないとき、既存の辞書に追加 else: all_values_dict[data['ApplianceName']] = data #CSV出力 output_csv(data, cfg['Path']['CSVOutput']) #成功数プラス success_num+=1 #処理終了をログ出力 logging.info(f'[masterdate{str(masterdate)} startdate{str(startdate)} enddate{str(datetime.today())} success{str(success_num)}/{str(appliance_num)}]')上記を実行すれば、設定ファイル"CSVOutput"で指定したフォルダに、取得データがデバイス名と日時の名称でCSV出力されます

以上で、情報取得が完了です

おわりに

RaspberrypPiで24時間稼働、かつPythonはIFTTTよりも自由度が高いので、色々なアイデアを具現化可能です

・人感センサと組み合わせて、人が入ったら電気が点くようにする

・30分以上人がいなければ、電気を消す

・人によって電球の明るさを自動で切り替える

などなどです。いくつか作りたいものがあるので、製作が完了したらまた記事にしようと思います

- 投稿日:2020-06-19T21:26:58+09:00

Tkinter入門2:ボタン

※この記事は前回の続きです。

4. ボタンウィジェット

この章はボタンウィジェットについて紹介します。ボタンウィジェットは限られた選択肢に対して、ユーザーの意思決定を素早く直感的に入力することのできるウィジェットです。

以下はButtonウィジェットのオプションです。

- 4.0 Button Widgetの基本構造

- 4.1 activebackground

- 4.2 activeforeground

- 4.3 bd

- 4.4 bg

- 4.5 command

- 4.6 fg

- 4.7 font

- 4.8 heightとwidth

- 4.9 image

- 4.10 justify

- 4.11 padxとpady

- 4.12 relief

- 4.13 state

- 4.14 underline

- 4.15 wraplength

4.0 Button Widget の基本構造

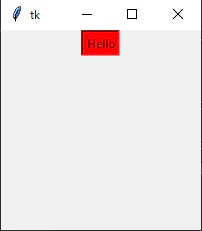

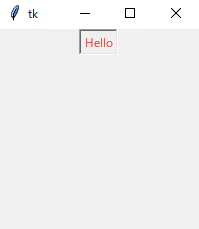

このウィジェットはtkinter.Button()でインスタンス化することで使用出来ます。表示方法は前回と同様 .pack()で配置できます。

4.0_BasicButtonWidgetimport tkinter as tk pop = tk.Tk() # buttonという変数にボタンのインスタンス情報を格納する # tk.Button(対象のウィンドウ, text="ボタンに表示する文字列") button = tk.Button(pop, text="Hello") # ボタンを出力する button.pack() pop.mainloop()今更ですが、ウィンドウのサイズがあまりにも小さいのでもう少し大きくすることにしましょう。

4.0_modify_x_yimport tkinter as tk pop = tk.Tk() # .geometry("縦x横")で大きさを指定できます ※xはエックスです pop.geometry("200x200") # 4.1からインスタンス化する際の追加オプションが含まれている行のみを載せます。 button = tk.Button(pop, text="Hello")##この行 button.pack() pop.mainloop()これでウィンドウのサイズを変更できたはずです。以降、追加オプションが含まれる行のみを載せます。全体的に大幅な変更がある場合はすべてのコードを載せます。

4.1 activebackground クリック中の背景色を指定する

ボタンが押されている間の背景色を指定します。

activebackground="色"で指定できます。

色の指定は、"red"や"blue"などの文字列を使った指定方法や、#を使った16進記法も使用できます。4.1_Button_activebackground# オプションの後に","を使用することで様々なオプションを付け足すことが出来ます。 # activebackgroundはボタンが押された時の背景色を出力します。 button = tk.Button(pop, text="Hello",activeforeground="red")4.2 activeforeground クリック中の前景色を指定する

activebackground の前景色バージョンです。クリックしている間、前にある物の色を指定できます。今回の場合はHelloという文字列に対して色を指定できます。

4.2_Button_activeforeground# activeforegroundはボタンが押された時の前景色を出力します。 button = tk.Button(pop, text="Hello",activeforeground="red")4.3 bd エッジのサイズを指定する

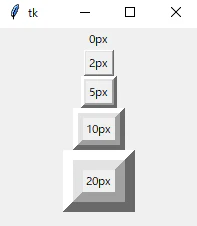

ボタンの淵のサイズ(単位はpixel)を指定します。このオプションを指定しない場合は生成する際に2pxで初期化されます。試しに、いくつかのボタンを表示してみましょう

4.3_Button_bd# ボタンのエッジのサイズを指定します button = tk.Button(pop, text="0px",bd="0") button1 = tk.Button(pop, text="2px",bd="2") button2 = tk.Button(pop, text="5px",bd="5") button3 = tk.Button(pop, text="10px",bd="10") button4 = tk.Button(pop, text="20px",bd="20") button.pack() button1.pack() button2.pack() button3.pack() button4.pack()4.4 bg 背景色を指定する

ボタンの背景色を変更します。これはactiveforegroundやactivebackgroundとは違って、アクションに依存しないオプションとなります。

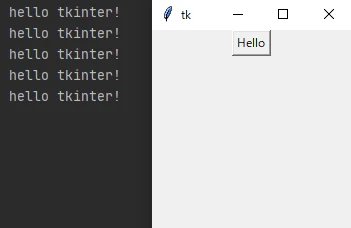

4.4_Button_bg# 通常状態の背景色を指定します。アクションに依存しません。 button = tk.Button(pop, text="Hello",bg="red")4.5 command 指定したプログラムを実行する

command で指定したプログラムを実行します。commandには実行したい関数名を入れてあげます。下の例ではoutputという関数を使用したいので、

command=outputこれで設定完了です。4.5_Button_command# コンソールにhello tkinterと出力する def output(): print("hello tkinter!") # 指定したプログラムを実行出来ます。 # commandには関数名のみを入力します。 button = tk.Button(pop, text="Hello",command=output)4.6 fg 前景色を指定する。

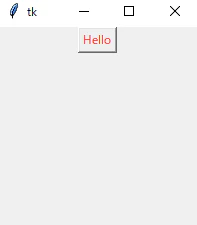

背景色ではbgというコマンドを使用しました。今回はfgです。fgは前面にあるコンテンツの色を指定します。なので今回の場合はhelloという文字列に色を指定できます。fgはbgと同様、アクションに依存しない指定方法です。

4.6_Button_fg# 前景色を指定します (※アクションには依存しない) button = tk.Button(pop, text="Hello",fg="red")4.7 フォントを指定する

コンピュータにインストールされているフォントを参照し、任意の文字列に字体を付与します。実際にフォントが指定されているか複数のボタンを生成して試してみましょう。

4.7_Button_font# フォントを指定します button1 = tk.Button(pop, text="Hello") button2 = tk.Button(pop, text="Hello",font="gabriola") button3 = tk.Button(pop, text="Hello",font="consolas") button1.pack() button2.pack() button3.pack()実行結果

確かにフォントが指定できていることが確認できます。4.8 height,width ボタンの大きさを指定する

heightとwidthを使用することでボタンの大きさを調整できます。heightは高さ、widthは幅を表します。どちらか一つのみでも構いません。

4.8_Button_width_height# ボタンの大きさを指定します button = tk.Button(pop, text="Hello",width="20",height="10")4.9 image ボタンに画像を配置する

後日記述します

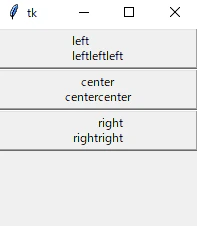

4.10 justify 複数行文字列の時にどの位置に寄せるか指定する

複数行の文字列が存在するとき、文字列がどの位置に寄せるかを指定します。属性は"left","center","right"の3つがあります。

実際に幾つかボタンを作って試してみましょう。4.10_Button_justifybutton1 = tk.Button(pop, text="left\nleftleftleft",width="30",justify="left") button2 = tk.Button(pop, text="center\ncentercenter",width="30",justify="center") button3 = tk.Button(pop, text="right\nrightright",width="30",justify="right") button1.pack() button2.pack() button3.pack()4.11 padx, pady 内側の空白を指定する

ボタンの内側の空白を指定します。padxは横軸に対して指定、padyは縦軸に対して指定できる。

4.11_Button_padding_x_y# ボタンの内側に空白を付与します。padxは横軸、padyは縦軸の空間を指定。 button = tk.Button(pop, text="Hello",padx='30',pady='50')4.12 relief 淵のスタイルを指定する

ボタンの淵の種類を指定します。エッジの種類は5種類あり、必要に応じて指定することが出来ます。属性は以下の通りです。

- flat:平らなボタン

- sunken:押された状態

- raised:手前に飛び出た状態

- groove:淵が溝に埋まった状態

- ridge:淵が盛り上がる状態

- solid:太い溝

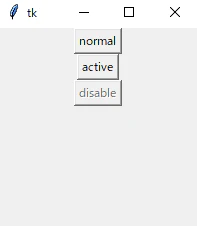

4.12_Button_relief# 淵のスタイルを指定します button1 = tk.Button(pop, text="Hello",relief='flat') button2 = tk.Button(pop, text="Hello",relief='sunken') button3 = tk.Button(pop, text="Hello",relief='raised') button4 = tk.Button(pop, text="Hello",relief='groove') button5 = tk.Button(pop, text="Hello",relief='ridge') button6 = tk.Button(pop, text="Hello",relief='solid') button1.pack() button2.pack() button3.pack() button4.pack() button5.pack() button6.pack()4.13 state ボタンの属性を変える

stateはボタンをアクティブにしたり、非アクティブにすることが出来ます。属性は3種類ありますが、そのうちの一つは同じ意味を持つ属性なので省略します。

- normal:押すことが可能なボタン

- disable:ボタンを押せないようにします

実際に2個のボタンを試してみましょう。

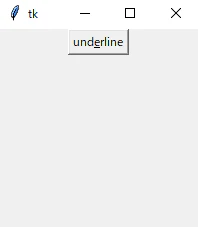

4.13_Button_state# 淵のスタイルを指定します # ボタンの属性を変える button1 = tk.Button(pop, text="normal",state='normal') button2 = tk.Button(pop, text="active",state='active') button3 = tk.Button(pop, text="disable",state='disable') button1.pack() button2.pack() button3.pack()4.14 underline 下線をつける

最初の文字を0番目として、何個目に下線を引くか指定します。デフォルトは-1でこの場合はどの文字にも下線が付きません。

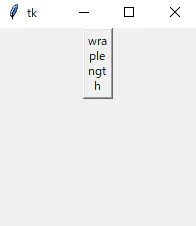

4.14_Button_underline# 任意の文字に下線を引く button = tk.Button(pop, text="disable",underline='3')4.15 wraplength 任意の大きさで文字を折り返す

好きな大きさで文字を折り返します。数字で指定しますが文字の桁数ではなく、pixel数であることに注意してください。

もし、20pxで折り返す場合は以下のように書きます。4.15_Button_state# 文字を任意の大きさで折り返します button = tk.Button(pop, text="wraplength",wraplength='20')以上ボタンウィジェットでした。

次回はキャンバスについて学びたいと思います。

- 投稿日:2020-06-19T20:57:59+09:00

Python requestsで天気を取得する

梅雨になったので天気が知りたいなーと思って作った

1.requestsについて

2.天気の入手場所

3.ソース

4.ソース解説

5.実行結果

6.まとめrequestsについて

- HTTP通信用のPythonのライブラリ。

- WEBスクレイピングでHTMLやXMLファイルからデータを取得するのに使われる。

- コマンドプロンプトで

pip install requestsを入力すればインストールできる。- 使用例

import requests r = requests.get("https://news.yahoo.co.jp/") print(r.text)

- 実行結果(一部抜粋)

<!DOCTYPE html> <style data-styled="gpQmdr jhlPYu" data-styled-version="4.4.1" data-styled-streamed="true"> /* sc-component-id: sc-jAaTju */ .gpQmdr{display:-webkit-box;display:-webkit-flex;display:-ms- flexbox;display:flex;-webkit-align-items:center;-webkit-box-align:center;-ms-flex-align:center;align-items:center;-webkit-box-pack:center;-webkit-justify-content:center;-ms-flex-pack:center;justify-content:center;-webkit-flex-direction:column;-ms-flex-direction:column;flex-direction:column;overflow:hidden;position:relative;background-color:#efefef;height:80px;width:80px;} .gpQmdr::after{content:'';display:block;position:absolute;top:0;left:0;box-sizing:border-box;width:100%;height:100%;border:solid 1px rgba(0,0,0,0.06);}天気の入手場所

livedoor天気情報のお天気Webサービス

上記サイトの全国の地点定義表のリンク内のリクエストする地域の「1次細分区(cityタグ)」のidを探す。(例:京都府 京都市 = 260010)ソース

import requests class GetWeather: url = "http://weather.livedoor.com/forecast/webservice/json/v1?" def getWeather(self, citycode): query_params = {"city": citycode} self.data = requests.get(self.url, params = query_params).json() def showWeather(self): print(self.data["location"]["city"], "の天気は、") for weather in self.data['forecasts']: print(weather["date"]) print(weather["dateLabel"] + "の天気:" + weather["telop"]) print("") citycode = 260010 w = GetWeather() w.getWeather(citycode) w.showWeather()ソース解説

1行目

import requestsrequestsライブラリのインポート

3行目

class GetWeatherGetWeatherクラスの定義。

4行目

url = "http://weather.livedoor.com/forecast/webservice/json/v1?"JSONデータをリクエストする際のURL

6~8行目 getWeatherメソッド

def getWeather(self, citycode): query_params = {"city": citycode} self.data = requests.get(self.url, params = query_params).json()6行目:getWeatherメソッドの定義。引数に地域コードを指定。天気データの取得を行うメソッド。

7行目:地域コードをquery_paramsに代入。

8行目:requests.get()で天気データを取得。これで、urlに地域コードをセットした状態でquery_paramsで指定したコードの地域の天気が取得出来る。

10~15行目 showWeatherメソッド

def showWeather(self): print(self.data["location"]["city"], "の天気は、") for weather in self.data['forecasts']: print(weather["date"]) print(weather["dateLabel"] + "の天気:" + weather["telop"]) print("")10行目:showWeatherメソッドの定義。取得した天気の表示を行うメソッド。

11行目:お天気Webサービス仕様のレスポンスフィールドのプロパティ名を見ると、locationプロパティのcityプロパティに1次細分区名があることがわかるので、

self.data["location"]["city"]でcityプロパティの1次細分区名を表示できる。12行目:同じようにforecastsプロパティのdateプロパティに予報日(年月日)、dataLabelプロパティに予報日(今日、明日、明後日のいずれか)があることがわかるので、

for weather in self.data['forecasts']:でforecastsプロパティ内のプロパティを取り出す。13行目:

print(weather["date"])でdateプロパティの表示14行目:

print(weather["dateLabel"] + "の天気:" + weather["telop"])で

dateLabelプロパティ、telopプロパティの表示17~20行目

17行目:citycodeの定義。(ここでは京都府京都市)

18行目:GetWeatherクラスのインスタンスの生成。

19行目:getWeatherメソッドの呼び出し。

20行目:showWeatherメソッドの呼び出し。実行結果

京都 の天気は、 2020-06-19 今日の天気:雨のち曇 2020-06-20 明日の天気:曇のち晴 2020-06-21 明後日の天気:晴時々曇まとめ

- requestsでHTTP通信ができる

- ユーザー指定の都道府県、地域の天気が取得できたらおもしろいかも

- 普通に天気見たほうがはy( ' ^'c彡☆))Д´) パーン

- 投稿日:2020-06-19T20:25:19+09:00

【AWS入門】音声-テキスト変換して遊んでみた♪

同じように見えるがこちらは、資料がほとんど無い。

参考のものを見てどうにか出来た。

昨夜の音声を貼っておく。今夜はこれをテキスト変換した。

音声発生【参考】

①Getting Started (AWS SDK for Python (Boto))

②Amazon Transcribeで音声の文字起こしを行う。

③S3 → Lambda → Transcribe → S3 で文字起こしパイプラインを作成する参考①より、以下のようなコードが出来る。

ほぼ参考①と同じように見えるが、一か所参考③を見て、出力先をOutputBucketName='バケット名'として指定している。

これが無いと、ほぼどこに出力されたのかが分からなかった。

※特に指定して存在している場合もファイルは隠しファイルになっているようである

⇒最後にもう一度見たらファイルが見えましたfrom __future__ import print_function import time import boto3 transcribe = boto3.client('transcribe') job_name = "test_tran3" job_uri = "https://バケット名.s3.amazonaws.com/speech.mp3" transcribe.start_transcription_job( TranscriptionJobName=job_name, Media={'MediaFileUri': job_uri}, MediaFormat='mp3', #wav, mp4, mp3 LanguageCode='ja-JP', #'en-US' OutputBucketName='muauanmp3' ) while True: status = transcribe.get_transcription_job(TranscriptionJobName=job_name) if status['TranscriptionJob']['TranscriptionJobStatus'] in ['COMPLETED', 'FAILED']: break print("Not ready yet...") time.sleep(5) print(status)上記コードで以下のような出力が得られる。Not ready yetは5秒に一回出力されるが、6回以上出力しているから30秒程度はかかっているようだ。

そして、一応結果のjsonを吐くがあまり意味は分からない。$ python3 boto_transcribe.py Not ready yet... ... Not ready yet... {'TranscriptionJob': {'TranscriptionJobName':..., 'content-length': '506', 'connection': 'keep-alive'}, 'RetryAttempts': 0}}そこで、参考②がやっているように、s3のバケットのファイルを確認する。

音声ファイルspeech.mp3と共に出力されたtest_tran3.jsonなどのファイルが見える。$ aws s3 ls s3://バケット名 2020-06-19 04:52:36 2 .write_access_check_file.temp ... 2020-06-18 23:44:17 35467 speech.mp3 ... 2020-06-19 04:45:47 1472 test_tran2.json 2020-06-19 04:54:09 1663 test_tran3.json次に、s3://バケット名/test_tran3.json をec2サーバーにコピーする。

$ aws s3 cp s3://バケット名/test_tran3.json ./ download: s3://バケット名/test_tran3.json to ./test_tran3.json最後に、jsonの中身を以下のコマンドで出力する。

ちゃんと言語があっていると、以下のように正しく出力されたが、同じ音声ファイルを英語の指定でtranscribeした結果は、下のようにアルファベットになっているが、どうも変!

とはいえ、これで一応の音声-テキスト変換が出来た。$ cat test_tran3.json |jq .results[][0].transcript "こんにちは 東京 横浜 も 少し 曇り です 声 は 水木 さん です" $ cat test_tran2.json |jq .results[][0].transcript "Tokyo, Yokohama, Moscow See Commodities, Cueva Mitic Sundays."しかし、実際に使う場合は、やはり手打ちではなくpythonコードでやりたい。

というわけで、いろいろ調査した結果、以下の参考のようなことが出来ることが分かった。【参考】

④boto3を使ってS3にファイルのアップ&ダウンロード

⑤pandasでJSON文字列・ファイルを読み込み(read_json)

⑥JSONで配列の入れ子構造や値の取得方法などをPythonを使って説明!

これらのやり方をコードに落とすと以下のようになる。

つまり、

① jsonファイルをダウンロード

② pandasで読み込む

③ 必要な部分を出力する

という方法である。import pandas as pd s3 = boto3.resource('s3') #S3オブジェクトを取得 bucket = s3.Bucket('バケット名') #bucket定義 bucket.download_file('test_tran3.json', 'test_tran3.json') #ec2へダウンロード;ダウンロードファイル、ダウンロード後ファイル df = pd.read_json('test_tran3.json') #jsonファイルをpandasで読込 print(df['results'][1][0]['transcript']) #jsonファイルから変換文字列を抽出こうして一連の作業の結果無事に以下のセンテンスが得られました。

※結果はよく見ると分かち書きされているのが分かりますこんにちは 東京 横浜 も 少し 曇り です 声 は 水木 さん です・バリエーション

アプリ応用

単品で、議事録や翻訳などは普通に使えそうです。

さらに、昨晩のテキスト-音声と合わせると、以下のようなシークエンスが構成出来ることが分かります。テキスト-音声-...-音声-テキストということで、...の部分の処理はいろいろ考えられます。

パーポや資料の読み上げと質問のシークエンスをテキストで記録する。

つまり、最初のテキストや音声と処理後の音声やテキストは異なると思われます。

また、他のシーケンスも考えられます。

会話アプリの場合だと、上記の配置は逆転して音声-テキスト-会話アプリ-テキスト-音声というのが考えられます。

これは、アレクサなんかのシークエンスですね。

この場合は、テキストベースの変換なので、普通に翻訳が出来そうです音声QA

アレクサみたいな音声-QAアプリも作れそうです。

質問をスマホなどの音声で受け付けて、その裏で上記のアプリを動かせばリアルタイムな音声QAも出来そうです。Twitter補助

Twitterに限らないけど、要は、入力は音声で出力も音声でやることもできそうです。

。。。ただし、これらのアプリにするにはもうひと頑張り必要ですね。まとめ

・音声―テキスト変換で遊んでみた

・pythonで一連の動作を作成できた・jsonファイルが存在すると二度できないので、毎回同じジョブでやるには一連のシーケンスで削除が必要

・何かアプリ作ろう...

・テキスト翻訳もやろう

- 投稿日:2020-06-19T20:10:08+09:00

DDPGでPendulum-v0を学習

概要

DQNなどの手法では方策によって各状態のQ(s,a)を計算し、Q値を最大化する行動を選択・行動をしていたが、これでは離散的な行動しか扱えなかった。それに対して、DDPGでは連続行動空間に対応するためQ値を最大化する行動を求めるのではなく、方策をパラメータ化し直接行動を出力することで対応した。そのため、決定的な方策となっている。

実装

リプレイバッファ

深層強化学習ではおなじみのリプレイバッファです。現在の状態、その時の行動、次状態、即時報酬、終端状態かどうかを一つのタプルとして保存しています。

from collections import deque, namedtuple import random Transition = namedtuple('Transition', ('state', 'action', 'next_state', 'reward', 'done')) class ReplayBuffer(object): def __init__(self, capacity=1e6): self.capacity = capacity self.memory = deque([], maxlen=int(capacity)) def append(self, *args): transition = Transition(*args) self.memory.append(transition) def sample(self, batch_size): return random.sample(self.memory, batch_size) def reset(self): self.memory.clear() def length(self): return len(self.memory) def __len__(self): return len(self.memory)モデル

DDPGでは現在の状態から行動を連続値で出力するActor$\mu(s)$と現在の状態と行動からQ値を出力するCritic$Q(s,a)$が存在します。各層の重みの初期化については元論文に沿っているので、詳しくはそちらを確認してください(下にリンクがあります)。特徴的なのはActorの最終層にtanhがあることと、Criticで行動を受け取る際に第二層で受け取ることですかね。もしPendulumで実験する場合には、行動範囲が[-2, 2]なので、出力に2を書けても良いかもしれません。

import torch import torch.nn as nn import torch.nn.functional as F import numpy as np def init_weight(size): f = size[0] v = 1. / np.sqrt(f) return torch.tensor(np.random.uniform(low=-v, high=v, size=size), dtype=torch.float) class ActorNetwork(nn.Module): def __init__(self, num_state, num_action, hidden1_size=400, hidden2_size=300, init_w=3e-3): super(ActorNetwork, self).__init__() self.fc1 = nn.Linear(num_state[0], hidden1_size) self.fc2 = nn.Linear(hidden1_size, hidden2_size) self.fc3 = nn.Linear(hidden2_size, num_action[0]) self.num_state = num_state self.num_action = num_action self.fc1.weight.data = init_weight(self.fc1.weight.data.size()) self.fc2.weight.data = init_weight(self.fc2.weight.data.size()) self.fc3.weight.data.uniform_(-init_w, init_w) def forward(self, x): h = F.relu(self.fc1(x)) h = F.relu(self.fc2(h)) y = torch.tanh(self.fc3(h)) # 2をかけてもよいかも? return y class CriticNetwork(nn.Module): def __init__(self, num_state, num_action, hidden1_size=400, hidden2_size=300, init_w=3e-4): super(CriticNetwork, self).__init__() self.fc1 = nn.Linear(num_state[0], hidden1_size) self.fc2 = nn.Linear(hidden1_size+num_action[0], hidden2_size) self.fc3 = nn.Linear(hidden2_size, 1) self.num_state = num_state self.num_action = num_action self.fc1.weight.data = init_weight(self.fc1.weight.data.size()) self.fc2.weight.data = init_weight(self.fc2.weight.data.size()) self.fc3.weight.data.uniform_(-init_w, init_w) def forward(self, x, action): h = F.relu(self.fc1(x)) h = F.relu(self.fc2(torch.cat([h, action], dim=1))) y = self.fc3(h) return yエージェント

エージェントでは行動を選択する際にそのままでは行動が決定的になってしまうため、ノイズ$\mathcal{N}$を加えます。このときのノイズはオルンシュタイン=ウーレンベック過程という確立過程に従います。詳しくはわからないです。時間経つに従って平均に近づいていくノイズだと思えばいいと思います。しらんけど。

a = \mu(s) + \mathcal{N}各モデルの学習についてはCriticはDQNなどと同様にTD誤差を最小化するように勾配を求めてモデルの更新を行います。損失関数については以下のとおりです。Nはバッチサイズです。

L = \frac{1}{N} \sum_{i=1}^N (r_i + \gamma Q^{\prime}(s_{i+1}, \mu^{\prime}(s_{i+1})) - Q(s_i, a_i))^2Actorの方はQ値を最大化するようにモデルの更新を行います。このとき最大化を行うので、Lossにマイナスがつくことに注意です。目的関数は以下の通りです。

J = \frac{1}{N}\sum_{i=1}^N Q(s_{i}, \mu{s_i})上記の目的関数ではダッシュがついてるものはtargetネットワークになります。これは学習を安定化させるためによく使われるものです。DQNなどではこのtargetネットワークの更新が数エポック毎に行われるのに対して、DDPGではハイパパラメータ$\tau(\ll 1)$を用いて

\theta \gets \tau \theta + (1 - \tau) \theta^{\prime}のように、緩やかに更新されます。これにより、学習が安定しますが学習時間が若干長くなってしまうらしいです。

import torch import torch.nn.functional as F import numpy as np import copy class OrnsteinUhlenbeckProcess: def __init__(self, theta=0.15, mu=0.0, sigma=0.2, dt=1e-2, x0=None, size=1, sigma_min=None, n_steps_annealing=1000): self.theta = theta self.mu = mu self.sigma = sigma self.dt = dt self.x0 = x0 self.size = size self.num_steps = 0 self.x_prev = self.x0 if self.x0 is not None else np.zeros(self.size) if sigma_min is not None: self.m = -float(sigma - sigma_min) / float(n_steps_annealing) self.c = sigma self.sigma_min = sigma_min else: self.m = 0 self.c = sigma self.sigma_min = sigma def current_sigma(self): sigma = max(self.sigma_min, self.m * float(self.num_steps) + self.c) return sigma def sample(self): x = self.x_prev + self.theta * (self.mu - self.x_prev) * self.dt + self.current_sigma() * np.sqrt(self.dt) * np.random.normal(size=self.size) self.x_prev = x self.num_steps += 1 return x class DDPG: def __init__(self, actor, critic, optimizer_actor, optimizer_critic, replay_buffer, device, gamma=0.99, tau=1e-3, epsilon=1.0, batch_size=64): self.actor = actor self.critic = critic self.actor_target = copy.deepcopy(self.actor) self.critic_target = copy.deepcopy(self.critic) self.optimizer_actor = optimizer_actor self.optimizer_critic = optimizer_critic self.replay_buffer = replay_buffer self.device = device self.gamma = gamma self.tau = tau self.epsilon = epsilon self.batch_size = batch_size self.random_process = OrnsteinUhlenbeckProcess(size=actor.num_action[0]) self.num_state = actor.num_state self.num_action = actor.num_action def add_memory(self, *args): self.replay_buffer.append(*args) def reset_memory(self): self.replay_buffer.reset() def get_action(self, state, greedy=False): state_tensor = torch.tensor(state, dtype=torch.float, device=self.device).view(-1, *self.num_state) action = self.actor(state_tensor) if not greedy: action += self.epsilon*torch.tensor(self.random_process.sample(), dtype=torch.float, device=self.device) return action.squeeze(0).detach().cpu().numpy() def train(self): if len(self.replay_buffer) < self.batch_size: return None transitions = self.replay_buffer.sample(self.batch_size) batch = Transition(*zip(*transitions)) state_batch = torch.tensor(batch.state, device=self.device, dtype=torch.float) action_batch = torch.tensor(batch.action, device=self.device, dtype=torch.float) next_state_batch = torch.tensor(batch.next_state, device=self.device, dtype=torch.float) reward_batch = torch.tensor(batch.reward, device=self.device, dtype=torch.float).unsqueeze(1) not_done = np.array([(not done) for done in batch.done]) not_done_batch = torch.tensor(not_done, device=self.device, dtype=torch.float).unsqueeze(1) # need to change qvalue = self.critic(state_batch, action_batch) next_qvalue = self.critic_target(next_state_batch, self.actor_target(next_state_batch)) target_qvalue = reward_batch + (self.gamma * next_qvalue * not_done_batch) critic_loss = F.mse_loss(qvalue, target_qvalue) self.optimizer_critic.zero_grad() critic_loss.backward() self.optimizer_critic.step() actor_loss = -self.critic(state_batch, self.actor(state_batch)).mean() self.optimizer_actor.zero_grad() actor_loss.backward() self.optimizer_actor.step() # soft parameter update for target_param, param in zip(self.actor_target.parameters(), self.actor.parameters()): target_param.data.copy_(target_param.data * (1.0 - self.tau) + param.data * self.tau) for target_param, param in zip(self.critic_target.parameters(), self.critic.parameters()): target_param.data.copy_(target_param.data * (1.0 - self.tau) + param.data * self.tau)学習

ここに関しては特に新しい点はありません。その他の強化学習のアルゴリズムと同様に環境からの状態を受け取って、行動、学習をしている感じになります。各ハイパーパラメータは元論文に沿っています。(多分)

import torch import torch.optim as optim import gym max_episodes = 300 memory_capacity = 1e6 # バッファの容量 gamma = 0.99 # 割引率 tau = 1e-3 # ターゲットの更新率 epsilon = 1.0 # ノイズの量をいじりたい場合、多分いらない batch_size = 64 lr_actor = 1e-4 lr_critic = 1e-3 logger_interval = 10 weight_decay = 1e-2 env = gym.make('Pendulum-v0') num_state = env.observation_space.shape num_action = env.action_space.shape max_steps = env.spec.max_episode_steps device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') actorNet = ActorNetwork(num_state, num_action).to(device) criticNet = CriticNetwork(num_state, num_action).to(device) optimizer_actor = optim.Adam(actorNet.parameters(), lr=lr_actor) optimizer_critic = optim.Adam(criticNet.parameters(), lr=lr_critic, weight_decay=weight_decay) replay_buffer = ReplayBuffer(capacity=memory_capacity) agent = DDPG(actorNet, criticNet, optimizer_actor, optimizer_critic, replay_buffer, device, gamma, tau, epsilon, batch_size) for episode in range(max_episodes): observation = env.reset() total_reward = 0 for step in range(max_steps): action = agent.get_action(observation) next_observation, reward, done, _ = env.step(action) total_reward += reward agent.add_memory(observation, action, next_observation, reward, done) agent.train() observation = next_observation if done: break if episode % logger_interval == 0: print("episode:{} total reward:{}".format(episode, total_reward)) for episode in range(3): observation = env.reset() env.render() for step in range(max_steps): action = agent.get_action(observation, greedy=True) next_observation, reward, done, _ = env.step(action) observation = next_observation env.render() if done: break env.close()gym.makeの環境を変えれば他の環境での学習もできるはず。

結果

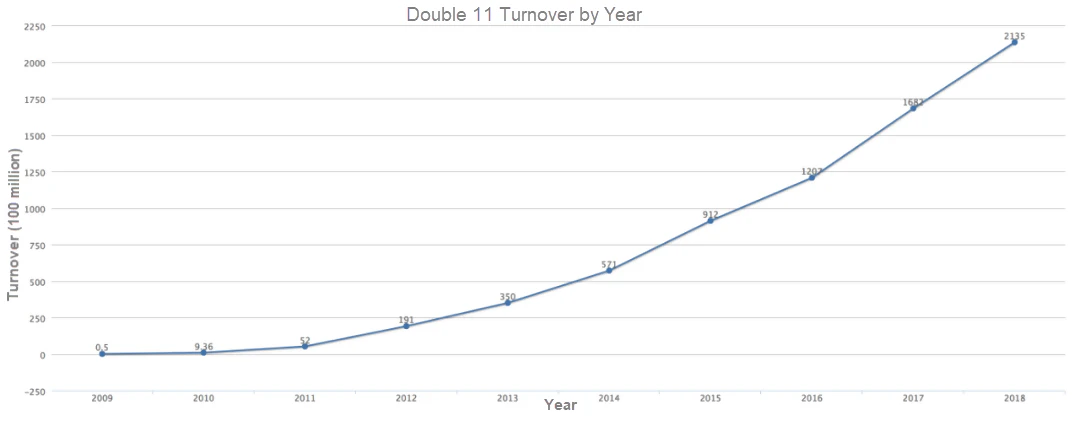

累積報酬と学習エピソードのグラフです。いい感じに学習できているのではないでしょうか。

ちゃんとたてられていますね。えらい。(gifは作り方がわからないので、載せられてないです)おわりに

基本的に上のコードをそのまま一つファイルにまとめて実行してもらえれば、動作の確認ができると思います。実装で手一杯だったのでいくつか余分な変数などが残っています。Pendulum-v0であれば、GPUが利用可能な環境でなくてもcpuのみで学習はできます。ただ、少し学習が不安定になるときがあるのでそのときには再度実行してください。 機会があれば、他の手法の実装も行っていくつもりです。

参考文献

- 投稿日:2020-06-19T19:55:23+09:00

オープンデータを利用して有機フッ素化合物の環境中濃度を地図上にプロットしてみる

ChemTHEATREに収録されたデータを活用して有機フッ素化合物の濃度を可視化してみる

有機フッ素化合物とは

親水性と親油性の両方の性質を持ち,撥水剤や消化剤,油剤,エッチング剤など幅広い用途で使用されています。

有機フッ素化合物に関するわかりやすい解説は,NHKのクローズアップ現代のHPを参照。

https://www.nhk.or.jp/gendai/articles/4280/index.htmlその有害性から,有機フッ素化合物のうちペルフルオロオクタン酸(Perfluorooctanoic acid: PFOA)は2019年からその製造・使用・輸出入が国際的に禁止され,ペルフルオロオクタンスルホン酸(Perfluorooctanesulfonate: PFOS)は2009年から製造・使用・輸出入が制限されています。

有機フッ素化合物の基準値等

近年,両物質が井戸水から検出されたり,河川に流出するなど,問題となっています。

これを受け,厚生労働省は水質管理目標設定項目にPFOSとPFOAを追加しました(令和2年4月1日施行)。水道水質基準の目標値をPFOSとPFOAの合算値で50 ng/Lとしています。

https://www.mhlw.go.jp/stf/seisakunitsuite/bunya/topics/bukyoku/kenkou/suido/kijun/index.htmlまた,環境省は水環境におけるPFOSとPFOAの全国存在量調査を実施し,「水質汚濁に係る人の健康の保護に関する環境基準等の施行について(通知)」(令和2年5月28日付け)で,水環境に係る暫定的な目標値としてPFOSとPFOAの合算値で50 ng/Lを設定しました。

令和元年度PFOA及びPFOA全国存在量調査結果

https://www.env.go.jp/press/108091.htmlちなみに,令和2年6月に厚生労働省が公開した浄水場を対象とした調査結果では,水道水の暫定目標値であるPFOS+PFOA 50 ng/Lを超過したところはありませんでした。

https://www.mhlw.go.jp/content/10900000/000638290.pdfChemTHEATREから有機フッ素化合物の環境中濃度データを取得する

ChemTHEATREでは環境中の化学物質濃度のモニタリングデータを公開しており,有機フッ素化合物のデータも収録しています。実際に,PFOSやPFOAがどのくらいの濃度で検出されたのか,また,その合算値は基準値と比較してどの程度高い,あるいは低いのか,実際に見てみましょう。

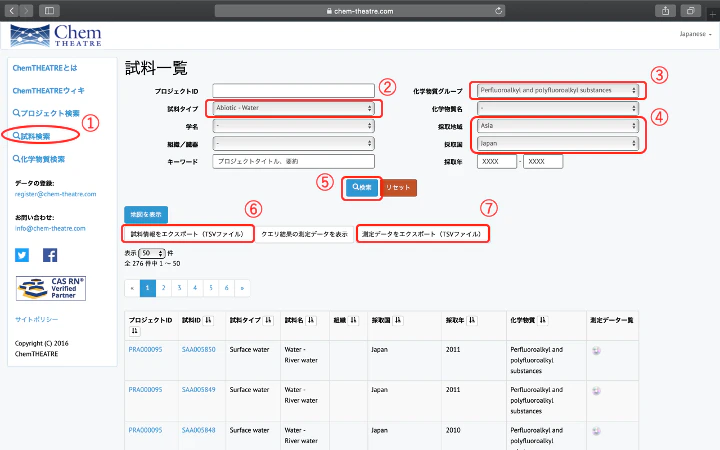

- ChemTHEATREのメニューバーから「試料検索」を選択する。

- 「試料タイプ」から「Abiotic - Water」(非生物 - 水)を選択する。

- 「化学物質グループ」から「Perfluoroalkyl and polyfluoroalkyl substances」を選択する。

- 「採取地域」から「Asia」を選択し,採取国を「Japan」にする。

- 「Search」ボタンをクリックすると,条件に合致する試料の一覧が出力される。

- 「Export samples」で試料の情報が,「Export measured data」で目的の化学物質の測定値が,タブ区切りのテキストファイルとして出力する。

エクスポートしたファイルを任意のディレクトリに保存して,解析に使用してください。

エクスポートしたデータを整形する

必要なライブラリとモジュールを読み込む。

%matplotlib inline import pandas as pd import matplotlib.pyplot as plt from cartopy import crs as ccrs化学物質の測定値の情報を読み込む。

data_file = "measureddata_20200521044415.tsv" data = pd.read_csv(data_file, delimiter="\t") data

MeasuredID ProjectID SampleID ScientificName ChemicalID ChemicalName ExperimentID MeasuredValue AlternativeData Unit Remarks RegisterDate UpdateDate 0 81245 PRA000095 SAA005816 Water CH0000362 PFBS EXA000001 0.00100 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 1 81246 PRA000095 SAA005817 Water CH0000362 PFBS EXA000001 0.00100 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 2 81247 PRA000095 SAA005818 Water CH0000362 PFBS EXA000001 0.00100 NaN μg/L NaN 2019/7/26 2019/7/26 3 81248 PRA000095 SAA005819 Water CH0000362 PFBS EXA000001 0.00100 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 4 81249 PRA000095 SAA005820 Water CH0000362 PFBS EXA000001 0.00100 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 ... ... ... ... ... ... ... ... ... ... ... ... ... ... 3087 48619 PRA000060 SAA003645 Water CH0000793 THPFOS EXA000001 0.00030 NaN μg/L NaN 2018/2/9 2018/6/8 3088 48620 PRA000060 SAA003646 Water CH0000793 THPFOS EXA000001 0.00008 NaN μg/L NaN 2018/2/9 2018/6/8 3089 48621 PRA000060 SAA003647 Water CH0000793 THPFOS EXA000001 0.00159 NaN μg/L NaN 2018/2/9 2018/6/8 3090 48622 PRA000060 SAA003648 Water CH0000793 THPFOS EXA000001 0.00188 NaN μg/L NaN 2018/2/9 2018/6/8 3091 48623 PRA000060 SAA003649 Water CH0000793 THPFOS EXA000001 0.00070 NaN μg/L NaN 2018/2/9 2018/6/8 3092 rows × 13 columns

続いて,試料の情報を読み込む。

sample_file = "samples_20200521044410.tsv" sample = pd.read_csv(sample_file, delimiter="\t") sample

ProjectID SampleID SampleType TaxonomyID UniqCodeType UniqCode SampleName ScientificName CommonName CollectionYear ... FlowRate MeanPM10 MeanTotalSuspendedParticles HumidityStartEnd WindDirectionStartEnd WindSpeedMSStartEnd AmountOfCollectedAirStartEnd Remarks RegisterDate UpdateDate 0 PRA000048 SAA002867 ST014 NaN NaN NaN SW-St.1 Water Surface water 2004 ... NaN NaN NaN NaN NaN NaN NaN NaN 2017/10/25 2019/7/18 1 PRA000048 SAA002868 ST014 NaN NaN NaN SW-St.3 Water Surface water 2004 ... NaN NaN NaN NaN NaN NaN NaN NaN 2017/10/25 2019/7/18 2 PRA000048 SAA002869 ST014 NaN NaN NaN SW-St.4 Water Surface water 2004 ... NaN NaN NaN NaN NaN NaN NaN NaN 2017/10/25 2019/7/18 3 PRA000048 SAA002870 ST014 NaN NaN NaN SW-St.5 Water Surface water 2004 ... NaN NaN NaN NaN NaN NaN NaN NaN 2017/10/25 2019/7/18 4 PRA000048 SAA002871 ST014 NaN NaN NaN SW-St.7 Water Surface water 2004 ... NaN NaN NaN NaN NaN NaN NaN NaN 2017/10/25 2019/7/18 ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... ... 271 PRA000095 SAA005846 ST015 NaN NaN NaN W_1xyz24_20100821 Water River water 2010 ... NaN NaN NaN NaN NaN NaN NaN Around Kushiro Airport 2019/7/26 2019/7/26 272 PRA000095 SAA005847 ST015 NaN NaN NaN W_1xyz25_20100821 Water River water 2010 ... NaN NaN NaN NaN NaN NaN NaN Around Kushiro Airport 2019/7/26 2019/7/26 273 PRA000095 SAA005848 ST015 NaN NaN NaN W_1xyz26_20100821 Water River water 2010 ... NaN NaN NaN NaN NaN NaN NaN Downstream from the inflow of wastewater from ... 2019/7/26 2019/7/26 274 PRA000095 SAA005849 ST015 NaN ZETTAICODE_FY2011_W 113680.0 W_113680_20110702 Water River water 2011 ... NaN NaN NaN NaN NaN NaN NaN Upstream from the inflow of wastewater from Ch... 2019/7/26 2019/7/26 275 PRA000095 SAA005850 ST015 NaN ZETTAICODE_FY2011_W 118873.0 W_118873_20110702 Water River water 2011 ... NaN NaN NaN NaN NaN NaN NaN Downstream from the inflow of wastewater from ... 2019/7/26 2019/7/26 276 rows × 66 columns

pfos = data[data["ChemicalName"] == "PFOS"] #ChemicalNameがPFOSのデータだけを抽出 pfoa = data[data["ChemicalName"] == "PFOA"] #ChemicalNameがPFOAのデータだけを抽出それぞれの中身を確認すると,下記のように見える。

pfos

MeasuredID ProjectID SampleID ScientificName ChemicalID ChemicalName ExperimentID MeasuredValue AlternativeData Unit Remarks RegisterDate UpdateDate 269 35646 PRA000048 SAA002867 Water CH0000365 PFOS EXA000001 0.0073 NaN μg/L NaN 2017/10/25 2018/6/8 270 35647 PRA000048 SAA002868 Water CH0000365 PFOS EXA000001 0.0030 NaN μg/L NaN 2017/10/25 2018/6/8 271 35648 PRA000048 SAA002869 Water CH0000365 PFOS EXA000001 0.0034 NaN μg/L NaN 2017/10/25 2018/6/8 272 35649 PRA000048 SAA002870 Water CH0000365 PFOS EXA000001 0.0038 NaN μg/L NaN 2017/10/25 2018/6/8 273 35650 PRA000048 SAA002871 Water CH0000365 PFOS EXA000001 0.0020 NaN μg/L NaN 2017/10/25 2018/6/8 ... ... ... ... ... ... ... ... ... ... ... ... ... ... 540 81380 PRA000095 SAA005846 Water CH0000365 PFOS EXA000001 0.0010 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 541 81381 PRA000095 SAA005847 Water CH0000365 PFOS EXA000001 0.0010 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 542 81382 PRA000095 SAA005848 Water CH0000365 PFOS EXA000001 0.0076 NaN μg/L NaN 2019/7/26 2019/7/26 543 81383 PRA000095 SAA005849 Water CH0000365 PFOS EXA000001 0.0028 NaN μg/L NaN 2019/7/26 2019/7/26 544 81384 PRA000095 SAA005850 Water CH0000365 PFOS EXA000001 0.0120 NaN μg/L NaN 2019/7/26 2019/7/26 276 rows × 13 columns

pfoa

MeasuredID ProjectID SampleID ScientificName ChemicalID ChemicalName ExperimentID MeasuredValue AlternativeData Unit Remarks RegisterDate UpdateDate 896 46410 PRA000060 SAA003568 Water CH0000372 PFOA EXA000001 0.00436 NaN μg/L NaN 2018/2/9 2018/6/8 897 46411 PRA000060 SAA003569 Water CH0000372 PFOA EXA000001 0.01166 NaN μg/L NaN 2018/2/9 2018/6/8 898 46412 PRA000060 SAA003570 Water CH0000372 PFOA EXA000001 0.01180 NaN μg/L NaN 2018/2/9 2018/6/8 899 46413 PRA000060 SAA003571 Water CH0000372 PFOA EXA000001 0.00430 NaN μg/L NaN 2018/2/9 2018/6/8 900 46414 PRA000060 SAA003572 Water CH0000372 PFOA EXA000001 0.00439 NaN μg/L NaN 2018/2/9 2018/6/8 ... ... ... ... ... ... ... ... ... ... ... ... ... ... 1143 81135 PRA000095 SAA005846 Water CH0000372 PFOA EXA000001 0.00100 <1.00E-3 μg/L NaN 2019/7/26 2019/7/26 1144 81136 PRA000095 SAA005847 Water CH0000372 PFOA EXA000001 0.00200 NaN μg/L NaN 2019/7/26 2019/7/26 1145 81137 PRA000095 SAA005848 Water CH0000372 PFOA EXA000001 0.00140 tr(1.40E-3) μg/L NaN 2019/7/26 2019/7/26 1146 81138 PRA000095 SAA005849 Water CH0000372 PFOA EXA000001 0.03900 NaN μg/L NaN 2019/7/26 2019/7/26 1147 81139 PRA000095 SAA005850 Water CH0000372 PFOA EXA000001 0.02400 NaN μg/L NaN 2019/7/26 2019/7/26 252 rows × 13 columns

PFOSとPFOAのデータだけを抜き出したものから,SampleIDとMeausredValueの列だけを抜き出し,測定値のカラム名がどちらもMeasuredValueになっているので,これをそれぞれPFOS,PFOAに変更する。

pfos = pfos[["SampleID","MeasuredValue"]].rename(columns={'MeasuredValue': 'PFOS'}) pfoa = pfoa[["SampleID","MeasuredValue"]].rename(columns={'MeasuredValue': 'PFOA'})PFOSとPFOAのデータフレームをSampleIDでマージする。

df = pd.merge(pfos, pfoa, on="SampleID").astype({"PFOS": float}, {"PFOA": float}) df

SampleID PFOS PFOA 0 SAA003568 0.00551 0.00436 1 SAA003569 0.01877 0.01166 2 SAA003570 0.01546 0.01180 3 SAA003571 0.00356 0.00430 4 SAA003572 0.00682 0.00439 ... ... ... ... 247 SAA005846 0.00100 0.00100 248 SAA005847 0.00100 0.00200 249 SAA005848 0.00760 0.00140 250 SAA005849 0.00280 0.03900 251 SAA005850 0.01200 0.02400 252 rows × 3 columns

今回知りたいのはPFOSとPFOAの濃度の合計値なので,TOTALという列を作って,そこに合計値を入れる。

df['TOTAL'] = df.sum(axis=1, numeric_only=True) df

SampleID PFOS PFOA TOTAL 0 SAA003568 0.00551 0.00436 0.00987 1 SAA003569 0.01877 0.01166 0.03043 2 SAA003570 0.01546 0.01180 0.02726 3 SAA003571 0.00356 0.00430 0.00786 4 SAA003572 0.00682 0.00439 0.01121 ... ... ... ... ... 247 SAA005846 0.00100 0.00100 0.00200 248 SAA005847 0.00100 0.00200 0.00300 249 SAA005848 0.00760 0.00140 0.00900 250 SAA005849 0.00280 0.03900 0.04180 251 SAA005850 0.01200 0.02400 0.03600 252 rows × 4 columns

試料のテーブルから,SampleIDと緯度経度のデータだけを抜き出す。

sample = sample[["SampleID", "CollectionLongitudeFrom", "CollectionLatitudeFrom"]] sample

SampleID CollectionLongitudeFrom CollectionLatitudeFrom 0 SAA002867 139.850000 35.599333 1 SAA002868 140.000000 35.583000 2 SAA002869 139.834500 35.515833 3 SAA002870 139.900333 35.532500 4 SAA002871 139.833667 35.433000 ... ... ... ... 271 SAA005846 144.192783 43.062302 272 SAA005847 144.232365 43.041624 273 SAA005848 144.155650 42.997641 274 SAA005849 141.719167 42.765833 275 SAA005850 141.719167 42.782500 276 rows × 3 columns

これを,先に作成した濃度のテーブルとSampleIDでマージする。

df = pd.merge(df, sample, on="SampleID") df

SampleID PFOS PFOA TOTAL CollectionLongitudeFrom CollectionLatitudeFrom 0 SAA003568 0.00551 0.00436 0.00987 139.607158 35.453746 1 SAA003569 0.01877 0.01166 0.03043 139.677734 35.501549 2 SAA003570 0.01546 0.01180 0.02726 139.617230 35.528481 3 SAA003571 0.00356 0.00430 0.00786 139.498684 35.578287 4 SAA003572 0.00682 0.00439 0.01121 139.480358 35.536396 ... ... ... ... ... ... ... 247 SAA005846 0.00100 0.00100 0.00200 144.192783 43.062302 248 SAA005847 0.00100 0.00200 0.00300 144.232365 43.041624 249 SAA005848 0.00760 0.00140 0.00900 144.155650 42.997641 250 SAA005849 0.00280 0.03900 0.04180 141.719167 42.765833 251 SAA005850 0.01200 0.02400 0.03600 141.719167 42.782500 252 rows × 6 columns

出来上がったファイルをcsv形式で保存する。

df.to_csv("sum_pfcs.csv")これを,QGISに読み込ませます。

QGISを使って濃度データを地図上に表示させる

QGISは下記からダウンロードする。

https://www.qgis.org/ja/site/

QGISの使用法はいろんなサイトで説明されているので,そちらを参照してください。地図情報(GMLシェープファイル)は,国土交通省のGISホームページからダウンロードする。

https://nlftp.mlit.go.jp/index.htmlとりあえず今回は,国土数値情報ダウンロードから,2. 政策区域のうち行政区域を利用する。

下記のページから「全国」のデータを選択してダウンロードする。年度は目的に応じて選んでください。

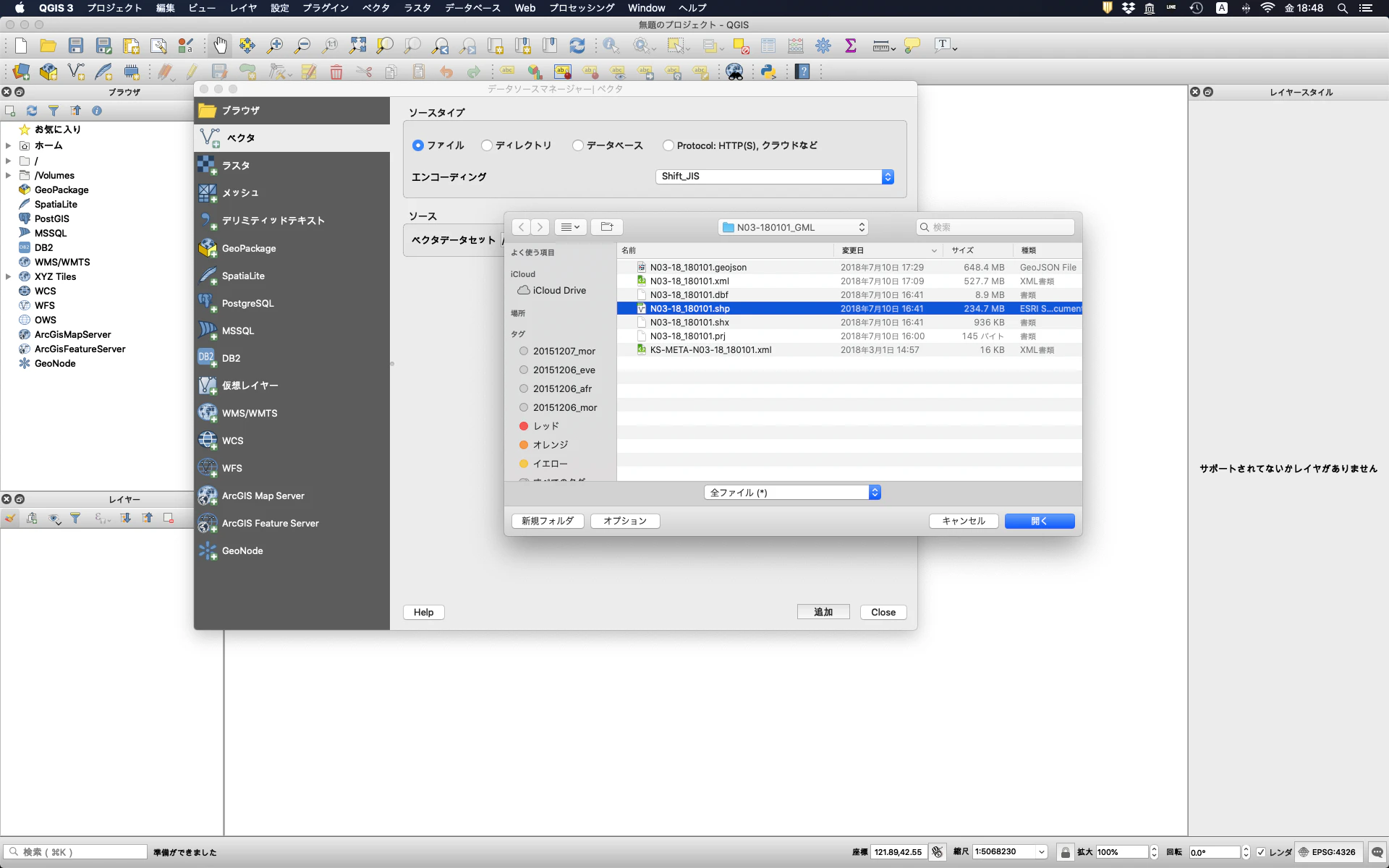

QGISを立ち上げ,データソースマネージャーからベクタのタブをクリックし,上でダウンロードした全国行政区域のシェープファイルを選択して「追加」をクリックする。

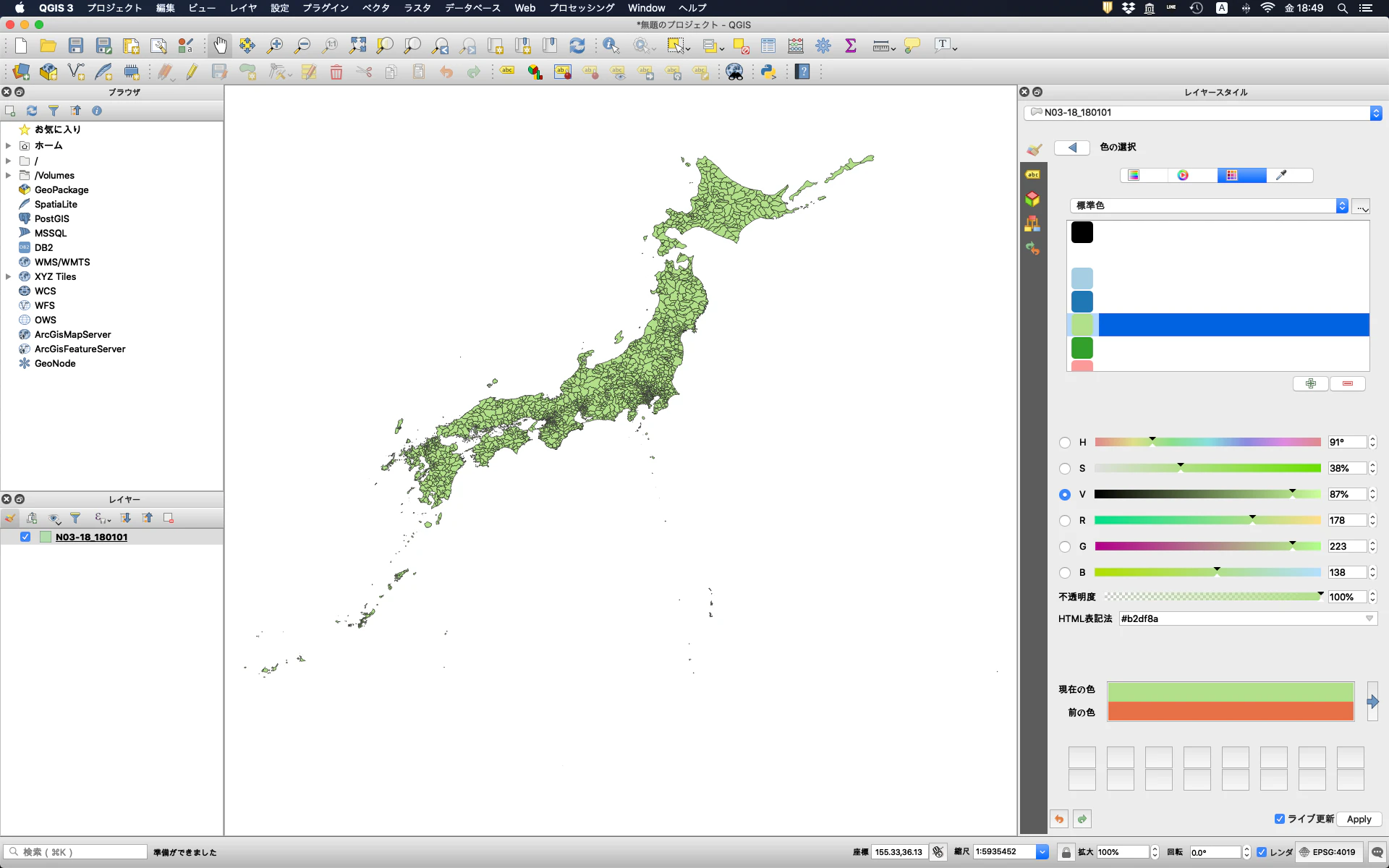

以下のように日本地図が読み込まれるので,好みの色に変更する。

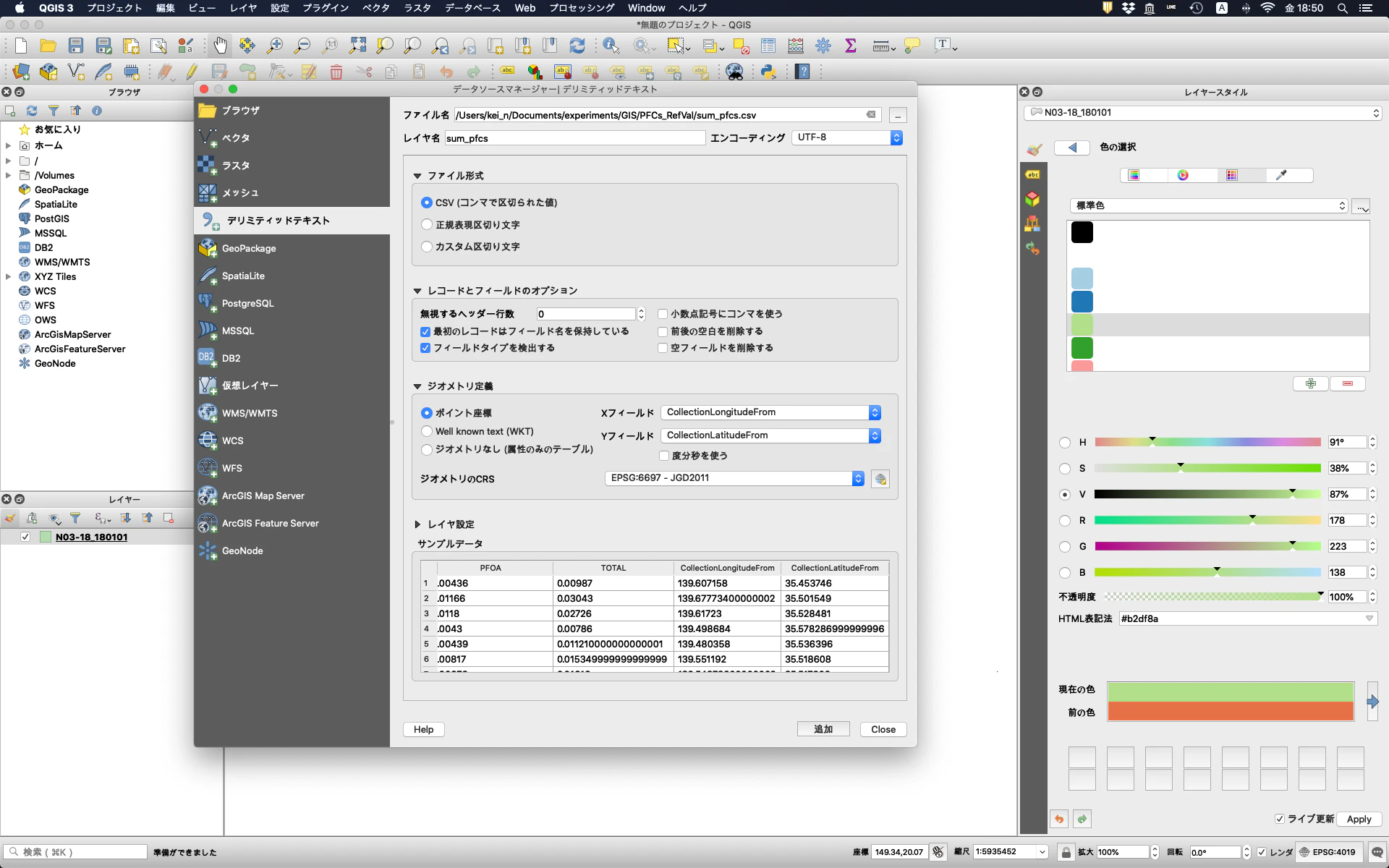

再び,データソースマネージャーからデリミティッドテキストのタブをクリックし,先のセクションで作成したCSVファイル(sum_pfcs.csv)を選択する。その後に,ジオメトリ定義のXフィールドに経度(CollectionLongitudeFrom)を,Yフィールドに緯度(CollectionLatitudeFrom)を選択し,「追加」をクリックする。

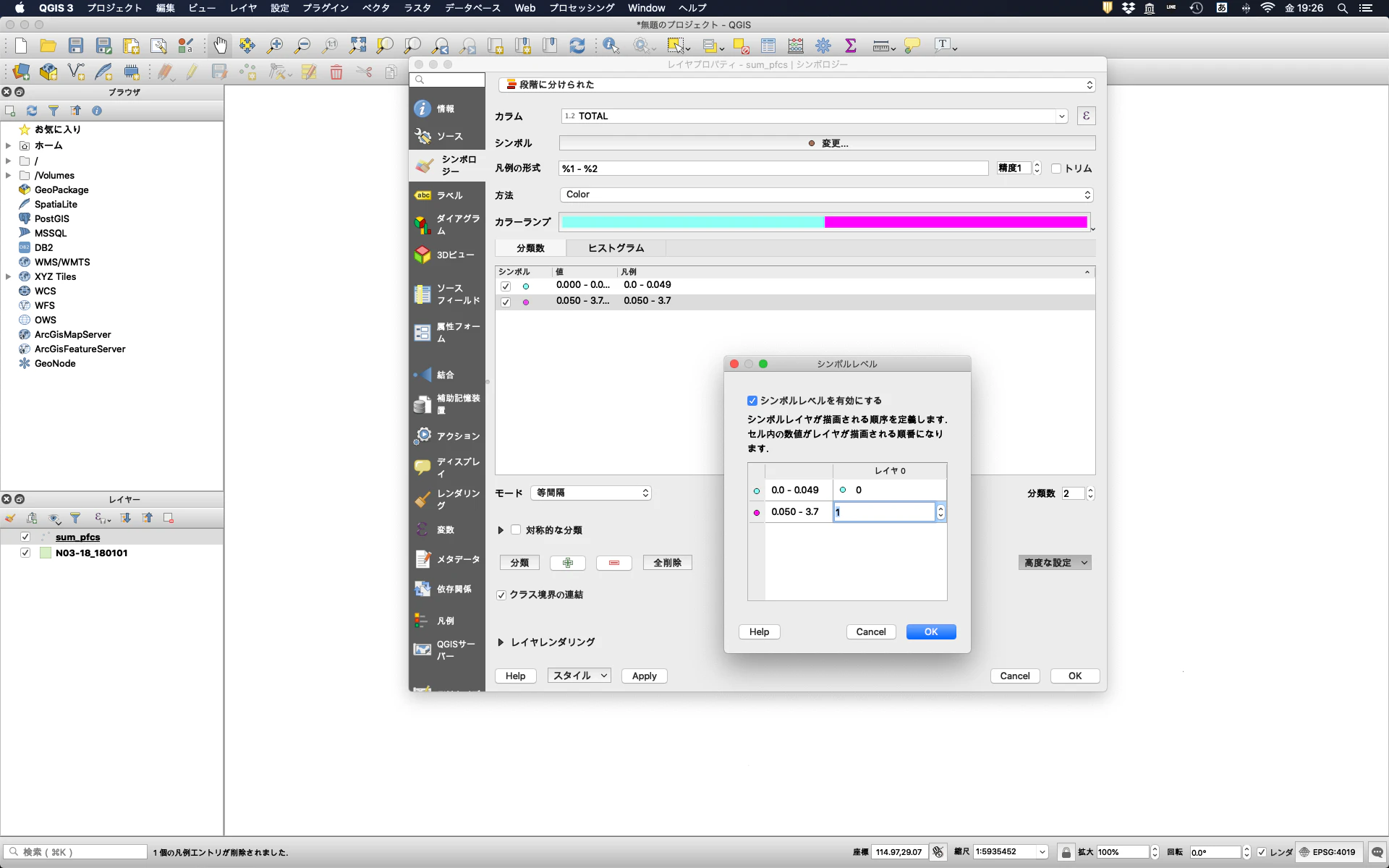

すると,サンプリング地点が地図上にプロットされる。次に,濃度で色分けをする。レイヤーから「sum_pfcs」をダブルクリックするとレイヤプロパティが開くので,シンボロジーのタブを選択する。シンボルは「段階に分けられた」を選び,PFOS+PFOAの濃度で色分けしたいので,カラムには「TOTAL」を選択する。シンボルはお好みで変更する。モードを等間隔のまま,分類数を変更すると,自動で等間隔の分類が出力される。ここでは,分類数を2にして,小さい数値のグループの値を0 - 0.05とする。(ChemTHEATREでは水中の化学物質濃度はµg/Lで統一されているので,50 ng/Lの基準値を超えるか超えないかで色分けしたい場合は,0.05とする必要がある。)デフォルトだと,高濃度のプロットが下層に表示されてしまうので,「高度な設定」から「シンボルレベル」を選択し,シンボルレベルを有効にするのチェックボックスにチェックを入れ,高濃度グループのレイヤを1に設定する。

その結果,PFOS+PFOAが50 ng/Lを超過する地点と超過しない地点が色分けされて表示される。この図を出力したい場合は,「プロジェクト」から「インポート/エクスポート」を選び,「地図を画像にエクスポート」あるいは「地図をPDFにエクスポート」を選択し,クリップボードにコピーするか,任意のディレクトリにファイルとして保存する。

いかがでしょう?出来ましたでしょうか?

このようにして,ChemTHEATREに収録されたデータを地図上に表現するなどして活用していただければ幸いです。

- 投稿日:2020-06-19T19:48:17+09:00

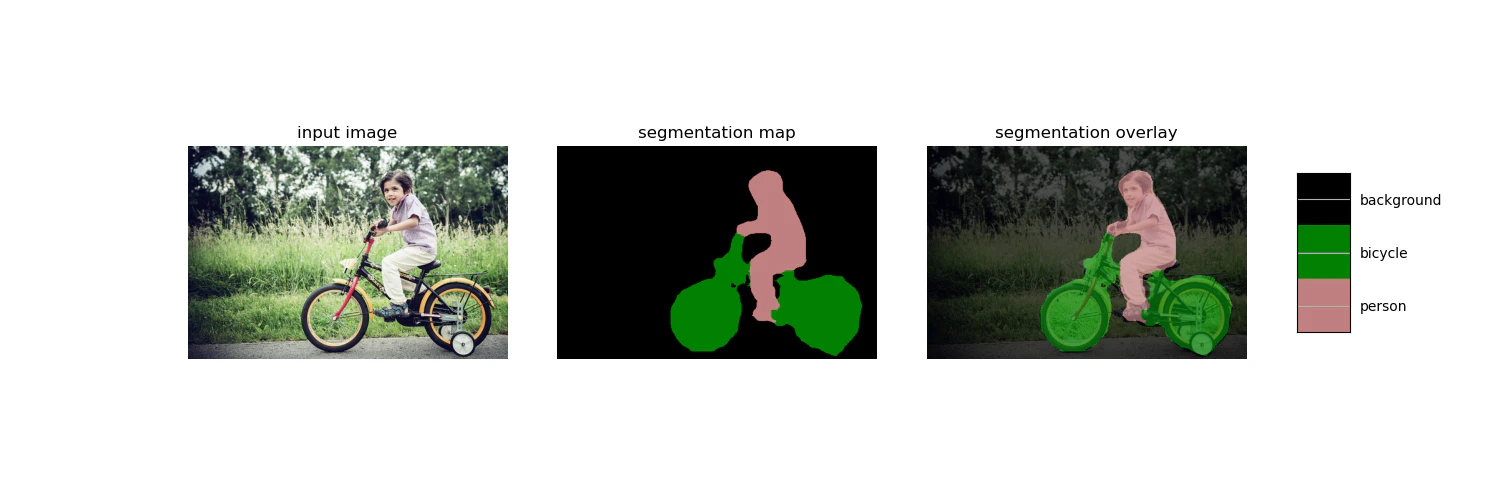

DeepLabでSemantic Segmentationやーる(Windows10、Python3.6)

はじめに

DeepLabのセマンティックセグメンテーションをやっていきます

システム環境

- Windows10(RTX2080 Max-Q、i7-8750H、RAM16GB)

- Anaconda 2020.02

- Python 3.6

- CUDA Toolkit v10.0

導入

modelsをクローンします。

DeepLabはresearch/deeplabにあります。deeplab_demo.ipynbを実行してみましょう。まずは、deeplab環境を作成します。

CUDA Toolkit v10.0をインストールしてください。cudart64_100.dllが必要です。anaconda create -n deeplab python=3.6 conda activate deeplab pip install jupyter pip install matplotlib pip install pillow pip install tensorflow-gpu==1.15jupyter notebookを開きます。

cd models-master/research/deeplab jupyter notebookdeeplab_demo.ipynbを開きます。上から順番に実行していきましょう。

最初のセルの%tensorflow_version 1.x はエラーが出たので、コメントアウトしました。import os from io import BytesIO import tarfile import tempfile from six.moves import urllib from matplotlib import gridspec from matplotlib import pyplot as plt import numpy as np from PIL import Image # %tensorflow_version 1.x import tensorflow as tfプログラムの部分をコピペして、deeplab_demo.pyを作成し、実行してみましょう。同じことができると思います。

ウェブカメラの映像を入力

ウェブカメラから読み込んで処理してみましょう。

描画にはOpenCVを用いるので、ライブラリをインストールします。pip install opencv-python次のプログラムを作成し、実行します。

import os from io import BytesIO import tarfile import tempfile from six.moves import urllib from matplotlib import gridspec from matplotlib import pyplot as plt import numpy as np from PIL import Image # %tensorflow_version 1.x import tensorflow as tf class DeepLabModel(object): """Class to load deeplab model and run inference.""" INPUT_TENSOR_NAME = 'ImageTensor:0' OUTPUT_TENSOR_NAME = 'SemanticPredictions:0' INPUT_SIZE = 513 FROZEN_GRAPH_NAME = 'frozen_inference_graph' def __init__(self, tarball_path): """Creates and loads pretrained deeplab model.""" self.graph = tf.Graph() graph_def = None # Extract frozen graph from tar archive. tar_file = tarfile.open(tarball_path) for tar_info in tar_file.getmembers(): if self.FROZEN_GRAPH_NAME in os.path.basename(tar_info.name): file_handle = tar_file.extractfile(tar_info) graph_def = tf.GraphDef.FromString(file_handle.read()) break tar_file.close() if graph_def is None: raise RuntimeError('Cannot find inference graph in tar archive.') with self.graph.as_default(): tf.import_graph_def(graph_def, name='') self.sess = tf.Session(graph=self.graph) def run(self, image): """Runs inference on a single image. Args: image: A PIL.Image object, raw input image. Returns: resized_image: RGB image resized from original input image. seg_map: Segmentation map of `resized_image`. """ width, height = image.size resize_ratio = 1.0 * self.INPUT_SIZE / max(width, height) target_size = (int(resize_ratio * width), int(resize_ratio * height)) resized_image = image.convert('RGB').resize(target_size, Image.ANTIALIAS) batch_seg_map = self.sess.run( self.OUTPUT_TENSOR_NAME, feed_dict={self.INPUT_TENSOR_NAME: [np.asarray(resized_image)]}) seg_map = batch_seg_map[0] return resized_image, seg_map def create_pascal_label_colormap(): """Creates a label colormap used in PASCAL VOC segmentation benchmark. Returns: A Colormap for visualizing segmentation results. """ colormap = np.zeros((256, 3), dtype=int) ind = np.arange(256, dtype=int) for shift in reversed(range(8)): for channel in range(3): colormap[:, channel] |= ((ind >> channel) & 1) << shift ind >>= 3 return colormap def label_to_color_image(label): """Adds color defined by the dataset colormap to the label. Args: label: A 2D array with integer type, storing the segmentation label. Returns: result: A 2D array with floating type. The element of the array is the color indexed by the corresponding element in the input label to the PASCAL color map. Raises: ValueError: If label is not of rank 2 or its value is larger than color map maximum entry. """ if label.ndim != 2: raise ValueError('Expect 2-D input label') colormap = create_pascal_label_colormap() if np.max(label) >= len(colormap): raise ValueError('label value too large.') return colormap[label] def vis_segmentation(image, seg_map): """Visualizes input image, segmentation map and overlay view.""" plt.figure(figsize=(15, 5)) grid_spec = gridspec.GridSpec(1, 4, width_ratios=[6, 6, 6, 1]) plt.subplot(grid_spec[0]) plt.imshow(image) plt.axis('off') plt.title('input image') plt.subplot(grid_spec[1]) seg_image = label_to_color_image(seg_map).astype(np.uint8) plt.imshow(seg_image) plt.axis('off') plt.title('segmentation map') plt.subplot(grid_spec[2]) plt.imshow(image) plt.imshow(seg_image, alpha=0.7) plt.axis('off') plt.title('segmentation overlay') unique_labels = np.unique(seg_map) ax = plt.subplot(grid_spec[3]) plt.imshow( FULL_COLOR_MAP[unique_labels].astype(np.uint8), interpolation='nearest') ax.yaxis.tick_right() plt.yticks(range(len(unique_labels)), LABEL_NAMES[unique_labels]) plt.xticks([], []) ax.tick_params(width=0.0) plt.grid('off') plt.show() LABEL_NAMES = np.asarray([ 'background', 'aeroplane', 'bicycle', 'bird', 'boat', 'bottle', 'bus', 'car', 'cat', 'chair', 'cow', 'diningtable', 'dog', 'horse', 'motorbike', 'person', 'pottedplant', 'sheep', 'sofa', 'train', 'tv' ]) FULL_LABEL_MAP = np.arange(len(LABEL_NAMES)).reshape(len(LABEL_NAMES), 1) FULL_COLOR_MAP = label_to_color_image(FULL_LABEL_MAP) # @param ['mobilenetv2_coco_voctrainaug', 'mobilenetv2_coco_voctrainval', 'xception_coco_voctrainaug', 'xception_coco_voctrainval'] MODEL_NAME = 'mobilenetv2_coco_voctrainaug' _DOWNLOAD_URL_PREFIX = 'http://download.tensorflow.org/models/' _MODEL_URLS = { 'mobilenetv2_coco_voctrainaug': 'deeplabv3_mnv2_pascal_train_aug_2018_01_29.tar.gz', 'mobilenetv2_coco_voctrainval': 'deeplabv3_mnv2_pascal_trainval_2018_01_29.tar.gz', 'xception_coco_voctrainaug': 'deeplabv3_pascal_train_aug_2018_01_04.tar.gz', 'xception_coco_voctrainval': 'deeplabv3_pascal_trainval_2018_01_04.tar.gz', } _TARBALL_NAME = 'deeplab_model.tar.gz' model_dir = tempfile.mkdtemp() tf.gfile.MakeDirs(model_dir) download_path = os.path.join(model_dir, _TARBALL_NAME) print('downloading model, this might take a while...') urllib.request.urlretrieve(_DOWNLOAD_URL_PREFIX + _MODEL_URLS[MODEL_NAME], download_path) print('download completed! loading DeepLab model...') MODEL = DeepLabModel(download_path) print('model loaded successfully!') SAMPLE_IMAGE = 'image1' # @param ['image1', 'image2', 'image3'] IMAGE_URL = '' # @param {type:"string"} _SAMPLE_URL = ('https://github.com/tensorflow/models/blob/master/research/' 'deeplab/g3doc/img/%s.jpg?raw=true') def run_visualization(url): """Inferences DeepLab model and visualizes result.""" try: f = urllib.request.urlopen(url) jpeg_str = f.read() original_im = Image.open(BytesIO(jpeg_str)) except IOError: print('Cannot retrieve image. Please check url: ' + url) return print('running deeplab on image %s...' % url) resized_im, seg_map = MODEL.run(original_im) vis_segmentation(resized_im, seg_map) # image_url = IMAGE_URL or _SAMPLE_URL % SAMPLE_IMAGE # run_visualization(image_url) import cv2 def vis_segmentation_opencv(image, seg_map): seg_image = label_to_color_image(seg_map).astype(np.uint8) unique_labels = np.unique(seg_map) return seg_image, unique_labels cap = cv2.VideoCapture(0) while True: ret, frame = cap.read() if ret: resized_im, seg_map = MODEL.run( Image.fromarray(cv2.cvtColor(frame, cv2.COLOR_BGR2RGB))) seg_image, unique_labels = vis_segmentation_opencv(resized_im, seg_map) seg_image_ = np.array(seg_image, dtype=np.uint8) h, w, ch = frame.shape resized_seg_im = cv2.resize(seg_image_, (w, h), interpolation=cv2.INTER_NEAREST) output = (0.4*resized_seg_im + 0.6*frame).astype("uint8") cv2.imshow('output', output) if cv2.waitKey(1) & 0xFF == ord('q'): break else: cap.set(cv2.CAP_PROP_POS_FRAMES, 0)結果はこちらになります。

DeepLabによるSemantic Segmentation #DeepLab #CV #Python #OpenCV pic.twitter.com/XBF0pdzB9E

— 藤本賢志(ガチ本)@pixivFANBOXはじめました (@sotongshi) June 19, 2020お疲れ様でした。

- 投稿日:2020-06-19T19:48:17+09:00

DeepLabのSemantic Segmentationやーる(Windows10、Python3.6)

はじめに

DeepLabのセマンティックセグメンテーションをやっていきます

システム環境

- Windows10(RTX2080 Max-Q、i7-8750H、RAM16GB)

- Anaconda 2020.02

- Python 3.6

- CUDA Toolkit v10.0

導入

modelsをクローンします。

DeepLabはresearch/deeplabにあります。deeplab_demo.ipynbを実行してみましょう。まずは、deeplab環境を作成します。

CUDA Toolkit v10.0をインストールしてください。cudart64_100.dllが必要です。$ anaconda create -n deeplab python=3.6 $ conda activate deeplab $ pip install jupyter $ pip install matplotlib $ pip install pillow $ pip install tensorflow-gpu==1.15jupyter notebookを開きます。

$ cd models-master/research/deeplab $ jupyter notebook出力されたURLにアクセスして、deeplab_demo.ipynbを開きます。上から順番に実行していきましょう。

最初のセルの%tensorflow_version 1.x はエラーが出たので、コメントアウトしました。import os from io import BytesIO import tarfile import tempfile from six.moves import urllib from matplotlib import gridspec from matplotlib import pyplot as plt import numpy as np from PIL import Image # %tensorflow_version 1.x import tensorflow as tfプログラムの部分をコピペして、deeplab_demo.pyを作成し、実行してみましょう。同じことができると思います。

ウェブカメラの映像を入力

ウェブカメラから読み込んで処理してみましょう。

描画にはOpenCVを用いるので、ライブラリをインストールします。$ pip install opencv-python次のプログラムを作成し、実行します。