- 投稿日:2020-11-12T23:26:00+09:00

PyTorch 1.7でtorch-scatterをインストール

環境

- Windows 10

- python 3.6.11

- Pytorch 1.7.0

- torch-scatter 2.0.5

取り急ぎ成功したので急いでメモ。

$ pip install torch-scatter -f https://pytorch-geometric.com/whl/torch-1.7.0.html Looking in links: https://pytorch-geometric.com/whl/torch-1.7.0.html Collecting torch-scatter Downloading https://pytorch-geometric.com/whl/torch-1.7.0/torch_scatter-2.0.5%2Bcu110-cp36-cp36m-win_amd64.whl (2.4 MB) |████████████████████████████████| 2.4 MB 544 kB/s Installing collected packages: torch-scatter Successfully installed torch-scatter-2.0.5しかし動かそうとすると失敗

$ python natura/bin/pytorch_sample.py Traceback (most recent call last): File "natura/bin/pytorch_sample.py", line 9, in <module> from torch_scatter import scatter_max File "C:\Users\dff40\.conda\envs\pytorch04gpu\lib\site-packages\torch_scatter\__init__.py", line 12, in <module> library, [osp.dirname(__file__)]).origin) File "C:\Users\dff40\.conda\envs\pytorch04gpu\lib\site-packages\torch\_ops.py", line 105, in load_library ctypes.CDLL(path) File "C:\Users\dff40\.conda\envs\pytorch04gpu\lib\ctypes\__init__.py", line 348, in __init__ self._handle = _dlopen(self._name, mode) OSError: [WinError 126] 指定されたモジュールが見つかりません。 (pytorch04gpu)あきらめず

エラー内容はGPU関連っぽい。CPU版をインストールすればよいかも。そこでアンインストールして以下を実行

$ pip install torch-scatter==latest+cpu -f https://pytorch-geometric.com/whl/torch-1.7.0.html Looking in links: https://pytorch-geometric.com/whl/torch-1.7.0.html Collecting torch-scatter==latest+cpu Downloading https://pytorch-geometric.com/whl/torch-1.7.0/torch_scatter-latest%2Bcpu-cp36-cp36m-win_amd64.whl (289 k B) |████████████████████████████████| 289 kB 364 kB/s Installing collected packages: torch-scatter Successfully installed torch-scatter-2.0.5これでさっきのコマンドを動かすと無事動いた!

- 投稿日:2020-11-12T23:26:00+09:00

PyTorch 1.7でtorch-scatterをインストール(失敗)

環境

- Windows 10

- python 3.6.11

- Pytorch 1.7.0

- torch-scatter 2.0.5

取り急ぎ成功したので急いでメモ。

$ pip install torch-scatter -f https://pytorch-geometric.com/whl/torch-1.7.0.html Looking in links: https://pytorch-geometric.com/whl/torch-1.7.0.html Collecting torch-scatter Downloading https://pytorch-geometric.com/whl/torch-1.7.0/torch_scatter-2.0.5%2Bcu110-cp36-cp36m-win_amd64.whl (2.4 MB) |████████████████████████████████| 2.4 MB 544 kB/s Installing collected packages: torch-scatter Successfully installed torch-scatter-2.0.5しかし動かそうとすると失敗

$ python natura/bin/pytorch_sample.py Traceback (most recent call last): File "natura/bin/pytorch_sample.py", line 9, in <module> from torch_scatter import scatter_max File "C:\Users\dff40\.conda\envs\pytorch04gpu\lib\site-packages\torch_scatter\__init__.py", line 12, in <module> library, [osp.dirname(__file__)]).origin) File "C:\Users\dff40\.conda\envs\pytorch04gpu\lib\site-packages\torch\_ops.py", line 105, in load_library ctypes.CDLL(path) File "C:\Users\dff40\.conda\envs\pytorch04gpu\lib\ctypes\__init__.py", line 348, in __init__ self._handle = _dlopen(self._name, mode) OSError: [WinError 126] 指定されたモジュールが見つかりません。 (pytorch04gpu)

- 投稿日:2020-11-12T22:35:25+09:00

主成分分析を初歩からの理解

はじめに

今回は主成分分析を勉強し直したのでまとめていきます。

主成分分析自体は前にも勉強したことあったのですが、分散共分散行列から固有値ベクトル算出して次元圧縮するであったり、scikit-learnを使って実装くらいの知識しかありませんでした。

しかしなぜ分散共分散行列の固有値から軸を求められるのか等、知らなかったので私なりに初歩的なところから理論をまとめてみることにしました。(私は忘れやすいので)

そして最後は理論をもとにpythonで実装して見ました。

よければ最後までお付き合いください。主成分分析とは(概要)

まず主成分分析についてと流れを簡単に説明します。

主成分分析とはデータの次元が大きいときに次元を圧縮して見やすくするために使用される手法です。

下図のようにある方向に軸を取りその軸に垂直に点を落としてみると効率よく2次元データを1次元で表すことができます。

もちろん軸と実際の点との距離(各点から伸びる線)の分が持つ情報は落ちてしまいます。

そのため最も情報が落ちないように分散が最大になるように軸を決めます。(詳しくは後ほど)

今回は2次元データを1次元にしていますが、高次元のデータをこのように圧縮することで私たちにも解釈しやすくなったり、分類の精度をあげたりすることができます。具体例

具体的な例を考えます。

ある5人の5教科の成績が

名前 国語 社会 英語 算数 理科 A 60 70 70 40 30 B 70 60 80 30 30 C 40 20 30 70 80 D 30 20 40 80 80 E 30 30 30 80 70 だったとします。

明らかに偏ってますが...

この人たちの傾向はどのようなものか考えたとき一つの手段としてグラフ化があります。

しかし5次元のデータに対してプロットをするときは図示や理解共になかなか難しいです。

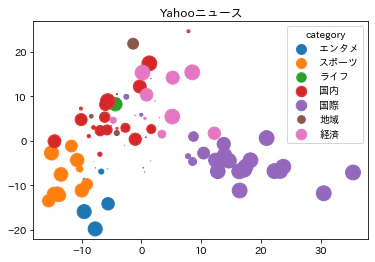

ちなみにこれを3次元空間+色(赤具合と青具合)で表すと次のようになりました。

やはり、このグラフでは何を言っているのかわかりにくいかと思います。(今回は5教科であるためわからないこともないのですが、これがもしよくわからないデータの集まりだとあたりをつけるのが難しいです)

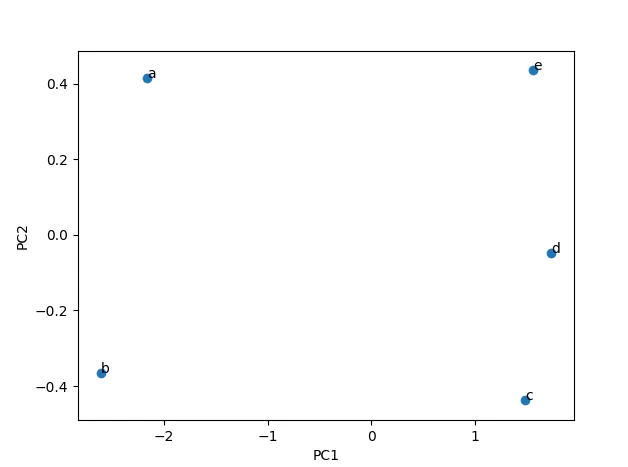

今度はこれを主成分分析で次元圧縮して2次元で図にしてみると次のようになりました。

(PCとは主成分:principal componentの事です)

主成分分析の結果のそれぞれの軸が何を表しているかの解釈は私たちが行わなければなりません。

今回の例の場合はPC1は理系科目が高い人は高い値、理系科目が不得意な人が低い値を取っているように感じられます。そのためPC1は理系の得意度を示しているのではないかと解釈します。

PC2ですが、こちらは正直何を示しているのか私には解釈できません(これからもうちょっと解釈の仕方は勉強していきます)。しかしここで寄与率をみてみます。

寄与率とは各軸がどの程度元のデータを説明できているか、の値です。

詳しくは先で説明しますが、今回の寄与率は

PC 寄与率 PC1 9.518791e-01 PC2 3.441020e-02 PC3 1.275504e-02 PC4 9.556157e-04 PC5 8.271560e-35 となり、PC1の成分で95%説明できていて、PC2で3.4%説明できている事がわかります。

そのためPC1だけでほとんどこのデータが説明できているのかもしれません。

今回はイメージしやすいように文系科目理系科目で点数を偏らせて示しましたが、このように主成分分析は次元が多いデータをイメージしやすいようにする分析方法の一つです。

今回はこの主成分分析を私のような人でも理解できるように説明していきたいと考えています。主成分分析とは(理論)

主成分分析の理論を細かく見ていきます。上の図は前述したように2次元のデータを新しい1次元のデータに変換しています。軸とデータ点の距離が大きいほどデータの損失があると考えられるため分散が最も大きい方向を求める必要があります。(一番分散が大きい方向が第一主成分)

この方向はどのように見つけるかと言うと分散共分散行列の一番大きい固有値に対応する固有ベクトルを求めれば良いのですが、なぜそれで考えられるのか見ていきたいと思います。あるデータ点と軸となるベクトルを次のように定義します。

\vec{x}= \left[ \begin{array}{r} x_1 \\\ x_2 \end{array} \right] \\\ \vec{v}= \left[ \begin{array}{r} v_1 \\\ v_2 \end{array} \right] \\\ ただし\|\vec{v}\|=1 \\\するとベクトル$\vec{x}を$ベクトル$\vec{v}$軸に垂直に落とした時の長さは

\vec{v}^\mathrm{T}\vec{x}=\left[ \begin{array}{r} v_1 & v_2 \end{array} \right]\left[ \begin{array}{r} x_1 \\\ x_2 \end{array} \right]=v_1 x_1+v_2 x_2で示されます。

ここで余談となるのですが、長さが$\vec{v}^\mathrm{T}\vec{x}$で示される証明を行います。

気になる人だけみていただければと思います。

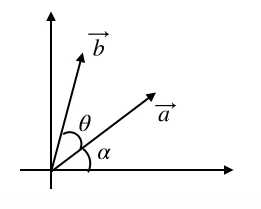

まずベクトル$\vec{a}$とベクトル$\vec{a}$を$\theta$回転させたベクトル$\vec{b}$を次のように定義します。

$\vec{a}= \left[ \begin{array}{r} a_1 \\ a_2 \end{array} \right]$

$\vec{b}= \left[ \begin{array}{r} b_1 \\ b_2 \end{array} \right]=\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\left[ \begin{array}{r} a_1 \\ a_2 \end{array} \right]$基本的なことですがベクトル$\vec{a}$にかけられている

$\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]$

はベクトル$\vec{a}$を$\theta$回転させる行列です。

ばぜこの行列で回転する変換ができる理由は加法定理によって証明することができます。加法定理による証明

ベクトルの長さをrとするとベクトル$\vec{a}$とベクトル$\vec{b}$は次のように表される。$\vec{a}= \left[ \begin{array}{r} rcos\alpha \\ rsin\alpha \end{array} \right]$

$\vec{b}= \left[ \begin{array}{r} rcos(\alpha + \theta) \\ rsin(\alpha + \theta) \end{array} \right]=\left[ \begin{array}{r} rcos(\alpha)cos(\theta) - rsin(\alpha)sin(\theta) \\ rsin(\alpha)cos(\theta)+rcos(\alpha)sin(\theta) \end{array} \right]=\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\left[ \begin{array}{r} rcos(\alpha) \\ rsin(\alpha) \end{array} \right]=\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\vec{a}$よって証明される。

証明するのはベクトル$\vec{b}$をベクトル$\vec{a}$軸状に垂直に落とした時の長さが等しくなれば良いため

$|\vec{b}|cos\theta=\vec{v}^\mathrm{T}\vec{b}$

が示されれば良いということになります。

ベクトル$\vec{v}$はベクトル$\vec{a}$と同じ方向で大きさが1であるため$\vec{v}=\frac{1}{\sqrt{a_1^2+a_2^2}}\vec{a}$

である。

そのため$\vec{v}^\mathrm{T}\vec{b}=\frac{1}{\sqrt{a_1^2+a_2^2}}\left[ \begin{array}{r} a_1 & a_2 \end{array} \right]\left[ \begin{array}{r} b_1 \\ b_2 \end{array} \right]$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}\left[ \begin{array}{r} a_1 & a_2 \end{array} \right]\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\left[ \begin{array}{r} a_1 \\ a_2 \end{array} \right]$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}\left[ \begin{array}{r} a_1 & a_2 \end{array} \right]\left[ \begin{array}{r} a_1cos\theta-a_2sin\theta \\ a_1sin\theta+a_2cos\theta \end{array} \right]$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}(a_1^2cos\theta-a_1a_2sin\theta+a_1a_2sin\theta+a_2^2cos\theta)$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}(a_1^2+a_2^2)cos\theta$

$\quad\ =\sqrt{a_1^2+a_2^2}cos\theta$

$\quad\ =|\vec{b}|cos\theta$よって$\vec{v}^\mathrm{T}\vec{x}$によってベクトル$\vec{x}$をベクトル$\vec{v}上に垂直に落とした時の長さを求めることができる。$

つまり求める$\vec{v}$はデータ点がn個ある時のこの長さ$\vec{v}^\mathrm{T}\vec{x}$の分散が大きくなるベクトルとなります。

$\vec{v}^\mathrm{T}\vec{x}$の分散は$$\frac{1}{n-1}\sum_{i=1}^{n}\left[\vec{v}^\mathrm{T}(\vec{x_i}-\hat{\mu})\right]^2\ \;=\; \vec{v}^{\mathrm{T}}\frac{1}{n-1}\sum_{i=1}^n(\vec{x_i}-\hat{\mu})(\vec{x_i}-\hat{\mu})^\mathrm{T}\vec{v}$$

$(\vec{a}\vec{b})^\mathrm{T}=\vec{a}^{\mathrm{T}} \vec{b}^{\mathrm{T}}$である。

ここでベクトル$\vec{v}$で囲まれ他部分は分散共分散行列の形であるため

$$\Sigma=\frac{1}{n-1}\sum_{i=1}^n(\vec{x_i}-\hat{\mu})(\vec{x_i}-\hat{\mu})^\mathrm{T}\ $$

と置くと

分散は$$\vec{v}^\mathrm{T}\Sigma\vec{v}$$

と置く事ができる。

つまりこの分散が最大となる方向のベクトル$\vec{v}$を求めるために$$\max_{v:|v|=1}(\vec{v}^\mathrm{T}\Sigma\vec{v})$$

を考えます。

ここで$\Sigma$は半正定値行列であるため直行行列で対角化する事ができます。全ての零ベクトルでない $x∈ℝ^n$ について $x^TAx≥0$ が成り立つとき半正定値(positive semidefinite)という

--Horn and Johnson(2013) Definition 4.1.11--つまり

$$\Sigma\vec{v_i}=\lambda_i\vec{v_i}$$

となる固有ベクトルと固有値を考え

V=[v_1,v_2,...,v_d] \\\ \Lambda=diag(\lambda_1,\lambda_2,...,\lambda_d)と置いた時

$\Sigma V$とはVベクトルをそれぞれ対応する固有値倍に変換しているため$$\Sigma V=V\Lambda$$

であり

$V$は直交行列であるので$$\Sigma = V\Lambda V^\mathrm{T} \quad V^\mathrm{T}\Sigma V=\Lambda$$

これをもとに分散が最大化されるベクトルを求めていきます。

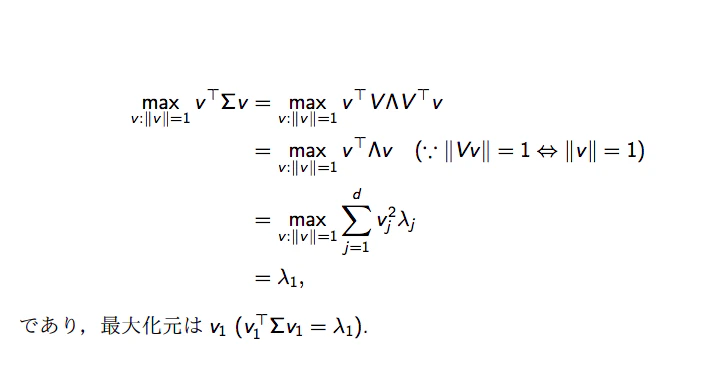

私が参考にした物では以下のように最大化解が一番大きい固有値であると証明されていました。(参考文献[1])

しかし私はこれがいまいち理解できなかったため私なりに考えて見ました。(間違っていればご指摘ください)

計算の簡略化のため2次元の場合を考えます、

まず\begin{align} V&=\left[\begin{array}{cc} v_1 & v_2\end{array} \right]=\left[\begin{array}{cc} v_{1x} & v_{2x} \\\ v_{1y} & v_{2y}\end{array} \right] \\\ \vec{v}&=\left[\begin{array}{c} v_x \\\ v_y \end{array}\right] \\\ \Lambda&=\left[\begin{array}{cc} \lambda_1 &0 \\\ 0 & \lambda_2 \end{array}\right] \end{align}と置きます。

そしてかっこの中身を式変形していきます。\begin{align} \vec{v}^\mathrm{T}\Sigma\vec{v} &= \vec{v}^\mathrm{T}V\Lambda V^\mathrm{T}\vec{v} \\\\ &= \vec{v}^\mathrm{T}\left[\begin{array}{cc} v_{1x} & v_{2x} \\\ v_{1y} & v_{2y}\end{array} \right]\left[\begin{array}{cc} \lambda_1 &0 \\\ 0 & \lambda_2 \end{array}\right] \left[\begin{array}{cc} v_{1x} & v_{1y} \\\ v_{2x} & v_{2y}\end{array} \right]\vec{v} \\\\ &=\vec{v}^\mathrm{T}\left[ \begin{array}{cc} v_{1x}^2\lambda_1+v_{2x}^2 \lambda_2 & v_{1x} v_{1y} \lambda_1 +v_{2x} v_{2y} \lambda_2 \\\ v_{1x} v_{1y} \lambda_1 +v_{2x} v_{2y} \lambda_2 & v_{1y}^2\lambda_1+V_{2y}^2 \lambda_2 \end{array} \right] \vec{v} \\\\ &=\vec{v}^\mathrm{T}\left( \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\lambda_1+\left[ \begin{array}{cc} v_{2x}^2& v_{2x} v_{2y} \\\ v_{2x} v_{2y} &V_{2y}^2 \end{array} \right]\lambda_2\right) \vec{v} \\\\ &=\vec{v}^\mathrm{T} \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\vec{v}\lambda_1+\vec{v}^\mathrm{T}\left[ \begin{array}{cc} v_{2x}^2& v_{2x} v_{2y} \\\ v_{2x} v_{2y} &V_{2y}^2 \end{array} \right]\vec{v}\lambda_2 \\\ \end{align}$\lambda_1$の項のみを取り出して考えて見ると

\begin{align} \vec{v}^\mathrm{T} \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\vec{v}\lambda_1&=\left[\begin{array}{c} v_x & v_y \end{array}\right] \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\left[\begin{array}{c} v_x \\\ v_y \end{array}\right]\lambda_1 \\\\ &=(v_{1x}^2 v_x^2+2v_{1x}v_{1y}v_xv_y+v_{1y}^2 v_y^2)\lambda_1 \\\\ &=(v_{1x}v_x+v_{1y}v_y)^2\lambda_1 \\\\ &=\left(\left[\begin{array}{c}v_{1x} & v_{1y} \end{array}\right]\left[\begin{array}{c} v_x \\\ v_y \end{array}\right]\right)^2\lambda_1 \\\\ &=\left(\vec{v_1}^\mathrm{T} \vec{v}\right)^2\lambda_1 \end{align}となる。

つまり\begin{align} \max_{v:|v|=1}\left(\vec{v}^\mathrm{T}\Sigma\vec{v}\right) &=\max_{v:|v|=1}\left(\left(\vec{v_1}^\mathrm{T}\vec{v}\right)^2\lambda_1+\left(\vec{v_2}^\mathrm{T}\vec{v}\right)^2\lambda_2\right) \\\ &=\max_{v:|v|=1}\left(\sum_{i=1}^2\left(\vec{v_i}^\mathrm{T}\vec{v}\right)^2\lambda_i\right) \\\ 一般化すると \\\ &=\max_{v:|v|=1}\left(\sum_{i=1}^d\left(\vec{v_i}^\mathrm{T}\vec{v}\right)^2\lambda_i\right) \end{align}となる。

この時$\vec{v},\vec{v_i}$は単位ベクトルで$\vec{v_1},\vec{v_2},...,\vec{v_d}$は互いに直行している。

そのため、$\vec{v}=\vec{v_i}$の時$$\max_{v:|v|=1}\left(\vec{v_i}^\mathrm{T}\vec{v}\right)=1$$

となる。(同じ方向の単位ベクトルの内積は1をとる)

同じように$i\neq j$の時$$\max_{v:|v|=1}\left(\vec{v_j}^\mathrm{T}\vec{v}\right)=0$$

である。(直行するベクトルの内積は0)

つまり最大値をとるときはベクトルvが最大の固有値と対応する固有ベクトルと等しくなるときであるため

$$\max_{v:|v|=1}\left(\sum_{i=1}^d\left(\vec{v_i}^\mathrm{T}\vec{v}\right)^2\lambda_i\right)=\lambda_1$$

となる。

また、同じように2番目に分散の大きい軸を取りたいときは$\vec{v}$を2番目に大きい固有値に対応する固有ベクトルと同じ方向に合わせれば良いという事になります。

分散共分散行列と相関行列

主成分分析を行う時、分散共分散行列の固有ベクトルをとる時と相関行列の固有ベクトルをとる方法があると聞いた事がある方がいるかと思います。

そもそも相関行列とはデータをそのデータの標準偏差で割ったものの分散共分散行列です。

先に平均も引いてしまって問題ないため、標準化されたデータの分散共分散行列でもあります。

つまりデータを先に標準化してしまえば先ほどの理論とやることは同じとなるため、標準偏差の固有ベクトルでも主成分分析できる事がわかると思います。

そのため実際どちらの方法をとっても主成分分析を行う事ができまが、相関行列の固有ベクトルをとった方が良いと言われています。

なぜならデータそのままの分散共分散行列だとデータの単位がバラバラでそこを考慮しなくてはいけないからです。

そのため単位をない状態にして主成分分析を行なった方が良いと言われています。(具体的にどのように影響が出るのかは例で説明できなかったので何か遭遇したら追記したいと思います)寄与率

最後に寄与率についてです。

寄与率とはそのデータがどのくらいデータを示しているかを差します。

そしてその値は理論でもお話したように分散の大きさで示す事ができ、分散の大きさはある方向ベクトルを取った時の固有値となりました。

その固有値の割合を求めれば良いため、寄与率PVは

$$PV_i=\frac{\lambda_i}{\sum_{j=1}^{d}\lambda_j}$$によって求められます。

実装

それではこの理論を用いて実装して見たいと思います。

ここで使用するデータは最初の概要でも使った5人の成績データを用います。

名前 国語 社会 英語 算数 理科 A 60 70 70 40 30 B 70 60 80 30 30 C 40 20 30 70 80 D 30 20 40 80 80 E 30 30 30 80 70 まず正解としてscikit-learnのPCAの実装を見て見ます。

実装したところこのようになりました。pandasを使用しているのは私が使い慣れていないための勉強を兼ねているだけですscikit_pca.pyimport matplotlib.pyplot as plt import numpy as np from sklearn.decomposition import PCA import pandas as pd #データの作成 name = ['a','b','c','d','e'] a = np.array([60,70,70,40,30]) b = np.array([70,60,80,30,30]) c = np.array([40,20,30,70,80]) d = np.array([30,20,40,80,80]) e = np.array([30,30,30,80,70]) #フレームワークに格納 df = pd.DataFrame([a,b,c,d,e],columns=['language','society','english','math','science'],index=name) dfs = df.iloc[:,:].apply(lambda x:(x-x.mean())/x.std(),axis=0) #データの標準化 #scikit-learnでのPCAインスタンス化と学習 pca = PCA() pca.fit(dfs) feature=pca.transform(dfs) #結果の出力 print(pd.DataFrame(feature,columns=["PC{}".format(x+1) for x in range(len(dfs.columns))]).head()) plt.figure() for i in range(len(name)): plt.annotate(name[i],xy=(feature[i,0],feature[i,1])) plt.scatter(feature[:,0],feature[:,1],marker='o') plt.xlabel('PC1') plt.ylabel('PC2') plt.show() print(pd.DataFrame(pca.explained_variance_ratio_,index=["PC{}".format(x+1) for x in range(len(dfs.columns))]))結果は以下のようになりました。

$python scikit_pca.py PC1 PC2 PC3 PC4 PC5 0 -2.161412 0.414977 -0.075496 -0.073419 4.163336e-17 1 -2.601987 -0.364980 0.088599 0.064849 4.163336e-17 2 1.479995 -0.437661 -0.290635 -0.037986 4.163336e-17 3 1.727683 -0.047103 0.382252 -0.035840 -1.387779e-17 4 1.555721 0.434767 -0.104720 0.082396 -1.457168e-16 0 PC1 9.518791e-01 PC2 3.441020e-02 PC3 1.275504e-02 PC4 9.556157e-04 PC5 8.271560e-35続いて理論に基づいて実装して見ました。

クラスとしてMyPCAを定義し、scikit-learnと同様に使えるようにfit()メソッドで学習、transform()メソッドで新しい空間に射影する処理をしています。

クラスの定義以外は前のプログラムのpca=PCA()を

pca=MyPCA()に変更するだけなので省略して、クラスの定義のみ載せていますが、次のようになりました。

my_pca.py#myPCA program class MyPCA: e_values = None #固有値の保存 e_covs = None #固有ベクトルの保存 explained_variance_ratio_ = None def fit(self,dfs): #pandasデータでもnumpyデータでも使えるようにするための処理 if(type(dfs)==type(pd.DataFrame())): all_data = dfs.values else: all_data=dfs data_cov=np.cov(all_data,rowvar=0,bias=0) #分散共分散行列処理 self.e_values,self.e_vecs=np.linalg.eig(data_cov) #固有値と固有ベクトルの算出 self.explained_variance_ratio_= self.e_values/self.e_values.sum() #寄与率の計算 def transform(self,dfs): #pandasデータでもnumpyデータでも使えるようにするための処理 if(type(dfs)==type(pd.DataFrame())): all_data = dfs.values else: all_data=dfs feature = [] for e_vec in self.e_vecs.T: temp_feature=[] for data in all_data: temp_feature.append(np.dot(e_vec,data)) #内積計算 feature.append(temp_feature) return np.array(feature).Tそして結果です。

PC1 PC2 PC3 PC4 PC5 0 2.161412 -0.414977 -0.075496 -7.771561e-16 0.073419 1 2.601987 0.364980 0.088599 1.665335e-15 -0.064849 2 -1.479995 0.437661 -0.290635 -4.996004e-16 0.037986 3 -1.727683 0.047103 0.382252 -5.551115e-16 0.035840 4 -1.555721 -0.434767 -0.104720 0.000000e+00 -0.082396 Attribute Qt::AA_EnableHighDpiScaling must be set before QCoreApplication is created. 0 PC1 9.518791e-01 PC2 3.441020e-02 PC3 1.275504e-02 PC4 2.659136e-17 PC5 9.556157e-04このようになりました。

おそらく固有ベクトルが反転してしまったため正負逆転してしまっているところもありますが、同じような解析結果が出せたかと思います。終わりに

今回は主成分分析の理論について個人的備忘録も兼ねて書いて見ました。

証明をところどころ挟んだので読みにくい記事になってしまった感が否めないのですが、私のような人は細かいところが気になって進めないこともあるかと考えできるだけ証明しました。今回取り上げた主成分分析はscikit-learnで簡単に使えてしまうので中身をあまり理解せず使うのが気持ち悪く感じていたので今回一応理解ができた気がするのでスッキリしました。

ただ、scikit-learnでの実装をのぞいて見たところ特異値分解によって実装しているようです。

ただ対称行列の場合は固有値分解と特異値分解の結果は同じになるようなので、今回のような分散共分散行列や相関行列に適用するときはどちらでもいいのかと感じました。

もし機会があれば一般化以外で特異値分解を使う利点も調べて見たいと思います。参考文献

[1]http://ibis.t.u-tokyo.ac.jp/suzuki/lecture/2015/dataanalysis/L7.pdf データ解析 第七回「主成分分析」

[2]https://seetheworld1992.hatenablog.com/entry/2017/03/17/104807 分散共分散行列(と相関行列)は半正定値であることを証明する

- 投稿日:2020-11-12T22:35:25+09:00

主成分分析を初歩から数学的な理解

はじめに

今回は主成分分析を勉強し直したのでまとめていきます。

主成分分析自体は前にも勉強したことあったのですが、分散共分散行列から固有値ベクトル算出して次元圧縮するであったり、scikit-learnを使って実装くらいの知識しかありませんでした。

しかしなぜ分散共分散行列の固有値から軸を求められるのか等、知らなかったので私なりに初歩的なところから計算上での理論をまとめてみることにしました。(私は忘れやすいので)

そして最後は理論をもとにpythonで実装して見ました。

よければ最後までお付き合いください。主成分分析とは(概要)

まず主成分分析についてと流れを簡単に説明します。

主成分分析とはデータの次元が大きいときに次元を圧縮して見やすくするために使用される手法です。

下図のようにある方向に軸を取りその軸に垂直に点を落としてみると効率よく2次元データを1次元で表すことができます。

もちろん軸と実際の点との距離(各点から伸びる線)の分が持つ情報は落ちてしまいます。

そのため最も情報が落ちないように分散が最大になるように軸を決めます。(詳しくは後ほど)

今回は2次元データを1次元にしていますが、高次元のデータをこのように圧縮することで私たちにも解釈しやすくなったり、分類の精度をあげたりすることができます。具体例

具体的な例を考えます。

ある5人の5教科の成績が

名前 国語 社会 英語 算数 理科 A 60 70 70 40 30 B 70 60 80 30 30 C 40 20 30 70 80 D 30 20 40 80 80 E 30 30 30 80 70 だったとします。

明らかに偏ってますが...

この人たちの傾向はどのようなものか考えたとき一つの手段としてグラフ化があります。

しかし5次元のデータに対してプロットをするときは図示や理解共になかなか難しいです。

ちなみにこれを3次元空間+色(赤具合と青具合)で表すと次のようになりました。

やはり、このグラフでは何を言っているのかわかりにくいかと思います。(今回は5教科であるためわからないこともないのですが、これがもしよくわからないデータの集まりだとあたりをつけるのが難しいです)

今度はこれを主成分分析で次元圧縮して2次元で図にしてみると次のようになりました。

(PCとは主成分:principal componentの事です)

主成分分析の結果のそれぞれの軸が何を表しているかの解釈は私たちが行わなければなりません。

今回の例の場合はPC1は理系科目が高い人は高い値、理系科目が不得意な人が低い値を取っているように感じられます。そのためPC1は理系の得意度を示しているのではないかと解釈します。

PC2ですが、こちらは正直何を示しているのか私には解釈できません(これからもうちょっと解釈の仕方は勉強していきます)。しかしここで寄与率をみてみます。

寄与率とは各軸がどの程度元のデータを説明できているか、の値です。

詳しくは先で説明しますが、今回の寄与率は

PC 寄与率 PC1 9.518791e-01 PC2 3.441020e-02 PC3 1.275504e-02 PC4 9.556157e-04 PC5 8.271560e-35 となり、PC1の成分で95%説明できていて、PC2で3.4%説明できている事がわかります。

そのためPC1だけでほとんどこのデータが説明できているのかもしれません。

今回はイメージしやすいように文系科目理系科目で点数を偏らせて示しましたが、このように主成分分析は次元が多いデータをイメージしやすいようにする分析方法の一つです。

今回はこの主成分分析を私のような人でも理解できるように説明していきたいと考えています。主成分分析とは(理論)

主成分分析の理論を細かく見ていきます。上の図は前述したように2次元のデータを新しい1次元のデータに変換しています。軸とデータ点の距離が大きいほどデータの損失があると考えられるため分散が最も大きい方向を求める必要があります。(一番分散が大きい方向が第一主成分)

この方向はどのように見つけるかと言うと分散共分散行列の一番大きい固有値に対応する固有ベクトルを求めれば良いのですが、なぜそれで考えられるのか見ていきたいと思います。あるデータ点と軸となるベクトルを次のように定義します。

\vec{x}= \left[ \begin{array}{r} x_1 \\\ x_2 \end{array} \right] \\\ \vec{v}= \left[ \begin{array}{r} v_1 \\\ v_2 \end{array} \right] \\\ ただし\|\vec{v}\|=1 \\\するとベクトル$\vec{x}を$ベクトル$\vec{v}$軸に垂直に落とした時の長さは

\vec{v}^\mathrm{T}\vec{x}=\left[ \begin{array}{r} v_1 & v_2 \end{array} \right]\left[ \begin{array}{r} x_1 \\\ x_2 \end{array} \right]=v_1 x_1+v_2 x_2で示されます。

ここで余談となるのですが、長さが$\vec{v}^\mathrm{T}\vec{x}$で示される証明を行います。

気になる人だけみていただければと思います。

まずベクトル$\vec{a}$とベクトル$\vec{a}$を$\theta$回転させたベクトル$\vec{b}$を次のように定義します。

$\vec{a}= \left[ \begin{array}{r} a_1 \\ a_2 \end{array} \right]$

$\vec{b}= \left[ \begin{array}{r} b_1 \\ b_2 \end{array} \right]=\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\left[ \begin{array}{r} a_1 \\ a_2 \end{array} \right]$基本的なことですがベクトル$\vec{a}$にかけられている

$\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]$

はベクトル$\vec{a}$を$\theta$回転させる行列です。

ばぜこの行列で回転する変換ができる理由は加法定理によって証明することができます。加法定理による証明

ベクトルの長さをrとするとベクトル$\vec{a}$とベクトル$\vec{b}$は次のように表される。$\vec{a}= \left[ \begin{array}{r} rcos\alpha \\ rsin\alpha \end{array} \right]$

$\vec{b}= \left[ \begin{array}{r} rcos(\alpha + \theta) \\ rsin(\alpha + \theta) \end{array} \right]=\left[ \begin{array}{r} rcos(\alpha)cos(\theta) - rsin(\alpha)sin(\theta) \\ rsin(\alpha)cos(\theta)+rcos(\alpha)sin(\theta) \end{array} \right]=\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\left[ \begin{array}{r} rcos(\alpha) \\ rsin(\alpha) \end{array} \right]=\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\vec{a}$よって証明される。

証明するのはベクトル$\vec{b}$をベクトル$\vec{a}$軸状に垂直に落とした時の長さが等しくなれば良いため

$|\vec{b}|cos\theta=\vec{v}^\mathrm{T}\vec{b}$

が示されれば良いということになります。

ベクトル$\vec{v}$はベクトル$\vec{a}$と同じ方向で大きさが1であるため$\vec{v}=\frac{1}{\sqrt{a_1^2+a_2^2}}\vec{a}$

である。

そのため$\vec{v}^\mathrm{T}\vec{b}=\frac{1}{\sqrt{a_1^2+a_2^2}}\left[ \begin{array}{r} a_1 & a_2 \end{array} \right]\left[ \begin{array}{r} b_1 \\ b_2 \end{array} \right]$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}\left[ \begin{array}{r} a_1 & a_2 \end{array} \right]\left[ \begin{array}{r} cos\theta&-sin\theta \\ sin\theta & cos\theta \end{array} \right]\left[ \begin{array}{r} a_1 \\ a_2 \end{array} \right]$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}\left[ \begin{array}{r} a_1 & a_2 \end{array} \right]\left[ \begin{array}{r} a_1cos\theta-a_2sin\theta \\ a_1sin\theta+a_2cos\theta \end{array} \right]$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}(a_1^2cos\theta-a_1a_2sin\theta+a_1a_2sin\theta+a_2^2cos\theta)$

$\quad\ =\frac{1}{\sqrt{a_1^2+a_2^2}}(a_1^2+a_2^2)cos\theta$

$\quad\ =\sqrt{a_1^2+a_2^2}cos\theta$

$\quad\ =|\vec{b}|cos\theta$よって$\vec{v}^\mathrm{T}\vec{x}$によってベクトル$\vec{x}$をベクトル$\vec{v}上に垂直に落とした時の長さを求めることができる。$

つまり求める$\vec{v}$はデータ点がn個ある時のこの長さ$\vec{v}^\mathrm{T}\vec{x}$の分散が大きくなるベクトルとなります。

$\vec{v}^\mathrm{T}\vec{x}$の分散は$$\frac{1}{n-1}\sum_{i=1}^{n}\left[\vec{v}^\mathrm{T}(\vec{x_i}-\hat{\mu})\right]^2\ \;=\; \vec{v}^{\mathrm{T}}\frac{1}{n-1}\sum_{i=1}^n(\vec{x_i}-\hat{\mu})(\vec{x_i}-\hat{\mu})^\mathrm{T}\vec{v}$$

$(\vec{a}\vec{b})^\mathrm{T}=\vec{a}^{\mathrm{T}} \vec{b}^{\mathrm{T}}$である。

ここでベクトル$\vec{v}$で囲まれ他部分は分散共分散行列の形であるため

$$\Sigma=\frac{1}{n-1}\sum_{i=1}^n(\vec{x_i}-\hat{\mu})(\vec{x_i}-\hat{\mu})^\mathrm{T}\ $$

と置くと

分散は$$\vec{v}^\mathrm{T}\Sigma\vec{v}$$

と置く事ができる。

つまりこの分散が最大となる方向のベクトル$\vec{v}$を求めるために$$\max_{v:|v|=1}(\vec{v}^\mathrm{T}\Sigma\vec{v})$$

を考えます。

ここで$\Sigma$は半正定値行列であるため直行行列で対角化する事ができます。全ての零ベクトルでない $x∈ℝ^n$ について $x^TAx≥0$ が成り立つとき半正定値(positive semidefinite)という

--Horn and Johnson(2013) Definition 4.1.11--つまり

$$\Sigma\vec{v_i}=\lambda_i\vec{v_i}$$

となる固有ベクトルと固有値を考え

V=[v_1,v_2,...,v_d] \\\ \Lambda=diag(\lambda_1,\lambda_2,...,\lambda_d)と置いた時

$\Sigma V$とはVベクトルをそれぞれ対応する固有値倍に変換しているため$$\Sigma V=V\Lambda$$

であり

$V$は直交行列であるので$$\Sigma = V\Lambda V^\mathrm{T} \quad V^\mathrm{T}\Sigma V=\Lambda$$

これをもとに分散が最大化されるベクトルを求めていきます。

私が参考にした物では以下のように最大化解が一番大きい固有値であると証明されていました。(参考文献[1])

しかし私はこれがいまいち理解できなかったため私なりに考えて見ました。(間違っていればご指摘ください)

計算の簡略化のため2次元の場合を考えます、

まず\begin{align} V&=\left[\begin{array}{cc} v_1 & v_2\end{array} \right]=\left[\begin{array}{cc} v_{1x} & v_{2x} \\\ v_{1y} & v_{2y}\end{array} \right] \\\ \vec{v}&=\left[\begin{array}{c} v_x \\\ v_y \end{array}\right] \\\ \Lambda&=\left[\begin{array}{cc} \lambda_1 &0 \\\ 0 & \lambda_2 \end{array}\right] \end{align}と置きます。

そしてかっこの中身を式変形していきます。\begin{align} \vec{v}^\mathrm{T}\Sigma\vec{v} &= \vec{v}^\mathrm{T}V\Lambda V^\mathrm{T}\vec{v} \\\\ &= \vec{v}^\mathrm{T}\left[\begin{array}{cc} v_{1x} & v_{2x} \\\ v_{1y} & v_{2y}\end{array} \right]\left[\begin{array}{cc} \lambda_1 &0 \\\ 0 & \lambda_2 \end{array}\right] \left[\begin{array}{cc} v_{1x} & v_{1y} \\\ v_{2x} & v_{2y}\end{array} \right]\vec{v} \\\\ &=\vec{v}^\mathrm{T}\left[ \begin{array}{cc} v_{1x}^2\lambda_1+v_{2x}^2 \lambda_2 & v_{1x} v_{1y} \lambda_1 +v_{2x} v_{2y} \lambda_2 \\\ v_{1x} v_{1y} \lambda_1 +v_{2x} v_{2y} \lambda_2 & v_{1y}^2\lambda_1+V_{2y}^2 \lambda_2 \end{array} \right] \vec{v} \\\\ &=\vec{v}^\mathrm{T}\left( \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\lambda_1+\left[ \begin{array}{cc} v_{2x}^2& v_{2x} v_{2y} \\\ v_{2x} v_{2y} &V_{2y}^2 \end{array} \right]\lambda_2\right) \vec{v} \\\\ &=\vec{v}^\mathrm{T} \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\vec{v}\lambda_1+\vec{v}^\mathrm{T}\left[ \begin{array}{cc} v_{2x}^2& v_{2x} v_{2y} \\\ v_{2x} v_{2y} &V_{2y}^2 \end{array} \right]\vec{v}\lambda_2 \\\ \end{align}$\lambda_1$の項のみを取り出して考えて見ると

\begin{align} \vec{v}^\mathrm{T} \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\vec{v}\lambda_1&=\left[\begin{array}{c} v_x & v_y \end{array}\right] \left[ \begin{array}{cc} v_{1x}^2 & v_{1x} v_{1y} \\\ v_{1x} v_{1y} & v_{1y}^2 \end{array} \right]\left[\begin{array}{c} v_x \\\ v_y \end{array}\right]\lambda_1 \\\\ &=(v_{1x}^2 v_x^2+2v_{1x}v_{1y}v_xv_y+v_{1y}^2 v_y^2)\lambda_1 \\\\ &=(v_{1x}v_x+v_{1y}v_y)^2\lambda_1 \\\\ &=\left(\left[\begin{array}{c}v_{1x} & v_{1y} \end{array}\right]\left[\begin{array}{c} v_x \\\ v_y \end{array}\right]\right)^2\lambda_1 \\\\ &=\left(\vec{v_1}^\mathrm{T} \vec{v}\right)^2\lambda_1 \end{align}となる。

つまり\begin{align} \max_{v:|v|=1}\left(\vec{v}^\mathrm{T}\Sigma\vec{v}\right) &=\max_{v:|v|=1}\left(\left(\vec{v_1}^\mathrm{T}\vec{v}\right)^2\lambda_1+\left(\vec{v_2}^\mathrm{T}\vec{v}\right)^2\lambda_2\right) \\\ &=\max_{v:|v|=1}\left(\sum_{i=1}^2\left(\vec{v_i}^\mathrm{T}\vec{v}\right)^2\lambda_i\right) \\\ 一般化すると \\\ &=\max_{v:|v|=1}\left(\sum_{i=1}^d\left(\vec{v_i}^\mathrm{T}\vec{v}\right)^2\lambda_i\right) \end{align}となる。

この時$\vec{v},\vec{v_i}$は単位ベクトルで$\vec{v_1},\vec{v_2},...,\vec{v_d}$は互いに直行している。

そのため、$\vec{v}=\vec{v_i}$の時$$\max_{v:|v|=1}\left(\vec{v_i}^\mathrm{T}\vec{v}\right)=1$$

となる。(同じ方向の単位ベクトルの内積は1をとる)

同じように$i\neq j$の時$$\max_{v:|v|=1}\left(\vec{v_j}^\mathrm{T}\vec{v}\right)=0$$

である。(直行するベクトルの内積は0)

つまり最大値をとるときはベクトルvが最大の固有値と対応する固有ベクトルと等しくなるときであるため

$$\max_{v:|v|=1}\left(\sum_{i=1}^d\left(\vec{v_i}^\mathrm{T}\vec{v}\right)^2\lambda_i\right)=\lambda_1$$

となる。

また、同じように2番目に分散の大きい軸を取りたいときは$\vec{v}$を2番目に大きい固有値に対応する固有ベクトルと同じ方向に合わせれば良いという事になります。

分散共分散行列と相関行列

主成分分析を行う時、分散共分散行列の固有ベクトルをとる時と相関行列の固有ベクトルをとる方法があると聞いた事がある方がいるかと思います。

そもそも相関行列とはデータをそのデータの標準偏差で割ったものの分散共分散行列です。

先に平均も引いてしまって問題ないため、標準化されたデータの分散共分散行列でもあります。

つまりデータを先に標準化してしまえば先ほどの理論とやることは同じとなるため、標準偏差の固有ベクトルでも主成分分析できる事がわかると思います。

そのため実際どちらの方法をとっても主成分分析を行う事ができまが、相関行列の固有ベクトルをとった方が良いと言われています。

なぜならデータそのままの分散共分散行列だとデータの単位がバラバラでそこを考慮しなくてはいけないからです。

そのため単位をない状態にして主成分分析を行なった方が良いと言われています。(具体的にどのように影響が出るのかは例で説明できなかったので何か遭遇したら追記したいと思います)寄与率

最後に寄与率についてです。

寄与率とはそのデータがどのくらいデータを示しているかを差します。

そしてその値は理論でもお話したように分散の大きさで示す事ができ、分散の大きさはある方向ベクトルを取った時の固有値となりました。

その固有値の割合を求めれば良いため、寄与率PVは

$$PV_i=\frac{\lambda_i}{\sum_{j=1}^{d}\lambda_j}$$によって求められます。

実装

それではこの理論を用いて実装して見たいと思います。

ここで使用するデータは最初の概要でも使った5人の成績データを用います。

名前 国語 社会 英語 算数 理科 A 60 70 70 40 30 B 70 60 80 30 30 C 40 20 30 70 80 D 30 20 40 80 80 E 30 30 30 80 70 まず正解としてscikit-learnのPCAの実装を見て見ます。

実装したところこのようになりました。pandasを使用しているのは私が使い慣れていないための勉強を兼ねているだけですscikit_pca.pyimport matplotlib.pyplot as plt import numpy as np from sklearn.decomposition import PCA import pandas as pd #データの作成 name = ['a','b','c','d','e'] a = np.array([60,70,70,40,30]) b = np.array([70,60,80,30,30]) c = np.array([40,20,30,70,80]) d = np.array([30,20,40,80,80]) e = np.array([30,30,30,80,70]) #フレームワークに格納 df = pd.DataFrame([a,b,c,d,e],columns=['language','society','english','math','science'],index=name) dfs = df.iloc[:,:].apply(lambda x:(x-x.mean())/x.std(),axis=0) #データの標準化 #scikit-learnでのPCAインスタンス化と学習 pca = PCA() pca.fit(dfs) feature=pca.transform(dfs) #結果の出力 print(pd.DataFrame(feature,columns=["PC{}".format(x+1) for x in range(len(dfs.columns))]).head()) plt.figure() for i in range(len(name)): plt.annotate(name[i],xy=(feature[i,0],feature[i,1])) plt.scatter(feature[:,0],feature[:,1],marker='o') plt.xlabel('PC1') plt.ylabel('PC2') plt.show() print(pd.DataFrame(pca.explained_variance_ratio_,index=["PC{}".format(x+1) for x in range(len(dfs.columns))]))結果は以下のようになりました。

$python scikit_pca.py PC1 PC2 PC3 PC4 PC5 0 -2.161412 0.414977 -0.075496 -0.073419 4.163336e-17 1 -2.601987 -0.364980 0.088599 0.064849 4.163336e-17 2 1.479995 -0.437661 -0.290635 -0.037986 4.163336e-17 3 1.727683 -0.047103 0.382252 -0.035840 -1.387779e-17 4 1.555721 0.434767 -0.104720 0.082396 -1.457168e-16 0 PC1 9.518791e-01 PC2 3.441020e-02 PC3 1.275504e-02 PC4 9.556157e-04 PC5 8.271560e-35続いて理論に基づいて実装して見ました。

クラスとしてMyPCAを定義し、scikit-learnと同様に使えるようにfit()メソッドで学習、transform()メソッドで新しい空間に射影する処理をしています。

クラスの定義以外は前のプログラムのpca=PCA()を

pca=MyPCA()に変更するだけなので省略して、クラスの定義のみ載せていますが、次のようになりました。

my_pca.py#myPCA program class MyPCA: e_values = None #固有値の保存 e_covs = None #固有ベクトルの保存 explained_variance_ratio_ = None def fit(self,dfs): #pandasデータでもnumpyデータでも使えるようにするための処理 if(type(dfs)==type(pd.DataFrame())): all_data = dfs.values else: all_data=dfs data_cov=np.cov(all_data,rowvar=0,bias=0) #分散共分散行列処理 self.e_values,self.e_vecs=np.linalg.eig(data_cov) #固有値と固有ベクトルの算出 self.explained_variance_ratio_= self.e_values/self.e_values.sum() #寄与率の計算 def transform(self,dfs): #pandasデータでもnumpyデータでも使えるようにするための処理 if(type(dfs)==type(pd.DataFrame())): all_data = dfs.values else: all_data=dfs feature = [] for e_vec in self.e_vecs.T: temp_feature=[] for data in all_data: temp_feature.append(np.dot(e_vec,data)) #内積計算 feature.append(temp_feature) return np.array(feature).Tそして結果です。

PC1 PC2 PC3 PC4 PC5 0 2.161412 -0.414977 -0.075496 -7.771561e-16 0.073419 1 2.601987 0.364980 0.088599 1.665335e-15 -0.064849 2 -1.479995 0.437661 -0.290635 -4.996004e-16 0.037986 3 -1.727683 0.047103 0.382252 -5.551115e-16 0.035840 4 -1.555721 -0.434767 -0.104720 0.000000e+00 -0.082396 Attribute Qt::AA_EnableHighDpiScaling must be set before QCoreApplication is created. 0 PC1 9.518791e-01 PC2 3.441020e-02 PC3 1.275504e-02 PC4 2.659136e-17 PC5 9.556157e-04このようになりました。

おそらく固有ベクトルが反転してしまったため正負逆転してしまっているところもありますが、同じような解析結果が出せたかと思います。終わりに

今回は主成分分析の理論について個人的備忘録も兼ねて書いて見ました。

証明をところどころ挟んだので読みにくい記事になってしまった感が否めないのですが、私のような人は細かいところが気になって進めないこともあるかと考えできるだけ証明しました。今回取り上げた主成分分析はscikit-learnで簡単に使えてしまうので中身をあまり理解せず使うのが気持ち悪く感じていたので今回一応理解ができた気がするのでスッキリしました。

ただ、scikit-learnでの実装をのぞいて見たところ特異値分解によって実装しているようです。

ただ対称行列の場合は固有値分解と特異値分解の結果は同じになるようなので、今回のような分散共分散行列や相関行列に適用するときはどちらでもいいのかと感じました。

もし機会があれば一般化以外で特異値分解を使う利点も調べて見たいと思います。参考文献

[1]http://ibis.t.u-tokyo.ac.jp/suzuki/lecture/2015/dataanalysis/L7.pdf データ解析 第七回「主成分分析」

[2]https://seetheworld1992.hatenablog.com/entry/2017/03/17/104807 分散共分散行列(と相関行列)は半正定値であることを証明する

- 投稿日:2020-11-12T22:24:53+09:00

ベルマーク教育助成財団の週別ベルマーク受付状況のPDFから都道府県別・市区町村別に集計する

はじめに

ベルマーク教育助成財団の週別ベルマーク受付状況のPDFから都道府県別・市区町村別に集計しました

現在はウェブベルマークというのも始まっていてウェブベルマークサイトからお好きなショップにアクセスお買い物に応じてベルマークポイントがたまります

じゃらんや楽天トラベルなども利用可能なのでGo To トラベルを申し込む前にご利用するだけで、自己負担なく支援できます。

※要事前登録

説明

こちらの処理はX座標、Y座標のlimitの範囲にあるのもを多い座標の位置に集約しています

文字数が多く2段になっているものや、多少ずれているところを調整していますdef snap_adjustment(s, limit=5): count = s.value_counts().sort_index() index = 0 value = 0 for i, v in count.items(): if (i - index) < limit: if v > value: s = s.replace(index, i) index = i value = v else: s = s.replace(i, index) else: index = i value = v return sプログラム

import pathlib import time import pandas as pd import pdfplumber import requests from bs4 import BeautifulSoup def fetch_file(url, dir="."): r = requests.get(url) r.raise_for_status() p = pathlib.Path(dir, pathlib.PurePath(url).name) p.parent.mkdir(parents=True, exist_ok=True) with p.open(mode="wb") as fw: fw.write(r.content) return p def snap_adjustment(s, limit=5): count = s.value_counts().sort_index() index = 0 value = 0 for i, v in count.items(): if (i - index) < limit: if v > value: s = s.replace(index, i) index = i value = v else: s = s.replace(i, index) else: index = i value = v return s url = "https://www.bellmark.or.jp/collect/accept.htm" headers = { "User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64; Trident/7.0; rv:11.0) like Gecko" } r = requests.get(url, headers=headers) r.raise_for_status() soup = BeautifulSoup(r.content, "html.parser") links = { href.get("href") for href in soup.select("div.cal-process > div.cal-row-date > div > a") } dfs = [] for link in links: p = fetch_file(link) with pdfplumber.open(p) as pdf: for page in pdf.pages: crop = page.within_bbox((0, 65, page.width, page.height - 40)) df_tmp = ( pd.DataFrame(crop.extract_words(keep_blank_chars=True)) .astype({"x0": float, "x1": float, "top": float, "bottom": float}) .sort_values(["top", "x0"]) ) df_tmp["top"] = snap_adjustment(df_tmp["top"], 6) df_tmp["x0"] = snap_adjustment(df_tmp["x0"]) table = ( df_tmp.pivot_table( index=["top"], columns="x0", values="text", aggfunc=lambda x: "".join(str(v) for v in x), ) ).values df = pd.DataFrame(table, columns=["都道府県", "市", "区町村", "参加団体", "受付日"]) dfs.append(df) time.sleep(3) df = pd.concat(dfs) df df["市区町村"] = df["市"].fillna("") + df["区町村"].fillna("") df1 = df.reindex(columns=["都道府県", "市区町村", "参加団体", "受付日"]) df1.to_csv("data.csv") df1都道府県別

import japanize_matplotlib import matplotlib as mpl import matplotlib.pyplot as plt mpl.rcParams["figure.dpi"] = 200 df1["都道府県"].value_counts(ascending=True).plot.barh(figsize=(5, 10)) # グラフを保存 plt.savefig("01.png", dpi=200, bbox_inches="tight") plt.show()市区町村別

s = df1.groupby(["都道府県", "市区町村"])["市区町村"].count().sort_values(ascending=True) s.tail(50).plot.barh(figsize=(5, 10)) # グラフを保存 plt.savefig("02.png", dpi=200, bbox_inches="tight") plt.show()

- 投稿日:2020-11-12T22:23:39+09:00

gdal_mergeで巨大ファイルが生成されるときの対処法

gdal_mergeで巨大なファイルが生成されてしまう...

tifデータなどを扱うgdalモジュール.

gdal_merge.pyはそのモジュール内にある、tifデータを位置情報に基づいて結合するスクリプト.ドキュメント内のスクリプト(以下)を実行したところ...

python gdal_merge.py -init 255 -o out.tif in1.tif in2.tif150MB程度のファイルを2つ結合しただけなのに、30GBを超える超巨大ファイルが生成された

(GとMをFinderが間違えているのではと何回も見返しました)解消法

tifファイルは基本的に圧縮されているものらしく、先ほどのスクリプトに圧縮方法を表すタグをつけると圧縮してくれるらしい.

値がない部分などを圧縮するため、離れた地点の画像を合成すると大きなファイルになるらしい.python gdal_merge.py -init 255 -o out.tif in1.tif in2.tif -co COMPRESS=DEFLATEこれで150MB程度の合成されたファイルが生成されました.

ちなみに圧縮率は多少少なくなるもののファイル互換性が高い圧縮方法などもあるそう

python gdal_merge.py -init 255 -o out.tif in1.tif in2.tif -co -co COMPRESS=LZW

- 投稿日:2020-11-12T20:55:26+09:00

keyhac で画面3分割

Windows には、 Win キーと矢印キーの同時押しで画面を左右2分割(上下も含めると4分割)できる「スナップ機能」があります。今回は keyhac でこの機能を拡張し、1:2 の比率でもスナップできるようにしてみます。

ウィンドウを並べて閲覧したいけれど半分だと小さすぎるし、かといって手で都度リサイズするのも煩わしい……などとお悩みの方にオススメです。

コード

config.pyの関数configureの中身を書いていきます。

※今回は最低限の部分のみ記述しています。基本的な設定等は 以前の記事 参照。def configure(keymap): keymap.replaceKey("(28)", 236) # 変換キーに仮想コード236を割り当て keymap.defineModifier(236, "User1") # 変換キーを仮想修飾キー "U1" として使う def triple_snap(position = "center", Narrow = False): main_monitor_info = (pyauto.Window.getMonitorInfo())[0] non_taskbar_area = main_monitor_info[1] [monitor_left, monitor_top, monitor_right,monitor_bottom] = non_taskbar_area monitor_width = monitor_right - monitor_left ratio = 3 if Narrow: wnd_width = int(monitor_width / ratio) wnd_pos_table = { "center": { "left": wnd_width, "right": wnd_width * 2, }, "left": { "left": monitor_left, "right": wnd_width, }, "right": { "left": wnd_width * 2, "right": monitor_right, }, } else: wnd_width = int(monitor_width / ratio) * 2 wnd_pos_table = { "center": { "left": int(monitor_width / ratio / 2), "right": int(monitor_width / ratio / 2) + wnd_width, }, "left": { "left": monitor_left, "right": wnd_width, }, "right": { "left": int(monitor_width / ratio), "right": monitor_right, }, } wnd_area = wnd_pos_table[position] rect = [wnd_area["left"], monitor_top, wnd_area["right"], monitor_bottom] wnd = keymap.getTopLevelWindow() if list(wnd.getRect()) == rect: wnd.maximize() else: if wnd.isMaximized(): wnd.restore() wnd.setRect(rect) for k in [ ("U1-M" , lambda: triple_snap("center", False)), ("S-U1-H", lambda: triple_snap("left" , False)), ("S-U1-L", lambda: triple_snap("right" , False)), ("C-U1-H", lambda: triple_snap("left" , True)), ("C-U1-L", lambda: triple_snap("right" , True)), ("C-U1-M", lambda: triple_snap("center", True)), ("U1-H" , "Win-Left"), ("U1-L" , "Win-Right"), ]: keymap_global[k[0]] = k[1]実行イメージ

変換キーと M で画面中央部にモニタ幅の 2/3 でウィンドウを持ってきます。もう一度同じキーを押すと最大化します。

変換キーと H・L には通常の左右スナップを割り当てて、 Shift を押していると 2/3 、 Ctrl を押していると 1/3 幅でスナップします。

(そもそもマルチモニタにできれば万事解決なんですけどね)

- 投稿日:2020-11-12T20:23:08+09:00

PythonのSeleniumでよく使うであろう備忘録

参考URL

タイトル URL Selenium for Python Elementにフォーカスを当てる https://qiita.com/BlueSilverCat/items/e1dc9ec65f235a7fff01 【Python】SeleniumでHeadless Chromeを使おう https://qiita.com/derodero24/items/9e9567790bde9e4b9d0c

- 投稿日:2020-11-12T19:12:44+09:00

[Blender×Python] 回転をマスターしよう!!

目次

0.立方体を回転させよう

1.トーラスを回転させよう

2.サンプルコード

3.英単語まとめ0.立方体を回転させよう

0-0.1つの立方体を回転させよう

◯1番シンプルな回転の方法です。

import bpy #計算に必要なものがいろいろ入ってる import math #立方体を追加する関数 bpy.ops.mesh.primitive_cube_add( scale=(1, 1, 1), #引数の追加 #math.piは180度のことなので math.pi * 1/6 = 30(度) #X軸を中心に30度回転させる rotation = (math.pi*1/6,0,0) )0-1.立方体を回転させて並べよう

◯少しずつずらして配置していきます。

import bpy import math #100回反復処理をする for i in range(0,100): bpy.ops.mesh.primitive_cube_add( #少しずつ上にずらす location=(0, 0, i/50), scale=(1, 1, 0.05), #180 * i * 36(度)ずつずらしていく rotation = (0, 0, math.pi*i*10/360) )

0-2.色をつけてみよう

◯上記のコードの応用です。

import bpy import math #materialという変数を自分でつくる(materialは素材という意味) material = bpy.data.materials.new('Red') #色を定義する(R,G,B,A) material.diffuse_color = (1.0, 0.0, 0.0, 1.0) #100回繰り返す for i in range(0,100): bpy.ops.mesh.primitive_cube_add( #すこしずつ上にずらす location=(0, 0, i/50), scale=(1, 1, 0.05), #少しずつ回転させる rotation = (0, 0, math.pi*i*10/360) ) #オブジェクトに自分で定義した色を追加する(appendは追加という意味) bpy.context.object.data.materials.append(material)

1.トーラスを回転させよう

1-0.トーラスを変形させよう

import bpy #トーラスを追加する関数 bpy.ops.mesh.primitive_torus_add( location=(0, 0, 0), major_radius=1.0, minor_radius=0.01, rotation=(0, 0, 0) ) #Y軸方向に縮める bpy.ops.transform.resize(value=(1, 0.3, 1))

1-0.トーラスを回転させて並べよう

◯形を作った後に回転させる方法です。

import bpy import math for i in range(0,36): bpy.ops.mesh.primitive_torus_add( location=(0, 0, 0), major_radius=1.0, minor_radius=0.01, ) #Y軸方向に縮める bpy.ops.transform.resize(value=(1, 0.3, 1)) #Z軸を中心に回転する bpy.ops.transform.rotate(value=math.pi*i*10/360,orient_axis='Z')1-2.トーラスに色をつけよう

◯1つの軸を中心に回転させた後に、別の軸を中心に回転させています。

import bpy import math #材質の定義 material = bpy.data.materials.new('Red') material.diffuse_color = (1.0, 0.0, 0.0, 1.0) for i in range(0,36): for j in range(0,36): bpy.ops.mesh.primitive_torus_add( location=(0, 0, 0), major_radius=1.0, minor_radius=0.01, ) #Y軸方向に縮める bpy.ops.transform.resize(value=(1, 0.3, 1)) #Z軸を中心に回転させる bpy.ops.transform.rotate(value=math.pi*j*10/360,orient_axis='Z') #Y軸を中心に回転させる bpy.ops.transform.rotate(value=math.pi*i*10/360,orient_axis='Y') #自分で定義した赤色を使う bpy.context.object.data.materials.append(material)2.サンプルコード

立方体を回転させるコード

import bpy #計算に必要なものがいろいろ入ってる import math #立方体を追加する関数 bpy.ops.mesh.primitive_cube_add( scale=(1, 1, 1), #引数の追加 #math.piは180度のことなので math.pi * 1/6 = 30(度) #X軸を中心に30度回転させる rotation = (math.pi*1/6,0,0) )立方体を回転させて並べていくコード

import bpy import math #100回反復処理をする for i in range(0,100): bpy.ops.mesh.primitive_cube_add( #少しずつ上にずらす location=(0, 0, i/50), scale=(1, 1, 0.05), #180 * i * 36(度)ずつずらしていく rotation = (0, 0, math.pi*i*10/360) )並べた立方体に色をつけるコード

import bpy import math #materialという変数を自分でつくる(materialは素材という意味) material = bpy.data.materials.new('Red') #色を定義する(R,G,B,A) material.diffuse_color = (1.0, 0.0, 0.0, 1.0) #100回繰り返す for i in range(0,100): bpy.ops.mesh.primitive_cube_add( #すこしずつ上にずらす location=(0, 0, i/50), scale=(1, 1, 0.05), #少しずつ回転させる rotation = (0, 0, math.pi*i*10/360) ) #オブジェクトに自分で定義した色を追加する(appendは追加という意味) bpy.context.object.data.materials.append(material)トーラスを変形させるコード

import bpy #トーラスを追加する関数 bpy.ops.mesh.primitive_torus_add( location=(0, 0, 0), major_radius=1.0, minor_radius=0.01, rotation=(0, 0, 0) ) #Y軸方向に縮める bpy.ops.transform.resize(value=(1, 0.3, 1))トーラスを回転させて並べるコード

import bpy import math for i in range(0,36): bpy.ops.mesh.primitive_torus_add( location=(0, 0, 0), major_radius=1.0, minor_radius=0.01, ) #Y軸方向に縮める bpy.ops.transform.resize(value=(1, 0.3, 1)) #Z軸を中心に回転する bpy.ops.transform.rotate(value=math.pi*i*10/360,orient_axis='Z')トーラスに色をつけて、2つの軸を中心に回転させるコード

import bpy import math #材質の定義 material = bpy.data.materials.new('Red') material.diffuse_color = (1.0, 0.0, 0.0, 1.0) for i in range(0,36): for j in range(0,36): bpy.ops.mesh.primitive_torus_add( location=(0, 0, 0), major_radius=1.0, minor_radius=0.01, ) #Y軸方向に縮める bpy.ops.transform.resize(value=(1, 0.3, 1)) #Z軸を中心に回転させる bpy.ops.transform.rotate(value=math.pi*j*10/360,orient_axis='Z') #Y軸を中心に回転させる bpy.ops.transform.rotate(value=math.pi*i*10/360,orient_axis='Y') #自分で定義した赤色を使う bpy.context.object.data.materials.append(material)3.英単語まとめ

英単語 日本語訳 import 輸入する/手に入れる math 数学 mesh 頂点、辺、面の集合 scale 大きさ primitive 原始的な add 追加する rotation 回転 pi π( = 180度) range 幅 cube 立方体 material 素材 diffuse 拡散、散乱 context 文脈、環境 object もの、物体 data 情報 append 加える、追加する major 大きな minor 小さな radius 半径 transform 変換 resize 大きさの変更 axis 軸 orient 方向 rotate 回転する rotation 回転 value 値 location 位置、座標 operation 運用、操作

- 投稿日:2020-11-12T18:59:03+09:00

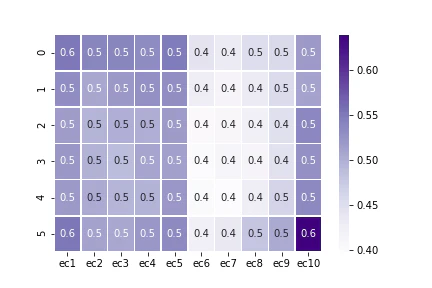

seabornでheatmap描いてみた�【Python】

実験データを使ってヒートマップを描く練習してみました。

matplotlib,seaborn,pandasのインポート

%matplotlib inline

import matplotlib.pyplot as plt

import pandas as pd

import seaborn as sns

上記コードで準備完了。データの読み込み

ec_am = pd.read_csv('./ec_am.csv')

データは6行10列

ヒートマップの作成

まずは何も条件指定しないでやってみる。

heatmap1 = sns.heatmap(ec_am)

plt.savefig("heatmap1.png")

plt.savefig("heatmap1.png")で図をheatmap1という名前のpng形式で保存。 保存先は開いてるjupyter notebookと同じファイル。次にいろんな条件を試してみる。

heatmap2 = sns.heatmap(ec_am, yticklabels=False, cbar=False)

plt.savefig("heatmap2.png")

yticklabelsでY軸ラベルの指定。cbarでカラーバーを指定。Falseだと無くなる。

heatmap3 = sns.heatmap(ec_am, cmap="Wistia", annot=True, fmt="1.2f")

plt.savefig("heatmap3.png")

cmapで色を指定。annotでデータの数値を表示。fmt="1.xf"(xには正の整数)で小数点第x位まで表示。

色の種類はbeizのノートを参照。

heatmap4 = sns.heatmap(ec_am, cmap="Purples", annot=True, fmt="1.1f", linewidths=.5)

plt.savefig("heatmap4.png")

linewidthsでセルの間に線を描く(この場合太さ0.5)。

- 投稿日:2020-11-12T18:19:47+09:00

「伸び悩んでいる3年目Webエンジニアのための、Python Webアプリケーション自作入門」を更新しました

本を更新しました

チャプター「複数回のHTTPリクエストに繰り返し応答できるようにする」 を更新しました。

続きを読みたい方は、ぜひBookの「いいね」か「筆者フォロー」をお願いします ;-)

以下、書籍の内容の抜粋です。

Webサーバーがリクエストを1回だけしか処理できない問題

そろそろこの問題に対処しましょう。

皆さんにこれまで作ってもらったWebサーバーは、一回のHTTPリクエストを処理するとすぐに終了してしまいます。

そのため、繰り返しリクエストに応答しようと思うと毎回サーバーを起動しなおさなければいけません。

開発中に動作確認のたびにサーバーを起動するのがめんどくさいというのもありますが、一般的なWebページを正常に表示する上でも問題があります。

HTMLから外部ファイルの参照ができない

例えば、前章で作ってもらった

index.htmlを下記のように変更してみてください。

study/static/index.html<!doctype html> <html lang="ja"> <head> <meta charset="UTF-8"> <title>HenaServer</title> <link rel="stylesheet" href="index.css"> </head> <body> <img alt="logo" src="logo.png"> <h1>Welcome to HenaServer!</h1> </body> </html>6行目:

<link rel="stylesheet" href="index.css">

10行目:<img alt="logo" src="logo.png">を追加しました。

よくある外部CSSファイルの読み込みと、画像ファイルの読み込みです。

次に、読み込もうとしているファイルを、同じディレクトリ内に新しく用意します。

CSSファイルの内容は下記のようにしています。

study/static/index.cssh1 { color: red; }画像ファイルはこちらです。

study/static/logo.png

https://github.com/bigen1925/introduction-to-web-application-with-python/blob/main/codes/chapter12/static/logo.png画像ファイルは何でも良いのですが、本書では「いらすとや」^[https://www.irasutoya.com/] から拝借しています。お好きな画像を使っていただいて構いません。

見ていただければ分かるように、通常のWebページであればChromeにはロゴ画像が表示され、文字にはCSSが適用されて赤色に表示されるはずです。

では、サーバーを起動してChromeで

http://localhost:8080/index.htmlへアクセスしてみましょう。これはよくないですね。

画像もCSSも読み込まれていません。

ブラウザはWebサーバーからレスポンスを受け取った際、レスポンスボディのHTML内に外部ファイル参照(

<img src="">、<script src="">、<link href="">など)が記載されていると、再度リクエストを送信しなおしてファイル内容を取得しようとします。しかし、私たちのWebサーバーは最初のリクエストを処理したあと、すぐにプログラムを終了させてしまうため、追加のリクエスト(今回でいうとCSSと画像のリクエスト)を処理できていないのです。

その様子を、もう少し具体的に見てみましょう。

ChromeにはHTTPリクエストの通信結果を詳細に見れる「開発者ツール」という機能が備わっています。

そちらを使って、実際に行われたリクエストの様子を確認していきます。さきほどChromeで

http://localhost:8080/index.htmlにアクセスした画面で、ctrl+shift+jを押してみましょう。

(または、画面を右クリックして検証を選択し、Consoleタブを開きます)図のように、既に

index.cssとlogo.pngを取得する際に、Webサーバーとのコネクションに失敗したことを示すエラーログが表示されています。(Chromeは他にも、特に指示がなくても勝手にファビコンの画像を取得しにくような仕様になっており、そちらのエラーも表示されていますが、本書では特に気にする必要はありません。)

次に、開発者ツールの

Networkタブを開き、サーバーを起動してからリロードしてみましょう。

(ネットワークタブは、開発者ツールを開いて以降の通信のみ情報を表示するため、リロードする必要があります)Chromeはこのページを表示するために、全部で4件の通信を行っていることが分かります。

(バージョンや環境によって内容は異なるかもしれません、)内訳を見てみると、

index.htmlを取得する通信は成功(statusが200)しており、index.cssとlogo.pngは通信に失敗(statusがfailed)していることが分かります。繰り返しリクエストを処理できるようにする

このままでは「ただ面倒くさい」だけではなく、CSSや画像、JSなどを使った普通のWebページ1つすら表示できないということが分かりました。

では、Webサーバーを改良して、これらの問題を解決していきましょう。

ソースコード

まずは、コネクションを確立してレスポンスを返す処理を無限ループに中に入れることで、繰り返しリクエストに対応できるようにします。

ソースコードがこちらです。

study/WebServer.py

https://github.com/bigen1925/introduction-to-web-application-with-python/blob/main/codes/chapter12/WebServer.py解説

30行目

while True:まず一番大きな変更点として、「クライアントからのコネクションを待つ」〜「コネクションを終了する」までの処理(31行目-97行目)をまるごと無限ループの中にいれたところです。

(無限ループの記法が分からない方は、「python while true」で調べてみてください。)たった1行ですが、これにより、1つのリクエストの処理が完了し、コネクションを終了させた後、ループの先頭にもどり再度リクエストを待機することになります。

次のリクエストの処理が完了すると、またループの先頭に戻り、次のリクエストを待ちます。つまり、プログラムを起動した人が明示的にプログラムを中断させるまで、無限にリクエストをさばき続けるプログラムになります。

89-97行目

except Exception: # リクエストの処理中に例外が発生した場合はコンソールにエラーログを出力し、 # 処理を続行する print("リクエストの処理中にエラーが発生しました。") traceback.print_exc() finally: # 例外が発生した場合も、発生しなかった場合も、TCP通信のcloseは行う client_socket.close()ついでに、例外処理を追加しておきました。

例外処理をしておかないとループの途中で例外が発生した場合にプログラム全体が停止してしまいますが、上記のようにハンドリングすることでその時扱っているリクエストの処理だけ中断させますが、プログラム全体は停止せずに次のループへ進むことになります。

また、

cient_socketのclose()はtry句の末尾でやるのではなく、finally句で行います。

try句の末尾でやってしまうと、途中で例外が発生した場合にコネクションの切断がスキップされてしまうためです。動かしてみる

では実際に動かしてみましょう。

いつもどおりコンソールからサーバーを起動します。

続きはBookで!

- 投稿日:2020-11-12T17:10:44+09:00

操作ログ整形ツールを作る 3日目

3日目

RuntimeError: The current Numpy installation (中略) fails to pass a sanity check due to a bug in the windows runtime. See this issue for more information: https://tinyurl.com/y3dm3h86の原因を探る。

for more information を見ると以下。

https://developercommunity.visualstudio.com/content/problem/1207405/fmod-after-an-update-to-windows-2004-is-causing-a.html

use numpy==1.19.3 works?https://qiita.com/bear_montblanc/items/b4b75dfd77da98076da5

ググったらまんまこれ

あまり根拠がわからず信じるのは何だがそのままやってみる

→エラーが消えた。えー。CSVのソートをしたい

https://note.nkmk.me/python-pandas-sort-values-sort-index/

に戻る。チュートリアル通りfirstpandas.pyimport pandas as pd df = pd.read_csv('sample_pandas_normal.csv', index_col=0) print(df)で、実行。

C:\workspaces\playground>firstpandas.py age state point name Alice 24 NY 64 Bob 42 CA 92 Charlie 18 CA 70 Dave 68 TX 70 Ellen 24 CA 88 Frank 30 NY 57おー、でた。これにソートを掛けてみる。こんなんでよいの?

firstpandas.pyimport pandas as pd df = pd.read_csv('sample_pandas_normal.csv', index_col=0) df.sort_values('age') print(df)結果、変わらない。いや感覚でやっちゃ良くない。。

まず公式ドキュメントはこの辺

https://pandas.pydata.org/pandas-docs/stable/reference/api/pandas.DataFrame.sort_values.htmlもう一度。

結論から書くと、これでイメージが付いた。firstpandas.pyimport pandas as pd df = pd.read_csv('sample_pandas_normal.csv') print(df) df_s = df.sort_values('age') print(df_s)C:\workspaces\playground>firstpandas.py name age state point 0 Alice 24 NY 64 1 Bob 42 CA 92 2 Charlie 18 CA 70 3 Dave 68 TX 70 4 Ellen 24 CA 88 5 Frank 30 NY 57 name age state point 2 Charlie 18 CA 70 0 Alice 24 NY 64 4 Ellen 24 CA 88 5 Frank 30 NY 57 1 Bob 42 CA 92 3 Dave 68 TX 70Pythonの文法からもっかいおさらいしたほうが良いね

Python3チートシート(基本編)

Pythonチートシート 基本要素編(@IT)

Pandas 公式チートシートを翻訳しました一旦ここまで。

日付でソートしてみる

さて用いるCSVをちょっと変えて、日付カラムを足した。

sample_pandas_date.csvname,age,state,point,birthday Alice,24,NY,64,1996/1/2 Bob,42,CA,92,1978/2/2 Charlie,18,CA,70,2002/3/4 Dave,68,TX,70,1952/1/1 Ellen,24,CA,88,1996/1/5 Frank,30,NY,57,1990/5/15firstpandas.pyimport pandas as pd df = pd.read_csv('sample_pandas_date.csv') print(df) df_s = df.sort_values('birthday') print(df_s)これでどうなるのかというと結果以下。

C:\workspaces\playground>firstpandas.py name age state point birthday 0 Alice 24 NY 64 1996/1/2 1 Bob 42 CA 92 1978/2/2 2 Charlie 18 CA 70 2002/3/4 3 Dave 68 TX 70 1952/1/1 4 Ellen 24 CA 88 1996/1/5 5 Frank 30 NY 57 1990/5/15 name age state point birthday 3 Dave 68 TX 70 1952/1/1 1 Bob 42 CA 92 1978/2/2 5 Frank 30 NY 57 1990/5/15 0 Alice 24 NY 64 1996/1/2 4 Ellen 24 CA 88 1996/1/5 2 Charlie 18 CA 70 2002/3/4それっぽくなってきた。

そろそろ本当の操作ログを用いてみよう。

と、実際のCSVを置いてみたらやっぱりエラーが出た。盛り上がってきたところで一旦ここまで。C:\workspaces\playground>firstpandas.py Traceback (most recent call last): File "C:\workspaces\playground\firstpandas.py", line 3, in <module> df = pd.read_csv('oplog20201112.csv') File "C:\Users\works\AppData\Local\Programs\Python\Python39\lib\site-packages\pandas\io\parsers.py", line 688, in read_csv return _read(filepath_or_buffer, kwds) File "C:\Users\works\AppData\Local\Programs\Python\Python39\lib\site-packages\pandas\io\parsers.py", line 454, in _read parser = TextFileReader(fp_or_buf, **kwds) File "C:\Users\works\AppData\Local\Programs\Python\Python39\lib\site-packages\pandas\io\parsers.py", line 948, in __init__ self._make_engine(self.engine) File "C:\Users\works\AppData\Local\Programs\Python\Python39\lib\site-packages\pandas\io\parsers.py", line 1180, in _make_engine self._engine = CParserWrapper(self.f, **self.options) File "C:\Users\works\AppData\Local\Programs\Python\Python39\lib\site-packages\pandas\io\parsers.py", line 2010, in __init__ self._reader = parsers.TextReader(src, **kwds) File "pandas\_libs\parsers.pyx", line 537, in pandas._libs.parsers.TextReader.__cinit__ File "pandas\_libs\parsers.pyx", line 740, in pandas._libs.parsers.TextReader._get_header UnicodeDecodeError: 'utf-8' codec can't decode byte 0x83 in position 0: invalid start byte

- 投稿日:2020-11-12T16:34:38+09:00

DTMの標高値をグラフで表示してみた

DTMとは

Digital Terrain Mapの略。今回は火星探査機MROに搭載されたHiRISEというカメラが取得したDEMデータを使う。

HiRISEとは

MROの搭載カメラの一つ。めちゃくちゃ高解像度。

上の画像もその一つらしい。(これは擬似カラー画像)手順

ダウンロード:HiRISE アーカイブサイト

ESPとかPSPとかはカメラが画像を取得した時のmodeになっている。(どれでもいい)今回はPythonで読んでいきます。

適当にgdalとか使って読み込んでください。(飛ばします。)dtm.pyxx=int(len(data_array))+1 yy=int(len(data_array[0]))+1 data_array = np.where(data_array<=-8000, data_array*(-0.0), data_array) x = np.arange(0, xx-1, 1) y = np.arange(0, yy-1, 1) Z = data_array Y, X = np.meshgrid(y, x) fig = plt.figure() ax = Axes3D(fig) ax.plot_wireframe(X, Y, Z) plt.show()雑な直貼り。

配列の長さ出して。-8000以下の標高はありえないから...それを使う。無効値をとりあえず0。max, minを特定。メッシュでプロット。

ちなみに、値とかみていくのにコメントアウト含めると270行もあった。中身こんなに薄いのに...とりあえず、こんな感じでやると

見にくい!

まとめ

表示はできたから綺麗にしようかな...

これ何に使うのかはわかりませんw

何かしらには使えるかな...綺麗にすれば!以上!雑多なまとめでした!

以降も何かしら面白いことや研究の延長戦でやったことなどをまとめてみます。

研究も就活もやらなくては...ゲームもしたいんだけどなぁ...

- 投稿日:2020-11-12T16:29:52+09:00

PythonでNetCDF形式のデータを扱う

環境

Ubuntu18.04LTS

Python3環境構築

Python3でNetCDF形式のファイルを使用するためにはNetCDF4モジュールが必要。

このモジュールはpip3で簡単にインストールできた。PythonでNetCDFファイルのI/O

以下は緯度、経度、時間の三次元変数T2が格納されたNetCDFファイルを開いて、新たにtest_ncout.ncというファイルを作成するプログラム。

#coding: utf-8 # This is a sample program to read and write s netCDF file with Python3 from netCDF4 import Dataset import numpy as np #*~*~*~*~*~*~*~*~*~*~*~*~*~*~* #read netCDF file #*~*~*~*~*~*~*~*~*~*~*~*~*~*~* #open a netCDF file to read ifile = "test.nc" ncin = Dataset(ifile, 'r') #check #print(ncin.file_format) #get variables #print(ncin.variables.keys()) #get axis data tin = ncin.variables['time'] latin = ncin.variables['lat'] lonin = ncin.variables['lon'] #get length of axis data ntime = len(tin) nlat = len(latin) nlon = len(lonin) #check axis #print(tim[:]) #print(latin[:]) #print(lonin[:]) #read data vin = ncin.variables['T2'] #check data #print(vin[:,:,:,:]) #*~*~*~*~*~*~*~*~*~*~*~*~*~*~* #write netCDF file #*~*~*~*~*~*~*~*~*~*~*~*~*~*~* #open a netCDF file to write ncout = Dataset('test_ncout.nc', 'w', format="NETCDF4") #check file format #print(ncout.file_format) #define axix size ncout.createDimension('time',ntime) ncout.createDimension('lat', nlat) ncout.createDimension('lon', nlon) #create time axis time = ncout.createVariable('time', np.dtype('f4').char, ('time')) time.long_name = 'time' time.units = 'months since 1850-1-1' time.axis = 'T' #create lat axis lat = ncout.createVariable('lat', np.dtype('f4').char, ('lat')) lat.long_name = 'latitude' lat.units ='degrees_north' lat.axis = 'Y' #create lon axis lon = ncout.createVariable('lon', np.dtype('f8').char, ('lon')) lon.long_name = 'longitude' lon.units = 'degrees_east' lon.axis = 'X' #create variable arry vout = ncout.createVariable('T2', np.dtype('f4').char, ('time', 'lat', 'lon')) vout.long_name = '2m temperature' vout.units = 'K' #copy axis from original data time[:] = tin[:] lon[:] = lonin[:] lat[:] = latin[:] vout[:] = vin[:] ncin.close() ncout.close()リファレンス

http://unidata.github.io/netcdf4-python/

https://github.com/Unidata/netcdf4-python

- 投稿日:2020-11-12T15:47:09+09:00

PySpark チートシート【Python】

はじめに

この記事は、PySpark 3.0.1 documentation の内容をベースとしています。

簡単に呼び出すことが可能な関数の動きを知っておくことで、より迅速に実装の方針を立てることができるかと思います。

Introduction

JupyterLab PySpark Kernel

先ずは GCP の Dataproc を利用して PySpark を動かす環境を作ります。

gcloud dataproc clusters create <cluster name> --enable-component-gateway --region <region> --zone <zone> \ --master-machine-type n1-standard-2 --master-boot-disk-size 500 --num-workers 2 \ --worker-machine-type n1-standard-2 --worker-boot-disk-size 500 --image-version 1.4-debian10 --optional-components ANACONDA,JUPYTER \ --scopes https://www.googleapis.com/auth/cloud-platform,https://www.googleapis.com/auth/devstorage.full_control --project <project id>--enable-component-gateway を設定しているのでクラスタの UI から JupyterLab を選択できるようになっています。

データは kaggle の Titanic Data を用います。import library

import pandas as pd import numpy as np import sys import time from google.cloud import storage as gcs from io import BytesIO from fs_gcsfs import GCSFS from fs import open_fs import gcsfs import pyspark from pyspark.sql import SparkSession from pyspark.sql.types import * from pyspark.sql import Row ,functions as F from pyspark.sql import SQLContext from pyspark.sql.functions import UserDefinedFunction from pyspark.sql.functions import * from pyspark.sql.window import Windowsys.path >> ['/opt/conda/anaconda/lib/python36.zip', '/opt/conda/anaconda/lib/python3.6', '/opt/conda/anaconda/lib/python3.6/lib-dynload', '', '/opt/conda/anaconda/lib/python3.6/site-packages', '/usr/lib/spark/python', '/opt/conda/anaconda/lib/python3.6/site-packages/IPython/extensions', '/root/.ipython']gcsfs = GCSFS(bucket_name = <bucket_name>) gcsfs.tree() >> |-- .ipynb_checkpoints | -- error (resource '/.ipynb_checkpoints' not found) |-- google-cloud-dataproc-metainfo | -- error (resource '/google-cloud-dataproc-metainfo' not found) |-- notebooks | -- jupyter | -- Untitled.ipynb -- titanic_data.csvload CSV data (as Pandas DataFrame) from Cloud Storage

bucket_name = "<bucket_name>" file_name = "titanic_data.csv" project_id = "<project_id>"# with Pandas titanic_data = pd.read_csv("<Cloud Storage Path>")# with gcsfs fs = gcsfs.GCSFileSystem(project = project_id) with fs.open('{}/titanic_data.csv'.format(bucket_name)) as file: titanic_data = pd.read_csv(file)# with gcs client = gcs.Client() bucket = client.get_bucket(bucket_name) blob = gcs.Blob(file_name, bucket) content = blob.download_as_string() titanic_data = pd.read_csv(BytesIO(content))write PySPark DataFrame (as Pandas DataFrame) to Cloud Storage

titanic_data.toPandas().to_csv('gs://pyspark_output/output.csv', header = True)Spark DataFrame

# spark = SparkSession.builder.appName("titanic_data_").getOrCreate() schema = StructType([ StructField("PassengerId", IntegerType(), True), StructField("Survived", IntegerType(), True), StructField("Pclass", IntegerType(), True), StructField("Name", StringType(), True), StructField("Sex", StringType(), True), StructField("Age", DoubleType(), True), StructField("SibSp", IntegerType(), True), StructField("Parch", IntegerType(), True), StructField("Ticket", StringType(), True), StructField("Fare", DoubleType(), True), StructField("Cabin", StringType(), True), StructField("Embarked", StringType(), True), ]) titanic_data = spark.read.format("com.databricks.spark.csv").options(header = "true").load("gs://{}/titanic_data.csv".format(bucket_name), schema = schema) # titanic_data = spark.read.format("com.databricks.spark.csv").option("header", "true").load("gs://{}/titanic_data.csv".format(bucket_name), schema = schema) titanic_data.show(5) >> +-----------+--------+------+--------------------+------+---+-----+-----+----------------+-------+-----+--------+ |PassengerId|Survived|Pclass| Name| Sex|Age|SibSp|Parch| Ticket| Fare|Cabin|Embarked| +-----------+--------+------+--------------------+------+---+-----+-----+----------------+-------+-----+--------+ | 1| 0| 3|Braund, Mr. Owen ...| male| 22| 1| 0| A/5 21171| 7.25| null| S| | 2| 1| 1|Cumings, Mrs. Joh...|female| 38| 1| 0| PC 17599|71.2833| C85| C| | 3| 1| 3|Heikkinen, Miss. ...|female| 26| 0| 0|STON/O2. 3101282| 7.925| null| S| | 4| 1| 1|Futrelle, Mrs. Ja...|female| 35| 1| 0| 113803| 53.1| C123| S| | 5| 0| 3|Allen, Mr. Willia...| male| 35| 0| 0| 373450| 8.05| null| S| +-----------+--------+------+--------------------+------+---+-----+-----+----------------+-------+-----+--------+ only showing top 5 rowsEmbarked の欠損値を削除しておきます。

titanic_data = titanic_data.filter(F.col('Embarked').isNotNull()) titanic_data.filter(F.col('Embarked').isNull()).count() >> 0titanic_data >> DataFrame[PassengerId: int, Survived: int, Pclass: int, Name: string, Sex: string, Age: double, SibSp: int, Parch: int, Ticket: string, Fare: double, Cabin: string, Embarked: string, Embarked_labeled: string, Age_cat: string]titanic_data.count() >> 889titanic_data.printSchema() >> root |-- PassengerId: integer (nullable = true) |-- Survived: integer (nullable = true) |-- Pclass: integer (nullable = true) |-- Name: string (nullable = true) |-- Sex: string (nullable = true) |-- Age: double (nullable = true) |-- SibSp: integer (nullable = true) |-- Parch: integer (nullable = true) |-- Ticket: string (nullable = true) |-- Fare: double (nullable = true) |-- Cabin: string (nullable = true) |-- Embarked: string (nullable = true) |-- Embarked_labeled: string (nullable = true) |-- Age_cat: string (nullable = true)titanic_data.dtypes >> [('PassengerId', 'int'), ('Survived', 'int'), ('Pclass', 'int'), ('Name', 'string'), ('Sex', 'string'), ('Age', 'double'), ('SibSp', 'int'), ('Parch', 'int'), ('Ticket', 'string'), ('Fare', 'double'), ('Cabin', 'string'), ('Embarked', 'string'), ('Embarked_labeled', 'string'), ('Age_cat', 'string')]DataFrame ⇔ RDD

# DataFrame -> RDD titanic_data.rdd # DataFrame <- RDD spark.createDataFrame(titanic_data.rdd)SparkSQL

titanic_data.registerTempTable('titanic_data_table') spark.sql("select PassengerID, Embarked from titanic_data_table where Embarked = 'S' ").toPandas().iloc[0:5] >> PassengerID Embarked 0 1 S 1 3 S 2 4 S 3 5 S 4 7 S spark.sql("select age, \ case when age <= 12 then 'C' \ when age between 13 and 19 then 'T' \ when age between 20 and 25 then '1' \ when age between 26 and 34 then '2' \ when age between 35 and 49 then '3' \ when age >= 50 then '4' end as age_cat \ from titanic_data_table").toPandas().iloc[0:5] >> age age_cat 0 22 1 1 38 3 2 26 2 3 35 3 4 35 3Functions

Max / Min / Avg (or Mean) / Std / Sum / Count

titanic_data.agg({'Fare': 'max'}).collect() >> [Row(max(Fare)=512.3292)]Join

join(other, on=None, how=None)[source]

Joins with another DataFrame, using the given join expression.<Parameters>

other – Right side of the joinon – a string for the join column name, a list of column names, a join expression (Column), or a list of Columns. If on is a string or a list of strings indicating the name of the join column(s), the column(s) must exist on both sides, and this performs an equi-join.

how – str, default inner. Must be one of: inner, cross, outer, full, fullouter, full_outer, left, leftouter, left_outer, right, rightouter, right_outer, semi, leftsemi, left_semi, anti, leftanti and left_anti.

random_number_pddf = pd.DataFrame(np.random.randint(100, size = 889)[:, np.newaxis], columns = {'random_number'}) data_for_join_ = pd.concat([titanic_data_.PassengerId, random_number_pddf], axis = 1) data_for_join = spark.createDataFrame(data_for_join_) # how = 'inner' data_join = titanic_data.join(data_for_join, titanic_data.PassengerId == data_for_join.PassengerId, how = 'inner').drop(data_for_join.PassengerId) data_join.printSchema() >> root |-- PassengerId: integer (nullable = true) |-- Survived: integer (nullable = true) |-- Pclass: integer (nullable = true) |-- Name: string (nullable = true) |-- Sex: string (nullable = true) |-- Age: double (nullable = true) |-- SibSp: integer (nullable = true) |-- Parch: integer (nullable = true) |-- Ticket: string (nullable = true) |-- Fare: double (nullable = true) |-- Cabin: string (nullable = true) |-- Embarked: string (nullable = true) |-- Embarked_labeled: string (nullable = true) |-- Age_cat: string (nullable = true) |-- random_number: double (nullable = true)groupBy

time_ = time.time() titanic_data.groupby('Embarked', 'Survived').count().sort('count', ascending = False).show(5) time_ = time.time() - time_ >> +--------+--------+-----+ |Embarked|Survived|count| +--------+--------+-----+ | S| 0| 427| | S| 1| 217| | C| 1| 93| | C| 0| 75| | Q| 0| 47| +--------+--------+-----+ only showing top 5 rows np.round(time_, 3) >> 2.426time_ = time.time() spark.sql("select Embarked, Survived, \ count(*) as per_Embarked_cat \ from titanic_data_table \ group by Embarked, Survived order by per_Embarked_cat desc").show(5) time_ = time.time() - time_ >> +--------+--------+----------------+ |Embarked|Survived|per_Embarked_cat| +--------+--------+----------------+ | S| 0| 427| | S| 1| 217| | C| 1| 93| | C| 0| 75| | Q| 0| 47| +--------+--------+----------------+ only showing top 5 rows np.round(time_, 3) >> 1.794Drop

titanic_data.select('Pclass', 'Age', 'Name').drop('Name').show(5) >> +------+----+ |Pclass| Age| +------+----+ | 3|22.0| | 1|38.0| | 3|26.0| | 1|35.0| | 3|35.0| +------+----+ only showing top 5 rowsDuplicate

titanic_data.select('Pclass', 'Age', 'Name').show(10) >> +------+----+--------------------+ |Pclass| Age| Name| +------+----+--------------------+ | 3|22.0|Braund, Mr. Owen ...| | 1|38.0|Cumings, Mrs. Joh...| | 3|26.0|Heikkinen, Miss. ...| | 1|35.0|Futrelle, Mrs. Ja...| | 3|35.0|Allen, Mr. Willia...| | 3|null| Moran, Mr. James| | 1|54.0|McCarthy, Mr. Tim...| | 3| 2.0|Palsson, Master. ...| | 3|27.0|Johnson, Mrs. Osc...| | 2|14.0|Nasser, Mrs. Nich...| +------+----+--------------------+ only showing top 10 rows titanic_data.select('Name').distinct().count() >> 889 titanic_data.select('Name').count() >> 889 titanic_data.dropDuplicates(['Name']).select('Pclass', 'Age', 'Name').show(10) >> +------+----+--------------------+ |Pclass| Age| Name| +------+----+--------------------+ | 2|40.0|Watt, Mrs. James...| | 1|36.0|Young, Miss. Mari...| | 1|null|Parr, Mr. William...| | 3|19.0|Soholt, Mr. Peter...| | 3|31.0|Goldsmith, Mrs. F...| | 3|42.0| Dimic, Mr. Jovan| | 1|48.0|Harper, Mr. Henry...| | 1|38.0|Reuchlin, Jonkhee...| | 2|18.0|Fahlstrom, Mr. Ar...| | 2|42.0|Hosono, Mr. Masabumi| +------+----+--------------------+ only showing top 10 rows titanic_data.dropDuplicates(['Name']).select('Pclass', 'Age', 'Name').count() >> 889Explode / Split / Regexp Replace

explode: Returns a new row for each element in the given array or map. Uses the default column name col for elements in the array and key and value for elements in the map unless specified otherwise.

split: Splits str around matches of the given pattern.

regexp_replace: Replace all substrings of the specified string value that match regexp with rep.

titanic_data.select('name').show(5) >> +--------------------+ | name| +--------------------+ |Braund, Mr. Owen ...| |Cumings, Mrs. Joh...| |Heikkinen, Miss. ...| |Futrelle, Mrs. Ja...| |Allen, Mr. Willia...| +--------------------+ only showing top 5 rows titanic_data.withColumn('Name', explode(split(regexp_replace(F.col('name'), "(^\[)|(\]$)", ""), ", "))).select('name').show(5) >> +--------------------+ | name| +--------------------+ | Braund| | Mr. Owen Harris| | Cumings| |Mrs. John Bradley...| | Heikkinen| +--------------------+ only showing top 5 rowsWindow-function

以下では Window 関数を扱います。

from pyspark.sql.window import Window from pyspark.sql.functions import *Rank

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('rank', rank().over(window_)).select('Embarked', 'Fare', 'rank').show(5) >> +--------+------+----+ |Embarked| Fare|rank| +--------+------+----+ | Q| 6.75| 1| | Q| 6.75| 1| | Q|6.8583| 3| | Q| 6.95| 4| | Q|7.6292| 5| +--------+------+----+ only showing top 5 rowsPercent Rank

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('percent_rank', percent_rank().over(window_)).select('Embarked', 'Fare', F.round('percent_rank', 2).alias('percent_rank')).show(5) >> +--------+------+------------+ |Embarked| Fare|percent_rank| +--------+------+------------+ | Q| 6.75| 0.0| | Q| 6.75| 0.0| | Q|6.8583| 0.03| | Q| 6.95| 0.04| | Q|7.6292| 0.05| +--------+------+------------+ only showing top 5 rowsDense Rank

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('dense_rank', dense_rank().over(window_)).select('Embarked', 'Fare', 'dense_rank').show(5) >> +--------+------+----------+ |Embarked| Fare|dense_rank| +--------+------+----------+ | Q| 6.75| 1| | Q| 6.75| 1| | Q|6.8583| 2| | Q| 6.95| 3| | Q|7.6292| 4| +--------+------+----------+ only showing top 5 rowsRow Number

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('row_number', row_number().over(window_)).select('Embarked', 'Fare', 'row_number').show(5) >> +--------+------+----------+ |Embarked| Fare|row_number| +--------+------+----------+ | Q| 6.75| 1| | Q| 6.75| 2| | Q|6.8583| 3| | Q| 6.95| 4| | Q|7.6292| 5| +--------+------+----------+ only showing top 5 rowsCume Dist

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('cumulative_dist', cume_dist().over(window_)).select('Embarked', 'Fare', F.round('cumulative_dist', 2).alias('cumulative_dist')).show(10) >> +--------+------+---------------+ |Embarked| Fare|cumulative_dist| +--------+------+---------------+ | Q| 6.75| 0.03| | Q| 6.75| 0.03| | Q|6.8583| 0.04| | Q| 6.95| 0.05| | Q|7.6292| 0.06| | Q| 7.725| 0.08| | Q|7.7292| 0.09| | Q|7.7333| 0.14| | Q|7.7333| 0.14| | Q|7.7333| 0.14| +--------+------+---------------+ only showing top 10 rowsLead

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('lead', lead('Fare', 2).over(window_)).select('Embarked', 'Fare', 'lead').show(5) >> +--------+------+------+ |Embarked| Fare| lead| +--------+------+------+ | Q| 6.75|6.8583| | Q| 6.75| 6.95| | Q|6.8583|7.6292| | Q| 6.95| 7.725| | Q|7.6292|7.7292| +--------+------+------+ only showing top 5 rowsLag

window_ = Window.partitionBy('Embarked').orderBy('Fare') titanic_data.withColumn('lag', lag('Fare', 2).over(window_)).select('Embarked', 'Fare', 'lag').show(5) >> +--------+------+------+ |Embarked| Fare| lag| +--------+------+------+ | Q| 6.75| null| | Q| 6.75| null| | Q|6.8583| 6.75| | Q| 6.95| 6.75| | Q|7.6292|6.8583| +--------+------+------+ only showing top 5 rowsAggregate

window_ = Window.partitionBy('Embarked').orderBy('Fare') window_agg = Window.partitionBy('Embarked') titanic_data.withColumn('row', row_number().over(window_))\ .withColumn('avg', avg(F.col('Fare')).over(window_agg))\ .withColumn('max', max(F.col('Fare')).over(window_agg))\ .select('Embarked', 'row', 'avg', 'max').show(5) >> +--------+---+------------------+----+ |Embarked|row| avg| max| +--------+---+------------------+----+ | Q| 1|13.276029870129872|90.0| | Q| 2|13.276029870129872|90.0| | Q| 3|13.276029870129872|90.0| | Q| 4|13.276029870129872|90.0| | Q| 5|13.276029870129872|90.0| +--------+---+------------------+----+ only showing top 5 rowstitanic_data.withColumn('row', row_number().over(window_))\ .withColumn('avg', avg(F.col('Fare')).over(window_agg).alias('avg'))\ .withColumn('max', max(F.col('Fare')).over(window_agg)).where(F.col('row') == 1)\ .select('Embarked', F.round(F.col('avg'), 2).alias('Fare_avg'), F.round(F.col('max'), 2).alias('Fare_max'))\ .sort('Fare_avg', ascending = False).show() >> +--------+--------+--------+ |Embarked|Fare_avg|Fare_max| +--------+--------+--------+ | C| 59.95| 512.33| | S| 27.08| 263.0| | Q| 13.28| 90.0| +--------+--------+--------+UserDefinedFunction

UserDefinedFunction【PySpark】

# from pyspark.sql.functions import UserDefinedFunction # from pyspark.sql import SQLContext, Row # from pyspark.sql.types import * def LabelEncoder(x): if x == 'S': x_ = 0 elif x == 'C': x_ = 1 elif x == 'Q': x_ = 2 return x_ udf_label_Encoder = UserDefinedFunction(LabelEncoder) titanic_data.filter('Age > 12').withColumn('Embarked_labeld', udf_label_Encoder(F.col('Embarked'))).select('PassengerId', 'Embarked_labeld').show(5) # titanic_data.filter('Age > 12').withColumn('Embarked_labeld', udf_label_Encoder('Embarked')).select('PassengerId', 'Embarked_labeld').show(5) >> +-----------+--------------+ |PassengerId|Embarked_label| +-----------+--------------+ | 1| 0| | 2| 1| | 3| 0| | 4| 0| | 5| 0| +-----------+--------------+ only showing top 5 rowstitanic_data.select('PassengerId', udf_label_Encoder('Embarked').alias('Embarked_label')).filter('PassengerId >= 2').show(5) >> +-----------+--------------+ |PassengerId|Embarked_label| +-----------+--------------+ | 2| 1| | 3| 0| | 4| 0| | 5| 0| | 6| 2| +-----------+--------------+ only showing top 5 rows# from pyspark.sql.functions import when titanic_data.withColumn('Embarked', when(F.col('Embarked') == 'S', '0').when(F.col('Embarked') == 'C', '1').otherwise('3'))\ .withColumnRenamed('Embarked', 'Embarked_label').select('PassengerId', 'Embarked_label').filter('PassengerId >= 2').show(5) >> +-----------+--------------+ |PassengerId|Embarked_label| +-----------+--------------+ | 2| 1| | 3| 0| | 4| 0| | 5| 0| | 6| 2| +-----------+--------------+ only showing top 5 rowsUserDefinedFunction【SparkSQL】

タイムゾーンを変更しておくことで SaprkSQL により新しく作られた DataFrame に対して PySpark 関数を実行できるようになります。

spark.conf.set("spark.sql.session.timeZone", "Asia/Tokyo") titanic_data.registerTempTable('titanic_data_table') spark.udf.register('LabelEncoder_', LabelEncoder) spark.sql('''select PassengerId, LabelEncoder_(Embarked) as Embarked_labeled from titanic_data_table''').show(5) >> +-----------+--------------+ |PassengerId|Embarked_label| +-----------+--------------+ | 1| 0| | 2| 1| | 3| 0| | 4| 0| | 5| 0| +-----------+--------------+ only showing top 5 rowsまとめ

PySpark では豊富な関数が提供されています。

そのうちの幾つかをまとめてみました。参考 URL

- 投稿日:2020-11-12T14:22:20+09:00

Flask-sqlalchemyでマルチデータベースの使用

テーマ

Flask-sqlalchemyのSQLクエリで、マルチデータベースを呼び出すとエラーになる。

SQLクエリは、ClassifyMaster.query.all()を実施し、SQLALCHEMY_TRACK_MODIFICATIONS = Falseでログで出したものをコピペfrom flask import Flask from flask_sqlalchemy import SQLAlchemy app = Flask(__name__) db = SQLAlchemy(app) class Master(db.Model): id = db.Column(db.Integer, primary_key=True) title = db.Column(db.String) sql = db.Column(db.String(500)) class ClassifyMaster(db.Model): __tablename__ = "classify_master" __bind_key__ = "db_classify" #db.Column情報の設定 id = db.Column(db.Integer, primary_key=True) DB_MAIN = 'sqlite:///data.db' DB_CLASSIFY = 'sqlite:///classify/data.db' SQLALCHEMY_DATABASE_URI = DB_MAIN SQLALCHEMY_BINDS = { "db_classify" : DB_CLASSIFY} db.session.add(Master(title = '品種分類表', sql = """SELECT ClassifyMaster.id FROM ClassifyMaster""" ))エラー内容

バインド先のデータベースが見つからない

(Pdb) db.session.execute(text) INFO:sqlalchemy.engine.base.Engine:SELECT ClassifyMaster.id FROM ClassifyMaster INFO:sqlalchemy.engine.base.Engine:() *** sqlalchemy.exc.OperationalError: (sqlite3.OperationalError) no such table: ClassifyMaster [SQL: SELECT ClassifyMaster.id FROM ClassifyMaster] (Background on this error at: http://sqlalche.me/e/e3q8)どうやって調べていくのか?

丸一日かけてマルチデータベースについて調べるが、有力回答が得られず。

結局はSQLITEの使い方を調べまくり、ハンドで

ATTACH DATABASEをつけたら、クエリが動くことを確認した。

https://sqlite-r.com/attach_database(Pdb) db.session.execute(r"""ATTACH DATABASE 'classify\data.db' as x;""") (Pdb) db.session.execute('SELECT * FROM x.classify_master') INFO:sqlalchemy.engine.base.Engine:SELECT * FROM x.classify_master INFO:sqlalchemy.engine.base.Engine:() <sqlalchemy.engine.result.ResultProxy object at 0x000001F679DDA730>一応解決策は見出せたが、もっとスマートにできないかと調査しはじめる。

Flask-Sqlalchemyの分かったこと

ソース解析 → さすがスクリプト言語。

分かりやすい → 万歳!def get_tables_for_bind(self, bind=None): """Returns a list of all tables relevant for a bind.""" result = [] for table in itervalues(self.Model.metadata.tables): if table.info.get('bind_key') == bind: result.append(table) return result def get_binds(self, app=None): """Returns a dictionary with a table->engine mapping. This is suitable for use of sessionmaker(binds=db.get_binds(app)). """ app = self.get_app(app) binds = [None] + list(app.config.get('SQLALCHEMY_BINDS') or ()) retval = {} for bind in binds: engine = self.get_engine(app, bind) tables = self.get_tables_for_bind(bind) retval.update(dict((table, engine) for table in tables)) return retval def _execute_for_all_tables(self, app, bind, operation, skip_tables=False): app = self.get_app(app) if bind == '__all__': binds = [None] + list(app.config.get('SQLALCHEMY_BINDS') or ()) elif isinstance(bind, string_types) or bind is None: binds = [bind] else: binds = bind for bind in binds: extra = {} if not skip_tables: tables = self.get_tables_for_bind(bind) extra['tables'] = tables op = getattr(self.Model.metadata, operation) op(bind=self.get_engine(app, bind), **extra)テーブルの取り出し

そもそもbindって、Flask側で宣言してたやん

(sqlarchemy関係あらへん・・・)これが第一の勘違い

binds = [None] + list(app.config.get('SQLALCHEMY_BINDS') or ()) (Pdb) binds [None, 'db_classify']エンジンの取得

- 取得したbindsを引数に渡す

get_engine(app=None, bind=None) #Returns a specific engine.(Pdb) db.get_engine(app, binds[0]) Engine(sqlite:///C: .... data.db) (Pdb) db.get_engine(app, binds[1]) Engine(sqlite:///C: .... classify\data.db)おー、取れた取れた!

ついでにテーブルも

(Pdb) db.get_tables_for_bind(bind=binds[1]) [Table('classify_master', MetaData(bind=None), Column('id', Integer(), table=<classify_master>, primary_key=True, nullable=False))]ここの

<classify_master>になっている奴が、たぶんSqlAlchemyでバインドされるんやろ

ATTACH DATABASEで、適当なネームスペースにデータソースをくっ付けたら、ええんやな!

ということで、方針決まりさあ、コーディング開始!

まとめ

結局は、Flask-SqlalchemyはTEXT()をカバーしていなかったのか?

→ この件、ISSUEを挙げるべきなのか?いや、そもそも生クエリ嫌だからORMにしたんじゃねぇ?

って返されるかもしれないしかしながら、クエリを動的にデータベースに突っ込みたいというニーズもあり、

やはり生クエリでの処理は必須だと思われる。つづく

- 投稿日:2020-11-12T13:52:35+09:00

VSCodeで手軽にpythonを勉強したい人のための環境構築(for Mac)

はじめに

「さぁ、Pythonの勉強をしよう」

と、思い立って環境を作るところから始めようと調べ始めると、

「Homebrewが…」「Pathを確認して…」「デフォルトのバージョンが…」などと

初心者の心を折ろうとする分岐がいくつも存在すると感じるのは私だけでしょうか?色々やり方はあるかと思いますが、

私はシンプルにDockerとVisual Studio Code(以下、VSCode)の拡張機能を使って環境を作るのが

面倒なく楽なのではないかと感じましたので、それを記録として残しておきます。もっとオススメがあるよ、という方はコメントいただければ幸いです。

インストール

それぞれ公式サイトよりダウンロード、インストールします。

Dockerは仮想マシンを作ることが出来るサービスです。

こちらは初めて使用する際はアカウントを作る必要があります。VSCodeのインストールはこちらの記事がとてもわかり易いです。

MacOSでVisual Studio Codeをインストールする手順VSCodeに拡張機能を入れる

- VSCodeを開く。

- 拡張機能から

Remote - Containersをインストールする。ディレクトリとファイルを準備する

- 新しくフォルダを作成する

- .devcontainerという名前のフォルダを作る

- その中にdevcontainer.jsonというファイルを作る

1.のフォルダにはDockerfileとdocker-compose.yamlという2つのファイルを作成する各種設定ファイルを書く

1. Dockerfile

pythonのバージョンを3.9に指定しています。

VSCode内でソースコードを自動整形するためのautopep8と、

コード解析ツールのpylintも一緒に入れておきます。DockerfileFROM python:3.9 USER root RUN apt-get update && apt-get -y install locales git wget unzip vim && \ localedef -f UTF-8 -i ja_JP ja_JP.UTF-8 ENV LANG ja_JP.UTF-8 ENV LANGUAGE ja_JP:ja ENV LC_ALL ja_JP.UTF-8 ENV TZ JST-9 ENV TERM xterm ARG DEBIAN_FRONTEND=noninteractive RUN pip install -U pip && \ pip install -U autopep8 && \ pip install -U pylint VOLUME /root/2. docker-compose.yaml

後でVSCodeがこのファイルを見て

buildとup -dをしてくれます。docker-compose.yamlversion: "3.8" services: python3.9: build: context: . dockerfile: Dockerfile volumes: - .:/root/ working_dir: /root/ tty: true3. devcontainer.json

このファイルが無くても上記で出来る環境を使用できますが、

VSCodeから簡単に環境の中に入るにはこのファイルが必要です。(※このファイルは

.devcontainerフォルダの中に置いて下さい)

(Finderから隠しファイル表示を切り替えるにはcommand + shift + .(ピリオド)で可能)devcontainer.json{ "name": "Python3.9", "dockerComposeFile": [ "../docker-compose.yml" ], "service": "python3.9", "workspaceFolder": "/root/", "settings": { "terminal.integrated.shell.linux": null }, "extensions": [ "ms-ceintl.vscode-language-pack-ja", "ms-python.python", "oderwat.indent-rainbow", "almenon.arepl" ] }

extensionsには、以下の内容の拡張機能を自動でインストールするようにしています。

* VSCodeを日本語化する「Japanese Language Pack」

* Pythonのための「Python」

* インデントを見やすくする「indent-rainbow」

* リアルタイムでデバッグしてくれる「AREPL for python」

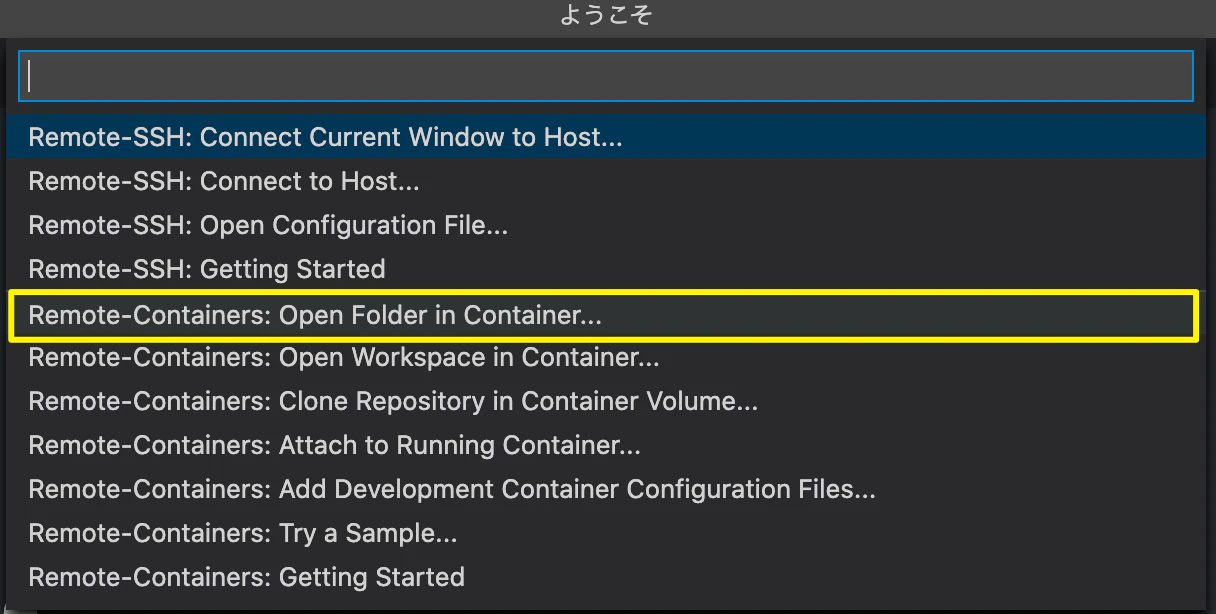

VSCodeから仮想環境を作成する

1. Remoteを開く

2. 「Open folder in Container」を選択する

3. 上記に自分で作成したフォルダを選択する

4. 仮想マシンの準備がはじまる

「show log」をクリックすると、実際にdocker-compose up -dなどコマンドが実行されている様子がみられるので、裏で何が行われているか確認したい方は見ると良いでしょう。うまく環境が構築されると、下記のような画面になります。

(私はテーマやアイコンの拡張なども入れているため、見た目は一部違うことがあります)

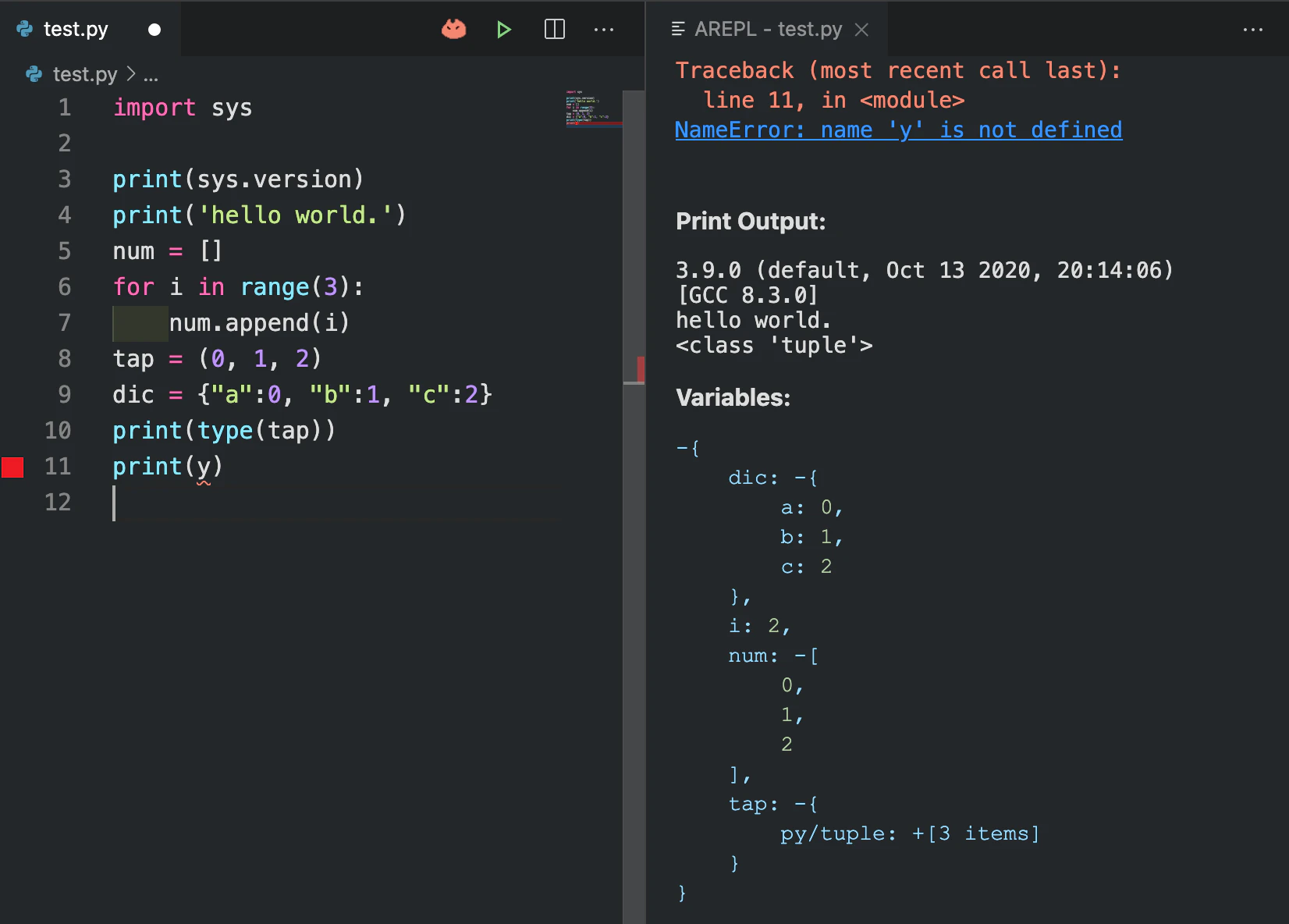

Pythonが無事動くか確認する

せっかく導入した拡張機能の

AREPLを併用して確認します。1.

.pyファイルを作ってAREPLを起動するここでは

test.pyという名前のファイルを作りました。

作ったら、画像のように猫みたいなアイコンをクリックします。

2. ソースコードを書いてみる

何でも良いので、ソースコードを書いてみましょう。

書いている間にリアルタイムで変数やprint文が表示されているのが確認できます。画像内ではわざと定義していない変数をprintしようとしています。

一応エディタで下線を引いて教えてくれている状態ですが、

AREPLの画面ですでにnot definedと教えてくれています。

注意点としては、あまり重たい処理にはAREPLは向かないです。

例えば上記for文のrangeが10000を超えてくると、当然ですがかなり反映が遅くなります。

その状態でrangeの数を減らしても、前の実行が終わらないと反映されません。本当に簡単な軽いプログラムで処理内容をできるだけすぐ見たい方におすすめですが、

そうではないなら、AREPLは使用しない方が良いかもしれませんね。3. 自動整形を使ってみる

option + shift + Fできれいに整えてくれます。4. プログラムを実行してみる

F5でプログラムが実行できます。

が、下記のように毎回デバッグの種類を聞かれて「Python File」を選択するのも面倒です。そこで、.vscodeという隠しフォルダに、

launch.jsonというデバッグの設定ファイルを作成します。

下記の表示から「launch.jsonファイルを作成します」を選択し、「Python File」を選択すれば、自動でそのファイルを作成してくれます。

今度こそ

F5を押すだけで、

下部のコンソール画面に実行結果が表示されます。

おわりに

VSCodeには他にも紹介しきれないくらいデバッグに便利な機能があります。

仮想環境には何をインストールしようが壊そうが、

実環境に影響なく、簡単に同じ環境を再生できるのが魅力的ですね。